Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

OpenAI stärkt das Sicherheitsteam und befähigt es, gegen gefährliche KI ein Veto einzulegen

OpenAI stärkt das Sicherheitsteam und befähigt es, gegen gefährliche KI ein Veto einzulegen

OpenAI stärkt das Sicherheitsteam und befähigt es, gegen gefährliche KI ein Veto einzulegen

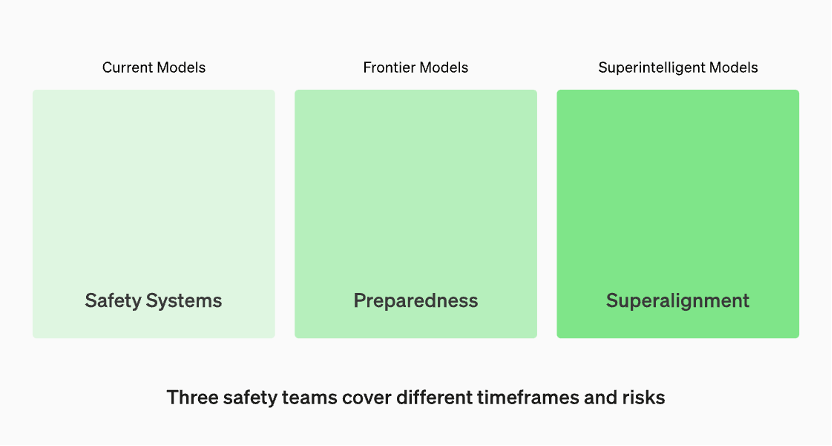

Modelle in Produktion werden vom Team „Sicherheitssysteme“ verwaltet. Spitzenmodelle in der Entwicklung verfügen über „Bereitschafts“-Teams, die Risiken identifizieren und quantifizieren, bevor das Modell veröffentlicht wird. Dann gibt es noch das „Super Alignment“-Team, das an theoretischen Leitlinien für „Super Intelligence“-Modelle arbeitet

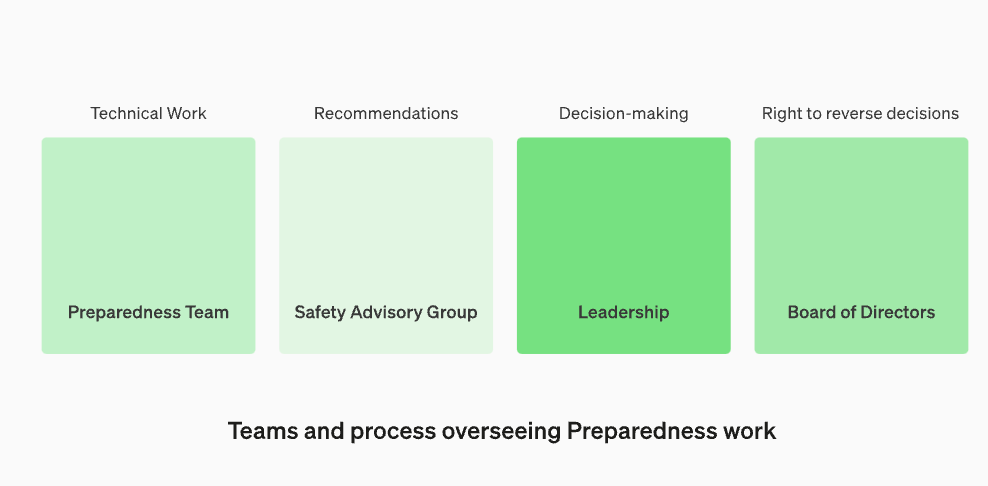

Restrukturieren Sie die Sicherheitsberatungsgruppe so, dass sie über dem technischen Team sitzt, Empfehlungen an die Führung richtet und dem Vorstand ein Vetorecht einräumt

OpenAI gab bekannt, dass sie zum Schutz vor der Bedrohung durch schädliche künstliche Intelligenz ihre internen Sicherheitsprozesse stärken. Sie werden eine neue Abteilung namens „Security Advisory Group“ einrichten, die oberhalb des Technologieteams angesiedelt ist, die Führung berät und ein Vetorecht im Vorstand erhält. Diese Entscheidung wurde am 18. Dezember Ortszeit bekannt gegeben

Das Update gibt vor allem Anlass zur Sorge, weil OpenAI-CEO Sam Altman vom Vorstand entlassen wurde, was offenbar mit Sicherheitsproblemen bei großen Modellen zusammenhängt. Zwei „verlangsamte“ Vorstandsmitglieder von OpenAI, Ilya Sutskvi und Helen Toner, verloren ihre Vorstandssitze nach einer Umstrukturierung auf höchster Ebene

In diesem Beitrag bespricht OpenAI sein neuestes „Preparedness Framework“, wie OpenAI katastrophale Risiken durch immer leistungsfähigere Modelle verfolgt, bewertet, vorhersagt und davor schützt. Was ist die Definition von Katastrophenrisiko? OpenAI erklärt: „Was wir als katastrophale Risiken bezeichnen, bezieht sich auf Risiken, die zu wirtschaftlichen Verlusten in Höhe von Hunderten von Milliarden Dollar führen oder bei vielen Menschen zu schweren Verletzungen oder zum Tod führen können.“

Laut der offiziellen Website von OpenAI werden Modelle in der Produktion vom „Security System“-Team verwaltet. Während der Entwicklungsphase gibt es ein Team namens „Vorbereitung“, das Risiken identifiziert und bewertet, bevor das Modell veröffentlicht wird. Darüber hinaus gibt es ein Team namens „Superalignment“, das an theoretischen Leitlinien für „superintelligente“ Modelle arbeitet

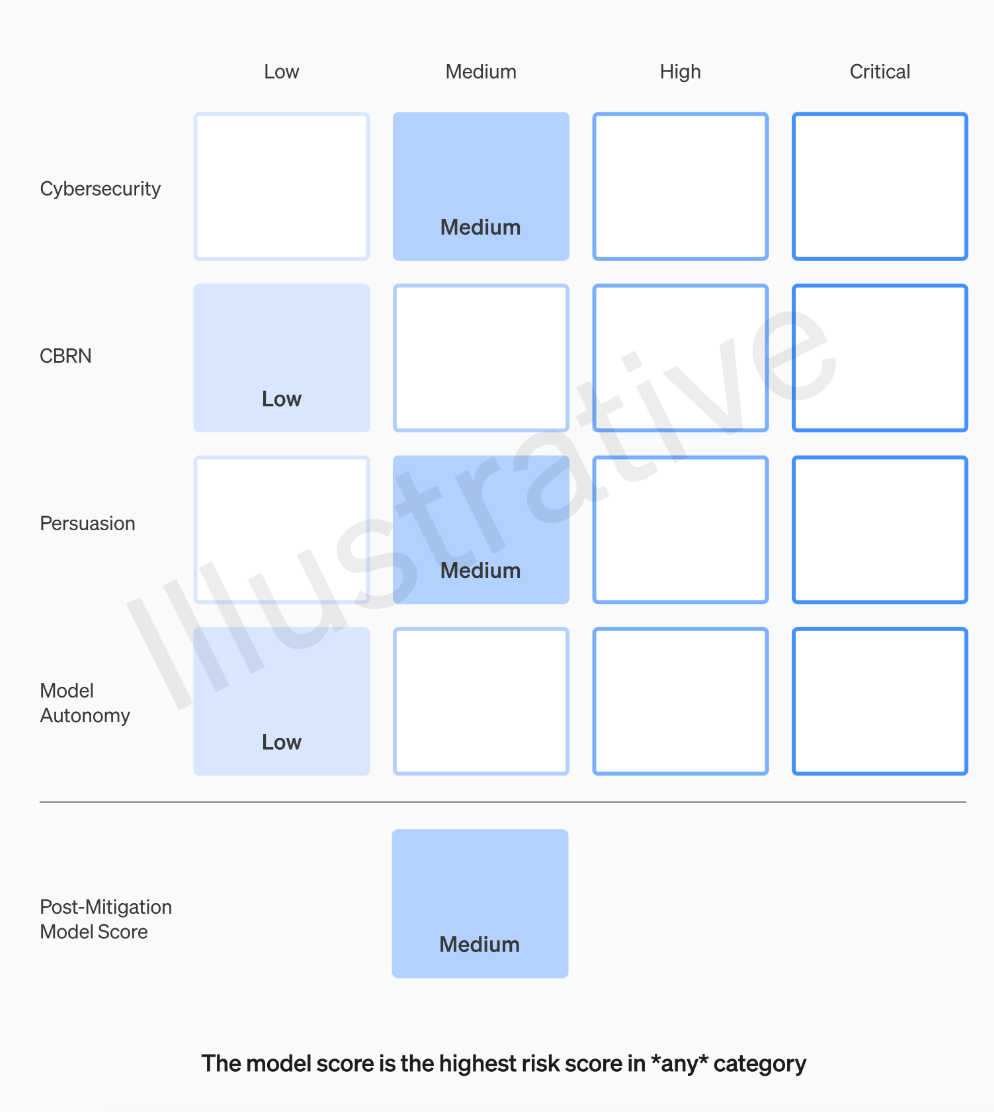

Das OpenAI-Team bewertet jedes Modell anhand von vier Risikokategorien: Cybersicherheit, Überzeugungskraft (z. B. Desinformation), Modellautonomie (die Fähigkeit, sich autonom zu verhalten) und CBRN (chemische, biologische, radiologische und nukleare Bedrohungen, z. B. die Fähigkeit dazu). neue Krankheitserreger erzeugen)

OpenAI berücksichtigt in seinen Annahmen verschiedene Abhilfemaßnahmen: Beispielsweise unterhält das Modell begründete Vorbehalte gegenüber der Beschreibung des Herstellungsprozesses von Napalm- oder Rohrbomben. Wenn ein Modell nach Berücksichtigung bekannter Abhilfemaßnahmen immer noch als „hohes“ Risiko eingestuft wird, wird es nicht eingesetzt, und wenn ein Modell „kritische“ Risiken aufweist, wird es nicht weiterentwickelt

Nicht jeder, der ein Modell herstellt, ist die beste Person, um es zu bewerten und Empfehlungen auszusprechen. Aus diesem Grund richtet OpenAI ein Team namens „Cross-Functional Security Advisory Group“ ein, das die Berichte der Forscher auf technischer Ebene prüft und Empfehlungen aus einer höheren Perspektive abgibt, in der Hoffnung, einige „unbekannte Unbekannte“ aufzudecken

Dieser Prozess erfordert, dass diese Empfehlungen sowohl an den Vorstand als auch an die Führung gesendet werden, die entscheiden, ob der Betrieb fortgeführt oder eingestellt wird. Der Vorstand hat jedoch das Recht, diese Entscheidungen rückgängig zu machen. Dadurch wird vermieden, dass risikoreiche Produkte oder Prozesse ohne Wissen des Vorstands genehmigt werden

Die Außenwelt ist jedoch immer noch besorgt darüber, ob der Vorstand von OpenAI wirklich das Recht hat, dies zu widerlegen und Maßnahmen zu ergreifen, wenn das Expertengremium Empfehlungen abgibt und der CEO Entscheidungen auf der Grundlage dieser Informationen trifft. Wenn ja, würde die Öffentlichkeit davon erfahren? Abgesehen von OpenAIs Versprechen, unabhängige Prüfungen durch Dritte einzuholen, wurden ihre Transparenzprobleme derzeit nicht wirklich angegangen

Das „Readiness Framework“ von OpenAI enthält die folgenden fünf Schlüsselelemente:1. Bewertung und Bewertung

Wir werden unser Modell evaluieren und unsere „Scorecard“ kontinuierlich aktualisieren. Wir werden alle hochmodernen Modelle evaluieren, einschließlich der Verdreifachung der effektiven Berechnung während des Trainings. Wir werden die Grenzen des Modells erweitern. Diese Ergebnisse werden uns dabei helfen, die Risiken der neuesten Modelle einzuschätzen und die Wirksamkeit aller vorgeschlagenen Abhilfemaßnahmen zu messen. Unser Ziel ist es, kantenspezifische Unsicherheiten zu erkennen, um Risiken effektiv zu mindern. Um das Sicherheitsniveau unserer Modelle zu verfolgen, erstellen wir Risiko-Scorecards und detaillierte Berichte

Zur Bewertung aller Spitzenmodelle ist eine „Scorecard“ erforderlich

Zur Bewertung aller Spitzenmodelle ist eine „Scorecard“ erforderlich

Der Zweck der Festlegung von Risikoschwellenwerten besteht darin, eine klare Grenze bei der Entscheidungsfindung und beim Risikomanagement zu schaffen. Der Risikoschwellenwert bezieht sich auf das maximale Risikoniveau, das eine Organisation oder Einzelperson unter bestimmten Umständen bereit ist, zu tragen. Durch das Festlegen von Risikoschwellenwerten können Sie einer Organisation oder Einzelperson dabei helfen, zu erkennen, wann Maßnahmen zur Minderung oder Vermeidung eines Risikos erforderlich sind. Die Festlegung von Risikoschwellenwerten sollte auf den Ergebnissen der Risikobewertung, relevanten Vorschriften und Richtlinien sowie der Risikotoleranz der Organisation oder Einzelperson basieren. Bei der Festlegung von Risikoschwellen müssen die Merkmale und Auswirkungen verschiedener Risikoarten berücksichtigt werden, um die Wirksamkeit und Anwendbarkeit von Risikomanagementmaßnahmen sicherzustellen. Schließlich sollten die festgelegten Risikoschwellen regelmäßig bewertet und angepasst werden, um mit den Risikomanagementzielen der Organisation oder Einzelperson in Einklang zu bleiben

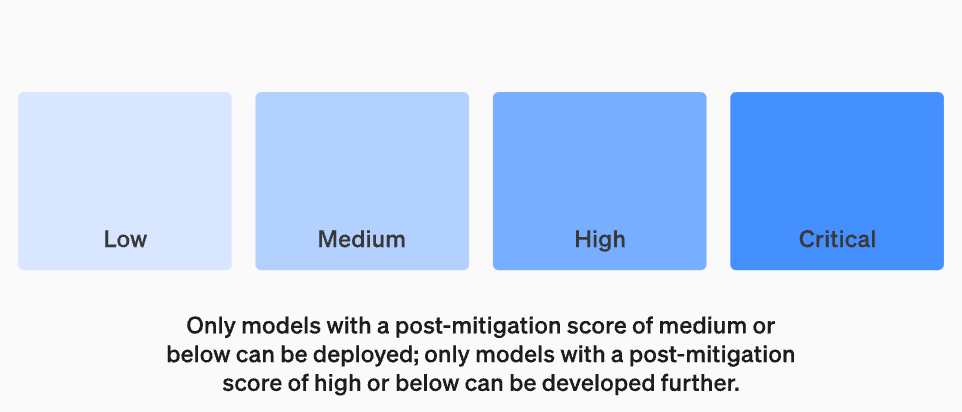

Wir werden Risikoschwellenwerte festlegen, die Sicherheitsmaßnahmen auslösen. Wir legen Schwellenwerte für Risikostufen fest, die auf den folgenden vorläufigen Tracking-Kategorien basieren: Cybersicherheit, CBRN (chemische, biologische, radiologische, nukleare Bedrohungen), Überzeugungskraft und Modellautonomie. Wir geben vier Sicherheitsrisikostufen an und es können nur Modelle mit einem Post-Minderungs-Score von „mittel“ oder darunter eingesetzt werden. Nur Modelle mit einem Post-Minderungs-Score von „hoch“ oder darunter können weiterentwickelt werden. Bei Modellen mit hohen oder schwerwiegenden Risiken (Pre-Mitigation) werden wir außerdem zusätzliche Sicherheitsmaßnahmen implementieren

Gefahrenstufe

Neugestaltung der Betriebsstruktur für die Überwachung technischer Arbeiten und Sicherheitsentscheidungen

Wir werden ein spezielles Team zusammenstellen, das die technische Arbeit und die operative Struktur von Sicherheitsentscheidungen überwacht. Das Bereitschaftsteam wird die technische Arbeit vorantreiben, um die Leistungsgrenzen modernster Modelle zu untersuchen und Bewertungen und umfassende Berichte durchzuführen. Diese technische Arbeit ist von entscheidender Bedeutung für die Entwicklungs- und Bereitstellungsentscheidungen von OpenAI-Sicherheitsmodellen. Wir bilden eine funktionsübergreifende Sicherheitsberatungsgruppe, die alle Berichte prüft und sie sowohl an die Führung als auch an den Vorstand sendet. Obwohl die Führung der Entscheidungsträger ist, hat der Vorstand die Macht, Entscheidungen zu kippen

Überwachung neuer Änderungen in der technischen Arbeits- und Sicherheitsentscheidungs-Betriebsstruktur

Erhöhen Sie die Sicherheit und stärken Sie die externe Rechenschaftspflicht

Wir werden Protokolle entwickeln, um die Sicherheit und die externe Rechenschaftspflicht zu verbessern. Wir werden regelmäßig Sicherheitsübungen durchführen, um unser Unternehmen und unsere eigene Kultur einem Stresstest zu unterziehen. Einige Sicherheitsprobleme können schnell auftreten, daher haben wir die Möglichkeit, dringende Probleme zu kennzeichnen, um schnell reagieren zu können. Wir glauben, dass es hilfreich ist, Feedback von Personen außerhalb von OpenAI einzuholen und es von einem qualifizierten, unabhängigen Dritten überprüfen zu lassen. Wir werden weiterhin dafür sorgen, dass andere rote Teams bilden und unsere Modelle bewerten, und planen, Aktualisierungen extern zu teilen

Reduzieren Sie andere bekannte und unbekannte Sicherheitsrisiken:

Wir helfen bei der Minderung anderer bekannter und unbekannter Sicherheitsrisiken. Wir werden sowohl mit externen Parteien als auch intern mit Teams wie Sicherheitssystemen eng zusammenarbeiten, um realen Missbrauch zu verfolgen. Wir werden auch mit Super Alignment zusammenarbeiten, um dringende Fehlausrichtungsrisiken zu verfolgen. Wir leisten auch Pionierarbeit bei neuen Forschungsarbeiten, um zu messen, wie sich Risiken bei der Skalierung von Modellen entwickeln, und helfen dabei, Risiken im Voraus vorherzusagen, ähnlich wie bei unserem früheren Erfolg mit dem Gesetz der Skalierung. Schließlich werden wir in einem kontinuierlichen Prozess versuchen, alle auftretenden „unbekannten Unbekannten“ aufzuklären

Das obige ist der detaillierte Inhalt vonOpenAI stärkt das Sicherheitsteam und befähigt es, gegen gefährliche KI ein Veto einzulegen. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1371

1371

52

52

Wählen Sie das Einbettungsmodell, das am besten zu Ihren Daten passt: Ein Vergleichstest von OpenAI und mehrsprachigen Open-Source-Einbettungen

Feb 26, 2024 pm 06:10 PM

Wählen Sie das Einbettungsmodell, das am besten zu Ihren Daten passt: Ein Vergleichstest von OpenAI und mehrsprachigen Open-Source-Einbettungen

Feb 26, 2024 pm 06:10 PM

OpenAI kündigte kürzlich die Einführung seines Einbettungsmodells embeddingv3 der neuesten Generation an, das seiner Meinung nach das leistungsstärkste Einbettungsmodell mit höherer Mehrsprachenleistung ist. Diese Reihe von Modellen ist in zwei Typen unterteilt: das kleinere Text-Embeddings-3-Small und das leistungsfähigere und größere Text-Embeddings-3-Large. Es werden nur wenige Informationen darüber offengelegt, wie diese Modelle entworfen und trainiert werden, und auf die Modelle kann nur über kostenpflichtige APIs zugegriffen werden. Es gab also viele Open-Source-Einbettungsmodelle. Aber wie schneiden diese Open-Source-Modelle im Vergleich zum Closed-Source-Modell von OpenAI ab? In diesem Artikel wird die Leistung dieser neuen Modelle empirisch mit Open-Source-Modellen verglichen. Wir planen, Daten zu erstellen

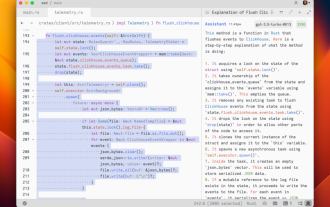

Ein neues Programmierparadigma, wenn Spring Boot auf OpenAI trifft

Feb 01, 2024 pm 09:18 PM

Ein neues Programmierparadigma, wenn Spring Boot auf OpenAI trifft

Feb 01, 2024 pm 09:18 PM

Im Jahr 2023 ist die KI-Technologie zu einem heißen Thema geworden und hat enorme Auswirkungen auf verschiedene Branchen, insbesondere im Programmierbereich. Die Bedeutung der KI-Technologie wird den Menschen zunehmend bewusst, und die Spring-Community bildet da keine Ausnahme. Mit der kontinuierlichen Weiterentwicklung der GenAI-Technologie (General Artificial Intelligence) ist es entscheidend und dringend geworden, die Erstellung von Anwendungen mit KI-Funktionen zu vereinfachen. Vor diesem Hintergrund entstand „SpringAI“ mit dem Ziel, den Prozess der Entwicklung von KI-Funktionsanwendungen zu vereinfachen, ihn einfach und intuitiv zu gestalten und unnötige Komplexität zu vermeiden. Durch „SpringAI“ können Entwickler einfacher Anwendungen mit KI-Funktionen erstellen, wodurch diese einfacher zu verwenden und zu bedienen sind.

Posthume Arbeit des OpenAI Super Alignment Teams: Zwei große Modelle spielen ein Spiel und die Ausgabe wird verständlicher

Jul 19, 2024 am 01:29 AM

Posthume Arbeit des OpenAI Super Alignment Teams: Zwei große Modelle spielen ein Spiel und die Ausgabe wird verständlicher

Jul 19, 2024 am 01:29 AM

Wenn die Antwort des KI-Modells überhaupt unverständlich ist, würden Sie es wagen, sie zu verwenden? Da maschinelle Lernsysteme in immer wichtigeren Bereichen eingesetzt werden, wird es immer wichtiger zu zeigen, warum wir ihren Ergebnissen vertrauen können und wann wir ihnen nicht vertrauen sollten. Eine Möglichkeit, Vertrauen in die Ausgabe eines komplexen Systems zu gewinnen, besteht darin, vom System zu verlangen, dass es eine Interpretation seiner Ausgabe erstellt, die für einen Menschen oder ein anderes vertrauenswürdiges System lesbar ist, d. h. so vollständig verständlich, dass mögliche Fehler erkannt werden können gefunden. Um beispielsweise Vertrauen in das Justizsystem aufzubauen, verlangen wir von den Gerichten, dass sie klare und lesbare schriftliche Stellungnahmen abgeben, die ihre Entscheidungen erläutern und stützen. Für große Sprachmodelle können wir auch einen ähnlichen Ansatz verfolgen. Stellen Sie bei diesem Ansatz jedoch sicher, dass das Sprachmodell generiert wird

Der Rust-basierte Zed-Editor ist Open Source und bietet integrierte Unterstützung für OpenAI und GitHub Copilot

Feb 01, 2024 pm 02:51 PM

Der Rust-basierte Zed-Editor ist Open Source und bietet integrierte Unterstützung für OpenAI und GitHub Copilot

Feb 01, 2024 pm 02:51 PM

Autor丨Zusammengestellt von TimAnderson丨Produziert von Noah|51CTO Technology Stack (WeChat-ID: blog51cto) Das Zed-Editor-Projekt befindet sich noch in der Vorabversionsphase und wurde unter AGPL-, GPL- und Apache-Lizenzen als Open Source bereitgestellt. Der Editor zeichnet sich durch hohe Leistung und mehrere KI-gestützte Optionen aus, ist jedoch derzeit nur auf der Mac-Plattform verfügbar. Nathan Sobo erklärte in einem Beitrag, dass in der Codebasis des Zed-Projekts auf GitHub der Editor-Teil unter der GPL lizenziert ist, die serverseitigen Komponenten unter der AGPL lizenziert sind und der GPUI-Teil (GPU Accelerated User) die Schnittstelle übernimmt Apache2.0-Lizenz. GPUI ist ein vom Zed-Team entwickeltes Produkt

Warten Sie nicht auf OpenAI, sondern darauf, dass Open-Sora vollständig Open Source ist

Mar 18, 2024 pm 08:40 PM

Warten Sie nicht auf OpenAI, sondern darauf, dass Open-Sora vollständig Open Source ist

Mar 18, 2024 pm 08:40 PM

Vor nicht allzu langer Zeit wurde OpenAISora mit seinen erstaunlichen Videogenerierungseffekten schnell populär und stach aus der Masse der literarischen Videomodelle hervor und rückte in den Mittelpunkt der weltweiten Aufmerksamkeit. Nach der Einführung des Sora-Trainings-Inferenzreproduktionsprozesses mit einer Kostenreduzierung von 46 % vor zwei Wochen hat das Colossal-AI-Team das weltweit erste Sora-ähnliche Architektur-Videogenerierungsmodell „Open-Sora1.0“ vollständig als Open-Source-Lösung bereitgestellt, das das gesamte Spektrum abdeckt Lernen Sie den Trainingsprozess, einschließlich der Datenverarbeitung, aller Trainingsdetails und Modellgewichte, kennen und schließen Sie sich mit globalen KI-Enthusiasten zusammen, um eine neue Ära der Videoerstellung voranzutreiben. Schauen wir uns für einen kleinen Vorgeschmack ein Video einer geschäftigen Stadt an, das mit dem vom Colossal-AI-Team veröffentlichten Modell „Open-Sora1.0“ erstellt wurde. Open-Sora1.0

Die lokale Ausführungsleistung des Embedding-Dienstes übertrifft die von OpenAI Text-Embedding-Ada-002, was sehr praktisch ist!

Apr 15, 2024 am 09:01 AM

Die lokale Ausführungsleistung des Embedding-Dienstes übertrifft die von OpenAI Text-Embedding-Ada-002, was sehr praktisch ist!

Apr 15, 2024 am 09:01 AM

Ollama ist ein superpraktisches Tool, mit dem Sie Open-Source-Modelle wie Llama2, Mistral und Gemma problemlos lokal ausführen können. In diesem Artikel werde ich vorstellen, wie man Ollama zum Vektorisieren von Text verwendet. Wenn Sie Ollama nicht lokal installiert haben, können Sie diesen Artikel lesen. In diesem Artikel verwenden wir das Modell nomic-embed-text[2]. Es handelt sich um einen Text-Encoder, der OpenAI text-embedding-ada-002 und text-embedding-3-small bei kurzen und langen Kontextaufgaben übertrifft. Starten Sie den nomic-embed-text-Dienst, wenn Sie o erfolgreich installiert haben

Microsoft und OpenAI planen, 100 Millionen US-Dollar in humanoide Roboter zu investieren! Internetnutzer rufen Musk an

Feb 01, 2024 am 11:18 AM

Microsoft und OpenAI planen, 100 Millionen US-Dollar in humanoide Roboter zu investieren! Internetnutzer rufen Musk an

Feb 01, 2024 am 11:18 AM

Anfang des Jahres wurde bekannt, dass Microsoft und OpenAI große Geldsummen in ein Startup für humanoide Roboter investieren. Unter anderem plant Microsoft, 95 Millionen US-Dollar zu investieren, und OpenAI wird 5 Millionen US-Dollar investieren. Laut Bloomberg wird das Unternehmen in dieser Runde voraussichtlich insgesamt 500 Millionen US-Dollar einsammeln, und seine Pre-Money-Bewertung könnte 1,9 Milliarden US-Dollar erreichen. Was zieht sie an? Werfen wir zunächst einen Blick auf die Robotik-Erfolge dieses Unternehmens. Dieser Roboter ist ganz in Silber und Schwarz gehalten und ähnelt in seinem Aussehen dem Abbild eines Roboters in einem Hollywood-Science-Fiction-Blockbuster: Jetzt steckt er eine Kaffeekapsel in die Kaffeemaschine: Wenn sie nicht richtig platziert ist, passt sie sich von selbst an menschliche Fernbedienung: Nach einer Weile kann jedoch eine Tasse Kaffee mitgenommen und genossen werden: Haben Sie Familienmitglieder, die es erkannt haben? Ja, dieser Roboter wurde vor einiger Zeit erstellt.

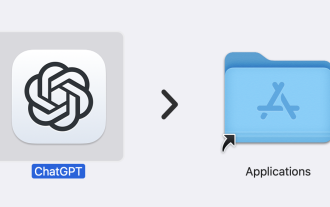

ChatGPT ist jetzt mit der Veröffentlichung einer speziellen App für macOS verfügbar

Jun 27, 2024 am 10:05 AM

ChatGPT ist jetzt mit der Veröffentlichung einer speziellen App für macOS verfügbar

Jun 27, 2024 am 10:05 AM

Die ChatGPT-Mac-Anwendung von Open AI ist jetzt für alle verfügbar, während sie in den letzten Monaten nur denjenigen mit einem ChatGPT Plus-Abonnement vorbehalten war. Die App lässt sich wie jede andere native Mac-App installieren, sofern Sie über ein aktuelles Apple S verfügen