Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

PAI x EasyPhoto, verabschieden Sie sich vom Aprilscherz und schaffen Sie eine festliche Atmosphäre mit KI-Fotos

PAI x EasyPhoto, verabschieden Sie sich vom Aprilscherz und schaffen Sie eine festliche Atmosphäre mit KI-Fotos

PAI x EasyPhoto, verabschieden Sie sich vom Aprilscherz und schaffen Sie eine festliche Atmosphäre mit KI-Fotos

Veranstaltungsadresse: https://developer.aliyun.com/topic/aigc_pai/newyear

Tutorial-Brief

Der Einsatz generativer KI-Technologie zur Stapelproduktion echter/ähnlicher/schöner persönlicher Fotos erfreut sich großer Beliebtheit. Das kürzlich eingeführte EasyPhoto bietet als Open-Source-SD-WebUI-Plug-in eine flexiblere und benutzerfreundlichere Entwicklungsmethode. Es hat die Aufmerksamkeit und das Lob einer großen Anzahl von Entwicklern erhalten. Benutzer können das LoRA-Modell schnell trainieren Mehrere Fotos derselben Person und kombiniert mit benutzerdefinierten Vorlagenbildern erzeugen schließlich echte, realistische und schöne Porträtfotos.

EasyPhoto ist ein Webui-UI-Plug-in zum Erstellen von KI-Porträts. Basierend auf StableDiffusion + Charakteranpassung Lora + ControlNet unterstützt es Low-Code-Vorgänge, benutzerdefinierte Stile und integrierte umfangreiche Vorlagen, sodass mehr Entwickler flexibel ihre eigene stilisierte künstlerische Fotogenerierung entwickeln können. Diese AIGC-Erstellungsaktivität basiert auf der Plattform für künstliche Intelligenz PAI EasyPhoto von Alibaba Cloud und wird mit geringem Code und hoher Effizienz gestartet, wodurch die schnelle Erstellung wunderschöner Bilder mit einer festlichen Atmosphäre erreicht wird.

Basierend auf diesem Tutorial können Sie Folgendes erleben:

Neue Benutzer können Testressourcen der Plattform für künstliche Intelligenz PAI im Wert von 10.000 Yuan kostenlos erhalten

Trainieren Sie ein persönliches LoRA-Modell basierend auf der interaktiven Modellierung PAI-DSW

Erstellen Sie neue Feiertags-KI-Fotos, damit Sie die persönliche Atmosphäre von Weihnachten, Neujahr und anderen Feiertagen erleben können

Senden Sie Ihre Werke Redmi Watch3, Xiaomi Band 8 usw. ein, um exquisite Geschenke zu gewinnen!

Verwenden Sie PAI, um EasyPhoto schnell zu starten

1. Vorbereitung

1.1 Holen Sie sich die kostenlosen Testrechte für die interaktive Modellierung PAI-DSW

Gehen Sie zur Veranstaltungsseite dieser „Hi 2024! AI New Year Photo Challenge“ und erhalten Sie ein kostenloses Testressourcenpaket für das interaktive Modellierungsprodukt PAI-DSW

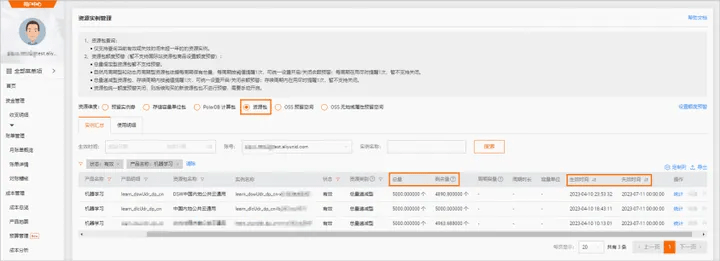

- Für neue Benutzer der interaktiven Modellierung PAI-DSW bietet Alibaba Cloud 5000CU*H kostenlose Testressourcen, die direkt auf der Veranstaltungsseite abgerufen werden können (Testregeln finden Sie unter Alibaba Cloud Free Trial: https://free.aliyun . com/); oder Sie können das interaktive Modellierungs-PAI-DSW-Ressourcenpaket erwerben, Kauflink: PAI-DSW 100CU*H-Ressourcenpaket, der Preis beginnt bei 59 Yuan; PAI-DSW wird auf der Grundlage der Gebühren berechnet. Einzelheiten zu den Abrechnungsstandards finden Sie in den Alibaba Cloud-Produktpreisen.

1.2 PAI-DSW-Instanz erstellen

- Gehen Sie zur PAI-Konsole der Plattform für künstliche Intelligenz, Link: https://pai.console.aliyun.com/

- Öffnen Sie PAI für künstliche Intelligenz und erstellen Sie einen Standardarbeitsbereich. Siehe Bereitstellen und Erstellen eines Standardarbeitsbereichs.

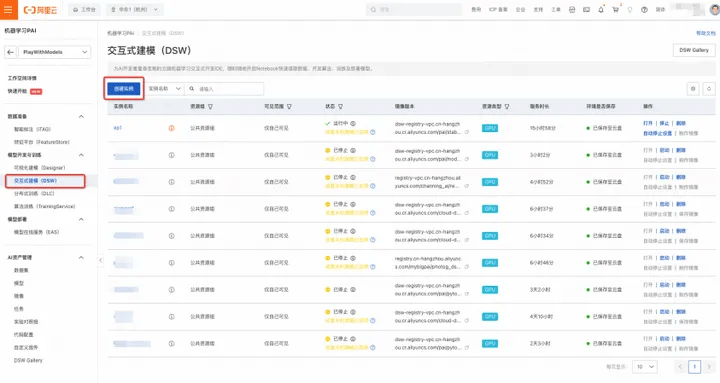

- Wählen Sie in der PAI-Konsole der Plattform für künstliche Intelligenz die interaktive Modellierung PAI-DSW aus

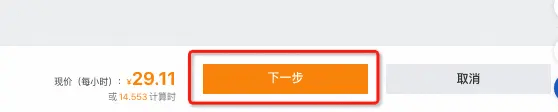

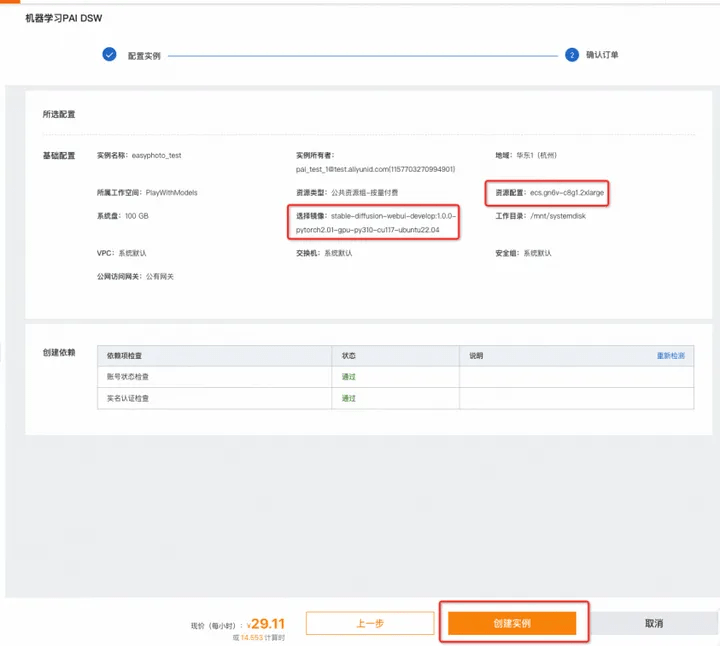

4. Klicken Sie, um eine Instanz zu erstellen (wie oben gezeigt)

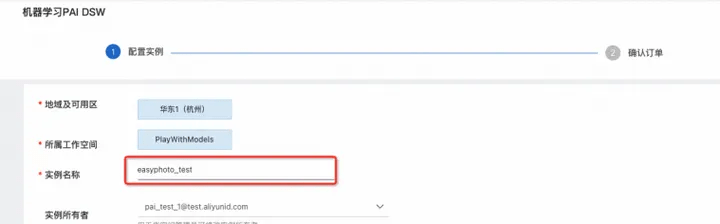

5. Passen Sie den Namen der Eingabeinstanz an, z. B. „easyphoto“

Bei der Auswahl eines Instanzmodells können Sie die Verwendung der GPU-Kategorie ecs.gn6v-c8g1.2xlarge (unterstützt die Ableitung von Ressourcenpaketen) oder ecs.gn7i-c8g1.2xlarge in Betracht ziehen

(Abzug von Support-Ressourcenpaketen). Wenn diese beiden Modelle auf Lager sind, können Sie zum Ausprobieren die Region ändern oder ein anderes kostenpflichtiges Modell auswählen (kostenlose Testversion wird nicht unterstützt).

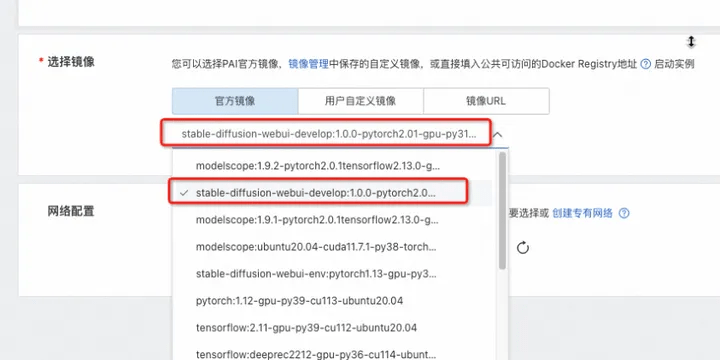

7. Wählen Sie das Bild „stable-diffusion-webui-develop:1.0.0-pytorch2.01-gpu-py310-cu117-ubuntu22.04“ aus

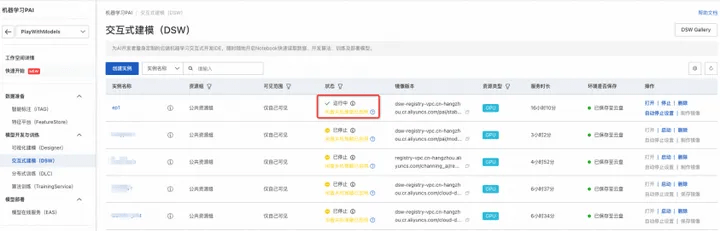

10. Warten Sie etwa 3-5 Minuten, der Instanzstatus ändert sich in „Wird ausgeführt“ und die Instanzerstellung ist abgeschlossen

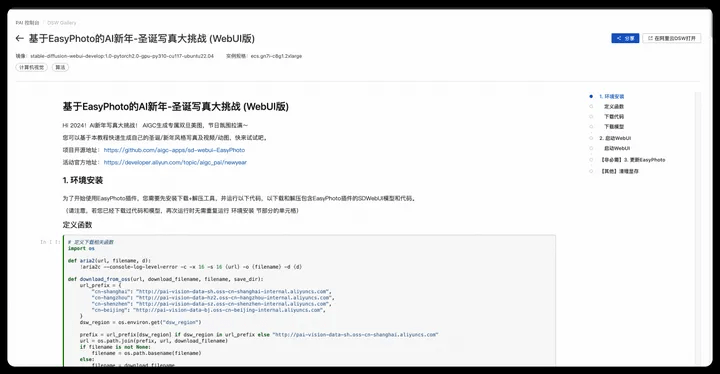

1.3 Öffnen Sie das EasyPhoto-Tutorial in PAI-DSW und erleben Sie die Zero-Code-KI-Entwicklung

- Öffnen Sie den Link: AI New Year-Christmas Photo Challenge basierend auf EasyPhoto (WebUI-Version), klicken Sie oben rechts auf „In Alibaba Cloud DSW öffnen“

2. Wählen Sie die zuvor erstellte Instanz aus und klicken Sie auf den Instanznamen

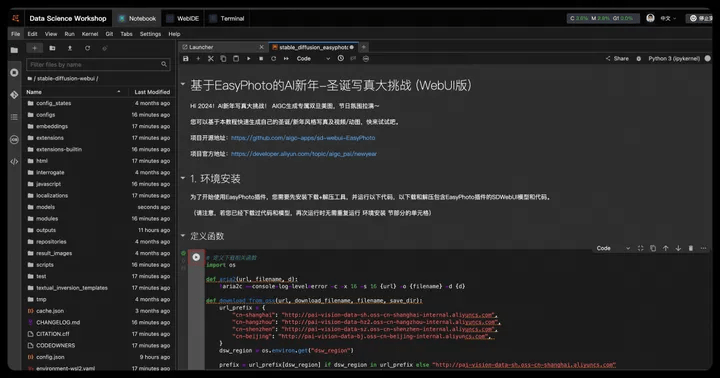

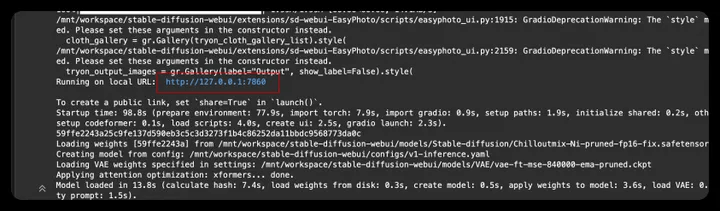

3. Rufen Sie die Notebook-Entwicklungsoberfläche auf und klicken Sie Schritt für Schritt auf die Schaltfläche „Ausführen“. 1. In den Zellen zur Installation der Umgebung (3 definierte Funktionen – Download-Code – Download-Modell) können Sie den voreingestellten EasyPhoto-Plugin herunterladen und installieren -in WebUI das Modell, auf dem es basiert.

2 aus. Starten Sie die Zelle des WebUI-Bereichs, um die WebUI zu öffnen.

5. Klicken Sie auf den generierten Link, um die WebUI aufzurufen

- Öffnen Sie die WebUI, rufen Sie die Erlebnissitzung auf und führen Sie EasyPhoto in der WebUI aus

Mit diesem Tutorial können Sie Ihre eigenen Urlaubsfotos/Animationen erstellen. Wir bieten folgende Funktionen:

Foto-Inferenz

- Fotos von Personen in bestimmten Bildern (Photo2Photo)

- Charakterfotos mit angegebenem Text (Text2Photo)

- Video-Inferenz

- Charakteranimation mit angegebenem Text (Text2Video)

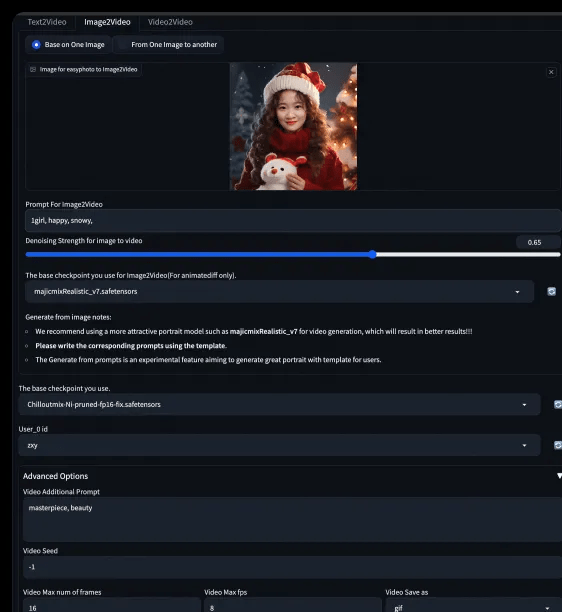

- Charakteranimation des angegebenen Bildes (Image2Video)

- Geben Sie die Charakteranimation des Videos an (Video2Video)

- Generell gliedert sich die Erstellung von Charakterporträts/Animationen in die folgenden zwei Schritte:

Schritt 1: Trainieren Sie den digitalen Klon des Charakters

- Schritt 2: Bild-/Videogenerierung basierend auf digitalem Klon

- Bitte lesen Sie Abschnitt 2.2 zum Generieren von Bildern und Abschnitt 2.3 zum Generieren von Videos.

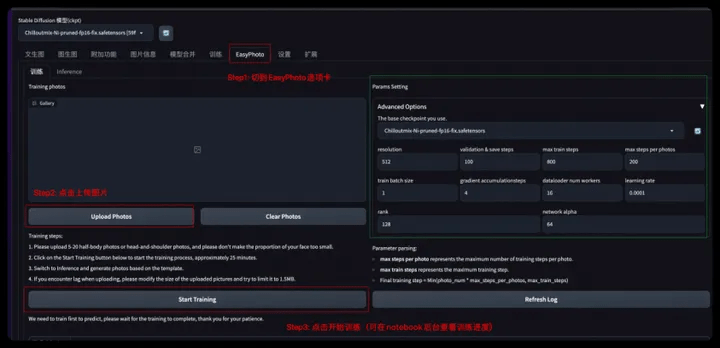

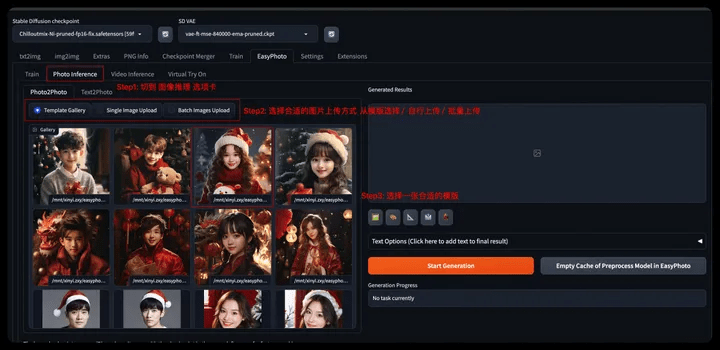

Schritt 1: Klicken Sie auf die Registerkarte EasyPhoto

- Schritt 2: Klicken Sie auf „Fotos hochladen“, um Ihre eigenen Trainingsbilder hochzuladen (5–20 klare Porträts, vorzugsweise halblang/frontal)

- Wenn Sie keine 10 klaren persönlichen Porträtfotos haben, können Sie das Mona Lisa-Foto als Test auswählen. Der Download-Link für Mona Lisa-Fotos lautet: https://pai-aigc-photog.oss-cn-hangzhou.aliyuncs.com/webui/mona.zip

Schritt 3: Klicken Sie auf „Training starten“ (geben Sie eine beliebige Benutzer-ID (Englisch) in das Popup-Feld ein)

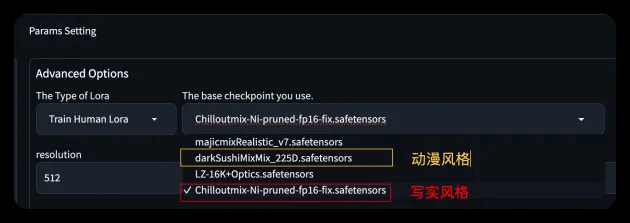

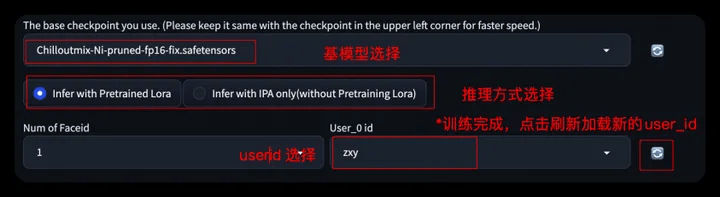

Wir haben zwei Basismodelle im realistischen/Animationsstil zur Auswahl. Sie können auch Ihr eigenes Basismodell nach Ihren Wünschen auswählen.

Wir haben zwei Basismodelle im realistischen/Animationsstil zur Auswahl. Sie können auch Ihr eigenes Basismodell nach Ihren Wünschen auswählen.

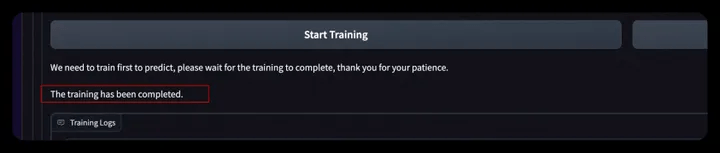

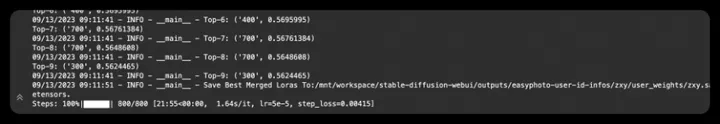

⚠️Bitte beachten Sie, dass Sie sich keine Sorgen machen müssen, wenn es während des Trainingsprozesses zu einer Front-End-Verbindungsunterbrechung kommt, wie im Bild gezeigt, Sie können den Trainingsfortschritt im Notebook-Hintergrund sehen. Aktualisieren Sie nach Abschluss des Trainings die Front-End-Seite, um eine Modellinferenz durchzuführen.

⚠️Bitte beachten Sie, dass Sie sich keine Sorgen machen müssen, wenn es während des Trainingsprozesses zu einer Front-End-Verbindungsunterbrechung kommt, wie im Bild gezeigt, Sie können den Trainingsfortschritt im Notebook-Hintergrund sehen. Aktualisieren Sie nach Abschluss des Trainings die Front-End-Seite, um eine Modellinferenz durchzuführen.

Front-End-Trennung (Verbindungszeitüberschreitung, stellen Sie nur sicher, dass der Hintergrund trainiert):

- Erinnerung an den Trainingsabschluss:

- SDWebUI-Frontend

- Notebook-Backend

2.2 Bildinferenz (Fotoinferenz)

Sie können Photo Inference für die Bildinferenz verwenden, wir unterstützen:

- Fotos von Personen in bestimmten Bildern (Photo2Photo)

- Charakterfotos mit angegebenem Text (Text2Photo)

2.2.1 Spezifizierte Bilder von Charakterporträts

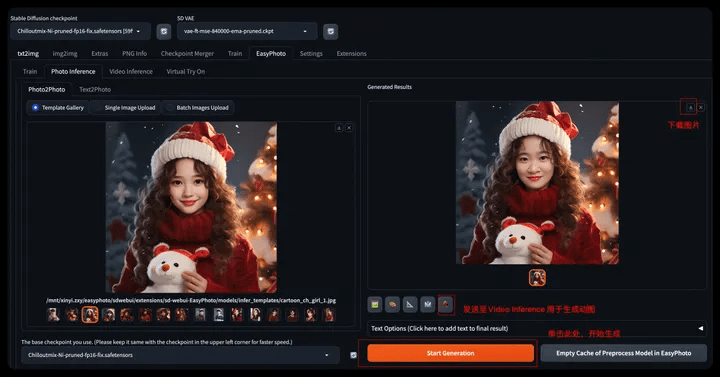

- Schritt 1: Wechseln Sie zur Registerkarte „Fotoinferenz“

- Schritt 2: Wählen Sie eine geeignete Methode zum Hochladen von Bildern

- Wählen Sie aus der Vorlage (Vorlagengalerie) aus. Sie müssen ein Bild in der Galerie auswählen

- Laden Sie Flugblätter selbst hoch (Einzelbild-Upload)

- Batch-Bild-Upload-Vorlage

- Schritt 3: Wählen Sie das Basismodell und das LoRA-Modell entsprechend der Benutzer-ID aus (Sie können auf das Aktualisierungssymbol klicken, um eine Liste aller Benutzer-IDs zu erhalten)

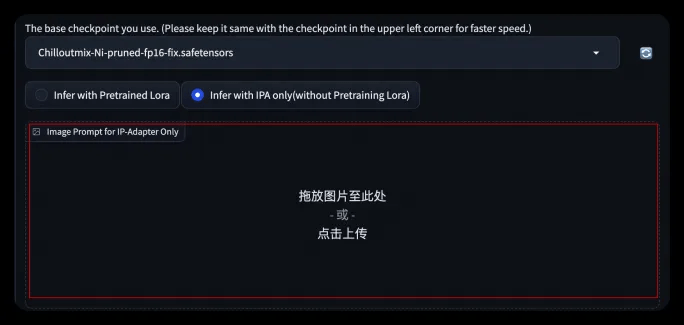

- Wenn Sie Infer With IPA verwenden, müssen Sie Ihren eigenen digitalen Klon nicht trainieren. Sie können ein Bild direkt in das Popup-Bildfeld hochladen, um es zu generieren.

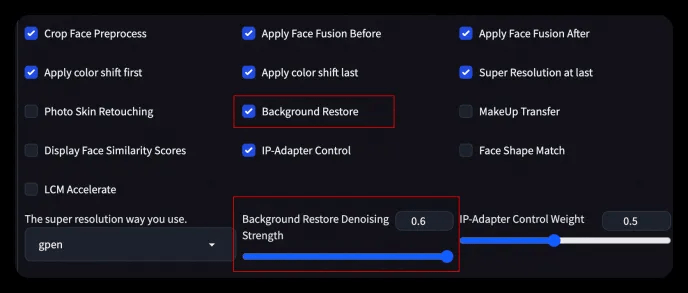

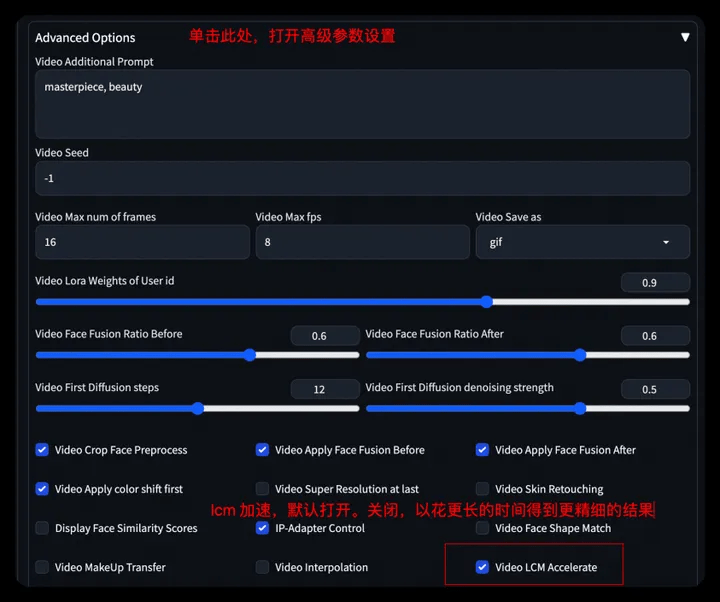

- Schritt 4: Verwandte Parameter können auf der Registerkarte „Erweiterte Optionen“ eingestellt werden

- Sie können die Hintergrundwiederherstellung aktivieren, den Neuzeichnungsbereich anpassen und das Vorlagenbild neu zeichnen, um unterschiedliche Generierungseffekte zu erzielen.

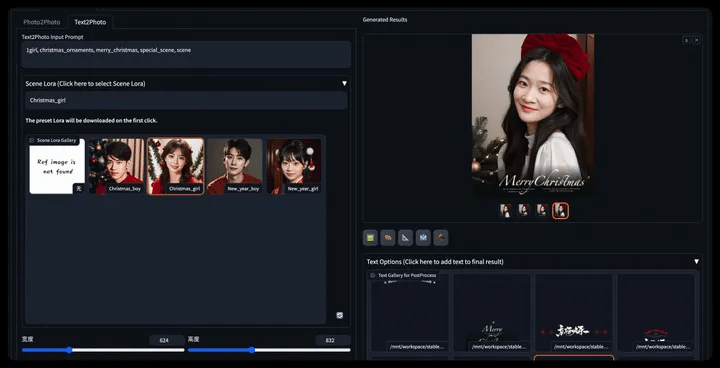

- Schritt 5: Klicken Sie auf „Generierung starten“, um eine Modellinferenz durchzuführen und Ihr eigenes KI-Foto zu generieren

- Nach ca. 1-2 Minuten Wartezeit ist die Bildgenerierung abgeschlossen und das Bild kann heruntergeladen und gespeichert werden

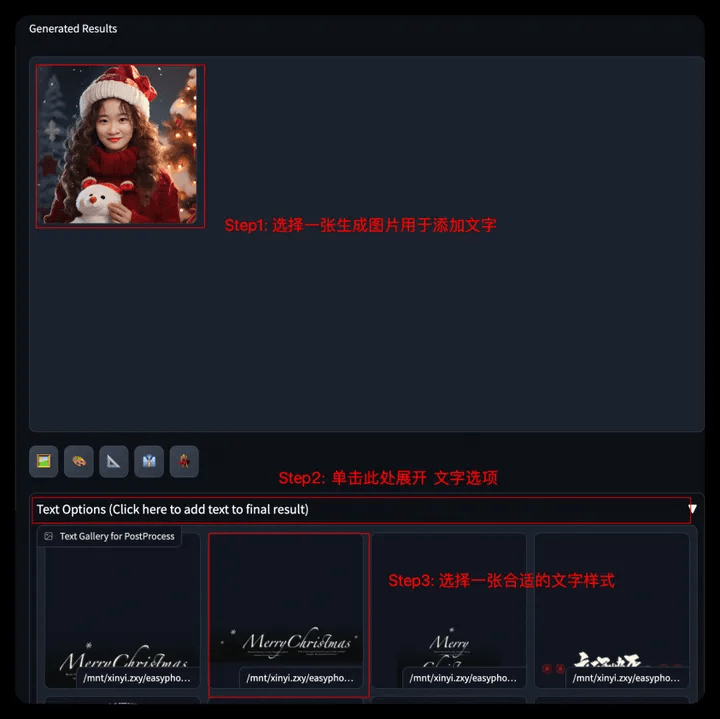

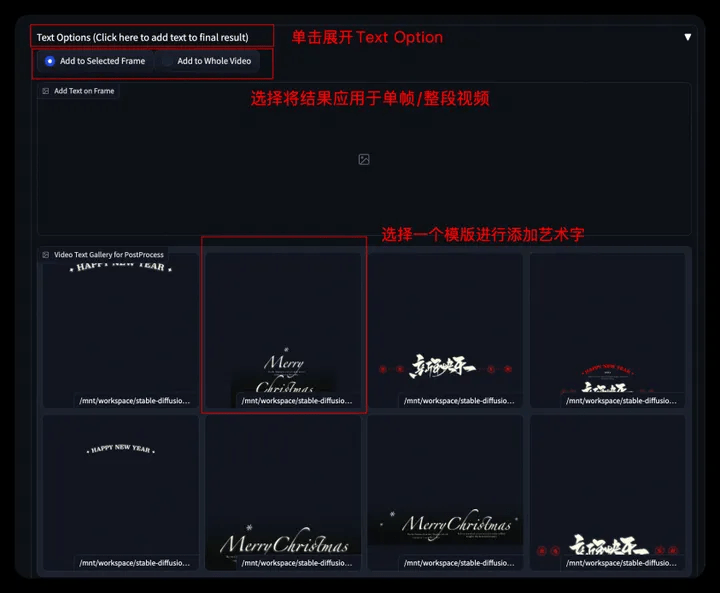

- Schritt 6: Sie können außerdem Bilder generieren, auf Textoptionen klicken, eine geeignete Vorlage zum Hinzufügen von Word-Art-Effekten auswählen und die generierten Ergebnisse werden auf der rechten Seite der Ergebnisse angezeigt.

- Senden Sie das Bild auf der Veranstaltungsseite und nehmen Sie an der Preisverleihung teil

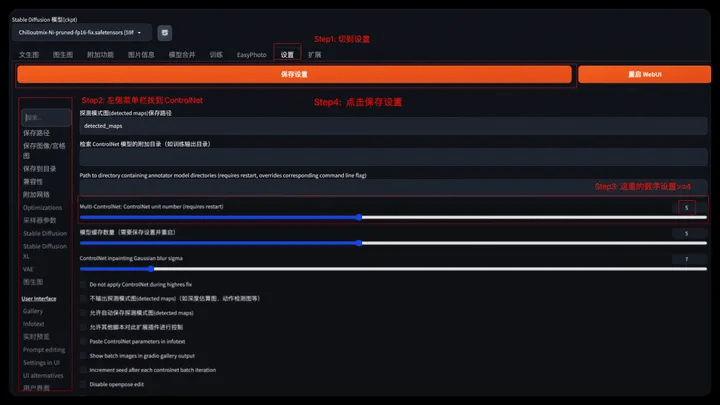

⚠️ Wenn die folgende Eingabeaufforderung erscheint, stellen Sie bitte die ControlNet-Nummer >= 4 ein. Verlassen Sie die Konsole und starten Sie die WebUI neu, um sie einzurichten.

- Schritt 1: Wählen Sie das Einstellungsmenü

- Schritt 2: Suchen Sie ControlNet in der linken Menüleiste

- Schritt 3: Stellen Sie die Anzahl der Multi-ControlNet >= 4 ein

- Schritt 4: Klicken Sie, um die Einstellungen zu speichern

- Schritt 5: Kehren Sie zur Notizbuchseite zurück, stoppen Sie SDWebUI und starten Sie es neu

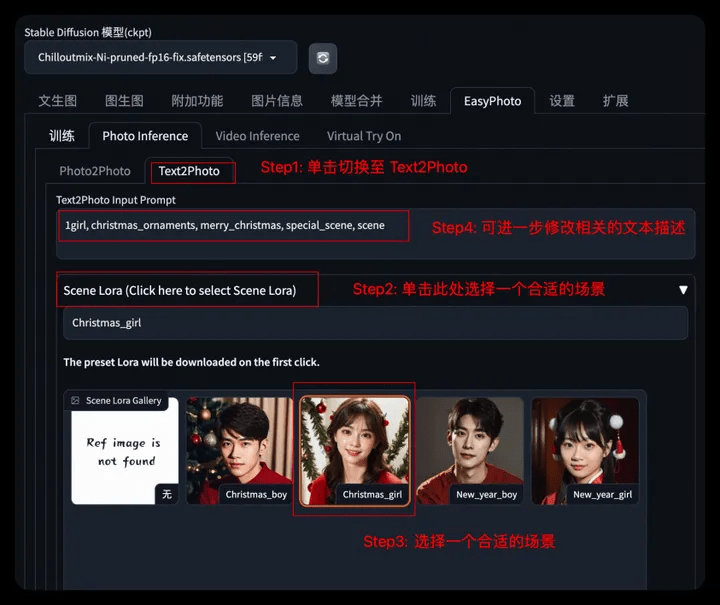

2.2.2 Charakterporträt mit angegebenem Text

- Schritt 1: Wechseln Sie zur Registerkarte Text2Photo

- Schritt 2: Wählen Sie eine geeignete Szene aus

- Schritt 3: Relevante Textbeschreibung ändern

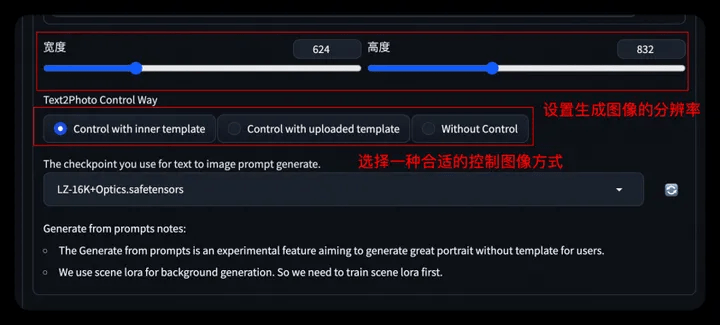

- Schritt 4: Stellen Sie die Auflösung des generierten Bildes ein

- Schritt 5: Weiteres Steuerbild auswählen/hochladen (Pose Control OpenPose)

- Schritt 6: Legen Sie das Basismodell/die Benutzer-ID und andere Parameter im Einklang mit Tushengtu fest, generieren Sie das Bild und fügen Sie nach Abschluss der Generierung selbst den Wortkunsteffekt hinzu.

* Sie können sich hier auf die Verwendungsmethoden beziehen, um Ihre eigenen Festivalszenen weiter zu trainieren und abwechslungsreiche Porträts zu erstellen~

2.3 Video-Inferenz

Sie können Video-Inferenz für Video-Inferenz verwenden, wir unterstützen:

- Charakteranimation mit angegebenem Text (Text2Video)

- Charakteranimation des angegebenen Bildes (Image2Video)

- Geben Sie die Charakteranimation des Videos an (Video2Video)

2.3.1 Charakteranimation mit angegebenem Text

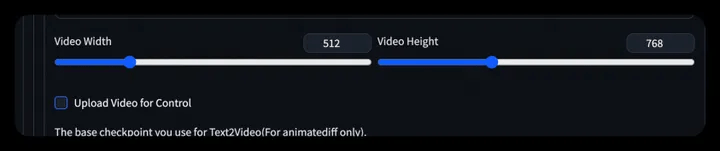

- Schritt 1: Wechseln Sie zur Registerkarte „Video-Inferenz“

- Schritt 2: Wählen Sie eine geeignete Szene aus und ändern Sie die entsprechende Eingabeaufforderung (derselbe Vorgang wie bei einem Charakterfoto mit angegebenem Text)

- Schritt 3: Stellen Sie die Bildgröße ein oder laden Sie ein Video zur Steuerung hoch und wählen Sie die entsprechende Steuerungsmethode.

- Schritt 4: Legen Sie das Basismodell, die Benutzer-ID und die zugehörigen Parameter fest.

⚠️ Wir aktivieren standardmäßig die LCM-Beschleunigung für die Videogenerierung. Sie können diese Option deaktivieren, um mehr Generierungsschritte zu verwenden, um detailliertere Videoergebnisse zu generieren.

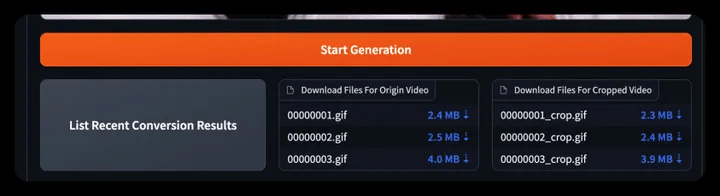

- Schritt 5: Klicken Sie auf „Generierung starten“, um das Video zu generieren

- Wenn ein Front-End-Fehler auftritt, wird im Hintergrund angezeigt, dass die Generierung abgeschlossen ist. Sie können auf „Letzte Konvertierungsergebnisse auflisten“ klicken, um das generierte historische Video herunterzuladen/anzusehen. (Keine Aktualisierung erforderlich)

- Schritt 6: Klicken Sie auf „Textoption“, um dem generierten Video Wortkunsteffekte hinzuzufügen. Sie können einen Frame auswählen oder den WordArt-Effekt auf das gesamte Video anwenden.

2.3.2 Charakteranimation des angegebenen Bildes

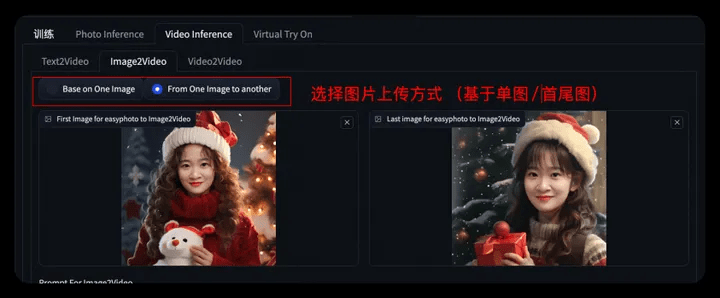

- Schritt 1: Laden Sie ein Charakterbild hoch (das generierte Charakterfoto kann hier über die Schaltfläche gesendet werden)/Laden Sie das erste und das letzte Bild hoch

- Schritt 2: Legen Sie das Basismodell, die Benutzer-ID und die zugehörigen Parameter fest. Klicken Sie auf „Generierung starten“, um das Video zu generieren. Und verwenden Sie die Textoptionen, um Wortkunst hinzuzufügen.

2.3.3 Charakteranimation des angegebenen Videos

- Schritt 1: Laden Sie ein Charaktervideo hoch

- Schritt 2: Legen Sie das Basismodell, die Benutzer-ID und die zugehörigen Parameter fest. Klicken Sie auf „Generierung starten“, um das Video zu generieren. Und verwenden Sie die Textoptionen, um Wortkunst hinzuzufügen.

3. Ressourcenbereinigung und Nachbereitung

3.1 Aufräumen

- Nach Abschluss des Experiments können Sie zur entsprechenden Produktkonsole gehen, um die Instanz zu stoppen oder zu löschen (beide Vorgänge sind möglich), Um zu vermeiden, dass die Instanz weiter ausgeführt wird, was zu zusätzlichen Abzügen führt, nachdem das Limit der kostenlosen Testversion überschritten wird ;

- Erwägen Sie die zukünftige Verwendung dieser Instanz>>Stopp; Verwenden Sie diese Instanz in Zukunft nicht mehr>>Löschen Der Ressourcenverbrauch wird nach erfolgreichem Stopp gestoppt.

3.2 Nachbereitung

Während der Gültigkeitsdauer der Testversion können Sie DSW-Instanzen weiterhin für das Modelltraining und die Inferenzüberprüfung verwenden.

Anhang:

Willkommen bei der Mitentwicklung von EasyPhoto, Github-Adresse: https://github.com/aigc-apps/sd-webui-EasyPhoto

Originallink: https://developer.aliyun.com/article/1401917?utm_content=g_1000386818

Dieser Artikel ist Originalinhalt von Alibaba Cloud und darf nicht ohne Genehmigung reproduziert werden.

Das obige ist der detaillierte Inhalt vonPAI x EasyPhoto, verabschieden Sie sich vom Aprilscherz und schaffen Sie eine festliche Atmosphäre mit KI-Fotos. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1376

1376

52

52

Ich habe versucht, die Vibe -Codierung mit Cursor AI und es ist erstaunlich!

Mar 20, 2025 pm 03:34 PM

Ich habe versucht, die Vibe -Codierung mit Cursor AI und es ist erstaunlich!

Mar 20, 2025 pm 03:34 PM

Die Vibe -Codierung verändert die Welt der Softwareentwicklung, indem wir Anwendungen mit natürlicher Sprache anstelle von endlosen Codezeilen erstellen können. Inspiriert von Visionären wie Andrej Karpathy, lässt dieser innovative Ansatz Dev

Top 5 Genai Starts vom Februar 2025: GPT-4,5, GROK-3 & MEHR!

Mar 22, 2025 am 10:58 AM

Top 5 Genai Starts vom Februar 2025: GPT-4,5, GROK-3 & MEHR!

Mar 22, 2025 am 10:58 AM

Februar 2025 war ein weiterer bahnbrechender Monat für die Generative KI, die uns einige der am meisten erwarteten Modell-Upgrades und bahnbrechenden neuen Funktionen gebracht hat. Von Xais Grok 3 und Anthropics Claude 3.7 -Sonett, um g zu eröffnen

Wie benutze ich Yolo V12 zur Objekterkennung?

Mar 22, 2025 am 11:07 AM

Wie benutze ich Yolo V12 zur Objekterkennung?

Mar 22, 2025 am 11:07 AM

Yolo (Sie schauen nur einmal) war ein führender Echtzeit-Objekterkennungsrahmen, wobei jede Iteration die vorherigen Versionen verbessert. Die neueste Version Yolo V12 führt Fortschritte vor, die die Genauigkeit erheblich verbessern

Ist Chatgpt 4 o verfügbar?

Mar 28, 2025 pm 05:29 PM

Ist Chatgpt 4 o verfügbar?

Mar 28, 2025 pm 05:29 PM

Chatgpt 4 ist derzeit verfügbar und weit verbreitet, wodurch im Vergleich zu seinen Vorgängern wie ChatGPT 3.5 signifikante Verbesserungen beim Verständnis des Kontextes und des Generierens kohärenter Antworten zeigt. Zukünftige Entwicklungen können mehr personalisierte Inters umfassen

Gencast von Google: Wettervorhersage mit Gencast Mini Demo

Mar 16, 2025 pm 01:46 PM

Gencast von Google: Wettervorhersage mit Gencast Mini Demo

Mar 16, 2025 pm 01:46 PM

Gencast von Google Deepmind: Eine revolutionäre KI für die Wettervorhersage Die Wettervorhersage wurde einer dramatischen Transformation unterzogen, die sich von rudimentären Beobachtungen zu ausgefeilten AI-angetriebenen Vorhersagen überschreitet. Google DeepMinds Gencast, ein Bodenbrei

Welche KI ist besser als Chatgpt?

Mar 18, 2025 pm 06:05 PM

Welche KI ist besser als Chatgpt?

Mar 18, 2025 pm 06:05 PM

Der Artikel erörtert KI -Modelle, die Chatgpt wie Lamda, Lama und Grok übertreffen und ihre Vorteile in Bezug auf Genauigkeit, Verständnis und Branchenauswirkungen hervorheben. (159 Charaktere)

O1 gegen GPT-4O: Ist OpenAIs neues Modell besser als GPT-4O?

Mar 16, 2025 am 11:47 AM

O1 gegen GPT-4O: Ist OpenAIs neues Modell besser als GPT-4O?

Mar 16, 2025 am 11:47 AM

Openais O1: Ein 12-tägiger Geschenkbummel beginnt mit ihrem bisher mächtigsten Modell Die Ankunft im Dezember bringt eine globale Verlangsamung, Schneeflocken in einigen Teilen der Welt, aber Openai fängt gerade erst an. Sam Altman und sein Team starten ein 12-tägiges Geschenk Ex

Beste KI -Kunstgeneratoren (kostenlos & amp; bezahlt) für kreative Projekte

Apr 02, 2025 pm 06:10 PM

Beste KI -Kunstgeneratoren (kostenlos & amp; bezahlt) für kreative Projekte

Apr 02, 2025 pm 06:10 PM

Der Artikel überprüft Top -KI -Kunstgeneratoren, diskutiert ihre Funktionen, Eignung für kreative Projekte und Wert. Es zeigt MidJourney als den besten Wert für Fachkräfte und empfiehlt Dall-E 2 für hochwertige, anpassbare Kunst.