Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Morph Studio: Kostenlose, 1080P- und 7-Sekunden-starke Dark-Horse-Videobearbeitungssoftware kommt

Morph Studio: Kostenlose, 1080P- und 7-Sekunden-starke Dark-Horse-Videobearbeitungssoftware kommt

Morph Studio: Kostenlose, 1080P- und 7-Sekunden-starke Dark-Horse-Videobearbeitungssoftware kommt

„Leuchtende Quallen steigen langsam aus dem Meer auf“, geben Sie in Morph Studio weiter ein, was Sie sehen möchten, „und verwandeln sich in funkelnde Sternbilder am Nachthimmel.“

Nach ein paar Minuten generiert Morph Studio ein kurzes Video. Eine Qualle ist völlig transparent und funkelnd, dreht sich und steigt auf, ihre schwankende Gestalt bildet einen Kontrast zu den Sternen am Nachthimmel.

Leuchtende Quallen steigen aus einem bezaubernden Meer auf und verwandeln sich in glitzernde Sterne am dunklen Himmel.

Betreten Sie „Joker Cinematic“, und das Gesicht, das einst die Welt eroberte, ist zurück.

Joaquin Phoenix liefert eine hyperrealistische Darstellung als Joker in der filmischen Szene ab, die in den neonbeleuchteten Straßen von New York spielt und Rauch umgibt, der die Atmosphäre des Chaos und der Dunkelheit verstärkt.

Vor kurzem Das Startup Morph Studio hat seine Technologie und Community zur Text-zu-Video-Generierung umfassend aktualisiert. Ihr Modell wurde einer umfassenden Aktualisierung unterzogen, und diese Videoproduktionen zeigen das aktualisierte Modell mit klaren Bildern und lebendigen Details.

Morph Studio ist das erste Team der Welt, das Text-zu-Video-Produkte öffentlich auf den Markt bringt, damit die Öffentlichkeit sie nach Belieben testen kann, bevor Runway die öffentliche Betaversion von Gen2 startete.

Im Vergleich zu anderen beliebten Text-zu-Video-Produkten unterscheidet sich Morph Studio in Bezug auf kostenlose Dienste. Es bietet eine Standardauflösung von 1080P und eine maximale Aufbauzeit von 7 Sekunden vom Start an. Für Text-zu-Video-Produkte sind eine höhere Auflösung, eine längere Generierungszeit und eine bessere Absichtsäußerung drei Schlüsselindikatoren. Bei diesen drei Indikatoren hat Morph das neueste Niveau der Branche erreicht.

Die durchschnittliche Länge einer einzelnen Aufnahme eines Hollywood-Films beträgt 6 Sekunden. Durch die Verlängerung der Generierungszeit auf 7 Sekunden können mehr Benutzer auf ihre kreativen Bedürfnisse eingehen.

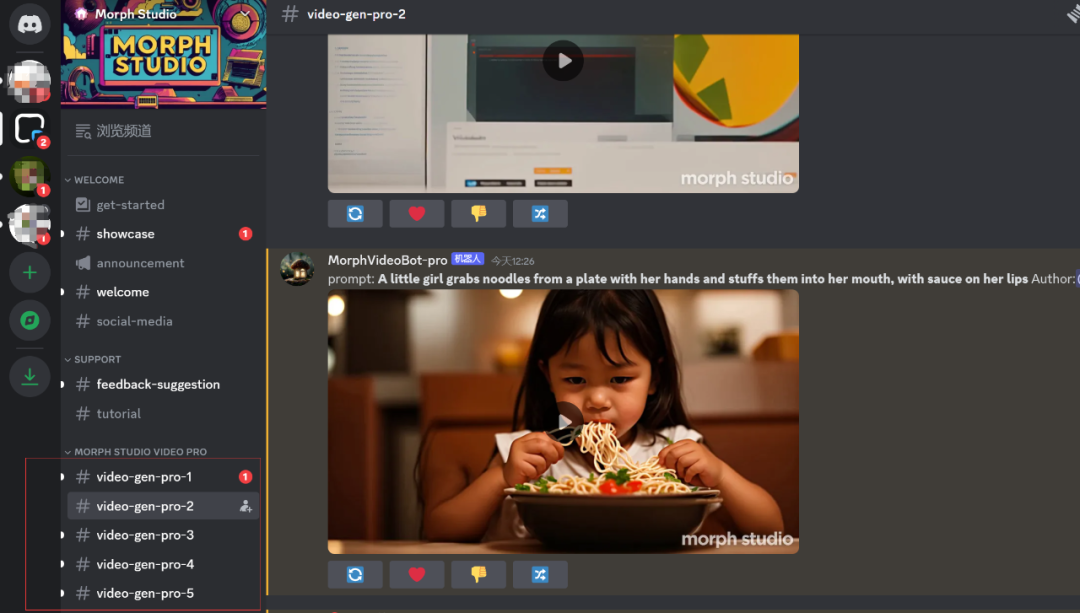

Das Erleben der Modelle von Morph Studio ist ganz einfach. Sie können sie kostenlos nutzen, indem Sie sich bei Discord registrieren.

Das Modell mit dem Wort „Pro“ im roten Feld auf dem Bildschirm ist das aktualisierte Modell und Gegenstand der Erfahrung dieses Artikels.

Kamerabewegung ist die Grundsprache der Videoproduktion und ein wirkungsvolles Erzählmittel. Morph bietet mehrere allgemeine Kamerasprachen, darunter Zoom, Schwenken (nach oben, unten, links, rechts), Drehung (im oder gegen den Uhrzeigersinn) und Standbilder.

Morph bietet auch die MOTION-Funktion (1-10) zur Steuerung der Videobewegung. Je größer der Wert, desto heftiger und übertriebener ist die Aktion. Je kleiner der Wert, desto subtiler und sanfter ist die Aktion.

Die Bildrate (FPS) bietet einen Einstellbereich von 8 bis 30. Je höher der Wert, desto flüssiger das Video und desto größer die Größe. Beispielsweise erzeugt -FPS 30 das flüssigste, aber auch größte Video. Standardmäßig werden alle Videos mit 24 Bildern pro Sekunde erstellt.

Die Standardvideolänge beträgt 3 Sekunden. Um ein 7-Sekunden-Video zu generieren, können Sie -s 7 in den Befehl eingeben. Darüber hinaus bietet das Modell 5 Videoformate zur Auswahl.

Wenn Sie Anforderungen an Details wie Objektiv, Bildrate und Videolänge haben, geben Sie bitte nach Eingabe der Inhaltsaufforderung weiterhin die entsprechenden Parameter ein. (Derzeit wird nur die Eingabe auf Englisch unterstützt.)

Wir haben den aktualisierten Modellservice erlebt und den visuellen Schock, den 1080P mit sich bringt, stark gespürt.

Bis vor kurzem hatten Menschen das erste Foto eines Schneeleoparden, der unter den Sternen spaziert:

Das erste Foto eines Schneeleoparden, der unter den Sternen spaziert.

Wir möchten wissen, ob das Modell von Morph Studio Videos dieses relativ seltenen Tieres generieren kann?

Mit der gleichen Aufforderung platzieren wir die Werke von Morph Studio im oberen Teil des Videos und die mit Pika generierten Werke im unteren Teil des Videos.

ein Schneeleopard, der unter einer sternenklaren Nacht läuft, filmisch realistisch, super detailliert, -Bewegung 10, -AR 16:9, -Heranzoomen, -Schwenken nach oben, -FPS 30, -S 7. Negativ: Zusätzliche Gliedmaßen, Fehlende Arme und Beine, verschmolzene Finger und Beine, zusätzliche Finger, entstellen

Der Antwortbogen von Morph Studio bietet ein genaues Textverständnis. Auf dem 1080P-Bild sind die Haare des Schneeleoparden detailreich und lebensecht. Im Hintergrund sind die Milchstraße und Sterne zu sehen. Allerdings ist die Bewegung des Schneeleoparden nicht offensichtlich.

In Pikas Hausaufgabe läuft der Schneeleopard zwar, aber der Nachthimmel scheint als eine Nacht mit schweren Schneeflocken verstanden zu werden. Es gibt immer noch eine Lücke in Bezug auf Snow Leopard-Stil, Details und Bildschärfe.

Schauen wir uns noch einmal den Effekt der Charaktergenerierung an.

Meisterwerk, beste Qualität, ultradetailliertes RAW-Video, 1 Mädchen, Solotanz, digitale Malerei, wunderschönes Cyborg-Mädchen, 21 Jahre, langes, welliges rotes Haar, blaue Augen, zarte, blassweiße Haut, perfekter Körper, der im unheimlichen Licht der Morgendämmerung in einer Postapokalypse singt

Morph In den von Studio erstellten Arbeiten bringt die hohe Auflösung äußerst feine Gesichtskonturen und Mikroausdrücke hervor, und im Morgenlicht sind Haardetails deutlich sichtbar.

Vorbehaltlich mangelnder Auflösung, Farbe und Lichtstärke sind die von Pika erzeugten Bilder insgesamt bläulich und die Gesichtsdetails der Charaktere sind nicht zufriedenstellend.

Menschen und Tiere haben es alle erlebt, werfen wir einen Blick auf die Erzeugungswirkung von Gebäuden (von Menschenhand geschaffenen Objekten).

La torre eifel sternenklare Nacht von Van Gogh, epischer, stilvoller Kunstkomplex, tiefe Farben, fließende fky, sich bewegende Wolken

Verglichen mit Pikas Werk, das eher an Gemälde erinnert, balanciert das Werk von Morph Studio die Van-Gogh-Elemente besser und realistische Elemente. Die Lichtverhältnisse sind sehr reichhaltig, insbesondere die fließenden Details des Wolkenmeeres, und der Himmel in Pikas Werken ist fast statisch.

Abschließend erleben Sie die Schaffung natürlicher Landschaften.

Eines frühen Morgens stieg die Sonne langsam über den Meeresspiegel und die Wellen berührten sanft den Strand.

Sie fragen sich vielleicht, ob es sich bei den Arbeiten von Morph Studio um echte Aufnahmen handelt, die von menschlichen Fotografen unter natürlichen Bedingungen aufgenommen wurden.

Aufgrund des Fehlens feiner Licht- und Schattenebenen erscheinen die Wellen und der Strand in dem von Pika generierten Video flach und die Bewegungen der Wellen, die auf den Strand treffen, sind relativ langweilig.

Zusätzlich zu dem schockierenden Erlebnis, das eine hohe Auflösung mit sich bringt, mit der gleichen Aufforderung zum Generieren von Videos (z. B. Tiere, Gebäude, Menschen und Naturlandschaftsthemen), werden Gegner bei bestimmten Generierungsaufgaben mehr oder weniger „fehlschlagen“ und Morph Studio bietet eine relativ gute Leistung. Es ist stabiler, hat relativ weniger Eckfälle und kann Benutzerabsichten genauer vorhersagen.

Das Verständnis dieses Startups für Vincent Video ist von Anfang an, dass das Video in der Lage sein muss, Benutzereingaben sehr genau zu beschreiben, und auch alle Optimierungsarbeiten gehen in diese Richtung. Die Modellstruktur von Morph Studio verfügt über ein tieferes Verständnis der Textabsichten. Dieses Update hat einige strukturelle Änderungen vorgenommen und insbesondere detailliertere Anmerkungen für einige Daten vorgenommen.

Neben dem relativ guten Textverständnis wird auch die Detailverarbeitung des Bildes durch die hochauflösende Ausgabe nicht behindert. Tatsächlich war der Aktionsinhalt auf dem Bildschirm nach der Aktualisierung des Modells umfangreicher, was sich auch in den Werken widerspiegelt, die wir mit Morph Studio erstellt haben.

Wenn das „Mädchen mit dem Perlenohrring“ den Kopf bewegt, zittern auch die Ohrringe leicht; die Bilder mit komplexeren Aktionen wie Reiten sind auch flüssiger, zusammenhängender und logischer, und die Ausgabe der Handbewegungen ist auch gut.

1080P bedeutet, dass das Modell mehr Pixel verarbeiten muss, was größere Herausforderungen bei der Detailgenerierung mit sich bringt. Den Ergebnissen nach zu urteilen, kollabiert das Bild jedoch nicht nur nicht, sondern ist aufgrund des hohen Detaillierungsgrades auch ausdrucksstärker .

Dies ist eine Reihe von Naturlandschaften, die wir mithilfe von Modellen erstellt haben, darunter spektakuläre riesige Wellen und Vulkanausbrüche sowie zarte Nahaufnahmen von Blumen.

Eine hochauflösende Ausgabe bietet Benutzern ein besseres visuelles Vergnügen, verlängert aber auch die Ausgabezeit des Modells und beeinträchtigt das Erlebnis.

Morph Studio generiert jetzt 1080p-Videos in dreieinhalb Minuten, was der gleichen Geschwindigkeit wie Pikas 720P-Videos entspricht. Start-up-Unternehmen verfügen nur über begrenzte Rechenressourcen, sodass es für Morph Studio nicht einfach ist, SOTA aufrechtzuerhalten.

Außerdem unterstützen Morph Studio-Modelle in Bezug auf den Videostil neben dem Filmrealismus auch gängige Stile wie Comics und 3D-Animationen.

Morph Studio konzentriert sich auf Text-to-Video-Technologie und gilt als die nächste Stufe des KI-Branchenwettbewerbs.

„Instant-Video könnte den nächsten Sprung in der KI-Technologie darstellen“, sagte die New York Times in der Überschrift eines Technologieberichts und argumentierte, dass es genauso wichtig sein wird wie der Webbrowser und das iPhone.

Im September 2022 hat Metas Ingenieurteam für maschinelles Lernen ein neues System namens Make-A-Video eingeführt. Benutzer geben eine grobe Beschreibung der Szene ein und das System generiert ein entsprechendes kurzes Video.

Im November 2022 veröffentlichten Forscher der Tsinghua-Universität und der Beijing Academy of Artificial Intelligence (BAAI) auch CogVideo.

Damals waren die von diesen Modellen generierten Videos nicht nur unscharf (die von CogVideo generierte Videoauflösung betrug beispielsweise nur 480 x 480), die Bilder waren auch relativ verzerrt und es gab viele technische Einschränkungen. Sie stellen jedoch immer noch eine bedeutende Entwicklung in der Generierung von KI-Inhalten dar.

Oberflächlich betrachtet ist ein Video nur eine Reihe von Einzelbildern (Standbildern), die so zusammengesetzt sind, dass die Illusion von Bewegung entsteht. Allerdings ist es deutlich schwieriger, die zeitliche und räumliche Konsistenz einer Bildserie sicherzustellen.

Das Aufkommen des Diffusionsmodells hat die Entwicklung der Technologie beschleunigt. Forscher haben versucht, das Diffusionsmodell auf andere Bereiche wie Audio, 3D und Video zu übertragen, und die Videosynthesetechnologie hat erhebliche Fortschritte gemacht.

Die auf dem Diffusionsmodell basierende Technologie ermöglicht es dem neuronalen Netzwerk hauptsächlich, einige Muster automatisch zu lernen, indem es umfangreiche Bilder, Videos und Textbeschreibungen aussortiert. Wenn Sie Inhaltsanforderungen eingeben, generiert das neuronale Netzwerk eine Liste aller Merkmale, die seiner Meinung nach zur Erstellung des Bildes verwendet werden könnten (denken Sie an die Umrisse von Katzenohren oder die Kanten eines Telefons).

Dann ist das zweite neuronale Netzwerk (auch als Diffusionsmodell bekannt) dafür verantwortlich, das Bild zu erstellen, die für diese Funktionen erforderlichen Pixel zu generieren und die Pixel in ein kohärentes Bild umzuwandeln.

Durch die Analyse Tausender Videos kann die KI lernen, viele Standbilder auf ähnlich zusammenhängende Weise aneinanderzureihen. Der Schlüssel besteht darin, ein Modell zu trainieren, das die Beziehungen und die Konsistenz zwischen den einzelnen Frames wirklich versteht.

„Dies ist eine der beeindruckendsten Technologien, die wir in den letzten hundert Jahren entwickelt haben“, sagte Runway-CEO Cristóbal Valenzuela einmal den Medien: „Man muss die Leute dazu bringen, sie tatsächlich zu nutzen.“

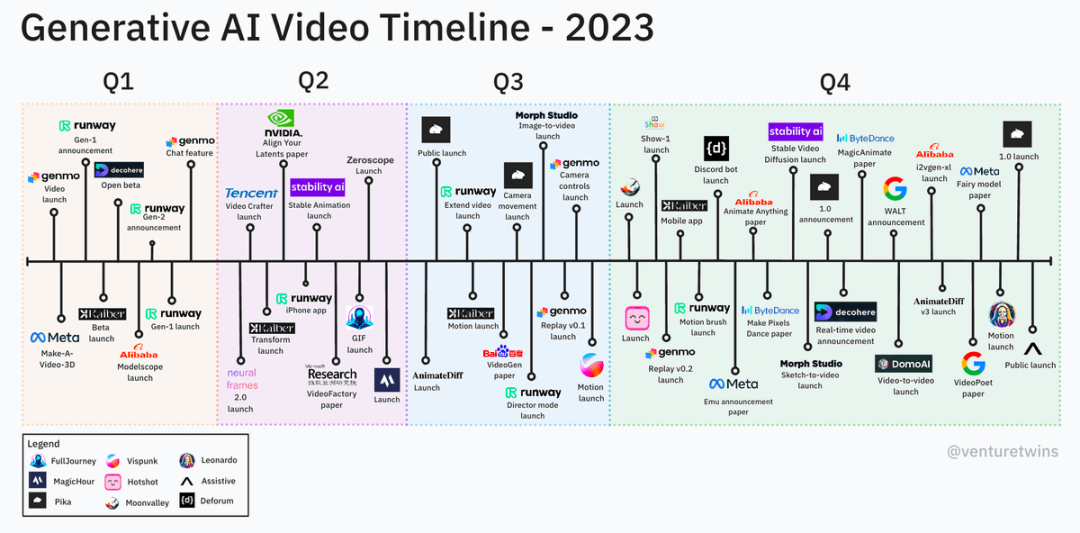

2023 wird von einigen in der Branche als Durchbruchjahr für die Videosynthese angesehen. Im Januar gab es kein öffentlich verfügbares Text-zu-Video-Modell, und bis zum Jahresende gab es Dutzende ähnlicher Produkte und Millionen von Benutzern.

a16z-Partnerin Justine Moore hat die Zeitleiste von Vincents Videomodell auf sozialen Plattformen geteilt. Daraus können wir ersehen, dass es neben großen Herstellern auch eine sehr hohe Geschwindigkeit bei der Technologieiteration gibt schnell.

Die aktuellen KI-generierten Videos haben kein einheitliches und klares technisches Paradigma ähnlich wie LLM gebildet. Die Branche befindet sich noch in der Erkundungsphase, wie stabile Videos generiert werden können. Die Forscher glauben jedoch, dass diese Mängel behoben werden können, wenn ihr System mit immer mehr Daten trainiert wird. Letztendlich wird diese Technologie das Erstellen von Videos so einfach machen wie das Schreiben von Sätzen.

Ein hochrangiger inländischer Investor der KI-Branche teilte uns mit, dass mehrere der wichtigsten Artikel zur Vincent Video Technology im Juli-August 2022 veröffentlicht wurden. In Analogie zum Industrialisierungsprozess von Vincent Video steht diese Technologie der Transformation der Branche nahe Der Knoten wird ein Jahr später, also Juli-August 2023, erscheinen.

Die gesamte Videotechnologie entwickelt sich sehr schnell und die Technologie wird immer ausgereifter. Dieser Investor sagte, dass er aufgrund früherer Investitionserfahrungen im GAN-Bereich davon ausgeht, dass die Text-to-Video-Technologie ein Produkt sein wird in den nächsten sechs Monaten bis zu einem Jahr.

Das Morph-Team vereint die besten jungen Forscher auf dem Gebiet der Videogenerierung. Nach intensiver Forschung und Entwicklung Tag und Nacht im vergangenen Jahr hat Gründer Xu Huaizhe zusammen mit den Mitbegründern Li Feng, Yin Zixin und Zhao Shihao , Liu Shaoteng und andere wichtige technische Rückgrate haben das Rätsel der KI-Videogenerierung gelöst.

Zusätzlich zum technischen Team hat Morph Studio kürzlich auch sein Produktteam verstärkt, ein Vertragsproduzent von Maoyan Films, ein Juror des Shanghai International Film Festival und ein Kernmitglied des ehemaligen AIGC-Unternehmens in Silicon Valley ist kürzlich ebenfalls Morph Studio beigetreten.

Haising sagte, dass Morph Studio in Bezug auf die technische Forschung eine führende Position in der gesamten Branche einnimmt; das Team sei flach, die Kommunikationseffizienz und die Ausführung seien besonders hoch; Ihr größter Traum war es, einer Animationsfirma beizutreten. Nach dem Aufkommen der KI-Ära wurde ihr schnell klar, dass sich die Animationsbranche in den letzten Jahrzehnten auf 3D-Engines stützen würde und bald eine neue Ära der KI-Engines einläuten würde. Der Pixar der Zukunft wird in einem KI-Unternehmen geboren. Und Morph war ihre Wahl.

Gründer Xu Huaizhe sagte, dass Morph aktiv an der Entwicklung von KI-Videos arbeitet. Wir sind entschlossen, eine Super-App im KI-Video-Zeitalter zu sein und Träume für Benutzer zu verwirklichen.

Der Track wird 2024 seinen eigenen Midjourney-Moment haben, fügte er hinzu.

PS: Um den ursprünglichen Spaß der kostenlosen 1080P-Videogenerierung zu erleben, gehen Sie bitte zu:

https://discord.com/invite/VVqS8QnBkA

Das obige ist der detaillierte Inhalt vonMorph Studio: Kostenlose, 1080P- und 7-Sekunden-starke Dark-Horse-Videobearbeitungssoftware kommt. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

Video Face Swap

Tauschen Sie Gesichter in jedem Video mühelos mit unserem völlig kostenlosen KI-Gesichtstausch-Tool aus!

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1387

1387

52

52

Das weltweit leistungsstärkste Open-Source-MoE-Modell ist da, mit chinesischen Fähigkeiten, die mit GPT-4 vergleichbar sind, und der Preis beträgt nur fast ein Prozent von GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Das weltweit leistungsstärkste Open-Source-MoE-Modell ist da, mit chinesischen Fähigkeiten, die mit GPT-4 vergleichbar sind, und der Preis beträgt nur fast ein Prozent von GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Stellen Sie sich ein Modell der künstlichen Intelligenz vor, das nicht nur die Fähigkeit besitzt, die traditionelle Datenverarbeitung zu übertreffen, sondern auch eine effizientere Leistung zu geringeren Kosten erzielt. Dies ist keine Science-Fiction, DeepSeek-V2[1], das weltweit leistungsstärkste Open-Source-MoE-Modell, ist da. DeepSeek-V2 ist ein leistungsstarkes MoE-Sprachmodell (Mix of Experts) mit den Merkmalen eines wirtschaftlichen Trainings und einer effizienten Inferenz. Es besteht aus 236B Parametern, von denen 21B zur Aktivierung jedes Markers verwendet werden. Im Vergleich zu DeepSeek67B bietet DeepSeek-V2 eine stärkere Leistung, spart gleichzeitig 42,5 % der Trainingskosten, reduziert den KV-Cache um 93,3 % und erhöht den maximalen Generierungsdurchsatz auf das 5,76-fache. DeepSeek ist ein Unternehmen, das sich mit allgemeiner künstlicher Intelligenz beschäftigt

KI untergräbt die mathematische Forschung! Der Gewinner der Fields-Medaille und der chinesisch-amerikanische Mathematiker führten 11 hochrangige Arbeiten an | Gefällt mir bei Terence Tao

Apr 09, 2024 am 11:52 AM

KI untergräbt die mathematische Forschung! Der Gewinner der Fields-Medaille und der chinesisch-amerikanische Mathematiker führten 11 hochrangige Arbeiten an | Gefällt mir bei Terence Tao

Apr 09, 2024 am 11:52 AM

KI verändert tatsächlich die Mathematik. Vor kurzem hat Tao Zhexuan, der diesem Thema große Aufmerksamkeit gewidmet hat, die neueste Ausgabe des „Bulletin of the American Mathematical Society“ (Bulletin der American Mathematical Society) weitergeleitet. Zum Thema „Werden Maschinen die Mathematik verändern?“ äußerten viele Mathematiker ihre Meinung. Der gesamte Prozess war voller Funken, knallhart und aufregend. Der Autor verfügt über eine starke Besetzung, darunter der Fields-Medaillengewinner Akshay Venkatesh, der chinesische Mathematiker Zheng Lejun, der NYU-Informatiker Ernest Davis und viele andere bekannte Wissenschaftler der Branche. Die Welt der KI hat sich dramatisch verändert. Viele dieser Artikel wurden vor einem Jahr eingereicht.

Google ist begeistert: JAX-Leistung übertrifft Pytorch und TensorFlow! Es könnte die schnellste Wahl für das GPU-Inferenztraining werden

Apr 01, 2024 pm 07:46 PM

Google ist begeistert: JAX-Leistung übertrifft Pytorch und TensorFlow! Es könnte die schnellste Wahl für das GPU-Inferenztraining werden

Apr 01, 2024 pm 07:46 PM

Die von Google geförderte Leistung von JAX hat in jüngsten Benchmark-Tests die von Pytorch und TensorFlow übertroffen und belegt bei 7 Indikatoren den ersten Platz. Und der Test wurde nicht auf der TPU mit der besten JAX-Leistung durchgeführt. Obwohl unter Entwicklern Pytorch immer noch beliebter ist als Tensorflow. Aber in Zukunft werden möglicherweise mehr große Modelle auf Basis der JAX-Plattform trainiert und ausgeführt. Modelle Kürzlich hat das Keras-Team drei Backends (TensorFlow, JAX, PyTorch) mit der nativen PyTorch-Implementierung und Keras2 mit TensorFlow verglichen. Zunächst wählen sie eine Reihe von Mainstream-Inhalten aus

Hallo, elektrischer Atlas! Der Boston Dynamics-Roboter erwacht wieder zum Leben, seltsame 180-Grad-Bewegungen machen Musk Angst

Apr 18, 2024 pm 07:58 PM

Hallo, elektrischer Atlas! Der Boston Dynamics-Roboter erwacht wieder zum Leben, seltsame 180-Grad-Bewegungen machen Musk Angst

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas tritt offiziell in die Ära der Elektroroboter ein! Gestern hat sich der hydraulische Atlas einfach „unter Tränen“ von der Bühne der Geschichte zurückgezogen. Heute gab Boston Dynamics bekannt, dass der elektrische Atlas im Einsatz ist. Es scheint, dass Boston Dynamics im Bereich kommerzieller humanoider Roboter entschlossen ist, mit Tesla zu konkurrieren. Nach der Veröffentlichung des neuen Videos wurde es innerhalb von nur zehn Stunden bereits von mehr als einer Million Menschen angesehen. Die alten Leute gehen und neue Rollen entstehen. Das ist eine historische Notwendigkeit. Es besteht kein Zweifel, dass dieses Jahr das explosive Jahr der humanoiden Roboter ist. Netizens kommentierten: Die Weiterentwicklung der Roboter hat dazu geführt, dass die diesjährige Eröffnungsfeier wie Menschen aussieht, und der Freiheitsgrad ist weitaus größer als der von Menschen. Aber ist das wirklich kein Horrorfilm? Zu Beginn des Videos liegt Atlas ruhig auf dem Boden, scheinbar auf dem Rücken. Was folgt, ist atemberaubend

KAN, das MLP ersetzt, wurde durch Open-Source-Projekte auf Faltung erweitert

Jun 01, 2024 pm 10:03 PM

KAN, das MLP ersetzt, wurde durch Open-Source-Projekte auf Faltung erweitert

Jun 01, 2024 pm 10:03 PM

Anfang dieses Monats schlugen Forscher des MIT und anderer Institutionen eine vielversprechende Alternative zu MLP vor – KAN. KAN übertrifft MLP in Bezug auf Genauigkeit und Interpretierbarkeit. Und es kann MLP, das mit einer größeren Anzahl von Parametern ausgeführt wird, mit einer sehr kleinen Anzahl von Parametern übertreffen. Beispielsweise gaben die Autoren an, dass sie KAN nutzten, um die Ergebnisse von DeepMind mit einem kleineren Netzwerk und einem höheren Automatisierungsgrad zu reproduzieren. Konkret verfügt DeepMinds MLP über etwa 300.000 Parameter, während KAN nur etwa 200 Parameter hat. KAN hat eine starke mathematische Grundlage wie MLP und basiert auf dem universellen Approximationssatz, während KAN auf dem Kolmogorov-Arnold-Darstellungssatz basiert. Wie in der folgenden Abbildung gezeigt, hat KAN

So posten Sie Videos auf Weibo, ohne die Bildqualität zu komprimieren_So posten Sie Videos auf Weibo, ohne die Bildqualität zu komprimieren

Mar 30, 2024 pm 12:26 PM

So posten Sie Videos auf Weibo, ohne die Bildqualität zu komprimieren_So posten Sie Videos auf Weibo, ohne die Bildqualität zu komprimieren

Mar 30, 2024 pm 12:26 PM

1. Öffnen Sie zunächst Weibo auf Ihrem Mobiltelefon und klicken Sie unten rechts auf [Ich] (wie im Bild gezeigt). 2. Klicken Sie dann oben rechts auf [Zahnrad], um die Einstellungen zu öffnen (wie im Bild gezeigt). 3. Suchen und öffnen Sie dann [Allgemeine Einstellungen] (wie im Bild gezeigt). 4. Geben Sie dann die Option [Video Follow] ein (wie im Bild gezeigt). 5. Öffnen Sie dann die Einstellung [Video-Upload-Auflösung] (wie im Bild gezeigt). 6. Wählen Sie abschließend [Originalbildqualität] aus, um eine Komprimierung zu vermeiden (wie im Bild gezeigt).

FisheyeDetNet: der erste Zielerkennungsalgorithmus basierend auf einer Fischaugenkamera

Apr 26, 2024 am 11:37 AM

FisheyeDetNet: der erste Zielerkennungsalgorithmus basierend auf einer Fischaugenkamera

Apr 26, 2024 am 11:37 AM

Die Zielerkennung ist ein relativ ausgereiftes Problem in autonomen Fahrsystemen, wobei die Fußgängererkennung einer der ersten Algorithmen ist, die eingesetzt werden. In den meisten Arbeiten wurde eine sehr umfassende Recherche durchgeführt. Die Entfernungswahrnehmung mithilfe von Fischaugenkameras für die Rundumsicht ist jedoch relativ wenig untersucht. Aufgrund der großen radialen Verzerrung ist es schwierig, die standardmäßige Bounding-Box-Darstellung in Fischaugenkameras zu implementieren. Um die obige Beschreibung zu vereinfachen, untersuchen wir erweiterte Begrenzungsrahmen-, Ellipsen- und allgemeine Polygondesigns in Polar-/Winkeldarstellungen und definieren eine mIOU-Metrik für die Instanzsegmentierung, um diese Darstellungen zu analysieren. Das vorgeschlagene Modell „fisheyeDetNet“ mit polygonaler Form übertrifft andere Modelle und erreicht gleichzeitig 49,5 % mAP auf dem Valeo-Fisheye-Kameradatensatz für autonomes Fahren

Tesla-Roboter arbeiten in Fabriken, Musk: Der Freiheitsgrad der Hände wird dieses Jahr 22 erreichen!

May 06, 2024 pm 04:13 PM

Tesla-Roboter arbeiten in Fabriken, Musk: Der Freiheitsgrad der Hände wird dieses Jahr 22 erreichen!

May 06, 2024 pm 04:13 PM

Das neueste Video von Teslas Roboter Optimus ist veröffentlicht und er kann bereits in der Fabrik arbeiten. Bei normaler Geschwindigkeit sortiert es Batterien (Teslas 4680-Batterien) so: Der Beamte hat auch veröffentlicht, wie es bei 20-facher Geschwindigkeit aussieht – auf einer kleinen „Workstation“, pflücken und pflücken und pflücken: Dieses Mal wird es freigegeben. Eines der Highlights Der Vorteil des Videos besteht darin, dass Optimus diese Arbeit in der Fabrik völlig autonom und ohne menschliches Eingreifen während des gesamten Prozesses erledigt. Und aus Sicht von Optimus kann es auch die krumme Batterie aufnehmen und platzieren, wobei der Schwerpunkt auf der automatischen Fehlerkorrektur liegt: In Bezug auf die Hand von Optimus gab der NVIDIA-Wissenschaftler Jim Fan eine hohe Bewertung ab: Die Hand von Optimus ist der fünffingrige Roboter der Welt am geschicktesten. Seine Hände sind nicht nur taktil