Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Produziert von der Peking-Universität: Das neueste SOTA mit Texturqualität und Multi-View-Konsistenz, das eine 3D-Konvertierung eines Bildes in 2 Minuten ermöglicht

Produziert von der Peking-Universität: Das neueste SOTA mit Texturqualität und Multi-View-Konsistenz, das eine 3D-Konvertierung eines Bildes in 2 Minuten ermöglicht

Produziert von der Peking-Universität: Das neueste SOTA mit Texturqualität und Multi-View-Konsistenz, das eine 3D-Konvertierung eines Bildes in 2 Minuten ermöglicht

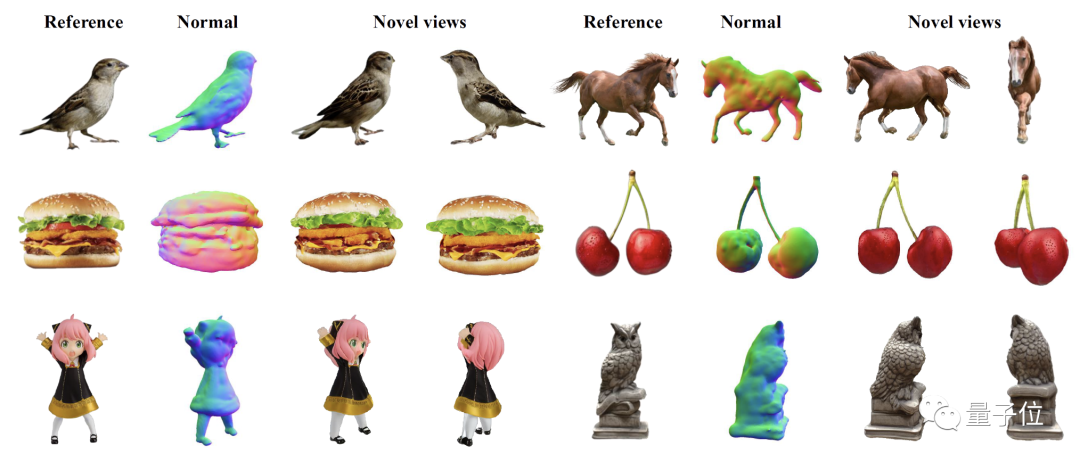

Es dauert nur zwei Minuten, Bilder in 3D zu konvertieren!

Es ist auch die Art mit hoher Texturqualität, Multi-Viewing und hoher Konsistenz.

Egal um welche Art es sich handelt, das Einzelansichtsbild sieht bei der Eingabe immer noch so aus:

Nach zwei Minuten ist die 3D-Version fertig:

△, Repaint123 (NeRF ); Als nächstes Repaint123 (GS)

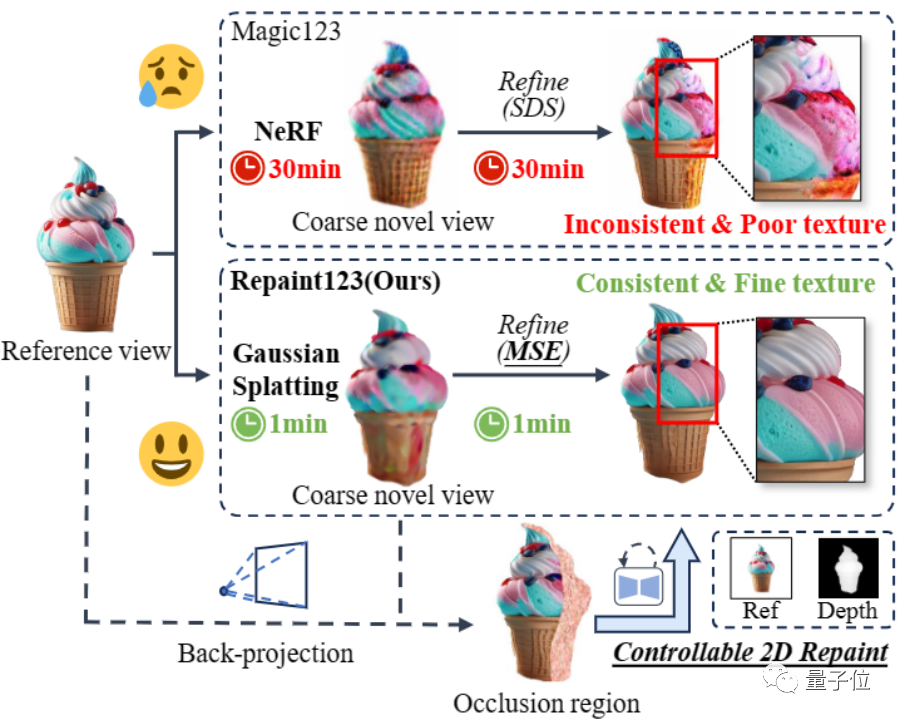

Die neue Methode heißt Repaint123. Die Kernidee besteht darin, die leistungsstarken Bilderzeugungsfähigkeiten des 2D-Diffusionsmodells mit den Texturausrichtungsfähigkeiten der Repaint-Strategie zu kombinieren, um hohe Werte zu erzeugen -Qualität, konsistente Bilder mit mehreren Ansichten.

Darüber hinaus stellt diese Forschung auch eine Methode zur sichtbarkeitsbewussten adaptiven Neulackierungsintensität für überlappende Bereiche vor.

Repaint123 löst die Probleme früherer Methoden wie große Abweichungen bei mehreren Ansichten, Texturverschlechterung und langsame Generierung auf einen Schlag.

Derzeit ist der Projektcode noch nicht auf GitHub veröffentlicht, aber über 100 Leute sind gekommen, um ihn zu markieren:

Wie sieht Repaint123 aus?

Früher verwendete die Methode zur Konvertierung von Bildern in 3D normalerweise Score Distillation Sampling (SDS). Obwohl die Ergebnisse dieser Methode beeindruckend sind, gibt es einige Probleme wie Inkonsistenz bei mehreren Ansichten, Übersättigung, zu stark geglättete Texturen und langsame Generierungsgeschwindigkeit.

△Von oben nach unten: Eingabe, Zero123-XL, Magic123, Dream Gaußian

Um diese Probleme zu lösen, schlugen Forscher der Peking-Universität, des Pengcheng-Labors, der National University of Singapore und der Wuhan-Universität Repaint123 vor.

Im Allgemeinen hat Repaint123 die folgenden Beiträge:

(1) Repaint123 kann qualitativ hochwertige Bildsequenzen generieren, indem es den kontrollierbaren Neuzeichnungsprozess von Bildern bis zur 3D-Generierung umfassend berücksichtigt und sicherstellt, dass diese Bilder über mehrere hinweg konsistent sind Perspektiven.

(2)Repaint123 schlägt eine einfache Basismethode für die 3D-Generierung in Einzelansichten vor.

In der Rohmodellphase wird Zero123 als 3D-Priori in Kombination mit der SDS-Verlustfunktion verwendet, um durch Optimierung der Gaußschen Splatting-Geometrie schnell ein grobes 3D-Modell zu generieren (nur 1 Minute).

In der Feinmodellphase wird die stabile Diffusion als 2D-Priori in Kombination mit der MSE-Verlustfunktion (Mean Square Error) verwendet, um durch schnelles Verfeinern der Netztextur ein hochwertiges 3D-Modell zu generieren (dauert ebenfalls nur 1 Minute). .

(3) Eine Vielzahl von Experimenten hat die Wirksamkeit der Repaint123-Methode nachgewiesen. Es ist in der Lage, aus einem einzigen Bild in nur 2 Minuten hochwertige 3D-Inhalte zu generieren, die der Qualität der 2D-Generierung entsprechen.

△Erzielen Sie eine konsistente und qualitativ hochwertige Einzelansicht-3D-Schnellgenerierung.

Werfen wir einen Blick auf die spezifischen Methoden.

Repaint123 konzentriert sich auf die Optimierung der Netzverfeinerungsphase und seine Hauptverbesserungsrichtungen decken zwei Aspekte ab: die Generierung hochwertiger Bildsequenzen mit Multi-View-Konsistenz und die Erzielung einer schnellen und hochwertigen 3D-Rekonstruktion.

1. Generieren hochwertiger Bildsequenzen mit Multi-View-Konsistenz

Das Generieren hochwertiger Bildsequenzen mit Multi-View-Konsistenz ist in die folgenden drei Teile unterteilt:

△Multi-View-konsistente Bildgenerierung Prozess

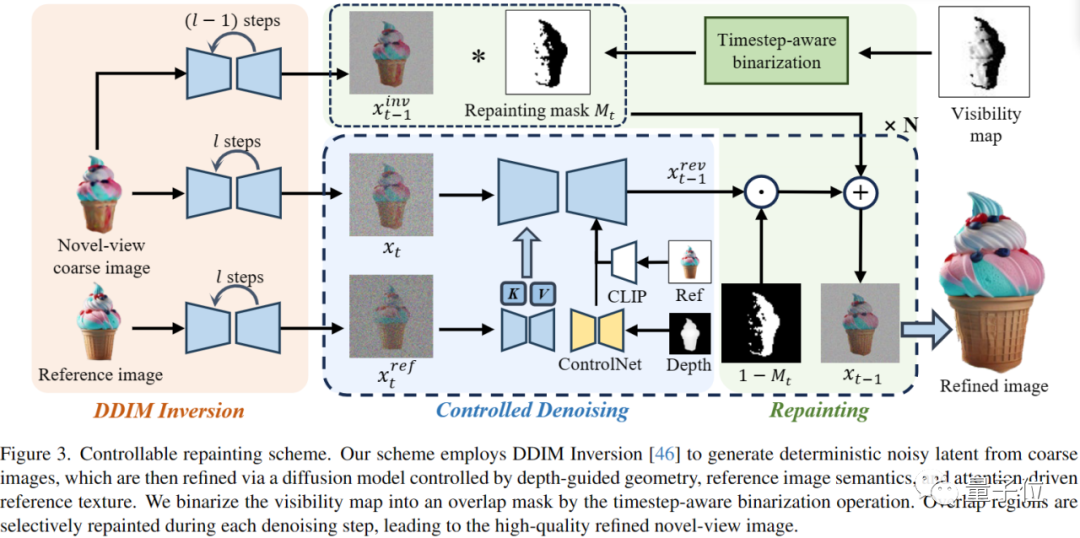

DDIM-Inversion

Um die in der Grobmodellstufe erzeugten 3D-konsistenten Niederfrequenz-Texturinformationen beizubehalten, verwendet der Autor die DDIM-Inversion, um das Bild in einen bestimmten latenten Raum zu invertieren und so den Grundstein für die anschließende Entrauschung zu legen Prozess, der originalgetreue und konsistente Bilder erzeugt.

Kontrollierbare Rauschunterdrückung

Um die geometrische Konsistenz und die Texturkonsistenz über große Entfernungen in der Entrauschungsphase zu steuern, führte der Autor ControlNet ein, indem er die vom groben Modell gerenderte Tiefenkarte als geometrischen Prior verwendete und gleichzeitig die Aufmerksamkeitsfunktion der Referenz einfügte Bild für Texturmigration.

Um eine klassifikatorfreie Führung zur Verbesserung der Bildqualität durchzuführen, verwendet das Papier außerdem CLIP, um Referenzbilder in Bildhinweise zur Führung des Rauschunterdrückungsnetzwerks zu kodieren.

Neuzeichnen

Progressives Neuzeichnen von Okklusionen und überlappenden Teilen Um sicherzustellen, dass die überlappenden Bereiche benachbarter Bilder in der Bildsequenz auf Pixelebene ausgerichtet sind, wendet der Autor eine Strategie des progressiven lokalen Neuzeichnens an.

Erzeugen Sie harmonische angrenzende Bereiche, während überlappende Bereiche unverändert bleiben, und erweitern Sie sie schrittweise auf 360° aus der Referenzperspektive.

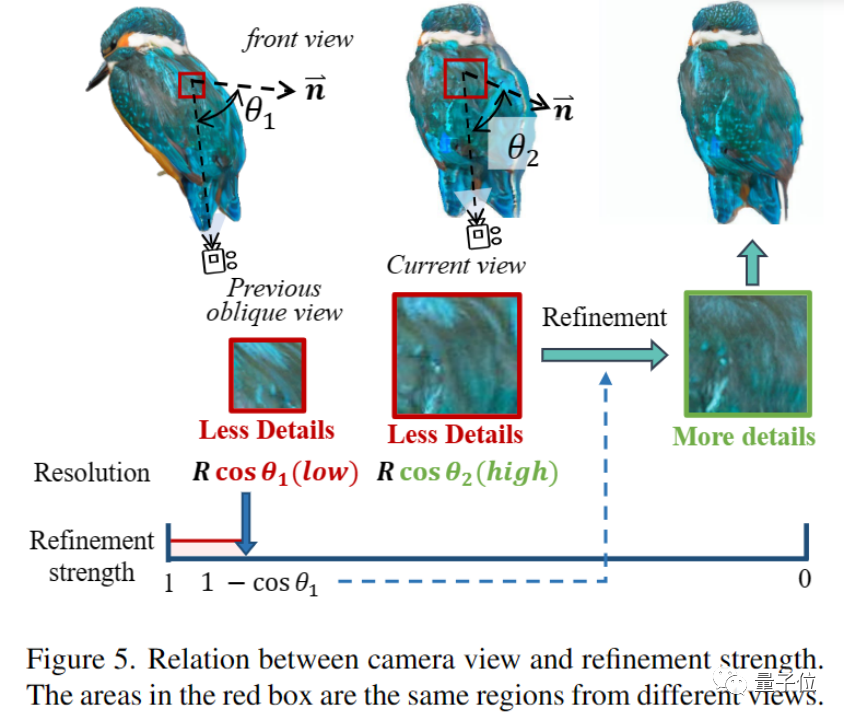

Wie in der Abbildung unten gezeigt, stellte der Autor jedoch fest, dass auch der überlappende Bereich verfeinert werden muss, da die visuelle Auflösung des zuvor schielenden Bereichs während der Emmetropie größer wird und mehr Hochfrequenzinformationen hinzugefügt werden müssen.

Darüber hinaus ist die Ausdünnungsintensität gleich 1-cosθ*, wobei θ* der Maximalwert des Winkels θ zwischen allen vorherigen Kamerawinkeln und dem Normalenvektor der betrachteten Oberfläche ist, wodurch die Überlappung adaptiv neu gezeichnet wird Bereich.

△Die Beziehung zwischen Kamerawinkel und Ausdünnungsintensität

Um die geeignete Ausdünnungsintensität zu wählen, um die Wiedergabetreue zu gewährleisten und gleichzeitig die Qualität zu verbessern, stützte sich der Autor auf das Projektionstheorem und die Idee der Bild-Superauflösung und schlug vor Eine einfache und unkomplizierte Strategie zur sichtbarkeitsbewussten Neuzeichnung, um überlappende Bereiche zu verfeinern.

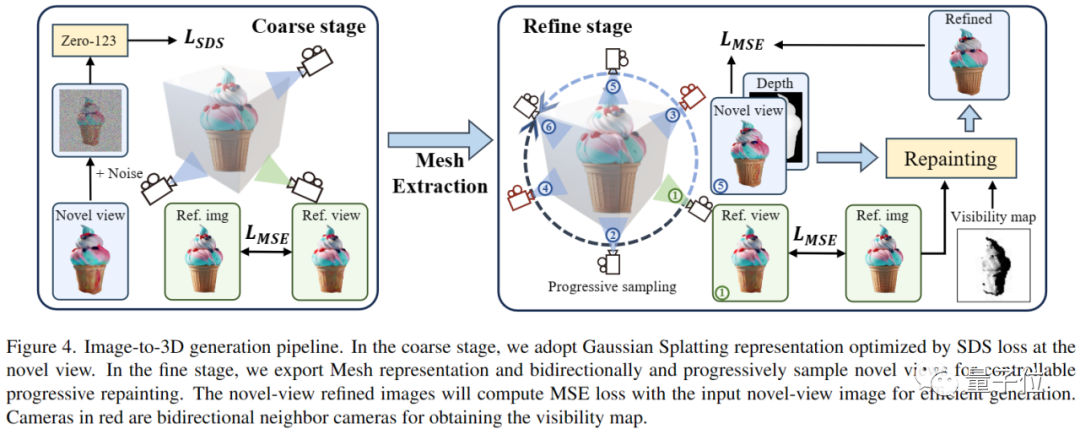

2. Schnelle und qualitativ hochwertige 3D-Rekonstruktion

Wie in der Abbildung unten gezeigt, wendet der Autor eine zweistufige Methode im Prozess der schnellen und qualitativ hochwertigen 3D-Rekonstruktion an.

△Repaint123 zweistufiges Einzelansicht-3D-Generierungsframework

Zunächst nutzen sie die Gaußsche Splatting-Darstellung, um schnell vernünftige geometrische Strukturen und grobe Texturen zu generieren.

Gleichzeitig ist der Autor mit Hilfe der zuvor generierten, konsistenten und qualitativ hochwertigen Multi-View-Bildsequenz in der Lage, eine schnelle 3D-Texturrekonstruktion unter Verwendung eines einfachen mittleren quadratischen Fehlers (MSE) Verlust durchzuführen.

Optimale Konsistenz, Qualität und Geschwindigkeit

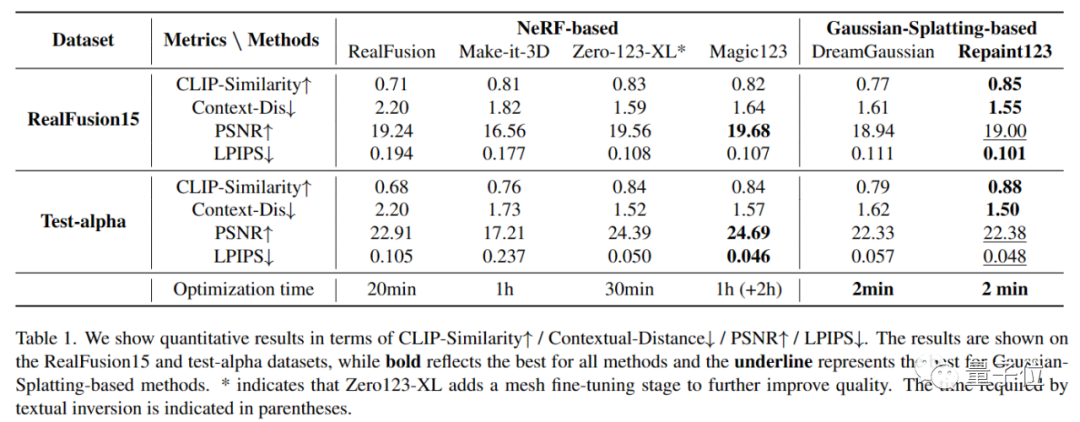

Forscher verglichen Methoden für mehrere Einzelansichtsgenerierungsaufgaben.

△Einzelansicht-3D-Generierungsvisualisierungsvergleich

Auf RealFusion15- und Test-Alpha-Datensätzen erzielte Repaint123 die besten Ergebnisse in drei Aspekten: Konsistenz, Qualität und Geschwindigkeit.

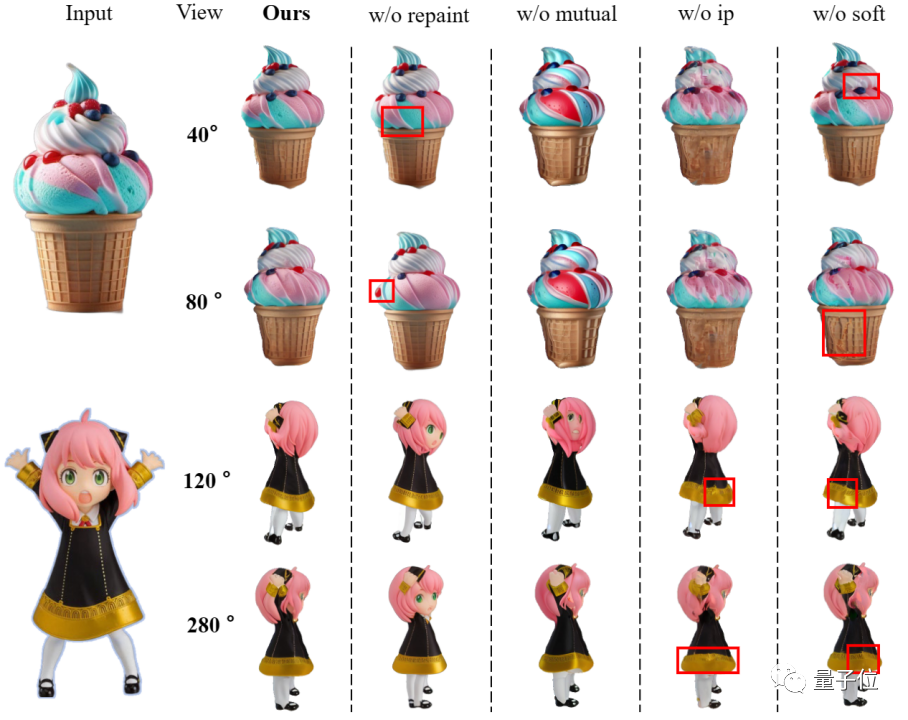

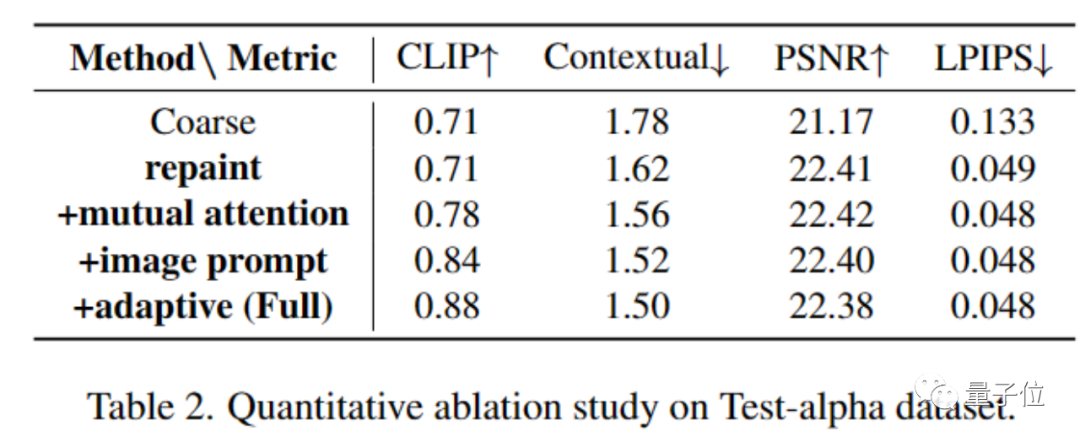

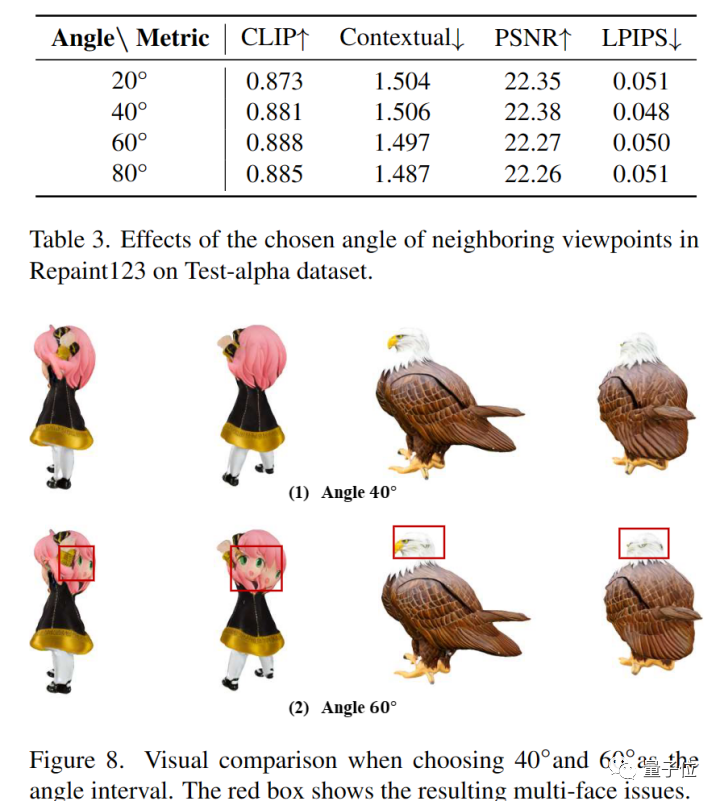

Gleichzeitig führte der Autor auch Ablationsexperimente zur Wirksamkeit jedes in der Arbeit verwendeten Moduls und zum Inkrement der Betrachtungswinkelrotation durch:

und stellte fest, dass das Betrachtungswinkelintervall 60 beträgt Grad erreicht die Leistung ihren Höhepunkt. Ein zu großes Betrachtungswinkelintervall verringert jedoch den Überlappungsbereich und erhöht die Möglichkeit vielschichtiger Probleme, sodass 40 Grad als optimales Betrachtungswinkelintervall verwendet werden können.

Papieradresse: https://arxiv.org/pdf/2312.13271.pdf

Codeadresse: https://pku-yuangroup.github.io/repaint123/

Projektadresse: https: //pku-yuangroup.github.io/repaint123/

Das obige ist der detaillierte Inhalt vonProduziert von der Peking-Universität: Das neueste SOTA mit Texturqualität und Multi-View-Konsistenz, das eine 3D-Konvertierung eines Bildes in 2 Minuten ermöglicht. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

So löschen Sie den Verlauf der letzten Desktop-Hintergrundbilder in Windows 11

Apr 14, 2023 pm 01:37 PM

So löschen Sie den Verlauf der letzten Desktop-Hintergrundbilder in Windows 11

Apr 14, 2023 pm 01:37 PM

<p>Windows 11 verbessert die Personalisierung im System und ermöglicht es Benutzern, einen aktuellen Verlauf zuvor vorgenommener Desktop-Hintergrundänderungen anzuzeigen. Wenn Sie den Abschnitt „Personalisierung“ in der Anwendung „Windows-Systemeinstellungen“ aufrufen, werden Ihnen verschiedene Optionen angezeigt. Eine davon ist das Ändern des Hintergrundbilds. Aber jetzt ist es möglich, den neuesten Verlauf der auf Ihrem System eingestellten Hintergrundbilder anzuzeigen. Wenn Ihnen dies nicht gefällt und Sie den aktuellen Verlauf löschen oder löschen möchten, lesen Sie diesen Artikel weiter. Dort erfahren Sie mehr darüber, wie Sie dies mit dem Registrierungseditor tun. </p><h2>So verwenden Sie die Registrierungsbearbeitung

So laden Sie das Windows Spotlight-Hintergrundbild auf den PC herunter

Aug 23, 2023 pm 02:06 PM

So laden Sie das Windows Spotlight-Hintergrundbild auf den PC herunter

Aug 23, 2023 pm 02:06 PM

Bei Fenstern kommt die Ästhetik nie zu kurz. Von den idyllischen grünen Feldern von XP bis zum blauen, wirbelnden Design von Windows 11 erfreuen Standard-Desktop-Hintergründe seit Jahren die Benutzer. Mit Windows Spotlight haben Sie jetzt jeden Tag direkten Zugriff auf wunderschöne, beeindruckende Bilder für Ihren Sperrbildschirm und Ihr Desktop-Hintergrundbild. Leider bleiben diese Bilder nicht hängen. Wenn Sie sich in eines der Windows-Spotlight-Bilder verliebt haben, möchten Sie vielleicht wissen, wie Sie sie herunterladen können, damit Sie sie für eine Weile als Hintergrund behalten können. Hier finden Sie alles, was Sie wissen müssen. Was ist WindowsSpotlight? Window Spotlight ist ein automatischer Hintergrund-Updater, der unter Personalisierung > in der App „Einstellungen“ verfügbar ist

Wie verwende ich die Bildsemantiksegmentierungstechnologie in Python?

Jun 06, 2023 am 08:03 AM

Wie verwende ich die Bildsemantiksegmentierungstechnologie in Python?

Jun 06, 2023 am 08:03 AM

Mit der kontinuierlichen Weiterentwicklung der Technologie der künstlichen Intelligenz hat sich die Bildsemantiksegmentierungstechnologie zu einer beliebten Forschungsrichtung im Bereich der Bildanalyse entwickelt. Bei der semantischen Bildsegmentierung segmentieren wir verschiedene Bereiche in einem Bild und klassifizieren jeden Bereich, um ein umfassendes Verständnis des Bildes zu erreichen. Python ist eine bekannte Programmiersprache. Aufgrund seiner leistungsstarken Datenanalyse- und Datenvisualisierungsfähigkeiten ist es die erste Wahl auf dem Gebiet der Technologieforschung im Bereich der künstlichen Intelligenz. In diesem Artikel wird die Verwendung der Bildsemantiksegmentierungstechnologie in Python vorgestellt. 1. Vorkenntnisse werden vertieft

Verwenden Sie 2D-Bilder, um einen 3D-menschlichen Körper zu erstellen. Sie können jede Kleidung tragen und Ihre Bewegungen ändern.

Apr 11, 2023 pm 02:31 PM

Verwenden Sie 2D-Bilder, um einen 3D-menschlichen Körper zu erstellen. Sie können jede Kleidung tragen und Ihre Bewegungen ändern.

Apr 11, 2023 pm 02:31 PM

Dank der differenzierbaren Darstellung durch NeRF haben neuere generative 3D-Modelle beeindruckende Ergebnisse auf stationären Objekten erzielt. Allerdings stellt die 3D-Generierung in einer komplexeren und verformbareren Kategorie wie dem menschlichen Körper immer noch große Herausforderungen dar. In diesem Artikel wird eine effiziente kombinierte NeRF-Darstellung des menschlichen Körpers vorgeschlagen, die eine hochauflösende (512 x 256) 3D-Generierung des menschlichen Körpers ohne den Einsatz hochauflösender Modelle ermöglicht. EVA3D hat bestehende Lösungen bei vier umfangreichen Datensätzen zum menschlichen Körper deutlich übertroffen, und der Code ist Open Source. Papiername: EVA3D: Compositional 3D Human Generation from 2D image Collections Papieradresse: http

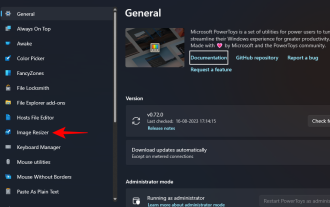

So ändern Sie die Größe von Bildern stapelweise mit PowerToys unter Windows

Aug 23, 2023 pm 07:49 PM

So ändern Sie die Größe von Bildern stapelweise mit PowerToys unter Windows

Aug 23, 2023 pm 07:49 PM

Wer täglich mit Bilddateien arbeitet, muss diese oft in der Größe anpassen, um sie an die Anforderungen seiner Projekte und Aufgaben anzupassen. Wenn Sie jedoch zu viele Bilder verarbeiten müssen, kann die Größenänderung einzelner Bilder viel Zeit und Mühe kosten. In diesem Fall kann ein Tool wie PowerToys nützlich sein, um unter anderem die Größe von Bilddateien mit dem Bild-Resizer-Dienstprogramm stapelweise zu ändern. Hier erfahren Sie, wie Sie Ihre Image Resizer-Einstellungen einrichten und mit PowerToys mit der Stapelgrößenänderung von Bildern beginnen. So ändern Sie die Größe von Bildern stapelweise mit PowerToys PowerToys ist ein All-in-One-Programm mit einer Vielzahl von Dienstprogrammen und Funktionen, die Ihnen helfen, Ihre täglichen Aufgaben zu beschleunigen. Eines seiner Dienstprogramme sind Bilder

iOS 17: So verwenden Sie das Zuschneiden mit einem Klick in Fotos

Sep 20, 2023 pm 08:45 PM

iOS 17: So verwenden Sie das Zuschneiden mit einem Klick in Fotos

Sep 20, 2023 pm 08:45 PM

Mit der iOS 17-Fotos-App erleichtert Apple das Zuschneiden von Fotos nach Ihren Vorgaben. Lesen Sie weiter, um zu erfahren, wie. Bisher umfasste das Zuschneiden eines Bildes in der Fotos-App in iOS 16 mehrere Schritte: Tippen Sie auf die Bearbeitungsoberfläche, wählen Sie das Zuschneidewerkzeug aus und passen Sie dann den Zuschnitt mithilfe einer Pinch-to-Zoom-Geste oder durch Ziehen an den Ecken des Zuschneidewerkzeugs an. In iOS 17 hat Apple diesen Vorgang dankenswerterweise vereinfacht, sodass beim Vergrößern eines ausgewählten Fotos in Ihrer Fotobibliothek automatisch eine neue Schaltfläche „Zuschneiden“ in der oberen rechten Ecke des Bildschirms angezeigt wird. Wenn Sie darauf klicken, wird die vollständige Zuschneideoberfläche mit der Zoomstufe Ihrer Wahl angezeigt, sodass Sie den gewünschten Teil des Bildes zuschneiden, das Bild drehen, umkehren, das Bildschirmverhältnis anwenden oder Markierungen verwenden können

So bearbeiten Sie Fotos auf dem iPhone mit iOS 17

Nov 30, 2023 pm 11:39 PM

So bearbeiten Sie Fotos auf dem iPhone mit iOS 17

Nov 30, 2023 pm 11:39 PM

Die mobile Fotografie hat die Art und Weise, wie wir die Momente des Lebens festhalten und teilen, grundlegend verändert. Das Aufkommen von Smartphones, insbesondere des iPhone, spielte bei diesem Wandel eine Schlüsselrolle. Das iPhone ist für seine fortschrittliche Kameratechnologie und benutzerfreundlichen Bearbeitungsfunktionen bekannt und zur ersten Wahl sowohl für Amateur- als auch für erfahrene Fotografen geworden. Die Einführung von iOS 17 markiert einen wichtigen Meilenstein auf diesem Weg. Das neueste Update von Apple bietet erweiterte Fotobearbeitungsfunktionen und gibt Benutzern ein leistungsfähigeres Toolkit an die Hand, mit dem sie ihre alltäglichen Schnappschüsse in visuell ansprechende und künstlerisch anspruchsvolle Bilder umwandeln können. Diese technologische Entwicklung vereinfacht nicht nur den Fotografieprozess, sondern eröffnet auch neue Möglichkeiten für den kreativen Ausdruck und ermöglicht es Benutzern, ihren Fotos mühelos eine professionelle Note zu verleihen

Neue Perspektive auf die Bilderzeugung: Diskussion NeRF-basierter Generalisierungsmethoden

Apr 09, 2023 pm 05:31 PM

Neue Perspektive auf die Bilderzeugung: Diskussion NeRF-basierter Generalisierungsmethoden

Apr 09, 2023 pm 05:31 PM

Die Erzeugung neuer perspektivischer Bilder (NVS) ist ein Anwendungsgebiet der Computer Vision. Im SuperBowl-Spiel von 1998 demonstrierte die RI NVS mit Multikamera-Stereovision (MVS). Damals wurde diese Technologie auf einen Sportfernsehsender übertragen Vereinigte Staaten, aber es wurde am Ende nicht kommerzialisiert; die britische BBC Broadcasting Company investierte in Forschung und Entwicklung dafür, aber es wurde nicht wirklich kommerzialisiert. Im Bereich des bildbasierten Renderings (IBR) gibt es einen Zweig der NVS-Anwendungen, nämlich das Tiefenbild-basierte Rendering (DBIR). Darüber hinaus musste das 3D-Fernsehen, das im Jahr 2010 sehr beliebt war, auch binokulare stereoskopische Effekte aus monokularen Videos erzielen, doch aufgrund der Unausgereiftheit der Technologie wurde es letztendlich nicht populär. Zu diesem Zeitpunkt begann man bereits mit der Erforschung von Methoden, die auf maschinellem Lernen basieren, wie z