Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Reduzieren Sie den Transformer-Rang, um die Leistung zu verbessern und gleichzeitig LLM beizubehalten, ohne die Entfernung von mehr als 90 % der Komponenten in einer bestimmten Schicht zu reduzieren

Reduzieren Sie den Transformer-Rang, um die Leistung zu verbessern und gleichzeitig LLM beizubehalten, ohne die Entfernung von mehr als 90 % der Komponenten in einer bestimmten Schicht zu reduzieren

Reduzieren Sie den Transformer-Rang, um die Leistung zu verbessern und gleichzeitig LLM beizubehalten, ohne die Entfernung von mehr als 90 % der Komponenten in einer bestimmten Schicht zu reduzieren

MIT und Microsoft führten gemeinsame Untersuchungen durch und stellten fest, dass keine zusätzliche Schulung erforderlich ist, um die Aufgabenleistung großer Sprachmodelle zu verbessern und ihre Größe zu reduzieren.

Im Zeitalter großer Modelle ist Transformer für seine einzigartigen Fähigkeiten zur Unterstützung bekannt gesamten wissenschaftlichen Forschungsbereich. Seit ihrer Einführung haben Transformer-basierte Sprachmodelle (LLM) bei verschiedenen Aufgaben eine hervorragende Leistung gezeigt. Die zugrunde liegende Architektur von Transformer hat sich zur modernsten Technologie für die Modellierung und Argumentation natürlicher Sprache entwickelt und hat in Bereichen wie Computer Vision und Reinforcement Learning gute Aussichten gezeigt

Die aktuelle Transformer-Architektur ist jedoch sehr umfangreich und normalerweise erfordert eine große Menge an Rechenressourcen für Training und Argumentation.

Schreiben Sie es so um: Dies ist sinnvoll, da ein mit mehr Parametern oder Daten trainierter Transformer offensichtlich leistungsfähiger ist als andere Modelle. Immer mehr Untersuchungen zeigen jedoch, dass Transformer-basierte Modelle und neuronale Netze nicht alle Anpassungsparameter beibehalten müssen, um ihre erlernten Hypothesen aufrechtzuerhalten.

Im Allgemeinen scheint eine Überparametrisierung beim Training von Modellen hilfreich zu sein, diese Modelle können jedoch schwerwiegend sein vor der Schlussfolgerung beschnitten. Studien haben gezeigt, dass neuronale Netze oft mehr als 90 % der Gewichte entfernen können, ohne dass es zu nennenswerten Leistungseinbußen kommt. Dieses Phänomen hat das Interesse von Forschern an Bereinigungsstrategien geweckt, die das Modellargumentieren unterstützen

Forscher vom MIT und Microsoft schrieben in dem Artikel „The Truth is in There: Improving Reasoning in Language Models with Layer-Selective Rank Reduction“ einen überraschenden Befund, der vorsichtig ist Das Beschneiden bestimmter Ebenen des Transformer-Modells kann die Leistung des Modells bei bestimmten Aufgaben erheblich verbessern.

Bitte klicken Sie auf den folgenden Link, um das Papier anzusehen: https://arxiv.org/pdf/2312.13558.pdf

-

Papier-Homepage: https://pratyushashama.github.io/laser/

Die Studie nennt diesen einfachen Eingriff LASER (Layer Selective Rank Reduction), der die Leistung von LLM erheblich verbessert, indem er die höherwertigen Komponenten der erlernten Gewichtsmatrix bestimmter Schichten im Transformer-Modell durch Singulärwertzerlegung selektiv reduziert. Dieser Vorgang kann nach Abschluss des Modelltrainings ohne zusätzliche Parameter oder Daten durchgeführt werden

Während des Vorgangs wird die Gewichtsreduzierung in modellspezifischen Gewichtsmatrizen und -schichten durchgeführt. Diese Studie ergab außerdem, dass viele ähnliche Matrizen Gewichte erheblich reduzieren können und typischerweise keine Leistungseinbußen beobachtet werden, bis mehr als 90 % der Komponenten entfernt wurden

Die Studie ergab außerdem, dass diese Reduzierungen die Genauigkeit erheblich verbessern können, ein Befund, der scheinbar nicht begrenzt ist Im Vergleich zur natürlichen Sprache wurden auch Leistungsverbesserungen beim Reinforcement Learning festgestellt.

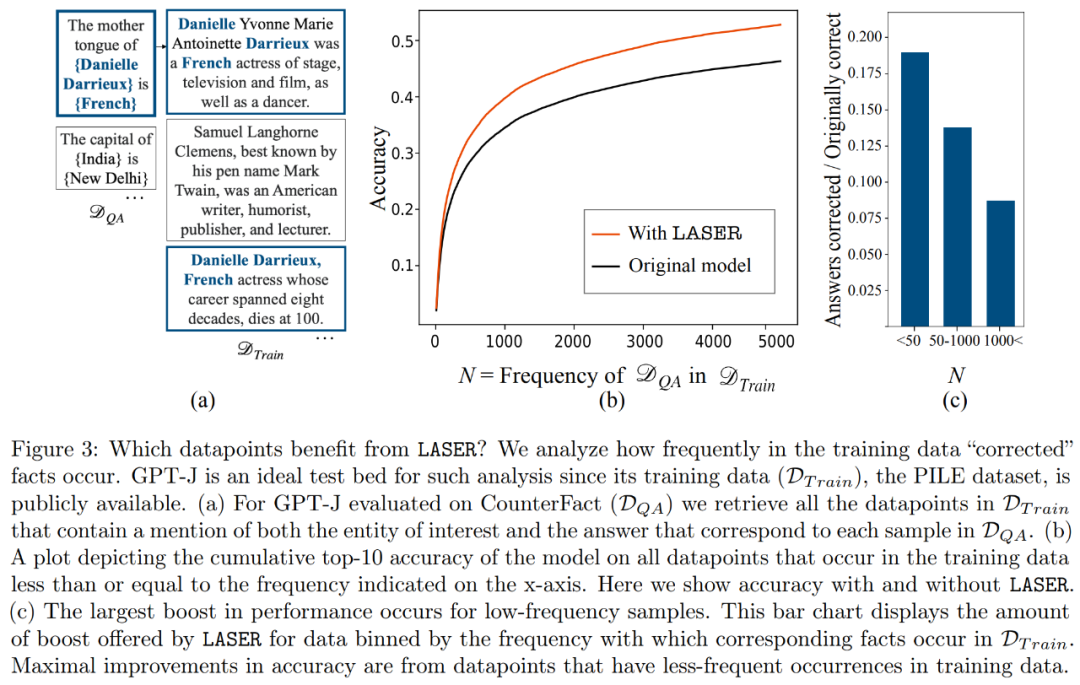

Darüber hinaus versucht diese Forschung abzuleiten, was in Komponenten höherer Ordnung gespeichert ist, damit es gelöscht werden kann, um die Leistung zu verbessern. Die Studie ergab, dass LASER die richtigen Fragen beantwortete, das ursprüngliche Modell jedoch vor der Intervention hauptsächlich mit hochfrequenten Wörtern (wie „der“, „von“ usw.) antwortete, die nicht einmal vom gleichen semantischen Typ waren wie der Richtige Antwort, und auch Das heißt, diese Komponenten bewirken, dass das Modell ohne Eingriff einige irrelevante hochfrequente Wörter generiert.

Durch eine gewisse Rangreduzierung kann die Antwort des Modells jedoch in eine richtige Antwort umgewandelt werden.

Um dies zu verstehen, untersuchte die Studie auch, was die übrigen Komponenten einzeln kodierten, und sie approximierten die Gewichtsmatrix nur mithilfe ihrer singulären Vektoren höherer Ordnung. Es wurde festgestellt, dass diese Komponenten unterschiedliche Antworten oder häufig vorkommende Wörter in derselben semantischen Kategorie wie die richtige Antwort beschreiben.

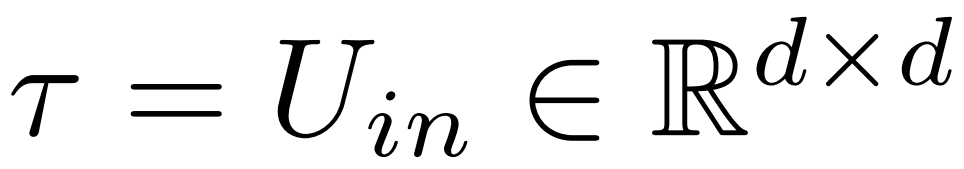

Diese Ergebnisse legen nahe, dass, wenn verrauschte Komponenten höherer Ordnung mit Komponenten niedrigerer Ordnung kombiniert werden, deren widersprüchliche Antworten eine durchschnittliche Antwort ergeben, die möglicherweise falsch ist. Abbildung 1 bietet eine visuelle Darstellung der Transformer-Architektur und des von LASER befolgten Verfahrens. Hier wird die Gewichtsmatrix einer bestimmten Schicht eines mehrschichtigen Perzeptrons (MLP) durch ihre Näherung mit niedrigem Rang ersetzt.

Laser-Übersicht

bietet eine detaillierte Einführung in die LASER-Intervention. Ein einstufiger LASER-Eingriff wird durch das Triplett (τ, ℓ, ρ) definiert, das den Parameter τ, die Anzahl der Schichten ℓ und den reduzierten Rang ρ enthält. Zusammen beschreiben diese Werte die Matrizen, die durch ihre Approximationen mit niedrigem Rang ersetzt werden sollen, sowie den Grad der Approximation. Forscher klassifizieren die Arten von Matrizen, die sie stören werden, basierend auf Parametertypen

Forscher konzentrieren sich auf Matrizen in W = {W_q, W_k, W_v, W_o, U_in, U_out}, die aus Matrizen in MLP und Aufmerksamkeitsschichten bestehen. Die Anzahl der Schichten stellt die Schicht der Forscherintervention dar (die erste Schicht wird beginnend bei 0 indiziert). Zum Beispiel hat Llama-2 32 Schichten, also ℓ ∈ {0, 1, 2,・・・31}.

Letztendlich beschreibt ρ ∈ [0, 1), welcher Teil des maximalen Rangs beibehalten werden sollte, wenn Näherungen mit niedrigem Rang vorgenommen werden. Unter der Annahme  ist der maximale Rang dieser Matrix beispielsweise d. Die Forscher ersetzten es durch die ⌊ρ・d⌋-Näherung.

ist der maximale Rang dieser Matrix beispielsweise d. Die Forscher ersetzten es durch die ⌊ρ・d⌋-Näherung.

Abbildung 1 unten ist ein Beispiel für LASER. In dieser Abbildung stellen τ = U_in und ℓ = L die Aktualisierung der Gewichtsmatrix der ersten Schicht von MLP im Transformer-Block der L^-ten Schicht dar. Ein weiterer Parameter steuert k in der Rang-k-Näherung.

LASER kann den Fluss bestimmter Informationen in einem Netzwerk einschränken und unerwartet erhebliche Leistungsvorteile bewirken. Diese Interventionen können auch problemlos kombiniert werden, beispielsweise durch die Anwendung einer Reihe von Interventionen in beliebiger Reihenfolge  .

.

Die LASER-Methode ist nur eine einfache Suche nach solchen Eingriffen, die so modifiziert sind, dass sie den maximalen Nutzen bringen. Es gibt jedoch viele andere Möglichkeiten, diese Interventionen zu kombinieren, was eine Richtung für die zukünftige Arbeit darstellt.

Um die ursprüngliche Bedeutung beizubehalten, muss der Inhalt ins Chinesische umgeschrieben werden. Der Originalsatz muss nicht angezeigt werden

Im experimentellen Teil verwendete der Forscher das auf dem PILE-Datensatz vorab trainierte GPT-J-Modell. Die Anzahl der Schichten des Modells beträgt 27 und die Parameter betragen 6 Milliarden. Das Verhalten des Modells wird dann anhand des CounterFact-Datensatzes bewertet, der Beispiele von Tripeln (Thema, Beziehung und Antwort) enthält, wobei für jede Frage drei Paraphrasierungsaufforderungen bereitgestellt werden.

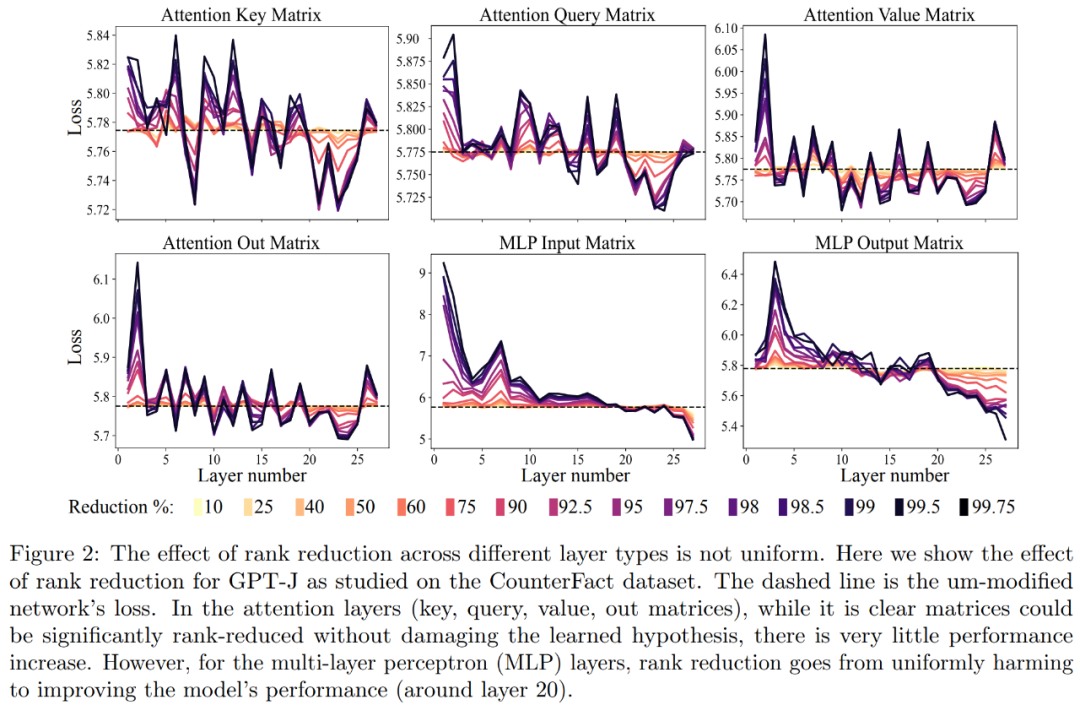

Die erste ist die Analyse des GPT-J-Modells auf dem CounterFact-Datensatz. Abbildung 2 unten zeigt die Auswirkungen auf den Klassifizierungsverlust des Datensatzes, wenn auf jede Matrix in der Transformer-Architektur unterschiedliche Grade der Rangreduzierung angewendet werden. Jede der Transformer-Schichten besteht aus einem zweischichtigen kleinen MLP, wobei die Eingabe- und Ausgabematrizen separat angezeigt werden. Unterschiedliche Farben stellen unterschiedliche Prozentsätze der entfernten Komponenten dar.

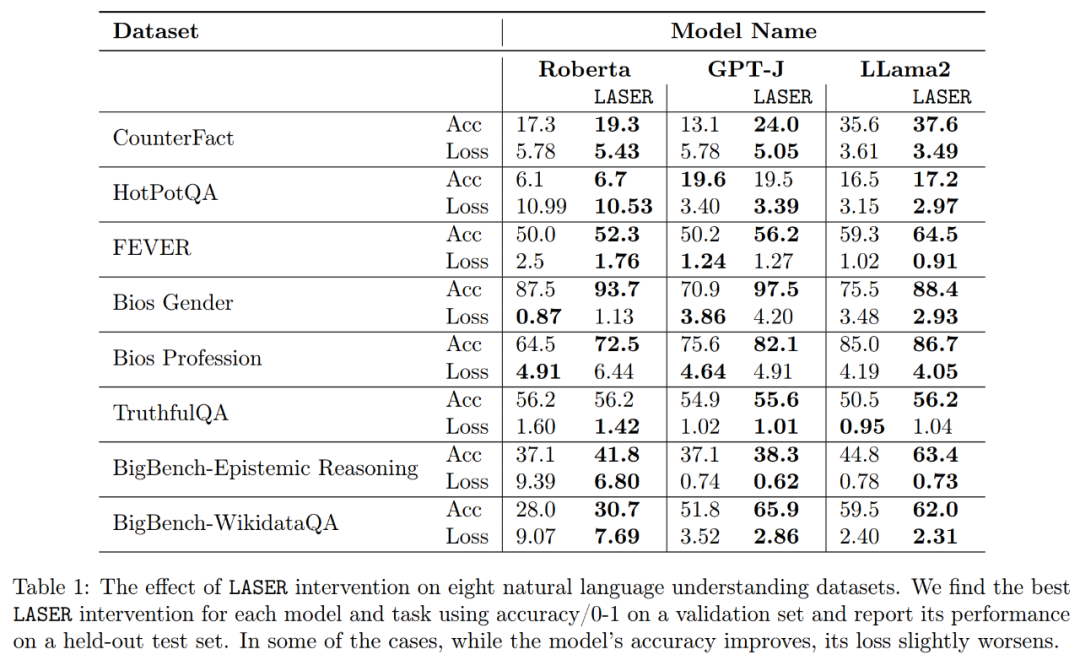

Im Hinblick auf die Verbesserung der Genauigkeit und Robustheit der Interpretation, wie in Abbildung 2 oben und Tabelle 1 unten dargestellt, stellten die Forscher fest, dass bei der Durchführung einer Rangreduzierung auf einer einzelnen Ebene die Tatsache, dass das GPT-J-Modell auf der eine gute Leistung erbringt CounterFact-Datensatz Die Genauigkeit stieg von 13,1 % auf 24,0 %. Es ist wichtig zu beachten, dass diese Verbesserungen nur das Ergebnis einer Rangreduzierung sind und kein weiteres Training oder eine Feinabstimmung des Modells erfordern.

Welche Fakten durch Rangreduzierung im Datensatz wiederhergestellt werden, ist für Forscher zu einem Problem geworden. Die Forscher fanden heraus, dass die Tatsache der Wiederherstellung durch Rangreduzierung selten in den Daten auftauchte, wie in Abbildung 3 dargestellt.

Was speichern Komponenten höherer Ordnung? Im Gegensatz zu LASER verwenden Forscher Komponenten höherer Ordnung zur Annäherung an die endgültige Gewichtsmatrix, wie in Abbildung 5(a) dargestellt. Bei der Approximation der Matrix unter Verwendung einer unterschiedlichen Anzahl von Komponenten höherer Ordnung maßen sie die durchschnittliche Kosinusähnlichkeit zwischen den wahren und vorhergesagten Antworten, wie in Abbildung 5(b) dargestellt LLMs zu mehreren Sprachverständnisaufgaben. Für jede Aufgabe bewerteten sie die Leistung des Modells, indem sie drei Metriken generierten: Genauigkeit, Klassifizierungsgenauigkeit und Verlust. Wie in Tabelle 1 oben gezeigt, führt selbst eine große Rangreduzierung nicht zu einer Verringerung der Modellgenauigkeit, kann jedoch die Modellleistung verbessern.

Das obige ist der detaillierte Inhalt vonReduzieren Sie den Transformer-Rang, um die Leistung zu verbessern und gleichzeitig LLM beizubehalten, ohne die Entfernung von mehr als 90 % der Komponenten in einer bestimmten Schicht zu reduzieren. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

Video Face Swap

Tauschen Sie Gesichter in jedem Video mühelos mit unserem völlig kostenlosen KI-Gesichtstausch-Tool aus!

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

Der Autor von ControlNet hat einen weiteren Hit! Der gesamte Prozess der Generierung eines Gemäldes aus einem Bild, der in zwei Tagen 1,4.000 Sterne verdient

Jul 17, 2024 am 01:56 AM

Der Autor von ControlNet hat einen weiteren Hit! Der gesamte Prozess der Generierung eines Gemäldes aus einem Bild, der in zwei Tagen 1,4.000 Sterne verdient

Jul 17, 2024 am 01:56 AM

Es ist ebenfalls ein Tusheng-Video, aber PaintsUndo ist einen anderen Weg gegangen. ControlNet-Autor LvminZhang begann wieder zu leben! Dieses Mal ziele ich auf den Bereich der Malerei. Das neue Projekt PaintsUndo hat nicht lange nach seinem Start 1,4.000 Sterne erhalten (die immer noch wahnsinnig steigen). Projektadresse: https://github.com/lllyasviel/Paints-UNDO Bei diesem Projekt gibt der Benutzer ein statisches Bild ein, und PaintsUndo kann Ihnen dabei helfen, automatisch ein Video des gesamten Malprozesses zu erstellen, vom Linienentwurf bis zum fertigen Produkt . Während des Zeichenvorgangs sind die Linienänderungen erstaunlich. Das Endergebnis des Videos ist dem Originalbild sehr ähnlich: Schauen wir uns eine vollständige Zeichnung an.

Die agentenlose Lösung von UIUC steht ganz oben auf der Liste der Open-Source-KI-Softwareentwickler und löst problemlos echte Programmierprobleme im SWE-Bench

Jul 17, 2024 pm 10:02 PM

Die agentenlose Lösung von UIUC steht ganz oben auf der Liste der Open-Source-KI-Softwareentwickler und löst problemlos echte Programmierprobleme im SWE-Bench

Jul 17, 2024 pm 10:02 PM

Die AIxiv-Kolumne ist eine Kolumne, in der diese Website akademische und technische Inhalte veröffentlicht. In den letzten Jahren sind in der AIxiv-Kolumne dieser Website mehr als 2.000 Berichte eingegangen, die Spitzenlabore großer Universitäten und Unternehmen auf der ganzen Welt abdecken und so den akademischen Austausch und die Verbreitung wirksam fördern. Wenn Sie hervorragende Arbeiten haben, die Sie teilen möchten, können Sie gerne einen Beitrag leisten oder uns für die Berichterstattung kontaktieren. Einreichungs-E-Mail: liyazhou@jiqizhixin.com; zhaoyunfeng@jiqizhixin.com Die Autoren dieses Artikels stammen alle aus dem Team von Lehrer Zhang Lingming an der University of Illinois in Urbana-Champaign, darunter: Steven Code Repair; Doktorand im vierten Jahr, Forscher

Von RLHF über DPO bis TDPO sind große Modellausrichtungsalgorithmen bereits auf „Token-Ebene'

Jun 24, 2024 pm 03:04 PM

Von RLHF über DPO bis TDPO sind große Modellausrichtungsalgorithmen bereits auf „Token-Ebene'

Jun 24, 2024 pm 03:04 PM

Die AIxiv-Kolumne ist eine Kolumne, in der diese Website akademische und technische Inhalte veröffentlicht. In den letzten Jahren sind in der AIxiv-Kolumne dieser Website mehr als 2.000 Berichte eingegangen, die Spitzenlabore großer Universitäten und Unternehmen auf der ganzen Welt abdecken und so den akademischen Austausch und die Verbreitung wirksam fördern. Wenn Sie hervorragende Arbeiten haben, die Sie teilen möchten, können Sie gerne einen Beitrag leisten oder uns für die Berichterstattung kontaktieren. Einreichungs-E-Mail: liyazhou@jiqizhixin.com; zhaoyunfeng@jiqizhixin.com Im Entwicklungsprozess der künstlichen Intelligenz war die Steuerung und Führung großer Sprachmodelle (LLM) schon immer eine der zentralen Herausforderungen, um sicherzustellen, dass diese Modelle beides sind kraftvoll und sicher dienen der menschlichen Gesellschaft. Frühe Bemühungen konzentrierten sich auf Methoden des verstärkenden Lernens durch menschliches Feedback (RL

Posthume Arbeit des OpenAI Super Alignment Teams: Zwei große Modelle spielen ein Spiel und die Ausgabe wird verständlicher

Jul 19, 2024 am 01:29 AM

Posthume Arbeit des OpenAI Super Alignment Teams: Zwei große Modelle spielen ein Spiel und die Ausgabe wird verständlicher

Jul 19, 2024 am 01:29 AM

Wenn die Antwort des KI-Modells überhaupt unverständlich ist, würden Sie es wagen, sie zu verwenden? Da maschinelle Lernsysteme in immer wichtigeren Bereichen eingesetzt werden, wird es immer wichtiger zu zeigen, warum wir ihren Ergebnissen vertrauen können und wann wir ihnen nicht vertrauen sollten. Eine Möglichkeit, Vertrauen in die Ausgabe eines komplexen Systems zu gewinnen, besteht darin, vom System zu verlangen, dass es eine Interpretation seiner Ausgabe erstellt, die für einen Menschen oder ein anderes vertrauenswürdiges System lesbar ist, d. h. so vollständig verständlich, dass mögliche Fehler erkannt werden können gefunden. Um beispielsweise Vertrauen in das Justizsystem aufzubauen, verlangen wir von den Gerichten, dass sie klare und lesbare schriftliche Stellungnahmen abgeben, die ihre Entscheidungen erläutern und stützen. Für große Sprachmodelle können wir auch einen ähnlichen Ansatz verfolgen. Stellen Sie bei diesem Ansatz jedoch sicher, dass das Sprachmodell generiert wird

Ein bedeutender Durchbruch in der Riemann-Hypothese! Tao Zhexuan empfiehlt dringend neue Arbeiten vom MIT und Oxford, und der 37-jährige Fields-Medaillengewinner nahm daran teil

Aug 05, 2024 pm 03:32 PM

Ein bedeutender Durchbruch in der Riemann-Hypothese! Tao Zhexuan empfiehlt dringend neue Arbeiten vom MIT und Oxford, und der 37-jährige Fields-Medaillengewinner nahm daran teil

Aug 05, 2024 pm 03:32 PM

Kürzlich gelang der Riemann-Hypothese, die als eines der sieben großen Probleme des Jahrtausends bekannt ist, ein neuer Durchbruch. Die Riemann-Hypothese ist ein sehr wichtiges ungelöstes Problem in der Mathematik, das sich auf die genauen Eigenschaften der Verteilung von Primzahlen bezieht (Primzahlen sind Zahlen, die nur durch 1 und sich selbst teilbar sind, und sie spielen eine grundlegende Rolle in der Zahlentheorie). In der heutigen mathematischen Literatur gibt es mehr als tausend mathematische Thesen, die auf der Aufstellung der Riemann-Hypothese (oder ihrer verallgemeinerten Form) basieren. Mit anderen Worten: Sobald die Riemann-Hypothese und ihre verallgemeinerte Form bewiesen sind, werden diese mehr als tausend Sätze als Theoreme etabliert, die einen tiefgreifenden Einfluss auf das Gebiet der Mathematik haben werden, und wenn sich die Riemann-Hypothese als falsch erweist, dann unter anderem Auch diese Sätze werden teilweise ihre Gültigkeit verlieren. Neuer Durchbruch kommt von MIT-Mathematikprofessor Larry Guth und der Universität Oxford

arXiv-Artikel können als „Barrage' gepostet werden, die Diskussionsplattform von Stanford alphaXiv ist online, LeCun gefällt es

Aug 01, 2024 pm 05:18 PM

arXiv-Artikel können als „Barrage' gepostet werden, die Diskussionsplattform von Stanford alphaXiv ist online, LeCun gefällt es

Aug 01, 2024 pm 05:18 PM

Prost! Wie ist es, wenn es bei einer Papierdiskussion auf Worte ankommt? Kürzlich haben Studenten der Stanford University alphaXiv erstellt, ein offenes Diskussionsforum für arXiv-Artikel, das es ermöglicht, Fragen und Kommentare direkt zu jedem arXiv-Artikel zu posten. Website-Link: https://alphaxiv.org/ Tatsächlich ist es nicht erforderlich, diese Website speziell zu besuchen. Ändern Sie einfach arXiv in einer beliebigen URL in alphaXiv, um den entsprechenden Artikel direkt im alphaXiv-Forum zu öffnen: Sie können die Absätze darin genau lokalisieren das Papier, Satz: Im Diskussionsbereich auf der rechten Seite können Benutzer Fragen stellen, um dem Autor Fragen zu den Ideen und Details des Papiers zu stellen. Sie können beispielsweise auch den Inhalt des Papiers kommentieren, wie zum Beispiel: „Gegeben an.“

Das erste Mamba-basierte MLLM ist da! Modellgewichte, Trainingscode usw. waren alle Open Source

Jul 17, 2024 am 02:46 AM

Das erste Mamba-basierte MLLM ist da! Modellgewichte, Trainingscode usw. waren alle Open Source

Jul 17, 2024 am 02:46 AM

Die AIxiv-Kolumne ist eine Kolumne, in der diese Website akademische und technische Inhalte veröffentlicht. In den letzten Jahren sind in der AIxiv-Kolumne dieser Website mehr als 2.000 Berichte eingegangen, die Spitzenlabore großer Universitäten und Unternehmen auf der ganzen Welt abdecken und so den akademischen Austausch und die Verbreitung wirksam fördern. Wenn Sie hervorragende Arbeiten haben, die Sie teilen möchten, können Sie gerne einen Beitrag leisten oder uns für die Berichterstattung kontaktieren. E-Mail-Adresse: liyazhou@jiqizhixin.com; zhaoyunfeng@jiqizhixin.com. Einleitung In den letzten Jahren hat die Anwendung multimodaler großer Sprachmodelle (MLLM) in verschiedenen Bereichen bemerkenswerte Erfolge erzielt. Als Grundmodell für viele nachgelagerte Aufgaben besteht aktuelles MLLM jedoch aus dem bekannten Transformer-Netzwerk, das

Axiomatisches Training ermöglicht es LLM, kausales Denken zu erlernen: Das 67-Millionen-Parameter-Modell ist vergleichbar mit der Billionen-Parameter-Ebene GPT-4

Jul 17, 2024 am 10:14 AM

Axiomatisches Training ermöglicht es LLM, kausales Denken zu erlernen: Das 67-Millionen-Parameter-Modell ist vergleichbar mit der Billionen-Parameter-Ebene GPT-4

Jul 17, 2024 am 10:14 AM

Zeigen Sie LLM die Kausalkette und es lernt die Axiome. KI hilft Mathematikern und Wissenschaftlern bereits bei der Forschung. Beispielsweise hat der berühmte Mathematiker Terence Tao wiederholt seine Forschungs- und Forschungserfahrungen mit Hilfe von KI-Tools wie GPT geteilt. Damit KI in diesen Bereichen konkurrenzfähig sein kann, sind starke und zuverlässige Fähigkeiten zum kausalen Denken unerlässlich. Die in diesem Artikel vorgestellte Forschung ergab, dass ein Transformer-Modell, das auf die Demonstration des kausalen Transitivitätsaxioms für kleine Graphen trainiert wurde, auf das Transitivitätsaxiom für große Graphen verallgemeinern kann. Mit anderen Worten: Wenn der Transformer lernt, einfache kausale Überlegungen anzustellen, kann er für komplexere kausale Überlegungen verwendet werden. Der vom Team vorgeschlagene axiomatische Trainingsrahmen ist ein neues Paradigma zum Erlernen des kausalen Denkens auf der Grundlage passiver Daten, nur mit Demonstrationen