Auf der CES im Jahr 2024 veröffentlichte NVIDIA eine Reihe neuer Produkte, darunter NVIDIA ACE-Dienste. Der Dienst stellt Entwicklern fortschrittliche generative KI-Modelle und Microservices zur Verfügung, die es ihnen ermöglichen, diese Modelle auf virtuelle digitale Charaktere in Spielen und Anwendungen anzuwenden. Diese innovative Technologie eröffnet Entwicklern mehr Möglichkeiten, realistischere und realistischere virtuelle Charaktererlebnisse zu schaffen. Die Einführung der NVIDIA ACE-Dienste markiert NVIDIAs kontinuierliche Innovation und Führungsrolle im Bereich KI.

Dies ist eine Technologieplattform, die generative KI nutzt, um virtuelle digitale Menschen zu erschaffen. Es kann in der Cloud oder auf einem lokalen PC ausgeführt werden. Zu den Partnerunternehmen gehören Convai, Charisma.AI, Inworld, MiHoYo, NetEase Games, PalmQu Technology, Tencent Games, Ubisoft und UneeQ usw.

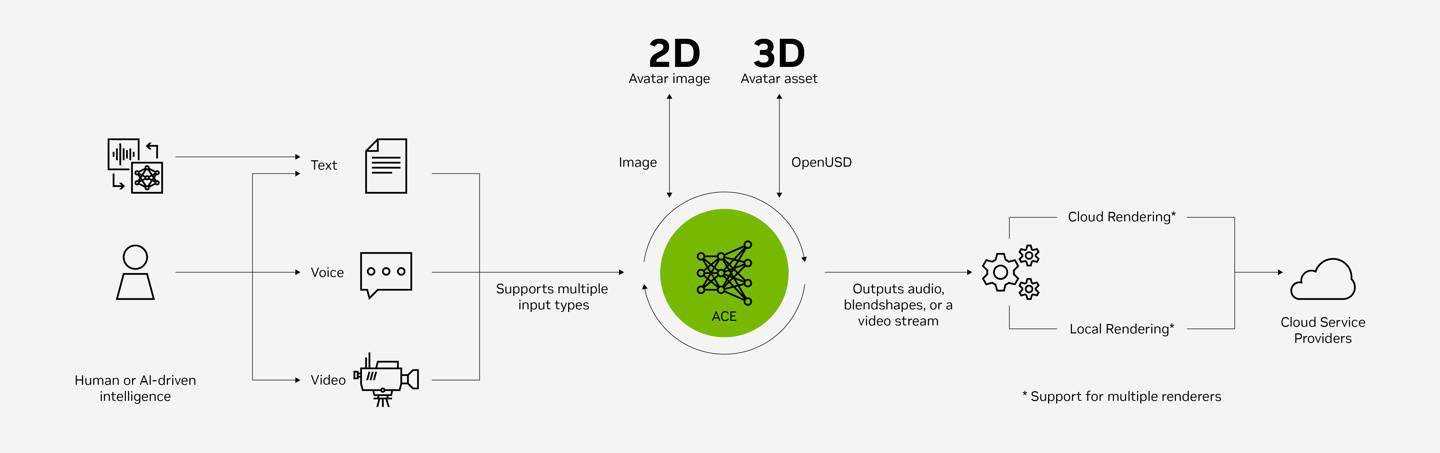

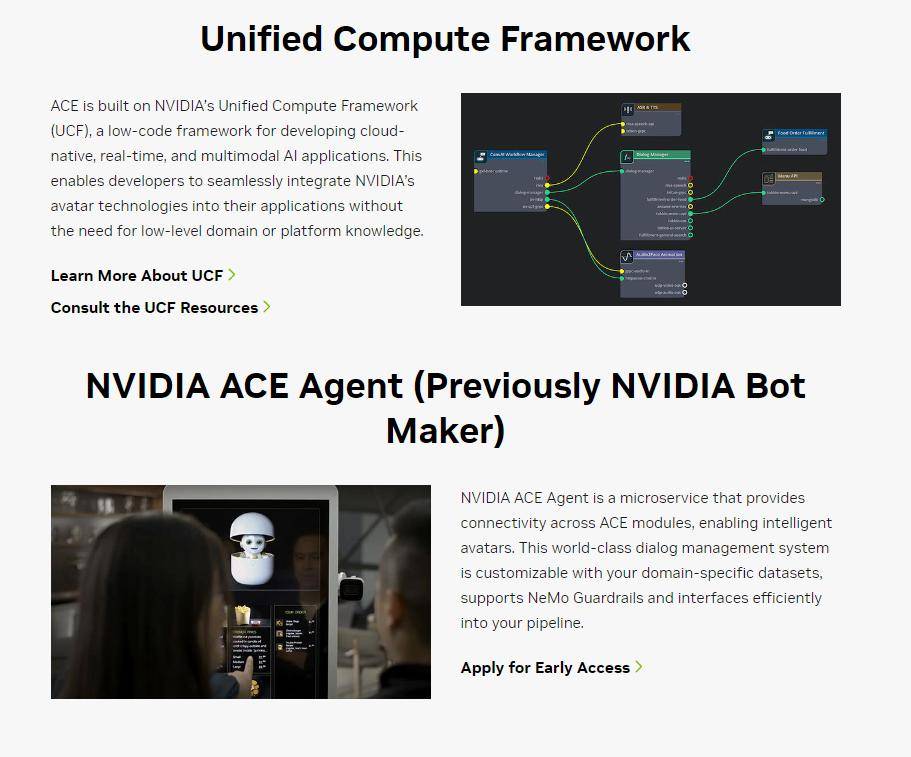

NVIDIA sagte, dass ACE eine Cloud-API ist, die aus anpassbaren Mikrodiensten besteht, die auf dem NVIDIA Unified Computing Framework, der Full-Stack-KI-Plattform und der NVIDIA RTX-Technologie basieren. Diese Komponenten bilden eine vollständige digitale Suite für die menschliche Entwicklung, einschließlich domänenspezifischer KI-Workflows und Low-Code-Tools. ACE bietet leistungsstarke Funktionen, die es Entwicklern ermöglichen, schnell KI-fähige Anwendungen zu erstellen und bereitzustellen. Ob in den Bereichen Bildverarbeitung, Verarbeitung natürlicher Sprache oder Spracherkennung, ACE kann effiziente und zuverlässige Lösungen bereitstellen, um Entwicklern zu höherer Produktivität und Innovation zu verhelfen.

Entwickler können die neuen ACE-Mikrodienste nutzen, um mithilfe von KI-Modellen wie NVIDIA Audio2Face (A2F) und NVIDIA Riva Automatic Speech Recognition (ASR) interaktive virtuelle digitale Avatare zu erstellen. Mit A2F können Entwickler aus Tonquellen ausdrucksstarke Gesichtsanimationen erstellen, während ASR zur Entwicklung benutzerdefinierter mehrsprachiger Sprach- und Übersetzungsanwendungen für virtuelle digitale Charaktere verwendet werden kann. Diese Funktionen ermöglichen es virtuellen digitalen Avataren, lebendiger und natürlicher mit Benutzern zu interagieren.

IT House wies außerdem darauf hin, dass NVIDIA die automatischen Spracherkennungs-Mikrodienste Audio2Face und Riva eingeführt hat. Diese Modelle können von interaktiven Avatar-Entwicklern individuell in ihre Entwicklungsprozesse eingebracht werden.

Das obige ist der detaillierte Inhalt vonNVIDIA kooperiert mit Spieleunternehmen wie miHoYo, Tencent und NetEase, um gemeinsam die Entwicklung von KI-Digital-Human-Business voranzutreiben. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Was bedeutet Apache?

Was bedeutet Apache?

Wie man im Währungskreis aus Tausenden Hunderttausende macht

Wie man im Währungskreis aus Tausenden Hunderttausende macht

Suffix für den Namen der Linux-Batch-Änderungsdatei

Suffix für den Namen der Linux-Batch-Änderungsdatei

Der Excel-Eingabewert ist unzulässig

Der Excel-Eingabewert ist unzulässig

PSP3000 Crack

PSP3000 Crack

Handelsplattform für virtuelle Währungen

Handelsplattform für virtuelle Währungen

So lösen Sie das Problem des vs2008-Installationsfehlers

So lösen Sie das Problem des vs2008-Installationsfehlers

Einführung in den Eröffnungsort von Win8

Einführung in den Eröffnungsort von Win8