Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Aktualisierter Point Transformer: effizienter, schneller und leistungsfähiger!

Aktualisierter Point Transformer: effizienter, schneller und leistungsfähiger!

Aktualisierter Point Transformer: effizienter, schneller und leistungsfähiger!

Originaltitel: Point Transformer V3: Simpler, Faster, Stronger

Papierlink: https://arxiv.org/pdf/2312.10035.pdf

Codelink: https://github.com/Pointcept/PointTransformerV3

Autor Einheit: HKU SH AI Lab MPI PKU MIT

Idee für die Abschlussarbeit:

Dieser Artikel zielt nicht darauf ab, Innovationen innerhalb des Aufmerksamkeitsmechanismus zu suchen. Stattdessen liegt der Schwerpunkt darauf, die Macht der Skalierung zu nutzen, um bestehende Kompromisse zwischen Genauigkeit und Effizienz im Kontext der Punktwolkenverarbeitung zu überwinden. Inspiriert von den jüngsten Fortschritten beim Lernen großräumiger 3D-Darstellungen erkennt dieser Artikel an, dass die Modellleistung stärker von der Skalierung als von der Komplexität des Designs abhängt. Daher wird in diesem Artikel Point Transformer V3 (PTv3) vorgeschlagen, bei dem Einfachheit und Effizienz Vorrang vor der Genauigkeit bestimmter Mechanismen haben, die nach der Skalierung weniger Einfluss auf die Gesamtleistung haben, z. B. Punktwolken, die in bestimmten Mustern organisiert sind, um KNNs zu ersetzen genaue Nachbarschaftssuche. Dieses Prinzip ermöglicht eine erhebliche Skalierung und erweitert das Empfangsfeld von 16 auf 1024 Punkte, während es gleichzeitig effizient bleibt (3x schnellere Verarbeitung und 10x mehr Speichereffizienz im Vergleich zum Vorgänger PTv2). PTv3 erzielt hochmoderne Ergebnisse bei mehr als 20 nachgelagerten Aufgaben, die Innen- und Außenszenarien abdecken. PTv3 bringt diese Ergebnisse mit weiteren Verbesserungen durch gemeinsames Training mit mehreren Datensätzen auf die nächste Ebene.

Netzwerkdesign:

Jüngste Fortschritte beim 3D-Darstellungslernen [85] haben Fortschritte bei der Überwindung von Datenskalenbeschränkungen bei der Punktwolkenverarbeitung durch die Einführung kollaborativer Trainingsmethoden für mehrere 3D-Datensätze gemacht. In Kombination mit dieser Strategie überbrückt ein effizientes Faltungs-Backbone [12] effektiv die Genauigkeitslücke, die typischerweise mit Punktwolkentransformatoren verbunden ist [38, 84]. Allerdings haben Punktwolkentransformatoren selbst aufgrund der Effizienzlücke von Punktwolkentransformatoren im Vergleich zu spärlichen Faltungen noch nicht vollständig von diesem Skalenvorteil profitiert. Diese Entdeckung bildete die ursprüngliche Motivation für diese Arbeit: die Entwurfsentscheidungen von Punkttransformatoren aus der Perspektive des Skalierungsprinzips neu abzuwägen. In diesem Artikel wird davon ausgegangen, dass die Modellleistung stärker von der Skalierung als vom komplexen Design beeinflusst wird.

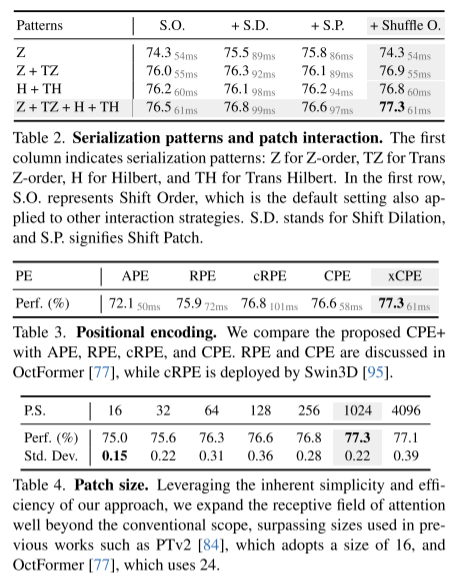

Daher stellt dieser Artikel Point Transformer V3 (PTv3) vor, bei dem Einfachheit und Effizienz Vorrang vor der Genauigkeit bestimmter Mechanismen haben, um Skalierbarkeit zu erreichen. Solche Anpassungen haben nach der Skalierung vernachlässigbare Auswirkungen auf die Gesamtleistung. Insbesondere hat PTv3 die folgenden Anpassungen vorgenommen, um eine überlegene Effizienz und Skalierbarkeit zu erreichen:

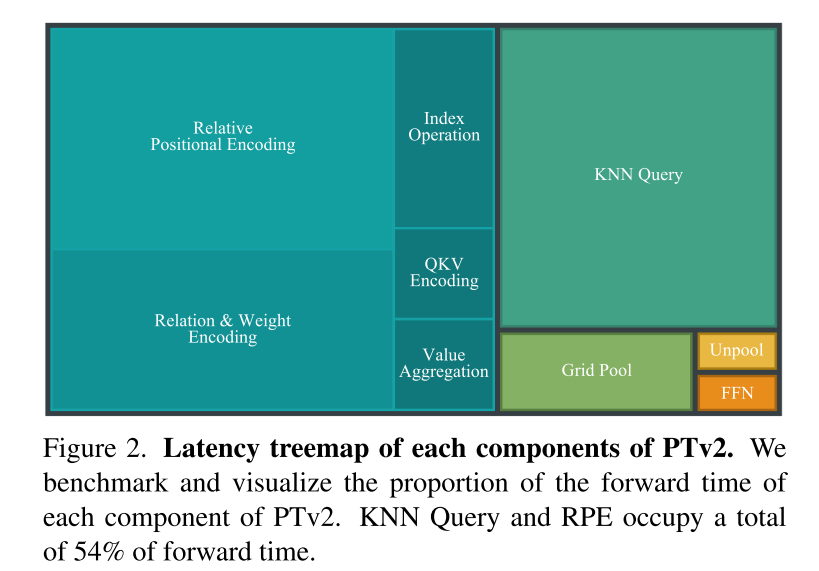

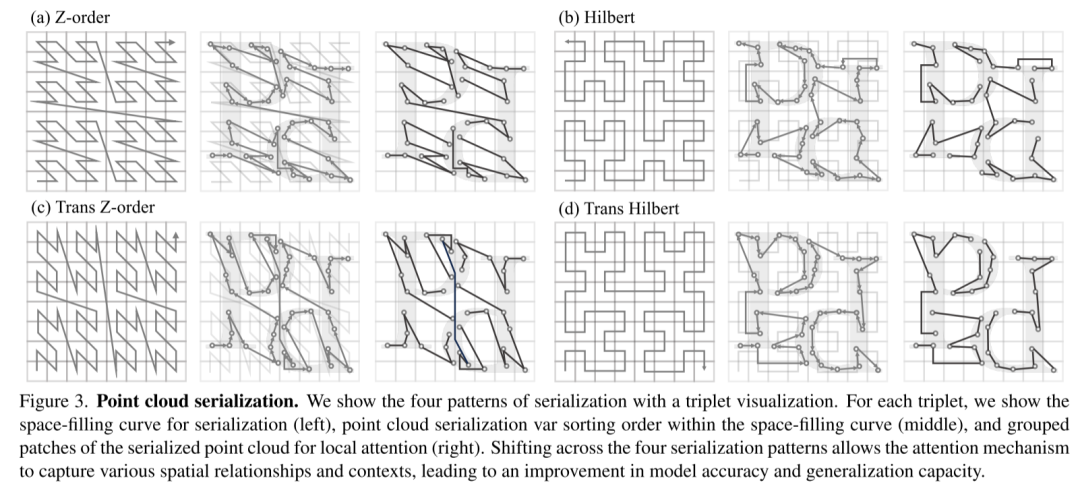

- Inspiriert von zwei jüngsten Fortschritten [48, 77] und der Erkenntnis der Skalierbarkeitsvorteile strukturierter unstrukturierter Punktwolken änderte PTv3 die traditionelle räumliche Nähe, die durch K-Nearest definiert wird Die Abfrage von Nachbarn (KNN) macht 28 % der Weiterleitungszeit aus. Stattdessen wird das Potenzial serialisierter Nachbarschaften in Punktwolken untersucht, die nach bestimmten Mustern organisiert sind.

- PTv3 verwendet einen vereinfachten Ansatz, der speziell auf serialisierte Punktwolken zugeschnitten ist und komplexere Aufmerksamkeits-Patch-Interaktionsmechanismen wie Shift-Window (was die Fusion von Aufmerksamkeitsoperatoren behindert) und Nachbarschaftsmechanismen (was zu einem hohen Speicherverbrauch führt) ersetzt.

- PTv3 eliminiert die Abhängigkeit von der relativen Positionskodierung, die 26 % der Vorlaufzeit ausmacht, und setzt stattdessen auf einfachere Front-End-Faltungsschichten mit geringer Dichte.

In diesem Artikel werden diese Entwürfe als intuitive Entscheidungen betrachtet, die auf Skalierungsprinzipien und Fortschritten bei bestehenden Punktwolkentransformatoren beruhen. Wichtig ist, dass dieser Artikel hervorhebt, wie wichtig es ist, zu verstehen, wie sich Skalierbarkeit auf das Backbone-Design auswirkt, und nicht auf das detaillierte Moduldesign.

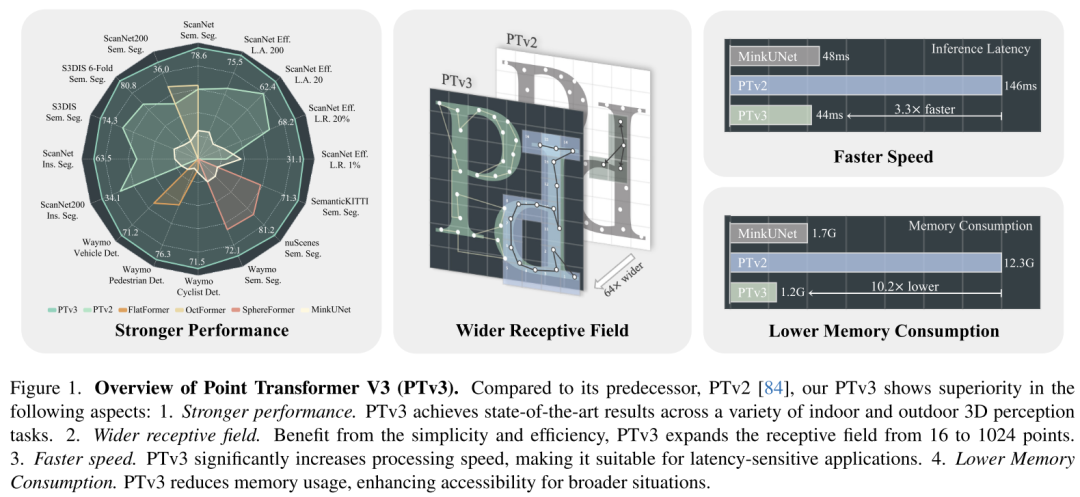

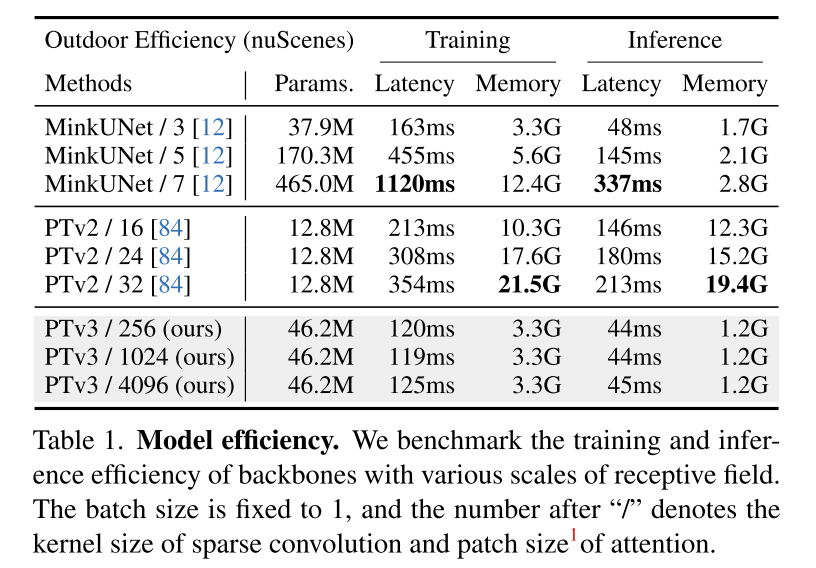

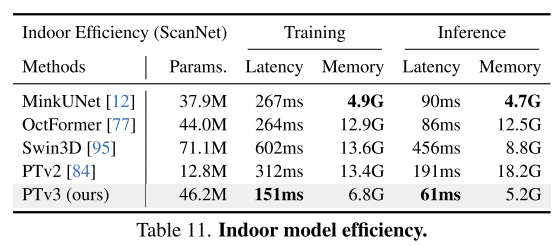

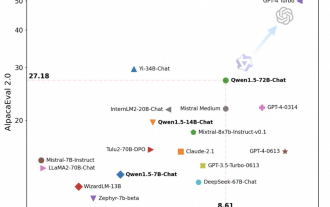

Dieses Prinzip verbessert die Skalierbarkeit erheblich und überwindet den traditionellen Kompromiss zwischen Genauigkeit und Effizienz (siehe Abbildung 1). PTv3 bietet eine 3,3-mal schnellere Inferenz und eine 10,2-mal geringere Speichernutzung als sein Vorgänger. Noch wichtiger ist, dass PTv3 seine inhärente Fähigkeit nutzt, den Erfassungsbereich zu skalieren und sein Empfangsfeld von 16 auf 1024 Punkte zu erweitern und gleichzeitig die Effizienz beizubehalten. Diese Skalierbarkeit untermauert seine überlegene Leistung bei realen Wahrnehmungsaufgaben, wobei PTv3 bei mehr als 20 nachgelagerten Aufgaben in Innen- und Außenszenarien hochmoderne Ergebnisse erzielt. PTv3 verbessert diese Ergebnisse weiter, indem es seine Datengröße durch Training mit mehreren Datensätzen weiter erhöht [85]. Wir hoffen, dass die Erkenntnisse dieses Artikels zukünftige Forschungen in dieser Richtung inspirieren werden.

Abbildung 1. Übersicht über Point Transformer V3 (PTv3). Im Vergleich zu seinem Vorgänger PTv2 [84] zeigt PTv3 in diesem Artikel eine Überlegenheit in den folgenden Aspekten: 1. Stärkere Leistung. PTv3 erzielt modernste Ergebnisse bei einer Vielzahl von 3D-Wahrnehmungsaufgaben im Innen- und Außenbereich. 2. Breiteres Empfangsfeld. Dank seiner Einfachheit und Effizienz erweitert PTv3 das Empfangsfeld von 16 auf 1024 Punkte. 3. Schneller. PTv3 erhöht die Verarbeitungsgeschwindigkeit erheblich und eignet sich daher für latenzempfindliche Anwendungen. 4. Reduzieren Sie den Speicherverbrauch. PTv3 reduziert die Speichernutzung und verbessert die Zugänglichkeit in einem breiteren Spektrum von Situationen.

Abbildung 2. Verzögerungsbaumdiagramm jeder Komponente von PTv2. Dieser Artikel bewertet und visualisiert das Vorwärtszeitverhältnis jeder Komponente von PTv2. KNN-Abfragen und RPE beanspruchen insgesamt 54 % der Weiterleitungszeit.

Abbildung 3. Punktwolken-Serialisierung. Dieser Artikel demonstriert vier Serialisierungsmuster durch Triplett-Visualisierung. Für jedes Triplett werden die raumfüllende Kurve für die Serialisierung (links), die Sortierreihenfolge der Punktwolken-Serialisierungsvariablen innerhalb der raumfüllenden Kurve (Mitte) und die gruppierten Patches der serialisierten Punktwolke für die lokale Aufmerksamkeit angezeigt (rechts). Durch die Transformation der vier Serialisierungsmodi kann der Aufmerksamkeitsmechanismus verschiedene räumliche Beziehungen und Kontexte erfassen und so die Modellgenauigkeit und Generalisierungsfähigkeit verbessern.

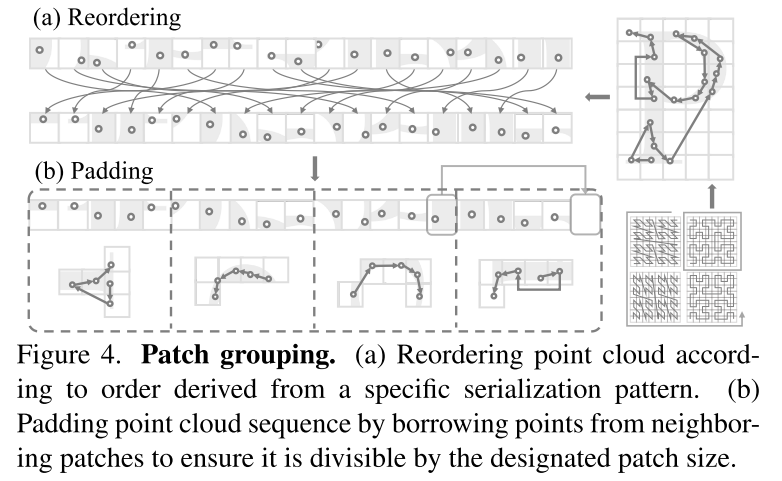

Abbildung 4. Patch-Gruppierung. (a) Neuordnung von Punktwolken gemäß einer aus einem bestimmten Serialisierungsschema abgeleiteten Reihenfolge. (b) Füllen Sie die Punktwolkensequenz, indem Sie Punkte aus benachbarten Patches übernehmen, um sicherzustellen, dass sie durch die angegebene Patchgröße teilbar ist.

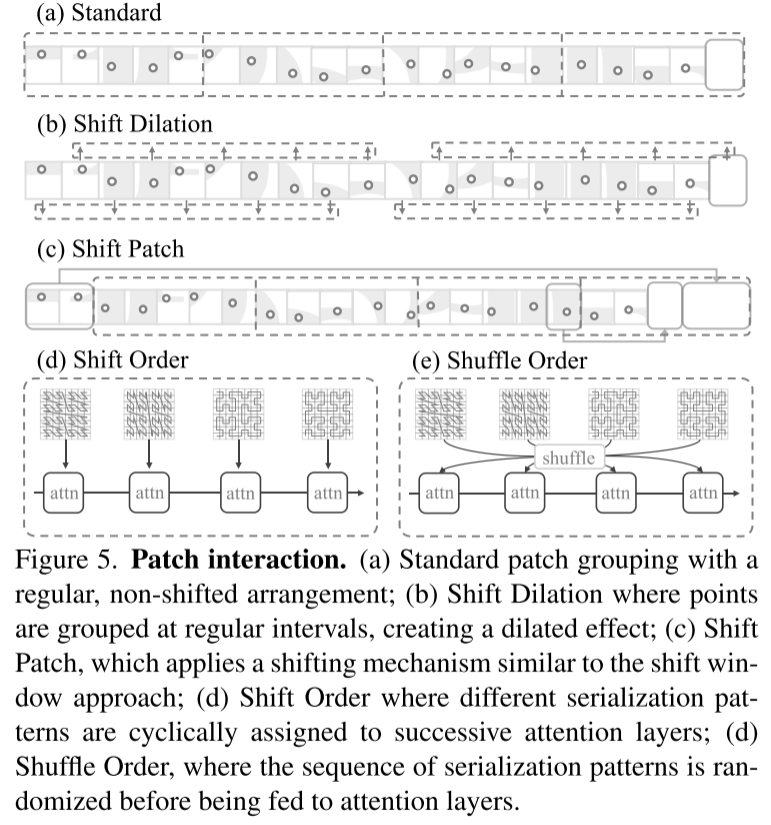

Abbildung 5. Patch-Interaktion. (a) Standard-Patch-Gruppierung mit einer regelmäßigen, nicht verschobenen Anordnung; (b) Translationserweiterung, bei der Punkte in regelmäßigen Abständen zusammengefasst werden, um einen Expansionseffekt zu erzeugen; (c) Shift Patch, der einen Verschiebungsmechanismus ähnlich dem verwendet Shift-Window-Methode; (d) Shift Order, bei der verschiedene Serialisierungsmuster zyklisch aufeinanderfolgenden Aufmerksamkeitsschichten zugewiesen werden; (d) Shuffle Order, bei der die Reihenfolge der Serialisierungsmuster vor der Eingabe in die Aufmerksamkeitsschicht randomisiert wird;

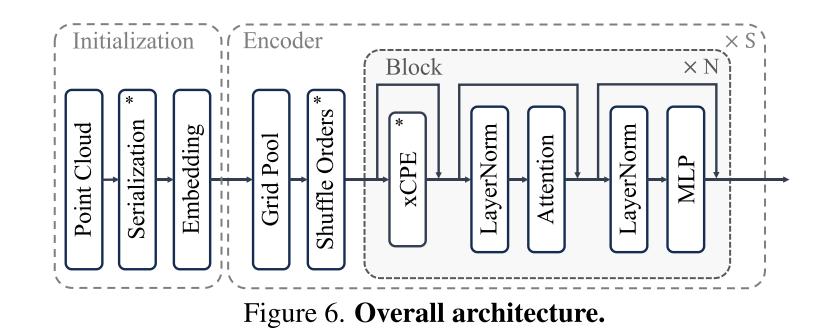

Abbildung 6. Gesamtarchitektur.

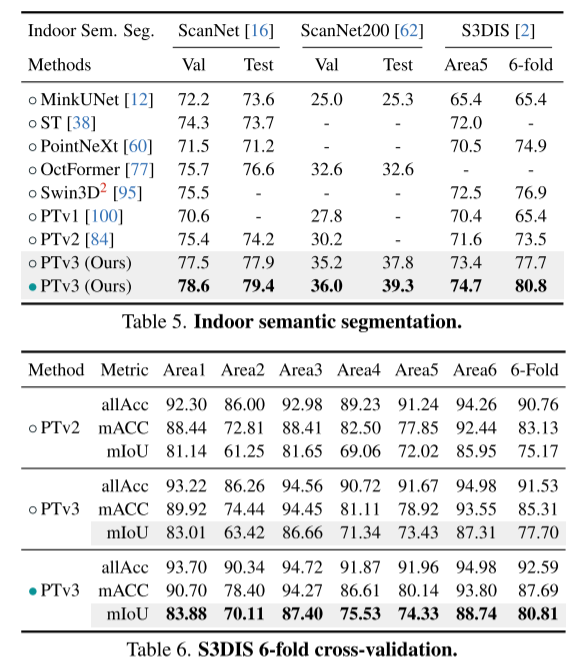

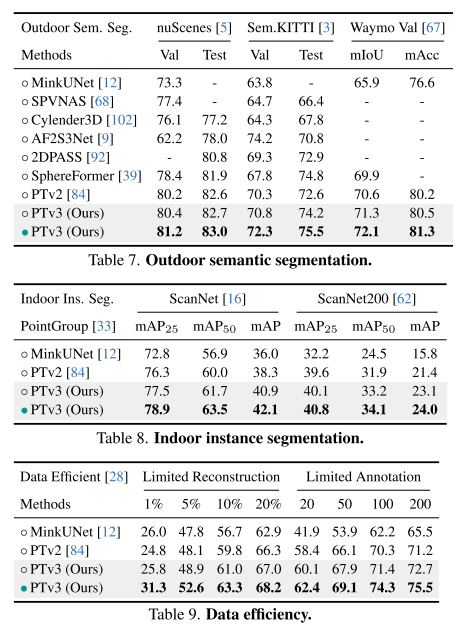

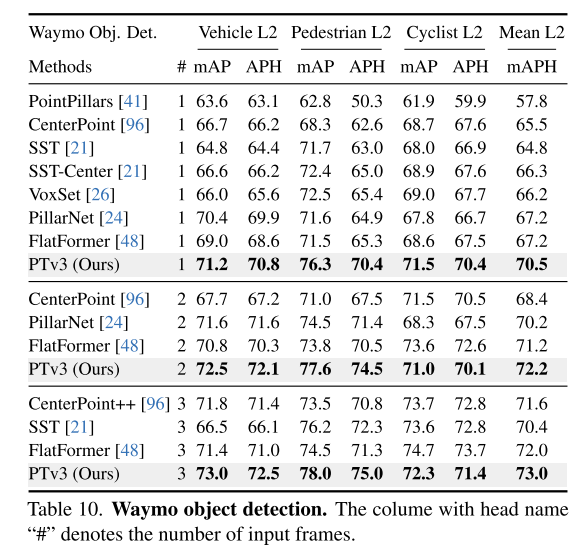

Experimentelle Ergebnisse:

Zusammenfassung:

In diesem Artikel wird Point Transform er V3 vorgestellt, der darauf abzielt, die Genauigkeit bei der Verarbeitung von Punktwolken zu verbessern Ein großer Fortschritt gegenüber dem traditionellen Kompromiss zwischen Effizienz und Effizienz. Basierend auf einer neuartigen Interpretation des Skalierungsprinzips im Backbone-Design argumentiert dieser Artikel, dass die Modellleistung stärker von der Skalierung als von der Komplexität des Designs beeinflusst wird. Durch die Priorisierung der Effizienz gegenüber der Genauigkeit kleinerer Schlagmechanismen nutzt dieses Papier die Macht der Skalierung und verbessert dadurch die Leistung. Kurz gesagt, dieser Artikel kann ein Modell leistungsfähiger machen, indem er es einfacher und schneller macht.

Zitat:

Wu, X., Jiang, L., Wang, P., Liu, Z., Liu, X., Qiao, Y., Ouyang, W., He, T. und Zhao , H. (2023). Point Transformer V3: Einfacher, schneller, stärker

Das obige ist der detaillierte Inhalt vonAktualisierter Point Transformer: effizienter, schneller und leistungsfähiger!. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

Open Source! Jenseits von ZoeDepth! DepthFM: Schnelle und genaue monokulare Tiefenschätzung!

Apr 03, 2024 pm 12:04 PM

Open Source! Jenseits von ZoeDepth! DepthFM: Schnelle und genaue monokulare Tiefenschätzung!

Apr 03, 2024 pm 12:04 PM

0.Was bewirkt dieser Artikel? Wir schlagen DepthFM vor: ein vielseitiges und schnelles generatives monokulares Tiefenschätzungsmodell auf dem neuesten Stand der Technik. Zusätzlich zu herkömmlichen Tiefenschätzungsaufgaben demonstriert DepthFM auch hochmoderne Fähigkeiten bei nachgelagerten Aufgaben wie dem Tiefen-Inpainting. DepthFM ist effizient und kann Tiefenkarten innerhalb weniger Inferenzschritte synthetisieren. Lassen Sie uns diese Arbeit gemeinsam lesen ~ 1. Titel der Papierinformationen: DepthFM: FastMonocularDepthEstimationwithFlowMatching Autor: MingGui, JohannesS.Fischer, UlrichPrestel, PingchuanMa, Dmytr

Tongyi Qianwen ist wieder Open Source, Qwen1.5 bietet sechs Volumenmodelle und seine Leistung übertrifft GPT3.5

Feb 07, 2024 pm 10:15 PM

Tongyi Qianwen ist wieder Open Source, Qwen1.5 bietet sechs Volumenmodelle und seine Leistung übertrifft GPT3.5

Feb 07, 2024 pm 10:15 PM

Pünktlich zum Frühlingsfest ist Version 1.5 des Tongyi Qianwen Large Model (Qwen) online. Heute Morgen erregten die Neuigkeiten über die neue Version die Aufmerksamkeit der KI-Community. Die neue Version des großen Modells umfasst sechs Modellgrößen: 0,5B, 1,8B, 4B, 7B, 14B und 72B. Unter ihnen übertrifft die Leistung der stärksten Version GPT3.5 und Mistral-Medium. Diese Version umfasst das Basismodell und das Chat-Modell und bietet Unterstützung für mehrere Sprachen. Das Tongyi Qianwen-Team von Alibaba gab an, dass die entsprechende Technologie auch auf der offiziellen Website von Tongyi Qianwen und der Tongyi Qianwen App eingeführt wurde. Darüber hinaus bietet die heutige Version von Qwen 1.5 auch die folgenden Highlights: Unterstützt eine Kontextlänge von 32 KB und öffnet den Prüfpunkt des Base+Chat-Modells.

Verzichten Sie auf die Encoder-Decoder-Architektur und verwenden Sie das Diffusionsmodell zur Kantenerkennung, das effektiver ist. Die National University of Defense Technology hat DiffusionEdge vorgeschlagen

Feb 07, 2024 pm 10:12 PM

Verzichten Sie auf die Encoder-Decoder-Architektur und verwenden Sie das Diffusionsmodell zur Kantenerkennung, das effektiver ist. Die National University of Defense Technology hat DiffusionEdge vorgeschlagen

Feb 07, 2024 pm 10:12 PM

Aktuelle Deep-Edge-Erkennungsnetzwerke verwenden normalerweise eine Encoder-Decoder-Architektur, die Up- und Down-Sampling-Module enthält, um mehrstufige Merkmale besser zu extrahieren. Diese Struktur schränkt jedoch die Ausgabe genauer und detaillierter Kantenerkennungsergebnisse des Netzwerks ein. Als Antwort auf dieses Problem bietet ein Papier zu AAAI2024 eine neue Lösung. Titel der Abschlussarbeit: DiffusionEdge:DiffusionProbabilisticModelforCrispEdgeDetection Autoren: Ye Yunfan (Nationale Universität für Verteidigungstechnologie), Xu Kai (Nationale Universität für Verteidigungstechnologie), Huang Yuxing (Nationale Universität für Verteidigungstechnologie), Yi Renjiao (Nationale Universität für Verteidigungstechnologie), Cai Zhiping (National University of Defense Technology) Link zum Papier: https://ar

Große Modelle können ebenfalls in Scheiben geschnitten werden, und Microsoft SliceGPT erhöht die Recheneffizienz von LLAMA-2 erheblich

Jan 31, 2024 am 11:39 AM

Große Modelle können ebenfalls in Scheiben geschnitten werden, und Microsoft SliceGPT erhöht die Recheneffizienz von LLAMA-2 erheblich

Jan 31, 2024 am 11:39 AM

Große Sprachmodelle (LLMs) verfügen typischerweise über Milliarden von Parametern und werden auf Billionen von Token trainiert. Die Schulung und Bereitstellung solcher Modelle ist jedoch sehr teuer. Um den Rechenaufwand zu reduzieren, werden häufig verschiedene Modellkomprimierungstechniken eingesetzt. Diese Modellkomprimierungstechniken können im Allgemeinen in vier Kategorien unterteilt werden: Destillation, Tensorzerlegung (einschließlich Faktorisierung mit niedrigem Rang), Bereinigung und Quantisierung. Pruning-Methoden gibt es schon seit einiger Zeit, aber viele erfordern nach dem Pruning eine Feinabstimmung der Wiederherstellung (Recovery Fine-Tuning, RFT), um die Leistung aufrechtzuerhalten, was den gesamten Prozess kostspielig und schwierig zu skalieren macht. Forscher der ETH Zürich und von Microsoft haben eine Lösung für dieses Problem namens SliceGPT vorgeschlagen. Die Kernidee dieser Methode besteht darin, die Einbettung des Netzwerks durch das Löschen von Zeilen und Spalten in der Gewichtsmatrix zu reduzieren.

Hallo, elektrischer Atlas! Der Boston Dynamics-Roboter erwacht wieder zum Leben, seltsame 180-Grad-Bewegungen machen Musk Angst

Apr 18, 2024 pm 07:58 PM

Hallo, elektrischer Atlas! Der Boston Dynamics-Roboter erwacht wieder zum Leben, seltsame 180-Grad-Bewegungen machen Musk Angst

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas tritt offiziell in die Ära der Elektroroboter ein! Gestern hat sich der hydraulische Atlas einfach „unter Tränen“ von der Bühne der Geschichte zurückgezogen. Heute gab Boston Dynamics bekannt, dass der elektrische Atlas im Einsatz ist. Es scheint, dass Boston Dynamics im Bereich kommerzieller humanoider Roboter entschlossen ist, mit Tesla zu konkurrieren. Nach der Veröffentlichung des neuen Videos wurde es innerhalb von nur zehn Stunden bereits von mehr als einer Million Menschen angesehen. Die alten Leute gehen und neue Rollen entstehen. Das ist eine historische Notwendigkeit. Es besteht kein Zweifel, dass dieses Jahr das explosive Jahr der humanoiden Roboter ist. Netizens kommentierten: Die Weiterentwicklung der Roboter hat dazu geführt, dass die diesjährige Eröffnungsfeier wie Menschen aussieht, und der Freiheitsgrad ist weitaus größer als der von Menschen. Aber ist das wirklich kein Horrorfilm? Zu Beginn des Videos liegt Atlas ruhig auf dem Boden, scheinbar auf dem Rücken. Was folgt, ist atemberaubend

Aktualisierter Point Transformer: effizienter, schneller und leistungsfähiger!

Jan 17, 2024 am 08:27 AM

Aktualisierter Point Transformer: effizienter, schneller und leistungsfähiger!

Jan 17, 2024 am 08:27 AM

Originaltitel: PointTransformerV3: Simpler, Faster, Stronger Papier-Link: https://arxiv.org/pdf/2312.10035.pdf Code-Link: https://github.com/Pointcept/PointTransformerV3 Autor: HKUSHAILabMPIPKUMIT Papier-Idee: Dieser Artikel ist nicht zur Veröffentlichung in „Suche nach Innovation innerhalb des Aufmerksamkeitsmechanismus“ gedacht. Stattdessen liegt der Schwerpunkt darauf, die Macht der Skalierung zu nutzen, um bestehende Kompromisse zwischen Genauigkeit und Effizienz im Kontext der Punktwolkenverarbeitung zu überwinden. Lassen Sie sich von den jüngsten Fortschritten beim Lernen groß angelegter 3D-Darstellungen inspirieren.

Die Vitalität der Superintelligenz erwacht! Aber mit der Einführung der sich selbst aktualisierenden KI müssen sich Mütter keine Sorgen mehr über Datenengpässe machen

Apr 29, 2024 pm 06:55 PM

Die Vitalität der Superintelligenz erwacht! Aber mit der Einführung der sich selbst aktualisierenden KI müssen sich Mütter keine Sorgen mehr über Datenengpässe machen

Apr 29, 2024 pm 06:55 PM

Ich weine zu Tode. Die Daten im Internet reichen überhaupt nicht aus. Das Trainingsmodell sieht aus wie „Die Tribute von Panem“, und KI-Forscher auf der ganzen Welt machen sich Gedanken darüber, wie sie diese datenhungrigen Esser ernähren sollen. Dieses Problem tritt insbesondere bei multimodalen Aufgaben auf. Zu einer Zeit, als sie ratlos waren, nutzte ein Start-up-Team der Abteilung der Renmin-Universität von China sein eigenes neues Modell, um als erstes in China einen „modellgenerierten Datenfeed selbst“ in die Realität umzusetzen. Darüber hinaus handelt es sich um einen zweigleisigen Ansatz auf der Verständnisseite und der Generierungsseite. Beide Seiten können hochwertige, multimodale neue Daten generieren und Datenrückmeldungen an das Modell selbst liefern. Was ist ein Modell? Awaker 1.0, ein großes multimodales Modell, das gerade im Zhongguancun-Forum erschienen ist. Wer ist das Team? Sophon-Motor. Gegründet von Gao Yizhao, einem Doktoranden an der Hillhouse School of Artificial Intelligence der Renmin University.

Die Kuaishou-Version von Sora „Ke Ling' steht zum Testen offen: Sie generiert über 120 Sekunden Videos, versteht die Physik besser und kann komplexe Bewegungen genau modellieren

Jun 11, 2024 am 09:51 AM

Die Kuaishou-Version von Sora „Ke Ling' steht zum Testen offen: Sie generiert über 120 Sekunden Videos, versteht die Physik besser und kann komplexe Bewegungen genau modellieren

Jun 11, 2024 am 09:51 AM

Was? Wird Zootopia durch heimische KI in die Realität umgesetzt? Zusammen mit dem Video wird ein neues groß angelegtes inländisches Videogenerationsmodell namens „Keling“ vorgestellt. Sora geht einen ähnlichen technischen Weg und kombiniert eine Reihe selbst entwickelter technologischer Innovationen, um Videos zu produzieren, die nicht nur große und vernünftige Bewegungen aufweisen, sondern auch die Eigenschaften der physischen Welt simulieren und über starke konzeptionelle Kombinationsfähigkeiten und Vorstellungskraft verfügen. Den Daten zufolge unterstützt Keling die Erstellung ultralanger Videos von bis zu 2 Minuten mit 30 Bildern pro Sekunde, mit Auflösungen von bis zu 1080p und unterstützt mehrere Seitenverhältnisse. Ein weiterer wichtiger Punkt ist, dass es sich bei Keling nicht um eine vom Labor veröffentlichte Demo oder Video-Ergebnisdemonstration handelt, sondern um eine Anwendung auf Produktebene, die von Kuaishou, einem führenden Anbieter im Bereich Kurzvideos, gestartet wurde. Darüber hinaus liegt das Hauptaugenmerk darauf, pragmatisch zu sein, keine Blankoschecks auszustellen und sofort nach der Veröffentlichung online zu gehen. Das große Modell von Ke Ling wurde bereits in Kuaiying veröffentlicht.