Gängige metaheuristische Algorithmen und ihre Prinzipien und Anwendungen

Bei der Lösung von Problemen müssen wir praktikable Lösungen finden und Verbesserungen vornehmen, um die optimale globale Lösung zu erhalten. Aufgrund begrenzter Ressourcen und der Komplexität der meisten Optimierungsprobleme ist es jedoch schwierig, sehr präzise Lösungen zu finden. Um solche Probleme zu lösen, können metaheuristische Optimierungsalgorithmen durch die Bereitstellung von Näherungslösungen gelöst werden. Diese Algorithmen helfen uns, mögliche Lösungen im Suchraum zu finden, indem sie biologische, physikalische oder soziale Phänomene in der Natur simulieren. Obwohl diese Lösungen möglicherweise nicht optimal sind, sind sie oft nahezu optimal und funktionieren in der Praxis gut. Daher sind metaheuristische Optimierungsalgorithmen zu einem leistungsstarken Werkzeug zur Lösung komplexer Optimierungsprobleme geworden.

Metaheuristische Algorithmen werden häufig zur Lösung verschiedener nichtlinearer und nichtkonvexer Optimierungsprobleme verwendet. Insbesondere bei der kombinatorischen Optimierung haben herkömmliche Algorithmen oft Schwierigkeiten, spezifische Probleme mit Unsicherheit innerhalb einer angemessenen Zeit zu lösen. Metaheuristiken können häufig mit weniger Rechenaufwand geeignete Lösungen finden als Optimierungsalgorithmen, iterative Methoden und einfache gierige Heuristiken.

Metaheuristische Algorithmen spielen in verschiedenen Bereichen eine Schlüsselrolle. Viele Optimierungsprobleme sind Mehrzielfunktionen mit nichtlinearen Einschränkungen. Beispielsweise sind viele technische Optimierungsprobleme stark nichtlinear und erfordern die Lösung von Problemen mit mehreren Zielen. Darüber hinaus beruhen Probleme der künstlichen Intelligenz und des maschinellen Lernens häufig auf großen Datensätzen, und es ist schwierig, die Optimalität durch Optimierungsprobleme zu lösen. Daher spielen metaheuristische Algorithmen eine wichtige Rolle bei der Lösung praktischer Probleme.

Metaheuristische Algorithmen werden nach verschiedenen Betriebsarten klassifiziert, darunter natürliche und unnatürliche Heuristiken, bevölkerungsbasierte und individuelle Suche, dynamische und statische Zielfunktionen, unterschiedliche Nachbarschaftsstrukturen, Speichernutzung und speicherfreie Methoden usw.

Häufig verwendete metaheuristische Algorithmen

1. Genetischer Algorithmus (GA)

Der genetische Algorithmus (GA) ist ein metaheuristischer Algorithmus, der vom Evolutionsprozess der natürlichen Selektion und der natürlichen Genetik inspiriert ist.

2. Simuliertes Glühen (SA)

Simuliertes Glühen (SA) ist von den Heiz- und kontrollierten Kühlvorgängen in der Metallurgie inspiriert.

3. Tabu Search (TS)

Tabu Search (TS) basiert auf Speicherstrukturen und nutzt lokale Suchmethoden, um mögliche Lösungen durch Überprüfung ihrer Nachbarn zu finden.

4. Schwarmintelligenz-Algorithmus

Der Schwarmintelligenzalgorithmus ist vom Sozialverhalten von Vogelschwärmen, Tierräubern und -jagden, Bakterienwachstum und Fischschwärmen inspiriert. Zu den gebräuchlichsten gehören der Ameisenkolonie-Algorithmus, der Partikelschwarm-Algorithmus, der Bienenkolonie-Algorithmus, der Kuckuckssuchalgorithmus und so weiter.

5. Variable Neighborhood Search (VNS)

Der Variable Neighborhood Search (VNS)-Algorithmus untersucht erste Lösungen und verbessert sie. Ähnlich wie bei der Tabu-Suche werden lokale Suchmethoden iterativ angewendet und aus den Lösungen lokal optimale Lösungen gewonnen.

Das obige ist der detaillierte Inhalt vonGängige metaheuristische Algorithmen und ihre Prinzipien und Anwendungen. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1376

1376

52

52

Eine eingehende Analyse des Grey Wolf Optimization Algorithm (GWO) und seiner Stärken und Schwächen

Jan 19, 2024 pm 07:48 PM

Eine eingehende Analyse des Grey Wolf Optimization Algorithm (GWO) und seiner Stärken und Schwächen

Jan 19, 2024 pm 07:48 PM

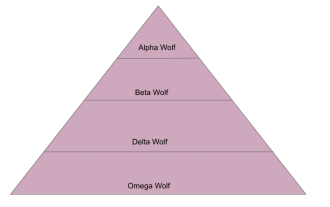

Der Grey Wolf Optimization Algorithm (GWO) ist ein bevölkerungsbasierter metaheuristischer Algorithmus, der die Führungshierarchie und den Jagdmechanismus grauer Wölfe in der Natur simuliert. Inspiration zum Grauwolf-Algorithmus 1. Graue Wölfe gelten als Spitzenprädatoren und stehen an der Spitze der Nahrungskette. 2. Graue Wölfe leben gerne in Gruppen (Gruppenleben), mit durchschnittlich 5-12 Wölfen in jedem Rudel. 3. Graue Wölfe haben eine sehr strenge soziale Dominanzhierarchie, wie unten gezeigt: Alpha-Wolf: Alpha-Wolf nimmt eine dominante Position in der gesamten Gruppe grauer Wölfe ein und hat das Recht, die gesamte Gruppe grauer Wölfe zu befehligen. Bei der Anwendung von Algorithmen ist Alpha Wolf eine der besten Lösungen, die vom Optimierungsalgorithmus erzeugte optimale Lösung. Beta-Wolf: Beta-Wolf berichtet regelmäßig an Alpha-Wolf und hilft Alpha-Wolf, die besten Entscheidungen zu treffen. In Algorithmusanwendungen kann Beta Wolf

Erkunden Sie die Grundprinzipien und den Implementierungsprozess verschachtelter Sampling-Algorithmen

Jan 22, 2024 pm 09:51 PM

Erkunden Sie die Grundprinzipien und den Implementierungsprozess verschachtelter Sampling-Algorithmen

Jan 22, 2024 pm 09:51 PM

Der verschachtelte Stichprobenalgorithmus ist ein effizienter Bayes'scher statistischer Inferenzalgorithmus, der zur Berechnung des Integrals oder der Summation unter komplexen Wahrscheinlichkeitsverteilungen verwendet wird. Dabei wird der Parameterraum in mehrere Hyperwürfel mit gleichem Volumen zerlegt und schrittweise und iterativ einer der Hyperwürfel mit dem kleinsten Volumen „herausgeschoben“ und dann der Hyperwürfel mit Zufallsstichproben gefüllt, um den Integralwert der Wahrscheinlichkeitsverteilung besser abzuschätzen. Durch kontinuierliche Iteration kann der verschachtelte Stichprobenalgorithmus hochpräzise Integralwerte und Grenzen des Parameterraums erhalten, die auf statistische Probleme wie Modellvergleich, Parameterschätzung und Modellauswahl angewendet werden können. Die Kernidee dieses Algorithmus besteht darin, komplexe Integrationsprobleme in eine Reihe einfacher Integrationsprobleme umzuwandeln und sich dem wahren Integralwert zu nähern, indem das Volumen des Parameterraums schrittweise verringert wird. Bei jedem Iterationsschritt werden zufällig Stichproben aus dem Parameterraum entnommen

Analysieren Sie die Prinzipien, Modelle und Zusammensetzung des Sparrow Search Algorithm (SSA)

Jan 19, 2024 pm 10:27 PM

Analysieren Sie die Prinzipien, Modelle und Zusammensetzung des Sparrow Search Algorithm (SSA)

Jan 19, 2024 pm 10:27 PM

Der Sparrow Search Algorithm (SSA) ist ein metaheuristischer Optimierungsalgorithmus, der auf dem Anti-Raub- und Futtersuchverhalten von Spatzen basiert. Das Futtersuchverhalten von Spatzen kann in zwei Haupttypen unterteilt werden: Produzenten und Aasfresser. Produzenten suchen aktiv nach Nahrungsmitteln, während Aasfresser um Nahrungsmittel von Produzenten konkurrieren. Prinzip des Sparrow-Suchalgorithmus (SSA) Beim Sparrow-Suchalgorithmus (SSA) achtet jeder Spatz genau auf das Verhalten seiner Nachbarn. Durch den Einsatz verschiedener Futtersuchstrategien sind Einzelpersonen in der Lage, die gespeicherte Energie effizient zu nutzen, um mehr Nahrung zu suchen. Darüber hinaus sind Vögel in ihrem Suchraum anfälliger für Raubtiere und müssen daher sicherere Orte finden. Vögel in der Mitte einer Kolonie können ihren eigenen Gefahrenbereich minimieren, indem sie in der Nähe ihrer Nachbarn bleiben. Wenn ein Vogel ein Raubtier entdeckt, alarmiert er es

Welche Rolle spielt der Informationsgewinn im ID3-Algorithmus?

Jan 23, 2024 pm 11:27 PM

Welche Rolle spielt der Informationsgewinn im ID3-Algorithmus?

Jan 23, 2024 pm 11:27 PM

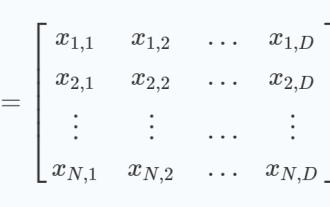

Der ID3-Algorithmus ist einer der grundlegenden Algorithmen beim Lernen von Entscheidungsbäumen. Es wählt den besten Teilungspunkt aus, indem es den Informationsgewinn jedes Features berechnet, um einen Entscheidungsbaum zu erstellen. Der Informationsgewinn ist ein wichtiges Konzept im ID3-Algorithmus, der zur Messung des Beitrags von Merkmalen zur Klassifizierungsaufgabe verwendet wird. In diesem Artikel werden das Konzept, die Berechnungsmethode und die Anwendung des Informationsgewinns im ID3-Algorithmus ausführlich vorgestellt. 1. Das Konzept der Informationsentropie Informationsentropie ist ein Konzept der Informationstheorie, das die Unsicherheit von Zufallsvariablen misst. Für eine diskrete Zufallsvariablenzahl stellt p(x_i) die Wahrscheinlichkeit dar, dass die Zufallsvariable X den Wert x_i annimmt. Brief

Einführung in den Wu-Manber-Algorithmus und Python-Implementierungsanweisungen

Jan 23, 2024 pm 07:03 PM

Einführung in den Wu-Manber-Algorithmus und Python-Implementierungsanweisungen

Jan 23, 2024 pm 07:03 PM

Der Wu-Manber-Algorithmus ist ein String-Matching-Algorithmus zur effizienten Suche nach Strings. Es handelt sich um einen Hybridalgorithmus, der die Vorteile der Boyer-Moore- und Knuth-Morris-Pratt-Algorithmen kombiniert, um einen schnellen und genauen Mustervergleich zu ermöglichen. Schritt 1 des Wu-Manber-Algorithmus: Erstellen Sie eine Hash-Tabelle, die jede mögliche Teilzeichenfolge des Musters der Musterposition zuordnet, an der diese Teilzeichenfolge auftritt. 2. Diese Hash-Tabelle wird verwendet, um mögliche Startpositionen von Mustern im Text schnell zu identifizieren. 3. Durchlaufen Sie den Text und vergleichen Sie jedes Zeichen mit dem entsprechenden Zeichen im Muster. 4. Wenn die Zeichen übereinstimmen, können Sie zum nächsten Zeichen wechseln und den Vergleich fortsetzen. 5. Wenn die Zeichen nicht übereinstimmen, können Sie mithilfe einer Hash-Tabelle das nächste mögliche Zeichen im Muster ermitteln.

SIFT-Algorithmus (Scale Invariant Features).

Jan 22, 2024 pm 05:09 PM

SIFT-Algorithmus (Scale Invariant Features).

Jan 22, 2024 pm 05:09 PM

Der Scale Invariant Feature Transform (SIFT)-Algorithmus ist ein Merkmalsextraktionsalgorithmus, der in den Bereichen Bildverarbeitung und Computer Vision verwendet wird. Dieser Algorithmus wurde 1999 vorgeschlagen, um die Objekterkennung und die Matching-Leistung in Computer-Vision-Systemen zu verbessern. Der SIFT-Algorithmus ist robust und genau und wird häufig in der Bilderkennung, dreidimensionalen Rekonstruktion, Zielerkennung, Videoverfolgung und anderen Bereichen eingesetzt. Es erreicht Skaleninvarianz, indem es Schlüsselpunkte in mehreren Skalenräumen erkennt und lokale Merkmalsdeskriptoren um die Schlüsselpunkte herum extrahiert. Zu den Hauptschritten des SIFT-Algorithmus gehören die Skalenraumkonstruktion, die Erkennung von Schlüsselpunkten, die Positionierung von Schlüsselpunkten, die Richtungszuweisung und die Generierung von Merkmalsdeskriptoren. Durch diese Schritte kann der SIFT-Algorithmus robuste und einzigartige Merkmale extrahieren und so eine effiziente Bildverarbeitung erreichen.

Numerische Optimierungsprinzipien und Analyse des Whale Optimization Algorithm (WOA)

Jan 19, 2024 pm 07:27 PM

Numerische Optimierungsprinzipien und Analyse des Whale Optimization Algorithm (WOA)

Jan 19, 2024 pm 07:27 PM

Der Whale Optimization Algorithm (WOA) ist ein von der Natur inspirierter metaheuristischer Optimierungsalgorithmus, der das Jagdverhalten von Buckelwalen simuliert und zur Optimierung numerischer Probleme eingesetzt wird. Der Whale Optimization Algorithm (WOA) beginnt mit einer Reihe zufälliger Lösungen und optimiert basierend auf einem zufällig ausgewählten Suchagenten oder der bisher besten Lösung durch Positionsaktualisierungen des Suchagenten in jeder Iteration. Inspiration für den Waloptimierungsalgorithmus Der Waloptimierungsalgorithmus ist vom Jagdverhalten von Buckelwalen inspiriert. Buckelwale bevorzugen oberflächennahe Nahrung wie Krill und Fischschwärme. Daher sammeln Buckelwale Nahrung und bilden ein Blasennetzwerk, indem sie bei der Jagd Blasen in einer Spirale von unten nach oben blasen. Bei einem „Aufwärtsspiral“-Manöver taucht der Buckelwal etwa 12 m tief, beginnt dann, eine spiralförmige Blase um seine Beute zu bilden und schwimmt nach oben

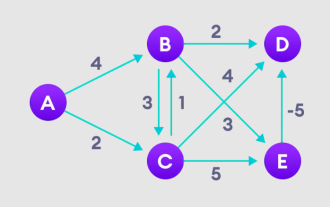

Detaillierte Erläuterung des Bellman-Ford-Algorithmus und der Implementierung in Python

Jan 22, 2024 pm 07:39 PM

Detaillierte Erläuterung des Bellman-Ford-Algorithmus und der Implementierung in Python

Jan 22, 2024 pm 07:39 PM

Der Bellman-Ford-Algorithmus kann den kürzesten Weg vom Zielknoten zu anderen Knoten im gewichteten Diagramm finden. Dies ist dem Dijkstra-Algorithmus sehr ähnlich. Der Bellman-Ford-Algorithmus kann Diagramme mit negativen Gewichten verarbeiten und ist hinsichtlich der Implementierung relativ einfach. Ausführliche Erläuterung des Prinzips des Bellman-Ford-Algorithmus: Der Bellman-Ford-Algorithmus findet iterativ neue Pfade, die kürzer als die überschätzten Pfade sind, indem er die Pfadlängen vom Startscheitelpunkt zu allen anderen Scheitelpunkten überschätzt. Da wir die Pfadentfernung jedes Knotens aufzeichnen möchten, können wir sie in einem Array der Größe n speichern, wobei n auch die Anzahl der Knoten darstellt. Beispiel Abbildung 1. Wählen Sie den Startknoten aus, weisen Sie ihn unbegrenzt allen anderen Scheitelpunkten zu und zeichnen Sie den Pfadwert auf. 2. Besuchen Sie jede Kante und führen Sie Entspannungsoperationen durch, um den kürzesten Pfad kontinuierlich zu aktualisieren. 3. Wir brauchen