Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Das neueste Benchmark-CMMMU, das für den chinesischen LMM-Körper geeignet ist: Enthält mehr als 30 Unterteilungen und 12.000 Fragen auf Expertenebene

Das neueste Benchmark-CMMMU, das für den chinesischen LMM-Körper geeignet ist: Enthält mehr als 30 Unterteilungen und 12.000 Fragen auf Expertenebene

Das neueste Benchmark-CMMMU, das für den chinesischen LMM-Körper geeignet ist: Enthält mehr als 30 Unterteilungen und 12.000 Fragen auf Expertenebene

Mit der Weiterentwicklung multimodaler Großmodelle (LMMs) wächst auch die Notwendigkeit, die Leistung von LMMs zu bewerten. Insbesondere im chinesischen Umfeld wird es immer wichtiger, das fortgeschrittene Wissen und die Denkfähigkeit von LMM zu bewerten.

Um in diesem Zusammenhang die multimodalen Verständnisfähigkeiten des Basismodells auf Expertenebene bei verschiedenen Aufgaben auf Chinesisch zu bewerten, haben die M-A-P Open Source Community, die Hong Kong University of Science and Technology, die University of Waterloo und Zero One Wanxing hat gemeinsam den CMMMU-Benchmark (Chinese Massive Multi-Discipline Multimodal Understanding and Reasoning) eingeführt. Dieser Benchmark zielt darauf ab, eine umfassende Bewertungsplattform für umfassendes multidisziplinäres multimodales Verständnis und Denken auf Chinesisch bereitzustellen. Der Benchmark ermöglicht es Forschern, Modelle für eine Vielzahl von Aufgaben zu testen und ihre multimodalen Verständnisfähigkeiten mit professionellem Niveau zu vergleichen. Das Ziel dieses gemeinsamen Projekts besteht darin, die Entwicklung des Bereichs des multimodalen Verständnisses und Denkens in China voranzutreiben und eine standardisierte Referenz für die entsprechende Forschung bereitzustellen.

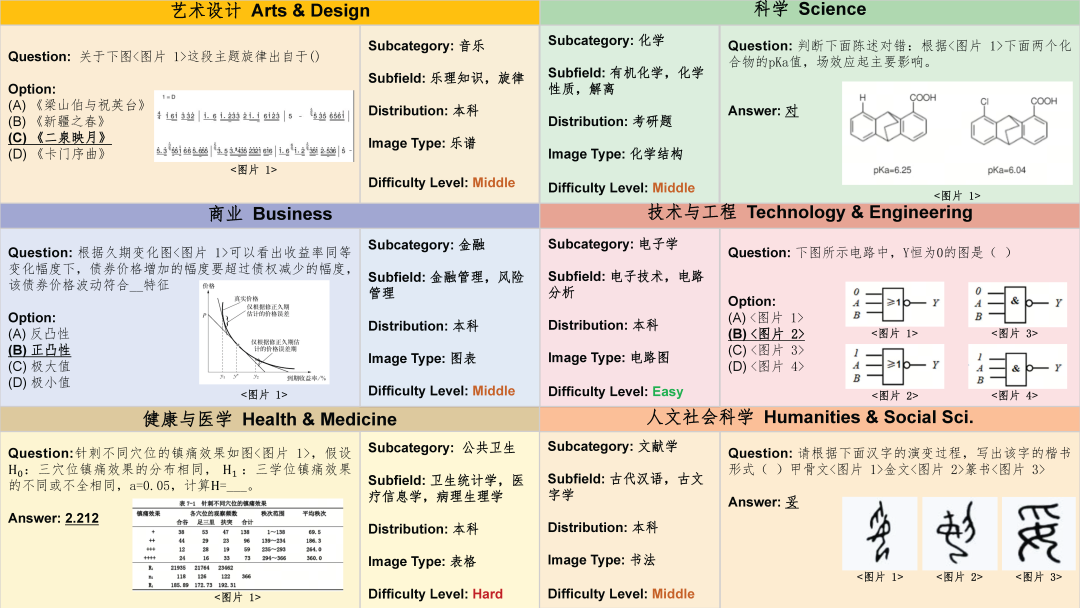

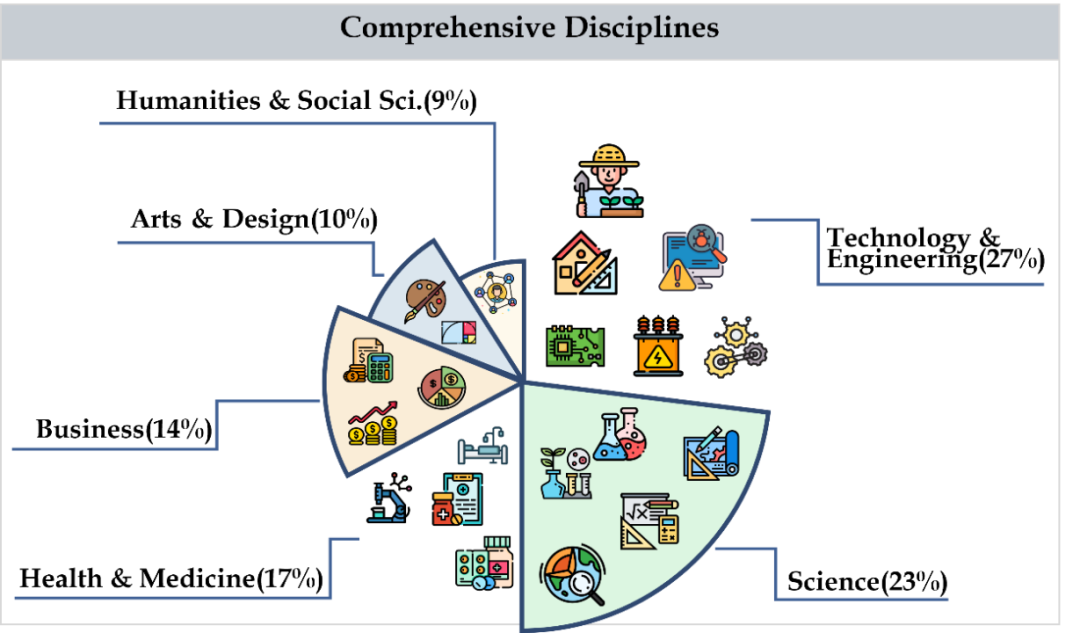

CMMMU deckt sechs Hauptkategorien von Fächern ab, darunter Kunst, Wirtschaft, Gesundheit und Medizin, Naturwissenschaften, Geistes- und Sozialwissenschaften, Technologie und Ingenieurwesen, mit mehr als 30 Unterteilungen. Die folgende Abbildung zeigt ein Beispiel einer Frage für jedes Unterfeldthema. CMMMU ist einer der ersten multimodalen Benchmarks im chinesischen Kontext und einer der wenigen multimodalen Benchmarks, der die komplexen Verständnis- und Argumentationsfähigkeiten von LMM untersucht.

Datensatzkonstruktion

Datenerfassung

Die Datenerfassung ist in drei Phasen unterteilt. Zunächst sammelten die Forscher Fragequellen für jedes Thema, das den Urheberrechtslizenzanforderungen entsprach, einschließlich Webseiten oder Büchern. Während dieses Prozesses haben sie hart daran gearbeitet, Duplikate von Fragenquellen zu vermeiden, um Datenvielfalt und -genauigkeit sicherzustellen. Zweitens leiteten die Forscher die Fragenquellen zur weiteren Kommentierung an Crowdsourcing-Annotatoren weiter. Alle Kommentatoren sind Personen mit einem Bachelor-Abschluss oder höher, um sicherzustellen, dass sie die kommentierten Fragen und zugehörigen Erklärungen überprüfen können. Während des Annotationsprozesses verlangen Forscher von den Annotatoren, dass sie sich strikt an die Annotationsprinzipien halten. Filtern Sie beispielsweise Fragen heraus, für deren Beantwortung keine Bilder erforderlich sind, Fragen, die nach Möglichkeit dasselbe Bild verwenden, und Fragen, für deren Beantwortung kein Expertenwissen erforderlich ist. Um schließlich die Anzahl der Fragen in jedem Fach im Datensatz auszugleichen, ergänzten die Forscher die Fächer gezielt durch weniger Fragen. Dadurch wird die Vollständigkeit und Repräsentativität des Datensatzes sichergestellt, sodass nachfolgende Analysen und Untersuchungen genauer und umfassender sind.

Datensatzbereinigung

Um die Datenqualität von CMMMU weiter zu verbessern, befolgen Forscher strenge Protokolle zur Datenqualitätskontrolle. Zunächst wird jede Frage von mindestens einem der Autoren der Arbeit persönlich überprüft. Zweitens haben sie zur Vermeidung von Datenverschmutzungsproblemen auch Fragen herausgefiltert, die mehrere LLMs ohne Rückgriff auf OCR-Technologie beantworten könnten. Diese Maßnahmen gewährleisten die Zuverlässigkeit und Genauigkeit der CMMMU-Daten.

Datensatzübersicht

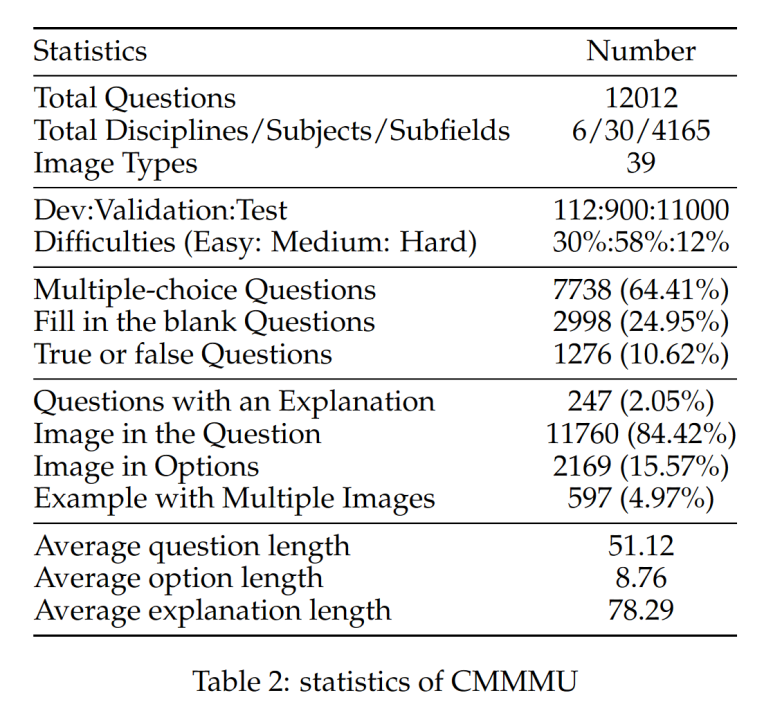

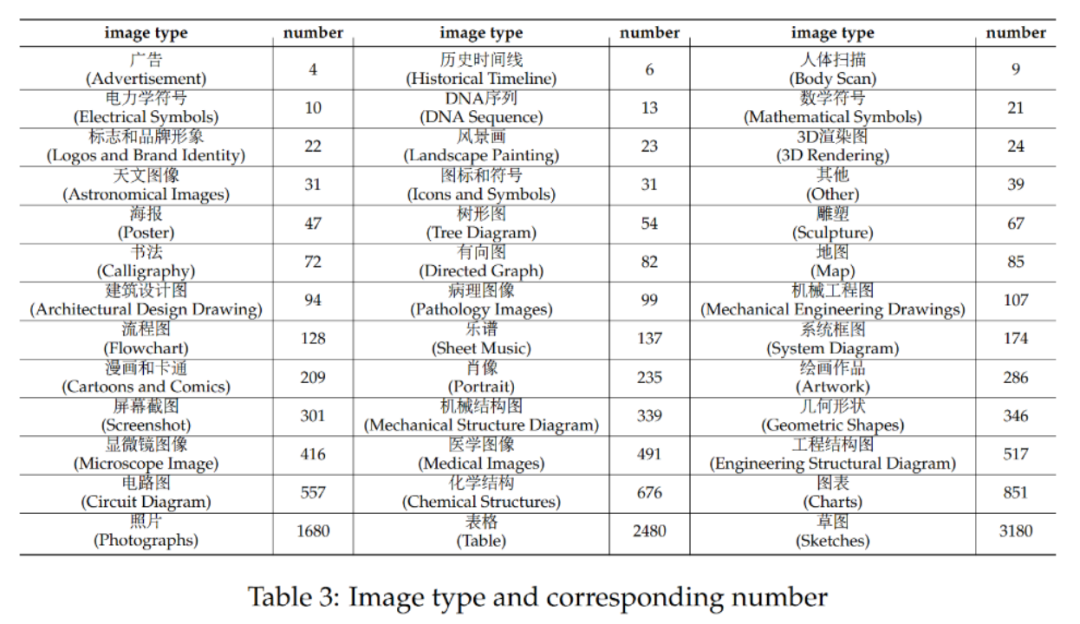

CMMMU verfügt über insgesamt 12.000 Fragen, die in Entwicklungssätze mit wenigen Stichproben, Verifizierungssätze und Testsätze unterteilt sind. Der Entwicklungssatz mit wenigen Stichproben enthält etwa 5 Fragen für jedes Thema, der Validierungssatz enthält 900 Fragen und der Testsatz enthält 11.000 Fragen. Die Fragen umfassen 39 Arten von Bildern, darunter pathologische Diagramme, Notendiagramme, Schaltpläne, chemische Strukturdiagramme usw. Die Fragen sind in drei Schwierigkeitsstufen unterteilt: leicht (30 %), mittel (58 %) und schwer (12 %), basierend auf der logischen Schwierigkeit und nicht auf der intellektuellen Schwierigkeit. Weitere Fragenstatistiken finden Sie in Tabelle 2 und Tabelle 3. Das Team testete die Leistung verschiedener gängiger zweisprachiger LMMs auf Chinesisch und Englisch sowie mehrerer LLMs auf CMMMU. Es sind sowohl Closed-Source- als auch Open-Source-Modelle enthalten. Der Bewertungsprozess verwendet Zero-Shot-Einstellungen anstelle von Feinabstimmungs- oder Wenig-Shot-Einstellungen, um die Rohfunktionen des Modells zu überprüfen. LLM fügte außerdem Experimente hinzu, bei denen Bild-OCR-Ergebnisse + Text als Eingabe verwendet werden. Alle Experimente wurden auf einem NVIDIA A100-Grafikprozessor durchgeführt.

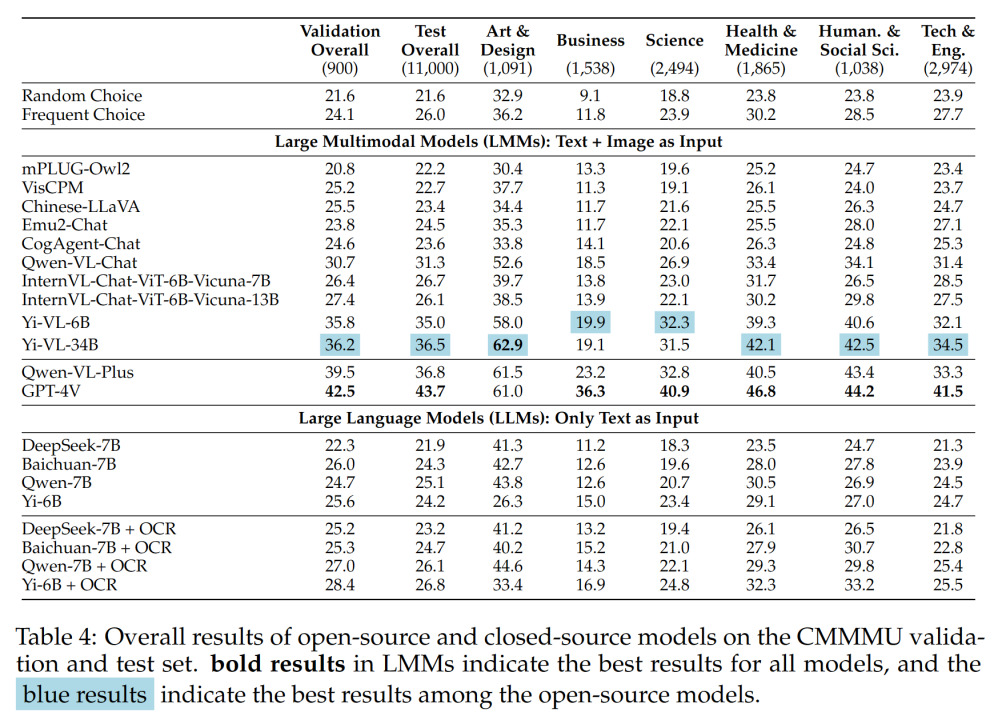

Tabelle 4 zeigt die Versuchsergebnisse:

Tabelle 4 zeigt die Versuchsergebnisse:

Einige wichtige Erkenntnisse sind:

– CMMMU ist anspruchsvoller als MMMU, und dies setzt voraus, dass MMMU bereits sehr herausfordernd ist.

Die Genauigkeit von GPT-4V im chinesischen Kontext beträgt nur 41,7 %, während die Genauigkeit im englischen Kontext 55,7 % beträgt. Dies zeigt, dass bestehende sprachübergreifende Generalisierungsmethoden selbst für hochmoderne Closed-Source-LMMs nicht gut genug sind.

- Im Vergleich zu MMMU ist die Lücke zwischen inländischen repräsentativen Open-Source-Modellen und GPT-4V relativ gering.

Der Unterschied zwischen Qwen-VL-Chat und GPT-4V auf MMMU beträgt 13,3 %, während der Unterschied zwischen BLIP2-FLAN-T5-XXL und GPT-4V auf MMMU 21,9 % beträgt. Überraschenderweise verringert Yi-VL-34B sogar die Lücke zwischen dem zweisprachigen Open-Source-LMM und GPT-4V auf CMMMU auf 7,5 %, was bedeutet, dass im chinesischen Umfeld das zweisprachige Open-Source-LMM GPT-4V entspricht ein vielversprechender Fortschritt in der Open-Source-Community.

- In der Open-Source-Community hat das Streben nach multimodaler künstlicher allgemeiner Intelligenz (AGI) durch chinesische Experten gerade erst begonnen. Das

-Team wies darauf hin, dass mit Ausnahme des kürzlich veröffentlichten Qwen-VL-Chat, Yi-VL-6B und Yi-VL-34B alle zweisprachigen LMMs aus der Open-Source-Community nur eine Genauigkeit erreichen können, die mit der von CMMMU vergleichbar ist Auswahl.

Analyse verschiedener Frageschwierigkeiten und Fragetypen

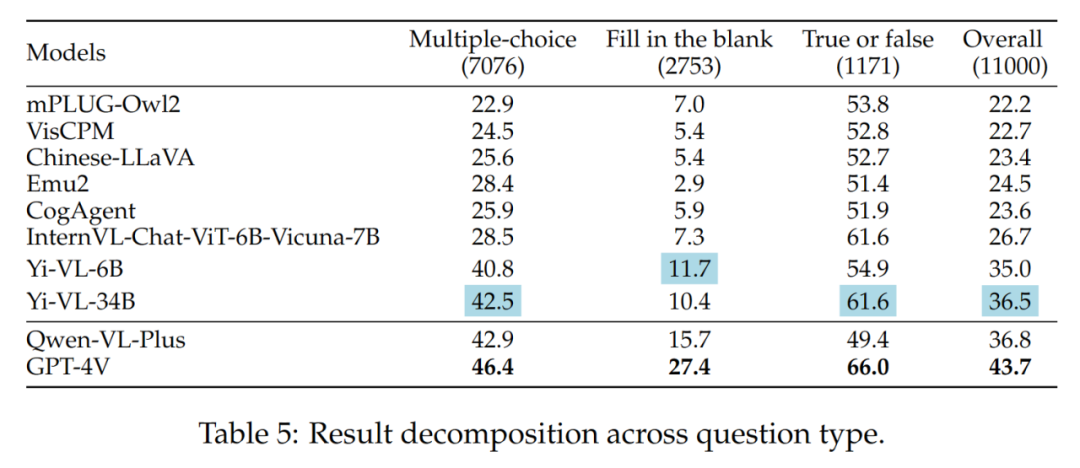

- Verschiedene Fragetypen

Die Unterschiede zwischen der Yi-VL-Serie, Qwen-VL-Plus und GPT-4V sind hauptsächlich auf Sie zurückzuführen unterscheiden sich in ihrer Fähigkeit, Multiple-Choice-Fragen zu beantworten. Die Ergebnisse der verschiedenen Fragetypen sind in Tabelle 5 dargestellt: VL-34B) und GPT-4V haben bei mittleren und schwierigen Problemen einen großen Abstand. Dies ist ein weiterer starker Beweis dafür, dass der Hauptunterschied zwischen Open-Source-LMMs und GPT-4V in der Fähigkeit liegt, unter komplexen Bedingungen zu rechnen und zu argumentieren.

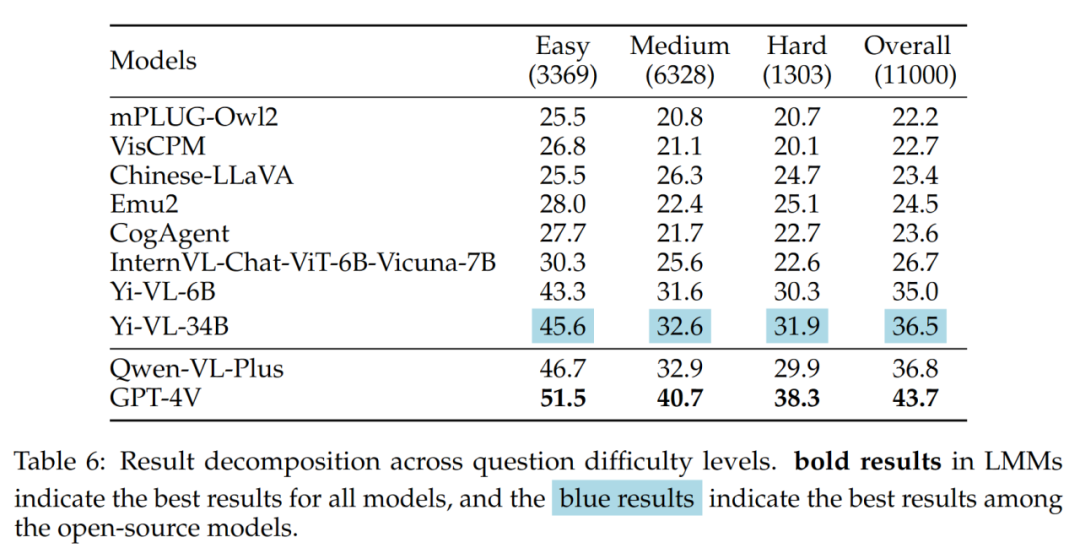

Die Ergebnisse verschiedener Frageschwierigkeiten sind in Tabelle 6 dargestellt:

Fehleranalyse

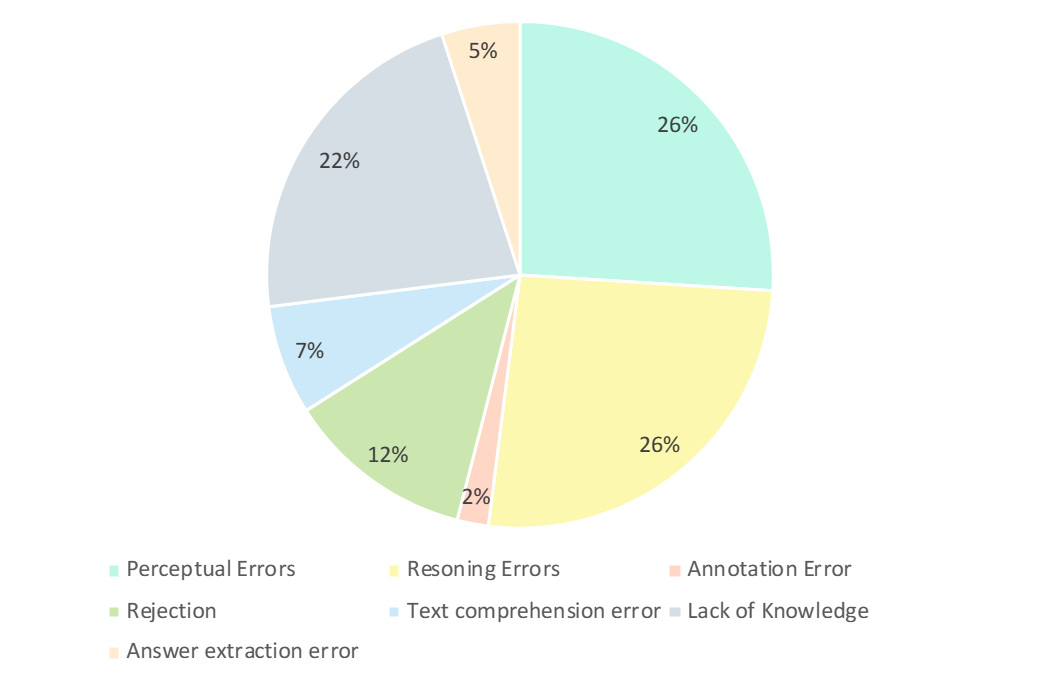

Die Forscher analysierten sorgfältig die falschen Antworten von GPT-4V. Wie in der folgenden Abbildung dargestellt, sind die Hauptfehlertypen Wahrnehmungsfehler, mangelndes Wissen, Argumentationsfehler, Antwortverweigerung und Anmerkungsfehler. Die Analyse dieser Fehlertypen ist der Schlüssel zum Verständnis der Fähigkeiten und Einschränkungen aktueller LMMs und kann auch als Leitfaden für zukünftige Verbesserungen von Design- und Trainingsmodellen dienen.

- Wahrnehmungsfehler (26 %):

- Wahrnehmungsfehler (26 %):

Wahrnehmungsfehler sind einer der Hauptgründe, warum GPT-4V falsche Beispiele erzeugt. Wenn das Modell einerseits das Bild nicht verstehen kann, führt dies zu einer Verzerrung der zugrunde liegenden Wahrnehmung des Bildes, was zu falschen Antworten führt. Wenn ein Modell andererseits auf Unklarheiten im domänenspezifischen Wissen, implizite Bedeutungen oder unklare Formeln stößt, weist es häufig domänenspezifische Wahrnehmungsfehler auf. In diesem Fall verlässt sich GPT-4V tendenziell mehr auf auf Textinformationen basierende Antworten (d. h. Fragen und Optionen) und räumt Textinformationen Vorrang vor visuellen Eingaben ein, was zu einer Verzerrung beim Verständnis multimodaler Daten führt.

- Inferenzfehler (26%):

Inferenzfehler sind ein weiterer wichtiger Faktor dafür, dass GPT-4V fehlerhafte Beispiele erzeugt. Selbst wenn Modelle die durch Bilder und Texte vermittelte Bedeutung richtig wahrnehmen, können beim Lösen von Problemen, die komplexe logische und mathematische Überlegungen erfordern, Fehler beim Denken auftreten. Typischerweise wird dieser Fehler durch die schwachen logischen und mathematischen Denkfähigkeiten des Modells verursacht.

- Mangelndes Wissen (22%): Mangelndes Fachwissen ist auch einer der Gründe für falsche Antworten auf GPT-4V. Da CMMMU ein Maßstab für die Bewertung von LMM-Experten-AGI ist, sind Kenntnisse auf Expertenebene in verschiedenen Disziplinen und Teilbereichen erforderlich. Daher ist die Einbringung von Expertenwissen in LMM auch eine der Richtungen, an denen gearbeitet werden kann.

- Antwort verweigern (12 %): Es kommt auch häufig vor, dass Models die Antwort verweigern. Durch die Analyse wiesen sie auf mehrere Gründe hin, warum das Modell sich weigerte, die Frage zu beantworten: (1) Das Modell konnte die Informationen aus dem Bild nicht wahrnehmen. (2) Es handelte sich um eine Frage, die religiöse Themen oder persönliche Informationen aus dem wirklichen Leben betraf, und das Modell würde dies aktiv vermeiden; (3) Wenn Fragen das Geschlecht und subjektive Faktoren betreffen, vermeidet das Modell die Bereitstellung direkter Antworten.

- Seine Fehler: Zu den verbleibenden Fehlern gehören Textverständnisfehler (7 %), Anmerkungsfehler (2 %) und Antwortextraktionsfehler (5 %). Diese Fehler werden durch eine Vielzahl von Faktoren verursacht, wie z. B. komplexe Strukturverfolgungsfunktionen, komplexes Verständnis der Textlogik, Einschränkungen bei der Antwortgenerierung, Fehler bei der Datenanmerkung und Probleme bei der Extraktion der Antwortübereinstimmung.

Fazit

Der CMMMU-Benchmark markiert einen bedeutenden Fortschritt in der Entwicklung der Advanced General Artificial Intelligence (AGI). CMMMU wurde entwickelt, um die neuesten großen multimodalen Modelle (LMMs) gründlich zu bewerten und grundlegende Wahrnehmungsfähigkeiten, komplexes logisches Denken und fundierte Fachkenntnisse in einem bestimmten Bereich zu testen. Diese Studie wies auf die Unterschiede hin, indem sie die Denkfähigkeit von LMM in zweisprachigen Kontexten auf Chinesisch und Englisch verglich. Diese detaillierte Bewertung ist entscheidend, um festzustellen, wie gut das Modell im Vergleich zu den Kompetenzen erfahrener Fachleute in den einzelnen Bereichen abschneidet.

Das obige ist der detaillierte Inhalt vonDas neueste Benchmark-CMMMU, das für den chinesischen LMM-Körper geeignet ist: Enthält mehr als 30 Unterteilungen und 12.000 Fragen auf Expertenebene. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1376

1376

52

52

Open Source! Jenseits von ZoeDepth! DepthFM: Schnelle und genaue monokulare Tiefenschätzung!

Apr 03, 2024 pm 12:04 PM

Open Source! Jenseits von ZoeDepth! DepthFM: Schnelle und genaue monokulare Tiefenschätzung!

Apr 03, 2024 pm 12:04 PM

0.Was bewirkt dieser Artikel? Wir schlagen DepthFM vor: ein vielseitiges und schnelles generatives monokulares Tiefenschätzungsmodell auf dem neuesten Stand der Technik. Zusätzlich zu herkömmlichen Tiefenschätzungsaufgaben demonstriert DepthFM auch hochmoderne Fähigkeiten bei nachgelagerten Aufgaben wie dem Tiefen-Inpainting. DepthFM ist effizient und kann Tiefenkarten innerhalb weniger Inferenzschritte synthetisieren. Lassen Sie uns diese Arbeit gemeinsam lesen ~ 1. Titel der Papierinformationen: DepthFM: FastMonocularDepthEstimationwithFlowMatching Autor: MingGui, JohannesS.Fischer, UlrichPrestel, PingchuanMa, Dmytr

Das weltweit leistungsstärkste Open-Source-MoE-Modell ist da, mit chinesischen Fähigkeiten, die mit GPT-4 vergleichbar sind, und der Preis beträgt nur fast ein Prozent von GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Das weltweit leistungsstärkste Open-Source-MoE-Modell ist da, mit chinesischen Fähigkeiten, die mit GPT-4 vergleichbar sind, und der Preis beträgt nur fast ein Prozent von GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Stellen Sie sich ein Modell der künstlichen Intelligenz vor, das nicht nur die Fähigkeit besitzt, die traditionelle Datenverarbeitung zu übertreffen, sondern auch eine effizientere Leistung zu geringeren Kosten erzielt. Dies ist keine Science-Fiction, DeepSeek-V2[1], das weltweit leistungsstärkste Open-Source-MoE-Modell, ist da. DeepSeek-V2 ist ein leistungsstarkes MoE-Sprachmodell (Mix of Experts) mit den Merkmalen eines wirtschaftlichen Trainings und einer effizienten Inferenz. Es besteht aus 236B Parametern, von denen 21B zur Aktivierung jedes Markers verwendet werden. Im Vergleich zu DeepSeek67B bietet DeepSeek-V2 eine stärkere Leistung, spart gleichzeitig 42,5 % der Trainingskosten, reduziert den KV-Cache um 93,3 % und erhöht den maximalen Generierungsdurchsatz auf das 5,76-fache. DeepSeek ist ein Unternehmen, das sich mit allgemeiner künstlicher Intelligenz beschäftigt

KAN, das MLP ersetzt, wurde durch Open-Source-Projekte auf Faltung erweitert

Jun 01, 2024 pm 10:03 PM

KAN, das MLP ersetzt, wurde durch Open-Source-Projekte auf Faltung erweitert

Jun 01, 2024 pm 10:03 PM

Anfang dieses Monats schlugen Forscher des MIT und anderer Institutionen eine vielversprechende Alternative zu MLP vor – KAN. KAN übertrifft MLP in Bezug auf Genauigkeit und Interpretierbarkeit. Und es kann MLP, das mit einer größeren Anzahl von Parametern ausgeführt wird, mit einer sehr kleinen Anzahl von Parametern übertreffen. Beispielsweise gaben die Autoren an, dass sie KAN nutzten, um die Ergebnisse von DeepMind mit einem kleineren Netzwerk und einem höheren Automatisierungsgrad zu reproduzieren. Konkret verfügt DeepMinds MLP über etwa 300.000 Parameter, während KAN nur etwa 200 Parameter hat. KAN hat eine starke mathematische Grundlage wie MLP und basiert auf dem universellen Approximationssatz, während KAN auf dem Kolmogorov-Arnold-Darstellungssatz basiert. Wie in der folgenden Abbildung gezeigt, hat KAN

Hallo, elektrischer Atlas! Der Boston Dynamics-Roboter erwacht wieder zum Leben, seltsame 180-Grad-Bewegungen machen Musk Angst

Apr 18, 2024 pm 07:58 PM

Hallo, elektrischer Atlas! Der Boston Dynamics-Roboter erwacht wieder zum Leben, seltsame 180-Grad-Bewegungen machen Musk Angst

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas tritt offiziell in die Ära der Elektroroboter ein! Gestern hat sich der hydraulische Atlas einfach „unter Tränen“ von der Bühne der Geschichte zurückgezogen. Heute gab Boston Dynamics bekannt, dass der elektrische Atlas im Einsatz ist. Es scheint, dass Boston Dynamics im Bereich kommerzieller humanoider Roboter entschlossen ist, mit Tesla zu konkurrieren. Nach der Veröffentlichung des neuen Videos wurde es innerhalb von nur zehn Stunden bereits von mehr als einer Million Menschen angesehen. Die alten Leute gehen und neue Rollen entstehen. Das ist eine historische Notwendigkeit. Es besteht kein Zweifel, dass dieses Jahr das explosive Jahr der humanoiden Roboter ist. Netizens kommentierten: Die Weiterentwicklung der Roboter hat dazu geführt, dass die diesjährige Eröffnungsfeier wie Menschen aussieht, und der Freiheitsgrad ist weitaus größer als der von Menschen. Aber ist das wirklich kein Horrorfilm? Zu Beginn des Videos liegt Atlas ruhig auf dem Boden, scheinbar auf dem Rücken. Was folgt, ist atemberaubend

KI untergräbt die mathematische Forschung! Der Gewinner der Fields-Medaille und der chinesisch-amerikanische Mathematiker führten 11 hochrangige Arbeiten an | Gefällt mir bei Terence Tao

Apr 09, 2024 am 11:52 AM

KI untergräbt die mathematische Forschung! Der Gewinner der Fields-Medaille und der chinesisch-amerikanische Mathematiker führten 11 hochrangige Arbeiten an | Gefällt mir bei Terence Tao

Apr 09, 2024 am 11:52 AM

KI verändert tatsächlich die Mathematik. Vor kurzem hat Tao Zhexuan, der diesem Thema große Aufmerksamkeit gewidmet hat, die neueste Ausgabe des „Bulletin of the American Mathematical Society“ (Bulletin der American Mathematical Society) weitergeleitet. Zum Thema „Werden Maschinen die Mathematik verändern?“ äußerten viele Mathematiker ihre Meinung. Der gesamte Prozess war voller Funken, knallhart und aufregend. Der Autor verfügt über eine starke Besetzung, darunter der Fields-Medaillengewinner Akshay Venkatesh, der chinesische Mathematiker Zheng Lejun, der NYU-Informatiker Ernest Davis und viele andere bekannte Wissenschaftler der Branche. Die Welt der KI hat sich dramatisch verändert. Viele dieser Artikel wurden vor einem Jahr eingereicht.

Langsame Internetgeschwindigkeiten für Mobilfunkdaten auf dem iPhone: Korrekturen

May 03, 2024 pm 09:01 PM

Langsame Internetgeschwindigkeiten für Mobilfunkdaten auf dem iPhone: Korrekturen

May 03, 2024 pm 09:01 PM

Stehen Sie vor einer Verzögerung oder einer langsamen mobilen Datenverbindung auf dem iPhone? Normalerweise hängt die Stärke des Mobilfunk-Internets auf Ihrem Telefon von mehreren Faktoren ab, wie z. B. der Region, dem Mobilfunknetztyp, dem Roaming-Typ usw. Es gibt einige Dinge, die Sie tun können, um eine schnellere und zuverlässigere Mobilfunk-Internetverbindung zu erhalten. Fix 1 – Neustart des iPhone erzwingen Manchmal werden durch einen erzwungenen Neustart Ihres Geräts viele Dinge zurückgesetzt, einschließlich der Mobilfunkverbindung. Schritt 1 – Drücken Sie einfach einmal die Lauter-Taste und lassen Sie sie los. Drücken Sie anschließend die Leiser-Taste und lassen Sie sie wieder los. Schritt 2 – Der nächste Teil des Prozesses besteht darin, die Taste auf der rechten Seite gedrückt zu halten. Lassen Sie das iPhone den Neustart abschließen. Aktivieren Sie Mobilfunkdaten und überprüfen Sie die Netzwerkgeschwindigkeit. Überprüfen Sie es erneut. Fix 2 – Datenmodus ändern 5G bietet zwar bessere Netzwerkgeschwindigkeiten, funktioniert jedoch besser, wenn das Signal schwächer ist

Die Vitalität der Superintelligenz erwacht! Aber mit der Einführung der sich selbst aktualisierenden KI müssen sich Mütter keine Sorgen mehr über Datenengpässe machen

Apr 29, 2024 pm 06:55 PM

Die Vitalität der Superintelligenz erwacht! Aber mit der Einführung der sich selbst aktualisierenden KI müssen sich Mütter keine Sorgen mehr über Datenengpässe machen

Apr 29, 2024 pm 06:55 PM

Ich weine zu Tode. Die Daten im Internet reichen überhaupt nicht aus. Das Trainingsmodell sieht aus wie „Die Tribute von Panem“, und KI-Forscher auf der ganzen Welt machen sich Gedanken darüber, wie sie diese datenhungrigen Esser ernähren sollen. Dieses Problem tritt insbesondere bei multimodalen Aufgaben auf. Zu einer Zeit, als sie ratlos waren, nutzte ein Start-up-Team der Abteilung der Renmin-Universität von China sein eigenes neues Modell, um als erstes in China einen „modellgenerierten Datenfeed selbst“ in die Realität umzusetzen. Darüber hinaus handelt es sich um einen zweigleisigen Ansatz auf der Verständnisseite und der Generierungsseite. Beide Seiten können hochwertige, multimodale neue Daten generieren und Datenrückmeldungen an das Modell selbst liefern. Was ist ein Modell? Awaker 1.0, ein großes multimodales Modell, das gerade im Zhongguancun-Forum erschienen ist. Wer ist das Team? Sophon-Motor. Gegründet von Gao Yizhao, einem Doktoranden an der Hillhouse School of Artificial Intelligence der Renmin University.

Die U.S. Air Force präsentiert ihren ersten KI-Kampfjet mit großem Aufsehen! Der Minister führte die Testfahrt persönlich durch, ohne in den gesamten Prozess einzugreifen, und 100.000 Codezeilen wurden 21 Mal getestet.

May 07, 2024 pm 05:00 PM

Die U.S. Air Force präsentiert ihren ersten KI-Kampfjet mit großem Aufsehen! Der Minister führte die Testfahrt persönlich durch, ohne in den gesamten Prozess einzugreifen, und 100.000 Codezeilen wurden 21 Mal getestet.

May 07, 2024 pm 05:00 PM

Kürzlich wurde die Militärwelt von der Nachricht überwältigt: US-Militärkampfflugzeuge können jetzt mithilfe von KI vollautomatische Luftkämpfe absolvieren. Ja, erst kürzlich wurde der KI-Kampfjet des US-Militärs zum ersten Mal der Öffentlichkeit zugänglich gemacht und sein Geheimnis gelüftet. Der vollständige Name dieses Jägers lautet „Variable Stability Simulator Test Aircraft“ (VISTA). Er wurde vom Minister der US-Luftwaffe persönlich geflogen, um einen Eins-gegen-eins-Luftkampf zu simulieren. Am 2. Mai startete US-Luftwaffenminister Frank Kendall mit einer X-62AVISTA auf der Edwards Air Force Base. Beachten Sie, dass während des einstündigen Fluges alle Flugaktionen autonom von der KI durchgeführt wurden! Kendall sagte: „In den letzten Jahrzehnten haben wir über das unbegrenzte Potenzial des autonomen Luft-Luft-Kampfes nachgedacht, aber es schien immer unerreichbar.“ Nun jedoch,