Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

„Rettung' offener heterogener Szenarien |. HEAL: das neueste skalierbare kollaborative Sensor-Framework

„Rettung' offener heterogener Szenarien |. HEAL: das neueste skalierbare kollaborative Sensor-Framework

„Rettung' offener heterogener Szenarien |. HEAL: das neueste skalierbare kollaborative Sensor-Framework

Kollaborative Sensortechnologie ist von großer Bedeutung für die Lösung des Wahrnehmungsproblems autonomer Fahrzeuge. Die bestehende Forschung ignoriert jedoch häufig die mögliche Heterogenität zwischen Agenten, also die Vielfalt von Sensoren und Wahrnehmungsmodellen. In praktischen Anwendungen kann es erhebliche Unterschiede in den Modalitäten und Modellen zwischen Agenten geben, was zur Entstehung von Domänenunterschieden führt und die kollaborative Wahrnehmung erschwert. Daher muss die zukünftige Forschung darüber nachdenken, wie die Heterogenität zwischen Agenten effektiv gehandhabt werden kann, um eine effektivere kollaborative Wahrnehmung zu erreichen. Dies erfordert die Entwicklung neuer Methoden und Algorithmen, um die Unterschiede zwischen verschiedenen Agenten zu berücksichtigen und sicherzustellen, dass sie zusammenarbeiten können, um ein effizienteres autonomes Fahrsystem zu erreichen.

Um diese praktische Herausforderung zu lösen, definiert der neueste Forschungsartikel von ICLR 2024 „An Extensible Framework for Open Heterogeneous Collaborative Perception“ das Problem der Open Heterogeneous Collaborative Perception: Wie können neue heterogene Agenten integriert werden, die ständig neu entstehen? Sensorsystem bei gleichzeitig hoher Sensorleistung und niedrigen Verbindungskosten? Forscher der Shanghai Jiao Tong University, der University of Southern California und des Shanghai Artificial Intelligence Laboratory haben in diesem Artikel HEAL (HEterogeneousALliance) vorgeschlagen: ein skalierbares Framework für die Zusammenarbeit heterogener Agenten, das effektiv ist und die beiden Hauptprobleme löst offener heterogener kollaborativer Wahrnehmungsprobleme.

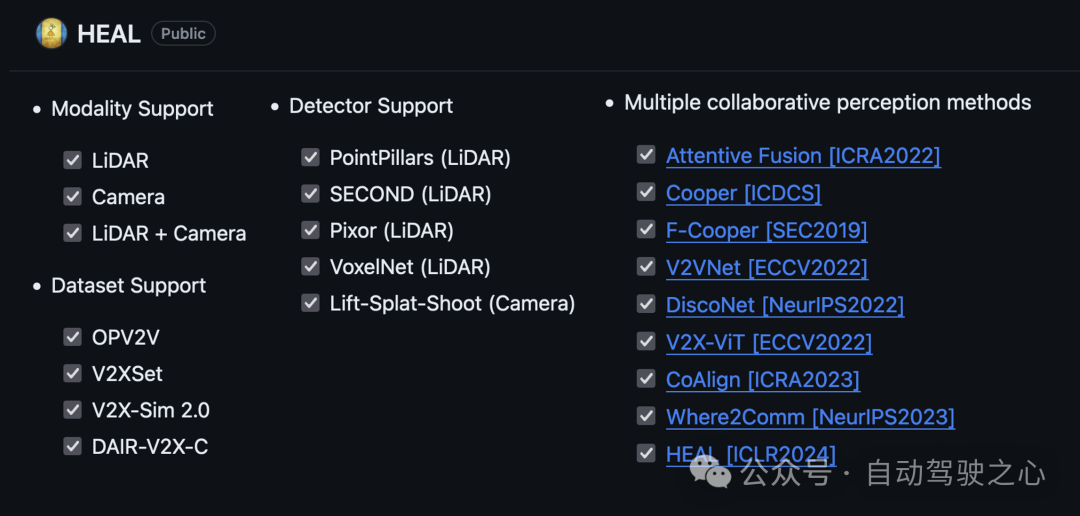

Sie haben ein Code-Framework erstellt, das mehrere kollaborative Sensordatensätze und mehrere kollaborative Sensoralgorithmen enthält und Multimodalität unterstützt, das jetzt vollständig Open Source ist. Der Autor ist der Ansicht, dass dies derzeit das umfassendste Code-Framework für die kollaborative Sensorik ist und voraussichtlich mehr Menschen den Einstieg in das multimodale und heterogene Forschungsfeld der kollaborativen Sensorik erleichtern wird.

- Papier-Link: https://arxiv.org/abs/2401.13964

- Code-Link: https://github.com/yifanlu0227/HEAL

Forschungshintergrund und Bedeutung

In den letzten Jahren , Die autonome Fahrtechnologie hat in Wissenschaft und Industrie große Aufmerksamkeit erregt. Die tatsächlichen Straßenbedingungen sind jedoch komplex und veränderlich, und die Sensoren eines einzelnen Fahrzeugs können von anderen Fahrzeugen blockiert werden, was die Wahrnehmungsfähigkeiten des autonomen Fahrsystems vor Herausforderungen stellt. Um diese Probleme zu lösen, wird die kollaborative Erfassung zwischen mehreren Agenten zu einer Lösung. Mit der Weiterentwicklung der Kommunikationstechnologie können Agenten sensorische Informationen austauschen und ihre eigenen Sensordaten mit Informationen anderer Agenten kombinieren, um ihre Wahrnehmung der Umgebung zu verbessern. Durch die Zusammenarbeit ist jeder Agent in der Lage, Informationen zu erhalten, die über sein eigenes Sichtfeld hinausgehen, was zur Verbesserung der Wahrnehmungs- und Entscheidungsfähigkeiten beiträgt.

Abbildung 1. Das „Geistersonden“-Problem, das durch Sichtlinienverdeckung und eingeschränkte Fahrradwahrnehmung verursacht wird

Im aktuellen Forschungsbereich basieren die meisten Arbeiten auf einer möglicherweise zu stark vereinfachten Annahme: Alle Agenten müssen die gleiche Struktur haben; Das heißt, ihre Wahrnehmungssysteme verwenden alle dieselben Sensoren und verwenden dasselbe Erkennungsmodell. In der realen Welt können die Muster und Modelle verschiedener Agenten jedoch unterschiedlich sein und es können weiterhin neue Muster und Modelle entstehen. Aufgrund der rasanten Entwicklung von Sensortechnologie und Algorithmen ist es unrealistisch, zunächst alle Arten kollaborativer Agenten (einschließlich Modi und Modelle) zu identifizieren. Wenn ein heterogener Agent, der noch nie im Trainingssatz aufgetreten ist, der Zusammenarbeit beitreten möchte, wird er unweigerlich auf Domänenunterschiede mit vorhandenen Agenten stoßen. Dieser Unterschied schränkt die Fähigkeit ein, eine Merkmalsfusion mit vorhandenen Agenten durchzuführen, wodurch die Skalierbarkeit der kollaborativen Erfassung erheblich eingeschränkt wird.

Daher stellt sich das Problem der offenen heterogenen kooperativen Erfassung: Wie können die neuen Agententypen zum bestehenden kooperativen Erfassungssystem hinzugefügt und gleichzeitig eine hohe Erfassungsleistung und niedrige Integrationskosten sichergestellt werden?

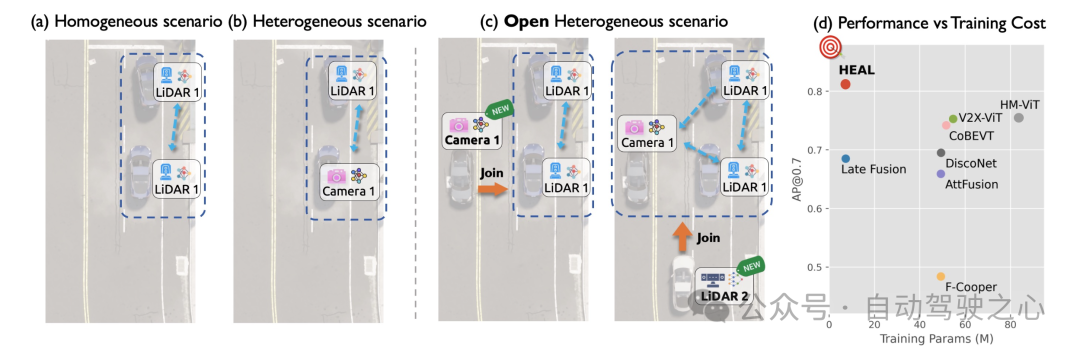

Abbildung 2. (a) Homogene kollaborative Wahrnehmung (b) Heterogene kollaborative Wahrnehmung (c) Offene heterogene kollaborative Wahrnehmung unter Berücksichtigung der Hinzufügung neuer heterogener Agenten (d) HEAL erzielt bei geringstem Schulungsaufwand die beste kollaborative Wahrnehmungsleistung

Um dieses Problem zu lösen, ist die Postfusion eine praktikable Lösung. Durch die Zusammenführung der Wahrnehmungsausgabe jedes Agenten (z. B. eines 3D-Begrenzungsrahmens) umgeht die Postfusion die Heterogenität zwischen neuen und vorhandenen Agenten, und das Training muss nur für eine einzelne Agentenklasse erfolgen. Allerdings ist die Leistung der Post-Fusion nicht ideal und erweist sich als besonders anfällig für Störfaktoren wie Positionierungsrauschen und Kommunikationsverzögerungen. Ein weiterer möglicher Ansatz ist ein vollständig kollektives Training, das alle Agententypen in einer Zusammenarbeit für ein gemeinsames Training zusammenfasst, um Domänenunterschiede zu überwinden. Dieser Ansatz erfordert jedoch jedes Mal eine Neuschulung aller Modelle, wenn ein neuer Agententyp eingeführt wird. Mit dem kontinuierlichen Aufkommen neuer heterogener Agenten steigen die Schulungskosten stark an. HEAL schlägt ein neues offenes heterogenes Kollaborationsframework vor, das gleichzeitig die hohe Leistung einer vollständig kollektiven Schulung und die niedrigen Schulungskosten einer Postfusion bietet.

Problemdefinition

Offenes heterogenes Kollaborationswahrnehmungsproblem Stellen Sie sich das folgende Szenario vor: Hinzufügen heterogener Agentenkategorien mit bisher nicht verfügbaren Modalitäten oder Modellen zum bestehenden Kollaborationssystem. Ohne Beschränkung der Allgemeinheit gehen wir davon aus, dass die Szene zunächst aus homogenen Agenten besteht, die mit demselben Sensortyp ausgestattet sind, dasselbe Erkennungsmodell einsetzen und alle über die Fähigkeit verfügen, miteinander zu kommunizieren. Diese isomorphen Agenten bilden ein bestehendes kollaboratives System. Anschließend schließen sich heterogene Agenten mit Modalitäten oder Wahrnehmungsmodellen, die noch nie in der Szene aufgetaucht sind, dem kollaborativen System an. Diese dynamische Natur ist ein charakteristisches Merkmal des Einsatzes kollaborativer Sensorik in der realen Welt: Agentenklassen sind zu Beginn nicht vollständig festgelegt und die Anzahl der Typen kann mit der Zeit zunehmen. Es unterscheidet sich auch erheblich von früheren heterogenen kollaborativen Erkennungsproblemen, bei denen die heterogenen Kategorien im Voraus festgelegt und festgelegt wurden.

Einführung in die Methode

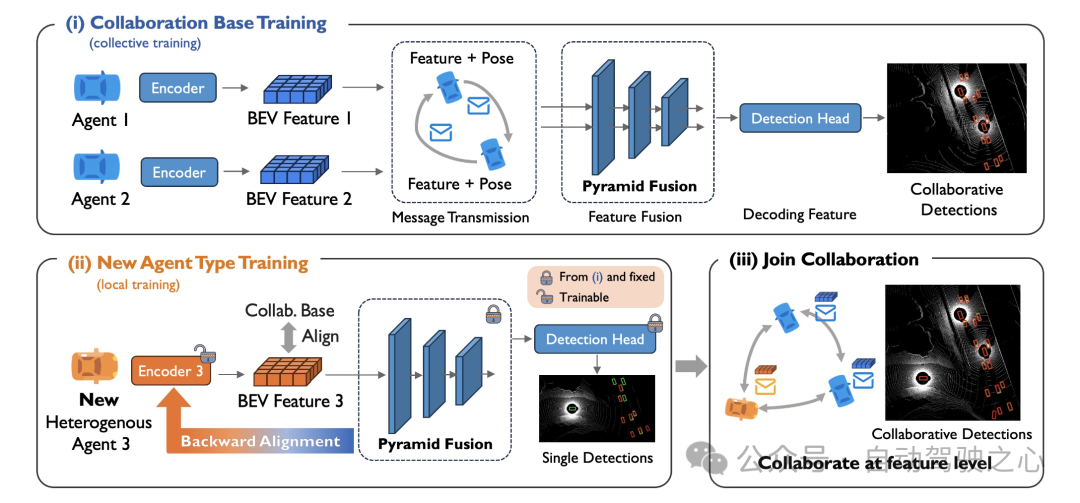

Das in diesem Artikel vorgeschlagene offene heterogene Kooperationsbewusstseins-Framework HEAL (HEterogeneous ALLiance) entwirft eine zweistufige Methode, um der Zusammenarbeit neue heterogene Agenten hinzuzufügen, um eine wachsende heterogene Basisklasse zu erreichen Schulung, die es dem anfänglichen Agenten ermöglicht, ein Feature-Fusion-Kollaborationsnetzwerk zu trainieren und einen einheitlichen Feature-Raum zu schaffen; ii) Training neuer Agenten, das die Funktionen des neuen Agenten an den zuvor eingerichteten einheitlichen Feature-Bereich anpasst, wodurch neue Agenten mit vorhandenen Agenten zusammenarbeiten können; auf der Funktionsebene.

Für jeden neuen Agententyp, der der Zusammenarbeit beitritt, ist nur die zweite Schulungsphase erforderlich. Es ist erwähnenswert, dass die zweite Schulungsphase unabhängig vom Eigentümer des Agenten durchgeführt werden kann und keine gemeinsame Schulung mit bestehenden Agenten erfordert. Dies ermöglicht das Hinzufügen neuer Agenten mit geringeren Schulungskosten und schützt gleichzeitig die Modelldetails der neuen Agenten vor der Offenlegung.

Abbildung 3. Das Gesamtgerüst von HEAL

Phase eins: kollaboratives Basisklassentraining

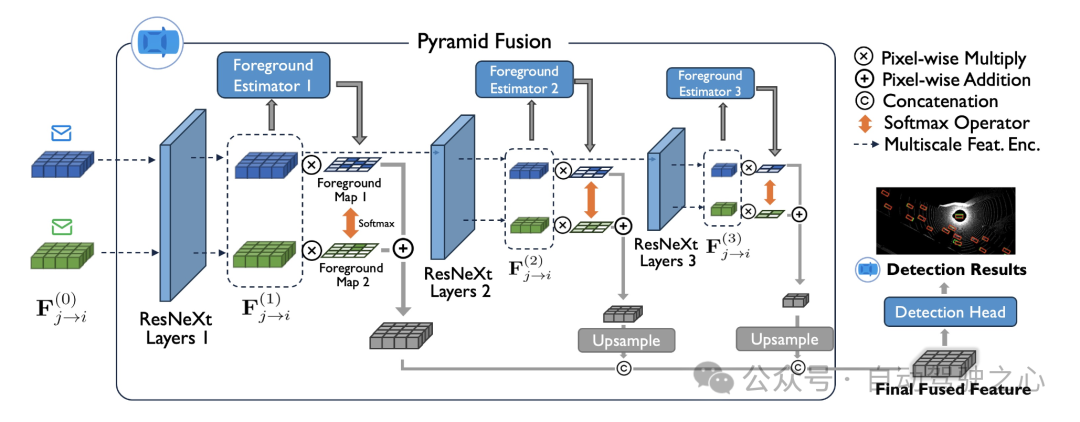

Wir verwenden die isomorphen Agenten, die zu Beginn der Szene vorhanden sind, als kollaborative Basisklassen und trainieren eine Feature-Fusion- basiertes kollaboratives Sensornetzwerk. Wir schlagen ein neuartiges Pyramidenfusionsnetzwerk vor, um die Merkmale mehrerer Agenten zu extrahieren und zu verschmelzen. Insbesondere lassen wir die vom Encoder jedes isomorphen Agenten codierten BEV-Merkmale mehrere Schichten von ResNeXt-Netzwerken unterschiedlicher Größenordnung durchlaufen, um sie grobkörnig zu extrahieren und feinkörnige Funktionsinformationen. Auf Feature-Karten unterschiedlicher Maßstäbe wenden wir ein Vordergrund-Prädiktornetzwerk an, um die Wahrscheinlichkeit abzuschätzen, dass an jeder Feature-Position des BEV ein Vordergrund vorhanden ist, beispielsweise ein Fahrzeug. Über alle Mitarbeiter hinweg wird die Wahrscheinlichkeitskarte des Vordergrunds als Gewichtsverteilung aus einer pixelweise gewichteten Fusion der Feature-Maps normalisiert. Nachdem wir die fusionierten Feature-Maps in verschiedenen Maßstäben erhalten haben, verwenden wir eine Reihe von Upsampling-Netzwerken, um sie in die gleiche Feature-Map-Größe zu konvertieren und die endgültige fusionierte Feature-Map zu erhalten.

Abbildung 4. Pyramid Fusion Network

Die fusionierte Feature-Map durchläuft einen Erkennungskopf und wird in das endgültige Ergebnis der kollaborativen Erkennung umgewandelt. Sowohl die kollaborativen Erkennungsergebnisse als auch die Wahrscheinlichkeitskarte des Vordergrunds werden durch Ground-Truth überwacht. Nach dem Training speichern die Parameter des Kollaborationsnetzwerks (Pyramidenfusionsnetzwerk) die relevanten Merkmalsinformationen der Kollaborationsbasisklasse und erstellen einen gemeinsamen Merkmalsraum für die anschließende Ausrichtung neuer heterogener Agenten.

Phase 2: Schulung neuer Agenten

Wir erwägen die Hinzufügung eines neuen heterogenen Agententyps. Wir schlagen eine neuartige Methode zur Rückwärtsausrichtung vor. Die Kernidee besteht darin, das Pyramidenfusionsnetzwerk und den Erkennungskopf der vorherigen Stufe als Detektor-Backend des neuen Agenten zu verwenden und nur die Parameter zu aktualisieren, die sich auf den Front-End-Encoder beziehen.

Es ist erwähnenswert, dass wir Einzelagentenschulungen für einzelne Agenten neuer heterogener Kategorien durchführen und keine Zusammenarbeit zwischen Agenten beinhalten. Daher ist die Eingabe des Pyramidenfusionsnetzwerks eine einzelne Feature-Map anstelle von Multi-Agent-Feature-Maps in einer Stufe. Während das vorab trainierte Pyramidenfusionsmodul und der Erkennungskopf als Backend etabliert und fixiert werden, entwickelt sich der Trainingsprozess weiter, um den Frontend-Encoder an die Parameter des Backends anzupassen, sodass die vom neuen Agenten codierten Features mit dem einheitlichen Feature-Raum konsistent sind. Da die Funktionen auf die Funktionen bestehender Agenten abgestimmt sind, können sie eine leistungsstarke Zusammenarbeit auf Funktionsebene erreichen.

Die Rückwärtsausrichtung bietet auch einen einzigartigen Vorteil: Das Training wird nur für einen neuen Einzelagenten durchgeführt. Dadurch werden die Schulungskosten und die Datenerfassungskosten der räumlich-zeitlichen Synchronisierung jedes Mal, wenn ein neuer Agent hinzugefügt wird, erheblich reduziert. Darüber hinaus wird verhindert, dass die Modelldetails des neuen Agenten anderen zugänglich gemacht werden, und der Besitzer des neuen Agenten kann das Modell mithilfe seiner eigenen Sensordaten trainieren. Dies wird viele Bedenken ausräumen, die Automobilunternehmen beim Einsatz kollaborativer Fahrzeug-zu-Fahrzeug-Sensortechnologie (V2V) haben könnten.

Experimentelle Ergebnisse

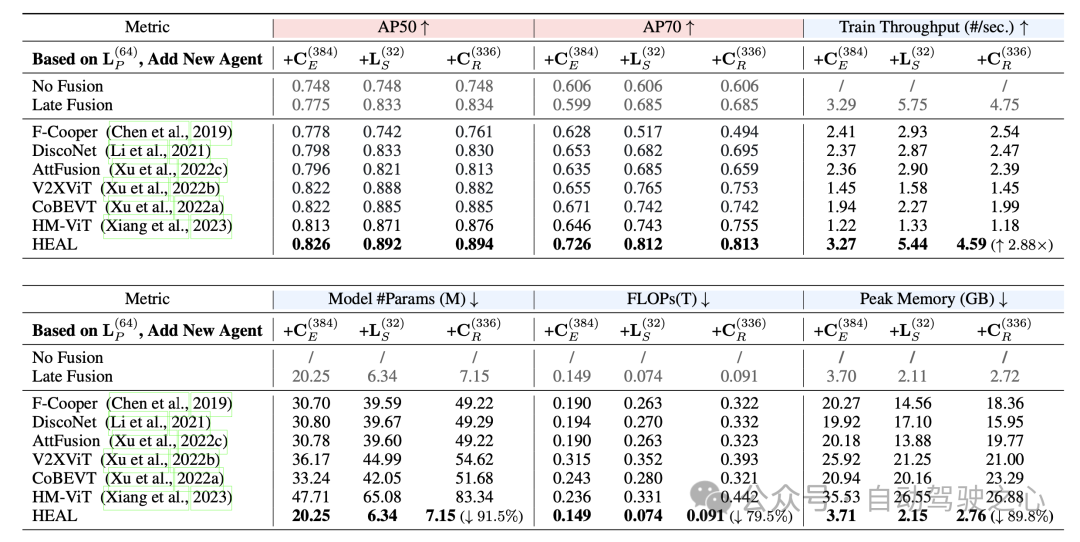

Basierend auf dem OPV2V-Datensatz schlägt dieses Papier einen heterogeneren OPV2V-H-Datensatz vor, der die 16-zeiligen und 32-zeiligen Lidar-Daten jedes Fahrzeugs sowie 4-Tiefen-Kameradaten ergänzt. Experimentelle Ergebnisse des OPV2V-H-Datensatzes und des realen Datensatzes DAIR-V2X zeigen, dass HEAL eine Reihe von Trainingskosten (Trainingsparameter, FLOPs, Trainingszeit usw.) für die Zusammenarbeit heterogener Agenten erheblich reduziert und diese auch aufrechterhält Extrem hohe kollaborative Erkennungsleistung.

Abbildung 5. HEAL bietet sowohl eine hohe Leistung als auch niedrige Schulungskosten.

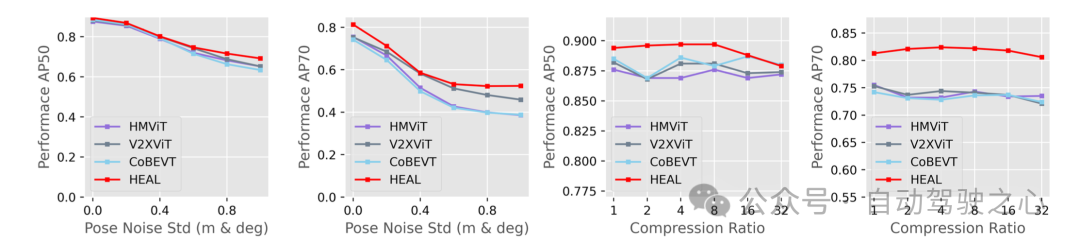

Beim Vorhandensein von Positionierungsrauschen und Merkmalskomprimierung behält HEAL immer noch die beste Erkennungsleistung bei, was zeigt, dass HEAL bei realitätsnäheren Einstellungen derzeit am besten ist effektiver kollaborativer Erfassungsalgorithmus.

Das obige ist der detaillierte Inhalt von„Rettung' offener heterogener Szenarien |. HEAL: das neueste skalierbare kollaborative Sensor-Framework. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

CUDAs universelle Matrixmultiplikation: vom Einstieg bis zur Kompetenz!

Mar 25, 2024 pm 12:30 PM

CUDAs universelle Matrixmultiplikation: vom Einstieg bis zur Kompetenz!

Mar 25, 2024 pm 12:30 PM

Die allgemeine Matrixmultiplikation (GEMM) ist ein wesentlicher Bestandteil vieler Anwendungen und Algorithmen und außerdem einer der wichtigen Indikatoren zur Bewertung der Leistung der Computerhardware. Eingehende Forschung und Optimierung der Implementierung von GEMM können uns helfen, Hochleistungsrechnen und die Beziehung zwischen Software- und Hardwaresystemen besser zu verstehen. In der Informatik kann eine effektive Optimierung von GEMM die Rechengeschwindigkeit erhöhen und Ressourcen einsparen, was für die Verbesserung der Gesamtleistung eines Computersystems von entscheidender Bedeutung ist. Ein tiefgreifendes Verständnis des Funktionsprinzips und der Optimierungsmethode von GEMM wird uns helfen, das Potenzial moderner Computerhardware besser zu nutzen und effizientere Lösungen für verschiedene komplexe Computeraufgaben bereitzustellen. Durch Optimierung der Leistung von GEMM

Das intelligente Fahrsystem Qiankun ADS3.0 von Huawei wird im August auf den Markt kommen und erstmals auf dem Xiangjie S9 eingeführt

Jul 30, 2024 pm 02:17 PM

Das intelligente Fahrsystem Qiankun ADS3.0 von Huawei wird im August auf den Markt kommen und erstmals auf dem Xiangjie S9 eingeführt

Jul 30, 2024 pm 02:17 PM

Am 29. Juli nahm Yu Chengdong, Huawei-Geschäftsführer, Vorsitzender von Terminal BG und Vorsitzender von Smart Car Solutions BU, an der Übergabezeremonie des 400.000sten Neuwagens von AITO Wenjie teil, hielt eine Rede und kündigte an, dass die Modelle der Wenjie-Serie dies tun werden Dieses Jahr auf den Markt kommen Im August wurde die Huawei Qiankun ADS 3.0-Version auf den Markt gebracht und es ist geplant, die Upgrades sukzessive von August bis September voranzutreiben. Das Xiangjie S9, das am 6. August auf den Markt kommt, wird erstmals mit dem intelligenten Fahrsystem ADS3.0 von Huawei ausgestattet sein. Mit Hilfe von Lidar wird Huawei Qiankun ADS3.0 seine intelligenten Fahrfähigkeiten erheblich verbessern, über integrierte End-to-End-Funktionen verfügen und eine neue End-to-End-Architektur von GOD (allgemeine Hinderniserkennung)/PDP (prädiktiv) einführen Entscheidungsfindung und Kontrolle), Bereitstellung der NCA-Funktion für intelligentes Fahren von Parkplatz zu Parkplatz und Aktualisierung von CAS3.0

Ein tiefer Einblick in Modelle, Daten und Frameworks: eine ausführliche 54-seitige Übersicht über effiziente große Sprachmodelle

Jan 14, 2024 pm 07:48 PM

Ein tiefer Einblick in Modelle, Daten und Frameworks: eine ausführliche 54-seitige Übersicht über effiziente große Sprachmodelle

Jan 14, 2024 pm 07:48 PM

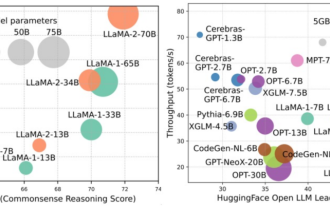

Large-Scale Language Models (LLMs) haben überzeugende Fähigkeiten bei vielen wichtigen Aufgaben bewiesen, darunter das Verständnis natürlicher Sprache, die Sprachgenerierung und das komplexe Denken, und hatten tiefgreifende Auswirkungen auf die Gesellschaft. Diese herausragenden Fähigkeiten erfordern jedoch erhebliche Schulungsressourcen (im linken Bild dargestellt) und lange Inferenzzeiten (im rechten Bild dargestellt). Daher müssen Forscher wirksame technische Mittel entwickeln, um ihre Effizienzprobleme zu lösen. Darüber hinaus wurden, wie auf der rechten Seite der Abbildung zu sehen ist, einige effiziente LLMs (LanguageModels) wie Mistral-7B erfolgreich beim Entwurf und Einsatz von LLMs eingesetzt. Diese effizienten LLMs können den Inferenzspeicher erheblich reduzieren und gleichzeitig eine ähnliche Genauigkeit wie LLaMA1-33B beibehalten

Welche Version des Apple 16-Systems ist die beste?

Mar 08, 2024 pm 05:16 PM

Welche Version des Apple 16-Systems ist die beste?

Mar 08, 2024 pm 05:16 PM

Die beste Version des Apple 16-Systems ist iOS16.1.4. Die beste Version des iOS16-Systems kann von Person zu Person unterschiedlich sein. Die Ergänzungen und Verbesserungen im täglichen Nutzungserlebnis wurden auch von vielen Benutzern gelobt. Welche Version des Apple 16-Systems ist die beste? Antwort: iOS16.1.4 Die beste Version des iOS 16-Systems kann von Person zu Person unterschiedlich sein. Öffentlichen Informationen zufolge gilt iOS16, das 2022 auf den Markt kam, als eine sehr stabile und leistungsstarke Version, und die Benutzer sind mit dem Gesamterlebnis recht zufrieden. Darüber hinaus wurden die neuen Funktionen und Verbesserungen des täglichen Nutzungserlebnisses in iOS16 von vielen Benutzern gut angenommen. Insbesondere in Bezug auf die aktualisierte Akkulaufzeit, Signalleistung und Heizungssteuerung war das Feedback der Benutzer relativ positiv. Betrachtet man jedoch das iPhone14

Immer neu! Upgrade der Huawei Mate60-Serie auf HarmonyOS 4.2: KI-Cloud-Erweiterung, Xiaoyi-Dialekt ist so einfach zu bedienen

Jun 02, 2024 pm 02:58 PM

Immer neu! Upgrade der Huawei Mate60-Serie auf HarmonyOS 4.2: KI-Cloud-Erweiterung, Xiaoyi-Dialekt ist so einfach zu bedienen

Jun 02, 2024 pm 02:58 PM

Am 11. April kündigte Huawei erstmals offiziell den 100-Maschinen-Upgradeplan für HarmonyOS 4.2 an. Dieses Mal werden mehr als 180 Geräte an dem Upgrade teilnehmen, darunter Mobiltelefone, Tablets, Uhren, Kopfhörer, Smart-Screens und andere Geräte. Im vergangenen Monat haben mit dem stetigen Fortschritt des HarmonyOS4.2-Upgradeplans für 100 Maschinen auch viele beliebte Modelle, darunter Huawei Pocket2, Huawei MateX5-Serie, Nova12-Serie, Huawei Pura-Serie usw., mit der Aktualisierung und Anpassung begonnen, was bedeutet, dass dass es mehr Benutzer von Huawei-Modellen geben wird, die das gemeinsame und oft neue Erlebnis von HarmonyOS genießen können. Den Rückmeldungen der Benutzer zufolge hat sich das Erlebnis der Modelle der Huawei Mate60-Serie nach dem Upgrade von HarmonyOS4.2 in allen Aspekten verbessert. Vor allem Huawei M

Welche Computer-Betriebssysteme gibt es?

Jan 12, 2024 pm 03:12 PM

Welche Computer-Betriebssysteme gibt es?

Jan 12, 2024 pm 03:12 PM

Ein Computerbetriebssystem ist ein System zur Verwaltung von Computerhardware und -software. Es ist auch ein Betriebssystemprogramm, das auf allen Softwaresystemen basiert. Welche Computersysteme gibt es also? Im Folgenden erklärt Ihnen der Herausgeber, was Computer-Betriebssysteme sind. Das sogenannte Betriebssystem dient der Verwaltung von Computerhardware und Softwareprogrammen. Sämtliche Software wird auf Basis von Betriebssystemprogrammen entwickelt. Tatsächlich gibt es viele Arten von Betriebssystemen, darunter solche für den industriellen Einsatz, den kommerziellen Einsatz und den persönlichen Gebrauch, die ein breites Anwendungsspektrum abdecken. Im Folgenden erklärt Ihnen der Herausgeber, was Computer-Betriebssysteme sind. Welche Computer-Betriebssysteme sind Windows-Systeme? Das Windows-System ist ein Betriebssystem, das von der Microsoft Corporation in den Vereinigten Staaten entwickelt wurde. als die meisten

Ausführliche Erklärung zum Ändern des Systemdatums in der Oracle-Datenbank

Mar 09, 2024 am 10:21 AM

Ausführliche Erklärung zum Ändern des Systemdatums in der Oracle-Datenbank

Mar 09, 2024 am 10:21 AM

Ausführliche Erläuterung der Methode zum Ändern des Systemdatums in der Oracle-Datenbank. In der Oracle-Datenbank umfasst die Methode zum Ändern des Systemdatums hauptsächlich das Ändern des Parameters NLS_DATE_FORMAT und die Verwendung der Funktion SYSDATE. In diesem Artikel werden diese beiden Methoden und ihre spezifischen Codebeispiele ausführlich vorgestellt, um den Lesern zu helfen, den Vorgang zum Ändern des Systemdatums in der Oracle-Datenbank besser zu verstehen und zu beherrschen. 1. Ändern Sie die NLS_DATE_FORMAT-Parametermethode. NLS_DATE_FORMAT sind Oracle-Daten

Unterschiede und Gemeinsamkeiten von cmd-Befehlen in Linux- und Windows-Systemen

Mar 15, 2024 am 08:12 AM

Unterschiede und Gemeinsamkeiten von cmd-Befehlen in Linux- und Windows-Systemen

Mar 15, 2024 am 08:12 AM

Linux und Windows sind zwei gängige Betriebssysteme, die das Open-Source-Linux-System bzw. das kommerzielle Windows-System darstellen. In beiden Betriebssystemen gibt es eine Befehlszeilenschnittstelle, über die Benutzer mit dem Betriebssystem interagieren können. In Linux-Systemen verwenden Benutzer die Shell-Befehlszeile, während Benutzer in Windows-Systemen die cmd-Befehlszeile verwenden. Die Shell-Befehlszeile im Linux-System ist ein sehr leistungsfähiges Tool, das fast alle Systemverwaltungsaufgaben erledigen kann.