Ein wenig über die Implementierung von BEV-Spurlinien

Im Jahr 2021 wurde ein Samen gepflanzt

Schüler, die die BEV-Hindernisgeschichte gelesen haben, sollten wissen, dass unsere Gruppe etwa am 21. Oktober mit der Herstellung von BEV-Hindernissen begonnen hat. Damals habe ich nicht daran gedacht, Spurmarkierungen für BEVs vorzunehmen, weil es an Arbeitskräften mangelte. Aber ich erinnere mich, dass wir uns etwa im Dezember mit einem Kandidaten getroffen haben. Während des Interviews erfuhren wir, dass sie seit mehr als einem halben Jahr an BEV-Spurmarkierungen arbeiteten. Präzisionskarten. Trainieren Sie den wahren Wert und sagen Sie, dass der Effekt nicht schlecht ist. Leider ist dieser Kandidat am Ende nicht zu uns gekommen. In Kombination mit den Inhalten der Fahrspurmarkierungen, die beim Telsa AI Day im Jahr 2021 vermittelt wurden, wurde in der Gruppe der Grundstein für die Herstellung von BEV-Fahrspurmarkierungen gelegt.

Machen Sie den ersten Schritt in die richtige Richtung seit 22 Jahren.

22 Jahre lang war die Personalstärke in unserem Team sehr knapp, wir hatten im Juni und Juli gerade noch genug Personal, um die BEV-Spurlinien zu erkunden. Aber zu diesem Zeitpunkt gab es in unserer Gruppe nur einen Klassenkameraden (nennen wir ihn jetzt Xiaoxuan), der dafür zwei Monate Zeit hatte. Dann begann der Samen des Jahres 2021 zu keimen. Der Student Xiaoxuan war immer noch sehr einfallsreich und er machte auch in Zukunft noch mehr Dinge, die alle überraschten. Mithilfe hochpräziser Hochgeschwindigkeitskarten können wir Spurliniendaten rund um das entsprechende Auto extrahieren. Ich erinnere mich, dass alle noch sehr aufgeregt waren, als es gemacht wurde.

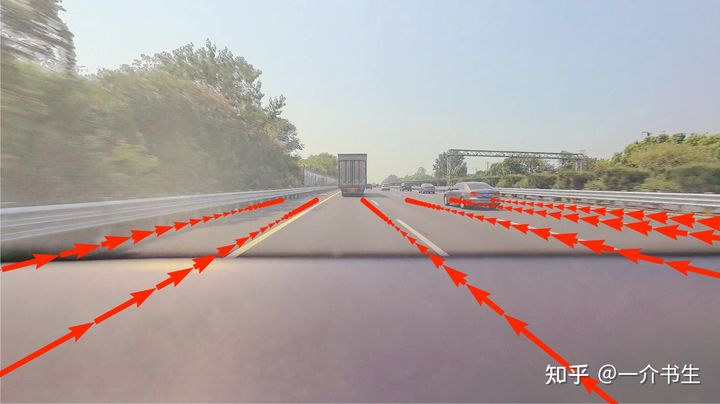

Abbildung 1: Der Effekt hochpräziser Kartenspurlinien, die auf das Bildsystem projiziert werden

Wie Sie in Abbildung 1 sehen können, gibt es immer noch einige Probleme mit dem Anpassungspaar, daher hat Xiaoxuan eine Reihe von Optimierungen vorgenommen. Zwei Monate später erledigte Xiaoxuan andere Aufgaben. Rückblickend haben wir den richtigen Schritt bei der Erkundung der BEV-Spurlinien getan. Denn in den Jahren 2021 und 22 wurden viele hervorragende BEV-Spurlinienpapiere und -codes nach und nach als Open Source bereitgestellt. Wenn man das sieht, könnte man denken, dass es eine perfekte Geschichte über die Einführung von BEV-Spurlinien im Jahr 2023 geben muss. Doch Ideale sind oft sehr erfüllend, aber die Realität ist sehr grausam.

23 Jahre Stolpern

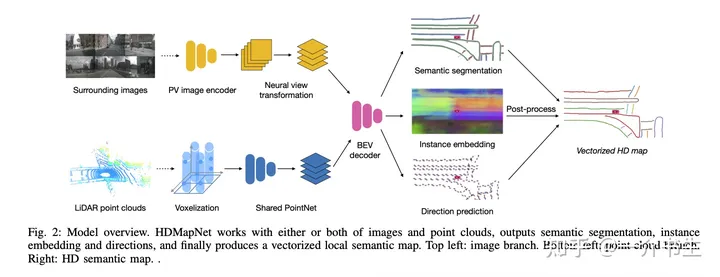

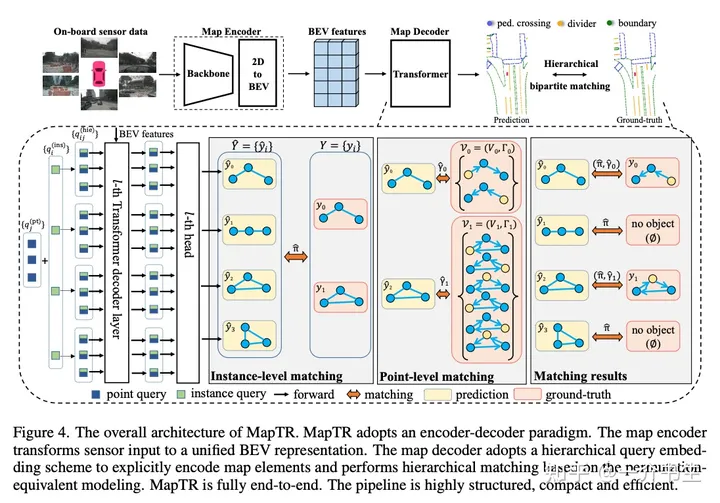

Denn unsere BEV-Hindernisse haben bewiesen, dass BEV diesen Weg gehen kann, und es hat auch bei Straßentests gute Ergebnisse gezeigt. Die Gruppe begann, über mehr Ressourcen zu verfügen, um Spurlinien zu berücksichtigen. Beachten Sie, dass es sich hier nicht um BEV handelt. Warum? Denn zu diesem Zeitpunkt standen wir unter großem Druck, online zu gehen, und wir hatten nicht genügend Erfahrung mit BEV-Spurlinien. Mit anderen Worten: Es gab fast keine Leute in der gesamten Gruppe, die Massenproduktion von 2D-Spurlinien durchgeführt hatten . Im ersten Halbjahr 2023 kann man es wirklich als Stolpern bezeichnen. Wir haben intern viele hitzige Diskussionen geführt und schließlich beschlossen, zwei Linien zu bilden, von denen eine die 2D-Lane-Linie ist: Die meisten Arbeitskräfte sind auf der 2D-Lane-Linie. Der Schwerpunkt liegt auf der 2D-Spurlinien-Nachbearbeitung und dem Lichtmodell durch 2D-Spurlinien, um Erfahrung in der Massenproduktion der Spurlinien-Nachbearbeitung zu sammeln. Eine Linie ist die BEV-Spurlinie: Es gibt nur eine kleine Anzahl von Arbeitskräften (eigentlich nur 1-2 Personen), die sich auf das Modelldesign der BEV-Spurlinie konzentrieren und Modellerfahrung sammeln. Es gibt bereits viele BEV-Spurmarkierungsnetzwerke. Ich werde hier als Referenz zwei Artikel veröffentlichen, die einen größeren Einfluss auf uns haben. „HDMapNet: An Online HD Map Construction and Evaluation Framework“ und „MapTR: Structured Modeling and Learning for Online Vectorized HD Map Construction“

Abbildung 2: HDMapNet

Abbildung 3 MapTR

Glücklicherweise in In Im April und Mai haben wir viel Erfahrung in der Massenproduktion der Spurliniennachbearbeitung in 2D-Spurlinien gesammelt und auch unser BEV-Spurliniennetz wurde Ende Mai reibungslos in den Bus eingebaut . . Hier muss ich sagen, dass unser Klassenkamerad Dahai, der für die Nachbearbeitung der Spurlinien verantwortlich ist, immer noch sehr fähig ist. Doch gerade wenn man denkt, dass die Dinge gut laufen, fängt oft schon der Albtraum an. Nach der Einführung der BEV-Spurlinien war der Fahrzeugkontrolleffekt nicht ideal. Zu diesem Zeitpunkt gerieten alle in eine Phase des Selbstzweifels. Liegt es an dem Problem der kubischen Spline-Anpassung der BEV-Spurlinien oder am Problem der schlechten Anpassung? der nachgeschalteten Parameter. Glücklicherweise haben wir die Ergebnisse des Zulieferers auf unserem Auto. Wir haben die Fahrspurlinienergebnisse des Zulieferers während des Straßentests gespeichert und sie dann mit unseren Ergebnissen im Visualisierungstool verglichen. Wenn der Fahrzeugkontrolleffekt nicht gut ist, müssen wir zunächst nachweisen, dass es kein Problem mit der Qualität unserer eigenen Spurlinien gibt, damit sich die nachgeschalteten Fahrer an unsere BEV-Spurlinien anpassen können. Es dauerte einen Monat, einen ganzen Monat, bis wir das Auto stabil unter Kontrolle hatten. Ich erinnere mich noch genau daran, dass wir auch von Shanghai nach Suzhou gefahren sind. Es war immer noch ein Samstag. Alle in der Gruppe waren sehr aufgeregt, den Effekt der Hochgeschwindigkeitsautokontrolle zu sehen.

Allerdings hat eine Geschichte oft Wendungen. Zur Erstellung von Spurliniendaten können wir nur Hochgeschwindigkeitskarten mit hoher Präzision verwenden. Was tun mit der Stadt? Es gibt immer noch so viele schlimme Fälle, die gelöst werden müssen. Zu diesem Zeitpunkt wird die wichtige Person endlich erscheinen. Nennen wir sie Klassenkamerad Xiaotang (den großen Verwalter unserer Datengruppe). Xiaotang und die anderen nutzten die Punktwolken-Rekonstruktion, um den Clip für uns zu rekonstruieren (Dieser Prozess war ziemlich schmerzhaft. Ich erinnere mich, dass diese zwei Monate die stressigste Zeit für sie waren, haha. Natürlich haben Xiaotang und ich uns oft verliebt und uns gegenseitig getötet Anderes. Schließlich sage ich oft, dass es bei Besprechungen wieder keine Daten gibt ). Wie erfolgt dann die Etikettierung nach dem Wiederaufbau? Wenn man sich die damaligen Lieferanten ansieht, verfügt keiner von ihnen über solche Etikettierwerkzeuge, geschweige denn über Etikettiererfahrung. Zusammen mit Xiaotang und anderen wurde das Anmerkungstool nach einem langen Monat endlich gemeinsam mit dem Lieferanten aufpoliert. (Wir scherzen oft darüber, dass wir die gesamte Branche der selbstfahrenden Anmerkungen stärken. Dieser Prozess ist wirklich mühsam und das Neuaufbauen von Clips ist sehr langsam zu laden.) Allerdings ist die gesamte Etikettierung immer noch relativ langsam oder teuer. Zu diesem Zeitpunkt debütierte Xiaoxuan mit seinem großen Modell der Spurlinien-Vormarkierung (die Wirkung des großen Modells der Spurlinien-Vormarkierung ist immer noch hervorragend). sah ihn erstaunt an. Nach dieser Reihe von Kombinationen ist unsere Produktion von Spurliniendaten endlich fast fertig. Im August wurde unsere BEV-Lane-Line-Control-Lane-Linie gut iteriert, die für einfache Hochgeschwindigkeits-Pilotfunktionen geeignet ist. Jetzt bringt uns Xiaoxuan noch mehr Überraschungen in die vorgezeichnete Richtung des großen Modells. Wir und Xiaotang sind immer noch verliebt und bringen uns gegenseitig um.

Allerdings endet keine Geschichte so einfach. Im September haben wir mit der Arbeit an multimodalen (Lidar, Kamera, Radar) und Multitasking-Modellen (Fahrspurlinien, Hindernisse, Occ) begonnen und werden anschließend die Städtenavigation unterstützen Power (NCP) ist die sogenannte Lösung, die die Wahrnehmung betont und Karten ignoriert. Basierend auf den Erfahrungen mit BEV-Hindernissen und BEV-Spurlinien werden wir das konvergierte Netzwerk bald, voraussichtlich bis Ende September, in Fahrzeugen implementieren. Den Fahrspurlinien wurden auch viele Unteraufgaben hinzugefügt, wie z. B. Verkehrszeichenerkennung, Kreuzungstopologie usw. In diesem Prozess haben wir die Nachbearbeitung der BEV-Spurlinien verbessert, die kubische Spline-Anpassung der Spurlinien aufgegeben und ein Punktverfolgungsschema übernommen. Die Ausgabe des Punktverfolgungsschemas und unseres Spurlinienmodells können problemlos kombiniert werden. Auch dieser Prozess war schmerzhaft. Wir hielten zwei Monate lang einmal in der Woche Sondertreffen ab. Schließlich hatten wir nach dem passenden Plan gute Arbeit geleistet, aber um eine höhere Grenze zu erreichen, mussten wir nur unter Schmerzen und Glück leiden. Abschließend haben wir die Grundfunktionen bereits im Praxistest getestet.

Lassen Sie mich Ihnen kurz Abbildung 4 erklären. Der Wahrnehmungsbereich unseres Modells beträgt derzeit nur die ersten 80 Meter. Sie können sehen, dass es einige Punkte hinter dem Auto gibt. die durch Tracking hinterlassen werden. Auf der rechten Seite befindet sich die von uns erstellte Echtzeit-Wahrnehmungskarte. Natürlich befindet sie sich noch in einem schnellen Iterationsprozess und es müssen noch viele Probleme gelöst werden.

24 ist der Neuanfang

Wenn ich 24 Jahre alt bin, bin ich sehr glücklich, dass ich zu diesem Zeitpunkt die Gelegenheit hatte, BEV I zu machen Ich habe auch das große Glück, eine Gruppe gleichgesinnter Freunde zu haben, die sich auf dem Weg ergänzen. In 24 Jahren gibt es für uns viele Dinge zu verfolgen, darunter die Massenproduktion von Pre-Fusion-Modellen, Bemühungen in der Datenrichtung, die Erforschung von Zeitmodellen, eine durchgängige Vorstellungskraft usw.

Das obige ist der detaillierte Inhalt vonEin wenig über die Implementierung von BEV-Spurlinien. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

Video Face Swap

Tauschen Sie Gesichter in jedem Video mühelos mit unserem völlig kostenlosen KI-Gesichtstausch-Tool aus!

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1393

1393

52

52

1207

1207

24

24

Warum ist Gaussian Splatting beim autonomen Fahren so beliebt, dass NeRF allmählich aufgegeben wird?

Jan 17, 2024 pm 02:57 PM

Warum ist Gaussian Splatting beim autonomen Fahren so beliebt, dass NeRF allmählich aufgegeben wird?

Jan 17, 2024 pm 02:57 PM

Oben geschrieben und persönliches Verständnis des Autors. Dreidimensionales Gaussplatting (3DGS) ist eine transformative Technologie, die in den letzten Jahren in den Bereichen explizite Strahlungsfelder und Computergrafik entstanden ist. Diese innovative Methode zeichnet sich durch die Verwendung von Millionen von 3D-Gaußkurven aus, was sich stark von der Neural Radiation Field (NeRF)-Methode unterscheidet, die hauptsächlich ein implizites koordinatenbasiertes Modell verwendet, um räumliche Koordinaten auf Pixelwerte abzubilden. Mit seiner expliziten Szenendarstellung und differenzierbaren Rendering-Algorithmen garantiert 3DGS nicht nur Echtzeit-Rendering-Fähigkeiten, sondern führt auch ein beispielloses Maß an Kontrolle und Szenenbearbeitung ein. Dies positioniert 3DGS als potenziellen Game-Changer für die 3D-Rekonstruktion und -Darstellung der nächsten Generation. Zu diesem Zweck geben wir erstmals einen systematischen Überblick über die neuesten Entwicklungen und Anliegen im Bereich 3DGS.

Wie lässt sich das Long-Tail-Problem in autonomen Fahrszenarien lösen?

Jun 02, 2024 pm 02:44 PM

Wie lässt sich das Long-Tail-Problem in autonomen Fahrszenarien lösen?

Jun 02, 2024 pm 02:44 PM

Gestern wurde ich während des Interviews gefragt, ob ich irgendwelche Long-Tail-Fragen gestellt hätte, also dachte ich, ich würde eine kurze Zusammenfassung geben. Das Long-Tail-Problem des autonomen Fahrens bezieht sich auf Randfälle bei autonomen Fahrzeugen, also mögliche Szenarien mit geringer Eintrittswahrscheinlichkeit. Das wahrgenommene Long-Tail-Problem ist einer der Hauptgründe, die derzeit den betrieblichen Designbereich intelligenter autonomer Einzelfahrzeugfahrzeuge einschränken. Die zugrunde liegende Architektur und die meisten technischen Probleme des autonomen Fahrens wurden gelöst, und die verbleibenden 5 % der Long-Tail-Probleme wurden nach und nach zum Schlüssel zur Einschränkung der Entwicklung des autonomen Fahrens. Zu diesen Problemen gehören eine Vielzahl fragmentierter Szenarien, Extremsituationen und unvorhersehbares menschliches Verhalten. Der „Long Tail“ von Randszenarien beim autonomen Fahren bezieht sich auf Randfälle in autonomen Fahrzeugen (AVs). Randfälle sind mögliche Szenarien mit geringer Eintrittswahrscheinlichkeit. diese seltenen Ereignisse

Kamera oder Lidar wählen? Eine aktuelle Übersicht über die Erzielung einer robusten 3D-Objekterkennung

Jan 26, 2024 am 11:18 AM

Kamera oder Lidar wählen? Eine aktuelle Übersicht über die Erzielung einer robusten 3D-Objekterkennung

Jan 26, 2024 am 11:18 AM

0. Vorab geschrieben&& Persönliches Verständnis, dass autonome Fahrsysteme auf fortschrittlichen Wahrnehmungs-, Entscheidungs- und Steuerungstechnologien beruhen, indem sie verschiedene Sensoren (wie Kameras, Lidar, Radar usw.) verwenden, um die Umgebung wahrzunehmen, und Algorithmen und Modelle verwenden für Echtzeitanalysen und Entscheidungsfindung. Dies ermöglicht es Fahrzeugen, Verkehrszeichen zu erkennen, andere Fahrzeuge zu erkennen und zu verfolgen, das Verhalten von Fußgängern vorherzusagen usw. und sich so sicher an komplexe Verkehrsumgebungen anzupassen. Diese Technologie erregt derzeit große Aufmerksamkeit und gilt als wichtiger Entwicklungsbereich für die Zukunft des Transportwesens . eins. Aber was autonomes Fahren schwierig macht, ist herauszufinden, wie man dem Auto klarmachen kann, was um es herum passiert. Dies erfordert, dass der dreidimensionale Objekterkennungsalgorithmus im autonomen Fahrsystem Objekte in der Umgebung, einschließlich ihrer Standorte, genau wahrnehmen und beschreiben kann.

Beherrschen Sie die Koordinatensystemkonvertierung wirklich? Multisensorik-Themen, die für das autonome Fahren unverzichtbar sind

Oct 12, 2023 am 11:21 AM

Beherrschen Sie die Koordinatensystemkonvertierung wirklich? Multisensorik-Themen, die für das autonome Fahren unverzichtbar sind

Oct 12, 2023 am 11:21 AM

Der erste Pilot- und Schlüsselartikel stellt hauptsächlich mehrere häufig verwendete Koordinatensysteme in der autonomen Fahrtechnologie vor und erläutert, wie die Korrelation und Konvertierung zwischen ihnen abgeschlossen und schließlich ein einheitliches Umgebungsmodell erstellt werden kann. Der Schwerpunkt liegt hier auf dem Verständnis der Umrechnung vom Fahrzeug in den starren Kamerakörper (externe Parameter), der Kamera-in-Bild-Konvertierung (interne Parameter) und der Bild-in-Pixel-Einheitenkonvertierung. Die Konvertierung von 3D in 2D führt zu entsprechenden Verzerrungen, Verschiebungen usw. Wichtige Punkte: Das Fahrzeugkoordinatensystem und das Kamerakörperkoordinatensystem müssen neu geschrieben werden: Das Ebenenkoordinatensystem und das Pixelkoordinatensystem. Schwierigkeit: Sowohl die Entzerrung als auch die Verzerrungsaddition müssen auf der Bildebene kompensiert werden. 2. Einführung Insgesamt gibt es vier visuelle Systeme Koordinatensystem: Pixelebenenkoordinatensystem (u, v), Bildkoordinatensystem (x, y), Kamerakoordinatensystem () und Weltkoordinatensystem (). Es gibt eine Beziehung zwischen jedem Koordinatensystem,

Dieser Artikel reicht aus, um etwas über autonomes Fahren und Flugbahnvorhersage zu lesen!

Feb 28, 2024 pm 07:20 PM

Dieser Artikel reicht aus, um etwas über autonomes Fahren und Flugbahnvorhersage zu lesen!

Feb 28, 2024 pm 07:20 PM

Die Trajektorienvorhersage spielt eine wichtige Rolle beim autonomen Fahren. Unter autonomer Fahrtrajektorienvorhersage versteht man die Vorhersage der zukünftigen Fahrtrajektorie des Fahrzeugs durch die Analyse verschiedener Daten während des Fahrvorgangs. Als Kernmodul des autonomen Fahrens ist die Qualität der Trajektorienvorhersage von entscheidender Bedeutung für die nachgelagerte Planungssteuerung. Die Trajektorienvorhersageaufgabe verfügt über einen umfangreichen Technologie-Stack und erfordert Vertrautheit mit der dynamischen/statischen Wahrnehmung des autonomen Fahrens, hochpräzisen Karten, Fahrspurlinien, Fähigkeiten in der neuronalen Netzwerkarchitektur (CNN&GNN&Transformer) usw. Der Einstieg ist sehr schwierig! Viele Fans hoffen, so schnell wie möglich mit der Flugbahnvorhersage beginnen zu können und Fallstricke zu vermeiden. Heute werde ich eine Bestandsaufnahme einiger häufiger Probleme und einführender Lernmethoden für die Flugbahnvorhersage machen! Einführungsbezogenes Wissen 1. Sind die Vorschaupapiere in Ordnung? A: Schauen Sie sich zuerst die Umfrage an, S

Sprechen wir über End-to-End- und autonome Fahrsysteme der nächsten Generation sowie über einige Missverständnisse über End-to-End-Autonomes Fahren?

Apr 15, 2024 pm 04:13 PM

Sprechen wir über End-to-End- und autonome Fahrsysteme der nächsten Generation sowie über einige Missverständnisse über End-to-End-Autonomes Fahren?

Apr 15, 2024 pm 04:13 PM

Im vergangenen Monat hatte ich aus bekannten Gründen einen sehr intensiven Austausch mit verschiedenen Lehrern und Mitschülern der Branche. Ein unvermeidliches Thema im Austausch ist natürlich End-to-End und der beliebte Tesla FSDV12. Ich möchte diese Gelegenheit nutzen, einige meiner aktuellen Gedanken und Meinungen als Referenz und Diskussion darzulegen. Wie definiert man ein durchgängiges autonomes Fahrsystem und welche Probleme sollten voraussichtlich durchgängig gelöst werden? Gemäß der traditionellsten Definition bezieht sich ein End-to-End-System auf ein System, das Rohinformationen von Sensoren eingibt und für die Aufgabe relevante Variablen direkt ausgibt. Bei der Bilderkennung kann CNN beispielsweise als End-to-End bezeichnet werden, verglichen mit der herkömmlichen Methode zum Extrahieren von Merkmalen + Klassifizieren. Bei autonomen Fahraufgaben werden Eingabedaten verschiedener Sensoren (Kamera/LiDAR) benötigt

SIMPL: Ein einfacher und effizienter Multi-Agent-Benchmark zur Bewegungsvorhersage für autonomes Fahren

Feb 20, 2024 am 11:48 AM

SIMPL: Ein einfacher und effizienter Multi-Agent-Benchmark zur Bewegungsvorhersage für autonomes Fahren

Feb 20, 2024 am 11:48 AM

Originaltitel: SIMPL: ASimpleandEfficientMulti-agentMotionPredictionBaselineforAutonomousDriving Paper-Link: https://arxiv.org/pdf/2402.02519.pdf Code-Link: https://github.com/HKUST-Aerial-Robotics/SIMPL Autor: Hong Kong University of Science und Technologie DJI-Papieridee: Dieses Papier schlägt eine einfache und effiziente Bewegungsvorhersagebasislinie (SIMPL) für autonome Fahrzeuge vor. Im Vergleich zum herkömmlichen Agent-Cent

FisheyeDetNet: der erste Zielerkennungsalgorithmus basierend auf einer Fischaugenkamera

Apr 26, 2024 am 11:37 AM

FisheyeDetNet: der erste Zielerkennungsalgorithmus basierend auf einer Fischaugenkamera

Apr 26, 2024 am 11:37 AM

Die Zielerkennung ist ein relativ ausgereiftes Problem in autonomen Fahrsystemen, wobei die Fußgängererkennung einer der ersten Algorithmen ist, die eingesetzt werden. In den meisten Arbeiten wurde eine sehr umfassende Recherche durchgeführt. Die Entfernungswahrnehmung mithilfe von Fischaugenkameras für die Rundumsicht ist jedoch relativ wenig untersucht. Aufgrund der großen radialen Verzerrung ist es schwierig, die standardmäßige Bounding-Box-Darstellung in Fischaugenkameras zu implementieren. Um die obige Beschreibung zu vereinfachen, untersuchen wir erweiterte Begrenzungsrahmen-, Ellipsen- und allgemeine Polygondesigns in Polar-/Winkeldarstellungen und definieren eine mIOU-Metrik für die Instanzsegmentierung, um diese Darstellungen zu analysieren. Das vorgeschlagene Modell „fisheyeDetNet“ mit polygonaler Form übertrifft andere Modelle und erreicht gleichzeitig 49,5 % mAP auf dem Valeo-Fisheye-Kameradatensatz für autonomes Fahren