Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

LimSim++: Eine neue Stufe für multimodale Großmodelle im autonomen Fahren

LimSim++: Eine neue Stufe für multimodale Großmodelle im autonomen Fahren

LimSim++: Eine neue Stufe für multimodale Großmodelle im autonomen Fahren

Papiername: LimSim++: A Closed-Loop Platform for Deploying Multimodal LLMs in Autonomous Driving

Projekthomepage: https://pjlab-adg.github.io/limsim_plus/

Einführung in den Simulator

Da das Multimodal Large Language Model ((M)LLM) einen Forschungsboom im Bereich der künstlichen Intelligenz auslöste, rückte seine Anwendung in der autonomen Fahrtechnologie nach und nach in den Mittelpunkt der Aufmerksamkeit. Diese Modelle bieten eine starke Unterstützung für den Aufbau sicherer und zuverlässiger autonomer Fahrsysteme durch leistungsstarkes allgemeines Verständnis und logische Denkfähigkeiten. Obwohl es bestehende Closed-Loop-Simulationsplattformen wie HighwayEnv, CARLA und NuPlan gibt, die die Leistung von LLM beim autonomen Fahren überprüfen können, müssen Benutzer diese Plattformen in der Regel selbst anpassen, was nicht nur die Einsatzschwelle erhöht, sondern auch die begrenzt Eingehende Untersuchung der LLM-Fähigkeiten.

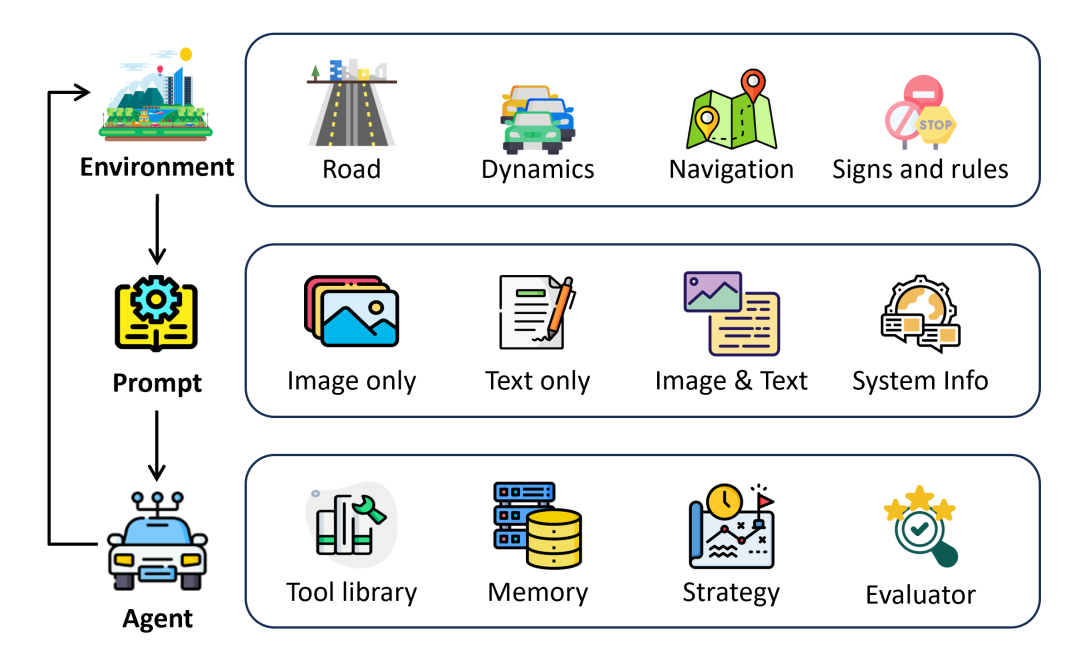

Um diese Herausforderung zu meistern, hat die Intelligent Transportation Platform Group des Shanghai Artificial Intelligence Laboratory **LimSim++** ins Leben gerufen, eine Simulationsplattform für autonomes Fahren mit geschlossenem Regelkreis, die speziell für (M)LLM entwickelt wurde. Der Start von LimSim++ zielt darauf ab, Forschern im Bereich des autonomen Fahrens eine geeignetere Umgebung zu bieten, um das Potenzial von LLM in der autonomen Fahrtechnologie umfassend zu erkunden. Die Plattform kann Szeneninformationen aus Simulationsumgebungen wie SUMO und CARLA extrahieren und verarbeiten und sie in verschiedene von LLM benötigte Eingabeformen umwandeln, einschließlich Bildinformationen, Szenenerkennung und Aufgabenbeschreibung. Darüber hinaus verfügt LimSim++ auch über eine Funktion zur Konvertierung von Bewegungsprimitiven, mit der basierend auf den Entscheidungen von LLM schnell geeignete Fahrtrajektorien generiert werden können, um eine Simulation mit geschlossenem Regelkreis zu erreichen. Noch wichtiger ist, dass LimSim++ eine kontinuierliche Lernumgebung für LLM schafft, die LLM dabei hilft, Fahrstrategien kontinuierlich zu optimieren und die Fahrleistung des Fahreragenten zu verbessern, indem es Entscheidungsergebnisse auswertet und Feedback gibt.

Simulatorfunktionen

LimSim++ verfügt über wichtige Funktionen im Bereich der autonomen Fahrsimulation und bietet eine ideale Closed-Loop-Simulation und kontinuierliche Lernumgebung für (M)LLM-gesteuerte Driver Agents.

- LimSim++ unterstützt die Simulation verschiedener Fahrszenarien wie Kreuzungen, Rampen und Kreisverkehre und stellt so sicher, dass der Fahreragent Herausforderungen bei verschiedenen komplexen Straßenbedingungen annehmen kann. Diese vielfältigen Szeneneinstellungen helfen LLM dabei, ein umfassenderes Fahrerlebnis zu erzielen und seine Anpassungsfähigkeit in realen Umgebungen zu verbessern.

- LimSim++ unterstützt große Sprachmodelle mit mehreren modalen Eingaben. LimSim++ bietet nicht nur eine regelbasierte Generierung von Szeneninformationen, sondern kann auch gemeinsam mit CARLA debuggt werden, um reichhaltige visuelle Eingaben bereitzustellen, um den visuellen Wahrnehmungsanforderungen von (M)LLM beim autonomen Fahren gerecht zu werden.

- LimSim++ konzentriert sich auf kontinuierliche Lernfähigkeiten. LimSim++ integriert Module wie Evaluation, Reflexion und Gedächtnis, um (M)LLM dabei zu helfen, kontinuierlich Erfahrungen zu sammeln und Entscheidungsstrategien während des Simulationsprozesses zu optimieren.

Erstellen Sie Ihren eigenen Treiberagenten

LimSim++ bietet Benutzern eine umfangreiche Benutzeroberfläche, die den Anpassungsanforderungen des Treiberagenten gerecht wird, die Flexibilität der LimSim++-Entwicklung verbessert und den Schwellenwert für die Verwendung senkt.

- Prompt-Konstruktion

- LimSim++ unterstützt benutzerdefinierte Eingabeaufforderungen, um die Eingabe von Textinformationen in (M)LLM zu ändern, einschließlich Rolleneinstellungen, Aufgabenanforderungen, Szenenbeschreibungen und anderen Informationen.

- LimSim++ bietet Szenenbeschreibungsvorlagen basierend auf dem JSON-Format, sodass Benutzer Eingabeaufforderungen ohne Code ändern können, ohne die spezifische Implementierung der Informationsextraktion berücksichtigen zu müssen.

- Entscheidungsbewertungsmodul

- LimSim++ bietet eine Basis für die Bewertung von (M)LLM-Entscheidungsergebnissen. Benutzer können Bewertungspräferenzen anpassen, indem sie die Gewichtsparameter ändern.

- Flexibilität des Frameworks

- LimSim++ unterstützt Benutzer beim Hinzufügen benutzerdefinierter Werkzeugbibliotheken für (M)LLM, wie z. B. Wahrnehmungswerkzeuge, numerische Verarbeitungswerkzeuge usw.

Schnell loslegen

- Schritt 0:SUMO installieren (Version≥v1.15.0, Ubuntu)

sudo add-apt-repository ppa:sumo/stablesudo apt-get updatesudo apt-get install sumo sumo-tools sumo-doc

- Schritt 1: Laden Sie das LimSim++-Quellcode-Komprimierungspaket herunter und entpacken Sie es und wechseln zum richtigen Zweig

git clone https://github.com/PJLab-ADG/LimSim.gitgit checkout -b LimSim_plus

- Schritt 2:Abhängigkeiten installieren (Canda ist erforderlich)

cd LimSimconda env create -f environment.yml

- Schritt 3: Simulation ausführen

- Simulation alleine ausführen

python ExampleModel.py

- LLM für autonomes Fahren nutzen

export OPENAI_API_KEY='your openai key'python ExampleLLMAgentCloseLoop.py

- VLM für autonomes Fahren nutzen

# Terminal 1cd path-to-carla/./CarlaUE4.sh# Termnial 2cd path-to-carla/cd PythonAPI/util/python3 config.py --map Town06# Termnial 2export OPENAI_API_KEY='your openai key'cd path-to-LimSim++/python ExampleVLMAgentCloseLoop.py

Weitere Informationen finden Sie im Github von LimSim++: https://github.com/PJLab-ADG/LimSim/tree /LimSim_plus, Wenn Sie weitere Fragen haben, stellen Sie diese bitte unter „Probleme“ auf GitHub oder kontaktieren Sie uns direkt per E-Mail!

Wir begrüßen Partner aus Wissenschaft und Industrie, um gemeinsam LimSim++ zu entwickeln und ein Open-Source-Ökosystem aufzubauen!

Das obige ist der detaillierte Inhalt vonLimSim++: Eine neue Stufe für multimodale Großmodelle im autonomen Fahren. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1376

1376

52

52

Smart App Control unter Windows 11: So aktivieren oder deaktivieren Sie es

Jun 06, 2023 pm 11:10 PM

Smart App Control unter Windows 11: So aktivieren oder deaktivieren Sie es

Jun 06, 2023 pm 11:10 PM

Intelligent App Control ist ein sehr nützliches Tool in Windows 11, das dabei hilft, Ihren PC vor nicht autorisierten Apps zu schützen, die Ihre Daten beschädigen können, wie z. B. Ransomware oder Spyware. In diesem Artikel wird erklärt, was Smart App Control ist, wie es funktioniert und wie man es in Windows 11 ein- oder ausschaltet. Was ist Smart App Control in Windows 11? Smart App Control (SAC) ist eine neue Sicherheitsfunktion, die mit dem Windows 1122H2-Update eingeführt wurde. Es arbeitet mit Microsoft Defender oder Antivirensoftware von Drittanbietern zusammen, um potenziell unnötige Apps zu blockieren, die Ihr Gerät verlangsamen, unerwartete Werbung anzeigen oder andere unerwartete Aktionen ausführen können. Intelligente Anwendung

Die herumfliegenden Gesichtszüge, das Öffnen des Mundes, das Starren und das Hochziehen der Augenbrauen können von der KI perfekt nachgeahmt werden, sodass Videobetrug nicht verhindert werden kann

Dec 14, 2023 pm 11:30 PM

Die herumfliegenden Gesichtszüge, das Öffnen des Mundes, das Starren und das Hochziehen der Augenbrauen können von der KI perfekt nachgeahmt werden, sodass Videobetrug nicht verhindert werden kann

Dec 14, 2023 pm 11:30 PM

Mit solch einer mächtigen KI-Imitationsfähigkeit ist es wirklich unmöglich, dies zu verhindern. Hat die Entwicklung der KI mittlerweile dieses Niveau erreicht? Ihr vorderer Fuß lässt Ihre Gesichtszüge fliegen, und auf Ihrem hinteren Fuß wird genau der gleiche Ausdruck reproduziert. Starren, Augenbrauen hochziehen, schmollen, egal wie übertrieben der Ausdruck ist, alles wird perfekt nachgeahmt. Erhöhen Sie den Schwierigkeitsgrad, heben Sie die Augenbrauen höher, öffnen Sie die Augen weiter, und sogar die Mundform ist schief und der Ausdruck des Avatars kann perfekt reproduziert werden. Wenn Sie die Parameter auf der linken Seite anpassen, ändert der virtuelle Avatar auf der rechten Seite auch seine Bewegungen entsprechend, um eine Nahaufnahme von Mund und Augen zu erhalten. Man kann nicht sagen, dass die Nachahmung genau gleich ist, aber der Ausdruck ist genau derselbe gleich (ganz rechts). Die Forschung stammt von Institutionen wie der Technischen Universität München, die GaussianAvatars vorschlägt

MotionLM: Sprachmodellierungstechnologie für die Bewegungsvorhersage mit mehreren Agenten

Oct 13, 2023 pm 12:09 PM

MotionLM: Sprachmodellierungstechnologie für die Bewegungsvorhersage mit mehreren Agenten

Oct 13, 2023 pm 12:09 PM

Dieser Artikel wird mit Genehmigung des öffentlichen Kontos von Autonomous Driving Heart nachgedruckt. Bitte wenden Sie sich für den Nachdruck an die Quelle. Originaltitel: MotionLM: Multi-Agent Motion Forecasting as Language Modeling Papierlink: https://arxiv.org/pdf/2309.16534.pdf Autorenzugehörigkeit: Waymo Konferenz: ICCV2023 Papieridee: Für die Sicherheitsplanung autonomer Fahrzeuge das zukünftige Verhalten zuverlässig vorhersagen der Straßenverkehrsbeamten ist von entscheidender Bedeutung. Diese Studie stellt kontinuierliche Trajektorien als Sequenzen diskreter Bewegungstokens dar und behandelt die Bewegungsvorhersage mit mehreren Agenten als eine Sprachmodellierungsaufgabe. Das von uns vorgeschlagene Modell MotionLM hat die folgenden Vorteile: Erstens

Der intelligente universelle humanoide Roboter GR-1 Fourier steht kurz vor dem Vorverkaufsstart!

Sep 27, 2023 pm 08:41 PM

Der intelligente universelle humanoide Roboter GR-1 Fourier steht kurz vor dem Vorverkaufsstart!

Sep 27, 2023 pm 08:41 PM

Der humanoide Roboter, der 1,65 Meter groß ist, 55 Kilogramm wiegt und über 44 Freiheitsgrade in seinem Körper verfügt, kann schnell gehen, Hindernissen schnell ausweichen, Steigungen stetig hinauf und hinunter klettern und Stößen und Störungen standhalten. Jetzt können Sie ihn mit nach Hause nehmen ! Der universelle humanoide Roboter GR-1 von Fourier Intelligence hat mit dem Vorverkauf begonnen. Der universelle humanoide Roboter Fourier GR-1 ist jetzt zum Vorverkauf geöffnet. GR-1 verfügt über eine hochgradig bionische Rumpfkonfiguration und anthropomorphe Bewegungssteuerung. Er verfügt über 44 Freiheitsgrade im gesamten Körper. Er verfügt über die Fähigkeit zu gehen, Hindernissen auszuweichen, über Hindernisse zu klettern, Abhänge zu überwinden, Störungen zu widerstehen und sich anzupassen Es handelt sich um ein allgemeines künstliches Intelligenzsystem. Offizielle Vorverkaufsseite der Website: www.fftai.cn/order#FourierGR-1# Fourier Intelligence muss neu geschrieben werden.

Wussten Sie, dass es bei Programmierern in ein paar Jahren einen Niedergang geben wird?

Nov 08, 2023 am 11:17 AM

Wussten Sie, dass es bei Programmierern in ein paar Jahren einen Niedergang geben wird?

Nov 08, 2023 am 11:17 AM

Die Zeitschrift „ComputerWorld“ schrieb einmal in einem Artikel, dass „die Programmierung bis 1960 verschwinden wird“, weil IBM eine neue Sprache FORTRAN entwickelt hat, die es Ingenieuren ermöglicht, die benötigten mathematischen Formeln zu schreiben und sie dann dem Computer zu übermitteln, damit das Programmieren endet. Ein paar Jahre später hörten wir ein neues Sprichwort: Jeder Unternehmer kann Geschäftsbegriffe verwenden, um seine Probleme zu beschreiben und dem Computer zu sagen, was er tun soll. Mit dieser Programmiersprache namens COBOL brauchen Unternehmen keine Programmierer mehr. Später soll IBM eine neue Programmiersprache namens RPG entwickelt haben, mit der Mitarbeiter Formulare ausfüllen und Berichte erstellen können, sodass die meisten Programmieranforderungen des Unternehmens damit erfüllt werden können.

Was sind die effektiven Methoden und gängigen Basismethoden für die Vorhersage der Fußgängerbahn? Teilen der besten Konferenzbeiträge!

Oct 17, 2023 am 11:13 AM

Was sind die effektiven Methoden und gängigen Basismethoden für die Vorhersage der Fußgängerbahn? Teilen der besten Konferenzbeiträge!

Oct 17, 2023 am 11:13 AM

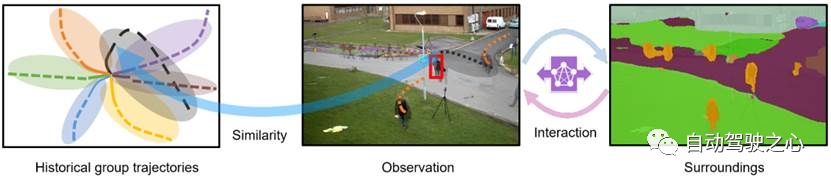

Die Flugbahnvorhersage stand in den letzten zwei Jahren im Rampenlicht, aber das meiste davon konzentriert sich auf die Richtung der Fahrzeugflugbahnvorhersage. Heute wird Autonomous Driving Heart den Algorithmus für die Flugbahnvorhersage von Fußgängern auf NeurIPS – SHENet teilen. Menschliche Bewegungsmuster unterliegen in der Regel bis zu einem gewissen Grad begrenzten Regeln. Basierend auf dieser Annahme sagt SHENet die zukünftige Flugbahn einer Person voraus, indem es implizite Szenenregeln lernt. Der Artikel wurde von Autonomous Driving Heart als Original zertifiziert! Nach persönlichem Verständnis des Autors ist die Vorhersage der zukünftigen Flugbahn einer Person aufgrund der Zufälligkeit und Subjektivität menschlicher Bewegungen derzeit immer noch ein herausforderndes Problem. Allerdings variieren menschliche Bewegungsmuster in eingeschränkten Szenen häufig aufgrund von Szenenbeschränkungen (z. B. Grundrissen, Straßen und Hindernissen) und der Interaktivität von Mensch zu Mensch oder Mensch zu Objekt.

Huawei wird das Xuanji-Sensorsystem im Bereich Smart Wearables auf den Markt bringen, das den emotionalen Zustand des Benutzers anhand der Herzfrequenz beurteilen kann

Aug 29, 2024 pm 03:30 PM

Huawei wird das Xuanji-Sensorsystem im Bereich Smart Wearables auf den Markt bringen, das den emotionalen Zustand des Benutzers anhand der Herzfrequenz beurteilen kann

Aug 29, 2024 pm 03:30 PM

Kürzlich gab Huawei bekannt, dass es im September ein neues intelligentes tragbares Produkt mit dem Xuanji-Sensorsystem auf den Markt bringen wird, bei dem es sich voraussichtlich um die neueste Smartwatch von Huawei handeln wird. Dieses neue Produkt wird fortschrittliche Funktionen zur Überwachung der emotionalen Gesundheit integrieren. Das Xuanji Perception System bietet Benutzern eine umfassende Gesundheitsbewertung mit seinen sechs Merkmalen – Genauigkeit, Vollständigkeit, Geschwindigkeit, Flexibilität, Offenheit und Skalierbarkeit. Das System nutzt ein Super-Sensing-Modul und optimiert die Mehrkanal-Optikpfad-Architekturtechnologie, wodurch die Überwachungsgenauigkeit grundlegender Indikatoren wie Herzfrequenz, Blutsauerstoff und Atemfrequenz erheblich verbessert wird. Darüber hinaus hat das Xuanji Sensing System auch die Erforschung emotionaler Zustände auf Basis von Herzfrequenzdaten erweitert. Es beschränkt sich nicht nur auf physiologische Indikatoren, sondern kann auch den emotionalen Zustand und das Stressniveau des Benutzers bewerten. Es unterstützt die Überwachung von mehr als 60 Sportarten Gesundheitsindikatoren, die kardiovaskuläre, respiratorische, neurologische, endokrine,

Lesen Sie das Smart-Car-Skateboard-Chassis in einem Artikel

May 24, 2023 pm 12:01 PM

Lesen Sie das Smart-Car-Skateboard-Chassis in einem Artikel

May 24, 2023 pm 12:01 PM

01 Was ist ein Skateboard-Chassis? Das sogenannte Skateboard-Chassis integriert die Batterie, das elektrische Antriebssystem, die Federung, die Bremsen und andere Komponenten im Voraus, um eine Trennung und Entkopplung von Karosserie und Chassis zu erreichen. Basierend auf dieser Art von Plattform können Automobilhersteller die frühen Forschungs- und Entwicklungs- sowie Testkosten erheblich senken und gleichzeitig schnell auf die Marktnachfrage reagieren, um verschiedene Modelle zu entwickeln. Insbesondere im Zeitalter des fahrerlosen Fahrens ist das Layout des Autos nicht mehr auf das Fahren ausgerichtet, sondern wird sich auf die Raumeigenschaften konzentrieren. Das Skateboard-Chassis kann mehr Möglichkeiten für die Entwicklung der oberen Kabine bieten. Wie im Bild oben gezeigt, sollten wir uns beim Betrachten des Skateboard-Chassis natürlich nicht von dem ersten Eindruck „Oh, es ist ein nicht tragender Körper“ einrahmen lassen. Damals gab es noch keine Elektroautos, also auch keine Hunderte Kilogramm schweren Batteriepakete, kein Steering-by-Wire-System, das die Lenksäule überflüssig machen konnte, und kein Brake-by-Wire-System.