Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Mit nur 200 Millionen Parametern übertrifft die Leistung bei Nullabtastungen die überwachter Leistung! Google veröffentlicht das grundlegende Zeitreihenvorhersagemodell TimesFM

Mit nur 200 Millionen Parametern übertrifft die Leistung bei Nullabtastungen die überwachter Leistung! Google veröffentlicht das grundlegende Zeitreihenvorhersagemodell TimesFM

Mit nur 200 Millionen Parametern übertrifft die Leistung bei Nullabtastungen die überwachter Leistung! Google veröffentlicht das grundlegende Zeitreihenvorhersagemodell TimesFM

Zeitreihenprognosen spielen in verschiedenen Bereichen wie Einzelhandel, Finanzen, Fertigung, Gesundheitswesen und Naturwissenschaften usw. eine wichtige Rolle. Im Einzelhandel können die Lagerkosten effektiv gesenkt und der Umsatz gesteigert werden, indem die Genauigkeit der Nachfrageprognosen verbessert wird. Dies bedeutet, dass Unternehmen die Kundennachfrage besser erfüllen, Lagerüberhänge und Verluste reduzieren und gleichzeitig Umsatz und Gewinn steigern können. Daher ist die Zeitreihenprognose im Einzelhandel von großem Wert und kann Unternehmen Substanz verleihen.

Deep-Learning-Modelle (DL) dominieren die Aufgabe der „multivariablen Zeitreihenprognose“ und werden in verschiedenen Wettbewerben und in der Praxis eingesetzt Anwendungen.

Gleichzeitig wurden erhebliche Fortschritte bei großen grundlegenden Sprachmodellen bei NLP-Aufgaben (Natural Language Processing) erzielt, wodurch die Leistung von Aufgaben wie Übersetzung, Generierung von Abrufverbesserungen und Code-Vervollständigung effektiv verbessert wurde.

Das Training von NLP-Modellen basiert auf umfangreichen Textdaten, die aus verschiedenen Quellen stammen, darunter Crawler, Open-Source-Code usw. Das trainierte Modell kann Muster in der Sprache erkennen und hat die Fähigkeit, aus Nullproben zu lernen : Beispielsweise werden große Modelle bei Abrufaufgaben verwendet, bei denen das Modell Fragen zu aktuellen Ereignissen beantworten und diese zusammenfassen kann.

Obwohl Deep-Learning-basierte Prädiktoren herkömmliche Methoden in vielerlei Hinsicht übertreffen, einschließlich der Reduzierung von Schulungs- und Inferenzkosten, müssen noch einige Herausforderungen bewältigt werden:

Viele Deep-Learning-Modelle durchlaufen langwieriges Training und Validierung. Nur dann kann es sein an einer neuen Zeitreihe getestet. Im Gegensatz dazu verfügt das zugrunde liegende Modell für die Zeitreihenprognose über „out-of-the-box-Prognose“-Funktionen und kann ohne zusätzliche Schulung auf unbekannte Zeitreihendaten angewendet werden. Mit dieser Funktion können sich Benutzer auf die Verbesserung der Prognosen für praktische nachgelagerte Aufgaben wie die Bedarfsplanung im Einzelhandel konzentrieren.

Forscher von Google Research haben kürzlich ein Basismodell für die Zeitreihenvorhersage namens TimesFM vorgeschlagen, das anhand von 100 Milliarden realen Zeitpunkten vorab trainiert wurde. Im Vergleich zu aktuellen, hochmodernen Large Language Models (LLMs) ist TimesFM viel kleiner und enthält nur 200 Millionen Parameter.

Link zum Papier: https://arxiv.org/pdf/2310.10688.pdf

Experimentelle Ergebnisse zeigen, dass TimesFM trotz des geringen Maßstabs über verschiedene Bereiche und Zeitskalen hinweg anders abschneidet als untrainierte. Der Datensatz zeigt überraschende „Zero-Shot-Leistung“, die der Leistung explizit trainierter, hochmoderner überwachter Methoden für diese Datensätze nahe kommt.

Die Forscher planen, das TimesFM-Modell noch in diesem Jahr externen Kunden in Google Cloud Vertex AI zur Verfügung zu stellen.

Basismodell TimesFM

LLMs werden in der Regel nur durch Decoder trainiert, einschließlich dreier Schritte:

1 Der Text wird in Unterwörter zerlegt, die als Token bezeichnet werden

2 Gestapelte kausale Transformer-Schicht und Generierung einer Ausgabe, die jedem Eingabe-Token entspricht. Es ist zu beachten, dass diese Schicht keine Token ohne Eingabe verarbeiten kann, d. h. zukünftige Token. Die Ausgabe des i-ten Tokens fasst alle zusammen Informationen aus den vorherigen Tokens und sagt das (i+1)-te Token voraus

Während der Inferenz generiert LLM jeweils die Ausgabe eines Tokens.

Wenn Sie beispielsweise die Eingabeaufforderung „Was ist die Hauptstadt von Frankreich?“ eingeben, generiert das Modell möglicherweise den Token „The“ und generiert dann den nächsten Token „Capital“. auf diese Eingabeaufforderung. “ (Großbuchstaben) und so weiter, bis das Modell eine vollständige Antwort generiert: „Die Hauptstadt Frankreichs ist Paris“ (Die Hauptstadt Frankreichs ist Paris).

Das zugrunde liegende Modell für die Zeitreihenvorhersage sollte sich an variable Kontexte (was das Modell beobachtet) und Bereichslängen (was das Abfragemodell vorhersagt) anpassen und gleichzeitig leistungsstark genug sein, um alle Muster aus großen vorab trainierten Datensätzen (Mustern) zu kodieren.

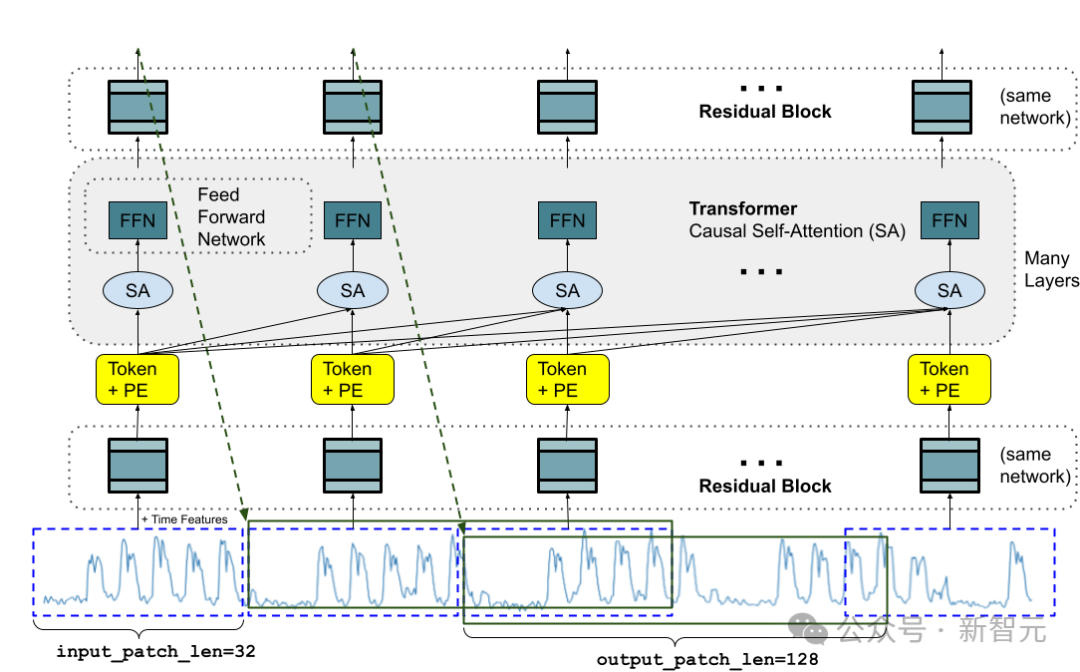

Ähnlich wie bei LLMs verwenden Forscher gestapelte Transformer-Schichten (Selbstaufmerksamkeits- und Feed-Forward-Schichten) als Hauptbausteine des TimesFM-Modells Kontinuierlicher Zeitpunkt) als Token verwendet wird, stammt die Idee aus neueren Langzeitprognosearbeiten: Die spezifische Aufgabe besteht darin, den (i+1)-ten Zeitpunkt für eine gegebene i-te Ausgabe am Ende des gestapelten Transformer-Layer-Patches vorherzusagen

Aber TimesFM weist mehrere wesentliche Unterschiede zu Sprachmodellen auf:

1 Das Modell erfordert einen mehrschichtigen Perzeptronblock mit Restverbindungen, um die Zeitreihen-Patches in Token umzuwandeln, die mit der Positionskodierung ( PE) zusammen mit der Eingabe in die Transformer-Schicht. Zu diesem Zweck verwenden wir Restblöcke, ähnlich wie bei unserer vorherigen Arbeit in der Langzeitvorhersage.

2. Das Ausgabe-Token des gestapelten Transformers kann verwendet werden, um die Länge nachfolgender Zeitpunkte vorherzusagen, die länger als die Eingabe-Patch-Länge ist, d. h. die Ausgabe-Patch-Länge kann größer als die Eingabe-Patch-Länge sein.

Angenommen, eine Zeitreihe mit einer Länge von 512 Zeitpunkten wird verwendet, um ein TimesFM-Modell mit „Eingabe-Patch-Länge 32“ und „Ausgabe-Patch-Länge 128“ zu trainieren:

Während des Trainings wird das Modell trainiert Zur gleichen Zeit: Um die nächsten 128 Zeitpunkte anhand der ersten 32 Zeitpunkte vorherzusagen, verwenden Sie die ersten 64 Zeitpunkte, um die Zeitpunkte 65 bis 192 vorherzusagen, verwenden Sie die ersten 96 Zeitpunkte, um die Zeitpunkte 97 bis 224 vorherzusagen, und so weiter.

Unter der Annahme, dass es sich bei den Eingabedaten um eine Zeitreihe der Länge 256 handelt und ihre Aufgabe darin besteht, die nächsten 256 Zeitpunkte in der Zukunft vorherzusagen, generiert das Modell zunächst Zukunftsvorhersagen für die Zeitpunkte 257 bis 384 und übernimmt dann die anfänglichen 256 Längeneingabe plus Die generierte Ausgabe ist an die Generierung der Zeitpunkte 385 bis 512 gebunden.

Wenn andererseits im Modell die Ausgabe-Patch-Länge gleich der Eingabe-Patch-Länge 32 ist, dann durchläuft das Modell für dieselbe Aufgabe acht Generierungsschritte statt zwei, was das Risiko einer Fehlerakkumulation erhöht und daher in den experimentellen Ergebnissen. Wie in zu sehen ist, führt eine längere Ausgabe-Patch-Länge zu einer besseren langfristigen Vorhersageleistung.

Daten vor dem Training

So wie LLMs mit mehr Token besser werden können, benötigt TimesFM große Mengen legitimer Zeitreihendaten, um zu lernen und sich zu verbessern; Forscher verbringen viel Zeit mit der Erstellung und Auswertung von Trainingsdatensätzen und haben zwei bessere Methoden gefunden :

Synthetische Daten helfen bei den Grundlagen

Sie können statistische Modelle oder physikalische Simulationen verwenden, um aussagekräftige synthetische Zeitreihendaten zu generieren. Grundsätzlich kann das zeitliche Muster das Modell beim Erlernen der Grammatik der Zeitreihenvorhersage unterstützen.

Daten aus der realen Welt verleihen dem Ganzen eine Atmosphäre aus der realen Welt

Forscher durchforsteten verfügbare öffentliche Zeitreihendatensätze und kombinierten selektiv 100 Milliarden Zeitpunkte. Es wurde ein großer Korpus von Zeitpunkten zusammengestellt.

Im Datensatz gibt es Seitenaufrufe von Google Trends und Wikipedia, die verfolgen, woran Benutzer interessiert sind, und die Trends und Muster vieler anderer realer Zeitreihen gut widerspiegeln, was TimesFM dabei hilft, das Gesamtbild zu verstehen kann die Generalisierungsleistung für „domänenspezifische Kontexte, die während des Trainings nicht gesehen wurden“ verbessern.

Ergebnisse der Nullstichprobenauswertung

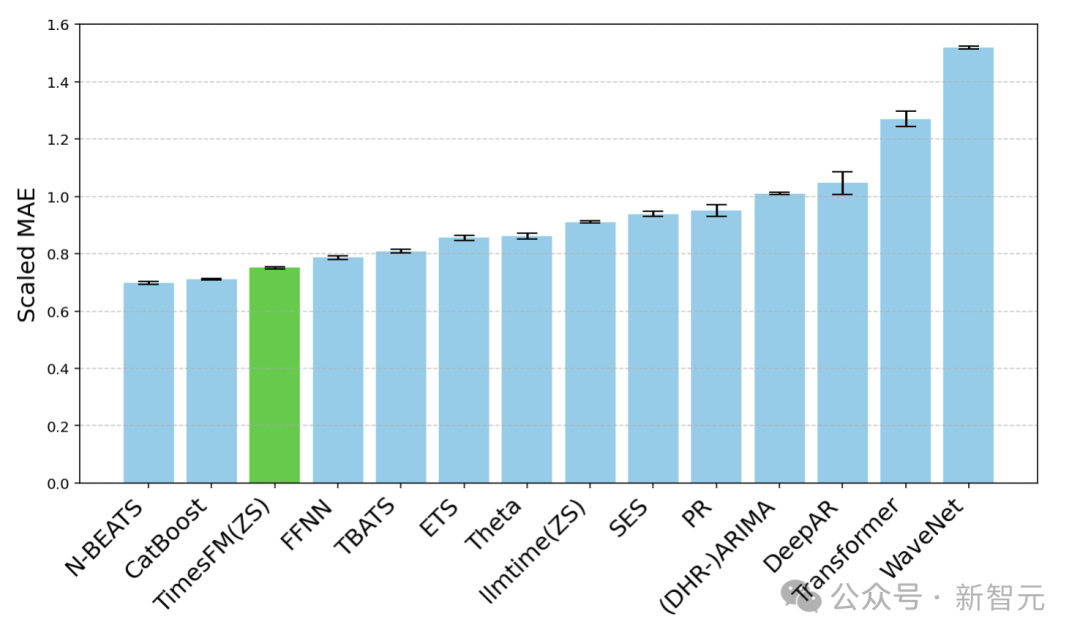

Die Forscher führten eine Nullstichprobenauswertung von TimesFM anhand von Daten durch, die während des Trainings nicht sichtbar waren, und verwendeten dazu einen häufig verwendeten Zeitreihen-Benchmark. Dabei wurde beobachtet, dass TimesFM die meisten statistischen Methoden wie ARIMA, ETS, und kann mit leistungsstarken DL-Modellen wie DeepAR und PatchTST mithalten oder diese übertreffen, die explizit auf Zielzeitreihen trainiert wurden.

Die Forscher verwendeten das Monash Forecasting Archive, um die sofort einsatzbereite Leistung von TimesFM zu bewerten, einem Datensatz, der Zehntausende Zeitreihen aus verschiedenen Bereichen wie Verkehrs-, Wetter- und Nachfrageprognosen enthält und Frequenzen von Minuten abdeckt zu jährlichen Daten.

Basierend auf vorhandener Literatur untersuchten die Forscher den mittleren absoluten Fehler (MAE), der entsprechend skaliert wurde, um den Durchschnitt über den Datensatz zu ermitteln.

Wie man sehen kann, übertrifft Zero-Shot (ZS) TimesFM die meisten überwachten Methoden, einschließlich neuerer Deep-Learning-Modelle. TimesFM und GPT-3.5 wurden auch für die Vorhersage unter Verwendung der von llmtime (ZS) vorgeschlagenen spezifischen Hinweistechnologie verglichen, und die Ergebnisse zeigten, dass TimesFM eine bessere Leistung als llmtime (ZS) erbrachte ) Verhältnis MAE zu anderen überwachten und Zero-Shot-Methoden (niedriger ist besser)

Die meisten Monash-Datensätze sind kurz- oder mittelfristig, was bedeutet, dass die Vorhersagedauer nicht zu lang ist. TimesFM wurde auch anhand häufig verwendeter Benchmarks getestet Langzeitprognosen sind die hochmoderne Basislinie PatchTST (und andere Basislinien für Langzeitprognosen).

Die meisten Monash-Datensätze sind kurz- oder mittelfristig, was bedeutet, dass die Vorhersagedauer nicht zu lang ist. TimesFM wurde auch anhand häufig verwendeter Benchmarks getestet Langzeitprognosen sind die hochmoderne Basislinie PatchTST (und andere Basislinien für Langzeitprognosen).

Die Forscher zeichneten die MAE auf dem ETT-Datensatz für die Aufgabe auf, 96 und 192 Zeitpunkte in der Zukunft vorherzusagen, und berechneten die Metrik im letzten Testfenster jedes Datensatzes. ( ZS) und entspricht dem eines überwachten PatchTST-Modells, das explizit auf den entsprechenden Datensatz trainiert wurde.

Fazit

Die Forscher trainierten ein reines Decoder-Basismodell unter Verwendung eines großen vorab trainierten Korpus von 100 Milliarden realen Zeitpunkten, bei denen es sich größtenteils um Suchinteressen-Zeitreihendaten aus Google Trends und Seiten aus Wikipedia-Ansichten handelte.

Die Ergebnisse zeigen, dass selbst ein relativ kleines vorab trainiertes Modell mit 200 M Parametern unter Verwendung der TimesFM-Architektur in verschiedenen öffentlichen Benchmarks (verschiedene Domänen und Granularitäten) eine recht gute Zero-Shot-Leistung aufweist.

Das obige ist der detaillierte Inhalt vonMit nur 200 Millionen Parametern übertrifft die Leistung bei Nullabtastungen die überwachter Leistung! Google veröffentlicht das grundlegende Zeitreihenvorhersagemodell TimesFM. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1359

1359

52

52

Open Source! Jenseits von ZoeDepth! DepthFM: Schnelle und genaue monokulare Tiefenschätzung!

Apr 03, 2024 pm 12:04 PM

Open Source! Jenseits von ZoeDepth! DepthFM: Schnelle und genaue monokulare Tiefenschätzung!

Apr 03, 2024 pm 12:04 PM

0.Was bewirkt dieser Artikel? Wir schlagen DepthFM vor: ein vielseitiges und schnelles generatives monokulares Tiefenschätzungsmodell auf dem neuesten Stand der Technik. Zusätzlich zu herkömmlichen Tiefenschätzungsaufgaben demonstriert DepthFM auch hochmoderne Fähigkeiten bei nachgelagerten Aufgaben wie dem Tiefen-Inpainting. DepthFM ist effizient und kann Tiefenkarten innerhalb weniger Inferenzschritte synthetisieren. Lassen Sie uns diese Arbeit gemeinsam lesen ~ 1. Titel der Papierinformationen: DepthFM: FastMonocularDepthEstimationwithFlowMatching Autor: MingGui, JohannesS.Fischer, UlrichPrestel, PingchuanMa, Dmytr

Das weltweit leistungsstärkste Open-Source-MoE-Modell ist da, mit chinesischen Fähigkeiten, die mit GPT-4 vergleichbar sind, und der Preis beträgt nur fast ein Prozent von GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Das weltweit leistungsstärkste Open-Source-MoE-Modell ist da, mit chinesischen Fähigkeiten, die mit GPT-4 vergleichbar sind, und der Preis beträgt nur fast ein Prozent von GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Stellen Sie sich ein Modell der künstlichen Intelligenz vor, das nicht nur die Fähigkeit besitzt, die traditionelle Datenverarbeitung zu übertreffen, sondern auch eine effizientere Leistung zu geringeren Kosten erzielt. Dies ist keine Science-Fiction, DeepSeek-V2[1], das weltweit leistungsstärkste Open-Source-MoE-Modell, ist da. DeepSeek-V2 ist ein leistungsstarkes MoE-Sprachmodell (Mix of Experts) mit den Merkmalen eines wirtschaftlichen Trainings und einer effizienten Inferenz. Es besteht aus 236B Parametern, von denen 21B zur Aktivierung jedes Markers verwendet werden. Im Vergleich zu DeepSeek67B bietet DeepSeek-V2 eine stärkere Leistung, spart gleichzeitig 42,5 % der Trainingskosten, reduziert den KV-Cache um 93,3 % und erhöht den maximalen Generierungsdurchsatz auf das 5,76-fache. DeepSeek ist ein Unternehmen, das sich mit allgemeiner künstlicher Intelligenz beschäftigt

KAN, das MLP ersetzt, wurde durch Open-Source-Projekte auf Faltung erweitert

Jun 01, 2024 pm 10:03 PM

KAN, das MLP ersetzt, wurde durch Open-Source-Projekte auf Faltung erweitert

Jun 01, 2024 pm 10:03 PM

Anfang dieses Monats schlugen Forscher des MIT und anderer Institutionen eine vielversprechende Alternative zu MLP vor – KAN. KAN übertrifft MLP in Bezug auf Genauigkeit und Interpretierbarkeit. Und es kann MLP, das mit einer größeren Anzahl von Parametern ausgeführt wird, mit einer sehr kleinen Anzahl von Parametern übertreffen. Beispielsweise gaben die Autoren an, dass sie KAN nutzten, um die Ergebnisse von DeepMind mit einem kleineren Netzwerk und einem höheren Automatisierungsgrad zu reproduzieren. Konkret verfügt DeepMinds MLP über etwa 300.000 Parameter, während KAN nur etwa 200 Parameter hat. KAN hat eine starke mathematische Grundlage wie MLP und basiert auf dem universellen Approximationssatz, während KAN auf dem Kolmogorov-Arnold-Darstellungssatz basiert. Wie in der folgenden Abbildung gezeigt, hat KAN

Hallo, elektrischer Atlas! Der Boston Dynamics-Roboter erwacht wieder zum Leben, seltsame 180-Grad-Bewegungen machen Musk Angst

Apr 18, 2024 pm 07:58 PM

Hallo, elektrischer Atlas! Der Boston Dynamics-Roboter erwacht wieder zum Leben, seltsame 180-Grad-Bewegungen machen Musk Angst

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas tritt offiziell in die Ära der Elektroroboter ein! Gestern hat sich der hydraulische Atlas einfach „unter Tränen“ von der Bühne der Geschichte zurückgezogen. Heute gab Boston Dynamics bekannt, dass der elektrische Atlas im Einsatz ist. Es scheint, dass Boston Dynamics im Bereich kommerzieller humanoider Roboter entschlossen ist, mit Tesla zu konkurrieren. Nach der Veröffentlichung des neuen Videos wurde es innerhalb von nur zehn Stunden bereits von mehr als einer Million Menschen angesehen. Die alten Leute gehen und neue Rollen entstehen. Das ist eine historische Notwendigkeit. Es besteht kein Zweifel, dass dieses Jahr das explosive Jahr der humanoiden Roboter ist. Netizens kommentierten: Die Weiterentwicklung der Roboter hat dazu geführt, dass die diesjährige Eröffnungsfeier wie Menschen aussieht, und der Freiheitsgrad ist weitaus größer als der von Menschen. Aber ist das wirklich kein Horrorfilm? Zu Beginn des Videos liegt Atlas ruhig auf dem Boden, scheinbar auf dem Rücken. Was folgt, ist atemberaubend

KI untergräbt die mathematische Forschung! Der Gewinner der Fields-Medaille und der chinesisch-amerikanische Mathematiker führten 11 hochrangige Arbeiten an | Gefällt mir bei Terence Tao

Apr 09, 2024 am 11:52 AM

KI untergräbt die mathematische Forschung! Der Gewinner der Fields-Medaille und der chinesisch-amerikanische Mathematiker führten 11 hochrangige Arbeiten an | Gefällt mir bei Terence Tao

Apr 09, 2024 am 11:52 AM

KI verändert tatsächlich die Mathematik. Vor kurzem hat Tao Zhexuan, der diesem Thema große Aufmerksamkeit gewidmet hat, die neueste Ausgabe des „Bulletin of the American Mathematical Society“ (Bulletin der American Mathematical Society) weitergeleitet. Zum Thema „Werden Maschinen die Mathematik verändern?“ äußerten viele Mathematiker ihre Meinung. Der gesamte Prozess war voller Funken, knallhart und aufregend. Der Autor verfügt über eine starke Besetzung, darunter der Fields-Medaillengewinner Akshay Venkatesh, der chinesische Mathematiker Zheng Lejun, der NYU-Informatiker Ernest Davis und viele andere bekannte Wissenschaftler der Branche. Die Welt der KI hat sich dramatisch verändert. Viele dieser Artikel wurden vor einem Jahr eingereicht.

Die Vitalität der Superintelligenz erwacht! Aber mit der Einführung der sich selbst aktualisierenden KI müssen sich Mütter keine Sorgen mehr über Datenengpässe machen

Apr 29, 2024 pm 06:55 PM

Die Vitalität der Superintelligenz erwacht! Aber mit der Einführung der sich selbst aktualisierenden KI müssen sich Mütter keine Sorgen mehr über Datenengpässe machen

Apr 29, 2024 pm 06:55 PM

Ich weine zu Tode. Die Daten im Internet reichen überhaupt nicht aus. Das Trainingsmodell sieht aus wie „Die Tribute von Panem“, und KI-Forscher auf der ganzen Welt machen sich Gedanken darüber, wie sie diese datenhungrigen Esser ernähren sollen. Dieses Problem tritt insbesondere bei multimodalen Aufgaben auf. Zu einer Zeit, als sie ratlos waren, nutzte ein Start-up-Team der Abteilung der Renmin-Universität von China sein eigenes neues Modell, um als erstes in China einen „modellgenerierten Datenfeed selbst“ in die Realität umzusetzen. Darüber hinaus handelt es sich um einen zweigleisigen Ansatz auf der Verständnisseite und der Generierungsseite. Beide Seiten können hochwertige, multimodale neue Daten generieren und Datenrückmeldungen an das Modell selbst liefern. Was ist ein Modell? Awaker 1.0, ein großes multimodales Modell, das gerade im Zhongguancun-Forum erschienen ist. Wer ist das Team? Sophon-Motor. Gegründet von Gao Yizhao, einem Doktoranden an der Hillhouse School of Artificial Intelligence der Renmin University.

Die Kuaishou-Version von Sora „Ke Ling' steht zum Testen offen: Sie generiert über 120 Sekunden Videos, versteht die Physik besser und kann komplexe Bewegungen genau modellieren

Jun 11, 2024 am 09:51 AM

Die Kuaishou-Version von Sora „Ke Ling' steht zum Testen offen: Sie generiert über 120 Sekunden Videos, versteht die Physik besser und kann komplexe Bewegungen genau modellieren

Jun 11, 2024 am 09:51 AM

Was? Wird Zootopia durch heimische KI in die Realität umgesetzt? Zusammen mit dem Video wird ein neues groß angelegtes inländisches Videogenerationsmodell namens „Keling“ vorgestellt. Sora geht einen ähnlichen technischen Weg und kombiniert eine Reihe selbst entwickelter technologischer Innovationen, um Videos zu produzieren, die nicht nur große und vernünftige Bewegungen aufweisen, sondern auch die Eigenschaften der physischen Welt simulieren und über starke konzeptionelle Kombinationsfähigkeiten und Vorstellungskraft verfügen. Den Daten zufolge unterstützt Keling die Erstellung ultralanger Videos von bis zu 2 Minuten mit 30 Bildern pro Sekunde, mit Auflösungen von bis zu 1080p und unterstützt mehrere Seitenverhältnisse. Ein weiterer wichtiger Punkt ist, dass es sich bei Keling nicht um eine vom Labor veröffentlichte Demo oder Video-Ergebnisdemonstration handelt, sondern um eine Anwendung auf Produktebene, die von Kuaishou, einem führenden Anbieter im Bereich Kurzvideos, gestartet wurde. Darüber hinaus liegt das Hauptaugenmerk darauf, pragmatisch zu sein, keine Blankoschecks auszustellen und sofort nach der Veröffentlichung online zu gehen. Das große Modell von Ke Ling wurde bereits in Kuaiying veröffentlicht.

Die U.S. Air Force präsentiert ihren ersten KI-Kampfjet mit großem Aufsehen! Der Minister führte die Testfahrt persönlich durch, ohne in den gesamten Prozess einzugreifen, und 100.000 Codezeilen wurden 21 Mal getestet.

May 07, 2024 pm 05:00 PM

Die U.S. Air Force präsentiert ihren ersten KI-Kampfjet mit großem Aufsehen! Der Minister führte die Testfahrt persönlich durch, ohne in den gesamten Prozess einzugreifen, und 100.000 Codezeilen wurden 21 Mal getestet.

May 07, 2024 pm 05:00 PM

Kürzlich wurde die Militärwelt von der Nachricht überwältigt: US-Militärkampfflugzeuge können jetzt mithilfe von KI vollautomatische Luftkämpfe absolvieren. Ja, erst kürzlich wurde der KI-Kampfjet des US-Militärs zum ersten Mal der Öffentlichkeit zugänglich gemacht und sein Geheimnis gelüftet. Der vollständige Name dieses Jägers lautet „Variable Stability Simulator Test Aircraft“ (VISTA). Er wurde vom Minister der US-Luftwaffe persönlich geflogen, um einen Eins-gegen-eins-Luftkampf zu simulieren. Am 2. Mai startete US-Luftwaffenminister Frank Kendall mit einer X-62AVISTA auf der Edwards Air Force Base. Beachten Sie, dass während des einstündigen Fluges alle Flugaktionen autonom von der KI durchgeführt wurden! Kendall sagte: „In den letzten Jahrzehnten haben wir über das unbegrenzte Potenzial des autonomen Luft-Luft-Kampfes nachgedacht, aber es schien immer unerreichbar.“ Nun jedoch,