Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Drei Geheimnisse für die Bereitstellung großer Modelle in der Cloud

Drei Geheimnisse für die Bereitstellung großer Modelle in der Cloud

Drei Geheimnisse für die Bereitstellung großer Modelle in der Cloud

51CTO Technology Stack (WeChat ID: blog51cto) . Ich fange an, serverloses Cloud Computing zu vermissen. Ihre Anwendungen reichen von der Verbesserung der Konversations-KI bis hin zur Bereitstellung komplexer Analyselösungen für verschiedene Branchen und vielen anderen Funktionen. Viele Unternehmen setzen diese Modelle auf Cloud-Plattformen ein, da öffentliche Cloud-Anbieter bereits ein fertiges Ökosystem bereitstellen und dies der Weg des geringsten Widerstands ist. Allerdings ist es nicht billig.

Die Cloud bietet darüber hinaus weitere Vorteile wie Skalierbarkeit, Effizienz und erweiterte Rechenleistung (GPUs auf Abruf). Der Prozess der Bereitstellung von LLM auf einer öffentlichen Cloud-Plattform birgt einige wenig bekannte Geheimnisse, die einen erheblichen Einfluss auf Erfolg oder Misserfolg haben können. Vielleicht weil es nicht viele KI-Experten gibt, die sich mit LLMs befassen, und weil wir noch nicht viel Erfahrung in diesem Bereich haben, gibt es viele Lücken in unserem Wissenssystem.

Die Cloud bietet darüber hinaus weitere Vorteile wie Skalierbarkeit, Effizienz und erweiterte Rechenleistung (GPUs auf Abruf). Der Prozess der Bereitstellung von LLM auf einer öffentlichen Cloud-Plattform birgt einige wenig bekannte Geheimnisse, die einen erheblichen Einfluss auf Erfolg oder Misserfolg haben können. Vielleicht weil es nicht viele KI-Experten gibt, die sich mit LLMs befassen, und weil wir noch nicht viel Erfahrung in diesem Bereich haben, gibt es viele Lücken in unserem Wissenssystem.

Hilfreich sind Orchestrierungstools, die eine zustandsbehaftete Bereitstellung unterstützen (z. B. Kubernetes). Sie können persistente Speicheroptionen für große Sprachmodelle nutzen und so konfiguriert werden, dass sie ihren Status über Sitzungen hinweg beibehalten und bearbeiten. Dies ist erforderlich, um die Kontinuität und Leistung großer Sprachmodelle zu unterstützen.

Angesichts des explosionsartigen Wachstums der generativen künstlichen Intelligenz ist die Bereitstellung großer Sprachmodelle auf Cloud-Plattformen eine Selbstverständlichkeit. Für die meisten Unternehmen ist es einfach zu umständlich, die Cloud nicht zu nutzen. Meine Sorge wegen der daraus resultierenden Hektik ist, dass wir einige leicht lösbare Probleme übersehen und große und teure Fehler machen, die am Ende größtenteils vermeidbar sind.

Um mehr über AIGC zu erfahren, besuchen Sie bitte:

51CTO AI.x Community

https://www.51cto.com/aigc/

Das obige ist der detaillierte Inhalt vonDrei Geheimnisse für die Bereitstellung großer Modelle in der Cloud. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1377

1377

52

52

Tokenisierung in einem Artikel verstehen!

Apr 12, 2024 pm 02:31 PM

Tokenisierung in einem Artikel verstehen!

Apr 12, 2024 pm 02:31 PM

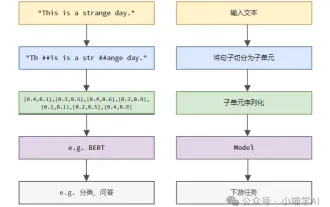

Sprachmodelle basieren auf Text, der normalerweise in Form von Zeichenfolgen vorliegt. Da die Eingabe in das Modell jedoch nur Zahlen sein kann, muss der Text in eine numerische Form umgewandelt werden. Die Tokenisierung ist eine grundlegende Aufgabe der Verarbeitung natürlicher Sprache. Sie kann eine fortlaufende Textsequenz (z. B. Sätze, Absätze usw.) entsprechend den spezifischen Anforderungen in eine Zeichenfolge (z. B. Wörter, Phrasen, Zeichen, Satzzeichen usw.) unterteilen. Die darin enthaltenen Einheiten werden als Token oder Wort bezeichnet. Gemäß dem in der Abbildung unten gezeigten spezifischen Prozess werden die Textsätze zunächst in Einheiten unterteilt, dann werden die einzelnen Elemente digitalisiert (in Vektoren abgebildet), dann werden diese Vektoren zur Codierung in das Modell eingegeben und schließlich an nachgelagerte Aufgaben ausgegeben erhalten Sie weiterhin das Endergebnis. Die Textsegmentierung kann entsprechend der Granularität der Textsegmentierung in Toke unterteilt werden.

So nutzen Sie Vue zur Datenverschlüsselung und sicheren Übertragung

Aug 02, 2023 pm 02:58 PM

So nutzen Sie Vue zur Datenverschlüsselung und sicheren Übertragung

Aug 02, 2023 pm 02:58 PM

So verwenden Sie Vue zur Datenverschlüsselung und sicheren Übertragung. Einführung: Mit der Entwicklung des Internets hat die Datensicherheit immer mehr Aufmerksamkeit erhalten. Bei der Entwicklung von Webanwendungen sind Datenverschlüsselung und sichere Übertragung wichtige Mittel zum Schutz der Privatsphäre und sensibler Informationen der Benutzer. Als beliebtes JavaScript-Framework bietet Vue eine Fülle von Tools und Plug-Ins, die uns bei der Datenverschlüsselung und sicheren Übertragung helfen können. In diesem Artikel wird die Verwendung von Vue zur Datenverschlüsselung und sicheren Übertragung vorgestellt und Codebeispiele als Referenz bereitgestellt. 1. Datenverschlüsselung und Datenverschlüsselung

Effiziente Parameter-Feinabstimmung umfangreicher Sprachmodelle – BitFit/Prefix/Prompt-Feinabstimmungsserie

Oct 07, 2023 pm 12:13 PM

Effiziente Parameter-Feinabstimmung umfangreicher Sprachmodelle – BitFit/Prefix/Prompt-Feinabstimmungsserie

Oct 07, 2023 pm 12:13 PM

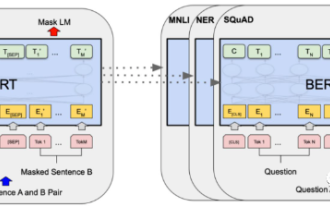

Im Jahr 2018 veröffentlichte Google BERT. Nach seiner Veröffentlichung übertraf es die State-of-the-Art-Ergebnisse (Sota) von 11 NLP-Aufgaben und stellte damit einen neuen Meilenstein in der NLP-Welt dar In der Abbildung unten ist der Trainingsprozess des BERT-Modells dargestellt, rechts der Feinabstimmungsprozess für bestimmte Aufgaben. Unter anderem dient die Feinabstimmungsphase der Feinabstimmung, wenn sie anschließend in einigen nachgelagerten Aufgaben verwendet wird, wie z. B. Textklassifizierung, Wortartkennzeichnung, Frage- und Antwortsysteme usw. BERT kann auf verschiedene Arten feinabgestimmt werden Aufgaben ohne Anpassung der Struktur. Durch das Aufgabendesign „vorab trainiertes Sprachmodell + Feinabstimmung der nachgelagerten Aufgabe“ werden leistungsstarke Modelleffekte erzielt. Seitdem ist „Sprachmodell vor dem Training + Feinabstimmung der nachgelagerten Aufgabe“ zum Mainstream-Training im NLP-Bereich geworden.

Um ein neues wissenschaftliches und komplexes Frage-Antwort-Benchmark- und Bewertungssystem für große Modelle bereitzustellen, haben UNSW, Argonne, die University of Chicago und andere Institutionen gemeinsam das SciQAG-Framework eingeführt

Jul 25, 2024 am 06:42 AM

Um ein neues wissenschaftliches und komplexes Frage-Antwort-Benchmark- und Bewertungssystem für große Modelle bereitzustellen, haben UNSW, Argonne, die University of Chicago und andere Institutionen gemeinsam das SciQAG-Framework eingeführt

Jul 25, 2024 am 06:42 AM

Herausgeber | Der Frage-Antwort-Datensatz (QA) von ScienceAI spielt eine entscheidende Rolle bei der Förderung der Forschung zur Verarbeitung natürlicher Sprache (NLP). Hochwertige QS-Datensätze können nicht nur zur Feinabstimmung von Modellen verwendet werden, sondern auch effektiv die Fähigkeiten großer Sprachmodelle (LLMs) bewerten, insbesondere die Fähigkeit, wissenschaftliche Erkenntnisse zu verstehen und zu begründen. Obwohl es derzeit viele wissenschaftliche QS-Datensätze aus den Bereichen Medizin, Chemie, Biologie und anderen Bereichen gibt, weisen diese Datensätze immer noch einige Mängel auf. Erstens ist das Datenformular relativ einfach, die meisten davon sind Multiple-Choice-Fragen. Sie sind leicht auszuwerten, schränken jedoch den Antwortauswahlbereich des Modells ein und können die Fähigkeit des Modells zur Beantwortung wissenschaftlicher Fragen nicht vollständig testen. Im Gegensatz dazu offene Fragen und Antworten

Drei Geheimnisse für die Bereitstellung großer Modelle in der Cloud

Apr 24, 2024 pm 03:00 PM

Drei Geheimnisse für die Bereitstellung großer Modelle in der Cloud

Apr 24, 2024 pm 03:00 PM

Zusammenstellung|Produziert von Ich fange an, serverloses Cloud Computing zu vermissen. Ihre Anwendungen reichen von der Verbesserung der Konversations-KI bis hin zur Bereitstellung komplexer Analyselösungen für verschiedene Branchen und vielen anderen Funktionen. Viele Unternehmen setzen diese Modelle auf Cloud-Plattformen ein, da öffentliche Cloud-Anbieter bereits ein fertiges Ökosystem bereitstellen und dies der Weg des geringsten Widerstands ist. Allerdings ist es nicht billig. Die Cloud bietet darüber hinaus weitere Vorteile wie Skalierbarkeit, Effizienz und erweiterte Rechenfunktionen (GPUs auf Anfrage verfügbar). Es gibt einige wenig bekannte Aspekte der Bereitstellung von LLM auf öffentlichen Cloud-Plattformen

RoSA: Eine neue Methode zur effizienten Feinabstimmung großer Modellparameter

Jan 18, 2024 pm 05:27 PM

RoSA: Eine neue Methode zur effizienten Feinabstimmung großer Modellparameter

Jan 18, 2024 pm 05:27 PM

Da Sprachmodelle in einem noch nie dagewesenen Ausmaß skaliert werden, wird eine umfassende Feinabstimmung für nachgelagerte Aufgaben unerschwinglich teuer. Um dieses Problem zu lösen, begannen Forscher, der PEFT-Methode Aufmerksamkeit zu schenken und sie zu übernehmen. Die Hauptidee der PEFT-Methode besteht darin, den Umfang der Feinabstimmung auf einen kleinen Satz von Parametern zu beschränken, um die Rechenkosten zu senken und gleichzeitig eine hochmoderne Leistung bei Aufgaben zum Verstehen natürlicher Sprache zu erzielen. Auf diese Weise können Forscher Rechenressourcen einsparen und gleichzeitig eine hohe Leistung aufrechterhalten, wodurch neue Forschungsschwerpunkte auf dem Gebiet der Verarbeitung natürlicher Sprache entstehen. RoSA ist eine neue PEFT-Technik, die durch Experimente mit einer Reihe von Benchmarks gezeigt hat, dass sie frühere Low-Rank-Adaptive- (LoRA) und reine Sparse-Feinabstimmungsmethoden mit demselben Parameterbudget übertrifft. Dieser Artikel wird näher darauf eingehen

Ein Artikel zum Verständnis der technischen Herausforderungen und Optimierungsstrategien für die Feinabstimmung großer Sprachmodelle

Mar 20, 2024 pm 11:01 PM

Ein Artikel zum Verständnis der technischen Herausforderungen und Optimierungsstrategien für die Feinabstimmung großer Sprachmodelle

Mar 20, 2024 pm 11:01 PM

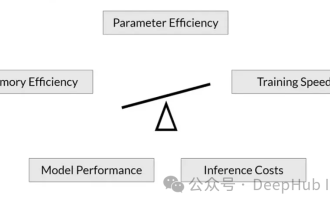

Hallo zusammen, mein Name ist Luga. Heute werden wir weiterhin Technologien im Ökosystem der künstlichen Intelligenz erforschen, insbesondere LLMFine-Tuning. In diesem Artikel wird die LLMFine-Tuning-Technologie weiterhin eingehend analysiert, um allen zu helfen, ihren Implementierungsmechanismus besser zu verstehen, damit sie besser auf die Marktentwicklung und andere Bereiche angewendet werden kann. LLMs (LargeLanguageModels) führen eine neue Welle der Technologie der künstlichen Intelligenz an. Diese fortschrittliche KI simuliert die menschlichen Wahrnehmungs- und Sprachfähigkeiten, indem sie riesige Datenmengen mithilfe statistischer Modelle analysiert, um komplexe Muster zwischen Wörtern und Phrasen zu lernen. Die leistungsstarken Funktionen von LLMs haben großes Interesse bei vielen führenden Unternehmen und Technologiebegeisterten geweckt, die sich beeilen, diese auf künstlicher Intelligenz basierenden Funktionen einzuführen

Den größten ViT der Geschichte bequem trainiert? Google aktualisiert das visuelle Sprachmodell PaLI: unterstützt mehr als 100 Sprachen

Apr 12, 2023 am 09:31 AM

Den größten ViT der Geschichte bequem trainiert? Google aktualisiert das visuelle Sprachmodell PaLI: unterstützt mehr als 100 Sprachen

Apr 12, 2023 am 09:31 AM

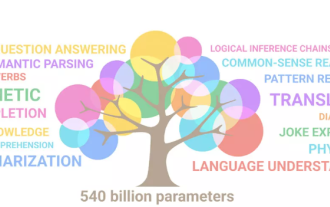

Der Fortschritt der Verarbeitung natürlicher Sprache ist in den letzten Jahren größtenteils auf groß angelegte Sprachmodelle zurückzuführen, die die Menge an Parametern und Trainingsdaten auf neue Höchstwerte bringen, und gleichzeitig werden die bestehenden Benchmark-Rankings geschlachtet! Beispielsweise veröffentlichte Google im April dieses Jahres das Sprachmodell PaLM (Pathways Language Model) mit 540 Milliarden Parametern, das Menschen in einer Reihe von Sprach- und Argumentationstests erfolgreich übertraf, insbesondere durch seine hervorragende Leistung in Lernszenarien mit wenigen Schüssen und kleinen Stichproben. PaLM gilt als Entwicklungsrichtung des Sprachmodells der nächsten Generation. Auf die gleiche Weise wirken visuelle Sprachmodelle tatsächlich Wunder, und die Leistung kann durch Erhöhen der Modellgröße verbessert werden. Natürlich, wenn es sich nur um ein multitaskingfähiges visuelles Sprachmodell handelt