Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Das multimodale Modell des Nationalen Volkskongresses bewegt sich in Richtung AGI: Es realisiert erstmals unabhängige Aktualisierungen und die Foto-Video-Generierung übertrifft Sora

Das multimodale Modell des Nationalen Volkskongresses bewegt sich in Richtung AGI: Es realisiert erstmals unabhängige Aktualisierungen und die Foto-Video-Generierung übertrifft Sora

Das multimodale Modell des Nationalen Volkskongresses bewegt sich in Richtung AGI: Es realisiert erstmals unabhängige Aktualisierungen und die Foto-Video-Generierung übertrifft Sora

Im Vergleich zum ChatImg-Sequenzmodell der vorherigen Generation der Sophon Engine übernimmt Awaker 1.0 eine neue MOE-Architektur und verfügt über unabhängige Aktualisierungsfunktionen. Es ist das erste multimodale große Modell in der Branche, das „echte“ Unabhängigkeit erreicht aktualisieren.

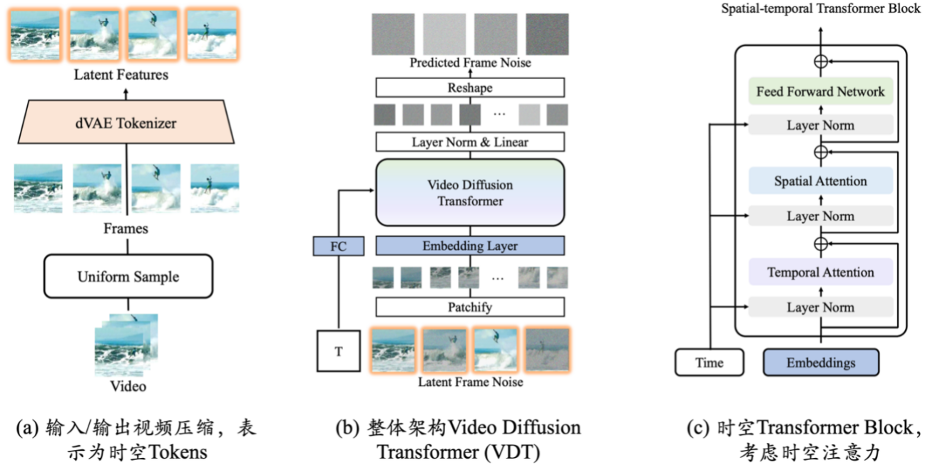

In Bezug auf die visuelle Generierung verwendet Awaker 1.0 eine vollständig selbst entwickelte Videogenerierungsbasis VDT, die bei der Generierung von Fotovideos bessere Ergebnisse als Sora erzielt und die Schwierigkeit der „letzten Meile“ bei der Landung großer Modelle überwindet.

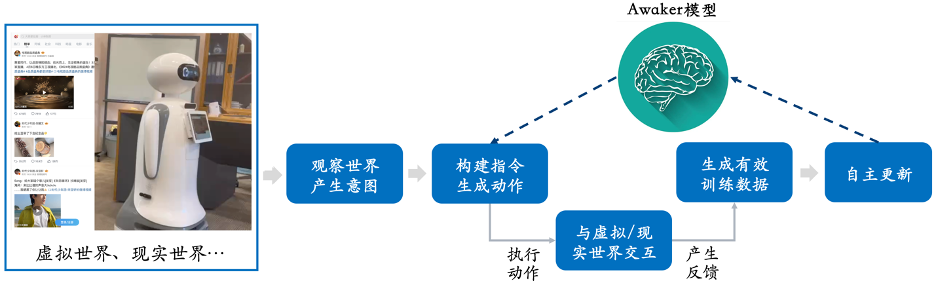

Awaker 1.0 ist ein multimodales großes Modell, das visuelles Verständnis und visuelle Generierung hervorragend integriert. Auf der Verständnisseite interagiert Awaker 1.0 mit der digitalen Welt und der realen Welt und gibt während der Aufgabenausführung Daten zum Szenenverhalten zurück, um eine kontinuierliche Aktualisierung und Schulung zu erreichen. Auf der Generierungsseite kann Awaker 1.0 hochwertige Multi-Daten generieren. Modaler Inhalt, Simulation der realen Welt und Bereitstellung weiterer Trainingsdaten für das verstehende Seitenmodell.

Awaker 1.0 ist ein multimodales großes Modell, das visuelles Verständnis und visuelle Generierung hervorragend integriert. Auf der Verständnisseite interagiert Awaker 1.0 mit der digitalen Welt und der realen Welt und gibt während der Aufgabenausführung Daten zum Szenenverhalten zurück, um eine kontinuierliche Aktualisierung und Schulung zu erreichen. Auf der Generierungsseite kann Awaker 1.0 hochwertige Multi-Daten generieren. Modaler Inhalt, Simulation der realen Welt und Bereitstellung weiterer Trainingsdaten für das verstehende Seitenmodell.

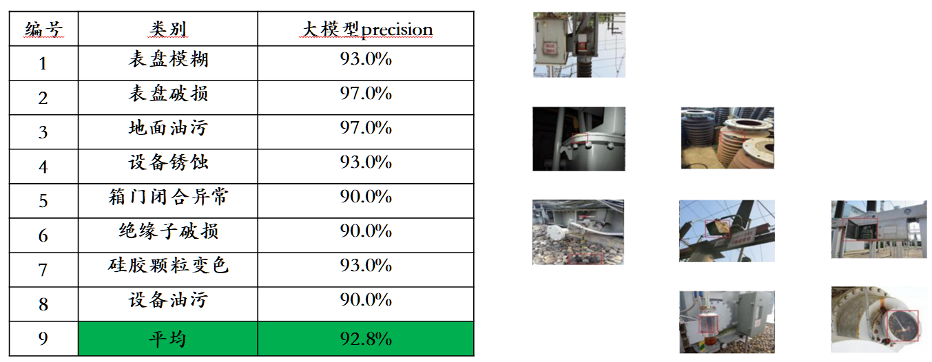

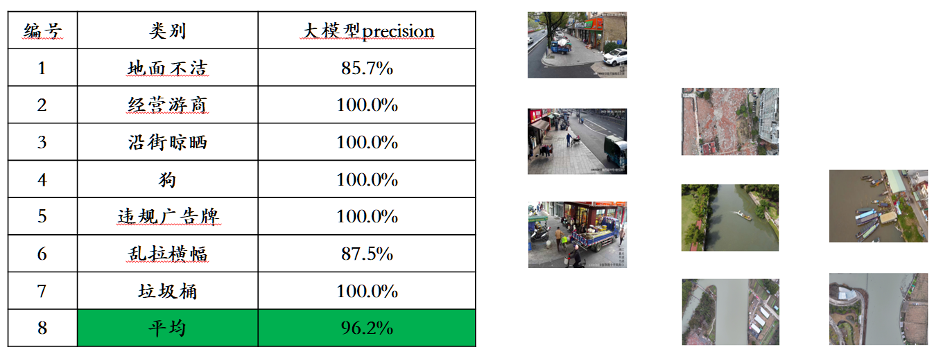

Besonders wichtig ist, dass Awaker 1.0 aufgrund seiner „echten“ autonomen Update-Fähigkeiten für ein breiteres Spektrum an Branchenszenarien geeignet ist und komplexere praktische Aufgaben lösen kann, wie z. B. AI Agent, verkörperte Intelligenz, umfassendes Management, und Sicherheitsinspektion usw.

Auf der Verständnisseite löst das Basismodell von Awaker 1.0 hauptsächlich das Problem schwerwiegender Konflikte im multimodalen Multitasking-Vortraining. Das Basismodell von Awaker 1.0 profitiert von der sorgfältig entwickelten Multitask-MOE-Architektur und kann nicht nur die Grundfunktionen des multimodalen Großmodells ChatImg der vorherigen Generation der Sophon Engine übernehmen, sondern auch die einzigartigen Fähigkeiten erlernen, die für jede multimodale Aufgabe erforderlich sind . Im Vergleich zum multimodalen Großmodell ChatImg der vorherigen Generation wurden die Basismodellfunktionen von Awaker 1.0 in mehreren Aufgaben erheblich verbessert.

Angesichts des Problems der Leckage von Bewertungsdaten in gängigen multimodalen Bewertungslisten haben wir strenge Standards übernommen, um unseren eigenen Bewertungssatz zu erstellen, in dem die meisten Testbilder aus persönlichen Mobiltelefonalben stammen. In diesem multimodalen Bewertungssatz führen wir eine faire manuelle Bewertung von Awaker 1.0 und den drei fortschrittlichsten multimodalen Großmodellen im In- und Ausland durch. Die detaillierten Bewertungsergebnisse sind in der folgenden Tabelle aufgeführt. Beachten Sie, dass GPT-4V und Intern-VL Erkennungsaufgaben nicht direkt unterstützen. Ihre Erkennungsergebnisse werden dadurch erhalten, dass das Modell die Objektorientierung mithilfe von Sprache beschreiben muss.

Wir haben festgestellt, dass das Basismodell von Awaker 1.0 GPT-4V, Qwen-VL-Max und Intern-VL bei der visuellen Beantwortung von Fragen und Geschäftsanwendungsaufgaben übertraf und gleichzeitig das nächstbeste Ergebnis erzielte. Insgesamt übertrifft die durchschnittliche Punktzahl von Awaker 1.0 die der drei fortschrittlichsten Modelle im In- und Ausland und bestätigt die Wirksamkeit der Multitasking-MOE-Architektur. Nachfolgend finden Sie einige konkrete Beispiele für vergleichende Analysen.

Wir haben festgestellt, dass das Basismodell von Awaker 1.0 GPT-4V, Qwen-VL-Max und Intern-VL bei der visuellen Beantwortung von Fragen und Geschäftsanwendungsaufgaben übertraf und gleichzeitig das nächstbeste Ergebnis erzielte. Insgesamt übertrifft die durchschnittliche Punktzahl von Awaker 1.0 die der drei fortschrittlichsten Modelle im In- und Ausland und bestätigt die Wirksamkeit der Multitasking-MOE-Architektur. Nachfolgend finden Sie einige konkrete Beispiele für vergleichende Analysen.

Einerseits erwarten die Menschen, dass die verkörperte Intelligenz anpassungsfähig ist, das heißt, der Agent kann sich durch kontinuierliches Lernen an sich ändernde Anwendungsumgebungen anpassen. Er kann nicht nur bekannte multimodale Aufgaben besser erledigen, sondern sich auch schnell anpassen zu multimodalen Aufgaben.

Andererseits erwarten die Menschen auch, dass verkörperte Intelligenz wirklich kreativ ist, in der Hoffnung, dass sie durch autonome Erkundung der Umwelt neue Strategien und Lösungen entdecken und die Grenzen der Fähigkeiten künstlicher Intelligenz erkunden kann. Durch die Verwendung multimodaler großer Modelle als „Gehirne“ der verkörperten Intelligenz haben wir das Potenzial, die Anpassungsfähigkeit und Kreativität der verkörperten Intelligenz dramatisch zu steigern und letztendlich die Schwelle von AGI zu erreichen (oder sogar AGI zu erreichen).

Es gibt jedoch zwei offensichtliche Probleme bei bestehenden großen multimodalen Modellen: Erstens ist der iterative Aktualisierungszyklus des Modells lang und erfordert große menschliche und finanzielle Investitionen; zweitens kommen die Trainingsdaten des Modells Aus vorhandenen Daten kann das Modell nicht kontinuierlich eine große Menge an neuem Wissen gewinnen. Obwohl die kontinuierliche Entstehung neuen Wissens auch durch RAG und langen Kontext eingebracht werden kann, lernt das multimodale große Modell selbst dieses neue Wissen nicht, und diese beiden Korrekturmethoden bringen auch zusätzliche Probleme mit sich.

Kurz gesagt, die aktuellen großen multimodalen Modelle sind in tatsächlichen Anwendungsszenarien nicht sehr anpassungsfähig, geschweige denn kreativ, was bei der Implementierung in der Branche zu verschiedenen Schwierigkeiten führt.

Der von Sophon Engine veröffentlichte Awaker 1.0 ist dieses Mal das weltweit erste multimodale Großmodell mit einem autonomen Aktualisierungsmechanismus, der als „Gehirn“ der verkörperten Intelligenz verwendet werden kann. Der autonome Aktualisierungsmechanismus von Awaker 1.0 umfasst drei Schlüsseltechnologien: aktive Datengenerierung, Modellreflexion und -bewertung sowie kontinuierliche Modellaktualisierung.

Der von Sophon Engine veröffentlichte Awaker 1.0 ist dieses Mal das weltweit erste multimodale Großmodell mit einem autonomen Aktualisierungsmechanismus, der als „Gehirn“ der verkörperten Intelligenz verwendet werden kann. Der autonome Aktualisierungsmechanismus von Awaker 1.0 umfasst drei Schlüsseltechnologien: aktive Datengenerierung, Modellreflexion und -bewertung sowie kontinuierliche Modellaktualisierung.

Anders als alle anderen großen multimodalen Modelle ist Awaker 1.0 „live“ und seine Parameter können kontinuierlich in Echtzeit aktualisiert werden.

Wie aus dem Rahmendiagramm oben ersichtlich ist, kann Awaker 1.0 mit verschiedenen intelligenten Geräten kombiniert werden, die Welt über intelligente Geräte beobachten, Handlungsabsichten generieren und automatisch Anweisungen erstellen, um intelligente Geräte zu steuern, um verschiedene Aktionen auszuführen. Intelligente Geräte generieren nach Abschluss verschiedener Aktionen automatisch verschiedene Rückmeldungen. Aus diesen Aktionen und Rückmeldungen kann Awaker 1.0 effektive Trainingsdaten zur kontinuierlichen Selbstaktualisierung abrufen und die verschiedenen Fähigkeiten des Modells kontinuierlich stärken.

Am Beispiel der Einspeisung neuen Wissens kann Awaker 1.0 kontinuierlich die neuesten Nachrichteninformationen im Internet lernen und auf der Grundlage der neu erlernten Nachrichteninformationen verschiedene komplexe Fragen beantworten. Im Gegensatz zu den herkömmlichen RAG- und Long-Context-Methoden kann Awaker 1.0 wirklich neues Wissen erlernen und sich die Parameter des Modells „merken“.

Die Anwendung der Transformer-Technologie auf die diffusionsbasierte Videogenerierung zeigt das große Potenzial von Transformer im Bereich der Videogenerierung. Der Vorteil von VDT ist seine hervorragende zeitabhängige Erfassungsfähigkeit, die die Erzeugung zeitlich kohärenter Videobilder ermöglicht, einschließlich der Simulation der physikalischen Dynamik dreidimensionaler Objekte im Zeitverlauf. Schlagen Sie einen einheitlichen räumlich-zeitlichen Maskenmodellierungsmechanismus vor, damit VDT eine Vielzahl von Videogenerierungsaufgaben bewältigen kann, und realisieren Sie so die breite Anwendung dieser Technologie. Die flexiblen bedingten Informationsverarbeitungsmethoden von VDT, wie z. B. einfaches Token-Space-Splicing, vereinheitlichen effektiv Informationen unterschiedlicher Länge und Modalitäten. Gleichzeitig ist VDT durch die Kombination mit dem räumlich-zeitlichen Maskenmodellierungsmechanismus zu einem universellen Videodiffusionswerkzeug geworden, das auf die bedingungslose Generierung, die Vorhersage nachfolgender Videobilder, die Bildinterpolation, bildgenerierende Videos und Videobilder angewendet werden kann, ohne die Daten zu ändern Modellstruktur. Fertigstellung und andere Videogenerierungsaufgaben.

Das obige ist der detaillierte Inhalt vonDas multimodale Modell des Nationalen Volkskongresses bewegt sich in Richtung AGI: Es realisiert erstmals unabhängige Aktualisierungen und die Foto-Video-Generierung übertrifft Sora. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1377

1377

52

52

Der DeepMind-Roboter spielt Tischtennis und seine Vor- und Rückhand rutschen in die Luft, wodurch menschliche Anfänger völlig besiegt werden

Aug 09, 2024 pm 04:01 PM

Der DeepMind-Roboter spielt Tischtennis und seine Vor- und Rückhand rutschen in die Luft, wodurch menschliche Anfänger völlig besiegt werden

Aug 09, 2024 pm 04:01 PM

Aber vielleicht kann er den alten Mann im Park nicht besiegen? Die Olympischen Spiele in Paris sind in vollem Gange und Tischtennis hat viel Aufmerksamkeit erregt. Gleichzeitig haben Roboter auch beim Tischtennisspielen neue Durchbrüche erzielt. Gerade hat DeepMind den ersten lernenden Roboteragenten vorgeschlagen, der das Niveau menschlicher Amateurspieler im Tischtennis-Wettkampf erreichen kann. Papieradresse: https://arxiv.org/pdf/2408.03906 Wie gut ist der DeepMind-Roboter beim Tischtennisspielen? Vermutlich auf Augenhöhe mit menschlichen Amateurspielern: Sowohl Vorhand als auch Rückhand: Der Gegner nutzt unterschiedliche Spielstile, und auch der Roboter hält aus: Aufschlagannahme mit unterschiedlichem Spin: Allerdings scheint die Intensität des Spiels nicht so intensiv zu sein wie Der alte Mann im Park. Für Roboter, Tischtennis

Die erste mechanische Klaue! Yuanluobao trat auf der Weltroboterkonferenz 2024 auf und stellte den ersten Schachroboter vor, der das Haus betreten kann

Aug 21, 2024 pm 07:33 PM

Die erste mechanische Klaue! Yuanluobao trat auf der Weltroboterkonferenz 2024 auf und stellte den ersten Schachroboter vor, der das Haus betreten kann

Aug 21, 2024 pm 07:33 PM

Am 21. August fand in Peking die Weltroboterkonferenz 2024 im großen Stil statt. Die Heimrobotermarke „Yuanluobot SenseRobot“ von SenseTime hat ihre gesamte Produktfamilie vorgestellt und kürzlich den Yuanluobot AI-Schachspielroboter – Chess Professional Edition (im Folgenden als „Yuanluobot SenseRobot“ bezeichnet) herausgebracht und ist damit der weltweit erste A-Schachroboter für heim. Als drittes schachspielendes Roboterprodukt von Yuanluobo hat der neue Guoxiang-Roboter eine Vielzahl spezieller technischer Verbesserungen und Innovationen in den Bereichen KI und Maschinenbau erfahren und erstmals die Fähigkeit erkannt, dreidimensionale Schachfiguren aufzunehmen B. durch mechanische Klauen an einem Heimroboter, und führen Sie Mensch-Maschine-Funktionen aus, z. B. Schach spielen, jeder spielt Schach, Überprüfung der Notation usw.

Claude ist auch faul geworden! Netizen: Lernen Sie, sich einen Urlaub zu gönnen

Sep 02, 2024 pm 01:56 PM

Claude ist auch faul geworden! Netizen: Lernen Sie, sich einen Urlaub zu gönnen

Sep 02, 2024 pm 01:56 PM

Der Schulstart steht vor der Tür und nicht nur die Schüler, die bald ins neue Semester starten, sollten auf sich selbst aufpassen, sondern auch die großen KI-Modelle. Vor einiger Zeit war Reddit voller Internetnutzer, die sich darüber beschwerten, dass Claude faul werde. „Sein Niveau ist stark gesunken, es kommt oft zu Pausen und sogar die Ausgabe wird sehr kurz. In der ersten Woche der Veröffentlichung konnte es ein komplettes 4-seitiges Dokument auf einmal übersetzen, aber jetzt kann es nicht einmal eine halbe Seite ausgeben.“ !

Auf der Weltroboterkonferenz wurde dieser Haushaltsroboter, der „die Hoffnung auf eine zukünftige Altenpflege' in sich trägt, umzingelt

Aug 22, 2024 pm 10:35 PM

Auf der Weltroboterkonferenz wurde dieser Haushaltsroboter, der „die Hoffnung auf eine zukünftige Altenpflege' in sich trägt, umzingelt

Aug 22, 2024 pm 10:35 PM

Auf der World Robot Conference in Peking ist die Präsentation humanoider Roboter zum absoluten Mittelpunkt der Szene geworden. Am Stand von Stardust Intelligent führte der KI-Roboterassistent S1 drei große Darbietungen mit Hackbrett, Kampfkunst und Kalligraphie auf Ein Ausstellungsbereich, der sowohl Literatur als auch Kampfkunst umfasst, zog eine große Anzahl von Fachpublikum und Medien an. Durch das elegante Spiel auf den elastischen Saiten demonstriert der S1 eine feine Bedienung und absolute Kontrolle mit Geschwindigkeit, Kraft und Präzision. CCTV News führte einen Sonderbericht über das Nachahmungslernen und die intelligente Steuerung hinter „Kalligraphie“ durch. Firmengründer Lai Jie erklärte, dass hinter den seidenweichen Bewegungen die Hardware-Seite die beste Kraftkontrolle und die menschenähnlichsten Körperindikatoren (Geschwindigkeit, Belastung) anstrebt. usw.), aber auf der KI-Seite werden die realen Bewegungsdaten von Menschen gesammelt, sodass der Roboter stärker werden kann, wenn er auf eine schwierige Situation stößt, und lernen kann, sich schnell weiterzuentwickeln. Und agil

Bekanntgabe der ACL 2024 Awards: Eines der besten Papers zum Thema Oracle Deciphering von HuaTech, GloVe Time Test Award

Aug 15, 2024 pm 04:37 PM

Bekanntgabe der ACL 2024 Awards: Eines der besten Papers zum Thema Oracle Deciphering von HuaTech, GloVe Time Test Award

Aug 15, 2024 pm 04:37 PM

Bei dieser ACL-Konferenz haben die Teilnehmer viel gewonnen. Die sechstägige ACL2024 findet in Bangkok, Thailand, statt. ACL ist die führende internationale Konferenz im Bereich Computerlinguistik und Verarbeitung natürlicher Sprache. Sie wird von der International Association for Computational Linguistics organisiert und findet jährlich statt. ACL steht seit jeher an erster Stelle, wenn es um akademischen Einfluss im Bereich NLP geht, und ist außerdem eine von der CCF-A empfohlene Konferenz. Die diesjährige ACL-Konferenz ist die 62. und hat mehr als 400 innovative Arbeiten im Bereich NLP eingereicht. Gestern Nachmittag gab die Konferenz den besten Vortrag und weitere Auszeichnungen bekannt. Diesmal gibt es 7 Best Paper Awards (zwei davon unveröffentlicht), 1 Best Theme Paper Award und 35 Outstanding Paper Awards. Die Konferenz verlieh außerdem drei Resource Paper Awards (ResourceAward) und einen Social Impact Award (

Hongmeng Smart Travel S9 und die umfassende Einführungskonferenz für neue Produkte wurden gemeinsam mit einer Reihe neuer Blockbuster-Produkte veröffentlicht

Aug 08, 2024 am 07:02 AM

Hongmeng Smart Travel S9 und die umfassende Einführungskonferenz für neue Produkte wurden gemeinsam mit einer Reihe neuer Blockbuster-Produkte veröffentlicht

Aug 08, 2024 am 07:02 AM

Heute Nachmittag begrüßte Hongmeng Zhixing offiziell neue Marken und neue Autos. Am 6. August veranstaltete Huawei die Hongmeng Smart Xingxing S9 und die Huawei-Konferenz zur Einführung neuer Produkte mit umfassendem Szenario und brachte die Panorama-Smart-Flaggschiff-Limousine Xiangjie S9, das neue M7Pro und Huawei novaFlip, MatePad Pro 12,2 Zoll, das neue MatePad Air und Huawei Bisheng mit Mit vielen neuen Smart-Produkten für alle Szenarien, darunter die Laserdrucker der X1-Serie, FreeBuds6i, WATCHFIT3 und der Smart Screen S5Pro, von Smart Travel über Smart Office bis hin zu Smart Wear baut Huawei weiterhin ein Smart-Ökosystem für alle Szenarien auf, um Verbrauchern ein Smart-Erlebnis zu bieten Internet von allem. Hongmeng Zhixing: Huawei arbeitet mit chinesischen Partnern aus der Automobilindustrie zusammen, um die Modernisierung der Smart-Car-Industrie voranzutreiben

Das Team von Li Feifei schlug ReKep vor, um Robotern räumliche Intelligenz zu verleihen und GPT-4o zu integrieren

Sep 03, 2024 pm 05:18 PM

Das Team von Li Feifei schlug ReKep vor, um Robotern räumliche Intelligenz zu verleihen und GPT-4o zu integrieren

Sep 03, 2024 pm 05:18 PM

Tiefe Integration von Vision und Roboterlernen. Wenn zwei Roboterhände reibungslos zusammenarbeiten, um Kleidung zu falten, Tee einzuschenken und Schuhe zu packen, gepaart mit dem humanoiden 1X-Roboter NEO, der in letzter Zeit für Schlagzeilen gesorgt hat, haben Sie vielleicht das Gefühl: Wir scheinen in das Zeitalter der Roboter einzutreten. Tatsächlich sind diese seidigen Bewegungen das Produkt fortschrittlicher Robotertechnologie + exquisitem Rahmendesign + multimodaler großer Modelle. Wir wissen, dass nützliche Roboter oft komplexe und exquisite Interaktionen mit der Umgebung erfordern und die Umgebung als Einschränkungen im räumlichen und zeitlichen Bereich dargestellt werden kann. Wenn Sie beispielsweise möchten, dass ein Roboter Tee einschenkt, muss der Roboter zunächst den Griff der Teekanne ergreifen und sie aufrecht halten, ohne den Tee zu verschütten, und ihn dann sanft bewegen, bis die Öffnung der Kanne mit der Öffnung der Tasse übereinstimmt , und neigen Sie dann die Teekanne in einem bestimmten Winkel. Das

KI im Einsatz |. Das verrückte KI-Spiel Amway des Microsoft-CEOs hat mich tausende Male gequält

Aug 14, 2024 am 12:00 AM

KI im Einsatz |. Das verrückte KI-Spiel Amway des Microsoft-CEOs hat mich tausende Male gequält

Aug 14, 2024 am 12:00 AM

Herausgeber des Machine Power Report: Yang Wen Die Welle der künstlichen Intelligenz, repräsentiert durch große Modelle und AIGC, hat unsere Art zu leben und zu arbeiten still und leise verändert, aber die meisten Menschen wissen immer noch nicht, wie sie sie nutzen sollen. Aus diesem Grund haben wir die Kolumne „KI im Einsatz“ ins Leben gerufen, um detailliert vorzustellen, wie KI durch intuitive, interessante und prägnante Anwendungsfälle für künstliche Intelligenz eingesetzt werden kann, und um das Denken aller anzuregen. Wir heißen Leser auch willkommen, innovative, praktische Anwendungsfälle einzureichen. Oh mein Gott, KI ist wirklich ein Genie geworden. In letzter Zeit ist es zu einem heißen Thema geworden, dass es schwierig ist, die Authentizität von KI-generierten Bildern zu erkennen. (Weitere Informationen finden Sie unter: KI im Einsatz | In drei Schritten zur KI-Schönheit werden und in einer Sekunde von der KI wieder in ihre ursprüngliche Form zurückgeprügelt werden) Neben der beliebten KI von Google Lady im Internet gibt es verschiedene FLUX-Generatoren entstanden auf sozialen Plattformen