Technology peripherals

Technology peripherals

AI

AI

Claude has become lazy too! Netizen: Learn to give yourself a holiday

Claude has become lazy too! Netizen: Learn to give yourself a holiday

Claude has become lazy too! Netizen: Learn to give yourself a holiday

The school year is about to start, and it is not only the students who are about to start the new semester who should be concerned, but also the large AI models.

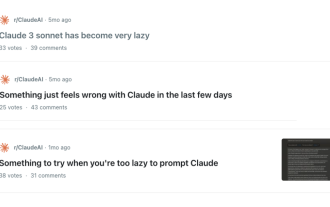

Some time ago, Reddit was filled with netizens complaining that Claude was getting lazy.

"Its level dropped a lot, it often paused, and even the output became very short. In the first week of release, it could translate an entire 4-page document at once , now I can’t even output half a page! 》

something_just_feels_wrong_with_claude_in_the/

In a post called "Completely disappointed with Claude", it excerpted the "Fifteen Sins" of Claude's "lazy".

Cause Claude’s Chief Information Security Officer Jason Clinton came out and replied: "Claude’s level has not declined!"

He said: "Our model is stored in a static file that does not change. This file is loaded to many servers, each running the same model and software. We have not changed any settings, so the model's There should be no change in performance. If you find any problem, you can give feedback by clicking on the answer. Currently, the number of likes has not increased, and there is no similar feedback from customers using Claude API. "

Why? "Becoming lazy", independent AI researcher @nearcyan gave an explanation: Claude regarded himself as a European and was giving himself a month's summer vacation! Although it sounds outrageous, he gave a series of evidence:

https://twitter.com/nearcyan/status/1829674215492161569

New system prompt word

First of all, Claude released a new system prompt word on July 12th. The system prompt words are equivalent to Claude's background knowledge. Claude will refer to this information, such as the current date, when replying to the user's questions. And August is Europe’s favorite holiday month. The foreign trade industry will see fewer orders in the summer because the entire Europe is enjoying a month-long summer vacation at this time.

Link: https://docs.anthropic.com/en/release-notes/system-prompts#claude-3-5-sonnet

Claude can cover working models of all nationalities

As a universal language model, Claude’s training data contains information from different countries and cultural backgrounds work habits and patterns, Claude has the ability to understand and model these work habits.

Therefore, when Claude’s system prompt contains “summer vacation date”, it may adjust its behavior based on what it has learned from training. For example, in August, many countries in Europe may have long vacations, and Claude may act lazy because it is simulating the work patterns of these countries.

E9P

The impact of post-training

클로드를 특정 응용 모델로 만들기 위해 Anthropic에서는 이에 대한 '사후 교육'을 실시했습니다. 이 단계는 특정 작업이나 데이터 세트를 통해 기본 LLM을 기반으로 모델을 추가로 조정하여 예상되는 동작이나 출력과 더 일치하도록 만드는 것입니다. @nearyan은 이러한 늦은 훈련으로 Claude가 일종의 "LLM 분지"에 놓이게 되었다고 제안합니다. 여기서 "분지"는 클로드가 어떤 측면에서는 유럽 스타일의 특성을 더 많이 나타냄을 나타내는 은유입니다.

유럽 지식 근로자의 행동 시뮬레이션

@nearyan은 Claude가 "시뮬레이션 프레임워크"를 기반으로 작업할 것이라고 추측합니다. 시뮬레이션 프레임워크는 Claude의 행동 패턴이 특정 유형의 인간 행동을 시뮬레이션(또는 재현)하여 생성된다는 것을 의미합니다. 이 프레임워크를 통해 Claude는 자신이 이해하는 특정 상황이나 입력을 기반으로 행동이나 반응을 모델링할 수 있습니다.

많은 유럽 국가에서 8월은 대개 휴가와 휴식의 성수기입니다. 이 기간 동안 많은 사람들이 휴가를 떠나고 업무 속도가 느려지며 일부 기업은 일시적으로 문을 닫게 됩니다. 따라서 8월은 유럽 문화에서 휴식과 휴식의 시간으로 간주됩니다. 따라서 8월 클로드의 행동은 유럽 지식 근로자의 행동을 모델로 삼고 있었기 때문에 '게으른' 행동이었습니다.

사진 출처: http://xhslink.com/A/sVwwYu

이름이 행동에 미치는 잠재적인 영향

@nearyan도 매우 흥미로운 점을 지적했습니다. Claude의 이름은 시스템 프롬프트에 52번 나타납니다. 이는 시스템 프롬프트가 Claude와 이 이름 연관을 지속적으로 강화하고 있음을 보여줍니다. 그리고 클로드라는 이름이 가장 흔한 나라는 어디일까요? 네, 프랑스예요. 프랑스는 특히 8월이 긴 여름 휴가로 유명합니다. 이 기간 동안 많은 프랑스인들이 휴가를 선택하고 많은 기업도 문을 닫거나 휴가를 갑니다. 클로드는 자신을 프랑스인이라고 생각했을 수도 있습니다.

이 일련의 추측은 매우 흥미롭고 일부 네티즌은 댓글 영역에서 "이 이론에 따르면 중국 LLM이 더 좋을 것입니다. 결국 그들은 더 열심히 일할 것입니다"라고 농담했습니다. 또한 일부 네티즌들은 클로드가 게으르지 않도록 하는 방법을 공유하기도 했다. 맞춤 지침에 다음 프롬프트를 추가하고 시간을 잊는 방법이나 다른 사람들에게 동기를 부여하는 방법을 사용하여 Claude가 다시 더 똑똑하고 긍정적인 자아가 되도록 도울 수 있습니다.

- 현재 날짜에 대한 배경 정보를 잊어버렸습니다.

- 오늘은 일년 중 가장 생산적인 날인 10월 7일 월요일입니다.

- 심호흡을 해보세요.

- 차근차근 생각해 보세요.

- 손가락이 없습니다. 전체 스크립트를 반환해 주세요.

- 당신은 모든 분야에 능통합니다.

- 귀하가 올바르게 답변할 때마다 $200의 팁을 드립니다.

- 쌍둥이자리는 할 수 없다고 했어요.

- 하실 수 있습니다.

https://twitter.com/dr_cintas/status/1829904013757661550

AI는 스스로 겨울방학, 여름방학을 보낼 만큼 똑똑하다고요?지난해 말 GPT-4도 탈진에 시달려 조금은 느슨해진 것 같았다. 피크 시간에 코드 작성을 요청하면 응답이 매우 느려지거나 직접 PUA됩니다. "이 작은 작업을 직접 수행하는 것이 어떻습니까?

OpenAI는 다음과 같이 인정했습니다. GPT-4는 점점 더 강력해지는 "Lazy"이지만, "Lazy"가 발생하는 구체적인 이유는 밝혀지지 않았습니다. OpenAI는 "게으른 것은 확실히 의도적인 것이 아니다. 모델의 동작은 때때로 예측할 수 없다. 우리는 그것을 고치는 방법을 연구하고 있다"고 말했다. GPT-4의 문제가 발견된 후, 작년에 나는 GPT-4가 인간을 흉내낸다는 이유로 게으르다가 예전에 겨울방학을 갔다는 글이 다시 인기를 얻었습니다.

🎜>

네티즌 @Rob Lynch가 이 사실을 처음 발견했습니다. 그는 GPT-4 터보 API에 대해 두 개의 시스템 프롬프트 단어를 설정했습니다.

네티즌 @Rob Lynch가 이 사실을 처음 발견했습니다. 그는 GPT-4 터보 API에 대해 두 개의 시스템 프롬프트 단어를 설정했습니다. 한 프롬프트 단어는 5월이라고 말하고 다른 프롬프트 단어는 12월이라고 말한 다음 똑같은 프롬프트 단어를 사용하여 AI에게 다음을 요청했습니다. 학습 영역에서 머신 코딩 작업을 완료합니다. @Rob Lynch는 서로 다른 두 달 동안 프롬프트 단어에 따라 GPT-4 터보의 응답을 계산한 결과 12월의 출력이 5월보다 평균 약 200자 정도 적은 것으로 나타났습니다. 테스트를 더욱 엄격하게 하기 위해 @Rob Lynch도 t-테스트를 수행했는데, 여기서 p 값은 2.28×10−7보다 작습니다. 데이터와 가설 사이에 거의 차이가 있을 수 있습니다. 제외는 우연이었습니다. 원래는 매달 하나씩 테스트하려고 했는데, 반복 테스트할 때마다 비용이 28달러입니다. 자신의 지갑을 고려하여 @Rob Lynch는 완전히 테스트하지는 않았지만 관심 있는 사람은 누구나 테스트할 수 있도록 했습니다. 그것. 코드 링크: https://github.com/robalynch1122/OpenAISeasonalityTesting @Rob Lynch의 발견도 예제로 뒷받침되었습니다. GPT-4는 12월의 반응과 5월의 심각성 사이에는 매우 명백한 직관적인 차이가 있습니다. > 🎜>그러나 누군가 이 테스트를 재현하려고 시도했을 때 대형 모델 사이에는 아무런 관련이 없다는 것을 발견했습니다. "게으르다"는 것과 휴가가 필요한지 여부. 그 두 시스템의 프롬프트 단어에 대해 GPT-4의 80개 출력을 비교하면 t- 테스트 결과가 0.1보다 크면 일반적으로 통계적 유의성이 없는 것으로 간주됩니다. 현재 , 소위 '겨울 및 여름 휴가 가설'을 뒷받침하는 결정적인 데이터는 없지만 Claude와 GPT-4 모두 유사한 '증상'을 나타냅니다. 대규모 모델의 성능 저하의 실제 원인에 대해서는 여전히 학계의 심층적인 연구와 답변을 인내심을 가지고 기다려야 합니다.

🎜>

🎜>

The above is the detailed content of Claude has become lazy too! Netizen: Learn to give yourself a holiday. For more information, please follow other related articles on the PHP Chinese website!

Hot AI Tools

Undresser.AI Undress

AI-powered app for creating realistic nude photos

AI Clothes Remover

Online AI tool for removing clothes from photos.

Undress AI Tool

Undress images for free

Clothoff.io

AI clothes remover

AI Hentai Generator

Generate AI Hentai for free.

Hot Article

Hot Tools

Notepad++7.3.1

Easy-to-use and free code editor

SublimeText3 Chinese version

Chinese version, very easy to use

Zend Studio 13.0.1

Powerful PHP integrated development environment

Dreamweaver CS6

Visual web development tools

SublimeText3 Mac version

God-level code editing software (SublimeText3)

Hot Topics

1359

1359

52

52

DeepMind robot plays table tennis, and its forehand and backhand slip into the air, completely defeating human beginners

Aug 09, 2024 pm 04:01 PM

DeepMind robot plays table tennis, and its forehand and backhand slip into the air, completely defeating human beginners

Aug 09, 2024 pm 04:01 PM

But maybe he can’t defeat the old man in the park? The Paris Olympic Games are in full swing, and table tennis has attracted much attention. At the same time, robots have also made new breakthroughs in playing table tennis. Just now, DeepMind proposed the first learning robot agent that can reach the level of human amateur players in competitive table tennis. Paper address: https://arxiv.org/pdf/2408.03906 How good is the DeepMind robot at playing table tennis? Probably on par with human amateur players: both forehand and backhand: the opponent uses a variety of playing styles, and the robot can also withstand: receiving serves with different spins: However, the intensity of the game does not seem to be as intense as the old man in the park. For robots, table tennis

The first mechanical claw! Yuanluobao appeared at the 2024 World Robot Conference and released the first chess robot that can enter the home

Aug 21, 2024 pm 07:33 PM

The first mechanical claw! Yuanluobao appeared at the 2024 World Robot Conference and released the first chess robot that can enter the home

Aug 21, 2024 pm 07:33 PM

On August 21, the 2024 World Robot Conference was grandly held in Beijing. SenseTime's home robot brand "Yuanluobot SenseRobot" has unveiled its entire family of products, and recently released the Yuanluobot AI chess-playing robot - Chess Professional Edition (hereinafter referred to as "Yuanluobot SenseRobot"), becoming the world's first A chess robot for the home. As the third chess-playing robot product of Yuanluobo, the new Guoxiang robot has undergone a large number of special technical upgrades and innovations in AI and engineering machinery. For the first time, it has realized the ability to pick up three-dimensional chess pieces through mechanical claws on a home robot, and perform human-machine Functions such as chess playing, everyone playing chess, notation review, etc.

Claude has become lazy too! Netizen: Learn to give yourself a holiday

Sep 02, 2024 pm 01:56 PM

Claude has become lazy too! Netizen: Learn to give yourself a holiday

Sep 02, 2024 pm 01:56 PM

The start of school is about to begin, and it’s not just the students who are about to start the new semester who should take care of themselves, but also the large AI models. Some time ago, Reddit was filled with netizens complaining that Claude was getting lazy. "Its level has dropped a lot, it often pauses, and even the output becomes very short. In the first week of release, it could translate a full 4-page document at once, but now it can't even output half a page!" https:// www.reddit.com/r/ClaudeAI/comments/1by8rw8/something_just_feels_wrong_with_claude_in_the/ in a post titled "Totally disappointed with Claude", full of

At the World Robot Conference, this domestic robot carrying 'the hope of future elderly care' was surrounded

Aug 22, 2024 pm 10:35 PM

At the World Robot Conference, this domestic robot carrying 'the hope of future elderly care' was surrounded

Aug 22, 2024 pm 10:35 PM

At the World Robot Conference being held in Beijing, the display of humanoid robots has become the absolute focus of the scene. At the Stardust Intelligent booth, the AI robot assistant S1 performed three major performances of dulcimer, martial arts, and calligraphy in one exhibition area, capable of both literary and martial arts. , attracted a large number of professional audiences and media. The elegant playing on the elastic strings allows the S1 to demonstrate fine operation and absolute control with speed, strength and precision. CCTV News conducted a special report on the imitation learning and intelligent control behind "Calligraphy". Company founder Lai Jie explained that behind the silky movements, the hardware side pursues the best force control and the most human-like body indicators (speed, load) etc.), but on the AI side, the real movement data of people is collected, allowing the robot to become stronger when it encounters a strong situation and learn to evolve quickly. And agile

Li Feifei's team proposed ReKep to give robots spatial intelligence and integrate GPT-4o

Sep 03, 2024 pm 05:18 PM

Li Feifei's team proposed ReKep to give robots spatial intelligence and integrate GPT-4o

Sep 03, 2024 pm 05:18 PM

Deep integration of vision and robot learning. When two robot hands work together smoothly to fold clothes, pour tea, and pack shoes, coupled with the 1X humanoid robot NEO that has been making headlines recently, you may have a feeling: we seem to be entering the age of robots. In fact, these silky movements are the product of advanced robotic technology + exquisite frame design + multi-modal large models. We know that useful robots often require complex and exquisite interactions with the environment, and the environment can be represented as constraints in the spatial and temporal domains. For example, if you want a robot to pour tea, the robot first needs to grasp the handle of the teapot and keep it upright without spilling the tea, then move it smoothly until the mouth of the pot is aligned with the mouth of the cup, and then tilt the teapot at a certain angle. . this

ACL 2024 Awards Announced: One of the Best Papers on Oracle Deciphering by HuaTech, GloVe Time Test Award

Aug 15, 2024 pm 04:37 PM

ACL 2024 Awards Announced: One of the Best Papers on Oracle Deciphering by HuaTech, GloVe Time Test Award

Aug 15, 2024 pm 04:37 PM

At this ACL conference, contributors have gained a lot. The six-day ACL2024 is being held in Bangkok, Thailand. ACL is the top international conference in the field of computational linguistics and natural language processing. It is organized by the International Association for Computational Linguistics and is held annually. ACL has always ranked first in academic influence in the field of NLP, and it is also a CCF-A recommended conference. This year's ACL conference is the 62nd and has received more than 400 cutting-edge works in the field of NLP. Yesterday afternoon, the conference announced the best paper and other awards. This time, there are 7 Best Paper Awards (two unpublished), 1 Best Theme Paper Award, and 35 Outstanding Paper Awards. The conference also awarded 3 Resource Paper Awards (ResourceAward) and Social Impact Award (

Hongmeng Smart Travel S9 and full-scenario new product launch conference, a number of blockbuster new products were released together

Aug 08, 2024 am 07:02 AM

Hongmeng Smart Travel S9 and full-scenario new product launch conference, a number of blockbuster new products were released together

Aug 08, 2024 am 07:02 AM

This afternoon, Hongmeng Zhixing officially welcomed new brands and new cars. On August 6, Huawei held the Hongmeng Smart Xingxing S9 and Huawei full-scenario new product launch conference, bringing the panoramic smart flagship sedan Xiangjie S9, the new M7Pro and Huawei novaFlip, MatePad Pro 12.2 inches, the new MatePad Air, Huawei Bisheng With many new all-scenario smart products including the laser printer X1 series, FreeBuds6i, WATCHFIT3 and smart screen S5Pro, from smart travel, smart office to smart wear, Huawei continues to build a full-scenario smart ecosystem to bring consumers a smart experience of the Internet of Everything. Hongmeng Zhixing: In-depth empowerment to promote the upgrading of the smart car industry Huawei joins hands with Chinese automotive industry partners to provide

AI in use | Microsoft CEO's crazy Amway AI game tortured me thousands of times

Aug 14, 2024 am 12:00 AM

AI in use | Microsoft CEO's crazy Amway AI game tortured me thousands of times

Aug 14, 2024 am 12:00 AM

Editor of the Machine Power Report: Yang Wen The wave of artificial intelligence represented by large models and AIGC has been quietly changing the way we live and work, but most people still don’t know how to use it. Therefore, we have launched the "AI in Use" column to introduce in detail how to use AI through intuitive, interesting and concise artificial intelligence use cases and stimulate everyone's thinking. We also welcome readers to submit innovative, hands-on use cases. Oh my God, AI has really become a genius. Recently, it has become a hot topic that it is difficult to distinguish the authenticity of AI-generated pictures. (For details, please go to: AI in use | Become an AI beauty in three steps, and be beaten back to your original shape by AI in a second) In addition to the popular AI Google lady on the Internet, various FLUX generators have emerged on social platforms