Hadoop 2.2 & HBase 0.96 Maven 依赖总结

由于Hbase 0.94对Hadoop 2.x的支持不是非常好,故直接添加Hbase 0.94的jar依赖可能会导致问题。 但是直接添加Hbase0.96的依赖,由于官方并没有发布Hbase 0.96的jar包,通过maven编译项目的时候会出现找不到jar包导致编译失败。 通过网上的资料,得知Hbase 0.9

由于Hbase 0.94对Hadoop 2.x的支持不是非常好,故直接添加Hbase 0.94的jar依赖可能会导致问题。 但是直接添加Hbase0.96的依赖,由于官方并没有发布Hbase 0.96的jar包,通过maven编译项目的时候会出现找不到jar包导致编译失败。

通过网上的资料,得知Hbase 0.94后版本,直接添加Hbase-Client的依赖,通过查询得知需要以下依赖:

[html]

view plaincopy

- dependency>

- groupId>commons-iogroupId>

- artifactId>commons-ioartifactId>

- version>1.3.2version>

- dependency>

- dependency>

- groupId>commons-logginggroupId>

- artifactId>commons-loggingartifactId>

- version>1.1.3version>

- dependency>

- dependency>

- groupId>log4jgroupId>

- artifactId>log4jartifactId>

- version>1.2.17version>

- dependency>

- dependency>

- groupId>org.apache.hbasegroupId>

- artifactId>hbase-clientartifactId>

- version>0.96.1-hadoop2version>

- dependency>

- dependency>

- groupId>com.google.protobufgroupId>

- artifactId>protobuf-javaartifactId>

- version>2.5.0version>

- dependency>

- dependency>

- groupId>io.nettygroupId>

- artifactId>nettyartifactId>

- version>3.6.6.Finalversion>

- dependency>

- dependency>

- groupId>org.apache.hbasegroupId>

- artifactId>hbase-commonartifactId>

- version>0.96.1-hadoop2version>

- dependency>

- dependency>

- groupId>org.apache.hbasegroupId>

- artifactId>hbase-protocolartifactId>

- version>0.96.1-hadoop2version>

- dependency>

- dependency>

- groupId>org.apache.zookeepergroupId>

- artifactId>zookeeperartifactId>

- version>3.4.5version>

- dependency>

- dependency>

- groupId>org.cloudera.htracegroupId>

- artifactId>htrace-coreartifactId>

- version>2.01version>

- dependency>

- dependency>

- groupId>org.codehaus.jacksongroupId>

- artifactId>jackson-mapper-aslartifactId>

- version>1.9.13version>

- dependency>

- dependency>

- groupId>org.codehaus.jacksongroupId>

- artifactId>jackson-core-aslartifactId>

- version>1.9.13version>

- dependency>

- dependency>

- groupId>org.codehaus.jacksongroupId>

- artifactId>jackson-jaxrsartifactId>

- version>1.9.13version>

- dependency>

- dependency>

- groupId>org.codehaus.jacksongroupId>

- artifactId>jackson-xcartifactId>

- version>1.9.13version>

- dependency>

- dependency>

- groupId>org.slf4jgroupId>

- artifactId>slf4j-apiartifactId>

- version>1.6.4version>

- dependency>

- dependency>

- groupId>org.slf4jgroupId>

- artifactId>slf4j-log4j12artifactId>

- version>1.6.4version>

- dependency>

若要使用org.apache.hadoop.hbase.mapreduce的API,需要加上:

最后,把Hadoop的依赖也贴上来,以防自己忘记:

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Sujets chauds

Erreurs Java : erreurs Hadoop, comment les gérer et les éviter

Jun 24, 2023 pm 01:06 PM

Erreurs Java : erreurs Hadoop, comment les gérer et les éviter

Jun 24, 2023 pm 01:06 PM

Erreurs Java : erreurs Hadoop, comment les gérer et les éviter Lorsque vous utilisez Hadoop pour traiter des données volumineuses, vous rencontrez souvent des erreurs d'exception Java, qui peuvent affecter l'exécution des tâches et provoquer l'échec du traitement des données. Cet article présentera quelques erreurs Hadoop courantes et fournira des moyens de les gérer et de les éviter. Java.lang.OutOfMemoryErrorOutOfMemoryError est une erreur provoquée par une mémoire insuffisante de la machine virtuelle Java. Quand Hadoop est

Utilisation de Hadoop et HBase dans Beego pour le stockage et les requêtes Big Data

Jun 22, 2023 am 10:21 AM

Utilisation de Hadoop et HBase dans Beego pour le stockage et les requêtes Big Data

Jun 22, 2023 am 10:21 AM

Avec l'avènement de l'ère du Big Data, le traitement et le stockage des données sont devenus de plus en plus importants, et la gestion et l'analyse efficaces de grandes quantités de données sont devenues un défi pour les entreprises. Hadoop et HBase, deux projets de la Fondation Apache, proposent une solution de stockage et d'analyse du Big Data. Cet article explique comment utiliser Hadoop et HBase dans Beego pour le stockage et les requêtes Big Data. 1. Introduction à Hadoop et HBase Hadoop est un système informatique et de stockage distribué open source qui peut

Comment utiliser PHP et Hadoop pour le traitement du Big Data

Jun 19, 2023 pm 02:24 PM

Comment utiliser PHP et Hadoop pour le traitement du Big Data

Jun 19, 2023 pm 02:24 PM

Alors que la quantité de données continue d’augmenter, les méthodes traditionnelles de traitement des données ne peuvent plus relever les défis posés par l’ère du Big Data. Hadoop est un cadre informatique distribué open source qui résout le problème de goulot d'étranglement des performances causé par les serveurs à nœud unique dans le traitement du Big Data grâce au stockage distribué et au traitement de grandes quantités de données. PHP est un langage de script largement utilisé dans le développement Web et présente les avantages d'un développement rapide et d'une maintenance facile. Cet article explique comment utiliser PHP et Hadoop pour le traitement du Big Data. Qu'est-ce que HadoopHadoop ?

Explorez l'application de Java dans le domaine du big data : compréhension de Hadoop, Spark, Kafka et d'autres piles technologiques

Dec 26, 2023 pm 02:57 PM

Explorez l'application de Java dans le domaine du big data : compréhension de Hadoop, Spark, Kafka et d'autres piles technologiques

Dec 26, 2023 pm 02:57 PM

Pile technologique Java Big Data : Comprendre l'application de Java dans le domaine du Big Data, comme Hadoop, Spark, Kafka, etc. Alors que la quantité de données continue d'augmenter, la technologie Big Data est devenue un sujet brûlant à l'ère d'Internet d'aujourd'hui. Dans le domaine du big data, on entend souvent les noms de Hadoop, Spark, Kafka et d’autres technologies. Ces technologies jouent un rôle essentiel et Java, en tant que langage de programmation largement utilisé, joue également un rôle majeur dans le domaine du Big Data. Cet article se concentrera sur l'application de Java en général

Quelle pièce est l'AMP ?

Feb 24, 2024 pm 09:16 PM

Quelle pièce est l'AMP ?

Feb 24, 2024 pm 09:16 PM

Qu’est-ce que la pièce AMP ? Le token AMP a été créé par l'équipe Synereo en 2015 comme principale devise de trading de la plateforme Synereo. Le jeton AMP vise à offrir aux utilisateurs une meilleure expérience économique numérique grâce à de multiples fonctions et utilisations. Objectif du jeton AMP Le jeton AMP a plusieurs rôles et fonctions dans la plateforme Synereo. Premièrement, dans le cadre du système de récompense en crypto-monnaie de la plateforme, les utilisateurs peuvent gagner des récompenses AMP en partageant et en promouvant du contenu, un mécanisme qui encourage les utilisateurs à participer plus activement aux activités de la plateforme. Les jetons AMP peuvent également être utilisés pour promouvoir et distribuer du contenu sur la plateforme Synereo. Les utilisateurs peuvent augmenter la visibilité de leur contenu sur la plateforme en utilisant des jetons AMP pour attirer davantage de téléspectateurs à consulter et à partager.

Comment installer Hadoop sous Linux

May 18, 2023 pm 08:19 PM

Comment installer Hadoop sous Linux

May 18, 2023 pm 08:19 PM

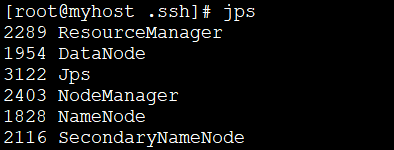

1 : Installez JDK1. Exécutez la commande suivante pour télécharger le package d'installation de JDK1.8. wget--no-check-certificatehttps://repo.huaweicloud.com/java/jdk/8u151-b12/jdk-8u151-linux-x64.tar.gz2 Exécutez la commande suivante pour décompresser le package d'installation JDK1.8 téléchargé. . tar-zxvfjdk-8u151-linux-x64.tar.gz3 Déplacez et renommez le package JDK. mvjdk1.8.0_151//usr/java84. Configurez les variables d'environnement Java. écho'

Introduction aux trois composants principaux de hadoop

Mar 13, 2024 pm 05:54 PM

Introduction aux trois composants principaux de hadoop

Mar 13, 2024 pm 05:54 PM

Les trois composants principaux de Hadoop sont : Hadoop Distributed File System (HDFS), MapReduce et Yet Another Resource Négociateur (YARN).

Moteurs de traitement de données en PHP (Spark, Hadoop, etc.)

Jun 23, 2023 am 09:43 AM

Moteurs de traitement de données en PHP (Spark, Hadoop, etc.)

Jun 23, 2023 am 09:43 AM

À l’ère actuelle d’Internet, le traitement de données massives est un problème auquel chaque entreprise et institution doit faire face. En tant que langage de programmation largement utilisé, PHP doit également suivre l’évolution du traitement des données. Afin de traiter plus efficacement des données massives, le développement PHP a introduit des outils de traitement du Big Data, tels que Spark et Hadoop. Spark est un moteur de traitement de données open source qui peut être utilisé pour le traitement distribué de grands ensembles de données. La plus grande caractéristique de Spark est sa vitesse de traitement rapide des données et son stockage efficace.