My First Lucky and Sad Hadoop Results

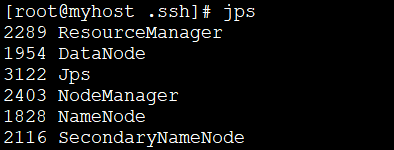

Recently I am playing with Hadoop per analyzing the data set I scraped from WEIBO.COM. After a couple of tryings, many are failed due to disk space shortage, after I decreased the input date set volumn, luckily I gained a completed Hadoop

Recently I am playing with Hadoop per analyzing the data set I scraped from WEIBO.COM. After a couple of tryings, many are failed due to disk space shortage, after I decreased the input date set volumn, luckily I gained a completed Hadoop Job results, but, sadly, with only 1000 lines of records processed.

Here is the Job Summary:

| Counter | Map | Reduce | Total |

| Bytes Read | 7,945,196 | 0 | 7,945,196 |

| FILE_BYTES_READ | 16,590,565,518 | 8,021,579,181 | 24,612,144,699 |

| HDFS_BYTES_READ | 7,945,580 | 0 | 7,945,580 |

| FILE_BYTES_WRITTEN | 24,612,303,774 | 8,021,632,091 | 32,633,935,865 |

| HDFS_BYTES_WRITTEN | 0 | 2,054,409,494 | 2,054,409,494 |

| Reduce input groups | 0 | 381,696,888 | 381,696,888 |

| Map output materialized bytes | 8,021,579,181 | 0 | 8,021,579,181 |

| Combine output records | 826,399,600 | 0 | 826,399,600 |

| Map input records | 1,000 | 0 | 1,000 |

| Reduce shuffle bytes | 0 | 8,021,579,181 | 8,021,579,181 |

| Physical memory (bytes) snapshot | 1,215,041,536 | 72,613,888 | 1,287,655,424 |

| Reduce output records | 0 | 381,696,888 | 381,696,888 |

| Spilled Records | 1,230,714,511 | 401,113,702 | 1,631,828,213 |

| Map output bytes | 7,667,457,405 | 0 | 7,667,457,405 |

| Total committed heap usage (bytes) | 1,038,745,600 | 29,097,984 | 1,067,843,584 |

| CPU time spent (ms) | 2,957,800 | 2,104,030 | 5,061,830 |

| Virtual memory (bytes) snapshot | 4,112,838,656 | 1,380,306,944 | 5,493,145,600 |

| SPLIT_RAW_BYTES | 384 | 0 | 384 |

| Map output records | 426,010,418 | 0 | 426,010,418 |

| Combine input records | 851,296,316 | 0 | 851,296,316 |

| Reduce input records | 0 | 401,113,702 | 401,113,702 |

From which we can see that, specially metrics which highlighted in bold style, I only passed in about 7MB data file with 1000 lines of records, but Reducer outputs 381,696,888 records, which are 2.1GB compressed gz file and some 9GB plain text when decompressed.

But clearly it’s not the problem of my code that leads to so much disk space usages, the above output metrics are all reasonable, although you may be surprised by the comparison between 7MB with only 1000 records input and 9GB with 381,696,888 records output. The truth is that I’m calculating co-appearance combination computation.

From this experimental I learned that my personal computer really cannot play with big elephant, input data records from the first 10 thousand down to 5 thousand to 3 thousand to ONE thousand at last, but data analytic should go on, I need to find a solution to work it out, actually I have 30 times of data need to process, that is 30 thousand records.

Yet still have a lot of work to do, and I plan to post some articles about what’s I have done with my big data :) and Hadoop so far.

---EOF---

原文地址:My First Lucky and Sad Hadoop Results, 感谢原作者分享。

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Erreurs Java : erreurs Hadoop, comment les gérer et les éviter

Jun 24, 2023 pm 01:06 PM

Erreurs Java : erreurs Hadoop, comment les gérer et les éviter

Jun 24, 2023 pm 01:06 PM

Erreurs Java : erreurs Hadoop, comment les gérer et les éviter Lorsque vous utilisez Hadoop pour traiter des données volumineuses, vous rencontrez souvent des erreurs d'exception Java, qui peuvent affecter l'exécution des tâches et provoquer l'échec du traitement des données. Cet article présentera quelques erreurs Hadoop courantes et fournira des moyens de les gérer et de les éviter. Java.lang.OutOfMemoryErrorOutOfMemoryError est une erreur provoquée par une mémoire insuffisante de la machine virtuelle Java. Quand Hadoop est

Utilisation de Hadoop et HBase dans Beego pour le stockage et les requêtes Big Data

Jun 22, 2023 am 10:21 AM

Utilisation de Hadoop et HBase dans Beego pour le stockage et les requêtes Big Data

Jun 22, 2023 am 10:21 AM

Avec l'avènement de l'ère du Big Data, le traitement et le stockage des données sont devenus de plus en plus importants, et la gestion et l'analyse efficaces de grandes quantités de données sont devenues un défi pour les entreprises. Hadoop et HBase, deux projets de la Fondation Apache, proposent une solution de stockage et d'analyse du Big Data. Cet article explique comment utiliser Hadoop et HBase dans Beego pour le stockage et les requêtes Big Data. 1. Introduction à Hadoop et HBase Hadoop est un système informatique et de stockage distribué open source qui peut

Comment utiliser PHP et Hadoop pour le traitement du Big Data

Jun 19, 2023 pm 02:24 PM

Comment utiliser PHP et Hadoop pour le traitement du Big Data

Jun 19, 2023 pm 02:24 PM

Alors que la quantité de données continue d’augmenter, les méthodes traditionnelles de traitement des données ne peuvent plus relever les défis posés par l’ère du Big Data. Hadoop est un cadre informatique distribué open source qui résout le problème de goulot d'étranglement des performances causé par les serveurs à nœud unique dans le traitement du Big Data grâce au stockage distribué et au traitement de grandes quantités de données. PHP est un langage de script largement utilisé dans le développement Web et présente les avantages d'un développement rapide et d'une maintenance facile. Cet article explique comment utiliser PHP et Hadoop pour le traitement du Big Data. Qu'est-ce que HadoopHadoop ?

Explorez l'application de Java dans le domaine du big data : compréhension de Hadoop, Spark, Kafka et d'autres piles technologiques

Dec 26, 2023 pm 02:57 PM

Explorez l'application de Java dans le domaine du big data : compréhension de Hadoop, Spark, Kafka et d'autres piles technologiques

Dec 26, 2023 pm 02:57 PM

Pile technologique Java Big Data : Comprendre l'application de Java dans le domaine du Big Data, comme Hadoop, Spark, Kafka, etc. Alors que la quantité de données continue d'augmenter, la technologie Big Data est devenue un sujet brûlant à l'ère d'Internet d'aujourd'hui. Dans le domaine du big data, on entend souvent les noms de Hadoop, Spark, Kafka et d’autres technologies. Ces technologies jouent un rôle essentiel et Java, en tant que langage de programmation largement utilisé, joue également un rôle majeur dans le domaine du Big Data. Cet article se concentrera sur l'application de Java en général

Comment installer Hadoop sous Linux

May 18, 2023 pm 08:19 PM

Comment installer Hadoop sous Linux

May 18, 2023 pm 08:19 PM

1 : Installez JDK1. Exécutez la commande suivante pour télécharger le package d'installation de JDK1.8. wget--no-check-certificatehttps://repo.huaweicloud.com/java/jdk/8u151-b12/jdk-8u151-linux-x64.tar.gz2 Exécutez la commande suivante pour décompresser le package d'installation JDK1.8 téléchargé. . tar-zxvfjdk-8u151-linux-x64.tar.gz3 Déplacez et renommez le package JDK. mvjdk1.8.0_151//usr/java84. Configurez les variables d'environnement Java. écho'

Utiliser PHP pour réaliser des traitements de données à grande échelle : Hadoop, Spark, Flink, etc.

May 11, 2023 pm 04:13 PM

Utiliser PHP pour réaliser des traitements de données à grande échelle : Hadoop, Spark, Flink, etc.

May 11, 2023 pm 04:13 PM

Alors que la quantité de données continue d’augmenter, le traitement des données à grande échelle est devenu un problème auquel les entreprises doivent faire face et résoudre. Les bases de données relationnelles traditionnelles ne peuvent plus répondre à cette demande pour le stockage et l'analyse de données à grande échelle, les plateformes informatiques distribuées telles que Hadoop, Spark et Flink sont devenues les meilleurs choix. Dans le processus de sélection des outils de traitement de données, PHP devient de plus en plus populaire parmi les développeurs en tant que langage facile à développer et à maintenir. Dans cet article, nous explorerons comment exploiter PHP pour le traitement de données à grande échelle et comment

Comparaison et scénarios d'application de Redis et Hadoop

Jun 21, 2023 am 08:28 AM

Comparaison et scénarios d'application de Redis et Hadoop

Jun 21, 2023 am 08:28 AM

Redis et Hadoop sont tous deux des systèmes de stockage et de traitement de données distribués couramment utilisés. Cependant, il existe des différences évidentes entre les deux en termes de conception, de performances, de scénarios d'utilisation, etc. Dans cet article, nous comparerons en détail les différences entre Redis et Hadoop et explorerons leurs scénarios applicables. Présentation de Redis Redis est un système de stockage de données open source basé sur la mémoire qui prend en charge plusieurs structures de données et des opérations de lecture et d'écriture efficaces. Les principales fonctionnalités de Redis incluent : Stockage mémoire : Redis

Moteurs de traitement de données en PHP (Spark, Hadoop, etc.)

Jun 23, 2023 am 09:43 AM

Moteurs de traitement de données en PHP (Spark, Hadoop, etc.)

Jun 23, 2023 am 09:43 AM

À l’ère actuelle d’Internet, le traitement de données massives est un problème auquel chaque entreprise et institution doit faire face. En tant que langage de programmation largement utilisé, PHP doit également suivre l’évolution du traitement des données. Afin de traiter plus efficacement des données massives, le développement PHP a introduit des outils de traitement du Big Data, tels que Spark et Hadoop. Spark est un moteur de traitement de données open source qui peut être utilisé pour le traitement distribué de grands ensembles de données. La plus grande caractéristique de Spark est sa vitesse de traitement rapide des données et son stockage efficace.