Hadoop HelloWord Examples- 求平均数

? 另外一个hadoop的入门demo,求平均数。是对WordCount这个demo的一个小小的修改。输入一堆成绩单(人名,成绩),然后求每个人成绩平均数,比如: //? subject1.txt ? a 90 ? b 80 ? c 70 ?// subject2.txt ? a 100 ? b 90 ? c 80 ? 求a,b,c这三个人的平均

? 另外一个hadoop的入门demo,求平均数。是对WordCount这个demo的一个小小的修改。输入一堆成绩单(人名,成绩),然后求每个人成绩平均数,比如:

//? subject1.txt

? a 90

? b 80

? c 70

?// subject2.txt

? a 100

? b 90

? c 80

? 求a,b,c这三个人的平均分。解决思路很简单,在map阶段key是名字,value是成绩,直接output。reduce阶段得到了map输出的key名字,values是该名字对应的一系列的成绩,那么对其求平均数即可。

? 这里我们实现了两个版本的代码,分别用TextInputFormat和 KeyValueTextInputFormat来作为输入格式。

? TextInputFormat版本:

?

import java.util.*;

import java.io.*;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.mapreduce.Mapper;

import org.apache.hadoop.mapreduce.Reducer;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;

public class AveScore {

public static class AveMapper extends Mapper

{

@Override

public void map(Object key, Text value, Context context) throws IOException, InterruptedException

{

String line = value.toString();

String[] strs = line.split(" ");

String name = strs[0];

int score = Integer.parseInt(strs[1]);

context.write(new Text(name), new IntWritable(score));

}

}

public static class AveReducer extends Reducer

{

@Override

public void reduce(Text key, Iterable values, Context context) throws IOException, InterruptedException

{

int sum = 0;

int count = 0;

for(IntWritable val : values)

{

sum += val.get();

count++;

}

int aveScore = sum / count;

context.write(key, new IntWritable(aveScore));

}

}

public static void main(String[] args) throws Exception

{

Configuration conf = new Configuration();

Job job = new Job(conf,"AverageScore");

job.setJarByClass(AveScore.class);

job.setMapperClass(AveMapper.class);

job.setReducerClass(AveReducer.class);

job.setOutputKeyClass(Text.class);

job.setOutputValueClass(IntWritable.class);

FileInputFormat.addInputPath(job, new Path(args[0]));

FileOutputFormat.setOutputPath(job, new Path(args[1]));

System.exit( job.waitForCompletion(true) ? 0 : 1);

}

}

KeyValueTextInputFormat版本;

import java.util.*;

import java.io.*;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.mapreduce.Mapper;

import org.apache.hadoop.mapreduce.Reducer;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;

import org.apache.hadoop.mapreduce.lib.input.KeyValueTextInputFormat;

import org.apache.hadoop.mapreduce.lib.output.TextOutputFormat;

public class AveScore_KeyValue {

public static class AveMapper extends Mapper

{

@Override

public void map(Text key, Text value, Context context) throws IOException, InterruptedException

{

int score = Integer.parseInt(value.toString());

context.write(key, new IntWritable(score) );

}

}

public static class AveReducer extends Reducer

{

@Override

public void reduce(Text key, Iterable values, Context context) throws IOException, InterruptedException

{

int sum = 0;

int count = 0;

for(IntWritable val : values)

{

sum += val.get();

count++;

}

int aveScore = sum / count;

context.write(key, new IntWritable(aveScore));

}

}

public static void main(String[] args) throws Exception

{

Configuration conf = new Configuration();

conf.set("mapreduce.input.keyvaluelinerecordreader.key.value.separator", " ");

Job job = new Job(conf,"AverageScore");

job.setJarByClass(AveScore_KeyValue.class);

job.setMapperClass(AveMapper.class);

job.setReducerClass(AveReducer.class);

job.setOutputKeyClass(Text.class);

job.setOutputValueClass(IntWritable.class);

job.setInputFormatClass(KeyValueTextInputFormat.class);

job.setOutputFormatClass(TextOutputFormat.class) ;

FileInputFormat.addInputPath(job, new Path(args[0]));

FileOutputFormat.setOutputPath(job, new Path(args[1]));

System.exit( job.waitForCompletion(true) ? 0 : 1);

}

}

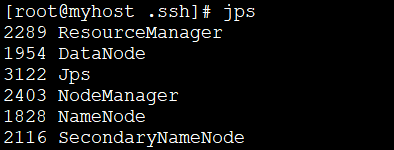

输出结果为:

? a 95

? b 85

? c 75

?

作者:qiul12345 发表于2013-8-23 21:51:03 原文链接

阅读:113 评论:0 查看评论

原文地址:Hadoop HelloWord Examples- 求平均数, 感谢原作者分享。

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

Video Face Swap

Échangez les visages dans n'importe quelle vidéo sans effort grâce à notre outil d'échange de visage AI entièrement gratuit !

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Sujets chauds

1659

1659

14

14

1416

1416

52

52

1310

1310

25

25

1258

1258

29

29

1232

1232

24

24

Erreurs Java : erreurs Hadoop, comment les gérer et les éviter

Jun 24, 2023 pm 01:06 PM

Erreurs Java : erreurs Hadoop, comment les gérer et les éviter

Jun 24, 2023 pm 01:06 PM

Erreurs Java : erreurs Hadoop, comment les gérer et les éviter Lorsque vous utilisez Hadoop pour traiter des données volumineuses, vous rencontrez souvent des erreurs d'exception Java, qui peuvent affecter l'exécution des tâches et provoquer l'échec du traitement des données. Cet article présentera quelques erreurs Hadoop courantes et fournira des moyens de les gérer et de les éviter. Java.lang.OutOfMemoryErrorOutOfMemoryError est une erreur provoquée par une mémoire insuffisante de la machine virtuelle Java. Quand Hadoop est

Utilisation de Hadoop et HBase dans Beego pour le stockage et les requêtes Big Data

Jun 22, 2023 am 10:21 AM

Utilisation de Hadoop et HBase dans Beego pour le stockage et les requêtes Big Data

Jun 22, 2023 am 10:21 AM

Avec l'avènement de l'ère du Big Data, le traitement et le stockage des données sont devenus de plus en plus importants, et la gestion et l'analyse efficaces de grandes quantités de données sont devenues un défi pour les entreprises. Hadoop et HBase, deux projets de la Fondation Apache, proposent une solution de stockage et d'analyse du Big Data. Cet article explique comment utiliser Hadoop et HBase dans Beego pour le stockage et les requêtes Big Data. 1. Introduction à Hadoop et HBase Hadoop est un système informatique et de stockage distribué open source qui peut

Comment utiliser PHP et Hadoop pour le traitement du Big Data

Jun 19, 2023 pm 02:24 PM

Comment utiliser PHP et Hadoop pour le traitement du Big Data

Jun 19, 2023 pm 02:24 PM

Alors que la quantité de données continue d’augmenter, les méthodes traditionnelles de traitement des données ne peuvent plus relever les défis posés par l’ère du Big Data. Hadoop est un cadre informatique distribué open source qui résout le problème de goulot d'étranglement des performances causé par les serveurs à nœud unique dans le traitement du Big Data grâce au stockage distribué et au traitement de grandes quantités de données. PHP est un langage de script largement utilisé dans le développement Web et présente les avantages d'un développement rapide et d'une maintenance facile. Cet article explique comment utiliser PHP et Hadoop pour le traitement du Big Data. Qu'est-ce que HadoopHadoop ?

Explorez l'application de Java dans le domaine du big data : compréhension de Hadoop, Spark, Kafka et d'autres piles technologiques

Dec 26, 2023 pm 02:57 PM

Explorez l'application de Java dans le domaine du big data : compréhension de Hadoop, Spark, Kafka et d'autres piles technologiques

Dec 26, 2023 pm 02:57 PM

Pile technologique Java Big Data : Comprendre l'application de Java dans le domaine du Big Data, comme Hadoop, Spark, Kafka, etc. Alors que la quantité de données continue d'augmenter, la technologie Big Data est devenue un sujet brûlant à l'ère d'Internet d'aujourd'hui. Dans le domaine du big data, on entend souvent les noms de Hadoop, Spark, Kafka et d’autres technologies. Ces technologies jouent un rôle essentiel et Java, en tant que langage de programmation largement utilisé, joue également un rôle majeur dans le domaine du Big Data. Cet article se concentrera sur l'application de Java en général

Comment installer Hadoop sous Linux

May 18, 2023 pm 08:19 PM

Comment installer Hadoop sous Linux

May 18, 2023 pm 08:19 PM

1 : Installez JDK1. Exécutez la commande suivante pour télécharger le package d'installation de JDK1.8. wget--no-check-certificatehttps://repo.huaweicloud.com/java/jdk/8u151-b12/jdk-8u151-linux-x64.tar.gz2 Exécutez la commande suivante pour décompresser le package d'installation JDK1.8 téléchargé. . tar-zxvfjdk-8u151-linux-x64.tar.gz3 Déplacez et renommez le package JDK. mvjdk1.8.0_151//usr/java84. Configurez les variables d'environnement Java. écho'

Excel supprime le score le plus élevé et le score le plus bas et calcule la moyenne

Mar 20, 2024 am 09:45 AM

Excel supprime le score le plus élevé et le score le plus bas et calcule la moyenne

Mar 20, 2024 am 09:45 AM

Les ordinateurs sont devenus une configuration standard pour le travail moderne, les logiciels de bureautique sont donc également une opération de base qu'il faut maîtriser au travail. Avec le développement de la technologie, les fonctions des logiciels de bureautique deviennent de plus en plus puissantes. Excel est souvent utilisé dans le travail réel en raison de ses fonctions puissantes. En tant qu'affichage de données, Excel est clair et intuitif. En tant que logiciel de calcul, Excel peut effectuer des sommes, des résumés et des calculs de moyenne. Aujourd'hui, nous allons vous apprendre à supprimer le score le plus élevé et le score le plus bas dans Excel et à calculer la moyenne. Après avoir ouvert le tableau, j'ai découvert que le score le plus élevé du tableau était de 100 points et le score le plus bas de 66 points. Par conséquent, nous devons calculer la moyenne des autres scores en plus de ces deux scores. 2. Cliquez sur l'icône de fonction (comme indiqué ci-dessous). 3. Utilisez la fonction TRIMMEAN. 4.Ceci

Moteurs de traitement de données en PHP (Spark, Hadoop, etc.)

Jun 23, 2023 am 09:43 AM

Moteurs de traitement de données en PHP (Spark, Hadoop, etc.)

Jun 23, 2023 am 09:43 AM

À l’ère actuelle d’Internet, le traitement de données massives est un problème auquel chaque entreprise et institution doit faire face. En tant que langage de programmation largement utilisé, PHP doit également suivre l’évolution du traitement des données. Afin de traiter plus efficacement des données massives, le développement PHP a introduit des outils de traitement du Big Data, tels que Spark et Hadoop. Spark est un moteur de traitement de données open source qui peut être utilisé pour le traitement distribué de grands ensembles de données. La plus grande caractéristique de Spark est sa vitesse de traitement rapide des données et son stockage efficace.

Utiliser PHP pour réaliser des traitements de données à grande échelle : Hadoop, Spark, Flink, etc.

May 11, 2023 pm 04:13 PM

Utiliser PHP pour réaliser des traitements de données à grande échelle : Hadoop, Spark, Flink, etc.

May 11, 2023 pm 04:13 PM

Alors que la quantité de données continue d’augmenter, le traitement des données à grande échelle est devenu un problème auquel les entreprises doivent faire face et résoudre. Les bases de données relationnelles traditionnelles ne peuvent plus répondre à cette demande pour le stockage et l'analyse de données à grande échelle, les plateformes informatiques distribuées telles que Hadoop, Spark et Flink sont devenues les meilleurs choix. Dans le processus de sélection des outils de traitement de données, PHP devient de plus en plus populaire parmi les développeurs en tant que langage facile à développer et à maintenir. Dans cet article, nous explorerons comment exploiter PHP pour le traitement de données à grande échelle et comment