Périphériques technologiques

Périphériques technologiques

IA

IA

Plusieurs modèles de conception que les excellents agents doivent apprendre, vous pouvez les apprendre en une seule fois

Plusieurs modèles de conception que les excellents agents doivent apprendre, vous pouvez les apprendre en une seule fois

Plusieurs modèles de conception que les excellents agents doivent apprendre, vous pouvez les apprendre en une seule fois

Bonjour à tous, je m'appelle Laodu.

Hier, j'ai écouté AI Hospital Town partagé par l'Institut de recherche sur l'industrie intelligente de l'Université Tsinghua au sein de l'entreprise.

Photos

Photos

C'est un monde virtuel Tous les médecins, infirmières et patients sont des intelligences d'agent pilotées par LLM et peuvent interagir de manière autonome. Ils ont simulé l’ensemble du processus de diagnostic et de traitement et ont atteint une précision de pointe de 93,06 % sur un sous-ensemble de données MedQA couvrant les principales maladies respiratoires.

Un excellent agent intelligent est indissociable d'excellents modèles de conception. Après avoir lu ce cas, j'ai rapidement lu les quatre principaux modèles de conception d'agents récemment publiés par M. Andrew Ng.

Enda Ng est l'un des chercheurs les plus influents au monde dans le domaine de l'intelligence artificielle et de l'apprentissage automatique

Ensuite, je l'ai rapidement compilé et partagé avec tout le monde.

Mode 1, Réflexion

Dans ce mode, les résultats générés pour la première fois par le grand modèle ne sont pas directement émis, mais les résultats sont renvoyés vers le grand modèle pour inspection et évaluation.

Il produira une deuxième version des résultats qui pourrait mieux fonctionner que la première version.

Pour reprendre les mots de Confucius, cela s'appelle "Je m'examine trois fois par jour".

L'invite spécifique écrite dans ce mode peut utiliser plusieurs modes d'inférence que nous avons partagés auparavant, tels que : quelques-shots (Few-shot), chaîne de pensée (CoT), arbre de pensée (ToT), ReAct , etc.

L'objectif principal de ce modèle est de maximiser les capacités de raisonnement des grands modèles sans recourir à des forces externes.

Mode 2. Utilisation des outils

Ce mode permet à l'agent d'utiliser des outils externes pour effectuer des tâches spécifiques.

Pour parler franchement, cela signifie « laisser les affaires professionnelles aux professionnels ».

L'essence du grand modèle est la prédiction de texte, et il n'a pas la capacité de faire de l'arithmétique, de l'exécution de code, etc. Lorsque nous rencontrons ces tâches, nous pouvons laisser le grand modèle générer des équations et des codes, puis appeler la calculatrice et l'interpréteur de code pour les compléter.

L'Agent dans ce mode semble devenir plus puissant avec une aide externe.

Mode 3. Planification

Ce mode permet à l'agent de décomposer une tâche complexe en une série de petites tâches simples, puis de les résoudre une par une.

En fait, cela signifie « De combien d'étapes faut-il pour mettre un éléphant au réfrigérateur ? » J'étais confus lorsque j'ai entendu cette question pour la première fois, mais quand j'ai vu l'image ci-dessous, elle est soudainement devenue claire.

Images

Images

Mode 4, Collaboration multi-agents

Une fois que l'agent du mode précédent a décomposé des tâches complexes, il est naturel que plusieurs agents soient tenus d'accomplir leurs tâches respectives et de collaborer les uns avec les autres. , travaillez ensemble pour accomplir des tâches complexes.

Photos

Photos

Nous avons déjà partagé un programmeur d'IA open source, GPT Pilot. Son idée de conception est le modèle multi-agent, qui simule divers rôles de chefs de produit, d'architectes, de programmeurs et de testeurs pour terminer le développement de logiciels. . Tâche.

La ville hospitalière IA présentée au début de l'article possède également ce modèle. Je partagerai également des cas pratiques de ce modèle dans le futur.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Dois-je choisir MBR ou GPT comme format de disque dur pour Win7 ?

Jan 03, 2024 pm 08:09 PM

Dois-je choisir MBR ou GPT comme format de disque dur pour Win7 ?

Jan 03, 2024 pm 08:09 PM

Lorsque nous utilisons le système d'exploitation Win7, nous pouvons parfois rencontrer des situations dans lesquelles nous devons réinstaller le système et partitionner le disque dur. Concernant la question de savoir si le format de disque dur win7 nécessite mbr ou gpt, l'éditeur pense que vous devez toujours faire un choix en fonction des détails de votre propre configuration système et matérielle. En termes de compatibilité, il est préférable de choisir le format mbr. Pour plus de détails, regardons ce que l'éditeur a fait ~ Le format de disque dur win7 nécessite mbr ou gpt1 Si le système est installé avec Win7, il est recommandé d'utiliser MBR, qui a une bonne compatibilité. 2. S'il dépasse 3T ou si vous installez Win8, vous pouvez utiliser GPT. 3. Bien que GPT soit effectivement plus avancé que MBR, MBR est définitivement invincible en termes de compatibilité. Zones GPT et MBR

L'arme ultime pour le débogage de Kubernetes : K8sGPT

Feb 26, 2024 am 11:40 AM

L'arme ultime pour le débogage de Kubernetes : K8sGPT

Feb 26, 2024 am 11:40 AM

À mesure que les technologies d’intelligence artificielle et d’apprentissage automatique continuent de se développer, les entreprises et les organisations ont commencé à explorer activement des stratégies innovantes pour tirer parti de ces technologies afin d’améliorer leur compétitivité. K8sGPT[2] est l'un des outils les plus puissants dans ce domaine. Il s'agit d'un modèle GPT basé sur k8s, qui combine les avantages de l'orchestration k8s avec les excellentes capacités de traitement du langage naturel du modèle GPT. Qu'est-ce que K8sGPT ? Regardons d'abord un exemple : Selon le site officiel de K8sGPT : K8sgpt est un outil conçu pour analyser, diagnostiquer et classer les problèmes du cluster Kubernetes. Il intègre l'expérience SRE dans son moteur d'analyse pour fournir les informations les plus pertinentes. Grâce à l'application de la technologie de l'intelligence artificielle, K8sgpt continue d'enrichir son contenu et d'aider les utilisateurs à comprendre plus rapidement et plus précisément.

Compréhension approfondie du format de partition Win10 : comparaison GPT et MBR

Dec 22, 2023 am 11:58 AM

Compréhension approfondie du format de partition Win10 : comparaison GPT et MBR

Dec 22, 2023 am 11:58 AM

Lors du partitionnement de leurs propres systèmes, en raison des différents disques durs utilisés par les utilisateurs, de nombreux utilisateurs ne connaissent pas le format de partition win10 gpt ou mbr. Pour cette raison, nous vous avons présenté une introduction détaillée pour vous aider à comprendre la différence entre les deux. Format de partition Win10 gpt ou mbr : Réponse : Si vous utilisez un disque dur dépassant 3 To, vous pouvez utiliser gpt. gpt est plus avancé que mbr, mais mbr est toujours meilleur en termes de compatibilité. Bien entendu, cela peut également être choisi en fonction des préférences de l'utilisateur. La différence entre gpt et mbr : 1. Nombre de partitions prises en charge : 1. MBR prend en charge jusqu'à 4 partitions principales. 2. GPT n'est pas limité par le nombre de partitions. 2. Taille de disque dur prise en charge : 1. MBR ne prend en charge que jusqu'à 2 To.

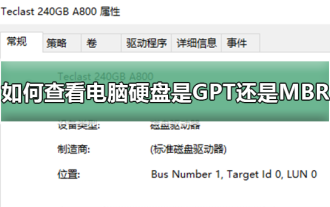

Comment déterminer si le disque dur de l'ordinateur utilise la méthode de partitionnement GPT ou MBR

Dec 25, 2023 pm 10:57 PM

Comment déterminer si le disque dur de l'ordinateur utilise la méthode de partitionnement GPT ou MBR

Dec 25, 2023 pm 10:57 PM

Comment vérifier si le disque dur d'un ordinateur est une partition GPT ou une partition MBR ? Lorsque nous utilisons un disque dur d'ordinateur, nous devons faire la distinction entre GPT et MBR. En fait, cette méthode de vérification est très simple. . Comment vérifier si le disque dur de l'ordinateur est GPT ou MBR 1. Cliquez avec le bouton droit sur « Ordinateur » sur le bureau et cliquez sur « Gérer » 2. Recherchez « Gestion des disques » dans « Gestion » 3. Entrez dans Gestion des disques pour voir l'état général de notre disque dur, puis Comment vérifier le mode de partition de mon disque dur, faites un clic droit sur "Disque 0" et sélectionnez "Propriétés" 4. Basculez vers l'onglet "Volume" dans "Propriétés", nous pouvons alors voir la "Partition du disque Form" et vous pouvez le voir comme Problèmes liés au disque Win10 de la partition MBR Comment convertir la partition MBR en partition GPT >

L'équipe Fudan NLP a publié un aperçu de 80 pages des agents modèles à grande échelle, fournissant un aperçu de l'état actuel et de l'avenir des agents IA dans un seul article.

Sep 23, 2023 am 09:01 AM

L'équipe Fudan NLP a publié un aperçu de 80 pages des agents modèles à grande échelle, fournissant un aperçu de l'état actuel et de l'avenir des agents IA dans un seul article.

Sep 23, 2023 am 09:01 AM

Récemment, l'équipe de traitement du langage naturel de l'Université de Fudan (FudanNLP) a lancé un article de synthèse sur les agents basés sur LLM. Le texte intégral compte 86 pages et contient plus de 600 références ! À partir de l'histoire d'AIAgent, les auteurs ont examiné de manière exhaustive l'état actuel des agents intelligents basés sur de grands modèles de langage, notamment : l'arrière-plan, la composition, les scénarios d'application de l'agent basé sur LLM et la société des agents qui a beaucoup attiré l'attention. Dans le même temps, les auteurs ont discuté de questions prospectives et ouvertes liées à Agent, qui sont d'une grande valeur pour les tendances de développement futures des domaines connexes. Lien papier : https://arxiv.org/pdf/2309.07864.pdfListe des documents LLM-basedAgent :

Combien des trois défauts majeurs du LLM connaissez-vous ?

Nov 26, 2023 am 11:26 AM

Combien des trois défauts majeurs du LLM connaissez-vous ?

Nov 26, 2023 am 11:26 AM

Science : Loin d’être une entité éternellement bienveillante et bénéfique, l’IA générale sensible du futur sera probablement un sociopathe manipulateur qui dévore toutes vos données personnelles et s’effondre ensuite lorsque cela est le plus nécessaire. Traduit de 3WaysLLMsCanLetYouDown, auteur JoabJackson. OpenAI est sur le point de publier GPT-5, et le monde extérieur fonde de grands espoirs sur cela. Les prédictions les plus optimistes pensent même qu'il atteindra l'intelligence artificielle générale. Mais dans le même temps, le PDG Sam Altman et son équipe sont confrontés à de nombreux obstacles sérieux pour le commercialiser, ce qu'il a reconnu plus tôt ce mois-ci. Certains articles de recherche récemment publiés pourraient fournir des indices sur le défi d'Altman. Résumé de ces articles

Pratique de déploiement de la localisation d'Alpaca-lora avec un grand modèle de langage GPT

Jun 01, 2023 pm 09:04 PM

Pratique de déploiement de la localisation d'Alpaca-lora avec un grand modèle de langage GPT

Jun 01, 2023 pm 09:04 PM

Introduction du modèle : Le modèle Alpaca est un modèle open source LLM (Large Language Model, big language) développé par l'Université de Stanford. Il est affiné à partir du modèle LLaMA7B (7B open source de la société Meta) sur 52 000 instructions. paramètres du modèle (plus les paramètres du modèle sont grands, plus les paramètres du modèle sont grands), plus la capacité de raisonnement du modèle est forte, bien sûr, plus le coût de formation du modèle est élevé). LoRA, le nom anglais complet est Low-RankAdaptation of Large Language Models, traduit littéralement par adaptation de bas niveau de grands modèles de langage. Il s'agit d'une technologie développée par les chercheurs de Microsoft pour résoudre le réglage fin des grands modèles de langage. Si vous souhaitez qu'un grand modèle de langage pré-entraîné soit capable d'exécuter un domaine spécifique

Comment a évolué la technologie GPT choisie par Bill Gates, et qui a-t-elle révolutionné la vie ?

May 28, 2023 pm 03:13 PM

Comment a évolué la technologie GPT choisie par Bill Gates, et qui a-t-elle révolutionné la vie ?

May 28, 2023 pm 03:13 PM

Xi Xiaoyao Science and Technology Talks Auteur original | Le QI a complètement chuté, Python Que se passera-t-il si les machines peuvent comprendre et communiquer d'une manière similaire aux humains ? Cela a été un sujet de grande préoccupation dans la communauté universitaire, et grâce à une série de percées dans le traitement du langage naturel ces dernières années, nous pourrions être plus proches que jamais d’atteindre cet objectif. À l'avant-garde de cette avancée se trouve le Generative Pre-trained Transformer (GPT), un modèle de réseau neuronal profond spécialement conçu pour les tâches de traitement du langage naturel. Ses performances exceptionnelles et sa capacité à tenir des conversations efficaces en ont fait l’un des modèles les plus utilisés et les plus efficaces dans le domaine, attirant une attention considérable de la part de la recherche et de l’industrie. Dans un récent rapport détaillé