Périphériques technologiques

Périphériques technologiques

IA

IA

Le modèle mondial se propage aussi ! L'agent formé s'avère plutôt bon

Le modèle mondial se propage aussi ! L'agent formé s'avère plutôt bon

Le modèle mondial se propage aussi ! L'agent formé s'avère plutôt bon

Les modèles mondiaux offrent un moyen de former des agents d'apprentissage par renforcement de manière sûre et efficace en matière d'échantillonnage. Récemment, les modèles mondiaux ont principalement fonctionné sur des séquences de variables latentes discrètes pour simuler la dynamique environnementale.

Cependant, cette méthode de compression en représentations discrètes compactes peut ignorer les détails visuels qui sont importants pour l'apprentissage par renforcement. D’un autre côté, les modèles de diffusion sont devenus la méthode dominante de génération d’images, posant des défis aux modèles latents discrets.

Promotionnés par ce changement de paradigme, des chercheurs de l'Université de Genève, de l'Université d'Édimbourg et de Microsoft Research ont proposé conjointement un agent d'apprentissage par renforcement formé dans un modèle mondial de diffusion - DIAMOND (DIffusion As a Model Of eNvironment Dreams).

- Adresse papier : https://arxiv.org/abs/2405.12399

- Adresse du projet : https://github.com/eloialonso/dia monde

- Titre de l'article : Diffusion pour la modélisation mondiale : les détails visuels comptent dans Atari

Sur le benchmark Atari 100k, DIAMOND+ a atteint un score humain normalisé (HNS) moyen de 1,46. Cela signifie qu'un agent formé au modèle mondial peut être entièrement formé au niveau SOTA d'un agent formé au modèle mondial. Cette étude fournit une analyse de stabilité pour illustrer que les choix de conception DIAMOND sont nécessaires pour garantir la stabilité efficace à long terme du modèle mondial diffusif.

En plus de l'avantage d'opérer dans l'espace image, cela permet au modèle du monde diffus de devenir une représentation directe de l'environnement, offrant ainsi une compréhension plus profonde du modèle du monde et du comportement des agents. L’étude a notamment révélé que les améliorations des performances dans certains jeux résultent d’une meilleure modélisation des détails visuels clés.

Introduction à la méthode

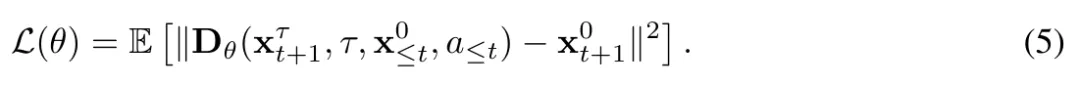

Ensuite, cet article présente DIAMOND, un agent d'apprentissage par renforcement formé dans un modèle mondial de diffusion. Plus précisément, nous nous basons sur les coefficients de dérive et de diffusion f et g introduits dans la section 2.2, qui correspondent à un choix spécifique de paradigme de diffusion. De plus, cette étude a également choisi la formulation EDM basée sur Karras et al.

Définissez d'abord un noyau de perturbation,  , où

, où  est une fonction à valeur réelle liée au temps de diffusion, appelée programme de bruit. Cela correspond à fixer les coefficients de dérive et de diffusion à

est une fonction à valeur réelle liée au temps de diffusion, appelée programme de bruit. Cela correspond à fixer les coefficients de dérive et de diffusion à  et

et  .

.

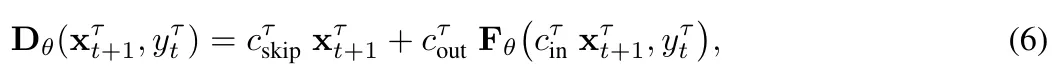

Utilisez ensuite le prétraitement de réseau introduit par Karras et al. (2022), tout en paramétrant  dans l'équation (5) comme la somme pondérée des observations bruyantes et des valeurs prédites du réseau neuronal

dans l'équation (5) comme la somme pondérée des observations bruyantes et des valeurs prédites du réseau neuronal  :

:

Obtenir la formule (6)

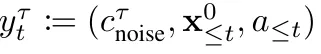

où, par souci de définition concise,  inclut toutes les variables de condition.

inclut toutes les variables de condition.

Sélection du préprocesseur. Les préprocesseurs  et

et  sont choisis pour maintenir la variance unitaire de l'entrée et de la sortie du réseau à n'importe quel niveau de bruit

sont choisis pour maintenir la variance unitaire de l'entrée et de la sortie du réseau à n'importe quel niveau de bruit  .

.  est la conversion empirique du niveau de bruit,

est la conversion empirique du niveau de bruit,  est donné par

est donné par  et l'écart type de la distribution des données

et l'écart type de la distribution des données  , et la formule est

, et la formule est

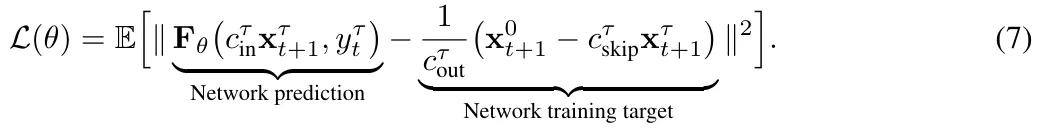

En combinant les formules 5 et 6, nous obtenons l' objectif d'entraînement :

objectif d'entraînement :

Cette étude conditionne le modèle en utilisant le standard U-Net 2D pour construire le champ vectoriel  et en conservant un tampon contenant les L observations et actions passées. Ensuite, ils ont concaténé ces observations passées par canal avec l'observation bruyante suivante et ont introduit les actions dans le bloc résiduel d'U-Net via une couche de normalisation de groupe adaptative. Comme indiqué à la section 2.3 et à l'annexe A, il existe de nombreuses méthodes d'échantillonnage possibles pour générer la prochaine observation à partir d'un modèle de diffusion entraîné. Bien que la base de code publiée par l'étude prenne en charge plusieurs schémas d'échantillonnage, l'étude a révélé que les méthodes d'Euler sont efficaces sans nécessiter de NFE supplémentaire (nombre d'évaluations de fonctions) et en évitant la complexité inutile des échantillonneurs d'ordre supérieur ou de l'échantillonnage aléatoire efficace.

et en conservant un tampon contenant les L observations et actions passées. Ensuite, ils ont concaténé ces observations passées par canal avec l'observation bruyante suivante et ont introduit les actions dans le bloc résiduel d'U-Net via une couche de normalisation de groupe adaptative. Comme indiqué à la section 2.3 et à l'annexe A, il existe de nombreuses méthodes d'échantillonnage possibles pour générer la prochaine observation à partir d'un modèle de diffusion entraîné. Bien que la base de code publiée par l'étude prenne en charge plusieurs schémas d'échantillonnage, l'étude a révélé que les méthodes d'Euler sont efficaces sans nécessiter de NFE supplémentaire (nombre d'évaluations de fonctions) et en évitant la complexité inutile des échantillonneurs d'ordre supérieur ou de l'échantillonnage aléatoire efficace.

Expériences

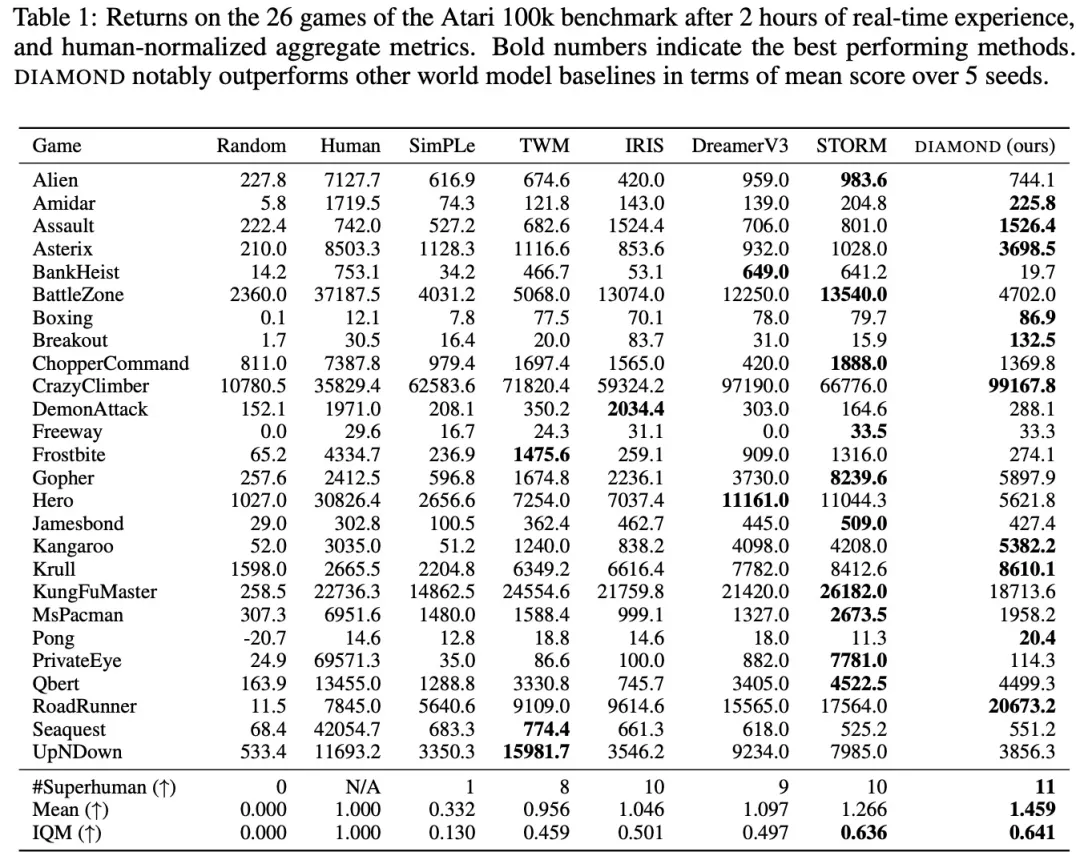

Pour évaluer pleinement DIAMOND, l'étude a utilisé le benchmark bien établi Atari 100k, qui comprend 26 jeux pour tester les larges capacités de l'agent. Pour chaque jeu, l'agent n'avait droit qu'à 100 000 actions dans l'environnement, ce qui équivaut à peu près à 2 heures de temps de jeu humain, pour apprendre à jouer au jeu avant d'être évalué. Pour référence, un agent Atari sans contraintes est généralement formé pour 50 millions d'étapes, ce qui correspond à une expérience 500 fois supérieure. Les chercheurs ont entraîné DIAMOND à partir de zéro pour chaque jeu en utilisant 5 graines aléatoires. Chaque exécution a utilisé environ 12 Go de VRAM et a pris environ 2,9 jours (1,03 années GPU au total) sur un seul Nvidia RTX 4090.

Le tableau 1 compare différents scores pour la formation d'un agent dans le modèle mondial :

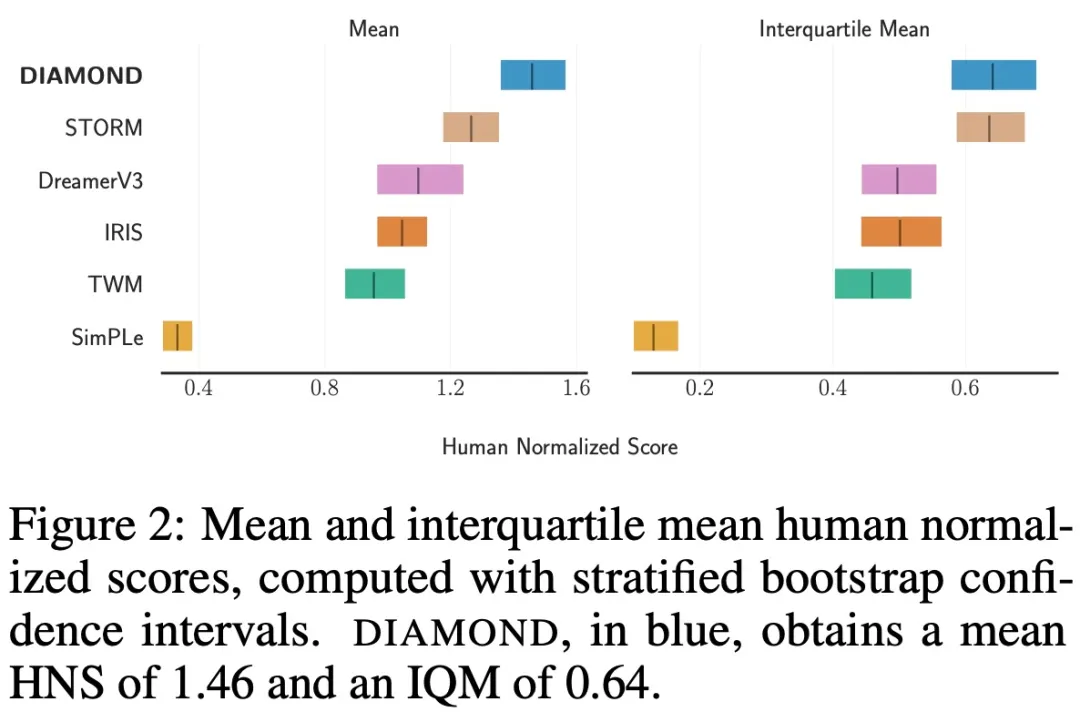

Les intervalles de confiance moyens et IQM (moyenne interquartile) sont fournis dans la figure 2 :

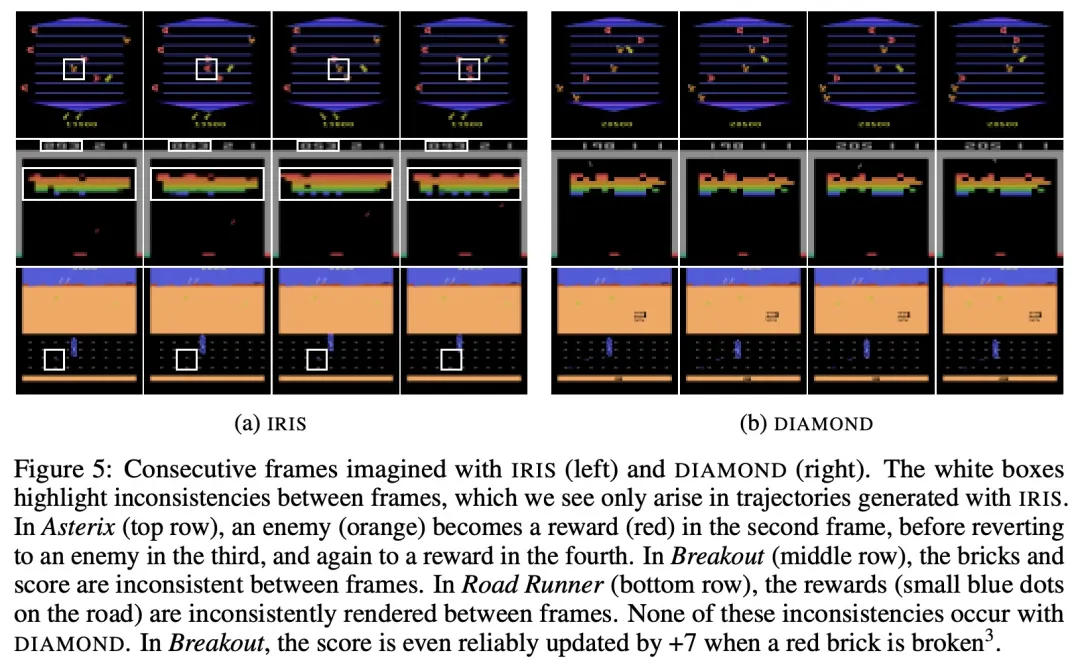

Les résultats montrent que DIAMOND obtient de bons résultats par rapport aux benchmarks, surpassant les joueurs humains dans 11 matchs et atteignant un score HNS de 1,46, un nouveau record pour un agent entièrement formé sur un modèle mondial. L'étude a également révélé que DIAMOND fonctionne particulièrement bien dans les environnements où les détails doivent être capturés, comme Astérix, Breakout et Road Runner.

Afin d'étudier la stabilité des variables de diffusion, cette étude a analysé la trajectoire imaginée générée par autorégression, comme le montre la figure 3 ci-dessous :

L'étude a révélé qu'il existe des situations dans lesquelles des solveurs itératifs sont nécessaires pour conduire le processus d'échantillonnage vers des modes spécifiques, comme le jeu de boxe illustré à la figure 4 :

illustré à la figure 5 par rapport à la trajectoire imaginées par IRIS, les trajectoires imaginées par DIAMOND ont généralement une qualité visuelle supérieure et sont plus cohérentes avec l'environnement réel.

Les lecteurs intéressés peuvent lire le texte original de l'article pour en savoir plus sur le contenu de la recherche.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

Video Face Swap

Échangez les visages dans n'importe quelle vidéo sans effort grâce à notre outil d'échange de visage AI entièrement gratuit !

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Sujets chauds

1670

1670

14

14

1428

1428

52

52

1329

1329

25

25

1276

1276

29

29

1256

1256

24

24

Open source! Au-delà de ZoeDepth ! DepthFM : estimation rapide et précise de la profondeur monoculaire !

Apr 03, 2024 pm 12:04 PM

Open source! Au-delà de ZoeDepth ! DepthFM : estimation rapide et précise de la profondeur monoculaire !

Apr 03, 2024 pm 12:04 PM

0. À quoi sert cet article ? Nous proposons DepthFM : un modèle d'estimation de profondeur monoculaire génératif de pointe, polyvalent et rapide. En plus des tâches traditionnelles d'estimation de la profondeur, DepthFM démontre également des capacités de pointe dans les tâches en aval telles que l'inpainting en profondeur. DepthFM est efficace et peut synthétiser des cartes de profondeur en quelques étapes d'inférence. Lisons ce travail ensemble ~ 1. Titre des informations sur l'article : DepthFM : FastMonocularDepthEstimationwithFlowMatching Auteur : MingGui, JohannesS.Fischer, UlrichPrestel, PingchuanMa, Dmytr

Abandonnez l'architecture codeur-décodeur et utilisez le modèle de diffusion pour la détection des contours avec de meilleurs résultats. L'Université nationale de technologie de la défense a proposé DiffusionEdge.

Feb 07, 2024 pm 10:12 PM

Abandonnez l'architecture codeur-décodeur et utilisez le modèle de diffusion pour la détection des contours avec de meilleurs résultats. L'Université nationale de technologie de la défense a proposé DiffusionEdge.

Feb 07, 2024 pm 10:12 PM

Les réseaux actuels de détection des contours profonds adoptent généralement une architecture d'encodeur-décodeur, qui contient des modules d'échantillonnage ascendant et descendant pour mieux extraire les fonctionnalités à plusieurs niveaux. Cependant, cette structure limite le réseau à produire des résultats de détection de contour précis et détaillés. En réponse à ce problème, un article sur AAAI2024 propose une nouvelle solution. Titre de la thèse : DiffusionEdge : DiffusionProbabilisticModelforCrispEdgeDetection Auteurs : Ye Yunfan (Université nationale de technologie de la défense), Xu Kai (Université nationale de technologie de la défense), Huang Yuxing (Université nationale de technologie de la défense), Yi Renjiao (Université nationale de technologie de la défense), Cai Zhiping (Université nationale de technologie de la défense) Lien vers l'article : https ://ar

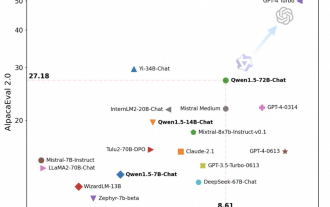

Tongyi Qianwen est à nouveau open source, Qwen1.5 propose six modèles de volume et ses performances dépassent GPT3.5

Feb 07, 2024 pm 10:15 PM

Tongyi Qianwen est à nouveau open source, Qwen1.5 propose six modèles de volume et ses performances dépassent GPT3.5

Feb 07, 2024 pm 10:15 PM

À temps pour la Fête du Printemps, la version 1.5 du modèle Tongyi Qianwen (Qwen) est en ligne. Ce matin, la nouvelle de la nouvelle version a attiré l'attention de la communauté IA. La nouvelle version du grand modèle comprend six tailles de modèle : 0,5B, 1,8B, 4B, 7B, 14B et 72B. Parmi eux, les performances de la version la plus puissante surpassent GPT3.5 et Mistral-Medium. Cette version inclut le modèle de base et le modèle Chat et fournit une prise en charge multilingue. L'équipe Tongyi Qianwen d'Alibaba a déclaré que la technologie pertinente avait également été lancée sur le site officiel de Tongyi Qianwen et sur l'application Tongyi Qianwen. De plus, la version actuelle de Qwen 1.5 présente également les points forts suivants : prend en charge une longueur de contexte de 32 Ko ; ouvre le point de contrôle du modèle Base+Chat ;

Les grands modèles peuvent également être découpés, et Microsoft SliceGPT augmente considérablement l'efficacité de calcul de LAMA-2.

Jan 31, 2024 am 11:39 AM

Les grands modèles peuvent également être découpés, et Microsoft SliceGPT augmente considérablement l'efficacité de calcul de LAMA-2.

Jan 31, 2024 am 11:39 AM

Les grands modèles de langage (LLM) comportent généralement des milliards de paramètres et sont formés sur des milliards de jetons. Cependant, ces modèles sont très coûteux à former et à déployer. Afin de réduire les besoins de calcul, diverses techniques de compression de modèles sont souvent utilisées. Ces techniques de compression de modèles peuvent généralement être divisées en quatre catégories : distillation, décomposition tensorielle (y compris la factorisation de bas rang), élagage et quantification. Les méthodes d'élagage existent depuis un certain temps, mais beaucoup nécessitent un réglage fin de la récupération (RFT) après l'élagage pour maintenir les performances, ce qui rend l'ensemble du processus coûteux et difficile à faire évoluer. Des chercheurs de l'ETH Zurich et de Microsoft ont proposé une solution à ce problème appelée SliceGPT. L'idée principale de cette méthode est de réduire l'intégration du réseau en supprimant des lignes et des colonnes dans la matrice de pondération.

Bonjour, Atlas électrique ! Le robot Boston Dynamics revient à la vie, des mouvements étranges à 180 degrés effraient Musk

Apr 18, 2024 pm 07:58 PM

Bonjour, Atlas électrique ! Le robot Boston Dynamics revient à la vie, des mouvements étranges à 180 degrés effraient Musk

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas entre officiellement dans l’ère des robots électriques ! Hier, l'Atlas hydraulique s'est retiré "en larmes" de la scène de l'histoire. Aujourd'hui, Boston Dynamics a annoncé que l'Atlas électrique était au travail. Il semble que dans le domaine des robots humanoïdes commerciaux, Boston Dynamics soit déterminé à concurrencer Tesla. Après la sortie de la nouvelle vidéo, elle a déjà été visionnée par plus d’un million de personnes en seulement dix heures. Les personnes âgées partent et de nouveaux rôles apparaissent. C'est une nécessité historique. Il ne fait aucun doute que cette année est l’année explosive des robots humanoïdes. Les internautes ont commenté : Les progrès des robots ont fait ressembler la cérémonie d'ouverture de cette année à des êtres humains, et le degré de liberté est bien plus grand que celui des humains. Mais n'est-ce vraiment pas un film d'horreur ? Au début de la vidéo, Atlas est allongé calmement sur le sol, apparemment sur le dos. Ce qui suit est à couper le souffle

LLaVA-1.6, qui rattrape Gemini Pro et améliore les capacités de raisonnement et d'OCR, est trop puissant

Feb 01, 2024 pm 04:51 PM

LLaVA-1.6, qui rattrape Gemini Pro et améliore les capacités de raisonnement et d'OCR, est trop puissant

Feb 01, 2024 pm 04:51 PM

En avril de l'année dernière, des chercheurs de l'Université du Wisconsin-Madison, de Microsoft Research et de l'Université de Columbia ont publié conjointement LLaVA (Large Language and Vision Assistant). Bien que LLaVA ne soit entraîné qu'avec un petit ensemble de données d'instructions multimodales, il montre des résultats d'inférence très similaires à ceux de GPT-4 sur certains échantillons. Puis, en octobre, ils ont lancé LLaVA-1.5, qui a actualisé le SOTA en 11 tests avec de simples modifications par rapport au LLaVA original. Les résultats de cette mise à niveau sont très intéressants, apportant de nouvelles avancées dans le domaine des assistants IA multimodaux. L'équipe de recherche a annoncé le lancement de la version LLaVA-1.6, ciblant le raisonnement, l'OCR et

La version Kuaishou de Sora 'Ke Ling' est ouverte aux tests : génère plus de 120 s de vidéo, comprend mieux la physique et peut modéliser avec précision des mouvements complexes

Jun 11, 2024 am 09:51 AM

La version Kuaishou de Sora 'Ke Ling' est ouverte aux tests : génère plus de 120 s de vidéo, comprend mieux la physique et peut modéliser avec précision des mouvements complexes

Jun 11, 2024 am 09:51 AM

Quoi? Zootopie est-elle concrétisée par l’IA domestique ? Avec la vidéo est exposé un nouveau modèle de génération vidéo domestique à grande échelle appelé « Keling ». Sora utilise une voie technique similaire et combine un certain nombre d'innovations technologiques auto-développées pour produire des vidéos qui comportent non seulement des mouvements larges et raisonnables, mais qui simulent également les caractéristiques du monde physique et possèdent de fortes capacités de combinaison conceptuelle et d'imagination. Selon les données, Keling prend en charge la génération de vidéos ultra-longues allant jusqu'à 2 minutes à 30 ips, avec des résolutions allant jusqu'à 1080p, et prend en charge plusieurs formats d'image. Un autre point important est que Keling n'est pas une démo ou une démonstration de résultats vidéo publiée par le laboratoire, mais une application au niveau produit lancée par Kuaishou, un acteur leader dans le domaine de la vidéo courte. De plus, l'objectif principal est d'être pragmatique, de ne pas faire de chèques en blanc et de se mettre en ligne dès sa sortie. Le grand modèle de Ke Ling est déjà sorti à Kuaiying.

La vitalité de la super intelligence s'éveille ! Mais avec l'arrivée de l'IA qui se met à jour automatiquement, les mères n'ont plus à se soucier des goulots d'étranglement des données.

Apr 29, 2024 pm 06:55 PM

La vitalité de la super intelligence s'éveille ! Mais avec l'arrivée de l'IA qui se met à jour automatiquement, les mères n'ont plus à se soucier des goulots d'étranglement des données.

Apr 29, 2024 pm 06:55 PM

Je pleure à mort. Le monde construit à la folie de grands modèles. Les données sur Internet ne suffisent pas du tout. Le modèle de formation ressemble à « The Hunger Games », et les chercheurs en IA du monde entier se demandent comment nourrir ces personnes avides de données. Ce problème est particulièrement important dans les tâches multimodales. À une époque où rien ne pouvait être fait, une équipe de start-up du département de l'Université Renmin de Chine a utilisé son propre nouveau modèle pour devenir la première en Chine à faire de « l'auto-alimentation des données générées par le modèle » une réalité. De plus, il s’agit d’une approche à deux volets, du côté compréhension et du côté génération, les deux côtés peuvent générer de nouvelles données multimodales de haute qualité et fournir un retour de données au modèle lui-même. Qu'est-ce qu'un modèle ? Awaker 1.0, un grand modèle multimodal qui vient d'apparaître sur le Forum Zhongguancun. Qui est l'équipe ? Moteur Sophon. Fondé par Gao Yizhao, doctorant à la Hillhouse School of Artificial Intelligence de l’Université Renmin.