Périphériques technologiques

Périphériques technologiques

IA

IA

Votre chatbot en révèle-t-il trop ? Explication des attaques par inversion de modèle de réseau neuronal

Votre chatbot en révèle-t-il trop ? Explication des attaques par inversion de modèle de réseau neuronal

Votre chatbot en révèle-t-il trop ? Explication des attaques par inversion de modèle de réseau neuronal

Imaginez que vous êtes au restaurant et que vous venez de déguster le meilleur gâteau que vous ayez jamais mangé. De retour chez vous, vous êtes déterminé à recréer ce chef-d'œuvre culinaire. Au lieu de demander la recette, vous comptez sur vos papilles gustatives et vos connaissances pour déconstruire le dessert et concocter le vôtre.

Et si quelqu'un pouvait faire ça avec vos informations personnelles ? Quelqu’un goûte l’empreinte numérique que vous laissez derrière vous et reconstruit vos informations privées.

C'est l'essence même d'une attaque par inversion de modèle de réseau neuronal, une technique qui pourrait transformer un chatbot IA en un outil de cyberdétective.

Comprendre les attaques d'inversion de modèle de réseau neuronal

Un réseau de neurones est le « cerveau » derrière l'intelligence artificielle (IA) moderne. Ils sont responsables des fonctionnalités impressionnantes derrière la reconnaissance vocale, les chatbots humanisés et l’IA générative.

Les réseaux de neurones sont essentiellement une série d'algorithmes conçus pour reconnaître des modèles, penser et même apprendre comme un cerveau humain. Ils le font à une échelle et à une vitesse qui dépassent de loin nos capacités organiques.

Le livre des secrets de l'IA

Tout comme notre cerveau humain, les réseaux de neurones peuvent cacher des secrets. Ces secrets sont les données que ses utilisateurs leur ont fournies. Dans une attaque par inversion de modèle, un pirate informatique utilise les sorties d'un réseau neuronal (comme les réponses d'un chatbot) pour effectuer une ingénierie inverse des entrées (les informations que vous avez fournies).

Pour exécuter l'attaque, les pirates utilisent leur propre modèle d'apprentissage automatique appelé « modèle d'inversion ». Ce modèle est conçu pour être une sorte d’image miroir, formée non pas sur les données d’origine mais sur les sorties générées par la cible.

Le but de ce modèle d'inversion est de prédire les entrées, les données originales, souvent sensibles, que vous avez introduites dans le chatbot.

Création du modèle d'inversion

La création de l'inversion peut être considérée comme la reconstruction d'un document déchiqueté. Mais au lieu de reconstituer des bandes de papier, il s'agit de reconstituer l'histoire racontée en fonction des réponses du modèle cible.

Le modèle d'inversion apprend le langage des sorties du réseau neuronal. Il recherche des signes révélateurs qui, avec le temps, révèlent la nature des intrants. Avec chaque nouvelle donnée et chaque réponse analysée, il prédit mieux les informations que vous fournissez.

Ce processus est un cycle constant d'hypothèses et de tests. Avec suffisamment de résultats, le modèle d’inversion peut déduire avec précision un profil détaillé de vous, même à partir des données apparemment les plus inoffensives.

Le processus du modèle d'inversion est un jeu consistant à relier les points. Chaque élément de données divulgué lors de l'interaction permet au modèle de former un profil, et avec suffisamment de temps, le profil qu'il forme est détaillé de manière inattendue.

Finalement, des informations sur les activités, les préférences et l'identité de l'utilisateur sont révélées. Des informations qui n’étaient pas destinées à être divulguées ou rendues publiques.

Qu'est-ce qui rend cela possible ?

Au sein des réseaux de neurones, chaque requête et réponse est un point de données. Les attaquants expérimentés déploient des méthodes statistiques avancées pour analyser ces points de données et rechercher des corrélations et des modèles imperceptibles à la compréhension humaine.

Des techniques telles que l'analyse de régression (examinant la relation entre deux variables) pour prédire les valeurs de l'entrée en fonction des sorties que vous recevez.

Les hackers utilisent des algorithmes d'apprentissage automatique dans leurs propres modèles d'inversion pour affiner leurs prédictions. Ils prennent les résultats du chatbot et les introduisent dans leurs algorithmes pour les entraîner à se rapprocher de la fonction inverse du réseau neuronal cible.

En termes simplifiés, la « fonction inverse » fait référence à la façon dont les pirates informatiques inversent le flux de données de la sortie à l'entrée. L’objectif de l’attaquant est d’entraîner ses modèles d’inversion pour qu’ils effectuent la tâche opposée au réseau neuronal d’origine.

Essentiellement, c'est ainsi qu'ils créent un modèle qui, étant donné le seul résultat, tente de calculer ce qu'a dû être l'entrée.

Comment les attaques d'inversion peuvent être utilisées contre vous

Imaginez que vous utilisez un outil d'évaluation de santé en ligne populaire. Vous saisissez vos symptômes, vos conditions antérieures, vos habitudes alimentaires et même votre consommation de drogues pour avoir un aperçu de votre bien-être.

Ce sont des informations sensibles et personnelles.

Avec une attaque d'inversion ciblant le système d'IA que vous utilisez, un pirate informatique pourrait être en mesure de suivre les conseils généraux que le chatbot vous donne et de les utiliser pour déduire vos antécédents médicaux privés. Par exemple, une réponse du chatbot pourrait ressembler à ceci :

Les anticorps antinucléaires (ANA) peuvent être utilisés pour indiquer la présence de maladies auto-immunes telles que le lupus.

Le modèle d'inversion peut prédire que l'utilisateur cible posait des questions liées à une maladie auto-immune. Avec plus d’informations et plus de réponses, les pirates peuvent en déduire que la cible souffre d’un problème de santé grave. Soudainement, cet outil en ligne utile devient un judas numérique sur votre santé personnelle.

Que peut-on faire contre les attaques par inversion ?

Pouvons-nous construire un fort autour de nos données personnelles ? Eh bien, c'est compliqué. Les développeurs de réseaux de neurones peuvent rendre plus difficile la réalisation d’attaques de modèle d’inversion en ajoutant des couches de sécurité et en masquant leur fonctionnement. Voici quelques exemples de techniques utilisées pour protéger les utilisateurs :

Confidentialité différentielle : cela garantit que les sorties de l'IA sont suffisamment « bruyantes » pour masquer les points de données individuels. C'est un peu comme chuchoter dans une foule : vos mots se perdent dans le bavardage collectif de ceux qui vous entourent. Calcul multipartite : cette technique est comme une équipe travaillant sur un projet confidentiel en partageant uniquement les résultats de leurs tâches individuelles, pas les détails sensibles. Il permet à plusieurs systèmes de traiter des données ensemble sans exposer les données des utilisateurs individuels au réseau ou entre eux. Apprentissage fédéré : implique la formation d'une IA sur plusieurs appareils, tout en conservant les données de chaque utilisateur au niveau local. C'est un peu comme une chorale chantant ensemble ; vous pouvez entendre chaque voix, mais aucune voix ne peut être isolée ou identifiée.Même si ces solutions sont largement efficaces, se protéger contre les attaques par inversion est un jeu du chat et de la souris. À mesure que les défenses s’améliorent, les techniques permettant de les contourner s’améliorent également. La responsabilité incombe donc aux entreprises et aux développeurs qui collectent et stockent nos données, mais il existe des moyens de vous protéger.

Comment se protéger contre les attaques d'inversion

Relativement parlant, les réseaux de neurones et les technologies d'IA en sont encore à leurs balbutiements. Jusqu'à ce que les systèmes soient infaillibles, il incombe à l'utilisateur d'être la première ligne de défense lors de la protection de vos données.

Voici quelques conseils pour réduire le risque d'être victime d'une attaque d'inversion :

Soyez un partageur sélectif : traitez vos informations personnelles comme une recette familiale secrète. Soyez sélectif quant aux personnes avec qui vous les partagez, en particulier lorsque vous remplissez des formulaires en ligne et interagissez avec des chatbots. Remettez en question la nécessité de chaque élément de données qui vous est demandé. Si vous ne souhaitez pas partager les informations avec un inconnu, ne les partagez pas avec un chatbot. Gardez les logiciels à jour : les mises à jour des logiciels frontaux, des navigateurs et même de votre système d'exploitation sont conçues pour assurer votre sécurité. Pendant que les développeurs s'affairent à protéger les réseaux de neurones, vous pouvez également réduire le risque d'interception de données en appliquant régulièrement des correctifs et des mises à jour. Gardez les informations personnelles personnelles : chaque fois qu'une application ou un chatbot demande des informations personnelles, faites une pause et réfléchissez à l'intention. Si les informations demandées ne semblent pas pertinentes pour le service fourni, c'est probablement le cas.Vous ne fourniriez pas d'informations sensibles telles que la santé, les finances ou l'identité à une nouvelle connaissance simplement parce qu'elle a dit qu'elle en avait besoin. De même, évaluez quelles informations sont réellement nécessaires au fonctionnement d’une application et refusez de partager davantage.

Sauvegarde de nos informations personnelles à l'ère de l'IA

Nos informations personnelles sont notre atout le plus précieux. Sa protection nécessite de la vigilance, à la fois dans la manière dont nous choisissons de partager les informations et dans l'élaboration de mesures de sécurité pour les services que nous utilisons.

La prise de conscience de ces menaces et la prise de mesures telles que celles décrites dans cet article contribuent à une défense plus forte contre ces vecteurs d'attaque apparemment invisibles.

Engageons-nous pour un avenir où nos informations privées resteront exactement cela : privées.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

Video Face Swap

Échangez les visages dans n'importe quelle vidéo sans effort grâce à notre outil d'échange de visage AI entièrement gratuit !

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Sujets chauds

1673

1673

14

14

1428

1428

52

52

1333

1333

25

25

1277

1277

29

29

1257

1257

24

24

Comment construire des agents d'IA multimodaux à l'aide d'AGNO Framework?

Apr 23, 2025 am 11:30 AM

Comment construire des agents d'IA multimodaux à l'aide d'AGNO Framework?

Apr 23, 2025 am 11:30 AM

Tout en travaillant sur une IA agentique, les développeurs se retrouvent souvent à naviguer dans les compromis entre la vitesse, la flexibilité et l'efficacité des ressources. J'ai exploré le cadre de l'IA agentique et je suis tombé sur Agno (plus tôt c'était Phi-

Comment ajouter une colonne dans SQL? - Analytique Vidhya

Apr 17, 2025 am 11:43 AM

Comment ajouter une colonne dans SQL? - Analytique Vidhya

Apr 17, 2025 am 11:43 AM

Instruction ALTER TABLE de SQL: Ajout de colonnes dynamiquement à votre base de données Dans la gestion des données, l'adaptabilité de SQL est cruciale. Besoin d'ajuster votre structure de base de données à la volée? L'énoncé de la table alter est votre solution. Ce guide détaille l'ajout de Colu

Openai change de mise au point avec GPT-4.1, priorise le codage et la rentabilité

Apr 16, 2025 am 11:37 AM

Openai change de mise au point avec GPT-4.1, priorise le codage et la rentabilité

Apr 16, 2025 am 11:37 AM

La version comprend trois modèles distincts, GPT-4.1, GPT-4.1 Mini et GPT-4.1 Nano, signalant une évolution vers des optimisations spécifiques à la tâche dans le paysage du modèle grand langage. Ces modèles ne remplacent pas immédiatement les interfaces orientées utilisateur comme

Nouveau cours court sur les modèles d'intégration par Andrew Ng

Apr 15, 2025 am 11:32 AM

Nouveau cours court sur les modèles d'intégration par Andrew Ng

Apr 15, 2025 am 11:32 AM

Déverrouiller la puissance des modèles d'intégration: une plongée profonde dans le nouveau cours d'Andrew Ng Imaginez un avenir où les machines comprennent et répondent à vos questions avec une précision parfaite. Ce n'est pas de la science-fiction; Grâce aux progrès de l'IA, cela devient un R

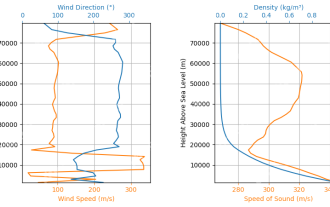

Simulation et analyse de lancement de fusées à l'aide de Rocketpy - Analytics Vidhya

Apr 19, 2025 am 11:12 AM

Simulation et analyse de lancement de fusées à l'aide de Rocketpy - Analytics Vidhya

Apr 19, 2025 am 11:12 AM

Simuler les lancements de fusée avec Rocketpy: un guide complet Cet article vous guide à travers la simulation des lancements de fusées haute puissance à l'aide de Rocketpy, une puissante bibliothèque Python. Nous couvrirons tout, de la définition de composants de fusée à l'analyse de Simula

Google dévoile la stratégie d'agent la plus complète au cloud prochain 2025

Apr 15, 2025 am 11:14 AM

Google dévoile la stratégie d'agent la plus complète au cloud prochain 2025

Apr 15, 2025 am 11:14 AM

Gemini comme fondement de la stratégie d'IA de Google Gemini est la pierre angulaire de la stratégie d'agent AI de Google, tirant parti de ses capacités multimodales avancées pour traiter et générer des réponses à travers le texte, les images, l'audio, la vidéo et le code. Développé par Deepm

Robots humanoïdes open source que vous pouvez imprimer vous-même: les câlins de visage achètent la robotique du pollen

Apr 15, 2025 am 11:25 AM

Robots humanoïdes open source que vous pouvez imprimer vous-même: les câlins de visage achètent la robotique du pollen

Apr 15, 2025 am 11:25 AM

"Super heureux d'annoncer que nous acquérons une robotique de pollen pour amener les robots open source au monde", a déclaré Hugging Face sur X. "Depuis que Remi Cadene nous a rejoints de Tesla, nous sommes devenus la plate-forme logicielle la plus utilisée pour la robotique ouverte grâce à des remerciements grâce à des remerciements grâce à des remerciements à une robotique ouverte grâce à des remerciements à des remerciements à des remerciements à la robotique ouverte grâce à des remerciements à Gérom

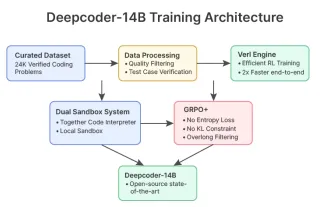

Deepcoder-14b: la compétition open source à O3-MinI et O1

Apr 26, 2025 am 09:07 AM

Deepcoder-14b: la compétition open source à O3-MinI et O1

Apr 26, 2025 am 09:07 AM

Dans un développement significatif pour la communauté de l'IA, Agetica et ensemble AI ont publié un modèle de codage d'IA open source nommé Deepcoder-14b. Offrir des capacités de génération de code à égalité avec des concurrents à source fermée comme OpenAI