Périphériques technologiques

Périphériques technologiques

IA

IA

CVPR 2024 | Pré-formation spatio-temporelle en quatre dimensions du modèle mondial de conduite autonome

CVPR 2024 | Pré-formation spatio-temporelle en quatre dimensions du modèle mondial de conduite autonome

CVPR 2024 | Pré-formation spatio-temporelle en quatre dimensions du modèle mondial de conduite autonome

Peking University dan pasukan inovasi EVLO bersama-sama mencadangkan DriveWorld, algoritma pra-latihan ruang masa empat dimensi untuk pemanduan autonomi. Kaedah ini menggunakan model dunia untuk pra-latihan, mereka bentuk model ruang keadaan memori untuk pemodelan spatio-temporal empat dimensi, dan mengurangkan ketidakpastian rawak dan ketidakpastian pengetahuan yang dihadapi oleh pemanduan autonomi dengan meramalkan grid pekerjaan tempat kejadian. Kertas kerja ini telah diterima oleh CVPR 2024. .

1. Motivasi

Untuk jujukan bingkai video T o1:T yang diperhatikan oleh sistem kamera sekeliling pemanduan autonomi, serta gelagat pakar yang sepadan a1:T dan label grid penghunian tiga dimensi y1:T, di mana label raster Occupancy tiga dimensi boleh diperoleh menggunakan awan titik LiDAR 3D dan data sikap. Kami berhasrat untuk mempelajari perwakilan BEV padat daripada model dunia yang meramalkan grid penghunian 3D semasa dan masa hadapan daripada imej dan tindakan berbilang paparan yang lalu.

2.1 Model kebarangkalian siri masaUntuk memberi model keupayaan untuk memodelkan ruang dan masa empat dimensi, kami mula-mula memperkenalkan dua pembolehubah berpotensi (h1:T, s1:T), di mana ht mewakili pembolehubah maklumat sejarah, termasuk Semua maklumat sejarah pada langkah masa t, st mewakili pembolehubah keadaan rawak, yang merupakan kunci kepada model meramalkan keadaan masa hadapan. ht dikemas kini melalui maklumat sejarah h1:t−1 dan keadaan rawak s1:t−1. Untuk meramalkan keadaan masa hadapan, kami mengikuti Model Ruang Keadaan Berulang (RSSM) dan membina taburan keadaan posterior q(st∣o≤t,a Memandangkan dimensi ciri BEV adalah tinggi, kami menukarnya kepada vektor satu dimensi xt, dan kemudian sampel taburan Gaussian daripada (ht,at−1,xt) untuk menjana taburan keadaan posterior: di mana st diparameterkan sebagai taburan normal dengan kovarians pepenjuru , taburan awal ditetapkan kepada s1∽N(0,I). (μϕ,σϕ) ialah perceptron berbilang lapisan dengan taburan keadaan posterior berparameter. p(st∣ht−1,st−1)∽N(μθ(ht,a^t− 1) ,σθ(ht,a^t−1)I),di mana (μθ,σθ) meparameterkan taburan keadaan sebelumnya. ?? ialah rangkaian dasar yang digunakan untuk meramalkan tindakan a^t−1, berdasarkan maklumat sejarah ht−1 dan keadaan rawak st−1. Dans la compréhension des scènes de la conduite autonome, la prise en compte du mouvement des objets est cruciale pour prédire avec précision les états futurs. Afin de capturer ces informations dynamiques, nous proposons de modéliser le mouvement des objets en introduisant des paramètres de mouvement pour obtenir une perception du mouvement lors de la propagation des informations dynamiques. Nous introduisons la normalisation des couches sensible au mouvement (MLN). Les attributs de mouvement incluent la vitesse v et l'intervalle de temps relatif Δt. (v,Δt) est aplati et transformé en vecteurs affines γ et β à travers deux couches linéaires (ξ1,ξ2) : γ=ξ1(v,Δt),β=ξ2(v,Δt). Une transformation affine est ensuite effectuée pour obtenir l'état stochastique sous-jacent de la perception du mouvement, exprimé par st=γ⋅LN(st)+β. Au fur et à mesure que le véhicule se déplace, l'état historique déterministe ht peut construire une bibliothèque de mémoire dynamique h1:t. En effectuant des calculs de mécanisme d'attention croisée avec la banque de mémoire dynamique, l'état historique déterministe ht peut être obtenu. 2.1.2 Transfert d'informations spatiales Dans la compréhension de la scène de la conduite autonome, en plus des informations sur les changements dynamiques, les informations sur la structure spatiale sont tout aussi importantes. Étant donné que les images de scène continues ne contiennent généralement que des changements mineurs et que le contenu principal de la scène est souvent composé d'objets statiques, tels que des routes, des arbres et des panneaux de signalisation, lors du traitement de ces informations, il est possible de convertir directement l'image d'entrée en image. vecteur unidimensionnel. Cela entraînera la perte d’informations clés sur la structure spatiale. Nous sélectionnons au hasard une image o ′ parmi 1 à T images et utilisons ses caractéristiques BEV b ′ pour construire une représentation statique latente b ^ = zθ (b ′) qui décrit la structure de perception spatiale. Nous combinons la représentation statique spatialement consciente b^ avec la représentation de mouvement à changement dynamique st pour obtenir une représentation complète de la scène environnante. 2.2 Tâches auxiliaires de pré-formation Une compréhension globale de l'environnement environnant est cruciale pour la conduite autonome. Nous proposons de modéliser le monde physique sous la forme d'une structure de grille d'occupation tridimensionnelle pour décrire l'environnement autour du véhicule. Le décodeur de grille d'occupation tridimensionnelle est réglé sur y^t=lθ(mθ(h~t,st),b^), où mθ est un réseau qui étend les caractéristiques unidimensionnelles à la dimension BEV, et lθ est utilisé pour prédire le réseau convolutif 3D de la grille d'occupation. Cette pré-formation sur la grille d'occupation en quatre dimensions peut non seulement capturer la structure statique de la scène, mais également comprendre les changements dynamiques de la scène au fil du temps, offrant ainsi une compréhension environnementale plus riche et plus dynamique pour le système de conduite autonome. 2.3 Mécanisme d'invite de tâche Bien que la représentation spatio-temporelle tridimensionnelle puisse être apprise grâce aux tâches de pré-formation conçues par le modèle mondial, différentes tâches en aval se concentrent sur différentes informations. Pour atténuer ce problème, inspiré des indices sémantiques pour la reconnaissance d'images en quelques prises de vue et des indices visuels guidés par des exemples dans l'apprentissage multitâche, un mécanisme « d'indice de tâche » est introduit pour fournir des indices spécifiques pour différentes tâches afin de les guider pour extraire des informations liées à la tâche. fonctionnalité. Puisqu'il existe des corrélations sémantiques entre différentes tâches, nous utilisons de grands modèles de langage gφ(⋅) (par exemple, BERT, CLIP) pour construire ces astuces de tâches. Par exemple, l'invite de tâche pour la tâche de reconstruction de la grille d'occupation tridimensionnelle se concentre davantage sur la scène actuelle et est définie sur « la tâche consiste à prédire la grille d'occupation tridimensionnelle de la scène actuelle ». Nous saisissons l'invite ptext dans gφ(⋅) pour obtenir l'invite de codage gφ(ptext). Il est ensuite étendu à la dimension de BEV, notée qφ(gφ(ptext)), et intégré aux caractéristiques spatio-temporelles apprises. 2.4 Fonction objectif de pré-entraînement Les objectifs de pré-entraînement de DriveWorld incluent la minimisation de la différence entre la distribution de l'état postérieur et la distribution de l'état antérieur (c'est-à-dire la divergence Kullback-Leibler (KL)) et la minimisation de la différence entre le passé et Perte liée à la future grille d'occupation tridimensionnelle (c'est-à-dire perte d'entropie croisée (CE)) et à l'action (c'est-à-dire perte L1). Nous adoptons le modèle pour observer l'entrée pour T pas de temps, puis prédire la future grille d'occupation tridimensionnelle et L étapes d'actions. 3. Expérimentation 3.1 Paramètres expérimentaux Nous avons pré-entraîné sur nuScenes et OpenScenes sur l'ensemble de données de conduite autonome, et affiné sur nuScenes. Nous utilisons l'agrégation de nuages de points LiDAR multi-trames pour obtenir des étiquettes de grille d'occupation 3D denses. 3.2 Résultats expérimentaux Une partie des résultats est présentée ici Pour plus de résultats, veuillez vous référer à l'article. 4. Résumé DriveWorld améliore les capacités de compréhension et de prédiction de l'environnement du système de conduite autonome grâce à un pré-entraînement spatio-temporel en quatre dimensions basé sur le modèle du monde, et réduit l'incertitude rencontrée par la conduite autonome. DriveWorld a proposé un modèle spatial d'état de mémoire pour la modélisation spatio-temporelle, qui comprend un module de stockage de mémoire dynamique pour l'apprentissage des représentations sensibles au timing et un module de propagation de scène statique pour l'apprentissage des représentations sensibles à l'espace. Afin d'améliorer encore l'adaptabilité et la flexibilité du modèle, DriveWorld introduit également un mécanisme d'invite de tâches, qui permet au modèle d'ajuster sa représentation de manière adaptative en fonction des exigences actuelles de la tâche, obtenant ainsi les meilleures performances dans différentes tâches de conduite autonome. Référence [1]Chen Min, et al. Pré-formation unifiée multi-caméras via la reconstruction de scènes 3D[J]. IEEE Robotics and Automation Letters, 2024. [2]Chen Min, et al. Occupation-mae : nuages de points lidar à grande échelle de pré-formation auto-supervisés avec auto-encodeurs d'occupation masqués [J]. Transactions IEEE sur les véhicules intelligents, 2023. Introduction à l'équipe d'innovation EVOL Zhao Jian, China Telecom Artificial Directeur du renseignement et jeune scientifique du Laboratoire d'apprentissage cognitif multimédia (EVOL Lab) de l'Intelligent Research Institute, chercheur et directeur de doctorat à l'Institut d'optoélectronique et d'intelligence de la Northwestern Polytechnical University. Il est diplômé de l'Université nationale de Singapour avec un doctorat. les intérêts de recherche incluent l’analyse multimédia, la sécurité locale et l’incarnation intelligente. Au total, plus de 60 articles CCF-A ont été publiés, dont un T-PAMI×2 (IF : 24,314) et IJCV×3 (IF : 13,369). Le premier inventeur a autorisé 5 brevets d'invention nationaux. Des avancées technologiques pertinentes ont été appliquées par six entreprises leaders du secteur technologique, dont Baidu, Ant Financial et Qihoo 360, et ont produit des avantages significatifs. Il a été sélectionné dans le « Projet de promotion des jeunes talents » de l'Association chinoise pour la science et la technologie et de l'Association de Pékin pour la science et la technologie, et a accueilli 6 projets, dont le Fonds national pour les sciences naturelles de la jeunesse. A remporté le Wu Wenjun Artificial Intelligence Outstanding Youth Award (2023), le premier prix du Wu Wenjun Artificial Intelligence Natural Science Award (2/5, 2022), le prix Lee Hwee Kuan de la Singapore Pattern Recognition and Machine Intelligence Association (PREMIA) et le seul meilleur étudiant de l'ACM Multimedia Paper Award (premier ouvrage, 1/208, conférence CCF-A, 2018), a remporté le championnat 7 fois lors d'importants événements scientifiques et technologiques internationaux. A été directeur de la Beijing Image and Graphics Society, membre du comité de rédaction des revues de renommée internationale "Artificial Intelligence Advances" et "IET Computer Vision", rédacteur invité des numéros spéciaux de "Pattern Recognition Letters" et "Electronics ", président principal de VALSE et buteur de l'ACM Multimedia 2021. Président du forum, président de la zone CICAI 2022/2023, président du forum CCBR 2024, membre senior de la China Artificial Intelligence Society/China Image and Graphics Society, juge du "Challenge Cup" Concours de travaux scientifiques et technologiques pour étudiants universitaires, membre du comité d'experts du Concours chinois d'intelligence artificielle, etc. Page d'accueil de GitHub : https://zhaoj9014.github.io Page d'accueil du Collège : https://www.php.cn/link/2e36742b377be90ffbf553692153d9a1 Jin Lei , Associé émérite de l'Université des postes et télécommunications de Pékin Chercheur, les principales orientations de recherche comprennent la vision par ordinateur, l'exploration de données et la reconnaissance de formes, avec des recherches approfondies sur l'estimation de la posture humaine, la reconnaissance des actions humaines, l'analyse du corps humain et d'autres subdivisions. Les résultats connexes ont été publiés dans des conférences et des revues de haut niveau telles que. comme CVPR, AAAI, NIPS et ACMMM, et ont été publiés au total. Il existe plus de 40 articles indexés SCI/EI, dont 11 articles de haut niveau, y compris des articles publiés en tant que premier auteur dans la zone 1 du JCR de l'Académie chinoise. of Sciences (IEEE Transactions on MultiMedia), conférence CCF-A CVPR, articles ACMMM, articles JCR Area 2 de l'Académie chinoise des sciences (Capteurs), IEEE Sensor Journal), etc. Nous avons accueilli un fonds pour la jeunesse de la Fondation nationale des sciences naturelles de Chine et participé à deux projets nationaux clés de R&D et à quatre projets de la Fondation nationale des sciences naturelles de Chine. Nous nous sommes appuyés sur des conférences de haut niveau pour organiser à de nombreuses reprises des ateliers ICCV2021/CVPR2023 (Anti-UAV Workshop & Challenge). Guider les étudiants pour qu'ils remportent le premier prix du concours « Trois innovations » de technologie et d'application du bio-Internet du Collège national (concours de catégorie A reconnu par l'Université des postes et télécommunications de Pékin). Min Cheng, Ph.D. de l'École d'informatique de l'Université de Pékin, assistant de recherche spécial à l'Institut de technologie informatique de l'Académie chinoise des sciences. Ses principaux domaines de recherche incluent la conduite autonome, l'intelligence incarnée et trois-. reconstruction dimensionnelle. Des résultats pertinents ont été publiés dans des conférences et des conférences de haut niveau telles que CVPR, ICCV, ICRA et RAL, y compris la conférence CCF-A CVPR en tant que premier auteur, la meilleure conférence de robotique ICRA, la revue de robotique faisant autorité RAL, etc. . Participation à un certain nombre de projets nationaux clés de R&D.

2.1.1 Pemesejan dinamik

L'état historique déterministe est ht+1=fθ(ht,st).

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

Video Face Swap

Échangez les visages dans n'importe quelle vidéo sans effort grâce à notre outil d'échange de visage AI entièrement gratuit !

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Sujets chauds

1667

1667

14

14

1426

1426

52

52

1328

1328

25

25

1273

1273

29

29

1255

1255

24

24

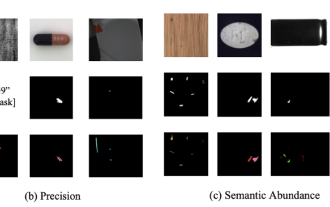

Repoussant les limites de la détection de défauts traditionnelle, « Defect Spectrum » permet pour la première fois une détection de défauts industriels d'une ultra haute précision et d'une sémantique riche.

Jul 26, 2024 pm 05:38 PM

Repoussant les limites de la détection de défauts traditionnelle, « Defect Spectrum » permet pour la première fois une détection de défauts industriels d'une ultra haute précision et d'une sémantique riche.

Jul 26, 2024 pm 05:38 PM

Dans la fabrication moderne, une détection précise des défauts est non seulement la clé pour garantir la qualité des produits, mais également la clé de l’amélioration de l’efficacité de la production. Cependant, les ensembles de données de détection de défauts existants manquent souvent de précision et de richesse sémantique requises pour les applications pratiques, ce qui rend les modèles incapables d'identifier des catégories ou des emplacements de défauts spécifiques. Afin de résoudre ce problème, une équipe de recherche de premier plan composée de l'Université des sciences et technologies de Hong Kong, Guangzhou et de Simou Technology a développé de manière innovante l'ensemble de données « DefectSpectrum », qui fournit une annotation à grande échelle détaillée et sémantiquement riche des défauts industriels. Comme le montre le tableau 1, par rapport à d'autres ensembles de données industrielles, l'ensemble de données « DefectSpectrum » fournit le plus grand nombre d'annotations de défauts (5 438 échantillons de défauts) et la classification de défauts la plus détaillée (125 catégories de défauts).

Formation avec des millions de données cristallines pour résoudre le problème de la phase cristallographique, la méthode d'apprentissage profond PhAI est publiée dans Science

Aug 08, 2024 pm 09:22 PM

Formation avec des millions de données cristallines pour résoudre le problème de la phase cristallographique, la méthode d'apprentissage profond PhAI est publiée dans Science

Aug 08, 2024 pm 09:22 PM

Editeur | KX À ce jour, les détails structurels et la précision déterminés par cristallographie, des métaux simples aux grandes protéines membranaires, sont inégalés par aucune autre méthode. Cependant, le plus grand défi, appelé problème de phase, reste la récupération des informations de phase à partir d'amplitudes déterminées expérimentalement. Des chercheurs de l'Université de Copenhague au Danemark ont développé une méthode d'apprentissage en profondeur appelée PhAI pour résoudre les problèmes de phase cristalline. Un réseau neuronal d'apprentissage en profondeur formé à l'aide de millions de structures cristallines artificielles et de leurs données de diffraction synthétique correspondantes peut générer des cartes précises de densité électronique. L'étude montre que cette méthode de solution structurelle ab initio basée sur l'apprentissage profond peut résoudre le problème de phase avec une résolution de seulement 2 Angströms, ce qui équivaut à seulement 10 à 20 % des données disponibles à la résolution atomique, alors que le calcul ab initio traditionnel

Le modèle de dialogue NVIDIA ChatQA a évolué vers la version 2.0, avec la longueur du contexte mentionnée à 128 Ko

Jul 26, 2024 am 08:40 AM

Le modèle de dialogue NVIDIA ChatQA a évolué vers la version 2.0, avec la longueur du contexte mentionnée à 128 Ko

Jul 26, 2024 am 08:40 AM

La communauté ouverte LLM est une époque où une centaine de fleurs fleurissent et s'affrontent. Vous pouvez voir Llama-3-70B-Instruct, QWen2-72B-Instruct, Nemotron-4-340B-Instruct, Mixtral-8x22BInstruct-v0.1 et bien d'autres. excellents interprètes. Cependant, par rapport aux grands modèles propriétaires représentés par le GPT-4-Turbo, les modèles ouverts présentent encore des lacunes importantes dans de nombreux domaines. En plus des modèles généraux, certains modèles ouverts spécialisés dans des domaines clés ont été développés, tels que DeepSeek-Coder-V2 pour la programmation et les mathématiques, et InternVL pour les tâches de langage visuel.

Google AI a remporté la médaille d'argent de l'Olympiade mathématique de l'OMI, le modèle de raisonnement mathématique AlphaProof a été lancé et l'apprentissage par renforcement est de retour.

Jul 26, 2024 pm 02:40 PM

Google AI a remporté la médaille d'argent de l'Olympiade mathématique de l'OMI, le modèle de raisonnement mathématique AlphaProof a été lancé et l'apprentissage par renforcement est de retour.

Jul 26, 2024 pm 02:40 PM

Pour l’IA, l’Olympiade mathématique n’est plus un problème. Jeudi, l'intelligence artificielle de Google DeepMind a réalisé un exploit : utiliser l'IA pour résoudre la vraie question de l'Olympiade mathématique internationale de cette année, l'OMI, et elle n'était qu'à un pas de remporter la médaille d'or. Le concours de l'OMI qui vient de se terminer la semaine dernière comportait six questions portant sur l'algèbre, la combinatoire, la géométrie et la théorie des nombres. Le système d'IA hybride proposé par Google a répondu correctement à quatre questions et a marqué 28 points, atteignant le niveau de la médaille d'argent. Plus tôt ce mois-ci, le professeur titulaire de l'UCLA, Terence Tao, venait de promouvoir l'Olympiade mathématique de l'IA (AIMO Progress Award) avec un prix d'un million de dollars. De manière inattendue, le niveau de résolution de problèmes d'IA s'était amélioré à ce niveau avant juillet. Posez les questions simultanément sur l'OMI. La chose la plus difficile à faire correctement est l'OMI, qui a la plus longue histoire, la plus grande échelle et la plus négative.

PRO | Pourquoi les grands modèles basés sur le MoE méritent-ils davantage d'attention ?

Aug 07, 2024 pm 07:08 PM

PRO | Pourquoi les grands modèles basés sur le MoE méritent-ils davantage d'attention ?

Aug 07, 2024 pm 07:08 PM

En 2023, presque tous les domaines de l’IA évoluent à une vitesse sans précédent. Dans le même temps, l’IA repousse constamment les limites technologiques de domaines clés tels que l’intelligence embarquée et la conduite autonome. Sous la tendance multimodale, le statut de Transformer en tant qu'architecture dominante des grands modèles d'IA sera-t-il ébranlé ? Pourquoi l'exploration de grands modèles basés sur l'architecture MoE (Mixture of Experts) est-elle devenue une nouvelle tendance dans l'industrie ? Les modèles de grande vision (LVM) peuvent-ils constituer une nouvelle avancée dans la vision générale ? ...Dans la newsletter des membres PRO 2023 de ce site publiée au cours des six derniers mois, nous avons sélectionné 10 interprétations spéciales qui fournissent une analyse approfondie des tendances technologiques et des changements industriels dans les domaines ci-dessus pour vous aider à atteindre vos objectifs dans le nouveau année. Cette interprétation provient de la Week50 2023

Afin de fournir un nouveau système de référence et d'évaluation de questions-réponses scientifiques et complexes pour les grands modèles, l'UNSW, Argonne, l'Université de Chicago et d'autres institutions ont lancé conjointement le cadre SciQAG.

Jul 25, 2024 am 06:42 AM

Afin de fournir un nouveau système de référence et d'évaluation de questions-réponses scientifiques et complexes pour les grands modèles, l'UNSW, Argonne, l'Université de Chicago et d'autres institutions ont lancé conjointement le cadre SciQAG.

Jul 25, 2024 am 06:42 AM

L'ensemble de données ScienceAI Question Answering (QA) joue un rôle essentiel dans la promotion de la recherche sur le traitement du langage naturel (NLP). Des ensembles de données d'assurance qualité de haute qualité peuvent non seulement être utilisés pour affiner les modèles, mais également évaluer efficacement les capacités des grands modèles linguistiques (LLM), en particulier la capacité à comprendre et à raisonner sur les connaissances scientifiques. Bien qu’il existe actuellement de nombreux ensembles de données scientifiques d’assurance qualité couvrant la médecine, la chimie, la biologie et d’autres domaines, ces ensembles de données présentent encore certaines lacunes. Premièrement, le formulaire de données est relativement simple, et la plupart sont des questions à choix multiples. Elles sont faciles à évaluer, mais limitent la plage de sélection des réponses du modèle et ne peuvent pas tester pleinement la capacité du modèle à répondre aux questions scientifiques. En revanche, les questions et réponses ouvertes

Le taux de précision atteint 60,8 %. Le modèle de prédiction de rétrosynthèse chimique de l'Université du Zhejiang basé sur Transformer a été publié dans la sous-journal Nature.

Aug 06, 2024 pm 07:34 PM

Le taux de précision atteint 60,8 %. Le modèle de prédiction de rétrosynthèse chimique de l'Université du Zhejiang basé sur Transformer a été publié dans la sous-journal Nature.

Aug 06, 2024 pm 07:34 PM

Editeur | KX La rétrosynthèse est une tâche essentielle dans la découverte de médicaments et la synthèse organique, et l'IA est de plus en plus utilisée pour accélérer le processus. Les méthodes d’IA existantes ont des performances insatisfaisantes et une diversité limitée. En pratique, les réactions chimiques provoquent souvent des modifications moléculaires locales, avec un chevauchement considérable entre les réactifs et les produits. Inspirée par cela, l'équipe de Hou Tingjun de l'Université du Zhejiang a proposé de redéfinir la prédiction rétrosynthétique en une seule étape en tant que tâche d'édition de chaînes moléculaires, en affinant de manière itérative la chaîne moléculaire cible pour générer des composés précurseurs. Et un modèle rétrosynthétique basé sur l'édition, EditRetro, est proposé, qui permet d'obtenir des prédictions diverses et de haute qualité. Des expériences approfondies montrent que le modèle atteint d'excellentes performances sur l'ensemble de données de référence standard USPTO-50 K, avec une précision top 1 de 60,8 %.

Le point de vue de la nature : les tests de l'intelligence artificielle en médecine sont dans le chaos. Que faut-il faire ?

Aug 22, 2024 pm 04:37 PM

Le point de vue de la nature : les tests de l'intelligence artificielle en médecine sont dans le chaos. Que faut-il faire ?

Aug 22, 2024 pm 04:37 PM

Editeur | ScienceAI Sur la base de données cliniques limitées, des centaines d'algorithmes médicaux ont été approuvés. Les scientifiques se demandent qui devrait tester les outils et comment le faire au mieux. Devin Singh a vu un patient pédiatrique aux urgences subir un arrêt cardiaque alors qu'il attendait un traitement pendant une longue période, ce qui l'a incité à explorer l'application de l'IA pour réduire les temps d'attente. À l’aide des données de triage des salles d’urgence de SickKids, Singh et ses collègues ont construit une série de modèles d’IA pour fournir des diagnostics potentiels et recommander des tests. Une étude a montré que ces modèles peuvent accélérer les visites chez le médecin de 22,3 %, accélérant ainsi le traitement des résultats de près de 3 heures par patient nécessitant un examen médical. Cependant, le succès des algorithmes d’intelligence artificielle dans la recherche ne fait que le vérifier.