Périphériques technologiques

Périphériques technologiques

IA

IA

Intégrant plus de 200 études connexes, la dernière revue du grand modèle « apprentissage tout au long de la vie » est ici

Intégrant plus de 200 études connexes, la dernière revue du grand modèle « apprentissage tout au long de la vie » est ici

Intégrant plus de 200 études connexes, la dernière revue du grand modèle « apprentissage tout au long de la vie » est ici

La rubrique AIxiv est une rubrique où des contenus académiques et techniques sont publiés sur ce site. Au cours des dernières années, la rubrique AIxiv de ce site a reçu plus de 2 000 rapports, couvrant les meilleurs laboratoires des principales universités et entreprises du monde entier, favorisant efficacement les échanges et la diffusion académiques. Si vous souhaitez partager un excellent travail, n'hésitez pas à contribuer ou à nous contacter pour un rapport. Courriel de soumission : liyazhou@jiqizhixin.com ; zhaoyunfeng@jiqizhixin.com

Titre de l'article : Vers un apprentissage tout au long de la vie des grands modèles linguistiques : une enquête Institution : Chine du Sud Université de technologie Adresse papier : https://arxiv.org/abs/2406.06391 Adresse du projet : https://github .com/ qianlima-lab/awesome-lifelong-learning-methods-for-llm

Classification des romans : introduction Un cadre structuré détaillé a été développé qui a divisé la vaste littérature sur l'apprentissage tout au long de la vie en 12 scénarios Techniques universelles : des techniques communes à toutes les situations d'apprentissage tout au long de la vie ont été identifiées et présentées. Il existe une littérature divisée en différents ; groupes techniques dans chaque scénario ; Orientations futures : accent sur certaines technologies émergentes telles que l'extension de modèle et la sélection de données, qui étaient moins explorées à l'ère pré-LLM.

Les connaissances internes font référence à l'absorption de nouvelles connaissances dans les paramètres du modèle par le biais d'une formation complète ou partielle, y compris une pré-formation continue et un réglage fin continu. -

Les connaissances externes font référence à l'incorporation de nouvelles connaissances provenant de ressources externes telles que Wikipédia ou des interfaces de programmes d'application dans le modèle sans mettre à jour les paramètres du modèle, y compris l'apprentissage tout au long de la vie basé sur la récupération et les outils d'apprentissage tout au long de la vie.

- Préformation continue dans le domaine vertical : pour des domaines verticaux spécifiques (tels que la finance, la médecine, etc.).

- Préformation continue dans le domaine du langage : Préformation continue pour le langage naturel et le langage codé.

- Pré-entraînement continu du domaine temporel : pré-entraînement continu pour les données liées au temps (telles que les données de séries chronologiques).

- Spécifique à la tâche :

- Classification continue de texte : pour les tâches de classification de texte Affinement continu.

- Reconnaissance continue d'entités nommées : ajustement continu des tâches de reconnaissance d'entités nommées.

- Extraction continue de relations : réglage fin continu des tâches d'extraction de relations.

- Traduction automatique continue : ajustement continu des tâches de traduction automatique.

- Agnostique de la tâche :

- Réglage continu des instructions : l'apprentissage continu du modèle est obtenu grâce à un réglage fin des instructions.

- Édition continue des connaissances : Apprentissage continu pour la mise à jour des connaissances.

- Alignement continu : apprentissage continu pour aligner le modèle avec de nouvelles tâches.

1. Apprentissage tout au long de la vie basé sur la récupération : apprentissage tout au long de la vie obtenu en récupérant des bases de connaissances externes.

2. Apprentissage tout au long de la vie basé sur des outils : apprentissage tout au long de la vie obtenu en faisant appel à des outils externes.

L'objectif de l'apprentissage tout au long de la vie est d'apprendre un modèle de langage à partir d'une série de tâches et de générer un résultat cible en saisissant un langage naturel. Plus précisément, pour les tâches de génération, telles que les questions et les réponses, l'entrée et la sortie représentent respectivement les questions et les réponses ; pour les tâches de traduction automatique, l'entrée et la sortie représentent la langue source et la langue cible pour les tâches de classification de texte, l'entrée est le contenu du texte et la langue cible ; la sortie est des étiquettes de catégorie ; Pour la tâche de pré-entraînement du modèle de langage autorégressif, l'entrée est une série de jetons et la sortie est le jeton suivant correspondant.

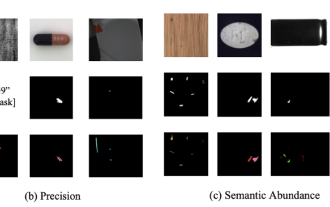

L'aperçu introduit l'évaluation tout au long de la vie Les indicateurs de l'effet d'apprentissage sont principalement évalués sous trois angles : performance globale, stabilité et adaptabilité :

- Mesure globale : y compris Précision moyenne (AA) et moyenne précision incrémentielle (AIA). AA fait référence à la performance moyenne du modèle après l'apprentissage de toutes les tâches, tandis que AIA prend en compte les changements historiques après l'apprentissage de chaque tâche.

- Mesure de stabilité : y compris la mesure de l'oubli (FGT) et le transfert vers l'arrière (BWT). FGT évalue la dégradation moyenne des performances des anciennes tâches, tandis que BWT évalue le changement moyen des performances des anciennes tâches.

- Mesure de plasticité : y compris le transfert vers l'avant (FWD), qui est l'amélioration moyenne des performances du modèle sur de nouvelles tâches.

Résumé dans la figure 3 Quatre Il a été démontré que les principales méthodes d'apprentissage tout au long de la vie traitent le problème d'oubli catastrophique des grands modèles de langage lors du traitement de tâches continues (Tâche

의미: 이 방법은 새 작업을 훈련할 때 사용됩니다. 이전 작업의 데이터를 재생하여 모델의 오래된 작업 기억. 일반적으로 재생된 데이터는 버퍼에 저장되어 현재 작업의 데이터와 함께 학습에 사용됩니다. 주로 다음을 포함합니다:

– 경험 재생: 이전 작업의 데이터 샘플 중 일부를 저장하고 새로운 작업 발생을 훈련할 때 이러한 데이터를 훈련에 재사용하여 망각을 줄입니다.

– 생성적 재생: 이전 데이터를 저장하는 것과 달리 이 방법은 생성 모델을 사용하여 유사 샘플을 생성함으로써 이전 작업에 대한 지식을 새 작업 학습에 도입합니다.

그림 3은 Task t-1에서 Task t까지의 과정을 보여줍니다. , 버퍼에 있는 이전 데이터(입력 t-1 )가 사용됩니다.

- 의미: 이 방법은 모델 매개변수에 정규화 제약 조건을 적용하여 새 작업을 학습할 때 모델이 이전 작업 매개변수를 과도하게 조정하는 것을 방지합니다. 정규화 제약조건은 모델이 이전 작업의 메모리를 유지하는 데 도움이 될 수 있습니다. 주로 다음을 포함합니다:

- 그림 3은 Task

t-1에서 Task t까지의 과정을 보여줍니다. , 매개변수 정규화는 Task t-1의 성능을 유지하는 데 사용됩니다.

(c) 아키텍처 기반 방법:

- 의미: 이 접근 방식은 이전에 학습한 지식과의 간섭을 최소화하면서 새로운 작업을 원활하게 통합하기 위해 모델 구조를 조정하는 데 중점을 둡니다. 여기에는 주로 그림 4의 6가지 방법이 포함됩니다.

- –(a) 프롬프트 조정: 모델 입력 앞에 "소프트 프롬프트"를 추가하여 모델 생성 또는 분류 작업을 안내합니다. 이 방법은 모델의 백본 구조를 변경하지 않고 소수의 매개변수(예: 프롬프트 단어)만 조정하면 됩니다.

–(b) 접두사 조정: 훈련된 조정 가능한 매개변수를 입력 시퀀스의 접두사 부분에 추가합니다. 이러한 매개변수는 모델이 상황별 정보를 더 잘 캡처하는 데 도움이 되도록 Transformer 레이어의 self-attention 메커니즘에 삽입됩니다.

–(c) Low-Rank Adaptation(LoRA, Low-Rank Adaptation): LoRA는 대형 모델의 주요 가중치를 변경하지 않고 특정 수준에 하위 행렬을 추가하여 새로운 작업에 적응합니다. 이 접근 방식은 모델 성능을 유지하면서 매개변수 조정 횟수를 크게 줄입니다.

–(d) 어댑터: 어댑터는 모델의 여러 레이어 사이에 삽입된 학습 가능한 모듈입니다. 이러한 모듈은 원래 모델 가중치를 변경하지 않고 소수의 추가 매개변수로 적응할 수 있습니다. 일반적으로 FFN(Feed Forward Network) 및 MHA(Multi-Head Attention) 부분에 적용됩니다.

–(e) 전문가 혼합: 모델의 특정 계층 또는 하위 네트워크일 수 있는 특정 "전문가" 모듈을 선택적으로 활성화하여 다양한 입력을 처리합니다. 라우터 모듈은 활성화해야 할 전문가 모듈을 결정하는 역할을 담당합니다.

–(f) 모델 확장: 원본 레이어(Old Layer)를 유지하면서 새 레이어(New Layer)를 추가하여 모델의 용량을 확장합니다. 이 접근 방식을 통해 모델은 보다 복잡한 작업 요구 사항을 수용할 수 있도록 용량을 점진적으로 늘릴 수 있습니다.

그림: 그림 3은 Task t-1에서 Task t까지의 과정을 보여줍니다. 모델이 새로운 작업을 학습하면 일부 매개변수가 동결됩니다. 새로 추가된 모듈은 새로운 작업을 훈련하는 데 사용됩니다(Trainable).

의미: 이 방법은 지식 증류를 통해 이전 모델의 지식을 새 모델로 전달합니다. 새 작업을 훈련할 때 새 모델은 현재 작업의 데이터를 학습할 뿐만 아니라 이전 작업에 대해 이전 모델의 출력을 모방하여 이전 작업에 대한 지식을 유지합니다. 주로 다음을 포함합니다:

그림: 그림 3은 작업 t-1에서 작업 t으로의 전환을 보여줍니다. 프로세스에서 모델이 새로운 작업을 훈련할 때 이전 모델의 예측 결과를 모방하여 이전 작업에 대한 지식을 유지합니다.

예: CorpusBrain++는 백본 어댑터 아키텍처와 경험 재생 전략을 사용하여 실제 지식 집약적인 언어 작업을 처리합니다. 예: Med-PaLM은 소수의 예를 사용하여 의료 분야의 지시 프롬프트 튜닝을 도입합니다.

예: ELLE 기존 사전 학습된 언어 모델의 폭과 깊이를 유연하게 확장하여 지식 획득 및 통합의 효율성을 높이기 위해 기능 보존 모델 확장 전략을 채택합니다. 예: LLaMA Pro는 Transformer 블록을 확장하고 새로운 코퍼스로 미세 조정하여 일반 사용, 프로그래밍 및 수학 작업에 탁월합니다.

-

예: Gupta et al.이 제안한 전략은 새로운 데이터 세트를 도입할 때 학습률을 조정하여 장기 훈련 중에 학습률이 너무 낮아지는 것을 방지함으로써 새로운 데이터 세트에 대한 적응 효과를 향상시킵니다.

예: RHO -1은 훈련 프로세스에 더 큰 영향을 미치는 토큰의 우선순위를 지정하는 SLM(선택적 언어 모델)로 훈련됩니다. 예: EcomGPT-CT는 반구조화된 전자상거래 데이터를 사용하여 도메인별 작업에 대한 모델 성능을 향상합니다.

예: Yadav 등은 교사 강제 메커니즘을 도입하여 새로운 작업에 대한 모델의 미세 조정을 안내하는 프롬프트 세트를 생성하여 프롬프트 조정을 개선합니다. 예: ModuleFormer와 Lifelong-MoE는 전문가 혼합(MoE) 접근 방식을 사용하여 모듈화 및 동적으로 모델 용량 증가를 통해 LLM의 효율성과 적응성을 향상합니다.

-

예: Ibrahim et al.이 제안한 재가열 방법은 새로운 데이터를 훈련할 때 학습 속도를 일시적으로 높여 모델이 새로운 언어에 더 빠르게 적응하도록 돕습니다.

예: 지속적인 텍스트 분류 작업은 변화하는 분류 요구 사항에 적응할 수 있도록 새로운 분류 범주(예: 의도: 전송 -> 의도: 신용 점수 -> 의도: 재미있는 사실)를 점진적으로 도입하여 모델을 교육합니다.

예 : 지속적인 명명된 엔터티 인식 작업은 특정 엔터티를 인식하면서 새로운 엔터티 유형(예: 운동선수 -> 스포츠팀 -> 정치인)을 점진적으로 도입하는 방법을 보여 주므로 모델은 새로운 엔터티 능력을 인식하면서 이전 엔터티에 대한 인식을 계속 유지할 수 있습니다. .

예: 지속적인 관계 추출 작업은 새로운 관계 유형(예: 관계: 설립자 -> 관계: 출생지 또는 도 -> 관계: 본사 국가)을 지속적으로 도입하여 모델이 관계 추출 기능을 점진적으로 확장하는 방법을 보여줍니다.

예: 지속적인 지식 편집 작업을 통해 모델의 지식 기반(예: 미국 대통령은 누구입니까? -> 크리스티아누 호날두가 현재 어느 클럽에서 뛰고 있습니까? -> 지난 겨울은 어디였습니까?)을 지속적으로 업데이트하여 최신 사실에 정확하게 답할 수 있습니다. 올림픽 개최?).

예: 지속적인 기계 번역 작업은 모델의 번역 기능을 다양한 언어(예: 영어 -> 중국어, 영어 -> 스페인어, 영어 -> 프랑스어)로 점진적으로 확장하여 다국어 환경에서 모델의 적응성을 보여줍니다.

예: 지속적인 지침 미세 조정 작업은 새로운 지침 유형(예: 요약 -> 스타일 전송 -> 수학)을 점진적으로 도입하여 여러 작업 유형에서 모델의 성능 능력을 훈련합니다.

예: 연속 정렬 작업은 새로운 정렬 목표(예: 유용하고 무해함 -> 간결하고 조직적 -> 긍정적인 감정)를 도입하여 다양한 도덕적 및 행동 표준 하에서 모델의 지속적인 학습 기능을 보여줍니다.

서론: 전 세계적으로 정보가 지속적으로 증가함에 따라 확장 및 진화 과거 데이터를 기반으로 훈련된 정적 모델은 빠르게 구식이 되어 새로운 개발에 대한 콘텐츠를 이해하거나 생성할 수 없게 됩니다. 검색 기반 평생 학습은 외부 소스로부터 최신 지식을 획득하고 동화하기 위한 대규모 언어 모델의 중요한 요구 사항을 해결하며, 모델은 필요할 때 이러한 외부 리소스를 검색하여 지식 기반을 보완하거나 업데이트합니다. 이러한 외부 리소스는 사전 훈련된 LLM의 정적 속성을 향상시키기 위한 중요한 보완 자산을 제공하는 대규모 최신 지식 기반을 제공합니다. 예: 다이어그램의 이러한 외부 리소스는 모델에서 액세스하고 검색할 수 있습니다. Wikipedia, 서적, 데이터베이스 등과 같은 외부 정보 소스에 액세스함으로써 모델은 지식을 업데이트하고 새로운 정보를 접할 때 적응할 수 있습니다.

소개: 도구 기반 평생 학습은 정적인 지식을 넘어 기능을 확장하고 환경과 동적으로 상호 작용할 수 있도록 해야 한다는 필요성에서 비롯되었습니다. 실제 애플리케이션에서 모델은 직접적인 텍스트 생성이나 해석 이상의 작업을 수행해야 하는 경우가 많습니다. 예: 그림의 모델은 이러한 도구를 사용하여 자체 기능을 확장 및 업데이트하고 외부 도구와의 상호 작용을 통해 평생 학습을 가능하게 합니다. 예를 들어 모델은 애플리케이션 프로그래밍 인터페이스를 통해 실시간 데이터를 얻거나 물리적 도구를 통해 외부 환경과 상호 작용하여 특정 작업을 완료하거나 새로운 지식을 얻을 수 있습니다.

재난적 망각: 이는 평생 학습의 핵심 과제 중 하나이며, 새로운 정보의 도입으로 덮어쓰게 될 수 있습니다. 모델이 이전에 학습한 내용. 가소성-안정성 딜레마: 모델의 학습 능력과 안정성 사이의 균형을 찾는 것이 매우 중요합니다. 이는 모델이 새로운 지식을 획득하는 능력에 직접적인 영향을 미칩니다. 광범위한 일반 기능. 비싼 계산 비용: 대규모 언어 모델을 완전히 미세 조정하기 위한 계산 요구 사항은 매우 높을 수 있습니다. 모델 가중치 또는 사전 학습된 데이터를 사용할 수 없음: 개인 정보 보호, 독점 제한 또는 상용 라이선스로 인해 추가 개선을 위해 원시 학습 데이터 또는 모델 가중치를 사용할 수 없는 경우가 많습니다.

특정 작업에서 일반 작업으로: 연구는 특정 작업(예: 텍스트 분류, 명명된 엔터티 인식)에 초점을 맞추는 것에서 명령 조정, 지식 편집 등과 같은 더 넓은 범위의 일반 작업으로 점차 이동합니다. 전체 미세 조정에서 부분 미세 조정까지: 전체 미세 조정의 높은 리소스 소비를 고려하여 부분 미세 조정 전략(예: 어댑터 계층, 프롬프트 조정, LoRA)가 점점 인기를 얻고 있습니다. 내부 지식에서 외부 지식으로: 잦은 내부 업데이트의 한계를 극복하기 위해 검색-증강 생성 및 도구와 같은 외부 지식 소스를 사용하는 전략이 점점 더 많아지고 있습니다. 학습을 통해 모델을 사용할 수 있습니다. 현재 외부 데이터에 동적으로 액세스하고 활용합니다.

다중 평생 학습: 텍스트를 넘어 다양한 양식(예: 이미지, 비디오, 오디오, 시계열 데이터, 지식 그래프)을 평생 학습에 통합하여 보다 포괄적이고 적응 가능한 성적 모델을 개발합니다. 효율적인 평생 학습: 연구원들은 모델 가지치기, 모델 병합, 모델 확장 및 기타 방법과 같은 모델 교육 및 업데이트의 계산 요구 사항을 관리하기 위한 보다 효율적인 전략을 개발하기 위해 노력하고 있습니다. 보편적 평생 학습: 궁극적인 목표는 대규모 언어 모델이 더 이상 정적 데이터 세트에만 의존하지 않고 환경과의 동적 상호 작용을 통해 적극적으로 새로운 지식을 습득하고 학습할 수 있도록 하는 것입니다.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

Video Face Swap

Échangez les visages dans n'importe quelle vidéo sans effort grâce à notre outil d'échange de visage AI entièrement gratuit !

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Sujets chauds

1667

1667

14

14

1426

1426

52

52

1328

1328

25

25

1273

1273

29

29

1255

1255

24

24

Repoussant les limites de la détection de défauts traditionnelle, « Defect Spectrum » permet pour la première fois une détection de défauts industriels d'une ultra haute précision et d'une sémantique riche.

Jul 26, 2024 pm 05:38 PM

Repoussant les limites de la détection de défauts traditionnelle, « Defect Spectrum » permet pour la première fois une détection de défauts industriels d'une ultra haute précision et d'une sémantique riche.

Jul 26, 2024 pm 05:38 PM

Dans la fabrication moderne, une détection précise des défauts est non seulement la clé pour garantir la qualité des produits, mais également la clé de l’amélioration de l’efficacité de la production. Cependant, les ensembles de données de détection de défauts existants manquent souvent de précision et de richesse sémantique requises pour les applications pratiques, ce qui rend les modèles incapables d'identifier des catégories ou des emplacements de défauts spécifiques. Afin de résoudre ce problème, une équipe de recherche de premier plan composée de l'Université des sciences et technologies de Hong Kong, Guangzhou et de Simou Technology a développé de manière innovante l'ensemble de données « DefectSpectrum », qui fournit une annotation à grande échelle détaillée et sémantiquement riche des défauts industriels. Comme le montre le tableau 1, par rapport à d'autres ensembles de données industrielles, l'ensemble de données « DefectSpectrum » fournit le plus grand nombre d'annotations de défauts (5 438 échantillons de défauts) et la classification de défauts la plus détaillée (125 catégories de défauts).

Formation avec des millions de données cristallines pour résoudre le problème de la phase cristallographique, la méthode d'apprentissage profond PhAI est publiée dans Science

Aug 08, 2024 pm 09:22 PM

Formation avec des millions de données cristallines pour résoudre le problème de la phase cristallographique, la méthode d'apprentissage profond PhAI est publiée dans Science

Aug 08, 2024 pm 09:22 PM

Editeur | KX À ce jour, les détails structurels et la précision déterminés par cristallographie, des métaux simples aux grandes protéines membranaires, sont inégalés par aucune autre méthode. Cependant, le plus grand défi, appelé problème de phase, reste la récupération des informations de phase à partir d'amplitudes déterminées expérimentalement. Des chercheurs de l'Université de Copenhague au Danemark ont développé une méthode d'apprentissage en profondeur appelée PhAI pour résoudre les problèmes de phase cristalline. Un réseau neuronal d'apprentissage en profondeur formé à l'aide de millions de structures cristallines artificielles et de leurs données de diffraction synthétique correspondantes peut générer des cartes précises de densité électronique. L'étude montre que cette méthode de solution structurelle ab initio basée sur l'apprentissage profond peut résoudre le problème de phase avec une résolution de seulement 2 Angströms, ce qui équivaut à seulement 10 à 20 % des données disponibles à la résolution atomique, alors que le calcul ab initio traditionnel

Le modèle de dialogue NVIDIA ChatQA a évolué vers la version 2.0, avec la longueur du contexte mentionnée à 128 Ko

Jul 26, 2024 am 08:40 AM

Le modèle de dialogue NVIDIA ChatQA a évolué vers la version 2.0, avec la longueur du contexte mentionnée à 128 Ko

Jul 26, 2024 am 08:40 AM

La communauté ouverte LLM est une époque où une centaine de fleurs fleurissent et s'affrontent. Vous pouvez voir Llama-3-70B-Instruct, QWen2-72B-Instruct, Nemotron-4-340B-Instruct, Mixtral-8x22BInstruct-v0.1 et bien d'autres. excellents interprètes. Cependant, par rapport aux grands modèles propriétaires représentés par le GPT-4-Turbo, les modèles ouverts présentent encore des lacunes importantes dans de nombreux domaines. En plus des modèles généraux, certains modèles ouverts spécialisés dans des domaines clés ont été développés, tels que DeepSeek-Coder-V2 pour la programmation et les mathématiques, et InternVL pour les tâches de langage visuel.

Google AI a remporté la médaille d'argent de l'Olympiade mathématique de l'OMI, le modèle de raisonnement mathématique AlphaProof a été lancé et l'apprentissage par renforcement est de retour.

Jul 26, 2024 pm 02:40 PM

Google AI a remporté la médaille d'argent de l'Olympiade mathématique de l'OMI, le modèle de raisonnement mathématique AlphaProof a été lancé et l'apprentissage par renforcement est de retour.

Jul 26, 2024 pm 02:40 PM

Pour l’IA, l’Olympiade mathématique n’est plus un problème. Jeudi, l'intelligence artificielle de Google DeepMind a réalisé un exploit : utiliser l'IA pour résoudre la vraie question de l'Olympiade mathématique internationale de cette année, l'OMI, et elle n'était qu'à un pas de remporter la médaille d'or. Le concours de l'OMI qui vient de se terminer la semaine dernière comportait six questions portant sur l'algèbre, la combinatoire, la géométrie et la théorie des nombres. Le système d'IA hybride proposé par Google a répondu correctement à quatre questions et a marqué 28 points, atteignant le niveau de la médaille d'argent. Plus tôt ce mois-ci, le professeur titulaire de l'UCLA, Terence Tao, venait de promouvoir l'Olympiade mathématique de l'IA (AIMO Progress Award) avec un prix d'un million de dollars. De manière inattendue, le niveau de résolution de problèmes d'IA s'était amélioré à ce niveau avant juillet. Posez les questions simultanément sur l'OMI. La chose la plus difficile à faire correctement est l'OMI, qui a la plus longue histoire, la plus grande échelle et la plus négative.

PRO | Pourquoi les grands modèles basés sur le MoE méritent-ils davantage d'attention ?

Aug 07, 2024 pm 07:08 PM

PRO | Pourquoi les grands modèles basés sur le MoE méritent-ils davantage d'attention ?

Aug 07, 2024 pm 07:08 PM

En 2023, presque tous les domaines de l’IA évoluent à une vitesse sans précédent. Dans le même temps, l’IA repousse constamment les limites technologiques de domaines clés tels que l’intelligence embarquée et la conduite autonome. Sous la tendance multimodale, le statut de Transformer en tant qu'architecture dominante des grands modèles d'IA sera-t-il ébranlé ? Pourquoi l'exploration de grands modèles basés sur l'architecture MoE (Mixture of Experts) est-elle devenue une nouvelle tendance dans l'industrie ? Les modèles de grande vision (LVM) peuvent-ils constituer une nouvelle avancée dans la vision générale ? ...Dans la newsletter des membres PRO 2023 de ce site publiée au cours des six derniers mois, nous avons sélectionné 10 interprétations spéciales qui fournissent une analyse approfondie des tendances technologiques et des changements industriels dans les domaines ci-dessus pour vous aider à atteindre vos objectifs dans le nouveau année. Cette interprétation provient de la Week50 2023

Afin de fournir un nouveau système de référence et d'évaluation de questions-réponses scientifiques et complexes pour les grands modèles, l'UNSW, Argonne, l'Université de Chicago et d'autres institutions ont lancé conjointement le cadre SciQAG.

Jul 25, 2024 am 06:42 AM

Afin de fournir un nouveau système de référence et d'évaluation de questions-réponses scientifiques et complexes pour les grands modèles, l'UNSW, Argonne, l'Université de Chicago et d'autres institutions ont lancé conjointement le cadre SciQAG.

Jul 25, 2024 am 06:42 AM

L'ensemble de données ScienceAI Question Answering (QA) joue un rôle essentiel dans la promotion de la recherche sur le traitement du langage naturel (NLP). Des ensembles de données d'assurance qualité de haute qualité peuvent non seulement être utilisés pour affiner les modèles, mais également évaluer efficacement les capacités des grands modèles linguistiques (LLM), en particulier la capacité à comprendre et à raisonner sur les connaissances scientifiques. Bien qu’il existe actuellement de nombreux ensembles de données scientifiques d’assurance qualité couvrant la médecine, la chimie, la biologie et d’autres domaines, ces ensembles de données présentent encore certaines lacunes. Premièrement, le formulaire de données est relativement simple, et la plupart sont des questions à choix multiples. Elles sont faciles à évaluer, mais limitent la plage de sélection des réponses du modèle et ne peuvent pas tester pleinement la capacité du modèle à répondre aux questions scientifiques. En revanche, les questions et réponses ouvertes

Le taux de précision atteint 60,8 %. Le modèle de prédiction de rétrosynthèse chimique de l'Université du Zhejiang basé sur Transformer a été publié dans la sous-journal Nature.

Aug 06, 2024 pm 07:34 PM

Le taux de précision atteint 60,8 %. Le modèle de prédiction de rétrosynthèse chimique de l'Université du Zhejiang basé sur Transformer a été publié dans la sous-journal Nature.

Aug 06, 2024 pm 07:34 PM

Editeur | KX La rétrosynthèse est une tâche essentielle dans la découverte de médicaments et la synthèse organique, et l'IA est de plus en plus utilisée pour accélérer le processus. Les méthodes d’IA existantes ont des performances insatisfaisantes et une diversité limitée. En pratique, les réactions chimiques provoquent souvent des modifications moléculaires locales, avec un chevauchement considérable entre les réactifs et les produits. Inspirée par cela, l'équipe de Hou Tingjun de l'Université du Zhejiang a proposé de redéfinir la prédiction rétrosynthétique en une seule étape en tant que tâche d'édition de chaînes moléculaires, en affinant de manière itérative la chaîne moléculaire cible pour générer des composés précurseurs. Et un modèle rétrosynthétique basé sur l'édition, EditRetro, est proposé, qui permet d'obtenir des prédictions diverses et de haute qualité. Des expériences approfondies montrent que le modèle atteint d'excellentes performances sur l'ensemble de données de référence standard USPTO-50 K, avec une précision top 1 de 60,8 %.

Le point de vue de la nature : les tests de l'intelligence artificielle en médecine sont dans le chaos. Que faut-il faire ?

Aug 22, 2024 pm 04:37 PM

Le point de vue de la nature : les tests de l'intelligence artificielle en médecine sont dans le chaos. Que faut-il faire ?

Aug 22, 2024 pm 04:37 PM

Editeur | ScienceAI Sur la base de données cliniques limitées, des centaines d'algorithmes médicaux ont été approuvés. Les scientifiques se demandent qui devrait tester les outils et comment le faire au mieux. Devin Singh a vu un patient pédiatrique aux urgences subir un arrêt cardiaque alors qu'il attendait un traitement pendant une longue période, ce qui l'a incité à explorer l'application de l'IA pour réduire les temps d'attente. À l’aide des données de triage des salles d’urgence de SickKids, Singh et ses collègues ont construit une série de modèles d’IA pour fournir des diagnostics potentiels et recommander des tests. Une étude a montré que ces modèles peuvent accélérer les visites chez le médecin de 22,3 %, accélérant ainsi le traitement des résultats de près de 3 heures par patient nécessitant un examen médical. Cependant, le succès des algorithmes d’intelligence artificielle dans la recherche ne fait que le vérifier.