Caltech dans PyTorch

Achetez-moi un café☕

*Mon message explique Caltech 101.

Caltech101() peut utiliser l'ensemble de données Caltech 101 comme indiqué ci-dessous :

*Mémos :

- Le 1er argument est root (Required-Type:str ou pathlib.Path). *Un chemin absolu ou relatif est possible.

- Le 2ème argument est target_type(Optional-Default:"category"-Type:str ou tuple ou liste de str). *"catégorie" et/ou "annotation" peuvent y être définies.

- Le 3ème argument est transform(Optional-Default:None-Type:callable).

- Le 4ème argument est target_transform(Optional-Default:None-Type:callable).

- Le 5ème argument est download(Optional-Default:False-Type:bool) :

*Mémos :

- Si c'est vrai, l'ensemble de données est téléchargé depuis Internet et extrait (décompressé) à la racine.

- Si c'est Vrai et que l'ensemble de données est déjà téléchargé, il est extrait.

- Si c'est vrai et que l'ensemble de données est déjà téléchargé et extrait, rien ne se passe.

- Il devrait être faux si l'ensemble de données est déjà téléchargé et extrait car il est plus rapide.

- Vous pouvez télécharger et extraire manuellement l'ensemble de données (101_ObjectCategories.tar.gz et Annotations.tar) d'ici vers data/caltech101/.

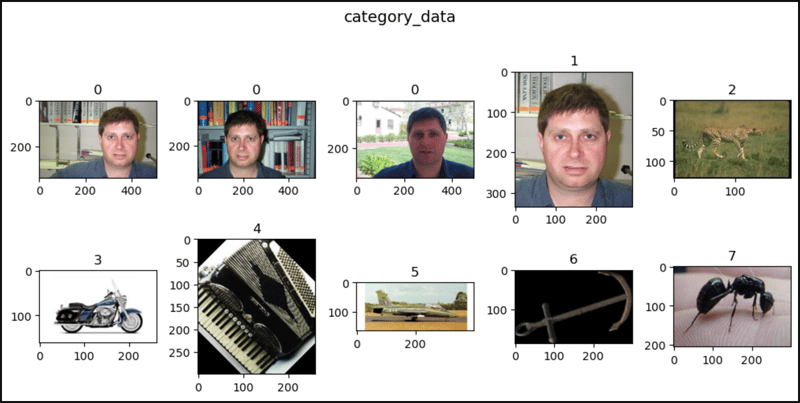

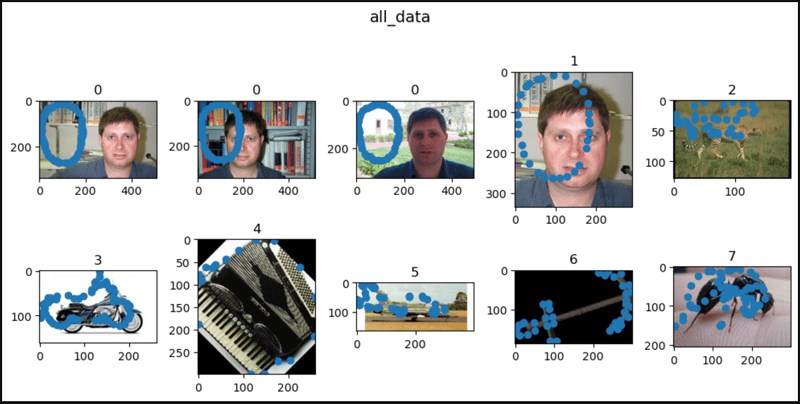

- À propos des catégories des indices d'image, Visages(0) vaut 0~434, Faces_easy(1) vaut 435~869, Léopards(2 ) est 870 ~ 1069, Motos(3) est 1070~1867, accordéon(4) est 1868~1922, avions(5) est 1923~2722, ancre(6) est 2723 ~ 2764, fourmi(7) est 2765~2806, baril(8) est 2807~2853, basse(9) est 2854~2907, etc. .

from torchvision.datasets import Caltech101

category_data = Caltech101(

root="data"

)

category_data = Caltech101(

root="data",

target_type="category",

transform=None,

target_transform=None,

download=False

)

annotation_data = Caltech101(

root="data",

target_type="annotation"

)

all_data = Caltech101(

root="data",

target_type=["category", "annotation"]

)

len(category_data), len(annotation_data), len(all_data)

# (8677, 8677, 8677)

category_data

# Dataset Caltech101

# Number of datapoints: 8677

# Root location: data\caltech101

# Target type: ['category']

category_data.root

# 'data/caltech101'

category_data.target_type

# ['category']

print(category_data.transform)

# None

print(category_data.target_transform)

# None

category_data.download

# <bound method Caltech101.download of Dataset Caltech101

# Number of datapoints: 8677

# Root location: data\caltech101

# Target type: ['category']>

len(category_data.categories)

# 101

category_data.categories

# ['Faces', 'Faces_easy', 'Leopards', 'Motorbikes', 'accordion',

# 'airplanes', 'anchor', 'ant', 'barrel', 'bass', 'beaver',

# 'binocular', 'bonsai', 'brain', 'brontosaurus', 'buddha',

# 'butterfly', 'camera', 'cannon', 'car_side', 'ceiling_fan',

# 'cellphone', 'chair', 'chandelier', 'cougar_body', 'cougar_face', ...]

len(category_data.annotation_categories)

# 101

category_data.annotation_categories

# ['Faces_2', 'Faces_3', 'Leopards', 'Motorbikes_16', 'accordion',

# 'Airplanes_Side_2', 'anchor', 'ant', 'barrel', 'bass',

# 'beaver', 'binocular', 'bonsai', 'brain', 'brontosaurus',

# 'buddha', 'butterfly', 'camera', 'cannon', 'car_side',

# 'ceiling_fan', 'cellphone', 'chair', 'chandelier', 'cougar_body', ...]

category_data[0]

# (<PIL.JpegImagePlugin.JpegImageFile image mode=RGB size=510x337>, 0)

category_data[1]

# (<PIL.JpegImagePlugin.JpegImageFile image mode=RGB size=519x343>, 0)

category_data[2]

# (<PIL.JpegImagePlugin.JpegImageFile image mode=RGB size=492x325>, 0)

category_data[435]

# (<PIL.JpegImagePlugin.JpegImageFile image mode=RGB size=290x334>, 1)

category_data[870]

# (<PIL.JpegImagePlugin.JpegImageFile image mode=RGB size=192x128>, 2)

annotation_data[0]

# (<PIL.JpegImagePlugin.JpegImageFile image mode=RGB size=510x337>,

# array([[10.00958466, 8.18210863, 8.18210863, 10.92332268, ...],

# [132.30670927, 120.42811502, 103.52396166, 90.73162939, ...]]))

annotation_data[1]

# (<PIL.JpegImagePlugin.JpegImageFile image mode=RGB size=519x343>,

# array([[15.19298246, 13.71929825, 15.19298246, 19.61403509, ...],

# [121.5877193, 103.90350877, 80.81578947, 64.11403509, ...]]))

annotation_data[2]

# (<PIL.JpegImagePlugin.JpegImageFile image mode=RGB size=492x325>,

# array([[10.40789474, 7.17807018, 5.79385965, 9.02368421, ...],

# [131.30789474, 120.69561404, 102.23947368, 86.09035088, ...]]))

annotation_data[435]

# (<PIL.JpegImagePlugin.JpegImageFile image mode=RGB size=290x334>,

# array([[64.52631579, 95.31578947, 123.26315789, 149.31578947, ...],

# [15.42105263, 8.31578947, 10.21052632, 28.21052632, ...]]))

annotation_data[870]

# (<PIL.JpegImagePlugin.JpegImageFile image mode=RGB size=192x128>,

# array([[2.96536524, 7.55604534, 19.45780856, 33.73992443, ...],

# [23.63413098, 32.13539043, 33.83564232, 8.84193955, ...]]))

all_data[0]

# (<PIL.JpegImagePlugin.JpegImageFile image mode=RGB size=510x337>,

# (0, array([[10.00958466, 8.18210863, 8.18210863, 10.92332268, ...],

# [132.30670927, 120.42811502, 103.52396166, 90.73162939, ...]]))

all_data[1]

# (<PIL.JpegImagePlugin.JpegImageFile image mode=RGB size=519x343>,

# (0, array([[15.19298246, 13.71929825, 15.19298246, 19.61403509, ...],

# [121.5877193, 103.90350877, 80.81578947, 64.11403509, ...]]))

all_data[2]

# (<PIL.JpegImagePlugin.JpegImageFile image mode=RGB size=492x325>,

# (0, array([[10.40789474, 7.17807018, 5.79385965, 9.02368421, ...],

# [131.30789474, 120.69561404, 102.23947368, 86.09035088, ...]]))

all_data[3]

# (<PIL.JpegImagePlugin.JpegImageFile image mode=RGB size=538x355>,

# (0, array([[19.54035088, 18.57894737, 26.27017544, 38.2877193, ...],

# [131.49122807, 100.24561404, 74.2877193, 49.29122807, ...]]))

all_data[4]

# (<PIL.JpegImagePlugin.JpegImageFile image mode=RGB size=528x349>,

# (0, array([[11.87982456, 11.87982456, 13.86578947, 15.35526316, ...],

# [128.34649123, 105.50789474, 91.60614035, 76.71140351, ...]]))

import matplotlib.pyplot as plt

def show_images(data, main_title=None):

plt.figure(figsize=(10, 5))

plt.suptitle(t=main_title, y=1.0, fontsize=14)

ims = (0, 1, 2, 435, 870, 1070, 1868, 1923, 2723, 2765, 2807, 2854)

for i, j in enumerate(ims, start=1):

plt.subplot(2, 5, i)

if len(data.target_type) == 1:

if data.target_type[0] == "category":

im, lab = data[j]

plt.title(label=lab)

elif data.target_type[0] == "annotation":

im, (px, py) = data[j]

plt.scatter(x=px, y=py)

plt.imshow(X=im)

elif len(data.target_type) == 2:

if data.target_type[0] == "category":

im, (lab, (px, py)) = data[j]

elif data.target_type[0] == "annotation":

im, ((px, py), lab) = data[j]

plt.title(label=lab)

plt.imshow(X=im)

plt.scatter(x=px, y=py)

if i == 10:

break

plt.tight_layout()

plt.show()

show_images(data=category_data, main_title="category_data")

show_images(data=annotation_data, main_title="annotation_data")

show_images(data=all_data, main_title="all_data")

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

Video Face Swap

Échangez les visages dans n'importe quelle vidéo sans effort grâce à notre outil d'échange de visage AI entièrement gratuit !

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Sujets chauds

1670

1670

14

14

1428

1428

52

52

1329

1329

25

25

1276

1276

29

29

1256

1256

24

24

Python vs C: courbes d'apprentissage et facilité d'utilisation

Apr 19, 2025 am 12:20 AM

Python vs C: courbes d'apprentissage et facilité d'utilisation

Apr 19, 2025 am 12:20 AM

Python est plus facile à apprendre et à utiliser, tandis que C est plus puissant mais complexe. 1. La syntaxe Python est concise et adaptée aux débutants. Le typage dynamique et la gestion automatique de la mémoire le rendent facile à utiliser, mais peuvent entraîner des erreurs d'exécution. 2.C fournit des fonctionnalités de contrôle de bas niveau et avancées, adaptées aux applications haute performance, mais a un seuil d'apprentissage élevé et nécessite une gestion manuelle de la mémoire et de la sécurité.

Python et temps: tirer le meilleur parti de votre temps d'étude

Apr 14, 2025 am 12:02 AM

Python et temps: tirer le meilleur parti de votre temps d'étude

Apr 14, 2025 am 12:02 AM

Pour maximiser l'efficacité de l'apprentissage de Python dans un temps limité, vous pouvez utiliser les modules DateTime, Time et Schedule de Python. 1. Le module DateTime est utilisé pour enregistrer et planifier le temps d'apprentissage. 2. Le module de temps aide à définir l'étude et le temps de repos. 3. Le module de planification organise automatiquement des tâches d'apprentissage hebdomadaires.

Python vs. C: Explorer les performances et l'efficacité

Apr 18, 2025 am 12:20 AM

Python vs. C: Explorer les performances et l'efficacité

Apr 18, 2025 am 12:20 AM

Python est meilleur que C dans l'efficacité du développement, mais C est plus élevé dans les performances d'exécution. 1. La syntaxe concise de Python et les bibliothèques riches améliorent l'efficacité du développement. Les caractéristiques de type compilation et le contrôle du matériel de CC améliorent les performances d'exécution. Lorsque vous faites un choix, vous devez peser la vitesse de développement et l'efficacité de l'exécution en fonction des besoins du projet.

Apprendre Python: 2 heures d'étude quotidienne est-elle suffisante?

Apr 18, 2025 am 12:22 AM

Apprendre Python: 2 heures d'étude quotidienne est-elle suffisante?

Apr 18, 2025 am 12:22 AM

Est-ce suffisant pour apprendre Python pendant deux heures par jour? Cela dépend de vos objectifs et de vos méthodes d'apprentissage. 1) Élaborer un plan d'apprentissage clair, 2) Sélectionnez les ressources et méthodes d'apprentissage appropriées, 3) la pratique et l'examen et la consolidation de la pratique pratique et de l'examen et de la consolidation, et vous pouvez progressivement maîtriser les connaissances de base et les fonctions avancées de Python au cours de cette période.

Python vs C: Comprendre les principales différences

Apr 21, 2025 am 12:18 AM

Python vs C: Comprendre les principales différences

Apr 21, 2025 am 12:18 AM

Python et C ont chacun leurs propres avantages, et le choix doit être basé sur les exigences du projet. 1) Python convient au développement rapide et au traitement des données en raison de sa syntaxe concise et de son typage dynamique. 2) C convient à des performances élevées et à une programmation système en raison de son typage statique et de sa gestion de la mémoire manuelle.

Quelle partie fait partie de la bibliothèque standard Python: listes ou tableaux?

Apr 27, 2025 am 12:03 AM

Quelle partie fait partie de la bibliothèque standard Python: listes ou tableaux?

Apr 27, 2025 am 12:03 AM

PythonlistSaReparmentofthestandardLibrary, tandis que les coloccules de colocède, tandis que les colocculations pour la base de la Parlementaire, des coloments de forage polyvalent, tandis que la fonctionnalité de la fonctionnalité nettement adressée.

Python: automatisation, script et gestion des tâches

Apr 16, 2025 am 12:14 AM

Python: automatisation, script et gestion des tâches

Apr 16, 2025 am 12:14 AM

Python excelle dans l'automatisation, les scripts et la gestion des tâches. 1) Automatisation: La sauvegarde du fichier est réalisée via des bibliothèques standard telles que le système d'exploitation et la fermeture. 2) Écriture de script: utilisez la bibliothèque PSUTIL pour surveiller les ressources système. 3) Gestion des tâches: utilisez la bibliothèque de planification pour planifier les tâches. La facilité d'utilisation de Python et la prise en charge de la bibliothèque riche en font l'outil préféré dans ces domaines.

Python pour le développement Web: applications clés

Apr 18, 2025 am 12:20 AM

Python pour le développement Web: applications clés

Apr 18, 2025 am 12:20 AM

Les applications clés de Python dans le développement Web incluent l'utilisation des cadres Django et Flask, le développement de l'API, l'analyse et la visualisation des données, l'apprentissage automatique et l'IA et l'optimisation des performances. 1. Framework Django et Flask: Django convient au développement rapide d'applications complexes, et Flask convient aux projets petits ou hautement personnalisés. 2. Développement de l'API: Utilisez Flask ou DjangorestFramework pour construire RestulAPI. 3. Analyse et visualisation des données: utilisez Python pour traiter les données et les afficher via l'interface Web. 4. Apprentissage automatique et AI: Python est utilisé pour créer des applications Web intelligentes. 5. Optimisation des performances: optimisée par la programmation, la mise en cache et le code asynchrones