développement back-end

développement back-end

Tutoriel Python

Tutoriel Python

Analyse de documents rapide et sale : combiner GOT-OCR et LLama en Python

Analyse de documents rapide et sale : combiner GOT-OCR et LLama en Python

Analyse de documents rapide et sale : combiner GOT-OCR et LLama en Python

Explorons un moyen d'effectuer une analyse OCR LLM pour une image. Est-ce que ce sera la meilleure méthode proposée par un expert possédant des décennies d’expérience ? Pas vraiment. Mais cela vient de quelqu’un qui adopte une approche similaire dans la vraie vie. Considérez cela comme une version de projet de week-end avec des extraits pratiques plutôt que du code prêt pour la production. Allons creuser !

Quel est notre objectif ici ?

Nous allons créer un pipeline simple capable de prendre une image (ou un PDF), d'en extraire du texte à l'aide de l'OCR, puis d'analyser ce texte à l'aide d'un LLM pour obtenir des métadonnées utiles. Cela pourrait être utile pour catégoriser automatiquement les documents, analyser la correspondance entrante ou créer un système intelligent de gestion de documents. Nous le ferons en utilisant des outils open source populaires et garderons les choses relativement simples.

Et oui, tout ce qui suit suppose que vous êtes déjà assez à l'aise avec les transformateurs HF. Sinon, consultez https://huggingface.co/docs/transformers/en/quicktour - cela semble être un bon point de départ. Même si je ne l'ai jamais fait et que j'ai juste appris des exemples. J'y arriverai... éventuellement.

De quels forfaits avons-nous besoin ?

Nous utiliserons une torche et des transformateurs pour le gros du travail, ainsi que pymupdf et rich pour nous faciliter la vie avec une sortie console conviviale (j'aime le riche, donc en gros, nous l'utilisons pour le plaisir).

import json import time import fitz import torch from transformers import AutoModel, AutoTokenizer, pipeline from rich.console import Console console = Console()

Préparez l'image

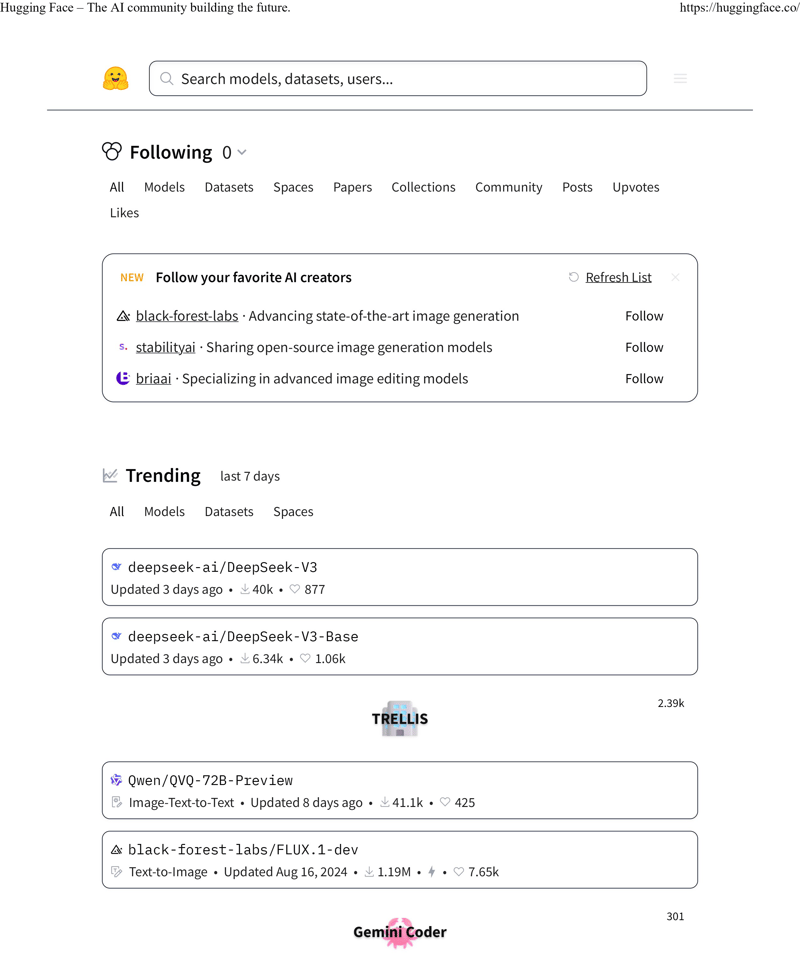

Tout d’abord, quelle image devons-nous utiliser comme entrée ? Puisque nous utilisons Hugging Face ici pour le travail principal, utilisons la première page de leur page Web principale comme sujet de test. C'est un bon candidat avec à la fois du texte et un formatage compliqué - parfait pour mettre notre OCR à l'épreuve.

Pour une solution plus réaliste, supposons que notre entrée est un PDF (car avouons-le, c'est ce à quoi vous aurez probablement affaire dans le monde réel). Nous devrons le convertir au format PNG pour que notre modèle puisse le traiter :

INPUT_PDF_FILE = "./data/ocr_hf_main_page.pdf"

OUTPUT_PNG_FILE = "./data/ocr_hf_main_page.png"

doc = fitz.open(INPUT_PDF_FILE)

page = doc.load_page(0)

pixmap = page.get_pixmap(dpi=300)

img = pixmap.tobytes()

with console.status("Converting PDF to PNG...", spinner="monkey"):

with open(OUTPUT_PNG_FILE, "wb") as f:

f.write(img)

Faites le vrai OCR ici

J'ai joué avec différentes solutions OCR pour cette tâche. Bien sûr, il existe du tesseract et de nombreuses autres options. Mais pour mon cas de test, j'ai obtenu les meilleurs résultats avec GOT-OCR2_0 (https://huggingface.co/stepfun-ai/GOT-OCR2_0). Alors allons-y directement :

tokenizer = AutoTokenizer.from_pretrained(

"ucaslcl/GOT-OCR2_0",

device_map="cuda",

trust_remote_code=True,

)

model = AutoModel.from_pretrained(

"ucaslcl/GOT-OCR2_0",

trust_remote_code=True,

low_cpu_mem_usage=True,

use_safetensors=True,

pad_token_id=tokenizer.eos_token_id,

)

model = model.eval().cuda()

Que se passe-t-il ici ? Eh bien, AutoModel et AutoTokenizer par défaut, la seule partie assez spéciale est que nous configurons le modèle pour utiliser cuda. Et ce n'est pas facultatif. Le modèle nécessite le support de CUDA pour fonctionner.

Maintenant que nous avons défini notre modèle, mettons-le en œuvre sur notre fichier enregistré. De plus, nous mesurerons le temps et l’imprimerons. Utile non seulement pour comparer avec différents modèles, mais aussi pour comprendre s'il est même possible que votre cas d'utilisation attende aussi longtemps (même si c'est très rapide pour notre cas) :

import json import time import fitz import torch from transformers import AutoModel, AutoTokenizer, pipeline from rich.console import Console console = Console()

Et voici ce que nous obtenons de notre image originale :

INPUT_PDF_FILE = "./data/ocr_hf_main_page.pdf"

OUTPUT_PNG_FILE = "./data/ocr_hf_main_page.png"

doc = fitz.open(INPUT_PDF_FILE)

page = doc.load_page(0)

pixmap = page.get_pixmap(dpi=300)

img = pixmap.tobytes()

with console.status("Converting PDF to PNG...", spinner="monkey"):

with open(OUTPUT_PNG_FILE, "wb") as f:

f.write(img)

^ tout le texte, pas de mise en forme, mais c'est intentionnel.

GOT-OCR2_0 est assez flexible : il peut sortir dans différents formats, y compris HTML. Voici d'autres façons de l'utiliser :

tokenizer = AutoTokenizer.from_pretrained(

"ucaslcl/GOT-OCR2_0",

device_map="cuda",

trust_remote_code=True,

)

model = AutoModel.from_pretrained(

"ucaslcl/GOT-OCR2_0",

trust_remote_code=True,

low_cpu_mem_usage=True,

use_safetensors=True,

pad_token_id=tokenizer.eos_token_id,

)

model = model.eval().cuda()

Essayez enfin le LLM

Vient maintenant la partie amusante : choisir un LLM. Il y a eu des discussions sans fin pour savoir lequel est le meilleur, avec des articles partout où vous regardez. Mais restons simples : quel est le LLM dont tout le monde et leur chien ont entendu parler ? Lama. Nous utiliserons donc Llama-3.2-1B pour traiter le texte.

Que pouvons-nous déduire du texte ? Pensez à des éléments de base comme la classification de texte, l'analyse des sentiments, la détection de la langue, etc. Imaginez que vous construisez un système pour classer automatiquement les documents téléchargés ou trier les fax entrants pour une pharmacie.

Je vais sauter l'étude approfondie de l'ingénierie des invites (c'est un tout autre article et je ne pense pas que j'en écrirai), mais voici l'idée de base :

def run_ocr_for_file(func: callable, text: str):

start_time = time.time()

res = func()

final_time = time.time() - start_time

console.rule(f"[bold red] {text} [/bold red]")

console.print(res)

console.rule(f"Time: {final_time} seconds")

return res

result_text = None

with console.status(

"Running OCR for the result file...",

spinner="monkey",

):

result_text = run_ocr_for_file(

lambda: model.chat(

tokenizer,

OUTPUT_PNG_FILE,

ocr_type="ocr",

),

"plain texts OCR",

)

Au fait, est-ce que je fais quelque chose d'hilarant et stupide ici avec une invite/un contenu ? Fais-moi savoir. Assez nouveau dans "l'ingénierie rapide" et ne le prenez pas encore assez au sérieux.

Le modèle enveloppe parfois le résultat dans des blocs de code markdown, nous devons donc gérer cela (si quelqu'un connaît une manière plus propre, je suis tout ouïe) :

Hugging Face- The Al community building the future. https: / / hugging face. co/ Search models, datasets, users. . . Following 0 All Models Datasets Spaces Papers Collections Community Posts Up votes Likes New Follow your favorite Al creators Refresh List black- forest- labs· Advancing state- of- the- art image generation Follow stability a i· Sharing open- source image generation models Follow bria a i· Specializing in advanced image editing models Follow Trending last 7 days All Models Datasets Spaces deep see k- a i/ Deep Seek- V 3 Updated 3 days ago· 40 k· 877 deep see k- a i/ Deep Seek- V 3- Base Updated 3 days ago· 6.34 k· 1.06 k 2.39 k TRELLIS Q wen/ QV Q- 72 B- Preview 88888888888888888888 888888888888888888 301 Gemini Co der 1 of 3 2025-01-01,9:38 p. m

Et voici ce que nous obtenons généralement en sortie :

# format texts OCR: result_text = model.chat( tokenizer, image_file, ocr_type='format', ) # fine-grained OCR: result_text = model.chat( tokenizer, image_file, ocr_type='ocr', ocr_box='', ) # ... ocr_type='format', ocr_box='') # ... ocr_type='ocr', ocr_color='') # ... ocr_type='format', ocr_color='') # multi-crop OCR: # ... ocr_type='ocr') # ... ocr_type='format') # render the formatted OCR results: result_text = model.chat( tokenizer, image_file, ocr_type='format', render=True, save_render_file = './demo.html', )

Pour résumer

Nous avons construit un petit pipeline capable de prendre un PDF, d'extraire son texte à l'aide d'un très bon OCR, puis d'analyser ce texte à l'aide d'un LLM pour obtenir des métadonnées utiles. Est-il prêt pour la production ? Probablement pas. Mais c'est un bon point de départ si vous cherchez à construire quelque chose de similaire. Ce qui est cool, c'est la façon dont nous avons combiné différents outils open source pour créer quelque chose d'utile - de la gestion des PDF à l'OCR en passant par l'analyse LLM.

Vous pouvez facilement prolonger cela. Ajoutez peut-être une meilleure gestion des erreurs, la prise en charge de plusieurs pages ou essayez différents LLM. Ou peut-être le connecter à un système de gestion de documents. J'espère que vous le ferez. Cela pourrait être une tâche amusante.

N'oubliez pas qu'il ne s'agit que d'une façon de procéder : il existe probablement des dizaines d'autres approches qui pourraient mieux fonctionner pour votre cas d'utilisation spécifique. Mais j’espère que cela vous donnera un bon point de départ pour vos propres expériences ! Ou un endroit parfait pour m'apprendre dans les commentaires comment on fait.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

Video Face Swap

Échangez les visages dans n'importe quelle vidéo sans effort grâce à notre outil d'échange de visage AI entièrement gratuit !

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Sujets chauds

1671

1671

14

14

1428

1428

52

52

1331

1331

25

25

1276

1276

29

29

1256

1256

24

24

Python vs C: courbes d'apprentissage et facilité d'utilisation

Apr 19, 2025 am 12:20 AM

Python vs C: courbes d'apprentissage et facilité d'utilisation

Apr 19, 2025 am 12:20 AM

Python est plus facile à apprendre et à utiliser, tandis que C est plus puissant mais complexe. 1. La syntaxe Python est concise et adaptée aux débutants. Le typage dynamique et la gestion automatique de la mémoire le rendent facile à utiliser, mais peuvent entraîner des erreurs d'exécution. 2.C fournit des fonctionnalités de contrôle de bas niveau et avancées, adaptées aux applications haute performance, mais a un seuil d'apprentissage élevé et nécessite une gestion manuelle de la mémoire et de la sécurité.

Python et temps: tirer le meilleur parti de votre temps d'étude

Apr 14, 2025 am 12:02 AM

Python et temps: tirer le meilleur parti de votre temps d'étude

Apr 14, 2025 am 12:02 AM

Pour maximiser l'efficacité de l'apprentissage de Python dans un temps limité, vous pouvez utiliser les modules DateTime, Time et Schedule de Python. 1. Le module DateTime est utilisé pour enregistrer et planifier le temps d'apprentissage. 2. Le module de temps aide à définir l'étude et le temps de repos. 3. Le module de planification organise automatiquement des tâches d'apprentissage hebdomadaires.

Python vs. C: Explorer les performances et l'efficacité

Apr 18, 2025 am 12:20 AM

Python vs. C: Explorer les performances et l'efficacité

Apr 18, 2025 am 12:20 AM

Python est meilleur que C dans l'efficacité du développement, mais C est plus élevé dans les performances d'exécution. 1. La syntaxe concise de Python et les bibliothèques riches améliorent l'efficacité du développement. Les caractéristiques de type compilation et le contrôle du matériel de CC améliorent les performances d'exécution. Lorsque vous faites un choix, vous devez peser la vitesse de développement et l'efficacité de l'exécution en fonction des besoins du projet.

Apprendre Python: 2 heures d'étude quotidienne est-elle suffisante?

Apr 18, 2025 am 12:22 AM

Apprendre Python: 2 heures d'étude quotidienne est-elle suffisante?

Apr 18, 2025 am 12:22 AM

Est-ce suffisant pour apprendre Python pendant deux heures par jour? Cela dépend de vos objectifs et de vos méthodes d'apprentissage. 1) Élaborer un plan d'apprentissage clair, 2) Sélectionnez les ressources et méthodes d'apprentissage appropriées, 3) la pratique et l'examen et la consolidation de la pratique pratique et de l'examen et de la consolidation, et vous pouvez progressivement maîtriser les connaissances de base et les fonctions avancées de Python au cours de cette période.

Python vs C: Comprendre les principales différences

Apr 21, 2025 am 12:18 AM

Python vs C: Comprendre les principales différences

Apr 21, 2025 am 12:18 AM

Python et C ont chacun leurs propres avantages, et le choix doit être basé sur les exigences du projet. 1) Python convient au développement rapide et au traitement des données en raison de sa syntaxe concise et de son typage dynamique. 2) C convient à des performances élevées et à une programmation système en raison de son typage statique et de sa gestion de la mémoire manuelle.

Quelle partie fait partie de la bibliothèque standard Python: listes ou tableaux?

Apr 27, 2025 am 12:03 AM

Quelle partie fait partie de la bibliothèque standard Python: listes ou tableaux?

Apr 27, 2025 am 12:03 AM

PythonlistSaReparmentofthestandardLibrary, tandis que les coloccules de colocède, tandis que les colocculations pour la base de la Parlementaire, des coloments de forage polyvalent, tandis que la fonctionnalité de la fonctionnalité nettement adressée.

Python: automatisation, script et gestion des tâches

Apr 16, 2025 am 12:14 AM

Python: automatisation, script et gestion des tâches

Apr 16, 2025 am 12:14 AM

Python excelle dans l'automatisation, les scripts et la gestion des tâches. 1) Automatisation: La sauvegarde du fichier est réalisée via des bibliothèques standard telles que le système d'exploitation et la fermeture. 2) Écriture de script: utilisez la bibliothèque PSUTIL pour surveiller les ressources système. 3) Gestion des tâches: utilisez la bibliothèque de planification pour planifier les tâches. La facilité d'utilisation de Python et la prise en charge de la bibliothèque riche en font l'outil préféré dans ces domaines.

Python pour l'informatique scientifique: un look détaillé

Apr 19, 2025 am 12:15 AM

Python pour l'informatique scientifique: un look détaillé

Apr 19, 2025 am 12:15 AM

Les applications de Python en informatique scientifique comprennent l'analyse des données, l'apprentissage automatique, la simulation numérique et la visualisation. 1.Numpy fournit des tableaux multidimensionnels et des fonctions mathématiques efficaces. 2. Scipy étend la fonctionnalité Numpy et fournit des outils d'optimisation et d'algèbre linéaire. 3. Pandas est utilisé pour le traitement et l'analyse des données. 4.Matplotlib est utilisé pour générer divers graphiques et résultats visuels.