Périphériques technologiques

Périphériques technologiques

IA

IA

6 stratégies de personnalisation LLM communes ont brièvement expliqué

6 stratégies de personnalisation LLM communes ont brièvement expliqué

6 stratégies de personnalisation LLM communes ont brièvement expliqué

Cet article explore six stratégies clés pour personnaliser les modèles de grands langues (LLM), allant des techniques simples à des méthodes plus à forte intensité de ressources. Le choix de la bonne approche dépend de vos besoins spécifiques, des ressources et de l'expertise technique.

Pourquoi personnaliser les LLMS?

LLMS pré-formés, tandis que puissants, ne sont souvent pas des exigences commerciales ou de domaine spécifiques. La personnalisation d'un LLM vous permet d'adapter ses capacités à vos besoins exacts sans le coût prohibitif de la formation d'un modèle à partir de zéro. Ceci est particulièrement crucial pour les petites équipes dépourvues de ressources étendues.

Choisir le bon LLM:

Avant la personnalisation, la sélection du modèle de base approprié est critique. Les facteurs à considérer comprennent:

- Open-source vs propriétaire: Les modèles open source offrent une flexibilité et un contrôle, mais exigent des compétences techniques, tandis que les modèles propriétaires offrent une facilité d'accès et des performances souvent supérieures à un coût.

- Tâche et métriques: différents modèles excellent dans diverses tâches (réponse aux questions, résumé, génération de code). Les mesures de référence et les tests spécifiques au domaine sont essentiels.

- Architecture: Les modèles uniquement du décodeur (comme GPT) sont forts à la génération de texte, tandis que les modèles d'encodeur (comme T5) sont mieux adaptés à la traduction. Les architectures émergentes comme le mélange d'experts (MOE) sont prometteuses.

- Taille du modèle: Les modèles plus grands fonctionnent généralement mieux mais nécessitent plus de ressources de calcul.

six stratégies de personnalisation LLM (classées par intensité des ressources):

Les stratégies suivantes sont présentées dans l'ordre croissant de la consommation de ressources:

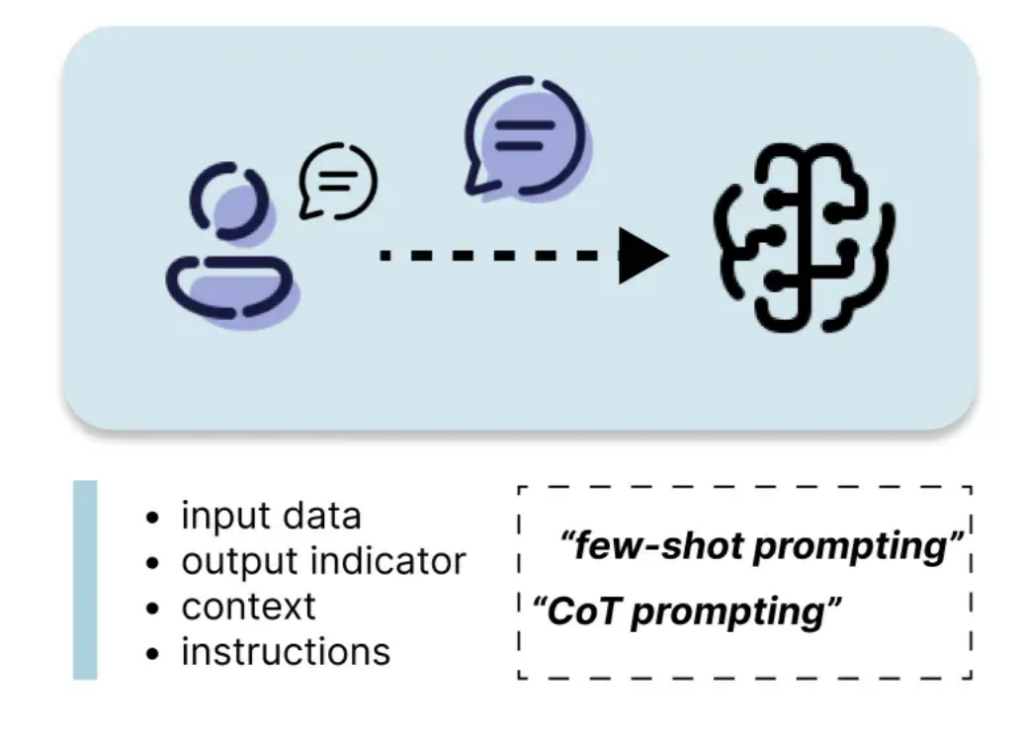

1. Ingénierie rapide

L'ingénierie rapide consiste à fabriquer soigneusement le texte d'entrée (invite) pour guider la réponse du LLM. Cela comprend les instructions, le contexte, les données d'entrée et les indicateurs de sortie. Des techniques comme les tirs zéro, une seule prise et à quelques coups, ainsi que des méthodes plus avancées comme la chaîne de pensée (COT), l'arbre de pensées, le raisonnement automatique et l'utilisation des outils (ART) et React, peuvent considérablement améliorer les performances . L'ingénierie rapide est efficace et facilement mise en œuvre.

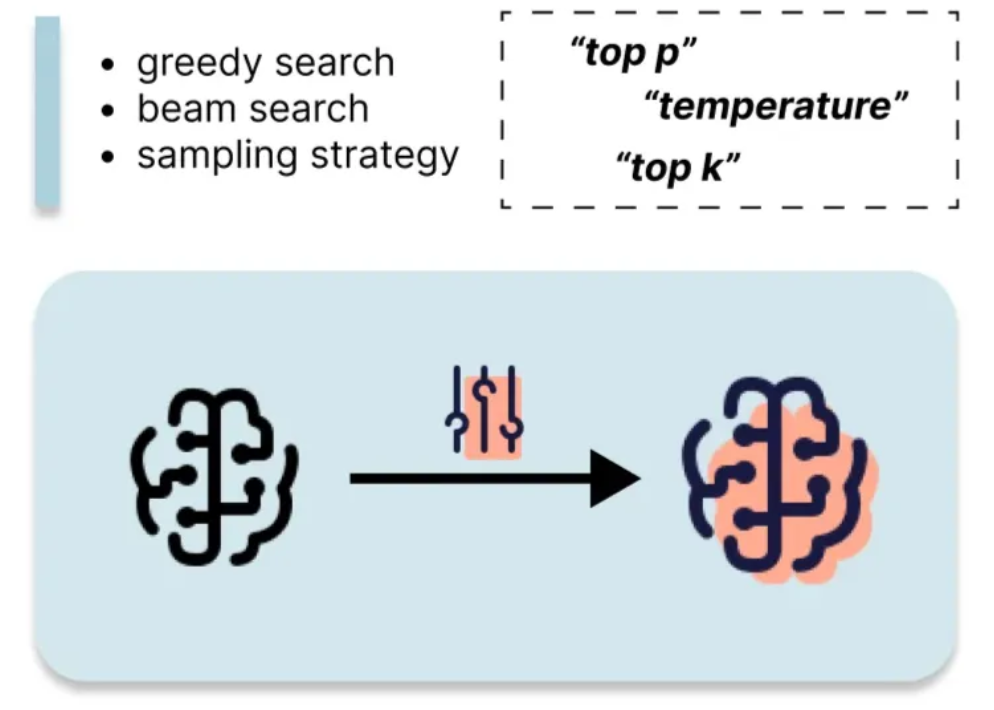

2. Stratégies de décodage et d'échantillonnage

Contrôle des stratégies de décodage (recherche gourmand, recherche de faisceau, échantillonnage) et paramètres d'échantillonnage (température, Top-K, Top-P) au moment de l'inférence vous permet d'ajuster le hasard et la diversité de la sortie de la LLM. Il s'agit d'une méthode à faible coût pour influencer le comportement du modèle.

3. Génération augmentée augmentée (RAG)

Rag améliore les réponses LLM en incorporant des connaissances externes. Il s'agit de récupérer des informations pertinentes à partir d'une base de connaissances et de les alimenter au LLM avec la requête de l'utilisateur. Cela réduit les hallucinations et améliore la précision, en particulier pour les tâches spécifiques au domaine. Le chiffon est relativement économe en ressources car il ne nécessite pas de recyclage du llm.

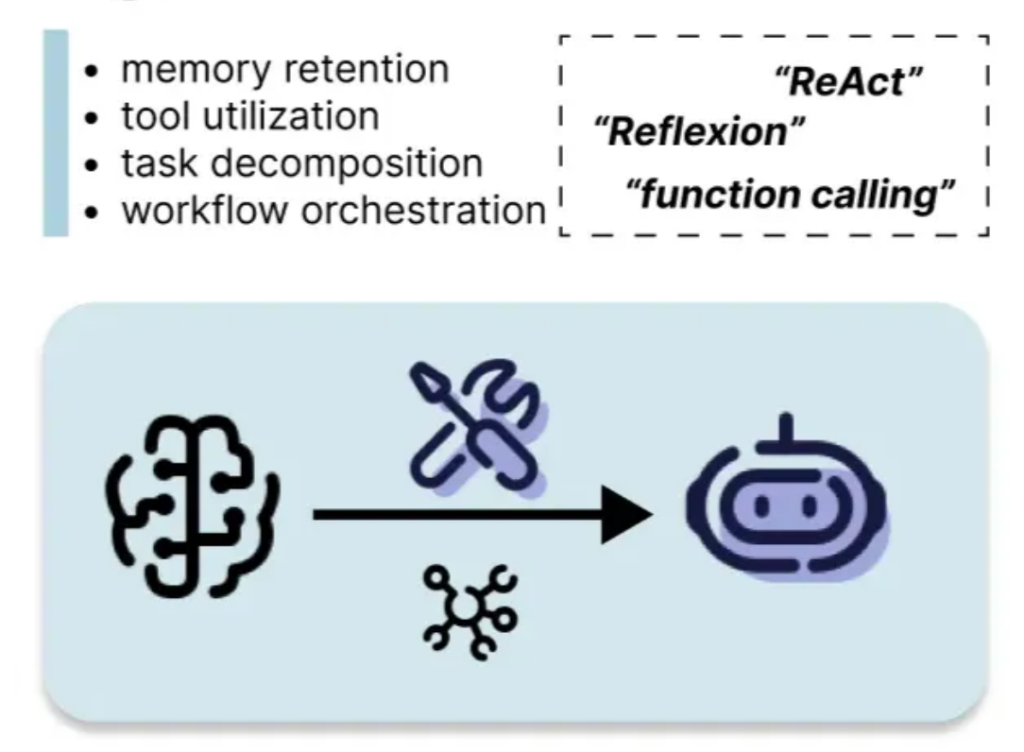

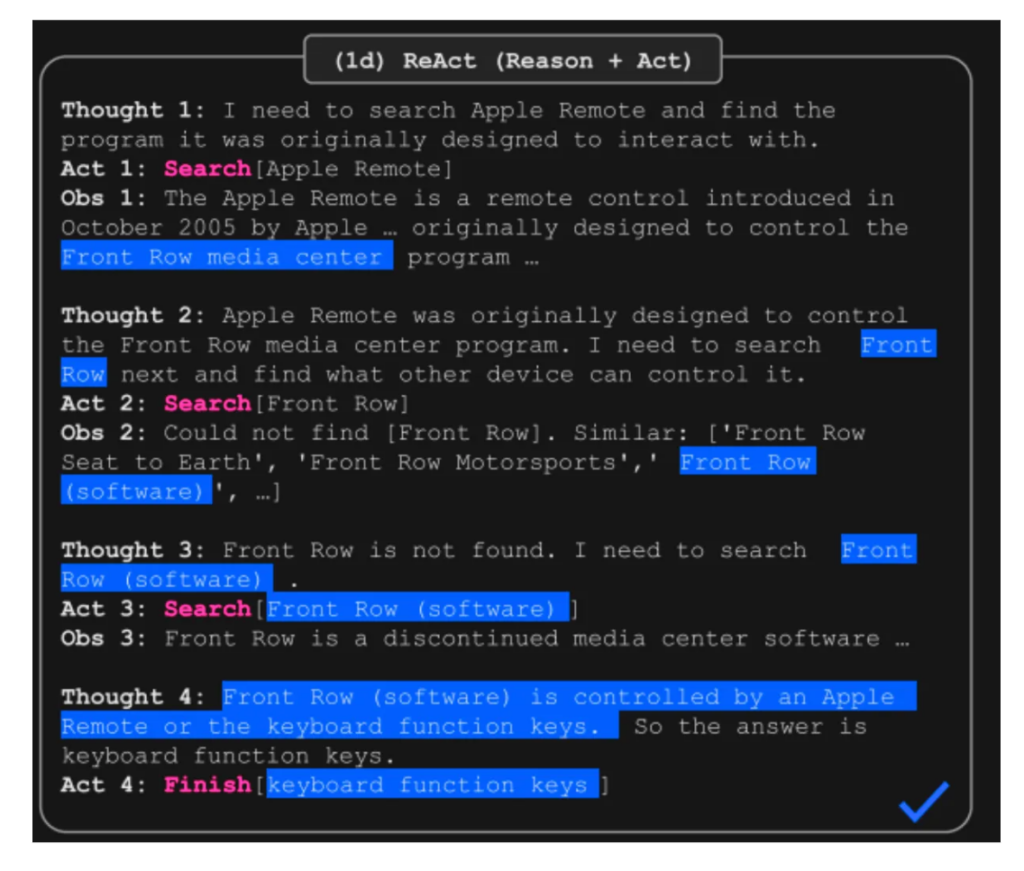

4. Systèmes basés sur des agents

Les systèmes basés sur les agents permettent aux LLMS d'interagir avec l'environnement, d'utiliser des outils et de maintenir la mémoire. Des cadres comme React (Synergising Reasoning and Agting) combinent le raisonnement avec les actions et les observations, améliorant les performances sur des tâches complexes. Les agents offrent des avantages importants dans la gestion des flux de travail complexes et l'utilisation des outils.

5. Dimension fine

Le réglage fin implique la mise à jour des paramètres de LLM à l'aide d'un ensemble de données personnalisé. Les méthodes de réglage fin et économes par les paramètres (PEFT), comme LORA, réduisent considérablement le coût de calcul par rapport au réglage fin complet. Cette approche nécessite plus de ressources que les méthodes précédentes mais fournit des gains de performance plus importants.

6. Renforcement d'apprentissage de la rétroaction humaine (RLHF)

RLHF aligne la sortie du LLM avec les préférences humaines en entraînant un modèle de récompense basé sur la rétroaction humaine. Il s'agit de la méthode la plus à forte intensité de ressources, nécessitant une annotation humaine et un pouvoir de calcul humaines importantes, mais cela peut entraîner des améliorations substantielles de la qualité de la réponse et de l'alignement avec le comportement souhaité.

Cet aperçu fournit une compréhension complète des différentes techniques de personnalisation LLM, vous permettant de choisir la stratégie la plus appropriée en fonction de vos exigences et ressources spécifiques. N'oubliez pas de considérer les compromis entre la consommation de ressources et les gains de performance lors de votre sélection.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

Video Face Swap

Échangez les visages dans n'importe quelle vidéo sans effort grâce à notre outil d'échange de visage AI entièrement gratuit !

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Sujets chauds

1673

1673

14

14

1429

1429

52

52

1333

1333

25

25

1278

1278

29

29

1257

1257

24

24

Comment construire des agents d'IA multimodaux à l'aide d'AGNO Framework?

Apr 23, 2025 am 11:30 AM

Comment construire des agents d'IA multimodaux à l'aide d'AGNO Framework?

Apr 23, 2025 am 11:30 AM

Tout en travaillant sur une IA agentique, les développeurs se retrouvent souvent à naviguer dans les compromis entre la vitesse, la flexibilité et l'efficacité des ressources. J'ai exploré le cadre de l'IA agentique et je suis tombé sur Agno (plus tôt c'était Phi-

Openai change de mise au point avec GPT-4.1, priorise le codage et la rentabilité

Apr 16, 2025 am 11:37 AM

Openai change de mise au point avec GPT-4.1, priorise le codage et la rentabilité

Apr 16, 2025 am 11:37 AM

La version comprend trois modèles distincts, GPT-4.1, GPT-4.1 Mini et GPT-4.1 Nano, signalant une évolution vers des optimisations spécifiques à la tâche dans le paysage du modèle grand langage. Ces modèles ne remplacent pas immédiatement les interfaces orientées utilisateur comme

Comment ajouter une colonne dans SQL? - Analytique Vidhya

Apr 17, 2025 am 11:43 AM

Comment ajouter une colonne dans SQL? - Analytique Vidhya

Apr 17, 2025 am 11:43 AM

Instruction ALTER TABLE de SQL: Ajout de colonnes dynamiquement à votre base de données Dans la gestion des données, l'adaptabilité de SQL est cruciale. Besoin d'ajuster votre structure de base de données à la volée? L'énoncé de la table alter est votre solution. Ce guide détaille l'ajout de Colu

Nouveau cours court sur les modèles d'intégration par Andrew Ng

Apr 15, 2025 am 11:32 AM

Nouveau cours court sur les modèles d'intégration par Andrew Ng

Apr 15, 2025 am 11:32 AM

Déverrouiller la puissance des modèles d'intégration: une plongée profonde dans le nouveau cours d'Andrew Ng Imaginez un avenir où les machines comprennent et répondent à vos questions avec une précision parfaite. Ce n'est pas de la science-fiction; Grâce aux progrès de l'IA, cela devient un R

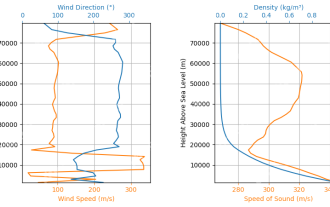

Simulation et analyse de lancement de fusées à l'aide de Rocketpy - Analytics Vidhya

Apr 19, 2025 am 11:12 AM

Simulation et analyse de lancement de fusées à l'aide de Rocketpy - Analytics Vidhya

Apr 19, 2025 am 11:12 AM

Simuler les lancements de fusée avec Rocketpy: un guide complet Cet article vous guide à travers la simulation des lancements de fusées haute puissance à l'aide de Rocketpy, une puissante bibliothèque Python. Nous couvrirons tout, de la définition de composants de fusée à l'analyse de Simula

Google dévoile la stratégie d'agent la plus complète au cloud prochain 2025

Apr 15, 2025 am 11:14 AM

Google dévoile la stratégie d'agent la plus complète au cloud prochain 2025

Apr 15, 2025 am 11:14 AM

Gemini comme fondement de la stratégie d'IA de Google Gemini est la pierre angulaire de la stratégie d'agent AI de Google, tirant parti de ses capacités multimodales avancées pour traiter et générer des réponses à travers le texte, les images, l'audio, la vidéo et le code. Développé par Deepm

Robots humanoïdes open source que vous pouvez imprimer vous-même: les câlins de visage achètent la robotique du pollen

Apr 15, 2025 am 11:25 AM

Robots humanoïdes open source que vous pouvez imprimer vous-même: les câlins de visage achètent la robotique du pollen

Apr 15, 2025 am 11:25 AM

"Super heureux d'annoncer que nous acquérons une robotique de pollen pour amener les robots open source au monde", a déclaré Hugging Face sur X. "Depuis que Remi Cadene nous a rejoints de Tesla, nous sommes devenus la plate-forme logicielle la plus utilisée pour la robotique ouverte grâce à des remerciements grâce à des remerciements grâce à des remerciements à une robotique ouverte grâce à des remerciements à des remerciements à des remerciements à la robotique ouverte grâce à des remerciements à Gérom

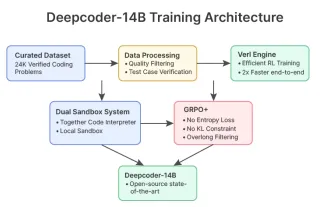

Deepcoder-14b: la compétition open source à O3-MinI et O1

Apr 26, 2025 am 09:07 AM

Deepcoder-14b: la compétition open source à O3-MinI et O1

Apr 26, 2025 am 09:07 AM

Dans un développement significatif pour la communauté de l'IA, Agetica et ensemble AI ont publié un modèle de codage d'IA open source nommé Deepcoder-14b. Offrir des capacités de génération de code à égalité avec des concurrents à source fermée comme OpenAI