Normalisation par lots: théorie et implémentation TensorFlow

La formation en réseau neuronal profond fait souvent face à des obstacles comme la disparition / explosion de gradients et le changement de covariable interne, le ralentissement de l'entraînement et le gêne d'apprentissage. Les techniques de normalisation offrent une solution, la normalisation par lots (BN) étant particulièrement importante. BN accélère la convergence, améliore la stabilité et améliore la généralisation dans de nombreuses architectures d'apprentissage en profondeur. Ce tutoriel explique la mécanique de BN, ses fondements mathématiques et la mise en œuvre de TensorFlow / Keras.

La normalisation dans l'apprentissage automatique standardise les données d'entrée, en utilisant des méthodes telles que la mise à l'échelle Min-Max, la normalisation des scores Z et les transformations de journal en fonctionnalités de sauvetage. Cela atténue les effets aberrants, améliore la convergence et garantit une comparaison des fonctionnalités équitables. Les données normalisées garantissent une contribution aux caractéristiques égales au processus d'apprentissage, empêchant les fonctionnalités à plus grande échelle de dominer et de conduisant à des performances sous-optimales du modèle. Il permet au modèle d'identifier plus efficacement les modèles significatifs.

Les défis de formation en profondeur comprennent:

- Shift de covariable interne: Les changements de distribution des activations entre les couches pendant la formation, l'adaptation et l'apprentissage.

- Les gradients de disparition / explosion: Les gradients deviennent trop petits ou grands pendant la rétropropagation, entravant des mises à jour efficaces de poids.

- Sensibilité d'initialisation: Les poids initiaux influencent fortement l'entraînement; Une mauvaise initialisation peut entraîner une convergence lente ou échouée.

La normalisation par lots les aborde en normalisant les activations au sein de chaque mini-lots, en stabilisant la formation et en améliorant les performances du modèle.

La normalisation par lots normalise les activations d'une couche dans un mini-lot pendant l'entraînement. Il calcule la moyenne et la variance des activations pour chaque fonctionnalité, puis se normalise en utilisant ces statistiques. Les paramètres apprenables (γ et β) sont à l'échelle et décalent les activations normalisées, permettant au modèle d'apprendre la distribution d'activation optimale.

Source: Yintai Ma et Diego Klabjan.

BN est généralement appliqué après la transformation linéaire d'une couche (par exemple, la multiplication matricielle dans les couches ou la convolution entièrement connectées dans les couches convolutionnelles) et avant la fonction d'activation non linéaire (par exemple, RELU). Les composants clés sont les statistiques de mini-lots (moyenne et variance), la normalisation et la mise à l'échelle / décalage avec des paramètres apprenables.

BN aborde le décalage de covariable interne en normalisant les activations au sein de chaque mini-lots, ce qui rend les entrées aux couches suivantes plus stables. Cela permet une convergence plus rapide avec des taux d'apprentissage plus élevés et réduit la sensibilité à l'initialisation. Il régulise également, empêchant le sur-ajustement en réduisant la dépendance à des modèles d'activation spécifiques.

Mathématiques de la normalisation par lots:

BN fonctionne différemment pendant la formation et l'inférence.

Formation:

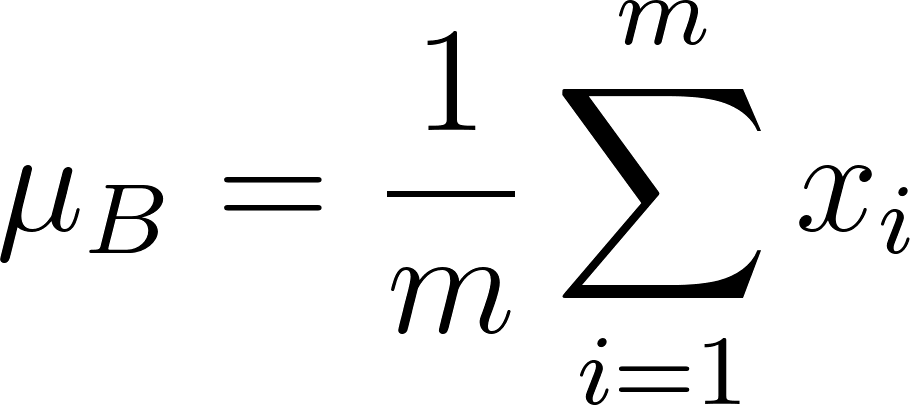

- Normalisation: Moyenne (μ B ) et la variance (σ b 2 ) sont calculées pour chaque caractéristique dans un mini-dossier:

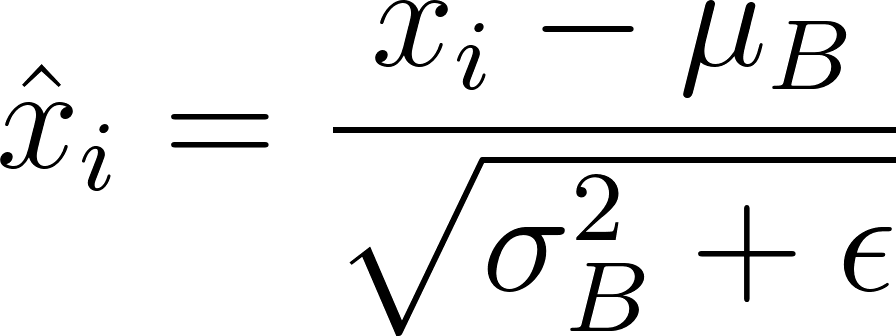

Les activations (x i ) sont normalisées:

(ε est une petite constante pour la stabilité numérique).

- Échelle et décalage: Paramètres apprenables γ et β Scale and Shift:

Inférence: Les statistiques par lots sont remplacées par des statistiques de fonctionnement (moyenne et variance) calculées pendant la formation en utilisant une moyenne mobile (facteur de momentum α):

Ces statistiques de course et les γ et β appris sont utilisés pour la normalisation pendant l'inférence.

Implémentation TensorFlow:

import tensorflow as tf

from tensorflow import keras

# Load and preprocess MNIST data (as described in the original text)

# ...

# Define the model architecture

model = keras.Sequential([

keras.layers.Conv2D(32, (3, 3), activation='relu', input_shape=(28, 28, 1)),

keras.layers.BatchNormalization(),

keras.layers.Conv2D(64, (3, 3), activation='relu'),

keras.layers.BatchNormalization(),

keras.layers.MaxPooling2D((2, 2)),

keras.layers.Flatten(),

keras.layers.Dense(128, activation='relu'),

keras.layers.BatchNormalization(),

keras.layers.Dense(10, activation='softmax')

])

# Compile and train the model (as described in the original text)

# ...Considérations d'implémentation:

- Placement: après transformations linéaires et avant les fonctions d'activation.

- Taille du lot: Les tailles de lots plus grandes fournissent des statistiques de lots plus précises.

- régularisation: bn introduit un effet de régularisation.

Limites et défis:

- Architectures non convolutionnelles: l'efficacité de BN est réduite dans les RNN et les transformateurs.

- Tailles de petites lots: Statistiques de lots moins fiables.

- frais généraux de calcul: Augmentation de la mémoire et du temps de formation.

Limitations d'atténuation: La normalisation du lot adaptative, la normalisation virtuelle des lots et les techniques de normalisation hybride peuvent répondre à certaines limitations.

Variants et extensions: La normalisation de la couche, la normalisation du groupe, la normalisation des instances, la renormalisation par lots et la normalisation du poids offrent des alternatives ou des améliorations en fonction des besoins spécifiques.

Conclusion: La normalisation par lots est une technique puissante améliorant la formation en réseau neuronal profond. N'oubliez pas ses avantages, ses détails de mise en œuvre et ses limites, et considérez ses variantes pour des performances optimales dans vos projets.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

Video Face Swap

Échangez les visages dans n'importe quelle vidéo sans effort grâce à notre outil d'échange de visage AI entièrement gratuit !

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Sujets chauds

Meilleurs générateurs d'art AI (gratuit & amp; payé) pour des projets créatifs

Apr 02, 2025 pm 06:10 PM

Meilleurs générateurs d'art AI (gratuit & amp; payé) pour des projets créatifs

Apr 02, 2025 pm 06:10 PM

L'article passe en revue les meilleurs générateurs d'art AI, discutant de leurs fonctionnalités, de leur aptitude aux projets créatifs et de la valeur. Il met en évidence MidJourney comme la meilleure valeur pour les professionnels et recommande Dall-E 2 pour un art personnalisable de haute qualité.

Début avec Meta Llama 3.2 - Analytics Vidhya

Apr 11, 2025 pm 12:04 PM

Début avec Meta Llama 3.2 - Analytics Vidhya

Apr 11, 2025 pm 12:04 PM

META'S LLAMA 3.2: un bond en avant dans l'IA multimodal et mobile Meta a récemment dévoilé Llama 3.2, une progression importante de l'IA avec de puissantes capacités de vision et des modèles de texte légers optimisés pour les appareils mobiles. S'appuyer sur le succès o

Meilleurs chatbots AI comparés (Chatgpt, Gemini, Claude & amp; plus)

Apr 02, 2025 pm 06:09 PM

Meilleurs chatbots AI comparés (Chatgpt, Gemini, Claude & amp; plus)

Apr 02, 2025 pm 06:09 PM

L'article compare les meilleurs chatbots d'IA comme Chatgpt, Gemini et Claude, en se concentrant sur leurs fonctionnalités uniques, leurs options de personnalisation et leurs performances dans le traitement et la fiabilité du langage naturel.

Assistants d'écriture de l'IA pour augmenter votre création de contenu

Apr 02, 2025 pm 06:11 PM

Assistants d'écriture de l'IA pour augmenter votre création de contenu

Apr 02, 2025 pm 06:11 PM

L'article traite des meilleurs assistants d'écriture d'IA comme Grammarly, Jasper, Copy.ai, WireSonic et Rytr, en se concentrant sur leurs fonctionnalités uniques pour la création de contenu. Il soutient que Jasper excelle dans l'optimisation du référencement, tandis que les outils d'IA aident à maintenir le ton

10 extensions de codage générateur AI dans le code vs que vous devez explorer

Apr 13, 2025 am 01:14 AM

10 extensions de codage générateur AI dans le code vs que vous devez explorer

Apr 13, 2025 am 01:14 AM

Hé là, codant ninja! Quelles tâches liées au codage avez-vous prévues pour la journée? Avant de plonger plus loin dans ce blog, je veux que vous réfléchissiez à tous vos malheurs liés au codage - les énumérez. Fait? - Let & # 8217

AV Bytes: Meta & # 039; S Llama 3.2, Google's Gemini 1.5, et plus

Apr 11, 2025 pm 12:01 PM

AV Bytes: Meta & # 039; S Llama 3.2, Google's Gemini 1.5, et plus

Apr 11, 2025 pm 12:01 PM

Le paysage de l'IA de cette semaine: un tourbillon de progrès, de considérations éthiques et de débats réglementaires. Les principaux acteurs comme Openai, Google, Meta et Microsoft ont déclenché un torrent de mises à jour, des nouveaux modèles révolutionnaires aux changements cruciaux de LE

Vendre une stratégie d'IA aux employés: le manifeste du PDG de Shopify

Apr 10, 2025 am 11:19 AM

Vendre une stratégie d'IA aux employés: le manifeste du PDG de Shopify

Apr 10, 2025 am 11:19 AM

La récente note du PDG de Shopify Tobi Lütke déclare hardiment la maîtrise de l'IA une attente fondamentale pour chaque employé, marquant un changement culturel important au sein de l'entreprise. Ce n'est pas une tendance éphémère; C'est un nouveau paradigme opérationnel intégré à P

Choisir le meilleur générateur de voix d'IA: les meilleures options examinées

Apr 02, 2025 pm 06:12 PM

Choisir le meilleur générateur de voix d'IA: les meilleures options examinées

Apr 02, 2025 pm 06:12 PM

L'article examine les meilleurs générateurs de voix d'IA comme Google Cloud, Amazon Polly, Microsoft Azure, IBM Watson et Descript, en se concentrant sur leurs fonctionnalités, leur qualité vocale et leur aptitude à différents besoins.