Périphériques technologiques

Périphériques technologiques

IA

IA

Comment exécuter LLM localement à l'aide de LM Studio? - Analytique Vidhya

Comment exécuter LLM localement à l'aide de LM Studio? - Analytique Vidhya

Comment exécuter LLM localement à l'aide de LM Studio? - Analytique Vidhya

Exécution de grands modèles de langue à la maison avec facilité: LM Studio User Guide

Ces dernières années, les progrès des logiciels et du matériel ont permis d'exécuter des modèles de grands langues (LLM) sur les ordinateurs personnels. LM Studio est un excellent outil pour rendre ce processus facile et pratique. Cet article plongera dans la façon d'exécuter LLM localement à l'aide de LM Studio, couvrant les étapes clés, les défis potentiels et les avantages d'avoir LLM localement. Que vous soyez un passionné de technologie ou que vous soyez curieux des dernières technologies de l'IA, ce guide fournira des informations précieuses et des conseils pratiques. Commençons!

Aperçu

- Comprendre les exigences de base pour exécuter LLM localement.

- Configurez LM Studio sur votre ordinateur.

- Exécutez et interagissez avec LLM à l'aide de LM Studio.

- Reconnaissez les avantages et les limites de LLM sur site.

Table des matières

- Qu'est-ce que LM Studio?

- Caractéristiques clés de LM Studio

- Configuration de LM Studio

- Exigences du système

- Étapes d'installation

- Télécharger et configurer le modèle

- Courir et interagir avec LLM

- En utilisant la console interactive

- Intégrer aux applications

- Démontrer LM Studio avec Gemma 2B de Google

- Avantages de l'exécution de LLM localement

- Limitations et défis

- FAQ

Qu'est-ce que LM Studio?

LM Studio simplifie la tâche d'exécution et de gestion de LLM sur un ordinateur personnel. Il offre des fonctionnalités puissantes et convient à tout le monde. Avec LM Studio, le téléchargement, la configuration et le déploiement de différents LLM sont un jeu d'enfant, vous permettant d'utiliser ses fonctionnalités sans compter sur les services cloud.

Caractéristiques clés de LM Studio

Voici les principales caractéristiques de LM Studio:

- Interface conviviale: LM Studio permet une gestion facile des modèles, des ensembles de données et des configurations.

- Gestion du modèle: téléchargez et changez facilement différents LLM.

- Configuration personnalisée: ajustez les paramètres pour optimiser les performances en fonction de vos capacités matérielles.

- Console interactive: interagir avec LLM en temps réel via une console intégrée.

- Fonctionnalités hors ligne: exécutez le modèle sans connexion Internet, assurant votre confidentialité et votre contrôle de données.

Lire aussi: Guide du débutant pour construire de grands modèles de langue à partir de zéro

Configuration de LM Studio

Voici comment configurer LM Studio:

Exigences du système

Avant d'installer LM Studio, assurez-vous que votre ordinateur répond aux exigences minimales suivantes:

- Exigences du processeur: processeur avec 4 cœurs ou plus.

- Compatibilité du système d'exploitation: Windows 10, Windows 11, MacOS 10.15 ou version ultérieure, ou distributions Linux modernes.

- RAM: au moins 16 Go.

- Espace disque: SSD avec au moins 50 Go d'espace libre.

- Carte graphique: NVIDIA GPU avec capacité CUDA (facultative pour les performances améliorées).

Étapes d'installation

- Téléchargez LM Studio: Visitez le site officiel de LM Studio et téléchargez l'installateur adapté à votre système d'exploitation.

- Installez LM Studio: suivez les instructions à l'écran pour installer le logiciel sur votre ordinateur.

- Démarrez LM Studio: Après l'installation, ouvrez-le et suivez l'assistant de configuration initial pour configurer les paramètres de base.

Télécharger et configurer le modèle

Voici comment télécharger et configurer le modèle:

- Sélectionnez un modèle: accédez à la section Modèles dans l'interface LM Studio pour parcourir les modèles de langue disponibles. Sélectionnez le modèle qui répond à vos exigences et cliquez sur "Télécharger".

- Ajustez les paramètres du modèle: après téléchargement, ajustez les paramètres du modèle tels que la taille du lot, l'utilisation de la mémoire et la puissance de calcul. Ces ajustements doivent correspondre à vos spécifications matérielles.

- Initialisez le modèle: Après la configuration des paramètres, cliquez sur "Charger le modèle" pour démarrer le modèle. Cela peut prendre plusieurs minutes, selon la taille du modèle et votre matériel.

Courir et interagir avec LLM

En utilisant la console interactive

Il fournit une console interactive qui vous permet de saisir du texte et de recevoir des réponses de LLMS chargés. Cette console est idéale pour tester la fonctionnalité du modèle et essayer différents conseils.

- Ouvrez la console: dans l'interface LM Studio, accédez à la section Console.

- Entrez le texte: entrez votre invite ou votre question dans le champ de saisie et appuyez sur Entrée.

- Réponse de réception: LLM traitera votre entrée et générera une réponse qui sera affichée dans la console.

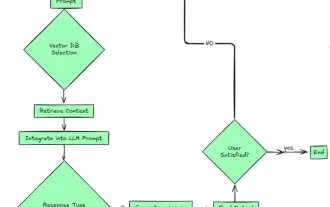

Intégrer aux applications

LM Studio prend également en charge l'intégration d'API, vous permettant d'intégrer LLM dans vos applications. Ceci est particulièrement utile pour développer des chatbots, des outils de génération de contenu ou toute autre application qui profite de la compréhension et de la génération du langage naturel.

Démontrer LM Studio avec Gemma 2B de Google

J'ai téléchargé GEMMA 2B Instruct de Google depuis la page d'accueil, qui est un petit LLM rapide. Vous pouvez télécharger tous les modèles suggérés à partir de la page d'accueil ou rechercher des modèles spécifiques. Les modèles téléchargés peuvent être consultés dans mes modèles.

Accédez aux options de chat AI à gauche et sélectionnez votre modèle en haut. J'utilise le modèle Gemma 2B Instruct ici. Notez que vous pouvez voir l'utilisation de la RAM en haut.

J'ai défini l'invite du système sur "Vous êtes un assistant utile" à droite. Ceci est facultatif; Vous pouvez le laisser par défaut ou définir en fonction de vos besoins.

Nous pouvons voir que le LLM généré par le texte répond à mon invite et répond à ma question. Vous pouvez maintenant explorer et expérimenter une variété de LLM locaux.

Avantages de l'exécution de LLM localement

Voici les avantages:

- Confidentialité des données: l'exécution de LLM garantit localement que vos données restent privées et sécurisées car elles n'ont pas besoin d'être transférées sur un serveur externe.

- Corparement: utilisez votre matériel existant pour éviter les coûts récurrents associés aux services LLM basés sur le cloud.

- Personnalisable: personnalisez le modèle et ses paramètres pour mieux répondre à vos exigences spécifiques et capacités matérielles.

- Accès hors ligne: utilisez le modèle sans connexion Internet, assurant l'accessibilité même dans des environnements distants ou restreints.

Limitations et défis

Voici les limites et les défis de l'exécution de LLM localement:

- Exigences matérielles: l'exécution de LLM localement nécessite beaucoup de ressources informatiques, en particulier pour les grands modèles.

- Complexité de configuration: la configuration et la configuration initiales peuvent être complexes pour les utilisateurs ayant une expertise technique limitée.

- Performances: les performances et l'évolutivité sur site peuvent ne pas correspondre aux solutions basées sur le cloud, en particulier dans les applications en temps réel.

en conclusion

L'exécution de LLM sur un PC avec LM Studio offre plusieurs avantages tels que l'amélioration de la sécurité des données, des coûts réduits et des capacités de personnalisation améliorées. Malgré les obstacles associés aux exigences matérielles et aux processus de configuration, ses avantages en font un choix idéal pour les utilisateurs qui cherchent à utiliser de grands modèles de langage.

FAQ

Q1. Qu'est-ce que LM Studio? R: LM Studio facilite le déploiement local et la gestion des modèles de grands langues, fournissant une interface conviviale et des fonctionnalités puissantes.

Q2. Puis-je utiliser LM Studio pour exécuter LLM sans connexion Internet? R: Oui, LM Studio vous permet d'exécuter des modèles hors ligne, d'assurer la confidentialité et l'accessibilité des données dans des environnements distants.

Q3. Quels sont les avantages de l'exécution de LLM localement? R: Confidentialité des données, économies de coûts, personnalisabilité et accès hors ligne.

Q4. À quels défis dois-je faire face lors de l'exécution de LLM localement? R: Les défis incluent des exigences matérielles élevées, des processus de configuration complexes et des limitations de performances potentielles par rapport aux solutions basées sur le cloud.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

Video Face Swap

Échangez les visages dans n'importe quelle vidéo sans effort grâce à notre outil d'échange de visage AI entièrement gratuit !

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Sujets chauds

Meilleurs générateurs d'art AI (gratuit & amp; payé) pour des projets créatifs

Apr 02, 2025 pm 06:10 PM

Meilleurs générateurs d'art AI (gratuit & amp; payé) pour des projets créatifs

Apr 02, 2025 pm 06:10 PM

L'article passe en revue les meilleurs générateurs d'art AI, discutant de leurs fonctionnalités, de leur aptitude aux projets créatifs et de la valeur. Il met en évidence MidJourney comme la meilleure valeur pour les professionnels et recommande Dall-E 2 pour un art personnalisable de haute qualité.

Début avec Meta Llama 3.2 - Analytics Vidhya

Apr 11, 2025 pm 12:04 PM

Début avec Meta Llama 3.2 - Analytics Vidhya

Apr 11, 2025 pm 12:04 PM

META'S LLAMA 3.2: un bond en avant dans l'IA multimodal et mobile Meta a récemment dévoilé Llama 3.2, une progression importante de l'IA avec de puissantes capacités de vision et des modèles de texte légers optimisés pour les appareils mobiles. S'appuyer sur le succès o

Meilleurs chatbots AI comparés (Chatgpt, Gemini, Claude & amp; plus)

Apr 02, 2025 pm 06:09 PM

Meilleurs chatbots AI comparés (Chatgpt, Gemini, Claude & amp; plus)

Apr 02, 2025 pm 06:09 PM

L'article compare les meilleurs chatbots d'IA comme Chatgpt, Gemini et Claude, en se concentrant sur leurs fonctionnalités uniques, leurs options de personnalisation et leurs performances dans le traitement et la fiabilité du langage naturel.

Assistants d'écriture de l'IA pour augmenter votre création de contenu

Apr 02, 2025 pm 06:11 PM

Assistants d'écriture de l'IA pour augmenter votre création de contenu

Apr 02, 2025 pm 06:11 PM

L'article traite des meilleurs assistants d'écriture d'IA comme Grammarly, Jasper, Copy.ai, WireSonic et Rytr, en se concentrant sur leurs fonctionnalités uniques pour la création de contenu. Il soutient que Jasper excelle dans l'optimisation du référencement, tandis que les outils d'IA aident à maintenir le ton

AV Bytes: Meta & # 039; S Llama 3.2, Google's Gemini 1.5, et plus

Apr 11, 2025 pm 12:01 PM

AV Bytes: Meta & # 039; S Llama 3.2, Google's Gemini 1.5, et plus

Apr 11, 2025 pm 12:01 PM

Le paysage de l'IA de cette semaine: un tourbillon de progrès, de considérations éthiques et de débats réglementaires. Les principaux acteurs comme Openai, Google, Meta et Microsoft ont déclenché un torrent de mises à jour, des nouveaux modèles révolutionnaires aux changements cruciaux de LE

Vendre une stratégie d'IA aux employés: le manifeste du PDG de Shopify

Apr 10, 2025 am 11:19 AM

Vendre une stratégie d'IA aux employés: le manifeste du PDG de Shopify

Apr 10, 2025 am 11:19 AM

La récente note du PDG de Shopify Tobi Lütke déclare hardiment la maîtrise de l'IA une attente fondamentale pour chaque employé, marquant un changement culturel important au sein de l'entreprise. Ce n'est pas une tendance éphémère; C'est un nouveau paradigme opérationnel intégré à P

Top 7 Système de chiffon agentique pour construire des agents d'IA

Mar 31, 2025 pm 04:25 PM

Top 7 Système de chiffon agentique pour construire des agents d'IA

Mar 31, 2025 pm 04:25 PM

2024 a été témoin d'un simple passage de l'utilisation des LLM pour la génération de contenu pour comprendre leur fonctionnement intérieur. Cette exploration a conduit à la découverte des agents de l'IA - les systèmes autonomes manipulant des tâches et des décisions avec une intervention humaine minimale. Construire

10 extensions de codage générateur AI dans le code vs que vous devez explorer

Apr 13, 2025 am 01:14 AM

10 extensions de codage générateur AI dans le code vs que vous devez explorer

Apr 13, 2025 am 01:14 AM

Hé là, codant ninja! Quelles tâches liées au codage avez-vous prévues pour la journée? Avant de plonger plus loin dans ce blog, je veux que vous réfléchissiez à tous vos malheurs liés au codage - les énumérez. Fait? - Let & # 8217