Javascript图像处理—阈值函数实例应用_javascript技巧

上一篇文章,我们讲解了图像处理中的亮度和对比度的变化,这篇文章我们来做一个阈值函数。

最简单的图像分割方法

阈值是最简单的图像分割方法。

比如为了从下图中分割出苹果,我们利用前景与背景的灰度差值,通过设定一个阈值,对于该像素大于这个阈值时就以黑色表示,小于便以灰色表示。

五种阈值类型

和OpenCV一样,我们将提供五种阈值类型,方便使用。

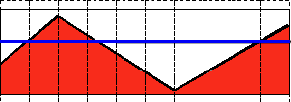

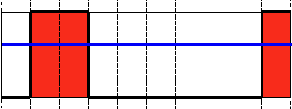

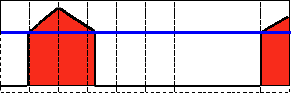

下面是原图像的波形表示,纵坐标表示像素点的灰度值大小,蓝线是阈值大小。

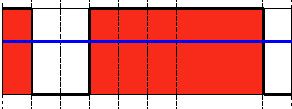

公式表示是:

图像表示是:

可见超过该阈值的就变成最大值(即255),否则变成最小值(也就是0)。我们需要一个函数来实现这个功能:

var CV_THRESH_BINARY = function(__value, __thresh, __maxVal){

return __value > __thresh ? __maxVal : 0;

};

反二进制阈值化

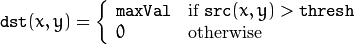

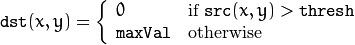

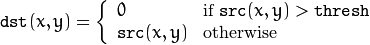

公式表示是:

图像表示是:

这个则反过来,超过阈值的变成最小值,否则变成最大值。函数实现是:

var CV_THRESH_BINARY_INV = function(__value, __thresh, __maxVal){

return __value > __thresh ? 0 : __maxVal;

};

截断阈值化

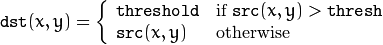

公式表示是:

图像表示是:

可见这个是超过阈值的就被截断。函数实现是:

var CV_THRESH_TRUNC = function(__value, __thresh, __maxVal){

return __value > __thresh ? __thresh : 0;

};

阈值化为0

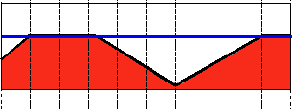

公式表示是:

图像表示是:

这个则是小于阈值的都化为0处理。函数实现:

var CV_THRESH_TOZERO = function(__value, __thresh, __maxVal){

return __value > __thresh ? __value : 0;

};

反阈值化为0

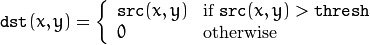

公式表示是:

图像表示是:

这个则在超过阈值时候置为0,函数实现是:

var CV_THRESH_TOZERO_INV = function(__value, __thresh, __maxVal){

return __value > __thresh ? 0 : __value;

};

阈值处理函数实现

然后我们做一个函数对整幅图进行上面这几种类型的阈值处理。

var threshold = function(__src, __thresh, __maxVal, __thresholdType, __dst){

(__src && __thresh) || error(arguments.callee, IS_UNDEFINED_OR_NULL/* {line} */);

if(__src.type && __src.type == "CV_GRAY"){

var width = __src.col,

height = __src.row,

sData = __src.data,

dst = __dst || new Mat(height, width, CV_GRAY),

dData = dst.data,

maxVal = __maxVal || 255,

threshouldType = __thresholdType || CV_THRESH_BINARY;

var i, j, offset;

for(i = height; i--;){

for(j = width; j--;){

offset = i * width + j;

dData[offset] = threshouldType(sData[offset], __thresh, maxVal);

}

}

}else{

error(arguments.callee, UNSPPORT_DATA_TYPE/* {line} */);

}

return dst;

};

这个函数比较简单,就是对每个像素点赋值为

threshouldType(sData[offset], __thresh, maxVal)

返回的数值。

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Sujets chauds

Comment la distance de Wasserstein est-elle utilisée dans les tâches de traitement d'images ?

Jan 23, 2024 am 10:39 AM

Comment la distance de Wasserstein est-elle utilisée dans les tâches de traitement d'images ?

Jan 23, 2024 am 10:39 AM

La distance de Wasserstein, également connue sous le nom de distance de EarthMover (EMD), est une mesure utilisée pour mesurer la différence entre deux distributions de probabilité. Par rapport à la divergence KL ou à la divergence JS traditionnelle, la distance de Wasserstein prend en compte les informations structurelles entre les distributions et présente donc de meilleures performances dans de nombreuses tâches de traitement d'image. En calculant le coût minimum de transport entre deux distributions, la distance de Wasserstein permet de mesurer la quantité minimale de travail nécessaire pour transformer une distribution en une autre. Cette métrique est capable de capturer les différences géométriques entre les distributions, jouant ainsi un rôle important dans des tâches telles que la génération d'images et le transfert de style. Par conséquent, la distance de Wasserstein devient le concept

Analyse approfondie des principes de fonctionnement et des caractéristiques du modèle Vision Transformer (VIT)

Jan 23, 2024 am 08:30 AM

Analyse approfondie des principes de fonctionnement et des caractéristiques du modèle Vision Transformer (VIT)

Jan 23, 2024 am 08:30 AM

VisionTransformer (VIT) est un modèle de classification d'images basé sur Transformer proposé par Google. Contrairement aux modèles CNN traditionnels, VIT représente les images sous forme de séquences et apprend la structure de l'image en prédisant l'étiquette de classe de l'image. Pour y parvenir, VIT divise l'image d'entrée en plusieurs patchs et concatène les pixels de chaque patch via des canaux, puis effectue une projection linéaire pour obtenir les dimensions d'entrée souhaitées. Enfin, chaque patch est aplati en un seul vecteur, formant la séquence d'entrée. Grâce au mécanisme d'auto-attention de Transformer, VIT est capable de capturer la relation entre les différents correctifs et d'effectuer une extraction efficace des fonctionnalités et une prédiction de classification. Cette représentation d'image sérialisée est

Comment utiliser la technologie IA pour restaurer d'anciennes photos (avec exemples et analyse de code)

Jan 24, 2024 pm 09:57 PM

Comment utiliser la technologie IA pour restaurer d'anciennes photos (avec exemples et analyse de code)

Jan 24, 2024 pm 09:57 PM

La restauration de photos anciennes est une méthode d'utilisation de la technologie de l'intelligence artificielle pour réparer, améliorer et améliorer de vieilles photos. Grâce à des algorithmes de vision par ordinateur et d’apprentissage automatique, la technologie peut identifier et réparer automatiquement les dommages et les imperfections des anciennes photos, les rendant ainsi plus claires, plus naturelles et plus réalistes. Les principes techniques de la restauration de photos anciennes incluent principalement les aspects suivants : 1. Débruitage et amélioration de l'image Lors de la restauration de photos anciennes, elles doivent d'abord être débruitées et améliorées. Des algorithmes et des filtres de traitement d'image, tels que le filtrage moyen, le filtrage gaussien, le filtrage bilatéral, etc., peuvent être utilisés pour résoudre les problèmes de bruit et de taches de couleur, améliorant ainsi la qualité des photos. 2. Restauration et réparation d'images Les anciennes photos peuvent présenter certains défauts et dommages, tels que des rayures, des fissures, une décoloration, etc. Ces problèmes peuvent être résolus par des algorithmes de restauration et de réparation d’images

Développement Java : comment implémenter la reconnaissance et le traitement d'images

Sep 21, 2023 am 08:39 AM

Développement Java : comment implémenter la reconnaissance et le traitement d'images

Sep 21, 2023 am 08:39 AM

Développement Java : Un guide pratique sur la reconnaissance et le traitement d'images Résumé : Avec le développement rapide de la vision par ordinateur et de l'intelligence artificielle, la reconnaissance et le traitement d'images jouent un rôle important dans divers domaines. Cet article expliquera comment utiliser le langage Java pour implémenter la reconnaissance et le traitement d'images, et fournira des exemples de code spécifiques. 1. Principes de base de la reconnaissance d'images La reconnaissance d'images fait référence à l'utilisation de la technologie informatique pour analyser et comprendre des images afin d'identifier des objets, des caractéristiques ou du contenu dans l'image. Avant d'effectuer la reconnaissance d'image, nous devons comprendre certaines techniques de base de traitement d'image, comme le montre la figure

Application de la technologie de l'IA à la reconstruction d'images en super-résolution

Jan 23, 2024 am 08:06 AM

Application de la technologie de l'IA à la reconstruction d'images en super-résolution

Jan 23, 2024 am 08:06 AM

La reconstruction d'images en super-résolution est le processus de génération d'images haute résolution à partir d'images basse résolution à l'aide de techniques d'apprentissage en profondeur, telles que les réseaux neuronaux convolutifs (CNN) et les réseaux contradictoires génératifs (GAN). Le but de cette méthode est d'améliorer la qualité et les détails des images en convertissant des images basse résolution en images haute résolution. Cette technologie trouve de nombreuses applications dans de nombreux domaines, comme l’imagerie médicale, les caméras de surveillance, les images satellites, etc. Grâce à la reconstruction d’images en super-résolution, nous pouvons obtenir des images plus claires et plus détaillées, ce qui permet d’analyser et d’identifier plus précisément les cibles et les caractéristiques des images. Méthodes de reconstruction Les méthodes de reconstruction d'images en super-résolution peuvent généralement être divisées en deux catégories : les méthodes basées sur l'interpolation et les méthodes basées sur l'apprentissage profond. 1) Méthode basée sur l'interpolation Reconstruction d'images en super-résolution basée sur l'interpolation

Notes d'étude PHP : reconnaissance faciale et traitement d'images

Oct 08, 2023 am 11:33 AM

Notes d'étude PHP : reconnaissance faciale et traitement d'images

Oct 08, 2023 am 11:33 AM

Notes d'étude PHP : Reconnaissance faciale et traitement d'images Préface : Avec le développement de la technologie de l'intelligence artificielle, la reconnaissance faciale et le traitement d'images sont devenus des sujets brûlants. Dans les applications pratiques, la reconnaissance faciale et le traitement d'images sont principalement utilisés dans la surveillance de la sécurité, le déverrouillage facial, la comparaison de cartes, etc. En tant que langage de script côté serveur couramment utilisé, PHP peut également être utilisé pour implémenter des fonctions liées à la reconnaissance faciale et au traitement d'images. Cet article vous présentera la reconnaissance faciale et le traitement d'images en PHP, avec des exemples de code spécifiques. 1. Reconnaissance faciale en PHP La reconnaissance faciale est un

Algorithme SIFT (Scale Invariant Features)

Jan 22, 2024 pm 05:09 PM

Algorithme SIFT (Scale Invariant Features)

Jan 22, 2024 pm 05:09 PM

L'algorithme SIFT (Scale Invariant Feature Transform) est un algorithme d'extraction de caractéristiques utilisé dans les domaines du traitement d'images et de la vision par ordinateur. Cet algorithme a été proposé en 1999 pour améliorer les performances de reconnaissance et de correspondance d'objets dans les systèmes de vision par ordinateur. L'algorithme SIFT est robuste et précis et est largement utilisé dans la reconnaissance d'images, la reconstruction tridimensionnelle, la détection de cibles, le suivi vidéo et d'autres domaines. Il obtient l'invariance d'échelle en détectant les points clés dans plusieurs espaces d'échelle et en extrayant des descripteurs de caractéristiques locales autour des points clés. Les principales étapes de l'algorithme SIFT comprennent la construction d'un espace d'échelle, la détection des points clés, le positionnement des points clés, l'attribution de directions et la génération de descripteurs de caractéristiques. Grâce à ces étapes, l’algorithme SIFT peut extraire des fonctionnalités robustes et uniques, permettant ainsi un traitement d’image efficace.

Comment gérer les problèmes de traitement d'image et de conception d'interface graphique dans le développement C#

Oct 08, 2023 pm 07:06 PM

Comment gérer les problèmes de traitement d'image et de conception d'interface graphique dans le développement C#

Oct 08, 2023 pm 07:06 PM

Comment gérer les problèmes de traitement d'image et de conception d'interface graphique dans le développement C# nécessite des exemples de code spécifiques Introduction : Dans le développement de logiciels modernes, le traitement d'image et la conception d'interface graphique sont des exigences courantes. En tant que langage de programmation généraliste de haut niveau, C# possède de puissantes capacités de traitement d’images et de conception d’interface graphique. Cet article sera basé sur C#, expliquera comment gérer les problèmes de traitement d'image et de conception d'interface graphique, et donnera des exemples de code détaillés. 1. Problèmes de traitement d'image : Lecture et affichage d'images : En C#, la lecture et l'affichage d'images sont des opérations de base. Peut être utilisé.N