ajax完美实现两个网页 分页功能的实例代码

分页的首页

复制代码 代码如下:

武侠小说分页

<script><BR>var page='';<BR> function init(page){<BR> document.getElementById("tables").innerHTML='';<BR> var xhr;<BR> if(window.XMLHttpRequest){<BR> xhr = new XMLHttpRequest();<BR>}else if(window.ActiveXObject){<BR> xhr =new ActiveXObject("Microsoft.XMLHTTP")<BR>}<BR>var url="fenye.php";<BR> xhr.open("POST",url,true);<BR> xhr.onreadystatechange=callback;<BR> xhr.setRequestHeader("Content-Type","application/x-www-form-urlencoded");<BR> if(page){<BR> xhr.send("page="+page);<BR> }<BR> else {xhr.send("page=1");}<BR> var content;<BR> function callback(){<BR> if(xhr.readyState==4){<BR> if(xhr.status==200){<BR> var json =eval('('+xhr.responseText+')');<BR> //alert(xhr.responseText);<BR> var fenye=json.str;<BR> // alert(fenye);<BR> document.getElementById('div').innerHTML=fenye;<BR> content="<th>ID<th>名称<th>作者<th>出版社<th>ISBN号<th>类型<th>价格";<BR> for(var i=0;i<json.info.length;i++){<BR> content+="<tr><td>"+json.info[i].id+"<td>"+json.info[i].name+"<td>"+json.info[i].author+"<td>"+json.info[i].publisher+"<td>"+json.info[i].isbn+"<td>"+json.info[i].type+"<td>"+json.info[i].price+"";<BR> document.getElementById("tables").innerHTML=content;<BR> }<BR> // alert(fenye);<BR> }<BR> }<BR> }<BR> }<br><br></script>

jquery实现$.ajax的分页

| ID | 名称 | 作者 | 出版社 | ISBN号 | 类型 | 价格 |

|---|

|

|

|

分页的php精华代码

复制代码 代码如下:

//命令模型层处理数据

$link=mysql_connect('localhost','root','') or die("失败");

mysql_select_db('books',$link) or die("连接数据库出错了!");

//每页显示记录数

$pagesize = 2;

//求出总的记录数

$sql = "select count(*) as total_rows from books";

$result = mysql_query($sql);

$total_rows = mysql_fetch_array($result);

//求总共的页码数

$pages = ceil($total_rows[0]/$pagesize);

//当前第几页

$page = $_POST['page'];

$strtext = "当前第".$page."页"."总共".$pages."页"."共".$total_rows[0]."记录";

//var_dump($str);

//接下来,我要根据当前点击的页码求出对应的数据

$offset = $pagesize*($page-1);

$sql = "select * from books limit $offset,$pagesize";

mysql_query("set names utf8");

$res=mysql_query($sql);

$rows=array();

while($row=mysql_fetch_assoc($res)){

$rows[]=$row;

}

$pageInfo = $rows;

//echo json_encode($pageInfo);

//var_dump($pageInfo);

//将获得数据链接,后返回

$first=1;

$prev=$page-1;

$next=$page+1;

$last=$pages;

//命令视图层显示数据

$first_a = " ";

";

if($page>1){

$prev_a = " ";

";

}

if($page $next_a = " ";

";

}

$last_a = " ";

";

@$str = $strtext.$first_a.$prev_a.$next_a.$last_a;

//var_dump($str);

$info = array('str'=>$str,'info'=>$pageInfo);

echo json_encode($info);

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Un nouveau casque VR Meta Quest 3S abordable apparaît sur FCC, suggérant un lancement imminent

Sep 04, 2024 am 06:51 AM

Un nouveau casque VR Meta Quest 3S abordable apparaît sur FCC, suggérant un lancement imminent

Sep 04, 2024 am 06:51 AM

L'événement Meta Connect 2024 est prévu du 25 au 26 septembre et lors de cet événement, la société devrait dévoiler un nouveau casque de réalité virtuelle abordable. Selon la rumeur, il s'agirait du Meta Quest 3S, le casque VR serait apparemment apparu sur la liste FCC. Cela suggère

Le premier modèle open source à dépasser le niveau GPT4o ! Llama 3.1 fuite : 405 milliards de paramètres, liens de téléchargement et cartes de modèles sont disponibles

Jul 23, 2024 pm 08:51 PM

Le premier modèle open source à dépasser le niveau GPT4o ! Llama 3.1 fuite : 405 milliards de paramètres, liens de téléchargement et cartes de modèles sont disponibles

Jul 23, 2024 pm 08:51 PM

Préparez votre GPU ! Llama3.1 est finalement apparu, mais la source n'est pas officielle de Meta. Aujourd'hui, la nouvelle divulguée du nouveau grand modèle Llama est devenue virale sur Reddit. En plus du modèle de base, elle comprend également des résultats de référence de 8B, 70B et le paramètre maximum de 405B. La figure ci-dessous montre les résultats de comparaison de chaque version de Llama3.1 avec OpenAIGPT-4o et Llama38B/70B. On peut voir que même la version 70B dépasse GPT-4o sur plusieurs benchmarks. Source de l'image : https://x.com/mattshumer_/status/1815444612414087294 Évidemment, version 3.1 de 8B et 70

Six façons rapides de découvrir le nouveau Llama 3 !

Apr 19, 2024 pm 12:16 PM

Six façons rapides de découvrir le nouveau Llama 3 !

Apr 19, 2024 pm 12:16 PM

Hier soir, Meta a publié les modèles Llama38B et 70B. Le modèle optimisé pour les instructions Llama3 est affiné et optimisé pour les cas d'utilisation de dialogue/chat et surpasse de nombreux modèles de chat open source existants dans les benchmarks courants. Par exemple, Gemma7B et Mistral7B. Le modèle Llama+3 améliore les données et l'échelle et atteint de nouveaux sommets. Il a été formé sur plus de 15 000 jetons de données sur deux clusters GPU 24 000 personnalisés récemment publiés par Meta. Cet ensemble de données de formation est 7 fois plus grand que Llama2 et contient 4 fois plus de code. Cela porte la capacité du modèle Llama au niveau le plus élevé actuel, qui prend en charge des longueurs de texte supérieures à 8 Ko, soit le double de celle de Llama2. sous

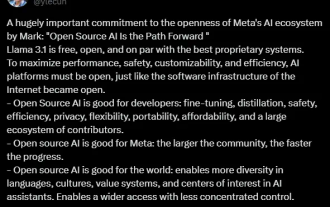

Le modèle le plus puissant Llama 3.1 405B est officiellement lancé, Zuckerberg : l'Open source mène une nouvelle ère

Jul 24, 2024 pm 08:23 PM

Le modèle le plus puissant Llama 3.1 405B est officiellement lancé, Zuckerberg : l'Open source mène une nouvelle ère

Jul 24, 2024 pm 08:23 PM

Tout à l'heure, le très attendu Llama 3.1 est officiellement sorti ! Meta a officiellement déclaré que "l'open source mène une nouvelle ère". Sur le blog officiel, Meta a déclaré : « Jusqu'à aujourd'hui, les grands modèles de langage open source étaient pour la plupart à la traîne des modèles fermés en termes de fonctionnalités et de performances. Nous inaugurons désormais une nouvelle ère dirigée par l'open source. Nous avons rendu public MetaLlama3.1405B. , qui, selon nous, est le modèle de base open source le plus grand et le plus puissant au monde, à ce jour, le nombre total de téléchargements de toutes les versions de Llama a dépassé les 300 millions de fois, et nous venons de commencer, le fondateur et PDG de Meta, Zuckerberg. article long "OpenSourceAIIsthePathForward",

Llama3 arrive soudainement ! La communauté open source est à nouveau en ébullition : l'ère de l'accès gratuit aux modèles de niveau GPT4 est arrivée

Apr 19, 2024 pm 12:43 PM

Llama3 arrive soudainement ! La communauté open source est à nouveau en ébullition : l'ère de l'accès gratuit aux modèles de niveau GPT4 est arrivée

Apr 19, 2024 pm 12:43 PM

Llama3 est là ! Tout à l'heure, le site officiel de Meta a été mis à jour et le responsable a annoncé les versions de Llama à 38 milliards et 70 milliards de paramètres. Et c'est un SOTA open source après son lancement : les métadonnées officielles montrent que les versions Llama38B et 70B surpassent tous les adversaires dans leurs échelles de paramètres respectives. Le modèle 8B surpasse Gemma7B et Mistral7BInstruct sur de nombreux benchmarks tels que MMLU, GPQA et HumanEval. Le modèle 70B a surpassé le populaire poulet frit Claude3Sonnet et a fait des allers-retours avec le GeminiPro1.5 de Google. Dès que le lien Huggingface est sorti, la communauté open source est redevenue enthousiasmée. Les étudiants aveugles aux yeux perçants ont également découvert immédiatement

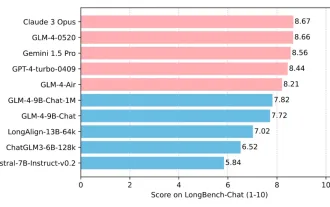

L'Université Tsinghua et Zhipu AI open source GLM-4 : lancent une nouvelle révolution dans le traitement du langage naturel

Jun 12, 2024 pm 08:38 PM

L'Université Tsinghua et Zhipu AI open source GLM-4 : lancent une nouvelle révolution dans le traitement du langage naturel

Jun 12, 2024 pm 08:38 PM

Depuis le lancement du ChatGLM-6B le 14 mars 2023, les modèles de la série GLM ont reçu une large attention et une grande reconnaissance. Surtout après que ChatGLM3-6B soit open source, les développeurs sont pleins d'attentes pour le modèle de quatrième génération lancé par Zhipu AI. Cette attente a finalement été pleinement satisfaite avec la sortie du GLM-4-9B. La naissance du GLM-4-9B Afin de donner aux petits modèles (10B et moins) des capacités plus puissantes, l'équipe technique de GLM a lancé ce nouveau modèle open source de la série GLM de quatrième génération : GLM-4-9B après près de six mois de exploration. Ce modèle compresse considérablement la taille du modèle tout en garantissant la précision, et offre une vitesse d'inférence plus rapide et une efficacité plus élevée. L’exploration de l’équipe technique du GLM n’a pas

Un analyste discute du prix de lancement du casque VR Meta Quest 3S

Aug 27, 2024 pm 09:35 PM

Un analyste discute du prix de lancement du casque VR Meta Quest 3S

Aug 27, 2024 pm 09:35 PM

Plus d'un an s'est écoulé depuis la sortie initiale du Quest 3 par Meta (499,99 $ sur Amazon). Depuis lors, Apple a commercialisé le Vision Pro, considérablement plus cher, tandis que Byte Dance a dévoilé le Pico 4 Ultra en Chine. Cependant, il y a

Comprendre VSCode : à quoi sert cet outil ?

Mar 25, 2024 pm 03:06 PM

Comprendre VSCode : à quoi sert cet outil ?

Mar 25, 2024 pm 03:06 PM

« Comprendre VSCode : à quoi sert cet outil ? » 》En tant que programmeur, que vous soyez débutant ou développeur expérimenté, vous ne pouvez pas vous passer de l'utilisation d'outils d'édition de code. Parmi les nombreux outils d'édition, Visual Studio Code (VSCode en abrégé) est très populaire parmi les développeurs en tant qu'éditeur de code open source, léger et puissant. Alors, à quoi sert exactement VSCode ? Cet article approfondira les fonctions et les utilisations de VSCode et fournira des exemples de code spécifiques pour aider les lecteurs.