développement back-end

développement back-end

Tutoriel Python

Tutoriel Python

Un tutoriel simple sur l'utilisation de Python pour l'analyse des données

Un tutoriel simple sur l'utilisation de Python pour l'analyse des données

Un tutoriel simple sur l'utilisation de Python pour l'analyse des données

Récemment, Analysis with Programming a ajouté Planet Python. En tant que l'un des premiers blogueurs invités sur ce site Web, je suis ici pour partager comment démarrer l'analyse de données via Python. Les contenus spécifiques sont les suivants :

Importation de données

Importation de fichiers CSV locaux ou Web ;

Transformation de données

Description statistique des données

Test d'hypothèses

Échantillon unique ; -test;

Visualisation;

Créer des fonctions personnalisées.

Importation de données

Il s'agit d'une étape critique pour une analyse ultérieure, nous devons d'abord importer les données. De manière générale, les données sont au format CSV, et même si ce n'est pas le cas, elles peuvent au moins être converties au format CSV. En Python, nos opérations sont les suivantes :

import pandas as pd # Reading data locally df = pd.read_csv('/Users/al-ahmadgaidasaad/Documents/d.csv') # Reading data from web data_url = "https://raw.githubusercontent.com/alstat/Analysis-with-Programming/master/2014/Python/Numerical-Descriptions-of-the-Data/data.csv" df = pd.read_csv(data_url)

Afin de lire les fichiers CSV locaux, nous avons besoin du module correspondant dans la bibliothèque d'analyse de données pandas. La fonction read_csv peut lire des données locales et Web.

Transformation des données

Maintenant qu'il y a des données dans l'espace de travail, la prochaine étape est la transformation des données. Les statisticiens et les scientifiques suppriment souvent les données inutiles de l’analyse à cette étape. Jetons d'abord un coup d'œil aux données :

# Head of the data print df.head() # OUTPUT Abra Apayao Benguet Ifugao Kalinga 0 1243 2934 148 3300 10553 1 4158 9235 4287 8063 35257 2 1787 1922 1955 1074 4544 3 17152 14501 3536 19607 31687 4 1266 2385 2530 3315 8520 # Tail of the data print df.tail() # OUTPUT Abra Apayao Benguet Ifugao Kalinga 74 2505 20878 3519 19737 16513 75 60303 40065 7062 19422 61808 76 6311 6756 3561 15910 23349 77 13345 38902 2583 11096 68663 78 2623 18264 3745 16787 16900

Pour les programmeurs en langage R, l'opération ci-dessus équivaut à imprimer les 6 premières lignes de données via print(head(df)) et à imprimer les 6 premières lignes de données via print(tail( df)) pour imprimer les 6 dernières lignes de données. Bien entendu, en Python, l’impression par défaut est de 5 lignes, alors qu’en R, elle est de 6 lignes. Par conséquent, le code R head(df, n = 10) est df.head(n = 10) en Python, et il en va de même pour l'impression de la queue des données.

En langage R, les noms des colonnes et des lignes de données sont extraits respectivement via les noms de colonnes et de lignes. En Python, nous utilisons les colonnes et les attributs d'index pour extraire, comme suit :

# Extracting column names print df.columns # OUTPUT Index([u'Abra', u'Apayao', u'Benguet', u'Ifugao', u'Kalinga'], dtype='object') # Extracting row names or the index print df.index # OUTPUT Int64Index([0, 1, 2, 3, 4, 5, 6, 7, 8, 9, 10, 11, 12, 13, 14, 15, 16, 17, 18, 19, 20, 21, 22, 23, 24, 25, 26, 27, 28, 29, 30, 31, 32, 33, 34, 35, 36, 37, 38, 39, 40, 41, 42, 43, 44, 45, 46, 47, 48, 49, 50, 51, 52, 53, 54, 55, 56, 57, 58, 59, 60, 61, 62, 63, 64, 65, 66, 67, 68, 69, 70, 71, 72, 73, 74, 75, 76, 77, 78], dtype='int64')

La transposition des données utilise la méthode T,

# Transpose data print df.T # OUTPUT 0 1 2 3 4 5 6 7 8 9 Abra 1243 4158 1787 17152 1266 5576 927 21540 1039 5424 Apayao 2934 9235 1922 14501 2385 7452 1099 17038 1382 10588 Benguet 148 4287 1955 3536 2530 771 2796 2463 2592 1064 Ifugao 3300 8063 1074 19607 3315 13134 5134 14226 6842 13828 Kalinga 10553 35257 4544 31687 8520 28252 3106 36238 4973 40140 ... 69 70 71 72 73 74 75 76 77 Abra ... 12763 2470 59094 6209 13316 2505 60303 6311 13345 Apayao ... 37625 19532 35126 6335 38613 20878 40065 6756 38902 Benguet ... 2354 4045 5987 3530 2585 3519 7062 3561 2583 Ifugao ... 9838 17125 18940 15560 7746 19737 19422 15910 11096 Kalinga ... 65782 15279 52437 24385 66148 16513 61808 23349 68663 78 Abra 2623 Apayao 18264 Benguet 3745 Ifugao 16787 Kalinga 16900

D'autres transformations, comme le tri, utilisent la méthode attribut de tri . Nous extrayons maintenant une colonne de données spécifique. En Python, vous pouvez utiliser les attributs iloc ou ix. Mais je préfère utiliser ix car il est plus stable. Supposons que nous ayons besoin des 5 premières lignes de la première colonne de données, nous avons :

print df.ix[:, 0].head() # OUTPUT 0 1243 1 4158 2 1787 3 17152 4 1266 Name: Abra, dtype: int64

Au fait, l'index de Python commence à 0 au lieu de 1. Afin d'obtenir les 3 premières colonnes de données des lignes 11 à 20, nous avons :

print df.ix[10:20, 0:3] # OUTPUT Abra Apayao Benguet 10 981 1311 2560 11 27366 15093 3039 12 1100 1701 2382 13 7212 11001 1088 14 1048 1427 2847 15 25679 15661 2942 16 1055 2191 2119 17 5437 6461 734 18 1029 1183 2302 19 23710 12222 2598 20 1091 2343 2654

La commande ci-dessus est équivalente à df.ix[10:20, ['Abra', 'Apayao' , 'Benguet'] ].

Pour déposer des colonnes dans les données, voici la colonne 1 (Apayao) et la colonne 2 (Benguet), on utilise l'attribut drop, comme suit :

print df.drop(df.columns[[1, 2]], axis = 1).head() # OUTPUT Abra Ifugao Kalinga 0 1243 3300 10553 1 4158 8063 35257 2 1787 1074 4544 3 17152 19607 31687 4 1266 3315 8520

Le paramètre axis indique le fonction exactement quelles colonnes supprimer. Si l’axe est égal à 0, alors les lignes sont supprimées.

Description statistique

L'étape suivante consiste à décrire les caractéristiques statistiques des données via l'attribut décrire :

print df.describe()

# OUTPUT

Abra Apayao Benguet Ifugao Kalinga

count 79.000000 79.000000 79.000000 79.000000 79.000000

mean 12874.379747 16860.645570 3237.392405 12414.620253 30446.417722

std 16746.466945 15448.153794 1588.536429 5034.282019 22245.707692

min 927.000000 401.000000 148.000000 1074.000000 2346.000000

25% 1524.000000 3435.500000 2328.000000 8205.000000 8601.500000

50% 5790.000000 10588.000000 3202.000000 13044.000000 24494.000000

75% 13330.500000 33289.000000 3918.500000 16099.500000 52510.500000

max 60303.000000 54625.000000 8813.000000 21031.000000 68663.000000Test d'hypothèse

Python a un très bon package d'inférence statistique. Ce sont les statistiques de scipy. ttest_1samp implémente le test t sur échantillon unique. Par conséquent, si nous voulons tester le rendement moyen en riz de la colonne Abra des données, en passant l'hypothèse nulle, nous supposons ici que le rendement moyen global en riz est de 15 000, nous avons :

from scipy import stats as ss # Perform one sample t-test using 1500 as the true mean print ss.ttest_1samp(a = df.ix[:, 'Abra'], popmean = 15000) # OUTPUT (-1.1281738488299586, 0.26270472069109496)

Renvoie le tuple composé des valeurs suivantes :

t : virgule flottante ou type tableau

t statistique

prob : virgule flottante ou type tableau

valeur p bilatérale valeur de probabilité bilatérale

grâce au résultat ci-dessus, étant donné que la valeur p de 0,267 est beaucoup plus grande que α égal à 0,05, il n'y a donc pas de preuves suffisantes pour dire que le rendement moyen du riz n'est pas de 150 000. En appliquant ce test à toutes les variables, en supposant encore une fois une moyenne de 15 000, nous avons :

print ss.ttest_1samp(a = df, popmean = 15000) # OUTPUT (array([ -1.12817385, 1.07053437, -65.81425599, -4.564575 , 6.17156198]), array([ 2.62704721e-01, 2.87680340e-01, 4.15643528e-70, 1.83764399e-05, 2.82461897e-08]))

Le premier tableau est la statistique t et le deuxième tableau est la valeur p correspondante.

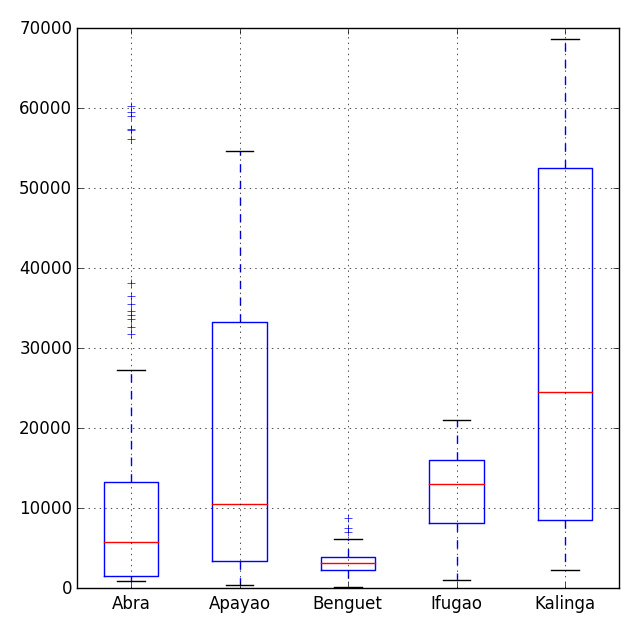

Visualisation

Il existe de nombreux modules de visualisation en Python, le plus populaire est la bibliothèque matpalotlib. En bref, nous pouvons également choisir les modules bokeh et seaborn. Dans un article de blog précédent, j'ai expliqué la fonctionnalité du module box-and-whisker plot dans la bibliothèque matplotlib.

# Import the module for plotting import matplotlib.pyplot as plt plt.show(df.plot(kind = 'box'))

Maintenant, nous pouvons utiliser le thème ggplot intégré à R dans le module pandas pour embellir le graphique. Pour utiliser ggplot, il suffit d'ajouter une ligne supplémentaire au code ci-dessus,

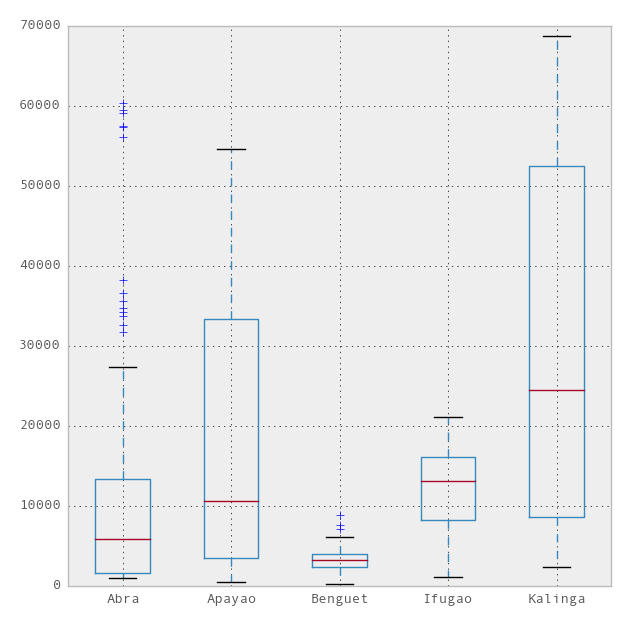

import matplotlib.pyplot as plt pd.options.display.mpl_style = 'default' # Sets the plotting display theme to ggplot2 df.plot(kind = 'box')

pour obtenir le graphique suivant :

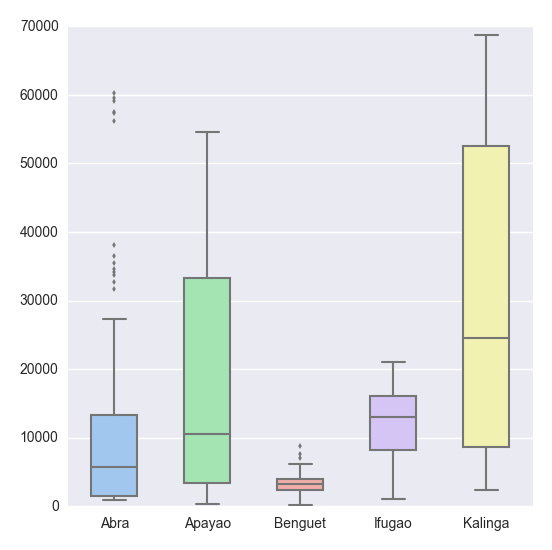

que Thème matplotlib.pyplot Trop de simplicité. Mais dans cet article de blog, je préfère présenter le module seaborn, qui est une bibliothèque de visualisation de données statistiques. Nous avons donc :

# Import the seaborn library import seaborn as sns # Do the boxplot plt.show(sns.boxplot(df, widths = 0.5, color = "pastel"))

Quel box art sexy, lisez la suite.

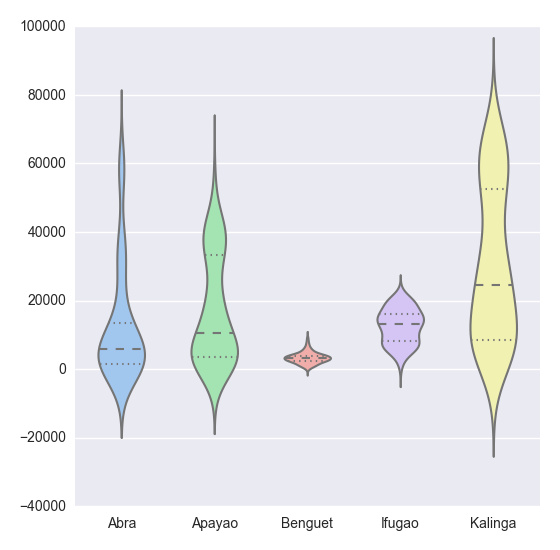

plt.show(sns.violinplot(df, widths = 0.5, color = "pastel"))

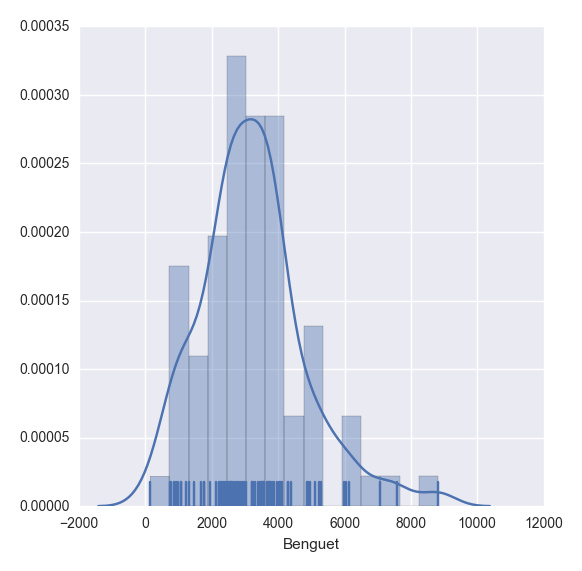

plt.show(sns.distplot(df.ix[:,2], rug = True, bins = 15))

with sns.axes_style("white"):

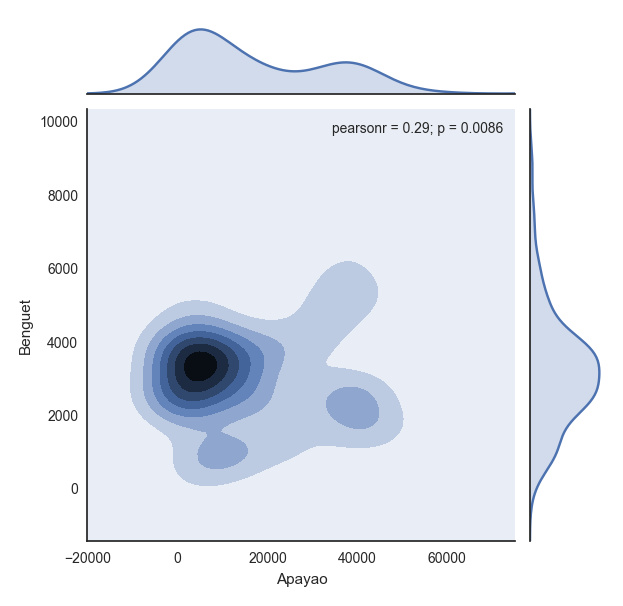

plt.show(sns.jointplot(df.ix[:,1], df.ix[:,2], kind = "kde"))

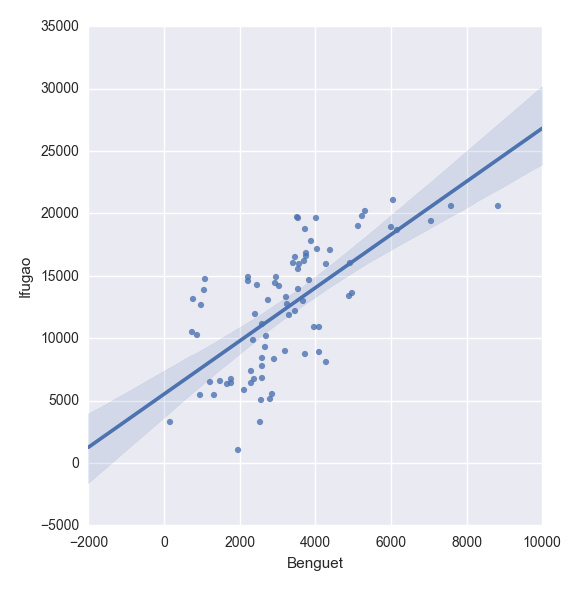

plt.show(sns.lmplot("Benguet", "Ifugao", df))创建自定义函数

在Python中,我们使用def函数来实现一个自定义函数。例如,如果我们要定义一个两数相加的函数,如下即可:

def add_2int(x, y): return x + y print add_2int(2, 2) # OUTPUT 4

顺便说一下,Python中的缩进是很重要的。通过缩进来定义函数作用域,就像在R语言中使用大括号{…}一样。这有一个我们之前博文的例子:

产生10个正态分布样本,其中u=3和o.

基于95%的置信度,计算 x_bar 和 x_bar2 ;

重复100次; 然后

计算出置信区间包含真实均值的百分比

Python中,程序如下:

import numpy as np

import scipy.stats as ss

def case(n = 10, mu = 3, sigma = np.sqrt(5), p = 0.025, rep = 100):

m = np.zeros((rep, 4))

for i in range(rep):

norm = np.random.normal(loc = mu, scale = sigma, size = n)

xbar = np.mean(norm)

low = xbar - ss.norm.ppf(q = 1 - p) * (sigma / np.sqrt(n))

up = xbar + ss.norm.ppf(q = 1 - p) * (sigma / np.sqrt(n))

if (mu > low) & (mu < up):

rem = 1

else:

rem = 0

m[i, :] = [xbar, low, up, rem]

inside = np.sum(m[:, 3])

per = inside / rep

desc = "There are " + str(inside) + " confidence intervals that contain "

"the true mean (" + str(mu) + "), that is " + str(per) + " percent of the total CIs"

return {"Matrix": m, "Decision": desc}

上述代码读起来很简单,但是循环的时候就很慢了。下面针对上述代码进行了改进,这多亏了 Python专家。

import numpy as np

import scipy.stats as ss

def case2(n = 10, mu = 3, sigma = np.sqrt(5), p = 0.025, rep = 100):

scaled_crit = ss.norm.ppf(q = 1 - p) * (sigma / np.sqrt(n))

norm = np.random.normal(loc = mu, scale = sigma, size = (rep, n))

xbar = norm.mean(1)

low = xbar - scaled_crit

up = xbar + scaled_crit

rem = (mu > low) & (mu < up)

m = np.c_[xbar, low, up, rem]

inside = np.sum(m[:, 3])

per = inside / rep

desc = "There are " + str(inside) + " confidence intervals that contain "

"the true mean (" + str(mu) + "), that is " + str(per) + " percent of the total CIs"

return {"Matrix": m, "Decision": desc}更多Un tutoriel simple sur lutilisation de Python pour lanalyse des données相关文章请关注PHP中文网!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Sujets chauds

Comment utiliser Python pour trouver la distribution ZIPF d'un fichier texte

Mar 05, 2025 am 09:58 AM

Comment utiliser Python pour trouver la distribution ZIPF d'un fichier texte

Mar 05, 2025 am 09:58 AM

Ce tutoriel montre comment utiliser Python pour traiter le concept statistique de la loi de Zipf et démontre l'efficacité de la lecture et du tri de Python de gros fichiers texte lors du traitement de la loi. Vous vous demandez peut-être ce que signifie le terme distribution ZIPF. Pour comprendre ce terme, nous devons d'abord définir la loi de Zipf. Ne vous inquiétez pas, je vais essayer de simplifier les instructions. La loi de Zipf La loi de Zipf signifie simplement: dans un grand corpus en langage naturel, les mots les plus fréquents apparaissent environ deux fois plus fréquemment que les deuxième mots fréquents, trois fois comme les troisième mots fréquents, quatre fois comme quatrième mots fréquents, etc. Regardons un exemple. Si vous regardez le corpus brun en anglais américain, vous remarquerez que le mot le plus fréquent est "th

Comment utiliser la belle soupe pour analyser HTML?

Mar 10, 2025 pm 06:54 PM

Comment utiliser la belle soupe pour analyser HTML?

Mar 10, 2025 pm 06:54 PM

Cet article explique comment utiliser la belle soupe, une bibliothèque Python, pour analyser HTML. Il détaille des méthodes courantes comme find (), find_all (), select () et get_text () pour l'extraction des données, la gestion de diverses structures et erreurs HTML et alternatives (Sel

Filtrage d'image en python

Mar 03, 2025 am 09:44 AM

Filtrage d'image en python

Mar 03, 2025 am 09:44 AM

Traiter avec des images bruyantes est un problème courant, en particulier avec des photos de téléphones portables ou de caméras basse résolution. Ce tutoriel explore les techniques de filtrage d'images dans Python à l'aide d'OpenCV pour résoudre ce problème. Filtrage d'image: un outil puissant Filtre d'image

Comment travailler avec des documents PDF à l'aide de Python

Mar 02, 2025 am 09:54 AM

Comment travailler avec des documents PDF à l'aide de Python

Mar 02, 2025 am 09:54 AM

Les fichiers PDF sont populaires pour leur compatibilité multiplateforme, avec du contenu et de la mise en page cohérents sur les systèmes d'exploitation, les appareils de lecture et les logiciels. Cependant, contrairement aux fichiers de texte brut de traitement Python, les fichiers PDF sont des fichiers binaires avec des structures plus complexes et contiennent des éléments tels que des polices, des couleurs et des images. Heureusement, il n'est pas difficile de traiter les fichiers PDF avec les modules externes de Python. Cet article utilisera le module PYPDF2 pour montrer comment ouvrir un fichier PDF, imprimer une page et extraire du texte. Pour la création et l'édition des fichiers PDF, veuillez vous référer à un autre tutoriel de moi. Préparation Le noyau réside dans l'utilisation du module externe PYPDF2. Tout d'abord, l'installez en utilisant PIP: pip is p

Comment se cacher en utilisant Redis dans les applications Django

Mar 02, 2025 am 10:10 AM

Comment se cacher en utilisant Redis dans les applications Django

Mar 02, 2025 am 10:10 AM

Ce tutoriel montre comment tirer parti de la mise en cache Redis pour augmenter les performances des applications Python, en particulier dans un cadre Django. Nous couvrirons l'installation redis, la configuration de Django et les comparaisons de performances pour mettre en évidence le bien

Comment effectuer l'apprentissage en profondeur avec TensorFlow ou Pytorch?

Mar 10, 2025 pm 06:52 PM

Comment effectuer l'apprentissage en profondeur avec TensorFlow ou Pytorch?

Mar 10, 2025 pm 06:52 PM

Cet article compare TensorFlow et Pytorch pour l'apprentissage en profondeur. Il détaille les étapes impliquées: préparation des données, construction de modèles, formation, évaluation et déploiement. Différences clés entre les cadres, en particulier en ce qui concerne le raisin informatique

Introduction à la programmation parallèle et simultanée dans Python

Mar 03, 2025 am 10:32 AM

Introduction à la programmation parallèle et simultanée dans Python

Mar 03, 2025 am 10:32 AM

Python, un favori pour la science et le traitement des données, propose un écosystème riche pour l'informatique haute performance. Cependant, la programmation parallèle dans Python présente des défis uniques. Ce tutoriel explore ces défis, en se concentrant sur l'interprète mondial

Comment implémenter votre propre structure de données dans Python

Mar 03, 2025 am 09:28 AM

Comment implémenter votre propre structure de données dans Python

Mar 03, 2025 am 09:28 AM

Ce didacticiel montre la création d'une structure de données de pipeline personnalisée dans Python 3, en tirant parti des classes et de la surcharge de l'opérateur pour une fonctionnalité améliorée. La flexibilité du pipeline réside dans sa capacité à appliquer une série de fonctions à un ensemble de données, GE