Explication détaillée et exemple de code du pool de threads Java

Contexte technique du pool de threads

Dans la programmation orientée objet, la création et la destruction d'objets prennent beaucoup de temps, car la création d'un objet nécessite l'obtention de ressources mémoire ou d'autres ressources supplémentaires. Cela est particulièrement vrai en Java, où la machine virtuelle essaiera de garder une trace de chaque objet afin qu'il puisse être récupéré après sa destruction.

Une façon d'améliorer l'efficacité des programmes de services est donc de réduire autant que possible le nombre d'objets créés et détruits, notamment la création et la destruction de certains objets très consommateurs de ressources. Comment utiliser les objets existants pour servir est une question clé qui doit être résolue. En fait, c'est la raison de l'émergence de certaines technologies de « ressources mutualisées ».

Par exemple, de nombreux composants courants couramment observés dans Android sont généralement indissociables du concept de « pool », tels que diverses bibliothèques de chargement d'images, des bibliothèques de requêtes réseau, même Meaasge dans le mécanisme de messagerie d'Android devrait utiliser Meaasge get(. ) est l'objet utilisé dans le pool de mesures, ce concept est donc très important. La technologie des pools de threads présentée dans cet article est également cohérente avec cette idée.

Avantages du pool de threads :

1. Réutilisez les threads dans le pool de threads et réduisez la surcharge de performances causée par la création et la destruction d'objets ;

2. nombre de threads simultanés, améliore l'utilisation des ressources du système et évite la concurrence et la congestion excessives des ressources

3. Capable d'effectuer une gestion simple des multi-threads, rendant l'utilisation des threads simple et efficace.

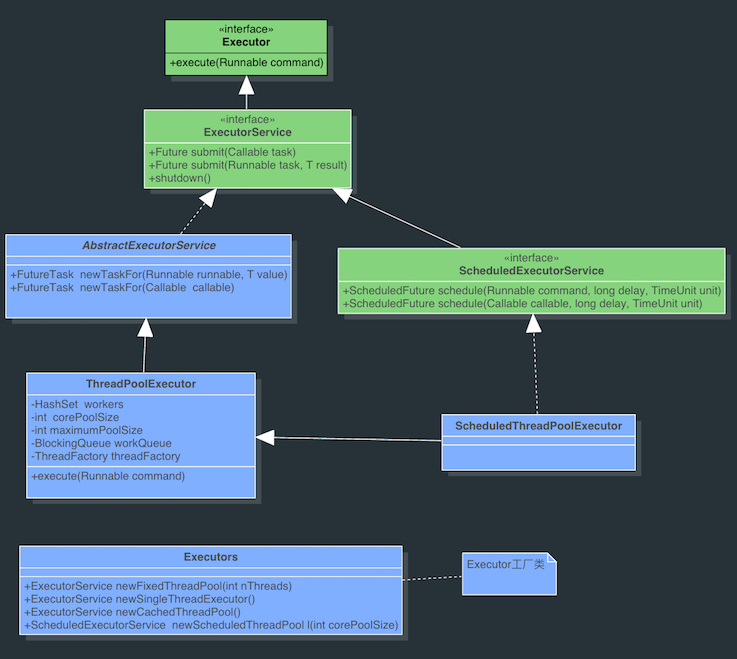

Framework de pool de threads Executor

Le pool de threads en Java est implémenté via le framework Executor. Le framework Executor comprend les classes : Executor, Executors, ExecutorService, ThreadPoolExecutor, Callable et Future, FutureTask. Utiliser etc

Exécuteur : toutes les interfaces de pool de threads n'ont qu'une seule méthode.

public interface Executor {

void execute(Runnable command);

}ExecutorService : ajoute le comportement de l'exécuteur et constitue l'interface la plus directe de la classe d'implémentation Executor.

Exécuteurs : fournit une série de méthodes d'usine pour créer des pools de threads, et les pools de threads renvoyés implémentent tous l'interface ExecutorService.

ThreadPoolExecutor : la classe d'implémentation spécifique du pool de threads. Divers pools de threads couramment utilisés sont implémentés sur la base de cette classe. La méthode de construction est la suivante :

public ThreadPoolExecutor(int corePoolSize,

int maximumPoolSize,

long keepAliveTime,

TimeUnit unit,

BlockingQueue<Runnable> workQueue) {

this(corePoolSize, maximumPoolSize, keepAliveTime, unit, workQueue,

Executors.defaultThreadFactory(), defaultHandler);

}corePoolSize : Le nombre de threads principaux dans le pool de threads. Le nombre de threads exécutés dans le pool de threads ne dépassera jamais corePoolSize par défaut. , il peut toujours survivre. Vous pouvez définir allowCoreThreadTimeOut sur True. À ce stade, le nombre de threads principaux est de 0. À ce stade, keepAliveTime contrôle le délai d'expiration de tous les threads.

maximumPoolSize : le nombre maximum de threads autorisés par le pool de threads ;

keepAliveTime : fait référence au délai d'expiration des threads inactifs

unit : est une énumération représentant ; keepAliveTime Unit;

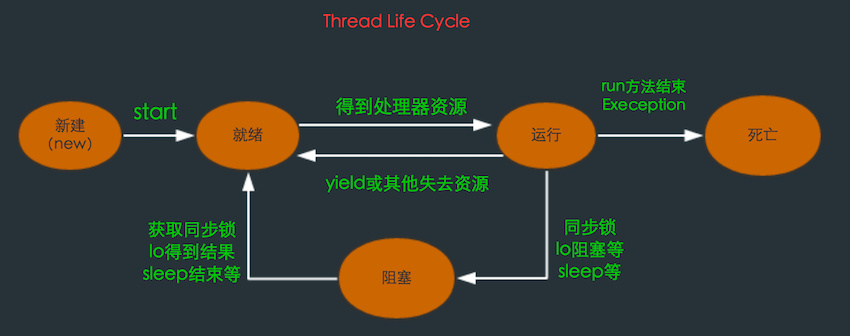

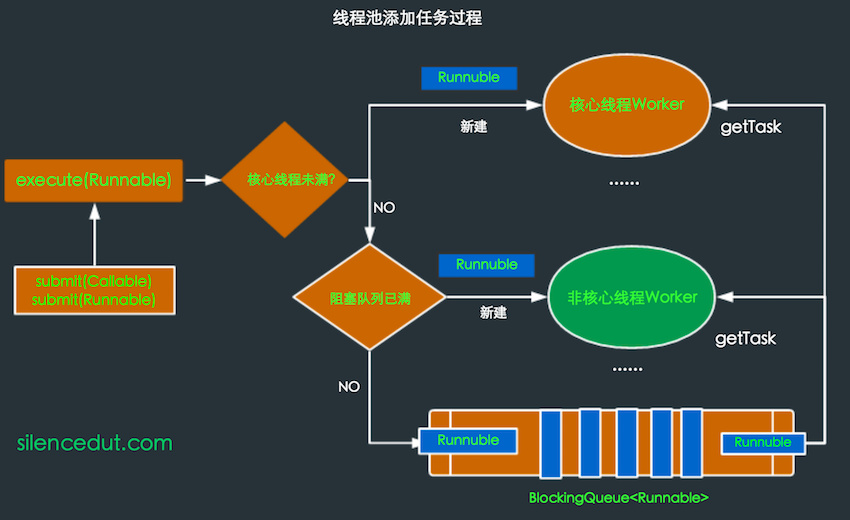

workQueue : représente la file d'attente BlockingQueue BlockingQueue : BlockingQueue est un outil sous java.util.concurrent qui est principalement utilisé pour contrôler la synchronisation des threads. Si la BlockQueue est vide, l'opération de récupération des éléments de la BlockingQueue sera bloquée et entrera dans l'état d'attente, et ne sera réveillée que lorsque quelque chose entrera dans la BlockingQueue. De même, si la BlockingQueue est pleine, toute opération qui tente d'y stocker quelque chose sera également bloquée et entrera dans un état d'attente. Elle ne sera pas réveillée pour continuer l'opération tant qu'il n'y aura pas d'espace dans la BlockingQueue. Les files d'attente de blocage sont souvent utilisées dans les scénarios de producteur et de consommateur. Le producteur est le thread qui ajoute des éléments à la file d'attente et le consommateur est le thread qui extrait les éléments de la file d'attente. La file d'attente de blocage est un conteneur dans lequel le producteur stocke les éléments et le consommateur ne récupère que les éléments du conteneur. Les classes d'implémentation spécifiques incluent LinkedBlockingQueue, ArrayBlockingQueued, etc. Généralement, le blocage et l'éveil sont implémentés en interne via le verrouillage et la condition (verrouillage de l'affichage (Lock) et apprentissage et utilisation des conditions). Le processus de fonctionnement du pool de threads est le suivant : Lorsque le pool de threads est créé pour la première fois, il ne contient aucun thread. La file d'attente des tâches est transmise en paramètre. Cependant, même s'il y a des tâches dans la file d'attente, le pool de threads ne les exécutera pas immédiatement. Lorsque la méthode execute() est appelée pour ajouter une tâche, le pool de threads fera le jugement suivant : Si le nombre de threads en cours d'exécution est inférieur à corePoolSize, alors un thread sera créé immédiatement pour exécuter la tâche Si le nombre de threads en cours d'exécution est supérieur ou égal à corePoolSize, alors mettez la tâche dans la file d'attente Si la file d'attente est pleine à ce moment-là, et le nombre de threads en cours d'exécution est inférieur à maximumPoolSize, alors vous devez toujours créer un thread non principal. Le thread exécute la tâche immédiatement Si la file d'attente est pleine et que le nombre de threads en cours d'exécution est supérieur ou égal ; à maximumPoolSize, le pool de threads lèvera une exception RejectExecutionException. Lorsqu'un thread termine une tâche, il prend une tâche de la file d'attente et l'exécute. Lorsqu'un thread n'a rien à faire et dépasse un certain temps (keepAliveTime), le pool de threads déterminera que si le nombre de threads en cours d'exécution est supérieur à corePoolSize, alors le thread sera arrêté. Ainsi, une fois toutes les tâches du pool de threads terminées, il finira par être réduit à la taille de corePoolSize. Création et utilisation de pools de threads La méthode statique de la classe d'outils Executors est utilisée pour générer des pools de threads. Voici plusieurs pools de threads courants. SingleThreadExecutor : thread d'arrière-plan unique (sa file d'attente de tampon est illimitée) 创建一个单线程的线程池。这个线程池只有一个核心线程在工作,也就是相当于单线程串行执行所有任务。如果这个唯一的线程因为异常结束,那么会有一个新的线程来替代它。此线程池保证所有任务的执行顺序按照任务的提交顺序执行。 FixedThreadPool:只有核心线程的线程池,大小固定 (其缓冲队列是无界的) 。 public static ExecutorService newFixedThreadPool(int nThreads) { CachedThreadPool:无界线程池,可以进行自动线程回收。 如果线程池的大小超过了处理任务所需要的线程,那么就会回收部分空闲(60秒不执行任务)的线程,当任务数增加时,此线程池又可以智能的添加新线程来处理任务。此线程池不会对线程池大小做限制,线程池大小完全依赖于操作系统(或者说JVM)能够创建的最大线程大小。SynchronousQueue是一个是缓冲区为1的阻塞队列。 ScheduledThreadPool:核心线程池固定,大小无限的线程池。此线程池支持定时以及周期性执行任务的需求。 创建一个周期性执行任务的线程池。如果闲置,非核心线程池会在DEFAULT_KEEPALIVEMILLIS时间内回收。 线程池最常用的提交任务的方法有两种: execute: ExecutorService.execute(Runnable runable); submit: FutureTask task = ExecutorService.submit(Runnable runnable); FutureTask submit(Callable callable)的实现,submit(Runnable runnable)同理。 可以看出submit开启的是有返回结果的任务,会返回一个FutureTask对象,这样就能通过get()方法得到结果。submit最终调用的也是execute(Runnable runable),submit只是将Callable对象或Runnable封装成一个FutureTask对象,因为FutureTask是个Runnable,所以可以在execute中执行。关于Callable对象和Runnable怎么封装成FutureTask对象,见Callable和Future、FutureTask的使用。 线程池实现的原理 如果只讲线程池的使用,那这篇博客没有什么大的价值,充其量也就是熟悉Executor相关API的过程。线程池的实现过程没有用到Synchronized关键字,用的都是Volatile,Lock和同步(阻塞)队列,Atomic相关类,FutureTask等等,因为后者的性能更优。理解的过程可以很好的学习源码中并发控制的思想。 在开篇提到过线程池的优点是可总结为以下三点: 线程复用 控制最大并发数 管理线程 1.线程复用过程 理解线程复用原理首先应了解线程生命周期。 在线程的生命周期中,它要经过新建(New)、就绪(Runnable)、运行(Running)、阻塞(Blocked)和死亡(Dead)5种状态。 Thread通过new来新建一个线程,这个过程是是初始化一些线程信息,如线程名,id,线程所属group等,可以认为只是个普通的对象。调用Thread的start()后Java虚拟机会为其创建方法调用栈和程序计数器,同时将hasBeenStarted为true,之后调用start方法就会有异常。 处于这个状态中的线程并没有开始运行,只是表示该线程可以运行了。至于该线程何时开始运行,取决于JVM里线程调度器的调度。当线程获取cpu后,run()方法会被调用。不要自己去调用Thread的run()方法。之后根据CPU的调度在就绪——运行——阻塞间切换,直到run()方法结束或其他方式停止线程,进入dead状态。 所以实现线程复用的原理应该就是要保持线程处于存活状态(就绪,运行或阻塞)。接下来来看下ThreadPoolExecutor是怎么实现线程复用的。 在ThreadPoolExecutor主要Worker类来控制线程的复用。看下Worker类简化后的代码,这样方便理解: Worker是一个Runnable,同时拥有一个thread,这个thread就是要开启的线程,在新建Worker对象时同时新建一个Thread对象,同时将Worker自己作为参数传入TThread,这样当Thread的start()方法调用时,运行的实际上是Worker的run()方法,接着到runWorker()中,有个while循环,一直从getTask()里得到Runnable对象,顺序执行。getTask()又是怎么得到Runnable对象的呢? 依旧是简化后的代码: 这个workQueue就是初始化ThreadPoolExecutor时存放任务的BlockingQueue队列,这个队列里的存放的都是将要执行的Runnable任务。因为BlockingQueue是个阻塞队列,BlockingQueue.take()得到如果是空,则进入等待状态直到BlockingQueue有新的对象被加入时唤醒阻塞的线程。所以一般情况Thread的run()方法就不会结束,而是不断执行从workQueue里的Runnable任务,这就达到了线程复用的原理了。 2.控制最大并发数 那Runnable是什么时候放入workQueue?Worker又是什么时候创建,Worker里的Thread的又是什么时候调用start()开启新线程来执行Worker的run()方法的呢?有上面的分析看出Worker里的runWorker()执行任务时是一个接一个,串行进行的,那并发是怎么体现的呢? 很容易想到是在execute(Runnable runnable)时会做上面的一些任务。看下execute里是怎么做的。 execute: 简化后的代码 addWorker: 简化后的代码 根据代码再来看上面提到的线程池工作过程中的添加任务的情况: * 如果正在运行的线程数量小于 corePoolSize,那么马上创建线程运行这个任务; 这就是Android的AsyncTask在并行执行是在超出最大任务数是抛出RejectExecutionException的原因所在,详见基于最新版本的AsyncTask源码解读及AsyncTask的黑暗面 通过addWorker如果成功创建新的线程成功,则通过start()开启新线程,同时将firstTask作为这个Worker里的run()中执行的第一个任务。 虽然每个Worker的任务是串行处理,但如果创建了多个Worker,因为共用一个workQueue,所以就会并行处理了。 所以根据corePoolSize和maximumPoolSize来控制最大并发数。大致过程可用下图表示。 上面的讲解和图来可以很好的理解的这个过程。 如果是做Android开发的,并且对Handler原理比较熟悉,你可能会觉得这个图挺熟悉,其中的一些过程和Handler,Looper,Meaasge使用中,很相似。Handler.send(Message)相当于execute(Runnuble),Looper中维护的Meaasge队列相当于BlockingQueue,只不过需要自己通过同步来维护这个队列,Looper中的loop()函数循环从Meaasge队列取Meaasge和Worker中的runWork()不断从BlockingQueue取Runnable是同样的道理。 3.管理线程 通过线程池可以很好的管理线程的复用,控制并发数,以及销毁等过程,线程的复用和控制并发上面已经讲了,而线程的管理过程已经穿插在其中了,也很好理解。 在ThreadPoolExecutor有个ctl的AtomicInteger变量。通过这一个变量保存了两个内容: 所有线程的数量 每个线程所处的状态 其中低29位存线程数,高3位存runState,通过位运算来得到不同的值。 Ici, nous analysons principalement le processus d'arrêt du pool de threads via shutdown et shutdownNow(). Premièrement, le pool de threads dispose de cinq états pour contrôler l’ajout et l’exécution des tâches. Introduisez principalement les trois types suivants : État RUNNING : le pool de threads fonctionne normalement et peut accepter de nouvelles tâches et traiter des tâches dans la file d'attente État SHUTDOWN : n'accepte plus de nouvelles tâches, mais exécutera les tâches dans la file d'attente ; état STOP : n'acceptera plus de nouvelles tâches et ne traitera pas les tâches dans la file d'attente. Cette méthode définira runState sur SHUTDOWN et mettra fin à tous les threads inactifs et ceux qui fonctionnent encore. . Cela n'est pas affecté, donc les tâches dans la file d'attente seront exécutées. La méthode shutdownNow définit runState sur STOP. La différence avec la méthode shutdown est que cette méthode mettra fin à tous les threads, donc les tâches dans la file d'attente ne seront pas exécutées. Résumé L'utilisation du contrôle de concurrence et du traitement des tâches du modèle producteur-consommateur qui en découle sera d'une grande aide pour comprendre ou résoudre d'autres problèmes connexes à l'avenir. Par exemple, le mécanisme Handler dans Android et la file d'attente Messager dans Looper peuvent également être traités par une BlookQueue. C'est ce que je gagne en lisant le code source. Ce qui précède est la collecte d'informations sur le pool de threads Java. Nous continuerons à ajouter des informations pertinentes à l'avenir. Merci pour votre soutien à ce site ! Pour plus d'explications détaillées sur le pool de threads Java et des exemples d'articles sur le code, veuillez faire attention au site Web PHP chinois ! public static ExecutorService newSingleThreadExecutor() {

return new FinalizableDelegatedExecutorService (

new ThreadPoolExecutor(1, 1,

0L, TimeUnit.MILLISECONDS,

new LinkedBlockingQueue<Runnable>()));

}

return new ThreadPoolExecutor(nThreads, nThreads,

0L, TimeUnit.MILLISECONDS,

new LinkedBlockingQueue

}

创建固定大小的线程池。每次提交一个任务就创建一个线程,直到线程达到线程池的最大大小。线程池的大小一旦达到最大值就会保持不变,如果某个线程因为执行异常而结束,那么线程池会补充一个新线程。public static ExecutorService newCachedThreadPool() {

return new ThreadPoolExecutor(0,Integer.MAX_VALUE,

60L, TimeUnit.SECONDS,

new SynchronousQueue<Runnable>());

}public static ExecutorService newScheduledThreadPool(int corePoolSize) {

return new ScheduledThreadPool(corePoolSize,

Integer.MAX_VALUE,

DEFAULT_KEEPALIVE_MILLIS, MILLISECONDS,

new DelayedWorkQueue());

}

FutureTaskpublic <T> Future<T> submit(Callable<T> task) {

if (task == null) throw new NullPointerException();

FutureTask<T> ftask = newTaskFor(task);

execute(ftask);

return ftask;

}

private final class Worker implements Runnable {

final Thread thread;

Runnable firstTask;

Worker(Runnable firstTask) {

this.firstTask = firstTask;

this.thread = getThreadFactory().newThread(this);

}

public void run() {

runWorker(this);

}

final void runWorker(Worker w) {

Runnable task = w.firstTask;

w.firstTask = null;

while (task != null || (task = getTask()) != null){

task.run();

}

}private Runnable getTask() {

if(一些特殊情况) {

return null;

}

Runnable r = workQueue.take();

return r;

}public void execute(Runnable command) {

if (command == null)

throw new NullPointerException();

int c = ctl.get();

// 当前线程数 < corePoolSize

if (workerCountOf(c) < corePoolSize) {

// 直接启动新的线程。

if (addWorker(command, true))

return;

c = ctl.get();

}

// 活动线程数 >= corePoolSize

// runState为RUNNING && 队列未满

if (isRunning(c) && workQueue.offer(command)) {

int recheck = ctl.get();

// 再次检验是否为RUNNING状态

// 非RUNNING状态 则从workQueue中移除任务并拒绝

if (!isRunning(recheck) && remove(command))

reject(command);// 采用线程池指定的策略拒绝任务

// 两种情况:

// 1.非RUNNING状态拒绝新的任务

// 2.队列满了启动新的线程失败(workCount > maximumPoolSize)

} else if (!addWorker(command, false))

reject(command);

}private boolean addWorker(Runnable firstTask, boolean core) {

int wc = workerCountOf(c);

if (wc >= (core ? corePoolSize : maximumPoolSize)) {

return false;

}

w = new Worker(firstTask);

final Thread t = w.thread;

t.start();

}

* 如果正在运行的线程数量大于或等于 corePoolSize,那么将这个任务放入队列;

* 如果这时候队列满了,而且正在运行的线程数量小于 maximumPoolSize,那么还是要创建非核心线程立刻运行这个任务;

* 如果队列满了,而且正在运行的线程数量大于或等于 maximumPoolSize,那么线程池会抛出异常RejectExecutionException。

private final AtomicInteger ctl = new AtomicInteger(ctlOf(RUNNING, 0));

//得到线程的状态

private static int runStateOf(int c) {

return c & ~CAPACITY;

}

//得到Worker的的数量

private static int workerCountOf(int c) {

return c & CAPACITY;

}

// 判断线程是否在运行

private static boolean isRunning(int c) {

return c < SHUTDOWN;

}

Grâce à l'analyse du code source de ThreadPoolExecutor, nous avons une compréhension globale de la création du pool de threads, de l'ajout de tâches, de l'exécution et d'autres processus. Si vous êtes familier avec ces processus, ce sera plus facile. pour utiliser le pool de threads.

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Comment fonctionne le mécanisme de chargement de classe de Java, y compris différents chargeurs de classe et leurs modèles de délégation?

Mar 17, 2025 pm 05:35 PM

Comment fonctionne le mécanisme de chargement de classe de Java, y compris différents chargeurs de classe et leurs modèles de délégation?

Mar 17, 2025 pm 05:35 PM

Le chargement de classe de Java implique le chargement, la liaison et l'initialisation des classes à l'aide d'un système hiérarchique avec Bootstrap, Extension et Application Classloaders. Le modèle de délégation parent garantit que les classes de base sont chargées en premier, affectant la classe de classe personnalisée LOA

Comment implémenter la mise en cache à plusieurs niveaux dans les applications Java à l'aide de bibliothèques comme la caféine ou le cache de goyave?

Mar 17, 2025 pm 05:44 PM

Comment implémenter la mise en cache à plusieurs niveaux dans les applications Java à l'aide de bibliothèques comme la caféine ou le cache de goyave?

Mar 17, 2025 pm 05:44 PM

L'article examine la mise en œuvre de la mise en cache à plusieurs niveaux en Java à l'aide de la caféine et du cache de goyave pour améliorer les performances de l'application. Il couvre les avantages de configuration, d'intégration et de performance, ainsi que la gestion de la politique de configuration et d'expulsion le meilleur PRA

Comment puis-je utiliser JPA (Java Persistance API) pour la cartographie relationnelle des objets avec des fonctionnalités avancées comme la mise en cache et le chargement paresseux?

Mar 17, 2025 pm 05:43 PM

Comment puis-je utiliser JPA (Java Persistance API) pour la cartographie relationnelle des objets avec des fonctionnalités avancées comme la mise en cache et le chargement paresseux?

Mar 17, 2025 pm 05:43 PM

L'article discute de l'utilisation de JPA pour la cartographie relationnelle des objets avec des fonctionnalités avancées comme la mise en cache et le chargement paresseux. Il couvre la configuration, la cartographie des entités et les meilleures pratiques pour optimiser les performances tout en mettant en évidence les pièges potentiels. [159 caractères]

Comment utiliser Maven ou Gradle pour la gestion avancée de projet Java, la création d'automatisation et la résolution de dépendance?

Mar 17, 2025 pm 05:46 PM

Comment utiliser Maven ou Gradle pour la gestion avancée de projet Java, la création d'automatisation et la résolution de dépendance?

Mar 17, 2025 pm 05:46 PM

L'article discute de l'utilisation de Maven et Gradle pour la gestion de projet Java, la construction de l'automatisation et la résolution de dépendance, en comparant leurs approches et leurs stratégies d'optimisation.