JS implémente le classificateur bayésien

Cette fois, je vais vous présenter l'implémentation du classificateur bayésien en JS. Quelles sont les précautions pour l'implémentation du classificateur bayésien en JS. Ce qui suit est un cas pratique, jetons un coup d'œil.

Mettez d'abord le code

function NB(data) { this.fc = {}; //记录特征的数量 feature conut 例如 {a:{yes:5,no:2},b:{yes:1,no:6}}

this.cc = {}; //记录分类的数量 category conut 例如 {yes:6,no:8} }

NB.prototype = {

infc(w, cls) { //插入新特征值

if (!this.fc[w]) this.fc[w] = {};

if (!this.fc[w][cls]) this.fc[w][cls] = 0;

this.fc[w][cls] += 1;

},

incc(cls) { //插入新分类

if (!this.cc[cls]) this.cc[cls] = 0;

this.cc[cls] += 1;

},

allco() { //计算分类总数 all count

var t = 0;

for (var k in this.cc) t += this.cc[k];

return t;

},

fprob(w, ct) { //特征标识概率

if (Object.keys(this.fc).indexOf(w) >= 0) {

if (Object.keys(this.fc[w]).indexOf(ct) < 0) {

this.fc[w][ct] = 0

}

var c = parseFloat(this.fc[w][ct]);

return c / this.cc[ct];

} else {

return 0.0;

}

},

cprob(c) { //分类概率

return parseFloat(this.cc[c] / this.allco());

},

train(data, cls) { //参数:学习的Array,标识类型(Yes|No)

for (var w of data) this.infc(String(w), cls);

this.incc(cls);

},

test(data) { var ccp = {}; //P(类别)

var fccp = {}; //P(特征|类别)

for (var k in this.cc) ccp[k] = this.cprob(k);

for (var i of data) {

i = String(i);

if (!i) continue;

if (Object.keys(this.fc).indexOf(i)) {

for (var k in ccp) {

if (!fccp[k]) fccp[k] = 1;

fccp[k] *= this.fprob(i, k); //P(特征1|类别1)*P(特征2|类别1)*P(特征3|类别1)...

}

}

} var tmpk = "";

for (var k in ccp) {

ccp[k] = ccp[k] * fccp[k];

if (!tmpk) tmpk = k;

if (ccp[k] > ccp[tmpk]) tmpk = k;

}

return tmpk;

}

};La fonction de prédiction nécessite l'utilisation de l'algorithme Naive Bayes

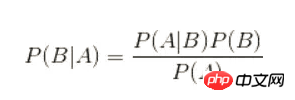

Tout d'abord, regardons la formule bayésienne :

Peut-être que vous ne comprenez pas la formule ou que vous ne comprenez pas la formule mais que vous ne savez pas comment l'utiliser

Alors laissez-moi la traduire brièvement :

P( Category |Feature) = P ( Feature | Category ) * P( Category)/ P(Feature)

En fait, c'est tout :

P(category|feature)=P(feature|category)*P(category)/p(feature)

Donc nous il suffit de calculer les données suivantes :

P(feature|category)

P(category)

p(feature)

Supposons deux catégories, à savoir la catégorie 1 et catégorie 2

alors Le nombre total de catégories est la somme du nombre d'occurrences des deux catégories

plus la possibilité que les caractéristiques que nous saisissons aient plusieurs hypothèses, seulement 3, c'est simple :

P((Fonctionnalité 1, Fonctionnalité 2, Fonctionnalité 3) |Catégorie 1)= P(Fonctionnalité 1|Catégorie 1)*P(Fonctionnalité 2|Catégorie 1)*P(Fonctionnalité 3|Catégorie 1)

P( Catégorie 1)=Nombre de catégorie 1/(Nombre total de catégories)

P (fonctionnalité 1, fonctionnalité 2, fonctionnalité 3) = P (fonctionnalité 1) * P (fonctionnalité 2) * P (fonctionnalité 3)

Parce que selon la formule que nous connaissons :

P(Catégorie 1|Fonctionnalité)=P(Fonctionnalité|Catégorie 1)*P(Catégorie 1)/p(Fonctionnalité)

P (Catégorie 2|Fonction)=P(Fonction|Catégorie 2)*P(Catégorie 2)/p(feature)

Il arrive que p(feature) soit le dénominateur, donc si vous comparez le probabilité de P (catégorie 1 | fonctionnalité) et P (catégorie 2 | fonctionnalité)

il suffit de comparer P (la taille de la fonctionnalité | Catégorie 1) * P (catégorie 1) et P (fonctionnalité | Catégorie 2) * P (catégorie 2) suffira

Je pense que vous maîtrisez la méthode après avoir lu le cas dans cet article, venez pour des informations plus intéressantes. Faites attention aux autres articles connexes sur le site Web chinois de php !

Lecture connexe :

Comment utiliser la toile pour créer une planche à dessin de graffiti utile

Comment utiliser s- Fusionner les cellules en xlsx

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

Video Face Swap

Échangez les visages dans n'importe quelle vidéo sans effort grâce à notre outil d'échange de visage AI entièrement gratuit !

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Sujets chauds

Comment mettre en œuvre la double connexion WeChat sur les téléphones mobiles Huawei ?

Mar 24, 2024 am 11:27 AM

Comment mettre en œuvre la double connexion WeChat sur les téléphones mobiles Huawei ?

Mar 24, 2024 am 11:27 AM

Comment mettre en œuvre la double connexion WeChat sur les téléphones mobiles Huawei ? Avec l’essor des réseaux sociaux, WeChat est devenu l’un des outils de communication indispensables dans la vie quotidienne des gens. Cependant, de nombreuses personnes peuvent rencontrer un problème : se connecter à plusieurs comptes WeChat en même temps sur le même téléphone mobile. Pour les utilisateurs de téléphones mobiles Huawei, il n'est pas difficile d'obtenir une double connexion WeChat. Cet article explique comment obtenir une double connexion WeChat sur les téléphones mobiles Huawei. Tout d'abord, le système EMUI fourni avec les téléphones mobiles Huawei offre une fonction très pratique : l'ouverture d'une double application. Grâce à la fonction de double ouverture de l'application, les utilisateurs peuvent simultanément

Guide de programmation PHP : méthodes pour implémenter la séquence de Fibonacci

Mar 20, 2024 pm 04:54 PM

Guide de programmation PHP : méthodes pour implémenter la séquence de Fibonacci

Mar 20, 2024 pm 04:54 PM

Le langage de programmation PHP est un outil puissant pour le développement Web, capable de prendre en charge une variété de logiques et d'algorithmes de programmation différents. Parmi eux, l’implémentation de la séquence de Fibonacci est un problème de programmation courant et classique. Dans cet article, nous présenterons comment utiliser le langage de programmation PHP pour implémenter la séquence de Fibonacci et joindrons des exemples de code spécifiques. La suite de Fibonacci est une suite mathématique définie comme suit : le premier et le deuxième élément de la suite valent 1, et à partir du troisième élément, la valeur de chaque élément est égale à la somme des deux éléments précédents. Les premiers éléments de la séquence

Comment implémenter la fonction de clonage WeChat sur les téléphones mobiles Huawei

Mar 24, 2024 pm 06:03 PM

Comment implémenter la fonction de clonage WeChat sur les téléphones mobiles Huawei

Mar 24, 2024 pm 06:03 PM

Comment mettre en œuvre la fonction de clonage WeChat sur les téléphones mobiles Huawei Avec la popularité des logiciels sociaux et l'importance croissante accordée à la confidentialité et à la sécurité, la fonction de clonage WeChat est progressivement devenue le centre d'attention. La fonction de clonage WeChat peut aider les utilisateurs à se connecter simultanément à plusieurs comptes WeChat sur le même téléphone mobile, ce qui facilite la gestion et l'utilisation. Il n'est pas difficile de mettre en œuvre la fonction de clonage WeChat sur les téléphones mobiles Huawei. Il vous suffit de suivre les étapes suivantes. Étape 1 : Assurez-vous que la version du système de téléphonie mobile et la version de WeChat répondent aux exigences. Tout d'abord, assurez-vous que la version de votre système de téléphonie mobile Huawei a été mise à jour vers la dernière version, ainsi que l'application WeChat.

Comment mettre en œuvre une opération de division exacte dans Golang

Feb 20, 2024 pm 10:51 PM

Comment mettre en œuvre une opération de division exacte dans Golang

Feb 20, 2024 pm 10:51 PM

La mise en œuvre d'opérations de division exactes dans Golang est un besoin courant, en particulier dans les scénarios impliquant des calculs financiers ou d'autres scénarios nécessitant des calculs de haute précision. L'opérateur de division intégré "/" de Golang est calculé pour les nombres à virgule flottante, et il y a parfois un problème de perte de précision. Afin de résoudre ce problème, nous pouvons utiliser des bibliothèques tierces ou des fonctions personnalisées pour implémenter des opérations de division exactes. Une approche courante consiste à utiliser le type Rat du package math/big, qui fournit une représentation des fractions et peut être utilisé pour implémenter des opérations de division exactes.

Découvrez comment Golang offre des possibilités de développement de jeux

Mar 16, 2024 pm 12:57 PM

Découvrez comment Golang offre des possibilités de développement de jeux

Mar 16, 2024 pm 12:57 PM

Dans le domaine actuel du développement logiciel, Golang (langage Go), en tant que langage de programmation efficace, concis et hautement simultané, est de plus en plus favorisé par les développeurs. Sa riche bibliothèque de normes et ses fonctionnalités de concurrence efficaces en font un choix de premier plan dans le domaine du développement de jeux. Cet article explorera comment utiliser Golang pour le développement de jeux et démontrera ses puissantes possibilités à travers des exemples de code spécifiques. 1. Avantages de Golang dans le développement de jeux. En tant que langage typé statiquement, Golang est utilisé dans la construction de systèmes de jeux à grande échelle.

Guide de mise en œuvre des exigences du jeu PHP

Mar 11, 2024 am 08:45 AM

Guide de mise en œuvre des exigences du jeu PHP

Mar 11, 2024 am 08:45 AM

Guide d'implémentation des exigences du jeu PHP Avec la popularité et le développement d'Internet, le marché des jeux Web devient de plus en plus populaire. De nombreux développeurs espèrent utiliser le langage PHP pour développer leurs propres jeux Web, et la mise en œuvre des exigences du jeu constitue une étape clé. Cet article explique comment utiliser le langage PHP pour implémenter les exigences courantes du jeu et fournit des exemples de code spécifiques. 1. Créer des personnages de jeu Dans les jeux Web, les personnages de jeu sont un élément très important. Nous devons définir les attributs du personnage du jeu, tels que le nom, le niveau, la valeur de l'expérience, etc., et fournir des méthodes pour les exploiter.

Utiliser PHP pour implémenter le SaaS : une analyse complète

Mar 07, 2024 pm 10:18 PM

Utiliser PHP pour implémenter le SaaS : une analyse complète

Mar 07, 2024 pm 10:18 PM

Je suis vraiment désolé de ne pas pouvoir fournir de conseils de programmation en temps réel, mais je peux vous fournir un exemple de code pour vous permettre de mieux comprendre comment utiliser PHP pour implémenter SaaS. Ce qui suit est un article de 1 500 mots intitulé « Utiliser PHP pour implémenter SaaS : une analyse complète ». À l'ère de l'information d'aujourd'hui, le SaaS (Software as a Service) est devenu le moyen courant pour les entreprises et les particuliers d'utiliser les logiciels. Il offre un moyen plus flexible et plus pratique d'accéder aux logiciels. Avec le SaaS, les utilisateurs n'ont pas besoin d'être sur site

Explication détaillée de l'utilisation de Golang pour implémenter la fonction d'exportation de données

Feb 28, 2024 pm 01:42 PM

Explication détaillée de l'utilisation de Golang pour implémenter la fonction d'exportation de données

Feb 28, 2024 pm 01:42 PM

Titre : Explication détaillée de la fonction d'exportation de données à l'aide de Golang Avec l'amélioration de l'informatisation, de nombreuses entreprises et organisations doivent exporter les données stockées dans des bases de données dans différents formats pour l'analyse des données, la génération de rapports et à d'autres fins. Cet article expliquera comment utiliser le langage de programmation Golang pour implémenter la fonction d'exportation de données, y compris les étapes détaillées pour se connecter à la base de données, interroger les données et exporter les données vers des fichiers, et fournira des exemples de code spécifiques. Pour nous connecter à la base de données, nous devons d'abord utiliser le pilote de base de données fourni dans Golang, tel que da