Résumé des points de connaissances Java : thread virtuel JDK19

Cet article vous apporte des connaissances pertinentes sur java, qui présente principalement le contenu pertinent sur les threads virtuels dans jdk19. Les threads virtuels ont une implémentation similaire aux goroutines du langage go et au processus du langage Erlang. du fil de discussion en mode utilisateur. Jetons-y un coup d'œil. J'espère que cela sera utile à tout le monde.

Apprentissage recommandé : "Tutoriel vidéo Java"

Introduction

Les threads virtuels ont une implémentation similaire aux goroutines du langage Go et aux processus du langage Erlang. mode (mode utilisateur) une forme de fil.

Dans le passé, Java utilisait souvent des pools de threads pour partager des threads de plate-forme afin d'améliorer l'utilisation du matériel informatique, mais dans ce style asynchrone, chaque étape de la requête peut être exécutée sur un thread différent, et chaque thread commence par les étapes d'exécution appartenant à différentes requêtes de manière entrelacée est incompatible avec la conception de la plate-forme Java, ce qui entraîne :

La trace de la pile ne fournit pas de contexte utilisable

Le débogueur ne peut pas parcourir en une seule étape la logique de traitement des requêtes

-

Analyzer Le coût d'une opération ne peut être associé à son appelant.

Et les threads virtuels restent compatibles avec la conception de la plateforme tout en utilisant de manière optimale le matériel sans affecter l'évolutivité. Les threads virtuels sont des implémentations légères de threads fournis par le JDK plutôt que par le système d'exploitation :

Les threads virtuels sont des threads qui ne sont pas liés à un thread spécifique du système d'exploitation.

Les threads de plate-forme sont des threads implémentés de manière traditionnelle, comme un simple wrapper autour des threads du système d'exploitation.

Résumé

Présentation des threads virtuels sur la plateforme Java. Les threads virtuels sont des threads légers qui réduisent considérablement les efforts d’écriture, de maintenance et d’observation des applications simultanées à haut débit.

Objectif

permet aux applications serveur écrites de manière simple, un thread par requête, d'évoluer avec une utilisation matérielle presque optimale.

Permet au code existant utilisant java.lang.ThreadAPI d'adopter des threads virtuels avec seulement des modifications minimes.

Utilisez les outils JDK existants pour dépanner, déboguer et analyser facilement les threads virtuels.

Non-objectif

Ce n'est pas un objectif de supprimer l'implémentation traditionnelle des threads ou de migrer les applications existantes pour utiliser des threads virtuels.

Modifiez le modèle de concurrence de base de Java.

Notre objectif n'est pas de fournir de nouvelles structures parallèles de données dans le langage Java ou les bibliothèques Java. StreamAPI reste la méthode privilégiée pour traiter en parallèle de grands ensembles de données.

Motivation

Depuis près de 30 ans, les développeurs Java s'appuient sur les threads comme éléments de base des applications serveur simultanées. Chaque instruction de chaque méthode est exécutée dans un thread et, comme Java est multithread, plusieurs threads d'exécution se produisent simultanément.

Un thread est l'unité de concurrence de Java : un morceau de code séquentiel qui s'exécute simultanément avec d'autres unités similaires et est largement indépendant de ces unités.

Chaque thread fournit une pile pour stocker les variables locales et coordonner les appels de méthode, ainsi que le contexte lorsqu'une erreur se produit : les exceptions sont levées et interceptées par les méthodes du même thread, afin que les développeurs puissent utiliser la trace de pile du thread pour savoir quoi s'est passé quoi.

Les threads sont également un concept central de l'outil : le débogueur parcourt les instructions dans les méthodes threadées et le profileur visualise le comportement de plusieurs threads pour aider à comprendre leurs performances.

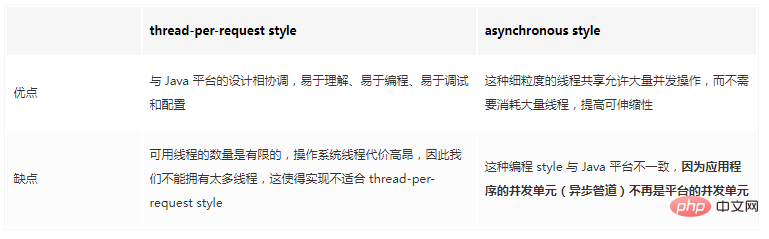

Deux styles de concurrence

style thread-per-request

Les applications serveur gèrent généralement les requêtes des utilisateurs simultanés indépendamment les unes des autres, de sorte que l'application gère la requête en allouant un thread à la requête pendant toute la durée de la la demande est significative. Ce style de thread sur demande est facile à comprendre, facile à programmer, facile à déboguer et facile à configurer car il utilise les unités de concurrence de la plateforme pour représenter les unités de concurrence de l'application.

L'évolutivité d'une application serveur est régie par la loi de Little, qui concerne la latence, la concurrence et le débit : Pour une durée de traitement des requêtes (latence) donnée, l'application simultanément Le nombre de requêtes traitées (concurrence) doit croître proportionnellement à le taux d'arrivée (débit).

Par exemple, supposons qu'une application avec une latence moyenne de 50 ms atteigne un débit de 200 requêtes par seconde en traitant 10 requêtes simultanément. Pour que l’application atteigne un débit de 2 000 requêtes par seconde, elle devrait traiter 100 requêtes simultanément. Si chaque requête est traitée dans un thread pendant toute la durée de la requête, le nombre de threads doit augmenter à mesure que le débit augmente pour que l'application puisse suivre le rythme.

Malheureusement, le nombre de threads disponibles est limité car le JDK implémente les threads en tant que wrappers pour les threads du système d'exploitation (OS). Les threads du système d'exploitation sont chers, nous ne pouvons donc pas avoir trop de threads, ce qui rend l'implémentation inadaptée au style un thread par requête.

Si chaque requête consomme un thread pendant sa durée, et donc un thread du système d'exploitation, le nombre de threads deviendra généralement le facteur limitant bien avant que les autres ressources (telles que le processeur ou les connexions réseau) ne soient épuisées. L'implémentation actuelle des threads du JDK limite le débit des applications à des niveaux bien inférieurs à ce que le matériel peut prendre en charge. Cela se produit même dans les pools de threads, car les pools permettent d'éviter le coût élevé du démarrage de nouveaux threads mais n'augmentent pas le nombre total de threads.

style asynchrone

Certains développeurs souhaitant profiter pleinement de leur matériel ont abandonné le style thread par requête au profit d'un style de partage de threads.

Au lieu de traiter la requête sur un thread du début à la fin, le code de gestion des requêtes renvoie son thread dans un pool en attendant la fin de l'opération d'E/S afin que le thread puisse gérer d'autres requêtes. Ce partage de threads à granularité fine (où le code réserve uniquement un thread lors de l'exécution de calculs plutôt que pendant l'attente d'E/S) permet un grand nombre d'opérations simultanées sans consommer un grand nombre de threads.

Bien que cela supprime la limite de débit imposée par la rareté des threads du système d'exploitation, cela a un coût élevé : cela nécessite un style de programmation dit asynchrone, utilisant un ensemble de méthodes d'E/S indépendantes qui n'attendent pas les E/S. O L'opération se termine, mais envoie à la place son signal d'achèvement au rappel ultérieurement. Sans threads dédiés, les développeurs doivent décomposer la logique de traitement des requêtes en petites étapes, généralement écrites sous la forme d'expressions lambda, puis les combiner dans un pipeline séquentiel avec une API (voir, par exemple, CompletableFuture, ou ce qu'on appelle " React" "sexualité"). Par conséquent, ils abandonnent les opérateurs de composition séquentielle de base du langage, tels que les boucles et les blocs try/catch.

Dans un style asynchrone, chaque phase d'une requête peut être exécutée sur un thread différent, chaque thread exécutant des phases appartenant à différentes requêtes de manière entrelacée. Cela a de profondes implications pour la compréhension du comportement du programme :

La trace de pile ne fournit aucun contexte utilisable

Le débogueur ne peut pas entrer dans la logique de gestion des requêtes

Le profileur ne peut pas corréler le coût de l'opération à son appelant.

La combinaison d'expressions lambda est gérable lors du traitement de données dans des pipelines courts à l'aide de l'API de streaming de Java, mais cela devient problématique lorsque tout le code de traitement des requêtes dans l'application doit être écrit de cette façon. Ce style de programmation n'est pas cohérent avec la plateforme Java car l'unité de concurrence de l'application (le canal asynchrone) n'est plus l'unité de concurrence de la plateforme. "Comparaison" efficacement Les threads sont implémentés pour essayer de conserver le style un thread par requête afin qu'ils puissent être plus riches.

Le système d'exploitation ne peut pas implémenter les threads du système d'exploitation plus efficacement, car différents langages et environnements d'exécution utilisent les piles de threads de différentes manières. Cependant, la manière dont le runtime Java implémente les threads Java peut réduire la correspondance biunivoque entre eux et les threads du système d'exploitation. Tout comme le système d'exploitation donne l'illusion d'une mémoire suffisante en mappant une grande quantité d'espace d'adressage virtuel sur une quantité limitée de RAM physique, le moteur d'exécution Java peut également donner l'illusion d'une mémoire suffisante en mappant un grand nombre d'espaces d'adressage virtuels sur un espace d'adressage virtuel. petit nombre de threads du système d'exploitation l'illusion. Un thread virtuel est un thread qui n'est pas lié à un thread spécifique du système d'exploitation.

Les threads de plate-forme sont des threads implémentés de manière traditionnelle, comme un simple wrapper autour des threads du système d'exploitation.

Les threads de plate-forme sont des threads implémentés de manière traditionnelle, comme un simple wrapper autour des threads du système d'exploitation.

Le code d'application de style thread par requête peut s'exécuter dans un thread virtuel pour l'intégralité de la requête, mais un thread virtuel utilise uniquement les threads du système d'exploitation lors de l'exécution de calculs sur le processeur. Le résultat est la même évolutivité que le style asynchrone, sauf qu'il est implémenté de manière transparente : Lorsque le code exécuté dans un thread virtuel appelle une opération d'E/S bloquante dans l'API Java.*, le runtime exécute un système d'exploitation non bloquant. appelle et suspend automatiquement le thread virtuel jusqu'à ce qu'il puisse être repris ultérieurement.

Pour les développeurs Java, les threads virtuels sont des threads peu coûteux à créer et dont le nombre est presque infini. L'utilisation du matériel est presque optimale, permettant des niveaux élevés de concurrence, augmentant ainsi le débit, tandis que les applications restent en phase avec la conception multithread de la plate-forme Java et de ses outils.

Signification des threads virtuels

Les threads virtuels sont bon marché et abondants et ne doivent donc jamais être partagés (c'est-à-dire en utilisant un pool de threads) : un nouveau thread virtuel doit être créé pour chaque tâche d'application.

En conséquence, la plupart des threads virtuels sont de courte durée et ont des piles d'appels peu profondes, exécutant aussi peu qu'un seul appel client HTTP ou une seule requête JDBC. En revanche, les threads de plateforme sont lourds et coûteux et doivent donc souvent être partagés. Ils ont tendance à durer longtemps, ont des piles d’appels importantes et sont partagés entre de nombreuses tâches.

En bref, les threads virtuels conservent un style de thread par requête fiable, cohérent avec la conception de la plate-forme Java tout en utilisant de manière optimale le matériel. L'utilisation de threads virtuels ne nécessite pas l'apprentissage de nouveaux concepts, même si elle peut nécessiter de désapprendre des habitudes développées en réponse au coût élevé des threads d'aujourd'hui. Non seulement les threads virtuels aident les développeurs d'applications, mais ils aident également les concepteurs de frameworks à fournir des API faciles à utiliser et compatibles avec la conception de la plateforme sans compromettre l'évolutivité.

Description

Aujourd'hui, chaque instance de java.lang. Un thread dans le JDK est un thread de plateforme. Les threads de plate-forme exécutent du code Java sur les threads du système d'exploitation sous-jacents et capturent les threads du système d'exploitation tout au long de la durée de vie du code. Le nombre de threads de la plateforme est limité au nombre de threads du système d'exploitation.

Le fil virtuel est une instance de java.lang. Thread qui exécute du code Java sur le thread du système d'exploitation sous-jacent, mais ne capture pas ce thread du système d'exploitation pendant toute la durée de vie du code. Cela signifie que de nombreux threads virtuels peuvent exécuter leur code Java sur le même thread du système d'exploitation, les partageant ainsi efficacement. Le thread de la plate-forme monopolise un précieux thread du système d’exploitation, mais pas le thread virtuel. Le nombre de threads virtuels peut être bien supérieur au nombre de threads du système d’exploitation.

Les threads virtuels sont des implémentations légères de threads fournies par le JDK plutôt que par le système d'exploitation. Il s'agit d'une forme de threads en mode utilisateur qui ont fait leurs preuves dans d'autres langages multithreads (par exemple, les goroutines en Go et les processus en Erlang). Les threads en mode utilisateur comportaient même ce que l'on appelle les « threads verts » dans les premières versions de Java, avant que les threads du système d'exploitation ne soient matures et populaires. Cependant, les threads verts de Java partagent tous un thread de système d'exploitation (planification M: 1) et sont finalement dépassés par les threads de plate-forme et implémentés en tant que wrappers pour les threads de système d'exploitation (planification 1: 1). Les threads virtuels utilisent la planification M:N, où un grand nombre (M) de threads virtuels sont programmés pour s'exécuter sur moins (N) de threads du système d'exploitation.

Threads virtuels VS threads de plateforme

Exemple simple

Les développeurs peuvent choisir d'utiliser des threads virtuels ou des threads de plateforme. Vous trouverez ci-dessous un exemple de programme qui crée un grand nombre de threads virtuels. Le programme obtient d'abord un ExecutorService, qui crée un nouveau thread virtuel pour chaque tâche soumise. Il soumet ensuite 10 000 tâches et attend qu'elles soient toutes terminées :

try (var executor = Executors.newVirtualThreadPerTaskExecutor()) {

IntStream.range(0, 10000).forEach(i -> {

executor.submit(() -> {

Thread.sleep(Duration.ofSeconds(1));

return i;

});

});

} // executor.close() is called implicitly, and waitsLes tâches de cet exemple sont du code simple (en veille pendant une seconde) que le matériel moderne peut facilement prendre en charge 10 000 threads virtuels exécutés simultanément. En coulisses, le JDK exécute du code sur une poignée de threads du système d'exploitation, peut-être seulement un.

Si ce programme utilise ExecutorService pour créer un nouveau thread de plateforme pour chaque tâche, comme Executors.newCachedThreadPool (), alors la situation sera très différente. ExecutorService tentera de créer 10 000 threads de plate-forme, créant ainsi 10 000 threads de système d'exploitation, et le programme peut planter, en fonction de l'ordinateur et du système d'exploitation.

Au contraire, si le programme utilise un ExecutorService qui obtient le thread de la plateforme du pool (comme Executors.newFixedThreadPool (200)), la situation ne sera pas bien meilleure. ExecutorService créera 200 threads de plate-forme, partagés par les 10 000 tâches, de sorte que de nombreuses tâches s'exécuteront séquentiellement plutôt que simultanément, et le programme prendra beaucoup de temps à se terminer. Pour ce programme, un pool de 200 threads de plateforme n'a atteint qu'un débit de 200 tâches par seconde, tandis que les threads virtuels ont atteint un débit de 10 000 tâches par seconde (après un échauffement suffisant). De plus, si le chiffre 10 000 dans l'exemple de programme était remplacé par 1 000 000, le programme soumettrait 1 000 000 de tâches, créerait 1 000 000 de threads virtuels s'exécutant simultanément et (après un échauffement suffisant) atteindrait un débit d'environ 1 000 000 de tâches/seconde.

Si les tâches de ce programme effectuent un calcul d'une seconde (par exemple, trier un énorme tableau) au lieu de simplement dormir, alors augmenter le nombre de threads au-delà du nombre de cœurs de processeur n'aidera pas, qu'il s'agisse de threads virtuels ou de threads de plate-forme. .

虚拟线程并不是更快的线程ーー它们运行代码的速度并不比平台线程快。它们的存在是为了提供规模(更高的吞吐量) ,而不是速度(更低的延迟) 。它们的数量可能比平台线程多得多,因此根据 Little’s Law,它们能够实现更高吞吐量所需的更高并发性。

换句话说,虚拟线程可以显著提高应用程序的吞吐量,在如下情况时:

并发任务的数量很多(超过几千个)

工作负载不受 CPU 限制,因为在这种情况下,比处理器核心拥有更多的线程并不能提高吞吐量

虚拟线程有助于提高典型服务器应用程序的吞吐量,因为这类应用程序由大量并发任务组成,这些任务花费了大量时间等待。

虚拟线程可以运行平台线程可以运行的任何代码。特别是,虚拟线程支持线程本地变量和线程中断,就像平台线程一样。这意味着处理请求的现有 Java 代码很容易在虚拟线程中运行。许多服务器框架将选择自动执行此操作,为每个传入请求启动一个新的虚拟线程,并在其中运行应用程序的业务逻辑。

下面是一个服务器应用程序示例,它聚合了另外两个服务的结果。假设的服务器框架(未显示)为每个请求创建一个新的虚拟线程,并在该虚拟线程中运行应用程序的句柄代码。然后,应用程序代码创建两个新的虚拟线程,通过与第一个示例相同的 ExecutorService 并发地获取资源:

void handle(Request request, Response response) {

var url1 = ...

var url2 = ...

try (var executor = Executors.newVirtualThreadPerTaskExecutor()) {

var future1 = executor.submit(() -> fetchURL(url1));

var future2 = executor.submit(() -> fetchURL(url2));

response.send(future1.get() + future2.get());

} catch (ExecutionException | InterruptedException e) {

response.fail(e);

}

}

String fetchURL(URL url) throws IOException {

try (var in = url.openStream()) {

return new String(in.readAllBytes(), StandardCharsets.UTF_8);

}

}这样的服务器应用程序使用简单的阻塞代码,可以很好地扩展,因为它可以使用大量虚拟线程。

NewVirtualThreadPerTaskExector ()并不是创建虚拟线程的唯一方法。新的 java.lang.Thread.Builder。可以创建和启动虚拟线程。此外,结构化并发提供了一个更强大的 API 来创建和管理虚拟线程,特别是在类似于这个服务器示例的代码中,通过这个 API,平台及其工具可以了解线程之间的关系。

虚拟线程是一个预览 API,默认情况下是禁用的

上面的程序使用 Executors.newVirtualThreadPerTaskExector ()方法,因此要在 JDK 19上运行它们,必须启用以下预览 API:

使用javac --release 19 --enable-preview Main.java编译该程序,并使用 java --enable-preview Main 运行该程序;或者:

在使用源代码启动程序时,使用 java --source 19 --enable-preview Main.java 运行程序; 或者:

在使用 jshell 时,使用 jshell --enable-preview 启动它。

不要共享(pool)虚拟线程

开发人员通常会将应用程序代码从传统的基于线程池的 ExecutorService 迁移到每个任务一个虚拟线程的 ExecutorService。与所有资源池一样,线程池旨在共享昂贵的资源,但虚拟线程并不昂贵,而且从不需要共享它们。

开发人员有时使用线程池来限制对有限资源的并发访问。例如,如果一个服务不能处理超过20个并发请求,那么通过提交给大小为 20 的池的任务将确保执行对该服务的所有访问。因为平台线程的高成本使得线程池无处不在,所以这个习惯用法也变得无处不在,但是开发人员不应该为了限制并发性而将虚拟线程集中起来。应该使用专门为此目的设计的构造(如信号量semaphores)来保护对有限资源的访问。这比线程池更有效、更方便,也更安全,因为不存在线程本地数据从一个任务意外泄漏到另一个任务的风险。

观测

编写清晰的代码并不是故事的全部。对于故障排除、维护和优化来说,清晰地表示正在运行的程序的状态也是必不可少的,JDK 长期以来一直提供调试、概要分析和监视线程的机制。这样的工具对虚拟线程也应该这样做ーー也许要适应它们的大量数据ーー因为它们毕竟是 java.lang.Thread 的实例。

Java 调试器可以单步执行虚拟线程、显示调用堆栈和检查堆栈帧中的变量。JDK Flight Recorder (JFR) 是 JDK 的低开销分析和监视机制,可以将来自应用程序代码的事件(比如对象分配和 I/O 操作)与正确的虚拟线程关联起来。

这些工具不能为以异步样式编写的应用程序做这些事情。在这种风格中,任务与线程无关,因此调试器不能显示或操作任务的状态,分析器也不能告诉任务等待 I/O 所花费的时间。

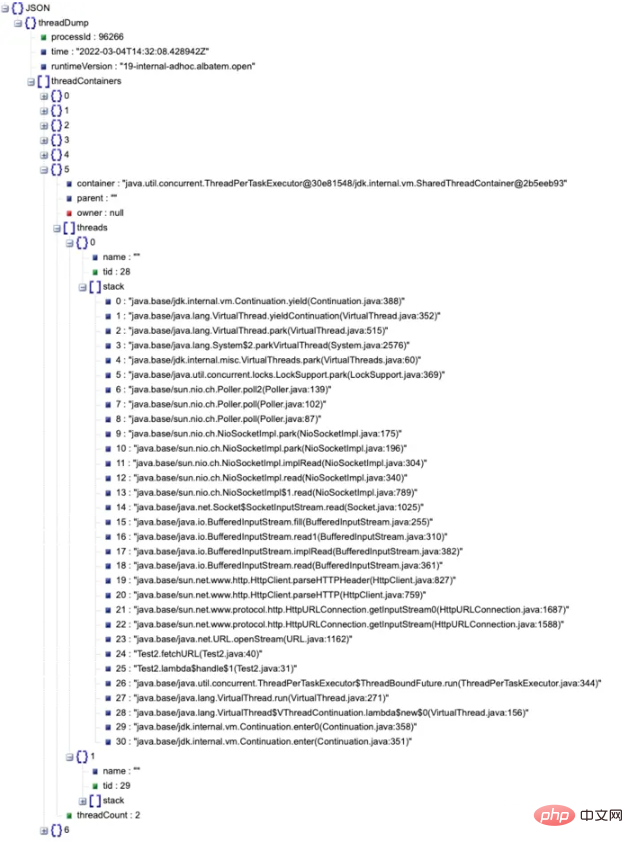

线程转储( thread dump) 是另一种流行的工具,用于以每个请求一个线程的样式编写的应用程序的故障排除。遗憾的是,通过 jstack 或 jcmd 获得的 JDK 传统线程转储提供了一个扁平的线程列表。这适用于数十或数百个平台线程,但不适用于数千或数百万个虚拟线程。因此,我们将不会扩展传统的线程转储以包含虚拟线程,而是在 jcmd 中引入一种新的线程转储,以显示平台线程旁边的虚拟线程,所有这些线程都以一种有意义的方式进行分组。当程序使用结构化并发时,可以显示线程之间更丰富的关系。

因为可视化和分析大量的线程可以从工具中受益,所以 jcmd 除了纯文本之外,还可以发布 JSON 格式的新线程转储:

$ jcmd <pid> Thread.dump_to_file -format=json <file>

新的线程转储格式列出了在网络 I/O 操作中被阻塞的虚拟线程,以及由上面所示的 new-thread-per-task ExecutorService 创建的虚拟线程。它不包括对象地址、锁、 JNI 统计信息、堆统计信息以及传统线程转储中出现的其他信息。此外,由于可能需要列出大量线程,因此生成新的线程转储并不会暂停应用程序。

下面是这样一个线程转储的示例,它取自类似于上面第二个示例的应用程序,在 JSON 查看器中呈现 :

由于虚拟线程是在 JDK 中实现的,并且不绑定到任何特定的操作系统线程,因此它们对操作系统是不可见的,操作系统不知道它们的存在。操作系统级别的监视将观察到,JDK 进程使用的操作系统线程比虚拟线程少。

调度

为了完成有用的工作,需要调度一个线程,也就是分配给处理器核心执行。对于作为 OS 线程实现的平台线程,JDK 依赖于 OS 中的调度程序。相比之下,对于虚拟线程,JDK 有自己的调度程序。JDK 的调度程序不直接将虚拟线程分配给处理器,而是将虚拟线程分配给平台线程(这是前面提到的虚拟线程的 M: N 调度)。然后,操作系统像往常一样调度平台线程。

JDK 的虚拟线程调度程序是一个在 FIFO 模式下运行的工作窃取(work-stealing) 的 ForkJoinPool。调度程序的并行性是可用于调度虚拟线程的平台线程的数量。默认情况下,它等于可用处理器的数量,但是可以使用系统属性 jdk.viralThreadScheduler.allelism 对其进行调优。注意,这个 ForkJoinPool 不同于公共池,例如,公共池用于并行流的实现,公共池以 LIFO 模式运行。

虚拟线程无法获得载体(即负责调度虚拟线程的平台线程)的标识。由 Thread.currentThread ()返回的值始终是虚拟线程本身。

载体和虚拟线程的堆栈跟踪是分离的。在虚拟线程中抛出的异常将不包括载体的堆栈帧。线程转储不会显示虚拟线程堆栈中其载体的堆栈帧,反之亦然。

虚拟线程不能使用载体的线程本地变量,反之亦然。

此外,从 Java 代码的角度来看,虚拟线程及其载体平台线程临时共享操作系统线程的事实是不存在的。相比之下,从本机代码的角度来看,虚拟线程及其载体都在同一个本机线程上运行。因此,在同一虚拟线程上多次调用的本机代码可能会在每次调用时观察到不同的 OS 线程标识符。

调度程序当前没有实现虚拟线程的时间共享。分时是对消耗了分配的 CPU 时间的线程的强制抢占。虽然在平台线程数量相对较少且 CPU 利用率为100% 的情况下,分时可以有效地减少某些任务的延迟,但是对于一百万个虚拟线程来说,分时是否有效尚不清楚。

执行

要利用虚拟线程,不必重写程序。虚拟线程不需要或期望应用程序代码显式地将控制权交还给调度程序; 换句话说,虚拟线程不是可协作的。用户代码不能假设如何或何时将虚拟线程分配给平台线程,就像它不能假设如何或何时将平台线程分配给处理器核心一样。

为了在虚拟线程中运行代码,JDK 的虚拟线程调度程序通过将虚拟线程挂载到平台线程上来分配要在平台线程上执行的虚拟线程。这使得平台线程成为虚拟线程的载体。稍后,在运行一些代码之后,虚拟线程可以从其载体卸载。此时平台线程是空闲的,因此调度程序可以在其上挂载不同的虚拟线程,从而使其再次成为载体。

通常,当虚拟线程阻塞 I/O 或 JDK 中的其他阻塞操作(如 BlockingQueue.take ())时,它将卸载。当阻塞操作准备完成时(例如,在套接字上已经接收到字节) ,它将虚拟线程提交回调度程序,调度程序将在运营商上挂载虚拟线程以恢复执行。

虚拟线程的挂载和卸载频繁且透明,并且不会阻塞任何 OS 线程。例如,前面显示的服务器应用程序包含以下代码行,其中包含对阻塞操作的调用:

response.send(future1.get() + future2.get());

这些操作将导致虚拟线程多次挂载和卸载,通常每个 get ()调用一次,在 send (...)中执行 I/O 过程中可能多次挂载和卸载。

JDK 中的绝大多数阻塞操作将卸载虚拟线程,从而释放其载体和底层操作系统线程,使其承担新的工作。但是,JDK 中的一些阻塞操作不会卸载虚拟线程,因此阻塞了其载体和底层 OS 线程。这是由于操作系统级别(例如,许多文件系统操作)或 JDK 级别(例如,Object.wait ())的限制造成的。这些阻塞操作的实现将通过暂时扩展调度程序的并行性来补偿对 OS 线程的捕获。因此,调度程序的 ForkJoinPool 中的平台线程的数量可能会暂时超过可用处理器的数量。可以使用系统属性 jdk.viralThreadScheduler.maxPoolSize 调优调度程序可用的最大平台线程数。

有两种情况下,在阻塞操作期间无法卸载虚拟线程,因为它被固定在其载体上:

当它在同步块或方法内执行代码时,或

当它执行本机方法或外部函数时。

固定并不会导致应用程序不正确,但它可能会妨碍应用程序的可伸缩性。如果虚拟线程在固定时执行阻塞操作(如 I/O 或 BlockingQueue.take () ) ,那么它的载体和底层操作系统线程将在操作期间被阻塞。长时间的频繁固定会通过捕获运营商而损害应用程序的可伸缩性。

调度程序不会通过扩展其并行性来补偿固定。相反,可以通过修改频繁运行的同步块或方法来避免频繁和长时间的固定,并保护潜在的长 I/O 操作来使用 java.util.concurrent.locks.ReentrantLock。不需要替换不常使用的同步块和方法(例如,只在启动时执行)或保护内存操作的同步块和方法。一如既往,努力保持锁定策略的简单明了。

新的诊断有助于将代码迁移到虚拟线程,以及评估是否应该使用 java.util.concurrent lock 替换同步的特定用法:

当线程在固定时阻塞时,会发出 JDK JFR事件。

当线程在固定时阻塞时,系统属性 jdk.tracePinnedThreads 触发堆栈跟踪。使用-Djdk.tracePinnedThreads = full 运行会在线程被固定时打印一个完整的堆栈跟踪,并突出显示保存监视器的本机框架和框架。使用-Djdk.tracePinnedThreads = short 将输出限制为有问题的帧。

内存使用和垃圾回收

虚拟线程的堆栈作为堆栈块对象存储在 Java 的垃圾回收堆中。堆栈随着应用程序的运行而增长和缩小,这既是为了提高内存效率,也是为了容纳任意深度的堆栈(直到 JVM 配置的平台线程堆栈大小)。这种效率支持大量的虚拟线程,因此服务器应用程序中每个请求一个线程的风格可以继续存在。

在上面的第二个例子中,回想一下,一个假设的框架通过创建一个新的虚拟线程并调用 handle 方法来处理每个请求; 即使它在深度调用堆栈的末尾调用 handle (在身份验证、事务处理等之后) ,handle 本身也会产生多个虚拟线程,这些虚拟线程只执行短暂的任务。因此,对于每个具有深层调用堆栈的虚拟线程,都会有多个具有浅层调用堆栈的虚拟线程,这些虚拟线程消耗的内存很少。

通常,虚拟线程所需的堆空间和垃圾收集器活动的数量很难与异步代码的数量相比较。一百万个虚拟线程至少需要一百万个对象,但是共享一个平台线程池的一百万个任务也需要一百万个对象。此外,处理请求的应用程序代码通常跨 I/O 操作维护数据。每个请求一个线程的代码可以将这些数据保存在本地变量中:

这些本地变量存储在堆中的虚拟线程堆栈中

异步代码必须将这些数据保存在从管道的一个阶段传递到下一个阶段的堆对象中

一方面,虚拟线程需要的堆栈帧布局比紧凑对象更浪费; 另一方面,虚拟线程可以在许多情况下变异和重用它们的堆栈(取决于低级 GC 交互) ,而异步管道总是需要分配新对象,因此虚拟线程可能需要更少的分配。

总的来说,每个请求线程与异步代码的堆消耗和垃圾收集器活动应该大致相似。随着时间的推移,我们希望使虚拟线程堆栈的内部表示更加紧凑。

与平台线程堆栈不同,虚拟线程堆栈不是 GC 根,所以它们中包含的引用不会被执行并发堆扫描的垃圾收集器(比如 G1)在 stop-the-world 暂停中遍历。这也意味着,如果一个虚拟线程被阻塞,例如 BlockingQueue.take () ,并且没有其他线程可以获得对虚拟线程或队列的引用,那么线程就可以被垃圾收集ーー这很好,因为虚拟线程永远不会被中断或解除阻塞。当然,如果虚拟线程正在运行,或者它被阻塞并且可能被解除阻塞,那么它将不会被垃圾收集。

当前虚拟线程的一个限制是 G1 GC 不支持大型堆栈块对象。如果虚拟线程的堆栈达到区域大小的一半(可能小到512KB) ,那么可能会抛出 StackOverfloError。

具体变化

java.lang.Thread

Thread.Builder, Thread.ofVirtual(), 和 Thread.ofPlatform() 是创建虚拟线程和平台线程的新 API,例如:

Thread thread = Thread.ofVirtual().name("duke").unstarted(runnable);创建一个新的未启动的虚拟线程“ duke”。

Thread.startVirtualThread(Runnable) 是创建然后启动虚拟线程的一种方便的方法。

Thread.Builder 可以创建线程或 ThreadFactory, 后者可以创建具有相同属性的多个线程。

Thread.isVirtual() 测试是否一个线程是一个虚拟的线程。

Thread.join 和 Thread.sleep 的新重载接受等待和睡眠时间作为java.time.Duration的实例。

新的 final 方法 Thread.threadId() 返回线程的标识符。现在不推荐使用现有的非 final 方法 Thread.getId() 。

Thread.getAllStackTraces() 现在返回所有平台线程的映射,而不是所有线程的映射。

java.lang.Thread API其他方面没有改变。构造器也无新变化。

虚拟线程和平台线程之间的主要 API 差异是:

公共线程构造函数不能创建虚拟线程。

虚拟线程始终是守护进程线程,Thread.setDaemon (boolean)方法不能将虚拟线程更改为非守护进程线程。

虚拟线程有一个固定的 Thread.NORM_PRIORITY 优先级。Thread.setPriority(int)方法对虚拟线程没有影响。在将来的版本中可能会重新讨论这个限制。

虚拟线程不是线程组的活动成员。在虚拟线程上调用时,Thread.getThreadGroup() 返回一个名为“ VirtualThreads”的占位符线程组。The Thread.Builder API 不定义设置虚拟线程的线程组的方法。

使用 SecurityManager 集运行时,虚拟线程没有权限。

虚拟线程不支持 stop(), suspend(), 或 resume()方法。这些方法在虚拟线程上调用时引发异常。

Thread-local variables

虚拟线程支持线程局部变量(ThreadLocal)和可继承的线程局部变量(InheritableThreadLocal) ,就像平台线程一样,因此它们可以运行使用线程局部变量的现有代码。但是,由于虚拟线程可能非常多,所以应该在仔细考虑之后使用线程局部变量。

特别是,不要使用线程局部变量在线程池中共享同一线程的多个任务之间共享昂贵的资源。虚拟线程永远不应该被共享,因为每个线程在其生存期内只能运行一个任务。我们已经从 java.base 模块中移除了许多线程局部变量的使用,以便为虚拟线程做准备,从而减少在使用数百万个线程运行时的内存占用。

此外:

The Thread.Builder API 定义了一个在创建线程时选择不使用线程局部变量的方法(a method to opt-out of thread locals when creating a thread)。它还定义了一个方法来选择不继承可继承线程局部变量的初始值( a method to opt-out of inheriting the initial value of inheritable thread-locals)。当从不支持线程局部变量的线程调用时, ThreadLocal.get()返回初始值,ThreadLocal.set(T) 抛出异常。

遗留上下文类加载器( context class loader)现在被指定为像可继承的线程本地一样工作。如果在不支持线程局部变量的线程上调用 Thread.setContextClassLoader(ClassLoader),那么它将引发异常。

Networking

L'implémentation de l'API réseau dans les packages java.net et java.nio.channels fonctionne désormais avec les threads virtuels : une opération bloquant sur le thread virtuel, par exemple, l'établissement d'une connexion réseau ou la lecture à partir d'un socket, libère le thread de plateforme sous-jacent pour Faites d'autres travaux.

Pour permettre l'interruption et l'annulation, les méthodes d'E/S bloquantes définies par java.net.Socket, ServerSocket et DatagramSocket sont désormais désignées comme interruptibles lorsqu'elles sont appelées dans un thread virtuel : Un thread virtuel bloqué sur une socket d'interruption libérera le thread et fermez la prise.

Les opérations d'E/S de blocage sur ces types de sockets sont toujours interruptions lorsqu'elles sont obtenues à partir d'InterruptibleChannel, ce changement rend donc le comportement de ces API à la création cohérent avec le comportement du constructeur lorsqu'il est obtenu à partir du canal.

java.io

Le package java.io fournit des API pour les flux d'octets et de caractères. L'implémentation de ces API est hautement synchrone et doit être modifiée pour éviter d'être épinglée pour une utilisation dans des threads virtuels.

Sous le capot, les flux d'entrée/sortie orientés octets ne sont pas spécifiés comme thread-safe, pas plus que les comportements attendus lors de l'appel de close() lors du blocage d'un thread dans une méthode de lecture ou d'écriture. Dans la plupart des cas, cela n’a pas de sens d’utiliser un flux d’entrée ou de sortie spécifique provenant de plusieurs threads simultanés. Les lecteurs/écrivains orientés caractères ne sont pas non plus spécifiés comme thread-safe, mais ils exposent un objet de verrouillage aux sous-classes. En plus d'être résolus, il existe des problèmes et des incohérences avec la synchronisation dans ces classes ; par exemple, les décodeurs et encodeurs de flux utilisés par InputStreamReader et OutputStreamWriter se synchronisent sur les objets de flux plutôt que de verrouiller les objets.

Pour éviter l'épinglage, l'implémentation est désormais la suivante :

BufferedInputStream, BufferedOutputStream, BufferedReader, BufferedWriter, PrintStream et PrintWriter utilisent désormais des verrous explicites au lieu de moniteurs lorsqu'ils sont utilisés directement. Lorsque ces classes sont sous-classées, elles sont synchronisées comme auparavant.

Les décodeurs et encodeurs de flux utilisés par InputStreamReader et OutputStreamWriter utilisent désormais les mêmes verrous que l'InputStreamReader ou OutputStreamWriter englobant.

Aller plus loin et éliminer tous ces blocages souvent inutiles dépasse le cadre de cet article.

De plus, la taille initiale des tampons utilisés par les encodeurs de flux de BufferedOutputStream, BufferedWriter et OutputStreamWriter est désormais plus petite pour réduire l'utilisation de la mémoire lorsqu'il y a de nombreux flux ou écrivains dans le tas - s'il y a un million de threads virtuels, chaque thread a un flux tampon sur la connexion socket, donc cette situation peut se produire

Etude recommandée : "Tutoriel vidéo Java"

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Nombre parfait en Java

Aug 30, 2024 pm 04:28 PM

Nombre parfait en Java

Aug 30, 2024 pm 04:28 PM

Guide du nombre parfait en Java. Nous discutons ici de la définition, comment vérifier le nombre parfait en Java ?, des exemples d'implémentation de code.

Weka en Java

Aug 30, 2024 pm 04:28 PM

Weka en Java

Aug 30, 2024 pm 04:28 PM

Guide de Weka en Java. Nous discutons ici de l'introduction, de la façon d'utiliser Weka Java, du type de plate-forme et des avantages avec des exemples.

Numéro de Smith en Java

Aug 30, 2024 pm 04:28 PM

Numéro de Smith en Java

Aug 30, 2024 pm 04:28 PM

Guide du nombre de Smith en Java. Nous discutons ici de la définition, comment vérifier le numéro Smith en Java ? exemple avec implémentation de code.

Questions d'entretien chez Java Spring

Aug 30, 2024 pm 04:29 PM

Questions d'entretien chez Java Spring

Aug 30, 2024 pm 04:29 PM

Dans cet article, nous avons conservé les questions d'entretien Java Spring les plus posées avec leurs réponses détaillées. Pour que vous puissiez réussir l'interview.

Break or Return of Java 8 Stream Forach?

Feb 07, 2025 pm 12:09 PM

Break or Return of Java 8 Stream Forach?

Feb 07, 2025 pm 12:09 PM

Java 8 présente l'API Stream, fournissant un moyen puissant et expressif de traiter les collections de données. Cependant, une question courante lors de l'utilisation du flux est: comment se casser ou revenir d'une opération FOREAK? Les boucles traditionnelles permettent une interruption ou un retour précoce, mais la méthode Foreach de Stream ne prend pas directement en charge cette méthode. Cet article expliquera les raisons et explorera des méthodes alternatives pour la mise en œuvre de terminaison prématurée dans les systèmes de traitement de flux. Lire plus approfondie: Améliorations de l'API Java Stream Comprendre le flux Forach La méthode foreach est une opération terminale qui effectue une opération sur chaque élément du flux. Son intention de conception est

Horodatage à ce jour en Java

Aug 30, 2024 pm 04:28 PM

Horodatage à ce jour en Java

Aug 30, 2024 pm 04:28 PM

Guide de TimeStamp to Date en Java. Ici, nous discutons également de l'introduction et de la façon de convertir l'horodatage en date en Java avec des exemples.

Programme Java pour trouver le volume de la capsule

Feb 07, 2025 am 11:37 AM

Programme Java pour trouver le volume de la capsule

Feb 07, 2025 am 11:37 AM

Les capsules sont des figures géométriques tridimensionnelles, composées d'un cylindre et d'un hémisphère aux deux extrémités. Le volume de la capsule peut être calculé en ajoutant le volume du cylindre et le volume de l'hémisphère aux deux extrémités. Ce tutoriel discutera de la façon de calculer le volume d'une capsule donnée en Java en utilisant différentes méthodes. Formule de volume de capsule La formule du volume de la capsule est la suivante: Volume de capsule = volume cylindrique volume de deux hémisphères volume dans, R: Le rayon de l'hémisphère. H: La hauteur du cylindre (à l'exclusion de l'hémisphère). Exemple 1 entrer Rayon = 5 unités Hauteur = 10 unités Sortir Volume = 1570,8 unités cubes expliquer Calculer le volume à l'aide de la formule: Volume = π × r2 × h (4

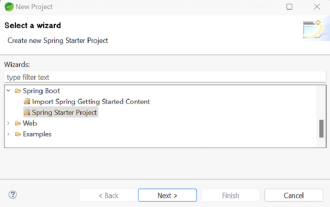

Comment exécuter votre première application Spring Boot dans Spring Tool Suite?

Feb 07, 2025 pm 12:11 PM

Comment exécuter votre première application Spring Boot dans Spring Tool Suite?

Feb 07, 2025 pm 12:11 PM

Spring Boot simplifie la création d'applications Java robustes, évolutives et prêtes à la production, révolutionnant le développement de Java. Son approche "Convention sur la configuration", inhérente à l'écosystème de ressort, minimise la configuration manuelle, allo