Périphériques technologiques

Périphériques technologiques

IA

IA

Il ne faut que quelques secondes pour convertir une photo d'identité en personne numérique. Microsoft a réalisé la première génération de modèles de diffusion 3D de haute qualité, et vous pouvez modifier votre apparence et votre apparence en une seule phrase.

Il ne faut que quelques secondes pour convertir une photo d'identité en personne numérique. Microsoft a réalisé la première génération de modèles de diffusion 3D de haute qualité, et vous pouvez modifier votre apparence et votre apparence en une seule phrase.

Il ne faut que quelques secondes pour convertir une photo d'identité en personne numérique. Microsoft a réalisé la première génération de modèles de diffusion 3D de haute qualité, et vous pouvez modifier votre apparence et votre apparence en une seule phrase.

Le nom de ce modèle de diffusion généré en 3D "Rodin" est inspiré de l'artiste sculpteur français Auguste Rodin.

Avec une photo d'identité 2D, vous pouvez concevoir un avatar de jeu 3D en quelques secondes seulement !

C'est la dernière réalisation du modèle de diffusion dans le domaine 3D. Par exemple, une simple vieille photo du sculpteur français Rodin peut le "transformer" en jeu en quelques minutes :

△Le modèle RODIN est une image 3D générée à partir de l'ancienne photo de Rodin

Il ne nécessite même qu'une seule phrase. peut modifier votre apparence et votre image. Dites à Rodin généré par l'IA "qu'il a l'air de porter un pull rouge et des lunettes" :

Vous n'aimez pas les gros cheveux gominés en arrière ? Passez ensuite au "look tressé" :

Essayez à nouveau de changer de couleur de cheveux ? Il s'agit d'une "personne branchée à la mode" aux cheveux bruns, même la couleur de la barbe est fixe :

("personne branchée à la mode" aux yeux de l'IA est effectivement un peu trop tendance)

Le dernier modèle de diffusion généré en 3D ci-dessus "Rodin" RODIN (Roll-out Diffusion Network), de Microsoft Research Asia.

RODIN est également le premier modèle à utiliser le modèle de diffusion générative pour générer automatiquement des avatars numériques 3D (Avatar) sur des données d'entraînement 3D. L'article a été accepté par CVPR 2023.

Jetons un coup d’œil.

Entraînez le modèle de diffusion directement avec des données 3D

Le nom de ce modèle de diffusion généré en 3D "Rodin" est inspiré de l'artiste sculpteur français Auguste Rodin.

Auparavant, les modèles d'images 3D générés en 2D étaient généralement obtenus en entraînant des réseaux contradictoires génératifs (GAN) ou des auto-encodeurs variationnels (VAE) avec des données 2D, mais les résultats étaient souvent insatisfaisants.

Les chercheurs ont analysé que la raison de ce phénomène est que ces méthodes ont un problème fondamental sous-déterminé (mal posé). Autrement dit, en raison de l'ambiguïté géométrique des images à vue unique, il est difficile d'apprendre la distribution raisonnable d'avatars 3D de haute qualité uniquement à travers une grande quantité de données 2D, ce qui entraîne de mauvais résultats de génération.

Par conséquent, cette fois, ils ont essayé d'utiliser directement les données 3D pour entraîner le modèle de diffusion, ce qui a principalement résolu trois problèmes :

- Premièrement, comment utiliser le modèle de diffusion pour générer des images multi-vues du modèle 3D. Auparavant, il n’existait aucune méthode pratique ni précédent à suivre pour les modèles de diffusion sur des données 3D.

- Deuxièmement, des ensembles de données d'images 3D de haute qualité et à grande échelle sont difficiles à obtenir, et il existe des risques en matière de confidentialité et de droits d'auteur, mais la cohérence multi-vues ne peut pas être garantie pour les images 3D publiées sur Internet.

- Enfin, le modèle de diffusion 2D est directement étendu à la génération 3D, ce qui nécessite d'énormes frais de mémoire, de stockage et de calcul.

Afin de résoudre ces trois problèmes, les chercheurs ont proposé le modèle de diffusion RODIN « AI Sculptor », qui dépasse le niveau SOTA des modèles existants.

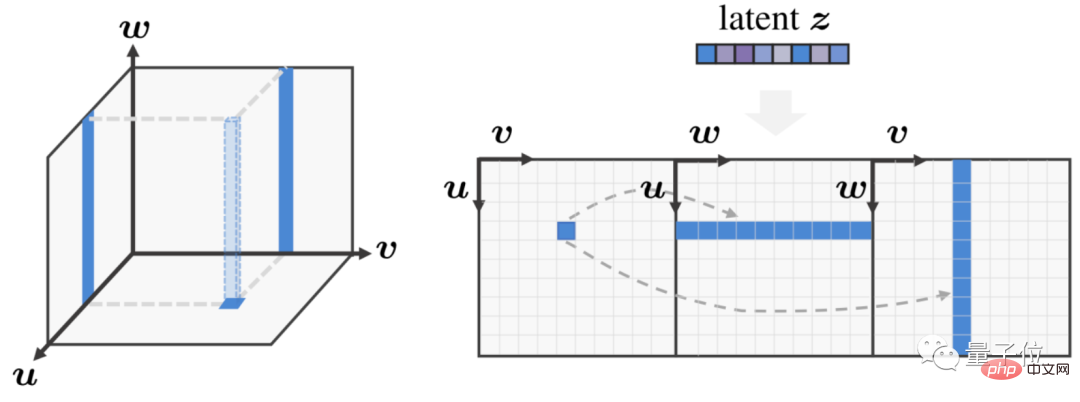

Le modèle RODIN utilise la méthode du champ de rayonnement neuronal (NeRF) et s'appuie sur le travail EG3D de NVIDIA pour exprimer de manière compacte l'espace 3D en trois plans caractéristiques mutuellement perpendiculaires (Triplans) dans l'espace, et étendre ces cartes en un seul plan caractéristique 2D. Effectuez ensuite une diffusion de détection 3D.

Plus précisément, il s'agit d'étendre l'espace 3D avec des caractéristiques bidimensionnelles sur trois vues planes orthogonales de plans horizontal, vertical et vertical. Cela permet non seulement au modèle RODIN d'utiliser une architecture 2D efficace pour la diffusion de la perception 3D, mais réduit également. l'image 3D. Les images 2D dimensionnelles réduisent également considérablement la complexité et les coûts de calcul.

△La convolution perceptuelle 3D traite efficacement les caractéristiques 3D

Sur le côté gauche de la figure ci-dessus, un triplan est utilisé pour exprimer l'espace 3D. À ce stade, les points caractéristiques du plan caractéristique inférieur correspondent aux deux. lignes des deux autres plans caractéristiques ; sur le côté droit de la figure ci-dessus, une convolution perceptuelle 3D est introduite pour traiter le plan caractéristique 2D étendu, tout en tenant compte de la correspondance tridimensionnelle inhérente des trois plans.

Plus précisément, trois éléments clés sont nécessaires pour parvenir à la génération d'images 3D :

Premièrement, la convolution compatible 3D assure la corrélation intrinsèque des trois plans après réduction de dimensionnalité.

Le réseau neuronal convolutif (CNN) 2D utilisé dans la diffusion 2D traditionnelle ne gère pas bien les cartes de caractéristiques Triplane.

La convolution prenant en compte la 3D ne génère pas simplement trois plans de caractéristiques 2D, mais prend en compte ses caractéristiques tridimensionnelles inhérentes lors du traitement de telles expressions 3D, c'est-à-dire que les caractéristiques 2D de l'un des trois plans de vue sont essentiellement un espace 3D. La projection d'une ligne droite La ligne dans le plan est donc liée aux caractéristiques de projection en ligne droite correspondantes dans les deux autres plans.

Afin de parvenir à une communication entre plans, les chercheurs considèrent ces corrélations 3D en convolution, synthétisant ainsi efficacement les détails 3D en 2D.

Deuxièmement, génération d'expressions 3D à trois plans de concerto spatial latent.

Les chercheurs coordonnent la génération de caractéristiques via des vecteurs latents pour la rendre globalement cohérente dans l'ensemble de l'espace tridimensionnel, ce qui aboutit à des avatars et à une édition sémantique de meilleure qualité.

Dans le même temps, un encodeur d'image supplémentaire est également entraîné en utilisant les images de l'ensemble de données d'entraînement, qui peut extraire des vecteurs sémantiques latents comme entrées conditionnelles du modèle de diffusion.

De cette manière, le réseau génératif global peut être considéré comme un auto-encodeur, utilisant le modèle de diffusion comme vecteur spatial latent de décodage. Pour la modification sémantique, les chercheurs ont adopté un encodeur d'image CLIP figé qui partage l'espace latent avec des invites de texte.

Troisièmement, la synthèse hiérarchique génère des détails tridimensionnels haute fidélité.

Les chercheurs ont utilisé le modèle de diffusion pour générer d'abord un plan à trois vues basse résolution (64 × 64), puis ont généré un plan à trois vues haute résolution (256 × 256) par suréchantillonnage de diffusion.

De cette manière, le modèle de diffusion de base se concentre sur la génération globale de la structure 3D, tandis que le modèle de suréchantillonnage ultérieur se concentre sur la génération de détails.

Générer une grande quantité de données aléatoires basées sur Blender

Sur l'ensemble de données d'entraînement, les chercheurs ont utilisé le logiciel de rendu 3D open source Blender pour combiner de manière aléatoire des images de personnages virtuels 3D créées manuellement par des artistes, ainsi qu'un grand nombre de cheveux, vêtements, expressions et accessoires, puis a créé 100 000 individus synthétiques, tout en restituant 300 images multi-vues avec une résolution de 256*256 pour chaque individu.

Dans la génération de texte en avatar 3D, les chercheurs ont utilisé le sous-ensemble portrait de l'ensemble de données LAION-400M pour entraîner le mappage de la modalité d'entrée à l'espace latent du modèle de diffusion 3D, et ont finalement permis au modèle RODIN d'utiliser une seule image 2D ou avec une seule description textuelle, vous pouvez créer un avatar 3D réaliste.

△À partir d'une photo pour générer un avatar

, vous ne pouvez pas seulement changer l'image en une phrase, comme "un homme aux cheveux bouclés et à la barbe portant une veste en cuir noir":

Vous pouvez même changer le sexe à volonté, « Femmes avec des vêtements rouges et des coiffures africaines » : (Tête de chien manuelle)

Les chercheurs ont également fait une démonstration de l'application. Créer votre propre image ne nécessite que quelques boutons :

.

△ Utilisez du texte pour créer un portrait en 3D

Pour plus d'effets, vous pouvez cliquer sur l'adresse du projet pour voir~

△Plus d'images virtuelles générées aléatoirement

Après avoir créé RODIN, quel est le prochain plan de l'équipe ?

Selon les auteurs de Microsoft Research Asia, les travaux actuels de RODIN se concentrent principalement sur les portraits en demi-longueur 3D, ce qui est également lié au fait qu'il utilise principalement les données du visage pour l'entraînement, mais la demande de génération d'images 3D n'est pas limité aux visages humains.

Dans la prochaine étape, l'équipe envisagera d'essayer d'utiliser les modèles RODIN pour créer davantage de scènes 3D, notamment des fleurs, des arbres, des bâtiments, des voitures et des maisons, etc., afin d'atteindre l'objectif ultime de « tout générer en 3D avec un seul modèle ». .

Adresse papier :

https://arxiv.org/abs/2212.06135

Page du projet :

https://3d-avatar-diffusion.microsoft.com

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Le modèle MoE open source le plus puissant au monde est ici, avec des capacités chinoises comparables à celles du GPT-4, et le prix ne représente que près d'un pour cent de celui du GPT-4-Turbo.

May 07, 2024 pm 04:13 PM

Le modèle MoE open source le plus puissant au monde est ici, avec des capacités chinoises comparables à celles du GPT-4, et le prix ne représente que près d'un pour cent de celui du GPT-4-Turbo.

May 07, 2024 pm 04:13 PM

Imaginez un modèle d'intelligence artificielle qui non seulement a la capacité de surpasser l'informatique traditionnelle, mais qui permet également d'obtenir des performances plus efficaces à moindre coût. Ce n'est pas de la science-fiction, DeepSeek-V2[1], le modèle MoE open source le plus puissant au monde est ici. DeepSeek-V2 est un puissant mélange de modèle de langage d'experts (MoE) présentant les caractéristiques d'une formation économique et d'une inférence efficace. Il est constitué de 236B paramètres, dont 21B servent à activer chaque marqueur. Par rapport à DeepSeek67B, DeepSeek-V2 offre des performances plus élevées, tout en économisant 42,5 % des coûts de formation, en réduisant le cache KV de 93,3 % et en augmentant le débit de génération maximal à 5,76 fois. DeepSeek est une entreprise explorant l'intelligence artificielle générale

KAN, qui remplace MLP, a été étendu à la convolution par des projets open source

Jun 01, 2024 pm 10:03 PM

KAN, qui remplace MLP, a été étendu à la convolution par des projets open source

Jun 01, 2024 pm 10:03 PM

Plus tôt ce mois-ci, des chercheurs du MIT et d'autres institutions ont proposé une alternative très prometteuse au MLP – KAN. KAN surpasse MLP en termes de précision et d’interprétabilité. Et il peut surpasser le MLP fonctionnant avec un plus grand nombre de paramètres avec un très petit nombre de paramètres. Par exemple, les auteurs ont déclaré avoir utilisé KAN pour reproduire les résultats de DeepMind avec un réseau plus petit et un degré d'automatisation plus élevé. Plus précisément, le MLP de DeepMind compte environ 300 000 paramètres, tandis que le KAN n'en compte qu'environ 200. KAN a une base mathématique solide comme MLP est basé sur le théorème d'approximation universelle, tandis que KAN est basé sur le théorème de représentation de Kolmogorov-Arnold. Comme le montre la figure ci-dessous, KAN a

Bonjour, Atlas électrique ! Le robot Boston Dynamics revient à la vie, des mouvements étranges à 180 degrés effraient Musk

Apr 18, 2024 pm 07:58 PM

Bonjour, Atlas électrique ! Le robot Boston Dynamics revient à la vie, des mouvements étranges à 180 degrés effraient Musk

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas entre officiellement dans l’ère des robots électriques ! Hier, l'Atlas hydraulique s'est retiré "en larmes" de la scène de l'histoire. Aujourd'hui, Boston Dynamics a annoncé que l'Atlas électrique était au travail. Il semble que dans le domaine des robots humanoïdes commerciaux, Boston Dynamics soit déterminé à concurrencer Tesla. Après la sortie de la nouvelle vidéo, elle a déjà été visionnée par plus d’un million de personnes en seulement dix heures. Les personnes âgées partent et de nouveaux rôles apparaissent. C'est une nécessité historique. Il ne fait aucun doute que cette année est l’année explosive des robots humanoïdes. Les internautes ont commenté : Les progrès des robots ont fait ressembler la cérémonie d'ouverture de cette année à des êtres humains, et le degré de liberté est bien plus grand que celui des humains. Mais n'est-ce vraiment pas un film d'horreur ? Au début de la vidéo, Atlas est allongé calmement sur le sol, apparemment sur le dos. Ce qui suit est à couper le souffle

L'IA bouleverse la recherche mathématique ! Le lauréat de la médaille Fields et mathématicien sino-américain a dirigé 11 articles les mieux classés | Aimé par Terence Tao

Apr 09, 2024 am 11:52 AM

L'IA bouleverse la recherche mathématique ! Le lauréat de la médaille Fields et mathématicien sino-américain a dirigé 11 articles les mieux classés | Aimé par Terence Tao

Apr 09, 2024 am 11:52 AM

L’IA change effectivement les mathématiques. Récemment, Tao Zhexuan, qui a prêté une attention particulière à cette question, a transmis le dernier numéro du « Bulletin de l'American Mathematical Society » (Bulletin de l'American Mathematical Society). En se concentrant sur le thème « Les machines changeront-elles les mathématiques ? », de nombreux mathématiciens ont exprimé leurs opinions. L'ensemble du processus a été plein d'étincelles, intense et passionnant. L'auteur dispose d'une équipe solide, comprenant Akshay Venkatesh, lauréat de la médaille Fields, le mathématicien chinois Zheng Lejun, l'informaticien de l'Université de New York Ernest Davis et de nombreux autres universitaires bien connus du secteur. Le monde de l’IA a radicalement changé. Vous savez, bon nombre de ces articles ont été soumis il y a un an.

Les robots Tesla travaillent dans les usines, Musk : Le degré de liberté des mains atteindra 22 cette année !

May 06, 2024 pm 04:13 PM

Les robots Tesla travaillent dans les usines, Musk : Le degré de liberté des mains atteindra 22 cette année !

May 06, 2024 pm 04:13 PM

La dernière vidéo du robot Optimus de Tesla est sortie, et il peut déjà fonctionner en usine. À vitesse normale, il trie les batteries (les batteries 4680 de Tesla) comme ceci : Le responsable a également publié à quoi cela ressemble à une vitesse 20 fois supérieure - sur un petit "poste de travail", en sélectionnant et en sélectionnant et en sélectionnant : Cette fois, il est publié L'un des points forts de la vidéo est qu'Optimus réalise ce travail en usine, de manière totalement autonome, sans intervention humaine tout au long du processus. Et du point de vue d'Optimus, il peut également récupérer et placer la batterie tordue, en se concentrant sur la correction automatique des erreurs : concernant la main d'Optimus, le scientifique de NVIDIA Jim Fan a donné une évaluation élevée : la main d'Optimus est l'un des robots à cinq doigts du monde. le plus adroit. Ses mains ne sont pas seulement tactiles

FisheyeDetNet : le premier algorithme de détection de cible basé sur une caméra fisheye

Apr 26, 2024 am 11:37 AM

FisheyeDetNet : le premier algorithme de détection de cible basé sur une caméra fisheye

Apr 26, 2024 am 11:37 AM

La détection de cibles est un problème relativement mature dans les systèmes de conduite autonome, parmi lesquels la détection des piétons est l'un des premiers algorithmes à être déployés. Des recherches très complètes ont été menées dans la plupart des articles. Cependant, la perception de la distance à l’aide de caméras fisheye pour une vue panoramique est relativement moins étudiée. En raison de la distorsion radiale importante, la représentation standard du cadre de délimitation est difficile à mettre en œuvre dans les caméras fisheye. Pour alléger la description ci-dessus, nous explorons les conceptions étendues de boîtes englobantes, d'ellipses et de polygones généraux dans des représentations polaires/angulaires et définissons une métrique de segmentation d'instance mIOU pour analyser ces représentations. Le modèle fisheyeDetNet proposé avec une forme polygonale surpasse les autres modèles et atteint simultanément 49,5 % de mAP sur l'ensemble de données de la caméra fisheye Valeo pour la conduite autonome.

Une seule carte exécute Llama 70B plus rapidement que deux cartes, Microsoft vient de mettre le FP6 dans l'Open source A100 |

Apr 29, 2024 pm 04:55 PM

Une seule carte exécute Llama 70B plus rapidement que deux cartes, Microsoft vient de mettre le FP6 dans l'Open source A100 |

Apr 29, 2024 pm 04:55 PM

Le FP8 et la précision de quantification inférieure en virgule flottante ne sont plus le « brevet » du H100 ! Lao Huang voulait que tout le monde utilise INT8/INT4, et l'équipe Microsoft DeepSpeed a commencé à exécuter FP6 sur A100 sans le soutien officiel de NVIDIA. Les résultats des tests montrent que la quantification FP6 de la nouvelle méthode TC-FPx sur A100 est proche ou parfois plus rapide que celle de INT4, et a une précision supérieure à celle de cette dernière. En plus de cela, il existe également une prise en charge de bout en bout des grands modèles, qui ont été open source et intégrés dans des cadres d'inférence d'apprentissage profond tels que DeepSpeed. Ce résultat a également un effet immédiat sur l'accélération des grands modèles : dans ce cadre, en utilisant une seule carte pour exécuter Llama, le débit est 2,65 fois supérieur à celui des cartes doubles. un

Les dernières nouvelles de l'Université d'Oxford ! Mickey : correspondance d'images 2D en 3D SOTA ! (CVPR\'24)

Apr 23, 2024 pm 01:20 PM

Les dernières nouvelles de l'Université d'Oxford ! Mickey : correspondance d'images 2D en 3D SOTA ! (CVPR\'24)

Apr 23, 2024 pm 01:20 PM

Lien du projet écrit devant : https://nianticlabs.github.io/mickey/ Étant donné deux images, la pose de la caméra entre elles peut être estimée en établissant la correspondance entre les images. En règle générale, ces correspondances sont 2D à 2D et nos poses estimées sont à échelle indéterminée. Certaines applications, telles que la réalité augmentée instantanée, à tout moment et en tout lieu, nécessitent une estimation de pose des métriques d'échelle, elles s'appuient donc sur des estimateurs de profondeur externes pour récupérer l'échelle. Cet article propose MicKey, un processus de correspondance de points clés capable de prédire les correspondances métriques dans l'espace d'une caméra 3D. En apprenant la correspondance des coordonnées 3D entre les images, nous sommes en mesure de déduire des métriques relatives.