Périphériques technologiques

Périphériques technologiques

IA

IA

Supprimer le scintillement vidéo en un clic, cette étude propose un cadre général

Supprimer le scintillement vidéo en un clic, cette étude propose un cadre général

Supprimer le scintillement vidéo en un clic, cette étude propose un cadre général

Cet article propose avec succès la première méthode universelle de suppression du scintillement qui ne nécessite pas de conseils ni de compréhension supplémentaires du scintillement et peut éliminer divers artefacts de scintillement.

Les vidéos de haute qualité sont généralement cohérentes dans le temps, mais de nombreuses vidéos présentent un scintillement pour diverses raisons. Par exemple, la luminosité des anciens films peut être très instable en raison de la mauvaise qualité de certains anciens appareils photo et de l'incapacité de régler le temps d'exposition de manière identique pour chaque image. De plus, les caméras à grande vitesse avec des temps d'exposition très courts peuvent capturer les changements à haute fréquence (par exemple 60 Hz) de l'éclairage intérieur.

Un scintillement peut se produire lors de l'application d'algorithmes d'image à des vidéos temporellement cohérentes, tels que des algorithmes de traitement efficaces tels que l'amélioration de l'image, la colorisation de l'image et le transfert de style.

Les vidéos générées par les méthodes de génération vidéo peuvent également contenir des artefacts de scintillement.

La suppression du scintillement des vidéos est très populaire dans les domaines du traitement vidéo et de la photographie informatique, car les vidéos temporellement cohérentes sont généralement plus attrayantes visuellement.

Cet article CVPR 2023 est dédié à la recherche d'une méthode universelle de suppression du scintillement qui : (1) a une forte généralisation à divers modèles ou niveaux de scintillement (par exemple, vieux films, vidéos au ralenti capturées par des caméras à grande vitesse), (2) Seule une vidéo flash est requise et aucune autre information auxiliaire (telle que le type de flash, une vidéo supplémentaire cohérente dans le temps) n'est requise. Comme cette méthode ne fait pas trop d’hypothèses, elle offre un large éventail de scénarios d’application.

Lien code : https://github.com/ChenyangLEI/All-in-one-Deflicker

Lien projet : https://chenyanglei.github.io/deflicker

Lien papier : https:// arxiv.org/pdf/2303.08120.pdf

Méthodes

Les méthodes génériques de suppression du scintillement sont difficiles car il est difficile d'assurer la cohérence temporelle dans la vidéo sans aucune orientation supplémentaire.

Les techniques existantes conçoivent généralement des stratégies spécifiques pour chaque type de scintillement et utilisent des connaissances spécifiques. Par exemple, pour les vidéos au ralenti capturées par des caméras à grande vitesse, des travaux antérieurs permettent d’analyser les fréquences d’éclairage. Pour les vidéos traitées par des algorithmes de traitement d'image, l'algorithme de cohérence temporelle vidéo aveugle peut utiliser la vidéo non traitée temporellement cohérente comme référence pour obtenir une cohérence à long terme. Cependant, les types de scintillement ou les vidéos non traitées ne sont pas toujours disponibles, de sorte que les algorithmes spécifiques au scintillement existants ne peuvent pas être appliqués à ce cas.

Une solution intuitive consiste à utiliser le flux optique pour suivre les correspondances. Cependant, le flux optique obtenu à partir des vidéos scintillantes n'est pas assez précis et l'erreur cumulée du flux optique augmente également avec le nombre d'images.

Grâce à deux observations et conceptions clés, l'auteur a proposé avec succès une méthode générale de suppression du scintillement qui peut éliminer divers artefacts de scintillement sans conseils supplémentaires.

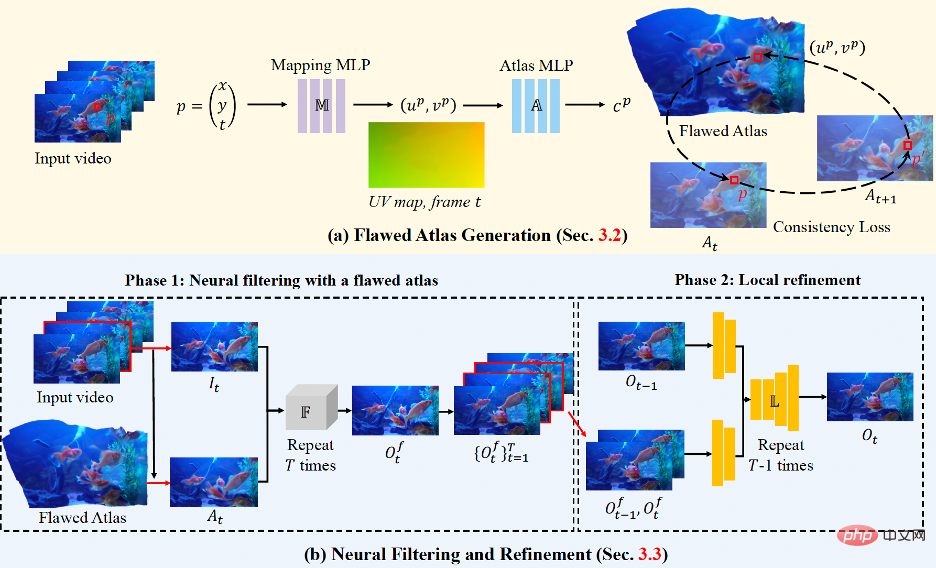

Un bon modèle anti-scintillement aveugle devrait avoir la capacité de suivre les points correspondants entre toutes les images vidéo. La plupart des structures de réseau dans le traitement vidéo ne peuvent accepter qu'un petit nombre d'images en entrée, ce qui entraîne un petit champ de réception et ne peut garantir une cohérence à long terme. Les chercheurs ont observé que les atlas neuronaux sont bien adaptés à la tâche d’élimination du scintillement et introduiront donc des atlas neuronaux dans cette tâche. Les atlas neuronaux sont une représentation unifiée et concise de tous les pixels d'une vidéo. Comme le montre la figure (a), soit p un pixel, et chaque pixel p est entré dans le réseau de cartographie M, qui prédit les coordonnées 2D (up, vp), représentant la position correspondante du pixel dans l'atlas. Idéalement, les points correspondants entre différentes images devraient partager un pixel dans l'atlas, même si les pixels d'entrée sont de couleurs différentes. Autrement dit, cela garantit la cohérence temporelle.

Deuxièmement, bien que les images extraites des calques partagés soient cohérentes, la structure des images est défectueuse : les couches neuronales ne peuvent pas facilement modéliser des objets dynamiques avec un mouvement important ; le flux optique utilisé pour construire les calques n'est pas non plus parfait. Par conséquent, les auteurs proposent une stratégie de filtrage neuronal pour sélectionner les bonnes pièces parmi les couches défectueuses. Les chercheurs ont formé un réseau neuronal pour apprendre l’invariance sous deux types de distorsion, qui simulent des artefacts en couches et un scintillement dans les vidéos. Lors des tests, le réseau a bien fonctionné comme filtre pour préserver les propriétés de cohérence et bloquer les artefacts dans les couches défectueuses.

Expérience

Les chercheurs ont construit un ensemble de données contenant diverses vidéos réelles scintillantes. Des expériences approfondies montrent que notre méthode permet d'obtenir des effets anti-scintillement satisfaisants sur plusieurs types de vidéos scintillantes. L'algorithme des chercheurs a même surpassé les méthodes de base en utilisant des conseils supplémentaires sur les références publiques.

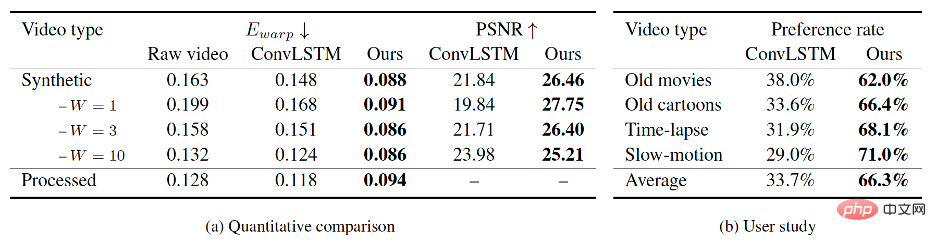

Le chercheur fournit (a) une comparaison quantitative de la vidéo scintillante traitée et de la vidéo scintillante synthétisée. L'erreur de déformation de la méthode du chercheur est bien inférieure à la ligne de base. Selon le PSNR, les résultats du chercheur sont meilleurs que ceux de la méthode du chercheur. vidéo scintillante synthétisée. Les données sont également plus proches de la valeur réelle. Pour d'autres vidéos du monde réel, l'étude a fourni (b) une expérience en double aveugle à des fins de comparaison, et la plupart des utilisateurs ont préféré les résultats des chercheurs.

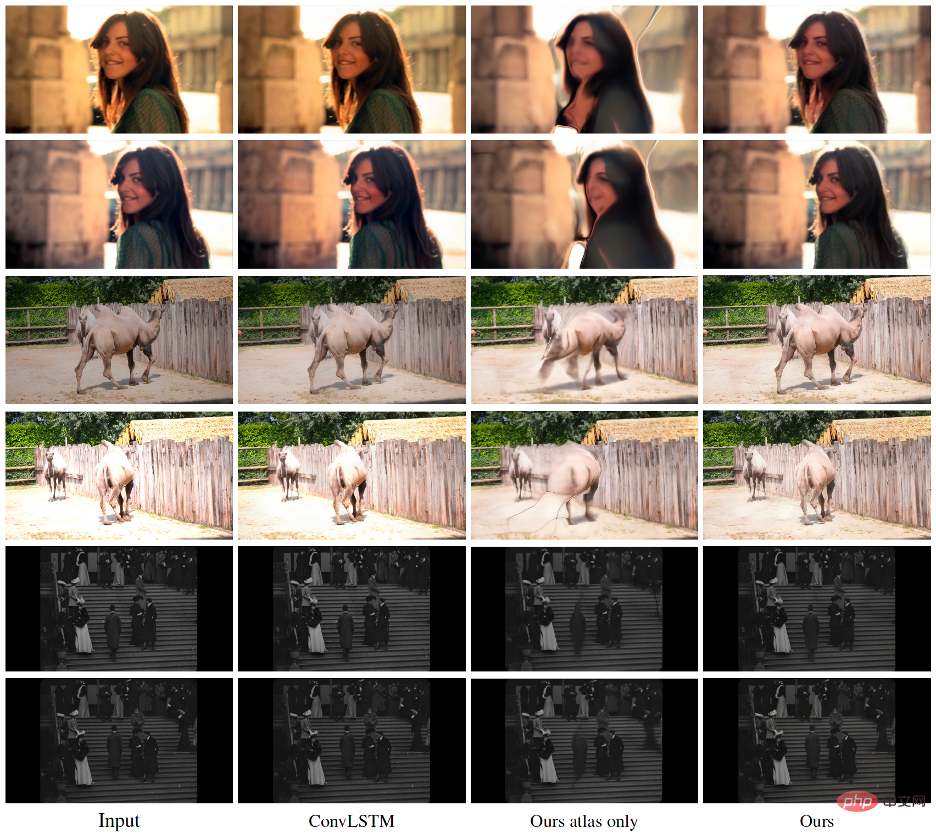

Comme le montre la figure ci-dessus, l'algorithme du chercheur peut très bien supprimer le scintillement de la vidéo d'entrée. A noter que la troisième colonne d'images montre les résultats de la couche neuronale. Des défauts évidents peuvent être observés, mais l'algorithme du chercheur peut faire bon usage de sa cohérence et éviter d'introduire ces défauts.

Ce framework peut supprimer différentes catégories de scintillement contenues dans les anciens films et les vidéos générées par l'IA.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Où sont stockés les fichiers vidéo dans le cache du navigateur ?

Feb 19, 2024 pm 05:09 PM

Où sont stockés les fichiers vidéo dans le cache du navigateur ?

Feb 19, 2024 pm 05:09 PM

Dans quel dossier le navigateur met-il la vidéo en cache ? Lorsque nous utilisons le navigateur Internet quotidiennement, nous regardons souvent diverses vidéos en ligne, comme regarder des clips vidéo sur YouTube ou regarder des films sur Netflix. Ces vidéos seront mises en cache par le navigateur pendant le processus de chargement afin qu'elles puissent être chargées rapidement lors d'une nouvelle lecture ultérieure. La question est donc de savoir dans quel dossier ces vidéos mises en cache sont réellement stockées ? Différents navigateurs stockent les dossiers vidéo mis en cache à différents emplacements. Ci-dessous, nous présenterons plusieurs navigateurs courants et leurs

Est-ce une infraction de publier des vidéos d'autres personnes sur Douyin ? Comment éditer des vidéos sans infraction ?

Mar 21, 2024 pm 05:57 PM

Est-ce une infraction de publier des vidéos d'autres personnes sur Douyin ? Comment éditer des vidéos sans infraction ?

Mar 21, 2024 pm 05:57 PM

Avec l'essor des plateformes de vidéos courtes, Douyin est devenu un élément indispensable de la vie quotidienne de chacun. Sur TikTok, nous pouvons voir des vidéos intéressantes du monde entier. Certaines personnes aiment publier les vidéos d’autres personnes, ce qui soulève une question : Douyin enfreint-il la publication de vidéos d’autres personnes ? Cet article abordera ce problème et vous expliquera comment éditer des vidéos sans infraction et comment éviter les problèmes d'infraction. 1. Cela porte-t-il atteinte à la publication par Douyin de vidéos d'autres personnes ? Selon les dispositions de la loi sur le droit d'auteur de mon pays, l'utilisation non autorisée des œuvres du titulaire du droit d'auteur sans l'autorisation du titulaire du droit d'auteur constitue une infraction. Par conséquent, publier des vidéos d’autres personnes sur Douyin sans l’autorisation de l’auteur original ou du titulaire des droits d’auteur constitue une infraction. 2. Comment monter une vidéo sans contrefaçon ? 1. Utilisation de contenu du domaine public ou sous licence : Public

Comment supprimer le filigrane vidéo dans Wink

Feb 23, 2024 pm 07:22 PM

Comment supprimer le filigrane vidéo dans Wink

Feb 23, 2024 pm 07:22 PM

Comment supprimer les filigranes des vidéos dans Wink ? Il existe un outil pour supprimer les filigranes des vidéos dans winkAPP, mais la plupart des amis ne savent pas comment supprimer les filigranes des vidéos dans Wink. Voici ensuite l'image de la façon de supprimer les filigranes des vidéos dans Wink. apporté par l'éditeur Tutoriel texte, les utilisateurs intéressés viennent y jeter un oeil ! Comment supprimer le filigrane vidéo dans Wink 1. Ouvrez d'abord l'application Wink et sélectionnez la fonction [Supprimer le filigrane] dans la zone de la page d'accueil ; 2. Sélectionnez ensuite la vidéo dont vous souhaitez supprimer le filigrane dans l'album ; dans le coin supérieur droit après avoir édité la vidéo [√] ; 4. Enfin, cliquez sur [Imprimer en un clic] comme indiqué dans la figure ci-dessous, puis cliquez sur [Traiter].

Comment gagner de l'argent en publiant des vidéos sur Douyin ? Comment un débutant peut-il gagner de l'argent sur Douyin ?

Mar 21, 2024 pm 08:17 PM

Comment gagner de l'argent en publiant des vidéos sur Douyin ? Comment un débutant peut-il gagner de l'argent sur Douyin ?

Mar 21, 2024 pm 08:17 PM

Douyin, la plateforme nationale de courtes vidéos, nous permet non seulement de profiter d'une variété de courtes vidéos intéressantes et originales pendant notre temps libre, mais nous donne également une scène pour nous montrer et réaliser nos valeurs. Alors, comment gagner de l’argent en postant des vidéos sur Douyin ? Cet article répondra à cette question en détail et vous aidera à gagner plus d’argent sur TikTok. 1. Comment gagner de l’argent en publiant des vidéos sur Douyin ? Après avoir posté une vidéo et obtenu un certain nombre de vues sur Douyin, vous aurez la possibilité de participer au plan de partage publicitaire. Cette méthode de revenus est l’une des plus connues des utilisateurs de Douyin et constitue également la principale source de revenus pour de nombreux créateurs. Douyin décide d'offrir ou non des opportunités de partage de publicités en fonction de divers facteurs tels que le poids du compte, le contenu vidéo et les commentaires du public. La plateforme TikTok permet aux téléspectateurs de soutenir leurs créateurs préférés en envoyant des cadeaux,

Comment publier des vidéos sur Weibo sans compresser la qualité de l'image_Comment publier des vidéos sur Weibo sans compresser la qualité de l'image

Mar 30, 2024 pm 12:26 PM

Comment publier des vidéos sur Weibo sans compresser la qualité de l'image_Comment publier des vidéos sur Weibo sans compresser la qualité de l'image

Mar 30, 2024 pm 12:26 PM

1. Ouvrez d'abord Weibo sur votre téléphone mobile et cliquez sur [Moi] dans le coin inférieur droit (comme indiqué sur l'image). 2. Cliquez ensuite sur [Gear] dans le coin supérieur droit pour ouvrir les paramètres (comme indiqué sur l'image). 3. Ensuite, recherchez et ouvrez [Paramètres généraux] (comme indiqué sur l'image). 4. Entrez ensuite l'option [Video Follow] (comme indiqué sur l'image). 5. Ensuite, ouvrez le paramètre [Résolution de téléchargement vidéo] (comme indiqué sur l'image). 6. Enfin, sélectionnez [Qualité d'image originale] pour éviter la compression (comme indiqué sur l'image).

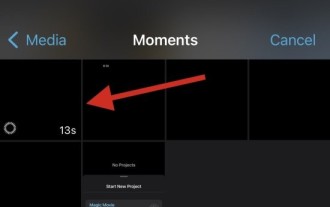

2 façons de supprimer le ralenti des vidéos sur iPhone

Mar 04, 2024 am 10:46 AM

2 façons de supprimer le ralenti des vidéos sur iPhone

Mar 04, 2024 am 10:46 AM

Sur les appareils iOS, l'application Appareil photo vous permet de filmer des vidéos au ralenti, voire à 240 images par seconde si vous possédez le dernier iPhone. Cette capacité vous permet de capturer une action à grande vitesse avec des détails riches. Mais parfois, vous souhaiterez peut-être lire des vidéos au ralenti à vitesse normale afin de mieux apprécier les détails et l'action de la vidéo. Dans cet article, nous expliquerons toutes les méthodes pour supprimer le ralenti des vidéos existantes sur iPhone. Comment supprimer le ralenti des vidéos sur iPhone [2 méthodes] Vous pouvez utiliser l'application Photos ou l'application iMovie pour supprimer le ralenti des vidéos sur votre appareil. Méthode 1 : ouvrir sur iPhone à l’aide de l’application Photos

Comment publier les œuvres vidéo de Xiaohongshu ? À quoi dois-je faire attention lorsque je publie des vidéos ?

Mar 23, 2024 pm 08:50 PM

Comment publier les œuvres vidéo de Xiaohongshu ? À quoi dois-je faire attention lorsque je publie des vidéos ?

Mar 23, 2024 pm 08:50 PM

Avec l'essor des plateformes de vidéos courtes, Xiaohongshu est devenue une plateforme permettant à de nombreuses personnes de partager leur vie, de s'exprimer et de gagner du trafic. Sur cette plateforme, la publication d’œuvres vidéo est un moyen d’interaction très prisé. Alors, comment publier les œuvres vidéo de Xiaohongshu ? 1. Comment publier les œuvres vidéo de Xiaohongshu ? Tout d’abord, assurez-vous d’avoir un contenu vidéo prêt à partager. Vous pouvez utiliser votre téléphone portable ou un autre équipement photo pour prendre des photos, mais vous devez faire attention à la qualité de l'image et à la clarté du son. 2. Editer la vidéo : Afin de rendre le travail plus attrayant, vous pouvez éditer la vidéo. Vous pouvez utiliser un logiciel de montage vidéo professionnel, tel que Douyin, Kuaishou, etc., pour ajouter des filtres, de la musique, des sous-titres et d'autres éléments. 3. Choisissez une couverture : La couverture est la clé pour inciter les utilisateurs à cliquer. Choisissez une image claire et intéressante comme couverture pour inciter les utilisateurs à cliquer dessus.

Le papier Stable Diffusion 3 est enfin publié, et les détails architecturaux sont révélés. Cela aidera-t-il à reproduire Sora ?

Mar 06, 2024 pm 05:34 PM

Le papier Stable Diffusion 3 est enfin publié, et les détails architecturaux sont révélés. Cela aidera-t-il à reproduire Sora ?

Mar 06, 2024 pm 05:34 PM

L'article de StableDiffusion3 est enfin là ! Ce modèle est sorti il y a deux semaines et utilise la même architecture DiT (DiffusionTransformer) que Sora. Il a fait beaucoup de bruit dès sa sortie. Par rapport à la version précédente, la qualité des images générées par StableDiffusion3 a été considérablement améliorée. Il prend désormais en charge les invites multithèmes, et l'effet d'écriture de texte a également été amélioré et les caractères tronqués n'apparaissent plus. StabilityAI a souligné que StableDiffusion3 est une série de modèles avec des tailles de paramètres allant de 800M à 8B. Cette plage de paramètres signifie que le modèle peut être exécuté directement sur de nombreux appareils portables, réduisant ainsi considérablement l'utilisation de l'IA.