Périphériques technologiques

Périphériques technologiques

IA

IA

CV ouvre l'ère des grands modèles ! Google publie le plus grand ViT de l'histoire : 22 milliards de paramètres, la perception visuelle est proche de celle des humains

CV ouvre l'ère des grands modèles ! Google publie le plus grand ViT de l'histoire : 22 milliards de paramètres, la perception visuelle est proche de celle des humains

CV ouvre l'ère des grands modèles ! Google publie le plus grand ViT de l'histoire : 22 milliards de paramètres, la perception visuelle est proche de celle des humains

Transformer est sans aucun doute le plus grand contributeur à la prospérité du domaine du traitement du langage naturel, et constitue également l'infrastructure des modèles de langage à grande échelle tels que GPT-4.

Cependant, comparé aux dizaines de milliards de paramètres des modèles de langage, le domaine de la vision par ordinateur ne profite pas autant des avantages de Transformer. Actuellement, le plus grand modèle visuel de Transformer, ViT-e, ne compte que 4 milliards de paramètres.

Récemment, Google a publié un article dans lequel des chercheurs proposaient une méthode capable de former de manière efficace et stable des modèles de transformateurs de vision (ViT) à grande échelle, augmentant avec succès le nombre de paramètres ViT à 22 milliards.

Lien papier : https://arxiv.org/abs/2302.05442

Afin de réaliser l'expansion du modèle, ViT-22B combine les fonctionnalités d'autres modèles de langage (tels que le modèle PaLM) L'idée est d'utiliser la normalisation QK pour améliorer la stabilité de la formation et de proposer une nouvelle méthode d'opérations linéaires parallèles asynchrones pour améliorer l'efficacité de la formation et pouvoir s'entraîner sur Cloud TPU avec une efficacité matérielle plus élevée.

Lors de la réalisation d'expériences sur le modèle ViT-22B pour évaluer les performances des tâches en aval, ViT-22B a également montré des capacités similaires aux modèles de langage à grande échelle, c'est-à-dire qu'à mesure que l'échelle du modèle augmente, les performances continuent de s'améliorer.

ViT-22B peut également être utilisé dans PaLM-e. Le grand modèle combiné au modèle de langage peut améliorer considérablement le niveau technique des tâches du robot.

Les chercheurs ont en outre observé d'autres avantages apportés par l'échelle, notamment un meilleur équilibre entre équité et performance, une cohérence avec la perception visuelle humaine en termes de biais forme/texture et une meilleure robustesse.

Architecture du modèle

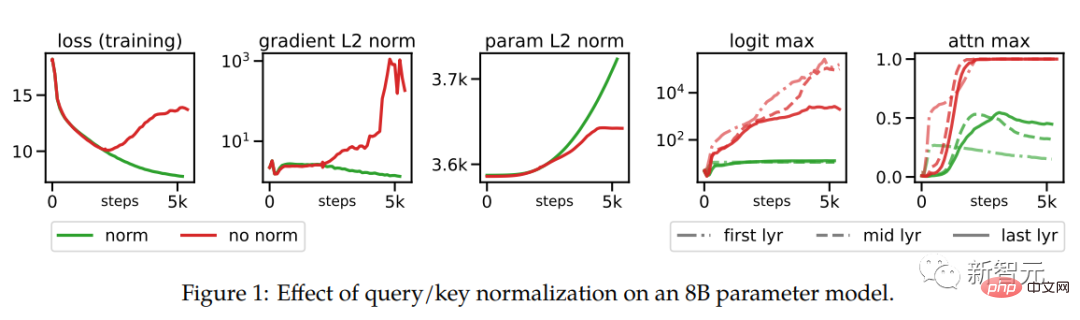

ViT-22B est un modèle basé sur l'architecture Transformer. Par rapport à l'architecture ViT originale, les chercheurs ont principalement apporté trois modifications pour améliorer l'efficacité et la stabilité de la formation.

Couches parallèles

ViT-22B exécute le bloc d'attention et le bloc MLP en parallèle, alors qu'ils sont exécutés séquentiellement dans le Transformer d'origine.

La formation de modèles PaLM utilise également cette méthode, qui peut augmenter la vitesse de formation des grands modèles de 15 % sans dégradation des performances.

normalisation des requêtes/clés (QK)

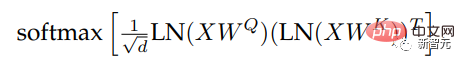

Dans le processus d'extension de ViT, les chercheurs ont observé dans un modèle avec 8 milliards de paramètres que la perte d'entraînement commençait à diverger après quelques milliers d'étapes d'entraînement, principalement. en raison de l'instabilité causée par des valeurs trop élevées de logits d'attention, ce qui entraîne des poids d'attention à entropie nulle (presque one-hot).

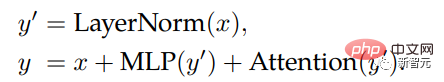

Afin de résoudre ce problème, les chercheurs ont utilisé LayerNorm sur Query et Key avant le calcul de l'attention du produit ponctuel

Les résultats expérimentaux sur le modèle à 8 milliards de paramètres sont présentés dans la figure ci-dessous, la normalisation peut atténuer Problème de divergence.

Supprimer le terme de biais sur la projection QKV et les LayerNorms

Comme le modèle PaLM, ViT-22B supprime le terme de biais de la projection QKV et dans toutes les LayerNorms L'absence de biais et de centrage augmente l'utilisation du matériel de 3% sans aucune dégradation de la qualité.

Cependant, contrairement à PaLM, ViT-22B utilise un terme de biais pour les couches MLP (internes et externes) densément connectées, et on peut observer que la qualité est améliorée et que la vitesse n'est pas réduite.

Dans le module d'encodeur de ViT-22B, la couche d'intégration, y compris les correctifs d'extraction, les projections linéaires et les intégrations de position supplémentaires, sont les mêmes que celles utilisées dans le ViT d'origine, et le regroupement d'attention multi-têtes est utilisé pour agréger par jeton. représentations dans chaque tête.

La taille du patch du ViT-22B est de 14 × 14 et la résolution de l'image est de 224 × 224 (prétraitée par recadrage initial et retournement horizontal aléatoire).

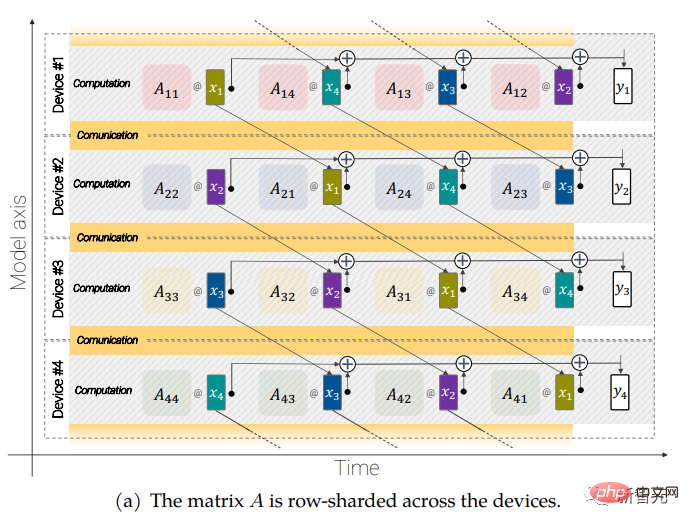

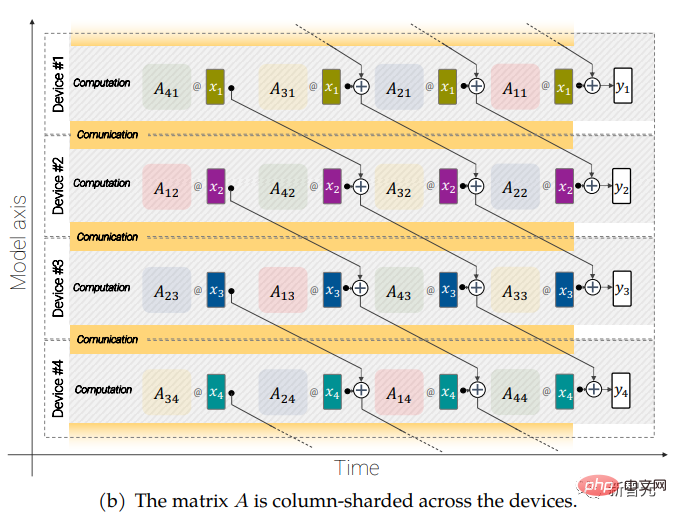

Opérations linéaires parallèles asynchrones

Les modèles à grande échelle nécessitent également un partitionnement, c'est-à-dire que les paramètres du modèle sont répartis entre différents appareils informatiques. De plus, les chercheurs Les activations (représentations intermédiaires de l'entrée) sont également. tranché.

Étant donné que l'entrée et la matrice elle-même sont réparties sur différents appareils, même des opérations simples comme la multiplication matricielle nécessitent une attention particulière.

Les chercheurs ont développé une méthode appelée opérations linéaires parallèles asynchrones qui peut simultanément contrôler les activations et les poids entre les appareils tout en calculant dans l'unité de multiplication matricielle (l'unité qui représente la grande majorité de la puissance de calcul dans la valeur du TPU pour communiquer). .

Les méthodes asynchrones minimisent le temps d'attente pour les communications entrantes, augmentant ainsi l'efficacité de l'appareil.

Le but des opérations linéaires parallèles asynchrones est de calculer la multiplication matricielle y = Ax, mais la matrice A et l'activation x sont distribuées sur différents appareils, ce qui nécessite un chevauchement des communications et des calculs entre les appareils pour y parvenir. La matrice A est répartie en colonnes sur plusieurs appareils. Chaque matrice contient une tranche contiguë, chaque bloc étant représenté par Aij. Voir l'article original pour plus de détails.

Résultats expérimentaux

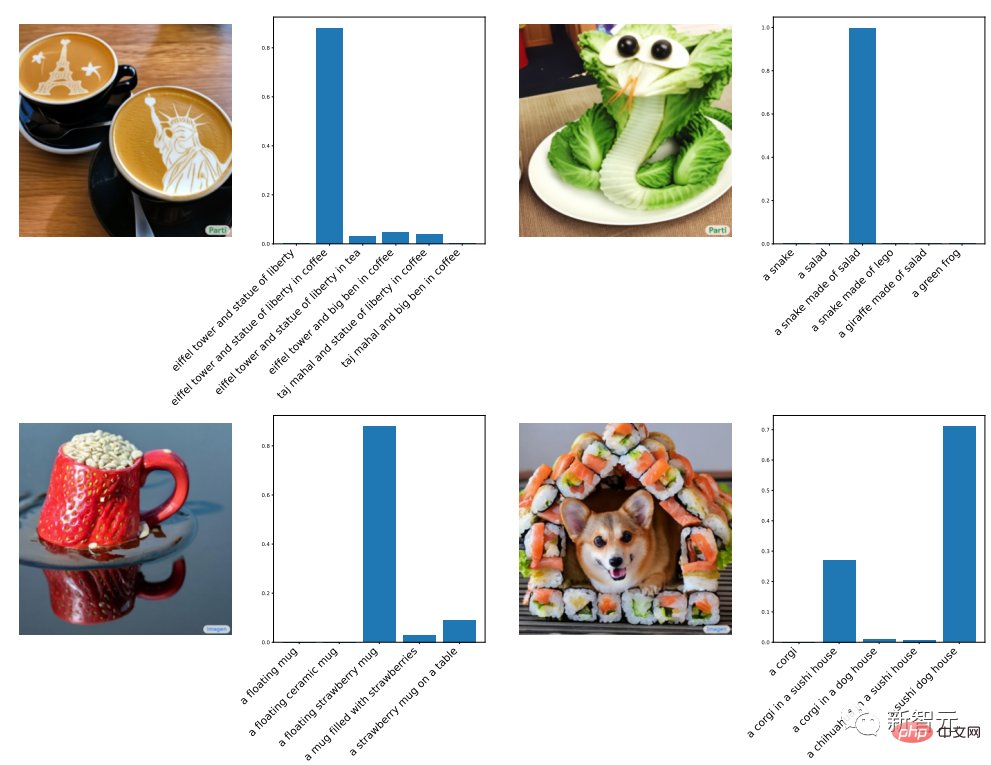

Pour illustrer que les représentations apprises par ViT-22B sont très riches, les chercheurs ont utilisé le réglage LiT pour entraîner un modèle de texte afin de générer des représentations permettant d'aligner le texte et les images.

Voici les résultats expérimentaux obtenus à l'aide d'images non distribuées générées par Parti et Imagen. On peut voir que la capacité de généralisation de la classification d'images zéro du ViT-22B est très forte. web. Les objets et les scènes invisibles peuvent être reconnus à l’aide d’images naturelles.

L'article discute également de l'effet du ViT-22B sur les tâches de classification vidéo, d'estimation de profondeur et de segmentation sémantique.

Aligné avec la reconnaissance d'objets humains

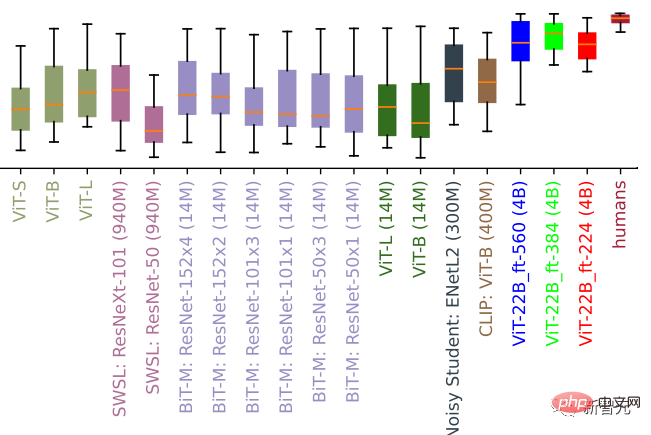

Pour vérifier la cohérence des décisions de classification ViT-22B avec les décisions de classification humaine, les chercheurs ont affiné ViT-22B sur différentes résolutions de l'ensemble de données hors distribution (OOD). -tuning, où les données de comparaison humaine sont disponibles via la boîte à outils modèle contre humain.

Cette boîte à outils mesure principalement trois indicateurs clés : Comment le modèle gère-t-il la distorsion (précision) ? Quelle est la différence entre la précision humaine et celle du modèle (différence de précision) ? Dans quelle mesure les modèles d’erreur (cohérence des erreurs) des personnes et des modèles sont-ils similaires ?

Évaluation des écarts de forme (des valeurs plus grandes représentent plus d'écarts de forme). De nombreux modèles de vision ont un biais de forme faible/texture élevée, et ViT-22B, affiné sur ImageNet, présente le biais de forme le plus élevé enregistré à ce jour parmi les modèles ML, plus proche du biais de forme humaine

Les résultats expérimentaux montrent que même si Non toutes les solutions affinées ont bien fonctionné, mais la variante ViT-22B a atteint de nouveaux sommets dans les trois paramètres.

De plus, le modèle ViT-22B possède également le record d'écart de forme le plus élevé parmi les modèles visuels. Cela signifie qu'ils utilisent principalement la forme de l'objet plutôt que la texture de l'objet pour prendre des décisions de classification, et les résultats de la stratégie sont similaires à la perception humaine (son biais de forme est de 96 %).

Les modèles standard (par exemple, ResNet-50 a un biais de forme de 20 à 30 %) sont souvent classés en fonction de la texture, tandis que les modèles avec un biais de forme élevé ont tendance à se concentrer sur la forme (identifiée comme un chat dans l'image ci-dessous), bien que les humains et modèles Il existe encore de nombreuses différences dans la perception, mais ViT-22B montre davantage de similitudes avec la reconnaissance visuelle humaine des objets.

Chat ou éléphant ? Voiture ou horloge ? Oiseau ou vélo ? Les images avec la forme d'un objet et la texture d'un autre objet différent peuvent être utilisées pour mesurer l'écart de forme/texture

performances hors distribution

Mesurer les performances de l'ensemble de données OOD permet d'évaluer la généralisabilité du modèle.

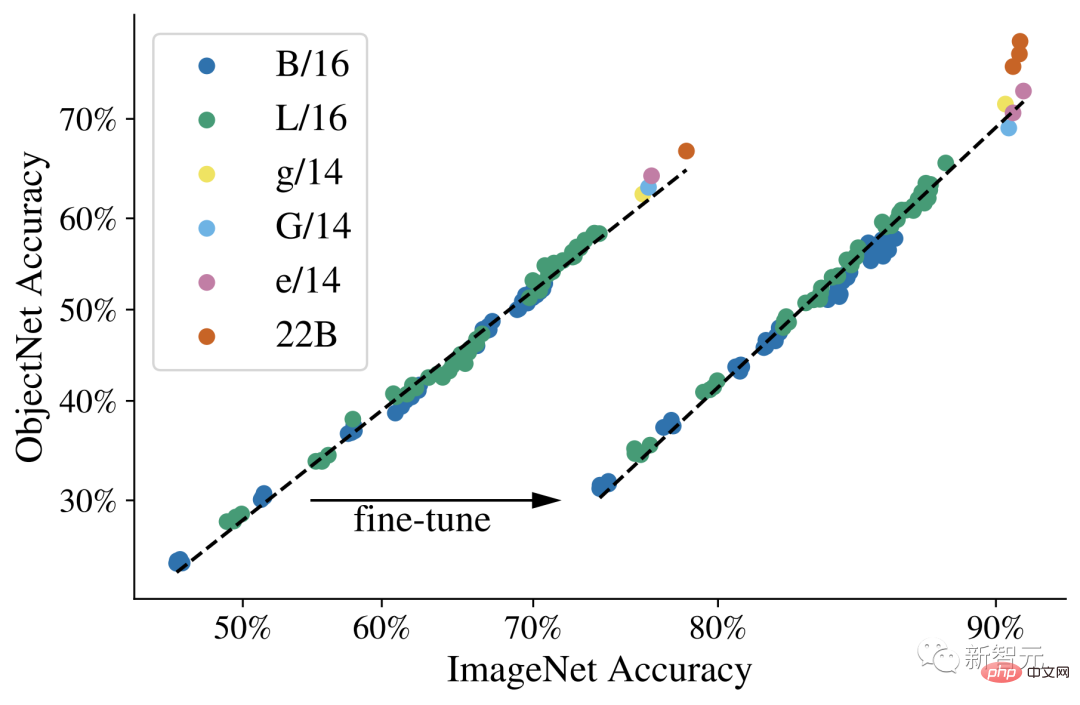

Dans cette expérience, les chercheurs ont construit des mappages d'étiquettes de JFT vers ImageNet, et d'ImageNet vers différents ensembles de données hors distribution tels qu'ObjectNet.

Les résultats après pré-entraînement sur ces données sont présentés dans la figure ci-dessous, puis le modèle est entièrement affiné sur ImageNet.

On peut observer que la mise à l'échelle des transformateurs de vision peut améliorer les performances OOD : même si la précision d'ImageNet atteint la saturation, on peut voir que le passage du modèle ViT-e au modèle ViT-22B sur ObjectNet peut améliorer considérablement la performance.

Sonde linéaire

La sonde linéaire est une technique qui place une seule couche linéaire au-dessus d'un modèle gelé, ce qui la rend moins coûteuse à entraîner et plus facile à configurer qu'un réglage fin complet.

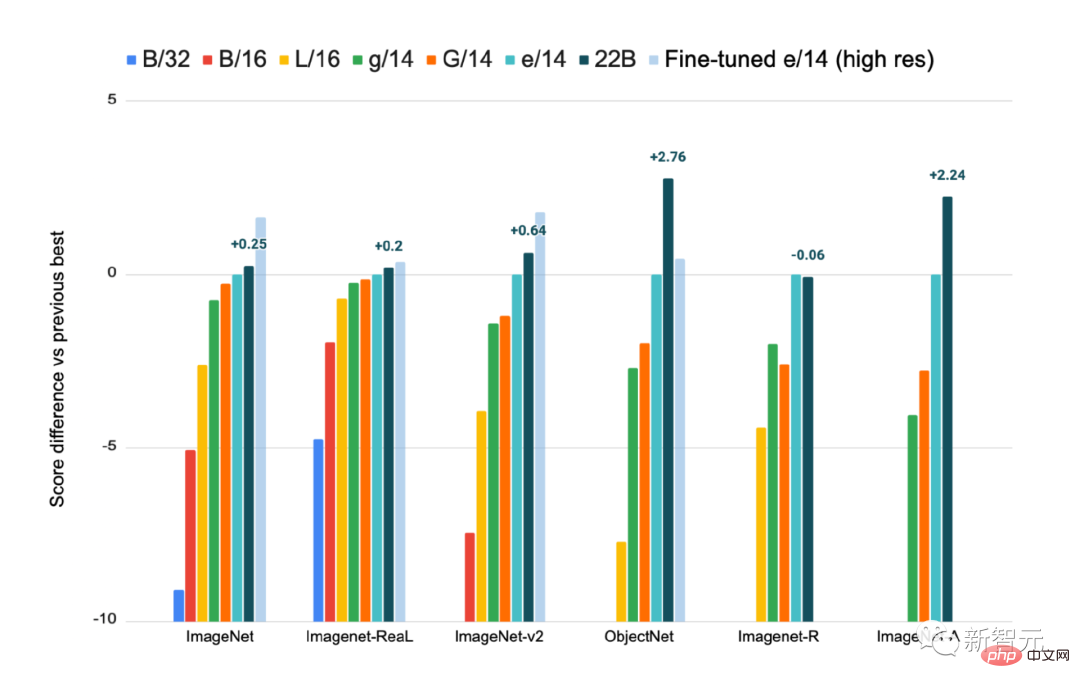

Résultats de détection linéaire formés sur ImageNet, évalués sur les ensembles de données ImageNet-Real, ImageNet-v2, ObjectNet, ImageNet-R et ImageNet-A, fournissant une haute résolution ViT-e/14 affinée pour référence

On peut observer à partir des résultats que les performances de détection linéaire du ViT-22B sont proches de l'état de l'art en matière de réglage entièrement fin de modèles plus petits à l'aide d'images haute résolution, où l'entraînement avec des résolutions plus élevées est généralement beaucoup plus cher, mais permet d'obtenir de meilleurs résultats sur de nombreuses tâches.

Distillation

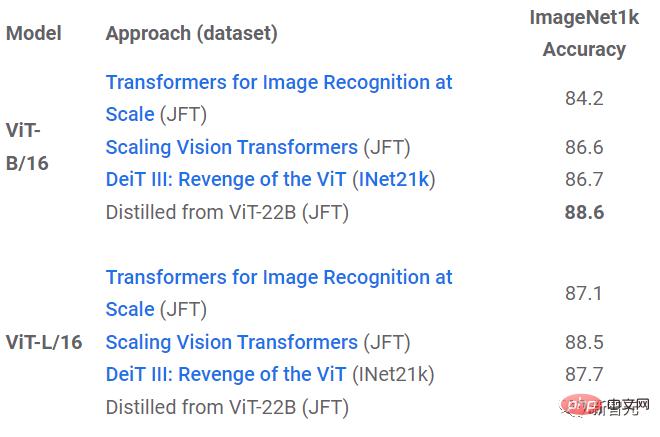

En utilisant la méthode de distillation, la connaissance d'un modèle plus grand peut être convertie en connaissance d'un modèle plus petit, ce qui peut améliorer l'efficacité opérationnelle des grands modèles qui sont plus chers et fonctionnent plus lentement.

Il ressort des résultats expérimentaux que les connaissances du ViT-22B peuvent être transférées à des modèles plus petits, tels que le ViT-B/16 et le ViT-L/16, et actualisées sur ImageNet en même temps. enregistrements de performances de taille de modèle.

Équité et biais

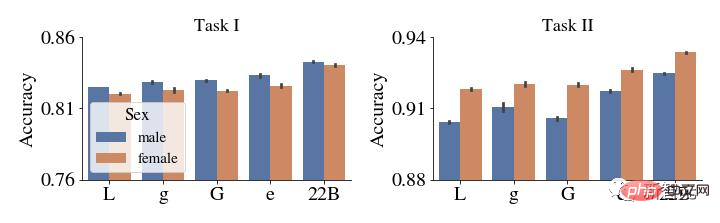

Les modèles d'apprentissage automatique sont sensibles à des biais injustes involontaires, tels que la recherche de mauvaises corrélations ou des écarts de performances entre sous-groupes, et les chercheurs ont découvert que la mise à l'échelle des modèles peut aider à atténuer ces problèmes.

Tout d'abord, l'échelle est un compromis prometteur Même si le modèle est entraîné puis post-traité pour contrôler son niveau de parité démographique en dessous d'un niveau prescrit et tolérable, les performances augmenteront avec le temps. l’augmentation d’échelle.

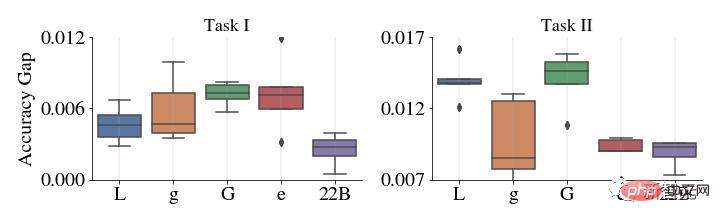

Ci-dessus : Précision de chaque sous-groupe dans CelebA avant le débiaisation. Ci-dessous : l'axe des y montre la différence absolue de performance pour les deux sous-groupes spécifiques mis en évidence dans cet exemple (femmes et hommes). Par rapport au modèle ViT plus petit, l’écart de performances du ViT-22B est très faible.

Plus important encore, cela est vrai non seulement lorsque la performance est mesurée en termes de précision, mais également pour d'autres mesures telles que l'étalonnage, c'est-à-dire une mesure statistique de la véracité des probabilités estimées du modèle, avec tous les sous-groupes classés comme It a tendance à s'améliorer avec l'augmentation de l'échelle, et ViT-22B réduit l'écart de performances entre les sous-groupes.

Conclusion

Les chercheurs ont proposé l'un des plus grands modèles de transformateur visuel actuellement, le ViT-22B, contenant 22 milliards de paramètres.

En apportant des modifications mineures mais clés à l'architecture du modèle d'origine, une utilisation matérielle et une stabilité de formation plus élevées sont obtenues, ce qui aboutit à un modèle qui améliore les performances de la limite supérieure sur plusieurs benchmarks.

En utilisant des modèles gelés pour générer des intégrations, en n'ayant besoin que de former quelques couches au-dessus, on peut obtenir de très bonnes performances, et les résultats de l'évaluation montrent en outre que ViT-22B présente un biais de forme et de texture significatif par rapport aux modèles existants. Une plus grande similarité à la perception visuelle humaine et offre des avantages en termes d'équité et de robustesse.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Le modèle MoE open source le plus puissant au monde est ici, avec des capacités chinoises comparables à celles du GPT-4, et le prix ne représente que près d'un pour cent de celui du GPT-4-Turbo.

May 07, 2024 pm 04:13 PM

Le modèle MoE open source le plus puissant au monde est ici, avec des capacités chinoises comparables à celles du GPT-4, et le prix ne représente que près d'un pour cent de celui du GPT-4-Turbo.

May 07, 2024 pm 04:13 PM

Imaginez un modèle d'intelligence artificielle qui non seulement a la capacité de surpasser l'informatique traditionnelle, mais qui permet également d'obtenir des performances plus efficaces à moindre coût. Ce n'est pas de la science-fiction, DeepSeek-V2[1], le modèle MoE open source le plus puissant au monde est ici. DeepSeek-V2 est un puissant mélange de modèle de langage d'experts (MoE) présentant les caractéristiques d'une formation économique et d'une inférence efficace. Il est constitué de 236B paramètres, dont 21B servent à activer chaque marqueur. Par rapport à DeepSeek67B, DeepSeek-V2 offre des performances plus élevées, tout en économisant 42,5 % des coûts de formation, en réduisant le cache KV de 93,3 % et en augmentant le débit de génération maximal à 5,76 fois. DeepSeek est une entreprise explorant l'intelligence artificielle générale

Bonjour, Atlas électrique ! Le robot Boston Dynamics revient à la vie, des mouvements étranges à 180 degrés effraient Musk

Apr 18, 2024 pm 07:58 PM

Bonjour, Atlas électrique ! Le robot Boston Dynamics revient à la vie, des mouvements étranges à 180 degrés effraient Musk

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas entre officiellement dans l’ère des robots électriques ! Hier, l'Atlas hydraulique s'est retiré "en larmes" de la scène de l'histoire. Aujourd'hui, Boston Dynamics a annoncé que l'Atlas électrique était au travail. Il semble que dans le domaine des robots humanoïdes commerciaux, Boston Dynamics soit déterminé à concurrencer Tesla. Après la sortie de la nouvelle vidéo, elle a déjà été visionnée par plus d’un million de personnes en seulement dix heures. Les personnes âgées partent et de nouveaux rôles apparaissent. C'est une nécessité historique. Il ne fait aucun doute que cette année est l’année explosive des robots humanoïdes. Les internautes ont commenté : Les progrès des robots ont fait ressembler la cérémonie d'ouverture de cette année à des êtres humains, et le degré de liberté est bien plus grand que celui des humains. Mais n'est-ce vraiment pas un film d'horreur ? Au début de la vidéo, Atlas est allongé calmement sur le sol, apparemment sur le dos. Ce qui suit est à couper le souffle

L'IA bouleverse la recherche mathématique ! Le lauréat de la médaille Fields et mathématicien sino-américain a dirigé 11 articles les mieux classés | Aimé par Terence Tao

Apr 09, 2024 am 11:52 AM

L'IA bouleverse la recherche mathématique ! Le lauréat de la médaille Fields et mathématicien sino-américain a dirigé 11 articles les mieux classés | Aimé par Terence Tao

Apr 09, 2024 am 11:52 AM

L’IA change effectivement les mathématiques. Récemment, Tao Zhexuan, qui a prêté une attention particulière à cette question, a transmis le dernier numéro du « Bulletin de l'American Mathematical Society » (Bulletin de l'American Mathematical Society). En se concentrant sur le thème « Les machines changeront-elles les mathématiques ? », de nombreux mathématiciens ont exprimé leurs opinions. L'ensemble du processus a été plein d'étincelles, intense et passionnant. L'auteur dispose d'une équipe solide, comprenant Akshay Venkatesh, lauréat de la médaille Fields, le mathématicien chinois Zheng Lejun, l'informaticien de l'Université de New York Ernest Davis et de nombreux autres universitaires bien connus du secteur. Le monde de l’IA a radicalement changé. Vous savez, bon nombre de ces articles ont été soumis il y a un an.

KAN, qui remplace MLP, a été étendu à la convolution par des projets open source

Jun 01, 2024 pm 10:03 PM

KAN, qui remplace MLP, a été étendu à la convolution par des projets open source

Jun 01, 2024 pm 10:03 PM

Plus tôt ce mois-ci, des chercheurs du MIT et d'autres institutions ont proposé une alternative très prometteuse au MLP – KAN. KAN surpasse MLP en termes de précision et d’interprétabilité. Et il peut surpasser le MLP fonctionnant avec un plus grand nombre de paramètres avec un très petit nombre de paramètres. Par exemple, les auteurs ont déclaré avoir utilisé KAN pour reproduire les résultats de DeepMind avec un réseau plus petit et un degré d'automatisation plus élevé. Plus précisément, le MLP de DeepMind compte environ 300 000 paramètres, tandis que le KAN n'en compte qu'environ 200. KAN a une base mathématique solide comme MLP est basé sur le théorème d'approximation universelle, tandis que KAN est basé sur le théorème de représentation de Kolmogorov-Arnold. Comme le montre la figure ci-dessous, KAN a

Google est ravi : les performances de JAX surpassent Pytorch et TensorFlow ! Cela pourrait devenir le choix le plus rapide pour la formation à l'inférence GPU

Apr 01, 2024 pm 07:46 PM

Google est ravi : les performances de JAX surpassent Pytorch et TensorFlow ! Cela pourrait devenir le choix le plus rapide pour la formation à l'inférence GPU

Apr 01, 2024 pm 07:46 PM

Les performances de JAX, promu par Google, ont dépassé celles de Pytorch et TensorFlow lors de récents tests de référence, se classant au premier rang sur 7 indicateurs. Et le test n’a pas été fait sur le TPU présentant les meilleures performances JAX. Bien que parmi les développeurs, Pytorch soit toujours plus populaire que Tensorflow. Mais à l’avenir, des modèles plus volumineux seront peut-être formés et exécutés sur la base de la plate-forme JAX. Modèles Récemment, l'équipe Keras a comparé trois backends (TensorFlow, JAX, PyTorch) avec l'implémentation native de PyTorch et Keras2 avec TensorFlow. Premièrement, ils sélectionnent un ensemble de

Nouveaux travaux sur la prédiction de séries chronologiques + grand modèle NLP : générer automatiquement des invites implicites pour la prédiction de séries chronologiques

Mar 18, 2024 am 09:20 AM

Nouveaux travaux sur la prédiction de séries chronologiques + grand modèle NLP : générer automatiquement des invites implicites pour la prédiction de séries chronologiques

Mar 18, 2024 am 09:20 AM

Aujourd'hui, j'aimerais partager un travail de recherche récent de l'Université du Connecticut qui propose une méthode pour aligner les données de séries chronologiques avec de grands modèles de traitement du langage naturel (NLP) sur l'espace latent afin d'améliorer les performances de prévision des séries chronologiques. La clé de cette méthode consiste à utiliser des indices spatiaux latents (invites) pour améliorer la précision des prévisions de séries chronologiques. Titre de l'article : S2IP-LLM : SemanticSpaceInformedPromptLearningwithLLMforTimeSeriesForecasting Adresse de téléchargement : https://arxiv.org/pdf/2403.05798v1.pdf 1. Modèle de fond de problème important

Les robots Tesla travaillent dans les usines, Musk : Le degré de liberté des mains atteindra 22 cette année !

May 06, 2024 pm 04:13 PM

Les robots Tesla travaillent dans les usines, Musk : Le degré de liberté des mains atteindra 22 cette année !

May 06, 2024 pm 04:13 PM

La dernière vidéo du robot Optimus de Tesla est sortie, et il peut déjà fonctionner en usine. À vitesse normale, il trie les batteries (les batteries 4680 de Tesla) comme ceci : Le responsable a également publié à quoi cela ressemble à une vitesse 20 fois supérieure - sur un petit "poste de travail", en sélectionnant et en sélectionnant et en sélectionnant : Cette fois, il est publié L'un des points forts de la vidéo est qu'Optimus réalise ce travail en usine, de manière totalement autonome, sans intervention humaine tout au long du processus. Et du point de vue d'Optimus, il peut également récupérer et placer la batterie tordue, en se concentrant sur la correction automatique des erreurs : concernant la main d'Optimus, le scientifique de NVIDIA Jim Fan a donné une évaluation élevée : la main d'Optimus est l'un des robots à cinq doigts du monde. le plus adroit. Ses mains ne sont pas seulement tactiles

DualBEV : dépassant largement BEVFormer et BEVDet4D, ouvrez le livre !

Mar 21, 2024 pm 05:21 PM

DualBEV : dépassant largement BEVFormer et BEVDet4D, ouvrez le livre !

Mar 21, 2024 pm 05:21 PM

Cet article explore le problème de la détection précise d'objets sous différents angles de vue (tels que la perspective et la vue à vol d'oiseau) dans la conduite autonome, en particulier comment transformer efficacement les caractéristiques de l'espace en perspective (PV) en vue à vol d'oiseau (BEV). implémenté via le module Visual Transformation (VT). Les méthodes existantes sont globalement divisées en deux stratégies : la conversion 2D en 3D et la conversion 3D en 2D. Les méthodes 2D vers 3D améliorent les caractéristiques 2D denses en prédisant les probabilités de profondeur, mais l'incertitude inhérente aux prévisions de profondeur, en particulier dans les régions éloignées, peut introduire des inexactitudes. Alors que les méthodes 3D vers 2D utilisent généralement des requêtes 3D pour échantillonner des fonctionnalités 2D et apprendre les poids d'attention de la correspondance entre les fonctionnalités 3D et 2D via un transformateur, ce qui augmente le temps de calcul et de déploiement.