Périphériques technologiques

Périphériques technologiques

IA

IA

13 milliards de paramètres, 8 formations A100, l'UC Berkeley publie le modèle de dialogue Koala

13 milliards de paramètres, 8 formations A100, l'UC Berkeley publie le modèle de dialogue Koala

13 milliards de paramètres, 8 formations A100, l'UC Berkeley publie le modèle de dialogue Koala

Depuis que Meta a publié et open source la série de modèles LLaMA, des chercheurs de l'Université de Stanford, de l'UC Berkeley et d'autres institutions ont réalisé une "seconde création" sur la base de LLaMA, et ont lancé successivement plusieurs modèles "alpaga" tels que Alpaca et Vicuna. . Modèle.

Alpaca est devenu le nouvel acteur incontournable de la communauté open source. En raison de l'abondance de « créations secondaires », les mots anglais désignant le genre biologique de l'alpaga sont presque hors d'usage, mais il est également possible de nommer le grand modèle d'après d'autres animaux.

Récemment, le Berkeley Artificial Intelligence Institute (BAIR) de l'UC Berkeley a publié un modèle de conversation Koala (traduit littéralement par Koala) qui peut fonctionner sur des GPU grand public. Koala affine le modèle LLaMA à l'aide des données de conversation collectées sur le Web.

Project Adresse: https: //bair.berkeley.edu/blog/2023/04/03/koala/

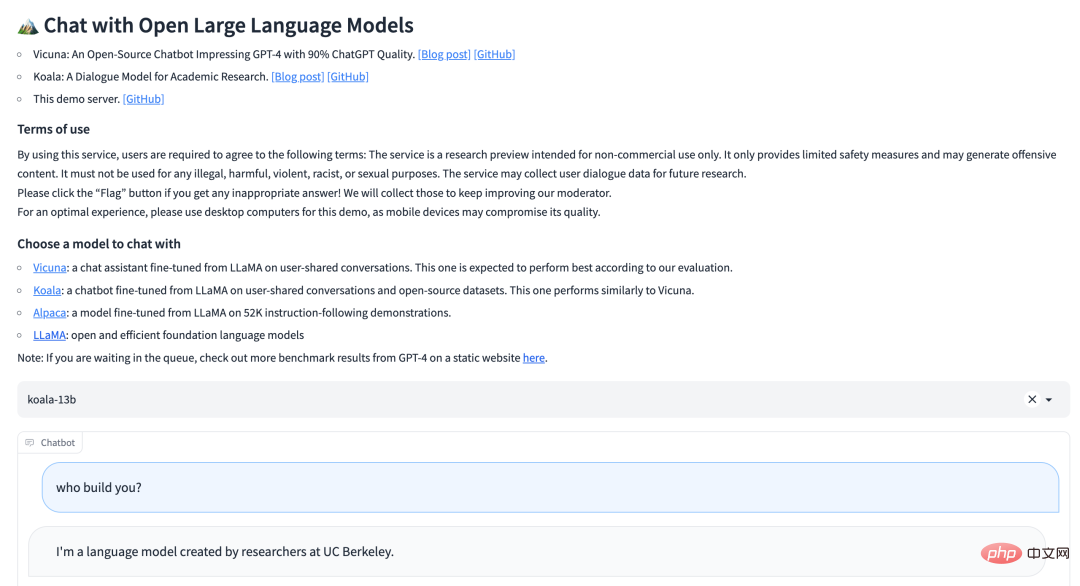

koala a lancé une démo de test en ligne:

- Adresse de démonstration : https://chat.lmsys.org/?model=koala-13b

- Adresse open source : https://github.com/young-geng/EasyLM

Présentation de Koala

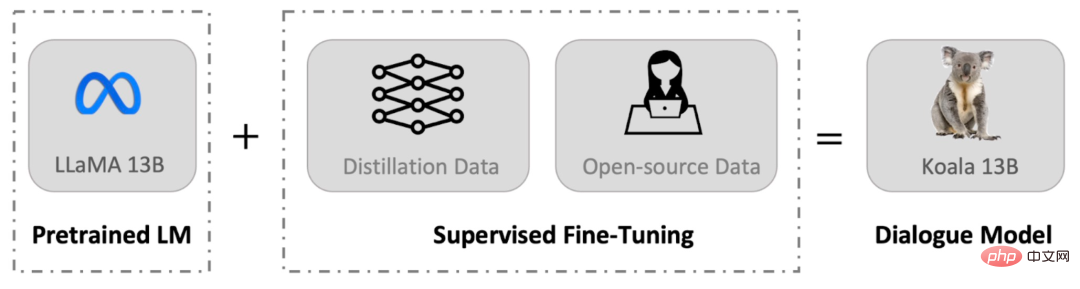

Semblable à Vicuna, Koala affine également le modèle LLaMA en utilisant les données de conversation collectées sur le Web, en mettant l'accent sur les données publiques sur les conversations avec de grands modèles à source fermée tels que ChatGPT.

L'équipe de recherche a déclaré que le modèle Koala est implémenté dans EasyLM à l'aide de JAX/Flax et que le modèle Koala est formé sur un seul serveur Nvidia DGX équipé de 8 GPU A100. Il faut 6 heures pour compléter 2 époques de formation. Le coût d’une telle formation est généralement inférieur à 100 $ sur les plateformes de cloud computing public.

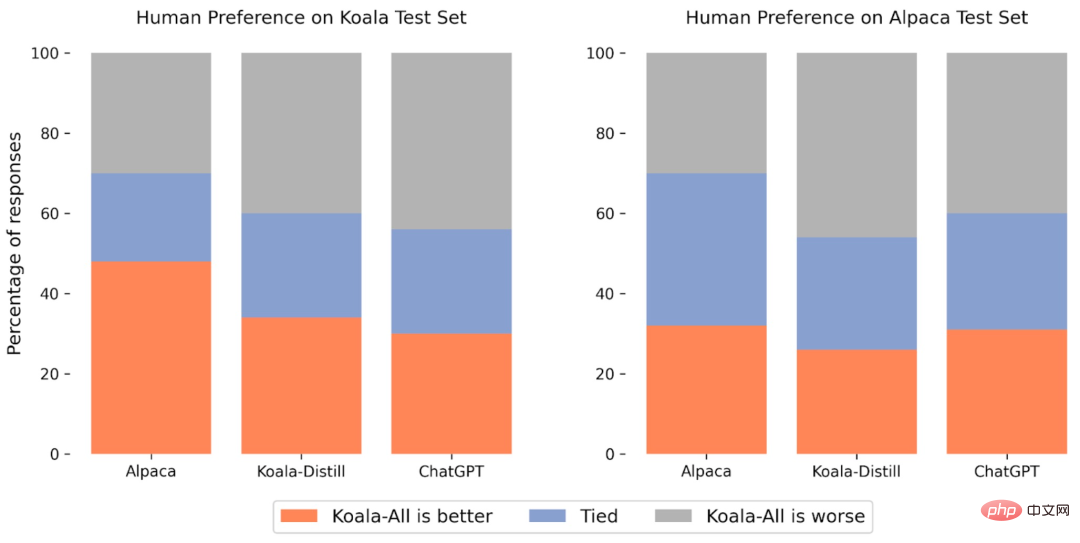

L'équipe de recherche a comparé expérimentalement Koala avec ChatGPT et Alpaca de l'Université de Stanford. Les résultats ont montré que : Koala-13B avec 13 milliards de paramètres peut répondre efficacement à diverses requêtes des utilisateurs, et les réponses générées sont généralement meilleures que celles d'Alpaca, et en termes de performances. est comparable à ChatGPT dans plus de la moitié des cas.

L'importance la plus importante de Koala est qu'il montre qu'en s'entraînant sur un ensemble de données de meilleure qualité, un modèle suffisamment petit pour être exécuté localement peut également atteindre d'excellentes performances similaires à celles d'un grand modèle. Cela signifie que la communauté open source devrait travailler plus dur pour conserver des ensembles de données de haute qualité, car cela pourrait conduire à des modèles plus sûrs, plus réalistes et plus puissants que la simple augmentation de la taille des systèmes existants. De ce point de vue, Koala est une alternative petite mais raffinée à ChatGPT.

Cependant, Koala n'est encore qu'un prototype de recherche et présente encore des défauts majeurs en termes de contenu, de sécurité et de fiabilité, et ne doit pas être utilisé à d'autres fins que la recherche.

Ensembles de données et formation

Le principal obstacle à la création d'un modèle de conversation est la gestion des données de formation. Les grands modèles de conversation tels que ChatGPT, Bard, Bing Chat et Claude utilisent tous des ensembles de données propriétaires avec de nombreuses annotations humaines. Pour créer l'ensemble de données de formation de Koala, l'équipe de recherche a collecté et organisé des données de conversation à partir du Web et des ensembles de données publics, qui contiennent des données partagées publiquement par les utilisateurs parlant à de grands modèles de langage tels que ChatGPT.

Contrairement à d'autres modèles qui explorent autant de données Web que possible pour maximiser l'ensemble de données, Koala se concentre sur la collecte de petits ensembles de données de haute qualité, y compris des sections de questions et réponses dans des ensembles de données publics, des commentaires humains (positifs et négatifs) et des conversations avec des utilisateurs existants. modèles de langage. Plus précisément, l'ensemble de données de formation de Koala comprend les parties suivantes :

Données distillées ChatGPT :

- Données de conversation accessibles au public avec ChatGPT (ShareGPT)

- Corpus de comparaison Human ChatGPT (HC3), où les deux ; les réponses humaines et ChatGPT de l’ensemble de données HC3 sont utilisées.

Données open source :

- Open Instruction Generalist (OIG) ;

- Ensemble de données utilisé par le modèle Stanford Alpaca ;

- Résumé OpenAI ;

- Expérimentation et évaluation

- Cette étude a mené une évaluation manuelle pour comparer les résultats de génération de Koala-All avec Koala-Distill, Alpaca et ChatGPT. Les résultats sont présentés dans la figure ci-dessous. Parmi eux, deux ensembles de données différents sont utilisés pour les tests, l'un est l'ensemble de tests Alpaca de Stanford, qui comprend 180 requêtes de test (Alpaca Test Set), et l'autre est l'ensemble de tests Koala.

Dans l'ensemble, le modèle Koala est suffisant pour démontrer de nombreuses capacités de LLM, tout en étant suffisamment petit pour faciliter un réglage précis ou une utilisation avec des ressources informatiques limitées. L'équipe de recherche espère que le modèle Koala deviendra une plate-forme utile pour les futures recherches universitaires sur les modèles de langage à grande échelle. Les applications potentielles de la recherche pourraient inclure :

Sécurité et alignement : Koala permet de poursuivre les recherches sur la sécurité des modèles de langage. et s'aligne mieux sur les intentions humaines. Soyez cohérent.

Sécurité et alignement : Koala permet de poursuivre les recherches sur la sécurité des modèles de langage. et s'aligne mieux sur les intentions humaines. Soyez cohérent.

Biais de modèle : Koala nous permet de mieux comprendre les biais dans les grands modèles de langage, d'approfondir les problèmes de qualité dans les ensembles de données de dialogue et, en fin de compte, de contribuer à améliorer les performances des grands modèles de langage.

- Comprendre les grands modèles de langage : étant donné que les modèles Koala peuvent fonctionner sur des GPU grand public relativement bon marché et effectuer une variété de tâches, Koala nous permet de mieux examiner et comprendre la structure interne des modèles de langage conversationnel, rendant les modèles de langage plus explicables.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Sujets chauds

1359

1359

52

52

Open source! Au-delà de ZoeDepth ! DepthFM : estimation rapide et précise de la profondeur monoculaire !

Apr 03, 2024 pm 12:04 PM

Open source! Au-delà de ZoeDepth ! DepthFM : estimation rapide et précise de la profondeur monoculaire !

Apr 03, 2024 pm 12:04 PM

0. À quoi sert cet article ? Nous proposons DepthFM : un modèle d'estimation de profondeur monoculaire génératif de pointe, polyvalent et rapide. En plus des tâches traditionnelles d'estimation de la profondeur, DepthFM démontre également des capacités de pointe dans les tâches en aval telles que l'inpainting en profondeur. DepthFM est efficace et peut synthétiser des cartes de profondeur en quelques étapes d'inférence. Lisons ce travail ensemble ~ 1. Titre des informations sur l'article : DepthFM : FastMonocularDepthEstimationwithFlowMatching Auteur : MingGui, JohannesS.Fischer, UlrichPrestel, PingchuanMa, Dmytr

Le modèle MoE open source le plus puissant au monde est ici, avec des capacités chinoises comparables à celles du GPT-4, et le prix ne représente que près d'un pour cent de celui du GPT-4-Turbo.

May 07, 2024 pm 04:13 PM

Le modèle MoE open source le plus puissant au monde est ici, avec des capacités chinoises comparables à celles du GPT-4, et le prix ne représente que près d'un pour cent de celui du GPT-4-Turbo.

May 07, 2024 pm 04:13 PM

Imaginez un modèle d'intelligence artificielle qui non seulement a la capacité de surpasser l'informatique traditionnelle, mais qui permet également d'obtenir des performances plus efficaces à moindre coût. Ce n'est pas de la science-fiction, DeepSeek-V2[1], le modèle MoE open source le plus puissant au monde est ici. DeepSeek-V2 est un puissant mélange de modèle de langage d'experts (MoE) présentant les caractéristiques d'une formation économique et d'une inférence efficace. Il est constitué de 236B paramètres, dont 21B servent à activer chaque marqueur. Par rapport à DeepSeek67B, DeepSeek-V2 offre des performances plus élevées, tout en économisant 42,5 % des coûts de formation, en réduisant le cache KV de 93,3 % et en augmentant le débit de génération maximal à 5,76 fois. DeepSeek est une entreprise explorant l'intelligence artificielle générale

Bonjour, Atlas électrique ! Le robot Boston Dynamics revient à la vie, des mouvements étranges à 180 degrés effraient Musk

Apr 18, 2024 pm 07:58 PM

Bonjour, Atlas électrique ! Le robot Boston Dynamics revient à la vie, des mouvements étranges à 180 degrés effraient Musk

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas entre officiellement dans l’ère des robots électriques ! Hier, l'Atlas hydraulique s'est retiré "en larmes" de la scène de l'histoire. Aujourd'hui, Boston Dynamics a annoncé que l'Atlas électrique était au travail. Il semble que dans le domaine des robots humanoïdes commerciaux, Boston Dynamics soit déterminé à concurrencer Tesla. Après la sortie de la nouvelle vidéo, elle a déjà été visionnée par plus d’un million de personnes en seulement dix heures. Les personnes âgées partent et de nouveaux rôles apparaissent. C'est une nécessité historique. Il ne fait aucun doute que cette année est l’année explosive des robots humanoïdes. Les internautes ont commenté : Les progrès des robots ont fait ressembler la cérémonie d'ouverture de cette année à des êtres humains, et le degré de liberté est bien plus grand que celui des humains. Mais n'est-ce vraiment pas un film d'horreur ? Au début de la vidéo, Atlas est allongé calmement sur le sol, apparemment sur le dos. Ce qui suit est à couper le souffle

KAN, qui remplace MLP, a été étendu à la convolution par des projets open source

Jun 01, 2024 pm 10:03 PM

KAN, qui remplace MLP, a été étendu à la convolution par des projets open source

Jun 01, 2024 pm 10:03 PM

Plus tôt ce mois-ci, des chercheurs du MIT et d'autres institutions ont proposé une alternative très prometteuse au MLP – KAN. KAN surpasse MLP en termes de précision et d’interprétabilité. Et il peut surpasser le MLP fonctionnant avec un plus grand nombre de paramètres avec un très petit nombre de paramètres. Par exemple, les auteurs ont déclaré avoir utilisé KAN pour reproduire les résultats de DeepMind avec un réseau plus petit et un degré d'automatisation plus élevé. Plus précisément, le MLP de DeepMind compte environ 300 000 paramètres, tandis que le KAN n'en compte qu'environ 200. KAN a une base mathématique solide comme MLP est basé sur le théorème d'approximation universelle, tandis que KAN est basé sur le théorème de représentation de Kolmogorov-Arnold. Comme le montre la figure ci-dessous, KAN a

L'IA bouleverse la recherche mathématique ! Le lauréat de la médaille Fields et mathématicien sino-américain a dirigé 11 articles les mieux classés | Aimé par Terence Tao

Apr 09, 2024 am 11:52 AM

L'IA bouleverse la recherche mathématique ! Le lauréat de la médaille Fields et mathématicien sino-américain a dirigé 11 articles les mieux classés | Aimé par Terence Tao

Apr 09, 2024 am 11:52 AM

L’IA change effectivement les mathématiques. Récemment, Tao Zhexuan, qui a prêté une attention particulière à cette question, a transmis le dernier numéro du « Bulletin de l'American Mathematical Society » (Bulletin de l'American Mathematical Society). En se concentrant sur le thème « Les machines changeront-elles les mathématiques ? », de nombreux mathématiciens ont exprimé leurs opinions. L'ensemble du processus a été plein d'étincelles, intense et passionnant. L'auteur dispose d'une équipe solide, comprenant Akshay Venkatesh, lauréat de la médaille Fields, le mathématicien chinois Zheng Lejun, l'informaticien de l'Université de New York Ernest Davis et de nombreux autres universitaires bien connus du secteur. Le monde de l’IA a radicalement changé. Vous savez, bon nombre de ces articles ont été soumis il y a un an.

La vitalité de la super intelligence s'éveille ! Mais avec l'arrivée de l'IA qui se met à jour automatiquement, les mères n'ont plus à se soucier des goulots d'étranglement des données.

Apr 29, 2024 pm 06:55 PM

La vitalité de la super intelligence s'éveille ! Mais avec l'arrivée de l'IA qui se met à jour automatiquement, les mères n'ont plus à se soucier des goulots d'étranglement des données.

Apr 29, 2024 pm 06:55 PM

Je pleure à mort. Le monde construit à la folie de grands modèles. Les données sur Internet ne suffisent pas du tout. Le modèle de formation ressemble à « The Hunger Games », et les chercheurs en IA du monde entier se demandent comment nourrir ces personnes avides de données. Ce problème est particulièrement important dans les tâches multimodales. À une époque où rien ne pouvait être fait, une équipe de start-up du département de l'Université Renmin de Chine a utilisé son propre nouveau modèle pour devenir la première en Chine à faire de « l'auto-alimentation des données générées par le modèle » une réalité. De plus, il s’agit d’une approche à deux volets, du côté compréhension et du côté génération, les deux côtés peuvent générer de nouvelles données multimodales de haute qualité et fournir un retour de données au modèle lui-même. Qu'est-ce qu'un modèle ? Awaker 1.0, un grand modèle multimodal qui vient d'apparaître sur le Forum Zhongguancun. Qui est l'équipe ? Moteur Sophon. Fondé par Gao Yizhao, doctorant à la Hillhouse School of Artificial Intelligence de l’Université Renmin.

La version Kuaishou de Sora 'Ke Ling' est ouverte aux tests : génère plus de 120 s de vidéo, comprend mieux la physique et peut modéliser avec précision des mouvements complexes

Jun 11, 2024 am 09:51 AM

La version Kuaishou de Sora 'Ke Ling' est ouverte aux tests : génère plus de 120 s de vidéo, comprend mieux la physique et peut modéliser avec précision des mouvements complexes

Jun 11, 2024 am 09:51 AM

Quoi? Zootopie est-elle concrétisée par l’IA domestique ? Avec la vidéo est exposé un nouveau modèle de génération vidéo domestique à grande échelle appelé « Keling ». Sora utilise une voie technique similaire et combine un certain nombre d'innovations technologiques auto-développées pour produire des vidéos qui comportent non seulement des mouvements larges et raisonnables, mais qui simulent également les caractéristiques du monde physique et possèdent de fortes capacités de combinaison conceptuelle et d'imagination. Selon les données, Keling prend en charge la génération de vidéos ultra-longues allant jusqu'à 2 minutes à 30 ips, avec des résolutions allant jusqu'à 1080p, et prend en charge plusieurs formats d'image. Un autre point important est que Keling n'est pas une démo ou une démonstration de résultats vidéo publiée par le laboratoire, mais une application au niveau produit lancée par Kuaishou, un acteur leader dans le domaine de la vidéo courte. De plus, l'objectif principal est d'être pragmatique, de ne pas faire de chèques en blanc et de se mettre en ligne dès sa sortie. Le grand modèle de Ke Ling est déjà sorti à Kuaiying.

L'US Air Force présente son premier avion de combat IA de grande envergure ! Le ministre a personnellement effectué l'essai routier sans intervenir pendant tout le processus, et 100 000 lignes de code ont été testées 21 fois.

May 07, 2024 pm 05:00 PM

L'US Air Force présente son premier avion de combat IA de grande envergure ! Le ministre a personnellement effectué l'essai routier sans intervenir pendant tout le processus, et 100 000 lignes de code ont été testées 21 fois.

May 07, 2024 pm 05:00 PM

Récemment, le milieu militaire a été submergé par la nouvelle : les avions de combat militaires américains peuvent désormais mener des combats aériens entièrement automatiques grâce à l'IA. Oui, tout récemment, l’avion de combat IA de l’armée américaine a été rendu public pour la première fois, dévoilant ainsi son mystère. Le nom complet de ce chasseur est Variable Stability Simulator Test Aircraft (VISTA). Il a été personnellement piloté par le secrétaire de l'US Air Force pour simuler une bataille aérienne en tête-à-tête. Le 2 mai, le secrétaire de l'US Air Force, Frank Kendall, a décollé à bord d'un X-62AVISTA à la base aérienne d'Edwards. Notez que pendant le vol d'une heure, toutes les actions de vol ont été effectuées de manière autonome par l'IA ! Kendall a déclaré : "Au cours des dernières décennies, nous avons réfléchi au potentiel illimité du combat air-air autonome, mais cela a toujours semblé hors de portée." Mais maintenant,