Périphériques technologiques

Périphériques technologiques

IA

IA

Le GAN traditionnel peut être interprété après modification, et l'interprétabilité du noyau de convolution et l'authenticité des images générées sont garanties.

Le GAN traditionnel peut être interprété après modification, et l'interprétabilité du noyau de convolution et l'authenticité des images générées sont garanties.

Le GAN traditionnel peut être interprété après modification, et l'interprétabilité du noyau de convolution et l'authenticité des images générées sont garanties.

- Adresse de l'article : https://www.aaai.org/AAAI22Papers/AAAI-7931.LiC.pdf

- Affiliations des auteurs : Institute of Computing Technology, Chinese Academy of Sciences, Shanghai Jiao Tong University, Laboratoire Zhijiang

Contexte de recherche et tâches de recherche

Les réseaux adverses génératifs (GAN) ont obtenu un grand succès dans la génération d'images haute résolution, et la recherche sur leur interprétabilité a également attiré une large attention ces dernières années.

Dans ce domaine, comment faire apprendre au GAN une représentation découplée reste un défi majeur. La représentation dite découplée du GAN signifie que chaque partie de la représentation n'affecte que des aspects spécifiques de l'image générée. Des recherches antérieures sur la représentation découplée des GAN se sont concentrées sur différentes perspectives.

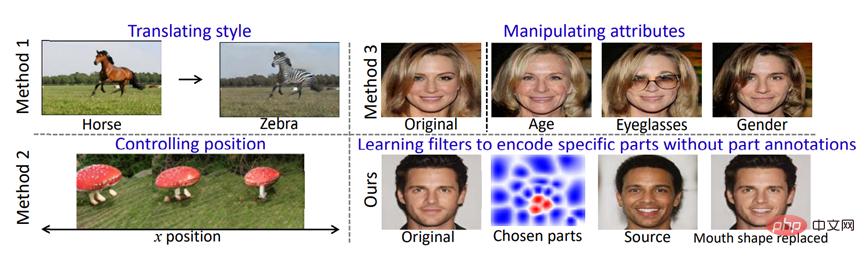

Par exemple, dans la figure 1 ci-dessous, la méthode 1 dissocie la structure et le style de l'image. La méthode 2 apprend les caractéristiques des objets locaux dans l'image. La méthode 3 apprend les caractéristiques découplées des attributs dans les images, telles que les attributs d'âge et les attributs de genre des images de visage. Cependant, ces études n’ont pas réussi à fournir une représentation claire et symbolique dans les GAN pour différents concepts visuels (tels que les parties du visage telles que les yeux, le nez et la bouche).

Figure 1 : Comparaison visuelle avec d'autres méthodes de caractérisation découplée du GAN

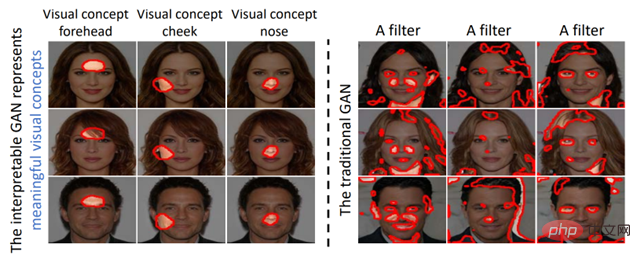

À cette fin, les chercheurs ont proposé une modifier le GAN traditionnel en une méthode générale GAN interprétable , qui garantit que les noyaux de convolution dans la couche intermédiaire du générateur peuvent apprendre des concepts visuels locaux découplés. Plus précisément, comme le montre la figure 2 ci-dessous, par rapport au GAN traditionnel, chaque noyau de convolution dans la couche intermédiaire du GAN interprétable représente toujours un concept visuel spécifique lors de la génération de différentes images, et différents noyaux de convolution représentent des visions différentes.

Figure 2 : Comparaison visuelle du GAN interprétable et de la représentation d'encodage du GAN traditionnelle

Méthode de modélisation

L'apprentissage du GAN interprétable doit répondre aux deux objectifs suivants : Convolution Le l'interprétabilité du noyau et l'authenticité de l'image générée .

Interprétabilité du noyau de convolution : les chercheurs espèrent que le noyau de convolution dans la couche intermédiaire pourra automatiquement apprendre des concepts visuels significatifs sans annotation manuelle d'aucun concept visuel. Plus précisément, chaque noyau de convolution doit générer de manière stable des régions d'image correspondant au même concept visuel lors de la génération d'images différentes. Différents noyaux de convolution doivent générer des zones d'image correspondant à différents concepts visuels ;- Authenticité des images générées : le générateur GAN interprétable peut toujours générer des images réalistes.

- Afin de garantir l'interprétabilité des noyaux de convolution dans la couche cible, les chercheurs ont remarqué que lorsque plusieurs noyaux de convolution génèrent des régions similaires correspondant à un certain concept visuel, ils représentent généralement conjointement ce concept visuel.

Par conséquent, ils utilisent un ensemble de noyaux de convolution pour représenter conjointement un concept visuel spécifique, et utilisent différents ensembles de noyaux de convolution pour représenter respectivement différents concepts visuels.

Afin de garantir en même temps l'authenticité des images générées, les chercheurs ont conçu la fonction de perte suivante pour modifier le GAN traditionnel en un GAN interprétable.

- Perte du GAN traditionnel : Cette perte est utilisée pour garantir l'authenticité de l'image générée

- Perte de partition du noyau de convolution : Étant donné un générateur, cette perte est utilisée pour trouver le volume Les noyaux sont divisés de telle manière que les noyaux de convolution du même groupe génèrent des zones d'image similaires. Plus précisément, ils utilisent un modèle de mélange gaussien (GMM) pour apprendre comment les noyaux de convolution sont divisés afin de garantir que les cartes caractéristiques des noyaux de convolution dans chaque groupe ont des activations neuronales similaires

- Perte de réalité du modèle énergétique : Étant donné la façon dont les noyaux de la couche cible sont divisés, forcer chaque noyau du même groupe à générer le même concept visuel peut réduire la qualité de l'image résultante. Afin de garantir davantage l'authenticité des images générées, ils utilisent le modèle énergétique pour générer la probabilité d'authenticité de la carte de caractéristiques dans la couche cible, et utilisent l'estimation du maximum de vraisemblance pour apprendre les paramètres du modèle énergétique

- ; Perte d'interprétabilité du noyau de convolution : étant donné la méthode de division du noyau de convolution de la couche cible, cette perte est utilisée pour améliorer encore l'interprétabilité du noyau de convolution. Plus précisément, cette perte amène chaque noyau de convolution du même groupe à générer de manière unique la même zone d'image, tandis que les noyaux de convolution de différents groupes sont responsables de la génération de différentes zones d'image.

Résultats expérimentaux

Dans l'expérience, les chercheurs ont évalué qualitativement et quantitativement leur GAN interprétable.

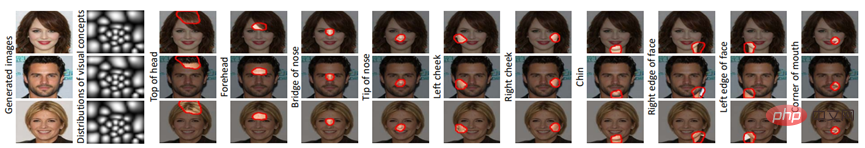

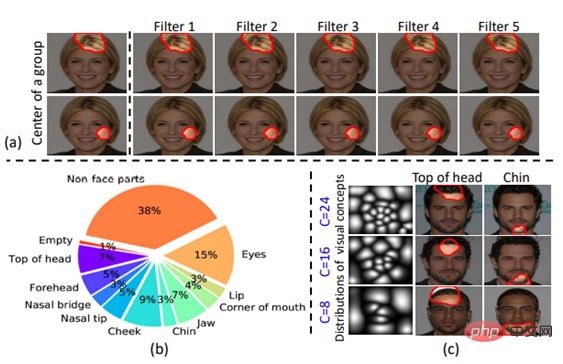

Pour l'analyse qualitative, ils ont visualisé la carte des caractéristiques de chaque noyau de convolution pour évaluer la cohérence des concepts visuels représentés par le noyau de convolution sur différentes images. Comme le montre la figure 3 ci-dessous, dans le GAN interprétable, chaque noyau de convolution génère toujours des zones d'image correspondant au même concept visuel lors de la génération d'images différentes, tandis que différents noyaux de convolution génèrent des zones d'image correspondant à différents concepts visuels. Figure 3 : Visualisation des cartes de fonctionnalités dans un GAN interprétable La différence est illustrée dans la figure 4(a) ci-dessous. La figure 4 (b) montre la proportion du nombre de noyaux de convolution correspondant à différents concepts visuels dans le GAN interprétable. La figure 4 (c) montre que lorsque le nombre de groupes de noyaux de convolution sélectionnés pour la division est différent, plus il y a de groupes, plus les concepts visuels appris par le GAN interprétable sont détaillés. Figure 4 : Évaluation qualitative du GAN explicable Par exemple, l'interaction de concepts visuels spécifiques entre des images peut être obtenue en échangeant les cartes de caractéristiques correspondantes dans la couche interprétable, c'est-à-dire que l'échange de visages local/global est terminé.

La figure 5 ci-dessous donne  les résultats

les résultats

de l'échange de la bouche, des cheveux et du nez entre des paires d'images. La dernière colonne donne la différence entre l'image modifiée et l'image originale. Ce résultat montre que la méthode des chercheurs a uniquement modifié le concept visuel local sans changer d'autres domaines non pertinents.

Figure 5 : Concepts visuels spécifiques d'échange d'images générées

Figure 5 : Concepts visuels spécifiques d'échange d'images générées

De plus, la figure 6 ci-dessous montre également les performances de leur

méthode lors de l'échange de l'ensemble du visage Effet.

Figure 6 : Échange de tout le visage de l'image générée

Pour l'analyse quantitative, les chercheurs ont utilisé des expériences de vérification du visage pour évaluer l'exactitude des résultats de l'échange de visage. Plus précisément, étant donné une paire d'images de visage, le visage de l'image originale est remplacé par le visage de l'image source pour générer une image modifiée. Ensuite, testez si le visage dans l'image modifiée et le visage dans l'image source ont la même identité.

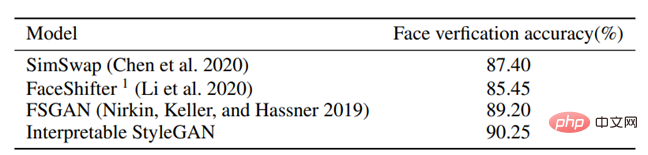

Le tableau 1 ci-dessous montre l'exactitude des résultats de vérification du visage de différentes méthodes Leur méthode est meilleure que les autres méthodes d'échange de visage en termes de préservation de l'identité.

Tableau 1 : Évaluation de la précision de l'identité par échange de visage

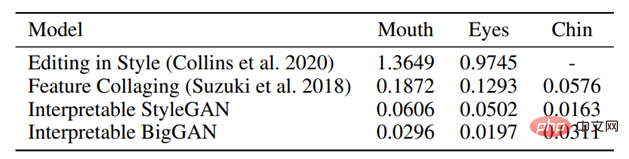

De plus, la localité de la méthode de modification de concepts visuels spécifiques a également été évaluée dans l'expérience. Plus précisément, les chercheurs ont calculé l'erreur quadratique moyenne (MSE) entre l'image originale et l'image modifiée dans l'espace RVB, et ont utilisé le rapport entre le MSE hors région et le MSE dans la région d'un concept visuel spécifique comme test expérimental. indice pour l'évaluation de la localité.

Les résultats sont présentés dans le tableau 2 ci-dessous. La méthode de modification du chercheur a une meilleure localité, c'est-à-dire qu'il y a moins de changements dans la zone de l'image en dehors du concept visuel modifié.

Tableau 2 : Évaluation de la localité des concepts visuels modifiés

Pour plus de résultats expérimentaux, voir l'article.

Résumé

Ce travail propose une méthode générale qui peut modifier les GAN traditionnels en GAN interprétables sans aucune annotation manuelle des concepts visuels. Dans un GAN interprétable, chaque noyau de convolution de la couche intermédiaire du générateur peut générer de manière stable le même concept visuel lors de la génération d'images différentes.

Les expériences montrent que le GAN interprétable permet également aux utilisateurs de modifier des concepts visuels spécifiques sur les images générées, offrant ainsi une nouvelle perspective sur la méthode d'édition contrôlable des images générées par le GAN.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Quelle méthode est utilisée pour convertir les chaînes en objets dans vue.js?

Apr 07, 2025 pm 09:39 PM

Quelle méthode est utilisée pour convertir les chaînes en objets dans vue.js?

Apr 07, 2025 pm 09:39 PM

Lors de la conversion des chaînes en objets dans vue.js, JSON.Parse () est préféré pour les chaînes JSON standard. Pour les chaînes JSON non standard, la chaîne peut être traitée en utilisant des expressions régulières et réduisez les méthodes en fonction du format ou du codé décodé par URL. Sélectionnez la méthode appropriée en fonction du format de chaîne et faites attention aux problèmes de sécurité et d'encodage pour éviter les bogues.

Vue et Element-UI Cascade déroulante Boîte en V Mode en V

Apr 07, 2025 pm 08:06 PM

Vue et Element-UI Cascade déroulante Boîte en V Mode en V

Apr 07, 2025 pm 08:06 PM

Vue et Element-UI Boîtes déroulantes en cascade Points de fosse de liaison V-model: V-model lie un tableau représentant les valeurs sélectionnées à chaque niveau de la boîte de sélection en cascade, pas une chaîne; La valeur initiale de SelectOptions doit être un tableau vide, non nul ou non défini; Le chargement dynamique des données nécessite l'utilisation de compétences de programmation asynchrones pour gérer les mises à jour des données en asynchrone; Pour les énormes ensembles de données, les techniques d'optimisation des performances telles que le défilement virtuel et le chargement paresseux doivent être prises en compte.

Vue.js Comment convertir un tableau de type de chaîne en un tableau d'objets?

Apr 07, 2025 pm 09:36 PM

Vue.js Comment convertir un tableau de type de chaîne en un tableau d'objets?

Apr 07, 2025 pm 09:36 PM

Résumé: Il existe les méthodes suivantes pour convertir les tableaux de chaîne Vue.js en tableaux d'objets: Méthode de base: utilisez la fonction de carte pour convenir à des données formatées régulières. Gameplay avancé: l'utilisation d'expressions régulières peut gérer des formats complexes, mais ils doivent être soigneusement écrits et considérés. Optimisation des performances: Considérant la grande quantité de données, des opérations asynchrones ou des bibliothèques efficaces de traitement des données peuvent être utilisées. MEILLEUR PRATIQUE: Effacer le style de code, utilisez des noms de variables significatifs et des commentaires pour garder le code concis.

Comment définir le délai de Vue Axios

Apr 07, 2025 pm 10:03 PM

Comment définir le délai de Vue Axios

Apr 07, 2025 pm 10:03 PM

Afin de définir le délai d'expiration de Vue Axios, nous pouvons créer une instance AxiOS et spécifier l'option Timeout: dans les paramètres globaux: vue.prototype. $ Axios = axios.create ({timeout: 5000}); Dans une seule demande: ce. $ axios.get ('/ api / utilisateurs', {timeout: 10000}).

Géospatial de Laravel: optimisation des cartes interactives et de grandes quantités de données

Apr 08, 2025 pm 12:24 PM

Géospatial de Laravel: optimisation des cartes interactives et de grandes quantités de données

Apr 08, 2025 pm 12:24 PM

Traiter efficacement 7 millions d'enregistrements et créer des cartes interactives avec la technologie géospatiale. Cet article explore comment traiter efficacement plus de 7 millions d'enregistrements en utilisant Laravel et MySQL et les convertir en visualisations de cartes interactives. Exigences initiales du projet de défi: extraire des informations précieuses en utilisant 7 millions d'enregistrements dans la base de données MySQL. Beaucoup de gens considèrent d'abord les langages de programmation, mais ignorent la base de données elle-même: peut-il répondre aux besoins? La migration des données ou l'ajustement structurel est-il requis? MySQL peut-il résister à une charge de données aussi importante? Analyse préliminaire: les filtres et les propriétés clés doivent être identifiés. Après analyse, il a été constaté que seuls quelques attributs étaient liés à la solution. Nous avons vérifié la faisabilité du filtre et établi certaines restrictions pour optimiser la recherche. Recherche de cartes basée sur la ville

Les ingénieurs de backend senior à distance (plates-formes) ont besoin de cercles

Apr 08, 2025 pm 12:27 PM

Les ingénieurs de backend senior à distance (plates-formes) ont besoin de cercles

Apr 08, 2025 pm 12:27 PM

Ingénieur backend à distance Emploi Vacant Société: Emplacement du cercle: Bureau à distance Type d'emploi: Salaire à temps plein: 130 000 $ - 140 000 $ Description du poste Participez à la recherche et au développement des applications mobiles Circle et des fonctionnalités publiques liées à l'API couvrant l'intégralité du cycle de vie de développement logiciel. Les principales responsabilités complètent indépendamment les travaux de développement basés sur RubyOnRails et collaborent avec l'équipe frontale React / Redux / Relay. Créez les fonctionnalités de base et les améliorations des applications Web et travaillez en étroite collaboration avec les concepteurs et le leadership tout au long du processus de conception fonctionnelle. Promouvoir les processus de développement positifs et hiérarchiser la vitesse d'itération. Nécessite plus de 6 ans de backend d'applications Web complexe

Comment résoudre MySQL ne peut pas être démarré

Apr 08, 2025 pm 02:21 PM

Comment résoudre MySQL ne peut pas être démarré

Apr 08, 2025 pm 02:21 PM

Il existe de nombreuses raisons pour lesquelles la startup MySQL échoue, et elle peut être diagnostiquée en vérifiant le journal des erreurs. Les causes courantes incluent les conflits de port (vérifier l'occupation du port et la configuration de modification), les problèmes d'autorisation (vérifier le service exécutant les autorisations des utilisateurs), les erreurs de fichier de configuration (vérifier les paramètres des paramètres), la corruption du répertoire de données (restaurer les données ou reconstruire l'espace de la table), les problèmes d'espace de la table InNODB (vérifier les fichiers IBDATA1), la défaillance du chargement du plug-in (vérification du journal des erreurs). Lors de la résolution de problèmes, vous devez les analyser en fonction du journal d'erreur, trouver la cause profonde du problème et développer l'habitude de sauvegarder régulièrement les données pour prévenir et résoudre des problèmes.

Comment utiliser MySQL après l'installation

Apr 08, 2025 am 11:48 AM

Comment utiliser MySQL après l'installation

Apr 08, 2025 am 11:48 AM

L'article présente le fonctionnement de la base de données MySQL. Tout d'abord, vous devez installer un client MySQL, tel que MySQLWorkBench ou le client de ligne de commande. 1. Utilisez la commande MySQL-UROot-P pour vous connecter au serveur et connecter avec le mot de passe du compte racine; 2. Utilisez Createdatabase pour créer une base de données et utilisez Sélectionner une base de données; 3. Utilisez CreateTable pour créer une table, définissez des champs et des types de données; 4. Utilisez InsertInto pour insérer des données, remettre en question les données, mettre à jour les données par mise à jour et supprimer les données par Supprimer. Ce n'est qu'en maîtrisant ces étapes, en apprenant à faire face à des problèmes courants et à l'optimisation des performances de la base de données que vous pouvez utiliser efficacement MySQL.