Périphériques technologiques

Périphériques technologiques

IA

IA

La conception matérielle universelle et explicable du matériel informatique d'IA sera la prochaine technologie révolutionnaire en matière d'EDA

La conception matérielle universelle et explicable du matériel informatique d'IA sera la prochaine technologie révolutionnaire en matière d'EDA

La conception matérielle universelle et explicable du matériel informatique d'IA sera la prochaine technologie révolutionnaire en matière d'EDA

Cet article est reproduit à partir de Lei Feng.com Si vous devez le réimprimer, veuillez vous rendre sur le site officiel de Lei Feng.com pour demander une autorisation.

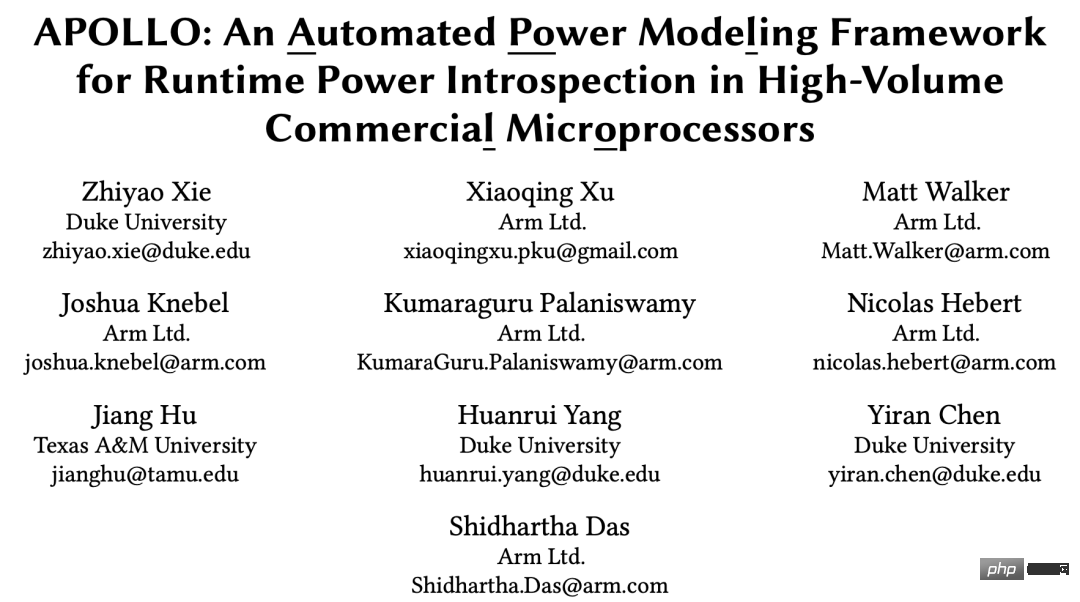

Chen Yiran, professeur au Département de génie électrique et informatique de l'Université Duke, directeur de la National Science Foundation (NSF) Next Generation Mobile Networks and Edge Computing Institute (Athena), NSF New and Sustainable Computing (ASIC) School Directeur d'entreprise du Collaborative Research Center (IUCRC) et co-directeur du Center for Computational Evolutionary Intelligence (DCEI) à l'Université Duke.

Chen Yiran est étudiante de premier cycle en 1994 au Département d'électronique de l'Université Tsinghua. Elle a obtenu une maîtrise de l'Université Tsinghua en 2001 et un doctorat de l'Université Purdue en 2005. Ses intérêts de recherche comprennent les nouveaux systèmes de mémoire et de stockage, l'apprentissage automatique, l'informatique neuromorphique et les systèmes informatiques mobiles. Il a publié plus de 500 articles, 1 monographie et a remporté plusieurs prix du meilleur article lors de diverses conférences. Ses distinctions incluent le prix de réalisation technique Edward J. McCluskey de l'IEEE Computer Society, le prix de service ACM SIGDA, etc., et il a été nominé en tant que membre de l'ACM pour ses contributions à la technologie des mémoires non volatiles. Il est également président du groupe d'intérêt spécial ACM sur l'automatisation de la conception (SIGDA).

Récemment, le professeur Chen Yiran a été interviewé par ACM et a partagé son point de vue sur la nouvelle architecture informatique, l'efficacité énergétique de l'IA informatique, le NSF AI Edge Computing Center, l'automatisation de la conception électronique et la branche d'automatisation de la conception ACM, ainsi que les tendances technologiques futures.

AI Technology Review a compilé le texte original de l'interview sans changer le sens original.

ACM : Depuis que vous êtes entré dans le domaine de la mémoire et des systèmes de stockage, qu'est-ce qui vous a le plus surpris dans le développement de ce domaine

Chen Yiran : Je pense, au cours des 15 à 20 dernières années ? La chose la plus excitante qui se passe aujourd’hui dans le domaine de la mémoire et des systèmes de stockage est que les frontières entre l’informatique et le stockage s’estompent.

La récente révolution du paradigme informatique moderne a commencé avec la nécessité de traiter le Big Data, ce qui a déclenché une demande croissante de périphériques de stockage de grande capacité. Un goulot d'étranglement est rapidement apparu en raison de la bande passante limitée entre l'unité informatique et le périphérique de stockage (souvent appelé « goulot d'étranglement de von Neumann »). Rendre les systèmes de mémoire et de stockage plus « intelligents » est devenu une solution populaire pour alléger la dépendance du système à l'égard de la bande passante mémoire et accélérer le traitement des données, comme l'informatique en mémoire proche et l'informatique en mémoire.

C'est un excellent exemple de la manière dont le passage des applications cibles (c'est-à-dire du calcul scientifique à l'informatique centrée sur les données) a modifié la philosophie de conception de l'architecture informatique. Ce changement de philosophie a inspiré une variété de nouveaux produits informatiques, tels que les disques SSD intelligents, la mémoire vive dynamique (DRAM) et les unités de traitement de données (DPU), ainsi que de nombreuses technologies de mémoire émergentes telles que 3D Xpoint. mémoire (Intel et Micron).

Cela a également conduit à l'émergence de nouvelles architectures non von Neumann, telles que les moteurs de produits scalaires basés sur des barres croisées, qui effectuent une multiplication vectorielle-matrice en mappant directement le calcul sur la topologie du matériel informatique.

ACM : L'un de vos articles récents les plus cités est "Apprendre la parcimonie structurée dans les réseaux de neurones profonds", qui explique l'importance d'améliorer l'efficacité des réseaux de neurones profonds. Pourquoi est-il important d’améliorer l’efficacité des réseaux de neurones profonds ? Quelles sont les pistes de recherche prometteuses dans ce domaine ? La grande précision (d'inférence) des réseaux neuronaux profonds (DNN) modernes s'accompagne d'un coût de calcul plus élevé, dû à l'augmentation de la profondeur et de la largeur des réseaux neuronaux. Cependant, nous savons également que les poids de connexion du réseau neuronal n’ont pas le même impact sur la précision du réseau neuronal. Lorsque les poids des connexions sont proches de zéro, il est probable que les connexions puissent être élaguées (c'est-à-dire que les poids sont fixés à zéro) sans affecter de manière significative la précision du réseau neuronal. Cet article que nous avons publié lors de NeurIPS 2016 montre que l'apprentissage de réseaux neuronaux clairsemés structurés à poids non nul et stockés en mémoire peut maintenir une bonne localité des données et réduire les taux d'échec du cache. L’efficacité informatique des réseaux de neurones est donc grandement améliorée. La technique proposée, à savoir l'apprentissage clairsemé structuré (souvent appelé épissage structuré) et ses variantes, a été largement utilisée dans la conception de modèles DNN modernes et efficaces et est prise en charge par de nombreuses puces informatiques d'intelligence artificielle (IA), telles qu'Intel Nervana et NVIDIA Ampere.

Améliorer l'efficacité du DNN est crucial car il entrave largement la mise à l'échelle des grands modèles DNN et le déploiement de grands modèles sur des systèmes avec des ressources de calcul, de stockage et des budgets énergétiques limités, tels que les équipements Edge et IoT. La dernière tendance de recherche dans ce domaine est la combinaison d'innovations au niveau des algorithmes et du matériel, telles que la conception d'accélérateurs d'intelligence artificielle basés sur des nanodispositifs émergents pour accélérer des modèles d'intelligence artificielle nouveaux ou non développés, tels que les modèles bayésiens, les modèles de type quantique, neuronaux. Modèle symbolique, etc.

ACM : Il a été récemment annoncé que vous dirigeriez le projet Athena (Athena) du Next Generation Network and Edge Computing Artificial Intelligence Institute de la National Science Foundation. Le projet Athena est un projet de 20 millions de dollars sur cinq ans qui impliquera plusieurs institutions, dont l'Université Duke, le MIT, l'Université de Princeton, l'Université de Yale, l'Université du Michigan, l'Université du Wisconsin et l'Université d'État agricole et technique de Caroline du Nord. Quels sont les objectifs du projet Athena ?

Yiran Chen : Nous sommes très enthousiasmés par la création du projet Athena, un institut phare pour l'intelligence artificielle informatique de pointe parrainé par la National Science Foundation et le département américain de la Sécurité intérieure. . L'objectif d'Athena est de transformer la conception, les opérations et les services des futurs systèmes de réseaux mobiles en offrant des performances sans précédent et en prenant en charge des services auparavant impossibles tout en contrôlant la complexité et les coûts grâce à une technologie avancée d'intelligence artificielle.

Les activités de recherche d'Athena sont divisées en quatre domaines principaux : les systèmes informatiques de pointe, les systèmes informatiques, les systèmes de réseau et les services et applications. La technologie d’intelligence artificielle que nous développons fournira également les bases théoriques et techniques de la fonctionnalité, de l’hétérogénéité, de l’évolutivité et de la fiabilité des futurs réseaux mobiles.

En tant que point de connexion pour la communauté, Athena promouvra l'écosystème des technologies émergentes et cultivera une nouvelle génération diversifiée de leaders technologiques dotés de valeurs éthiques et équitables. Nous espérons que le succès d'Athena remodèlera l'avenir du secteur des réseaux mobiles, créera de nouveaux modèles commerciaux et de nouvelles opportunités entrepreneuriales, et modifiera la recherche future sur les réseaux mobiles et les applications industrielles.

ACM : Quelles sont les tendances les plus excitantes en matière d'automatisation de la conception ? En tant que président du Groupe d'intérêt spécial de l'ACM sur l'automatisation de la conception (SIGDA), quel rôle voyez-vous cette organisation jouer dans ce domaine ?

Yiran Chen : La tendance la plus excitante en matière d'automatisation de la conception au cours de la dernière décennie a été l'adoption généralisée de la technologie d'apprentissage automatique dans les outils d'automatisation de la conception électronique (EDA). Étant donné que la qualité de la conception des puces dépend en grande partie de l'expérience des concepteurs de puces, il est naturel de développer des outils EDA intelligents capables d'apprendre directement comment hériter des méthodes de conception de puces à semi-conducteurs à partir de conceptions existantes sans avoir à passer par le modèle volumineux traditionnel. . Divers modèles d'apprentissage automatique ont été intégrés aux derniers flux EDA pour accélérer le routage et le placement des tests informatiques, l'estimation de la puissance, l'analyse temporelle, le réglage des paramètres, l'intégrité du signal, etc. Des algorithmes d’apprentissage automatique ont également été implémentés dans les modules matériels de la puce pour surveiller et prédire la consommation électrique d’exécution de la puce. Par exemple, notre framework APOLLO (a remporté le MICRO 2021 Best Paper Award).

Adresse papier : https://dl.acm.org/doi/pdf/10.1145/3466752.3480064

En tant que l'une des plus grandes associations professionnelles d'EDA, SIGDA s'engage à promouvoir les professionnels et les étudiants de l'EDA dans le monde entier. les compétences et les connaissances du monde. SIGDA parraine et organise plus de 30 conférences internationales et régionales chaque année, édite et prend en charge plusieurs revues et newsletters, et accueille plus d'une douzaine d'événements éducatifs et techniques, notamment des ateliers, des tutoriels, des webinaires, des concours, des forums de recherche et des présentations universitaires. En collaboration avec nos partenaires industriels, SIGDA offre également des allocations de voyage aux jeunes étudiants, enseignants et professionnels pour soutenir leur participation à des conférences. Nous décernons également un certain nombre de prix à des chercheurs et bénévoles exceptionnels de la communauté.

ACM : Quel est un exemple d'avenue de recherche dans votre domaine qui aura particulièrement un impact dans les années à venir ?

Chen Yiran : Je crois qu'un processus de conception de matériel informatique d'IA universel et explicable sera la prochaine technologie révolutionnaire dans la recherche sur l'EDA et les systèmes informatiques.

Au cours de la dernière décennie, diverses conceptions matérielles ont été proposées pour accélérer le calcul des modèles d'intelligence artificielle. Cependant, les concepteurs luttent toujours entre polyvalence de conception et efficacité, car de nombreuses personnalisations matérielles sont nécessaires pour s'adapter à la structure unique du modèle en constante évolution. D’un autre côté, l’explicabilité constitue un défi à long terme pour garantir la robustesse des modèles d’IA et généraliser la conception des modèles.

La conception future du matériel informatique d'IA pourrait être composée de divers modules matériels interprétables qui correspondent à leurs algorithmes respectifs. Les performances du matériel informatique IA sont garanties par un processus de conception commun. Une solution possible consiste à utiliser des méthodes symboliques neuronales pour créer un modèle d'IA composable et implémenter des modules matériels correspondant aux modules d'algorithme symbolique. Les flux AutoML étendus peuvent ensuite être utilisés pour automatiser la conception du matériel informatique d'IA cible afin d'atteindre les performances souhaitées tout en garantissant la généralisabilité et l'interprétabilité.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Comment résoudre MySQL ne peut pas être démarré

Apr 08, 2025 pm 02:21 PM

Comment résoudre MySQL ne peut pas être démarré

Apr 08, 2025 pm 02:21 PM

Il existe de nombreuses raisons pour lesquelles la startup MySQL échoue, et elle peut être diagnostiquée en vérifiant le journal des erreurs. Les causes courantes incluent les conflits de port (vérifier l'occupation du port et la configuration de modification), les problèmes d'autorisation (vérifier le service exécutant les autorisations des utilisateurs), les erreurs de fichier de configuration (vérifier les paramètres des paramètres), la corruption du répertoire de données (restaurer les données ou reconstruire l'espace de la table), les problèmes d'espace de la table InNODB (vérifier les fichiers IBDATA1), la défaillance du chargement du plug-in (vérification du journal des erreurs). Lors de la résolution de problèmes, vous devez les analyser en fonction du journal d'erreur, trouver la cause profonde du problème et développer l'habitude de sauvegarder régulièrement les données pour prévenir et résoudre des problèmes.

Comprendre les propriétés acides: les piliers d'une base de données fiable

Apr 08, 2025 pm 06:33 PM

Comprendre les propriétés acides: les piliers d'une base de données fiable

Apr 08, 2025 pm 06:33 PM

Une explication détaillée des attributs d'acide de base de données Les attributs acides sont un ensemble de règles pour garantir la fiabilité et la cohérence des transactions de base de données. Ils définissent comment les systèmes de bases de données gérent les transactions et garantissent l'intégrité et la précision des données même en cas de plantages système, d'interruptions d'alimentation ou de plusieurs utilisateurs d'accès simultanément. Présentation de l'attribut acide Atomicité: une transaction est considérée comme une unité indivisible. Toute pièce échoue, la transaction entière est reculée et la base de données ne conserve aucune modification. Par exemple, si un transfert bancaire est déduit d'un compte mais pas augmenté à un autre, toute l'opération est révoquée. BeginTransaction; UpdateAccountSsetBalance = Balance-100Wh

Mysql peut-il renvoyer JSON

Apr 08, 2025 pm 03:09 PM

Mysql peut-il renvoyer JSON

Apr 08, 2025 pm 03:09 PM

MySQL peut renvoyer les données JSON. La fonction JSON_Extract extrait les valeurs de champ. Pour les requêtes complexes, envisagez d'utiliser la clause pour filtrer les données JSON, mais faites attention à son impact sur les performances. Le support de MySQL pour JSON augmente constamment, et il est recommandé de faire attention aux dernières versions et fonctionnalités.

Master SQL Limit Clause: Contrôlez le nombre de lignes dans une requête

Apr 08, 2025 pm 07:00 PM

Master SQL Limit Clause: Contrôlez le nombre de lignes dans une requête

Apr 08, 2025 pm 07:00 PM

Clause SQLLIMIT: Contrôlez le nombre de lignes dans les résultats de la requête. La clause limite dans SQL est utilisée pour limiter le nombre de lignes renvoyées par la requête. Ceci est très utile lors du traitement de grands ensembles de données, des affichages paginés et des données de test, et peut améliorer efficacement l'efficacité de la requête. Syntaxe de base de la syntaxe: selectColumn1, Column2, ... FromTable_NamelimitNumber_Of_Rows; Number_OF_ROWS: Spécifiez le nombre de lignes renvoyées. Syntaxe avec décalage: selectColumn1, Column2, ... FromTable_Namelimitoffset, numéro_of_rows; décalage: sauter

Comment optimiser les performances MySQL pour les applications de haute charge?

Apr 08, 2025 pm 06:03 PM

Comment optimiser les performances MySQL pour les applications de haute charge?

Apr 08, 2025 pm 06:03 PM

Guide d'optimisation des performances de la base de données MySQL dans les applications à forte intensité de ressources, la base de données MySQL joue un rôle crucial et est responsable de la gestion des transactions massives. Cependant, à mesure que l'échelle de l'application se développe, les goulots d'étranglement des performances de la base de données deviennent souvent une contrainte. Cet article explorera une série de stratégies efficaces d'optimisation des performances MySQL pour garantir que votre application reste efficace et réactive dans des charges élevées. Nous combinerons des cas réels pour expliquer les technologies clés approfondies telles que l'indexation, l'optimisation des requêtes, la conception de la base de données et la mise en cache. 1. La conception de l'architecture de la base de données et l'architecture optimisée de la base de données sont la pierre angulaire de l'optimisation des performances MySQL. Voici quelques principes de base: sélectionner le bon type de données et sélectionner le plus petit type de données qui répond aux besoins peut non seulement économiser un espace de stockage, mais également améliorer la vitesse de traitement des données.

Surveillez les gouttelettes MySQL et MariaDB avec Exportateur de Prometheus Mysql

Apr 08, 2025 pm 02:42 PM

Surveillez les gouttelettes MySQL et MariaDB avec Exportateur de Prometheus Mysql

Apr 08, 2025 pm 02:42 PM

Une surveillance efficace des bases de données MySQL et MARIADB est essentielle pour maintenir des performances optimales, identifier les goulots d'étranglement potentiels et assurer la fiabilité globale du système. Prometheus Mysql Exportateur est un outil puissant qui fournit des informations détaillées sur les mesures de base de données qui sont essentielles pour la gestion et le dépannage proactifs.

La clé principale de MySQL peut être nul

Apr 08, 2025 pm 03:03 PM

La clé principale de MySQL peut être nul

Apr 08, 2025 pm 03:03 PM

La clé primaire MySQL ne peut pas être vide car la clé principale est un attribut de clé qui identifie de manière unique chaque ligne dans la base de données. Si la clé primaire peut être vide, l'enregistrement ne peut pas être identifié de manière unique, ce qui entraînera une confusion des données. Lorsque vous utilisez des colonnes entières ou des UUIdes auto-incrémentales comme clés principales, vous devez considérer des facteurs tels que l'efficacité et l'occupation de l'espace et choisir une solution appropriée.

Méthode de Navicat pour afficher le mot de passe de la base de données MongoDB

Apr 08, 2025 pm 09:39 PM

Méthode de Navicat pour afficher le mot de passe de la base de données MongoDB

Apr 08, 2025 pm 09:39 PM

Il est impossible de visualiser le mot de passe MongoDB directement via NAVICAT car il est stocké sous forme de valeurs de hachage. Comment récupérer les mots de passe perdus: 1. Réinitialiser les mots de passe; 2. Vérifiez les fichiers de configuration (peut contenir des valeurs de hachage); 3. Vérifiez les codes (May Code Hardcode).