Périphériques technologiques

Périphériques technologiques

IA

IA

L'IA écrit des romans, peint et monte des vidéos. L'IA générative est encore plus populaire !

L'IA écrit des romans, peint et monte des vidéos. L'IA générative est encore plus populaire !

L'IA écrit des romans, peint et monte des vidéos. L'IA générative est encore plus populaire !

Récemment, l'IA générative est redevenue populaire ! Une applet WeChat appelée « Dream Stealer » est devenue un succès instantané, atteignant un record de 50 000 nouveaux utilisateurs chaque jour.

Dream Stealer est une plate-forme d'IA qui peut générer des images basées sur le texte saisi. Il s'agit d'une branche de l'AIGC (AI-Generated Content).

Une fois que les utilisateurs ont utilisé leur imagination et saisi des descriptions textuelles, Dream Stealer peut générer des images dans trois rapports : 1:1, 9:16 et 16:9. Il existe également 24 styles de peinture parmi lesquels choisir - en plus des peintures à l'huile de base, Les catégories de peinture telles que l'aquarelle et le croquis incluent également des styles spéciaux tels que le cyberpunk, la vaporwave, le pixel art, Ghibli et le rendu CG.

Photo : L'éditeur du rapport Technology Cloud a utilisé l'applet WeChat "Dream Stealer" pour le générer

En fait, ce n'est pas le premier logiciel d'IA qui "utilise du texte pour créer des images". De Midjourney à Stable Diffusion, l’IA générative a été le sujet le plus brûlant de ces deux dernières années.

En tant que direction importante dans le développement de l’IA, l’IA générative présente un grand potentiel de développement.

Selon les données de Gartner au premier semestre, on s'attend à ce que l'IA générative représente 10 % de toutes les données générées d'ici 2025, contre moins de 1 % actuellement.

Certaines personnes pensent que 2022 sera la première année où l'IA générative sortira de la technologie pour pénétrer dans les fondamentaux de la société.

La croissance explosive de l'IA générative : des images aux vidéos

Ces dernières années, le développement de la technologie de l'IA dans le domaine visuel peut être qualifié de « rapide ».

En janvier de l'année dernière, OpenAI, une société dédiée à « faire bénéficier toute l'humanité d'une intelligence artificielle générale », a lancé le DALL-E qui a fait date, basé sur le modèle GPT-3, qui réalise la génération d'images à partir de texte.

En avril de cette année, le modèle DALL-E 2 de deuxième génération lancé par OpenAI a une fois de plus établi une nouvelle référence dans le domaine de la génération d'images.

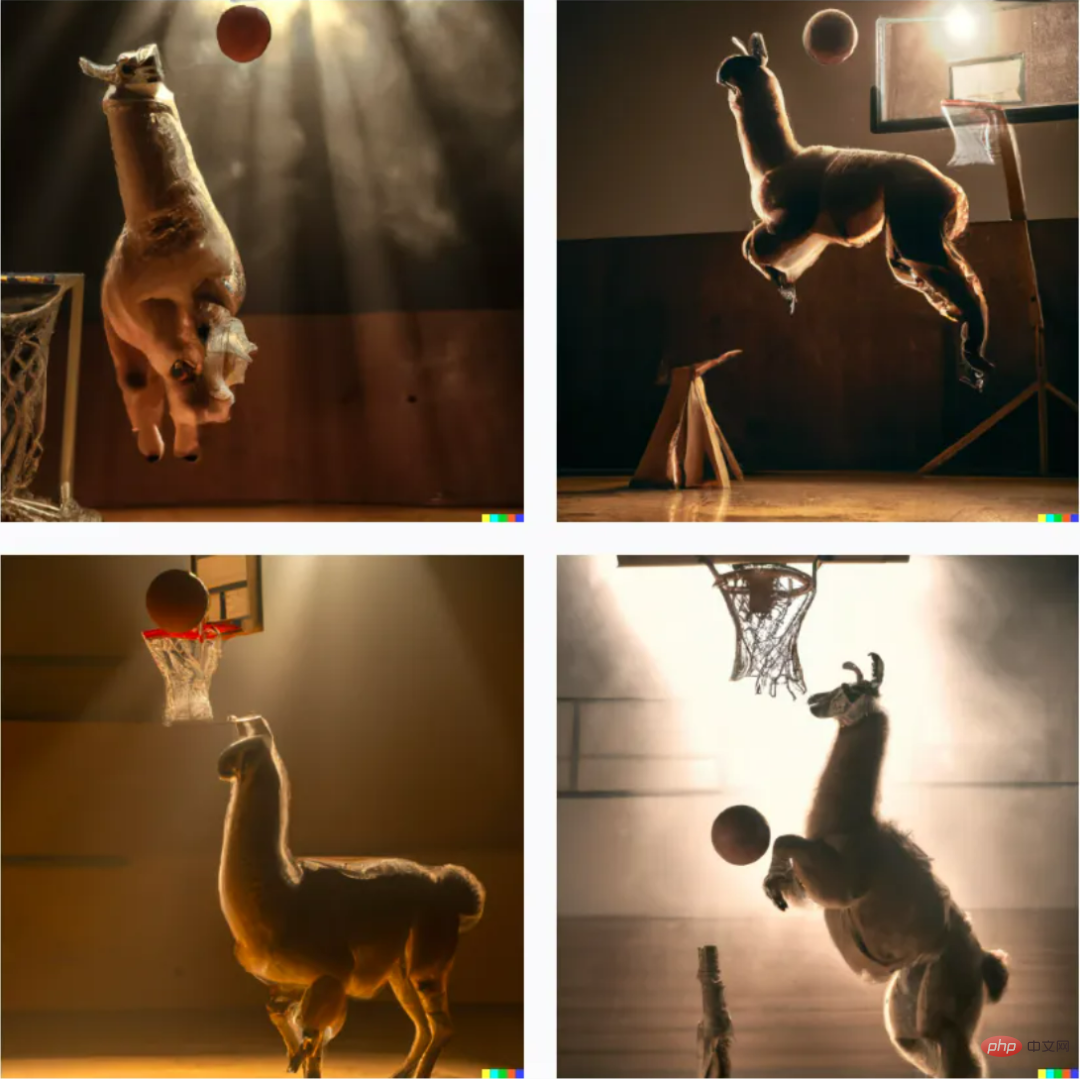

Les utilisateurs peuvent générer des images correspondantes via de courtes descriptions textuelles (invite), afin que les personnes qui ne savent pas dessiner puissent également transformer leur imagination en créations artistiques, comme les quatre mots générés par la phrase "Alpaga jouant au basket-ball". L'image ressemble beaucoup à conforme aux attentes de chacun.

Exemple d'image générée par le modèle DALL-E 2

De plus, à mesure que la granularité des descriptions textuelles continue d'être affinée, les images générées deviendront de plus en plus précises, et l'effet est déjà assez choquant pour les non- professionnels.

Mais des modèles comme DALL-E 2 restent toujours dans le domaine de la création bidimensionnelle, c'est-à-dire de la génération d'images, et ne peuvent pas générer de modèles 3D à 360 degrés sans impasses.

Cependant, cela ne pose toujours pas de problème aux chercheurs en algorithmes très créatifs. L'un des derniers résultats de la recherche Google : le modèle DreamFusion, peut générer un modèle 3D en saisissant de simples invites de texte. Il peut non seulement être rendu dans différentes conditions d'éclairage. , De plus, les modèles 3D générés ont également des caractéristiques telles que la densité et la couleur, et plusieurs modèles 3D générés peuvent même être intégrés dans une seule scène.

Après avoir généré des images 3D, l'équipe d'algorithmes de Meta a ouvert davantage ses idées, a relevé des difficultés plus élevées et a commencé à explorer l'utilisation d'invites textuelles pour générer directement des vidéos.

Bien que la vidéo soit essentiellement la superposition d'une série d'images, par rapport à la génération d'images, lors de l'utilisation de texte pour générer une vidéo, il est non seulement nécessaire de générer plusieurs images de la même scène, mais également d'assurer la continuité entre les images adjacentes. sexe. Comme il y a très peu de données vidéo de haute qualité disponibles lors de la formation du modèle, mais que la quantité de calcul est très importante, cela augmente considérablement la complexité de la tâche de génération vidéo.

En septembre de cette année, des chercheurs de Meta ont publié Make-A-Video, un modèle de génération de vidéos courtes de haute qualité basé sur l'intelligence artificielle, équivalent à la version vidéo de DALL-E, également surnommée "Made with Mouth" " Vidéo", c'est-à-dire que vous pouvez créer un nouveau contenu vidéo via des invites textuelles. La technologie clé derrière cela vient également de la technologie de synthèse "texte-image" utilisée par les générateurs d'images tels que DALL-E.

Seulement une semaine plus tard, le PDG de Google, Pichai, a officiellement annoncé deux modèles pour défier de front Make-A-Video de Meta, à savoir Imagen Video et Phenaki.

Par rapport à Make-A-Video, Imagen Video met en évidence les caractéristiques haute définition de la vidéo, peut générer une résolution de 1280*768, des clips vidéo de 24 images par seconde, et peut également comprendre et générer des œuvres de différents styles artistiques

Comprendre ; La structure 3D de l'objet ne sera pas déformée lors de l'affichage par rotation ;

hérite même de la capacité d'Imagen à représenter avec précision le texte, et sur cette base, diverses animations créatives peuvent être générées sur la base de descriptions simples.

Imagen Video génère des exemples vidéo

Et Phenaki peut générer plus de 2 minutes de longs plans à basse résolution basés sur des invites d'environ 200 mots, racontant une histoire relativement complète.

Exemple vidéo généré par Phenaki

Actuellement, il existe de nombreuses applications d'IA générative en Chine.

Par exemple, l'application Jianying de ByteDance fournit des fonctions vidéo générées par l'IA et peut être utilisée gratuitement.

La fonction vidéo image-texte est similaire à celle de Google. Les créateurs peuvent utiliser quelques mots-clés ou un court paragraphe de texte pour générer une courte vidéo créative.

Clip Screen peut également associer intelligemment du matériel vidéo en fonction de descriptions textuelles et regrouper des vidéos dans des œuvres à contenu plus vertical, notamment la finance, l'histoire, les sciences humaines et d'autres catégories.

En janvier 2022, NetEase a lancé la plateforme unique de création musicale par IA « NetEase Tianyin », dont l'IA génère des vœux de Nouvel An édités par les utilisateurs en chansons, et a lancé une version professionnelle côté Web au premier semestre.

En septembre 2021, l'application Caiyun Xiaomeng a été lancée, qui peut créer différents types de texte. Les utilisateurs n'ont qu'à donner un début de 1 à 1 000 mots, et Caiyun Xiaomeng peut continuer à écrire l'histoire suivante.

En fait, il existe de nombreuses formes de création d'IA. Lorsque la technologie de l'IA générative est appliquée à l'écriture, des versions machines de journalistes, romanciers, poètes, scénaristes, etc. peuvent naître. Lorsqu'elle est appliquée aux domaines de la peinture, de la musique et de la danse, elle peut « cultiver » des peintres, des compositeurs et des éditeurs. .Personne de danse.

Derrière l'explosion de l'IA générative

Au cours de la dernière année, l'IA générative s'est encore mieux développée. Les géants du logiciel dans le domaine de l'IA tels que Google, Microsoft et Meta ont promu cette technologie en interne et intégré l'IA générative dans leurs produits.

Pourquoi l’IA générative est-elle soudainement si populaire ?

En fait, la technologie de l'IA générative s'est développée rapidement, mais elle était auparavant limitée à un petit cercle de l'industrie technologique en raison de seuils techniques trop élevés.

En regardant l'histoire du développement de la technologie de l'IA, nous constaterons que l'explosion de l'IA générative est indissociable de trois facteurs : de meilleurs modèles, plus de données et plus de calculs.

Avant 2015, les petits modèles étaient considérés comme la « technologie de pointe » pour comprendre le langage. Ces petits modèles excellent dans les tâches analytiques et sont déployés dans des tâches allant de la prévision des délais de livraison à la classification des fraudes.

Cependant, ils ne sont pas assez expressifs pour les tâches de génération générales. Générer de l'écriture ou du code au niveau humain n'est encore qu'un rêve.

En 2017, Google Research a publié un article historique (Attention is All You Need), décrivant une nouvelle architecture de réseau neuronal pour la compréhension du langage naturel, appelée transformateurs, qui peut générer des modèles de langage de haute qualité, en même temps, elle a une plus grande la parallélisabilité et le temps de formation requis sont également considérablement réduits.

Bien sûr, à mesure que les modèles grandissent, ils commencent à montrer des performances surhumaines. La quantité de calcul utilisée pour entraîner ces modèles a augmenté de six ordres de grandeur entre 2015 et 2020, les résultats dépassant les critères de performance humaine en matière d’écriture manuscrite, de reconnaissance de la parole et d’images, de compréhension écrite et de compréhension du langage.

Parmi eux, le GPT-3 d'OpenAI se démarque. Les performances de ce modèle ont fait un énorme bond en avant par rapport au GPT-2, montrant de meilleures capacités de la génération de code à l'écriture de blagues.

Malgré toutes les avancées dans les domaines de la recherche fondamentale, ces modèles ne sont pas universels.

Ils sont volumineux, difficiles à exécuter (nécessitent une coordination GPU), peu disponibles (indisponibles ou uniquement en version bêta fermée) et coûteux à utiliser en tant que service cloud.

Mais malgré ces limitations, les premières applications d’IA générative ont commencé à entrer sur le champ de bataille.

Par la suite, à mesure que l'informatique devenait moins chère, l'industrie a continué à développer de meilleurs algorithmes et des modèles plus grands.

Les autorisations des développeurs ont été étendues de la version bêta fermée à la version bêta ouverte, ou dans certains cas, à l'open source.

Maintenant que la couche plate-forme est solide, couplée à des modèles qui continuent de s'améliorer, plus rapides et moins chers, et à un accès aux modèles tendant à être gratuit et open source, la couche application IA est mûre pour que la créativité explose.

Par exemple, en août de cette année, le modèle de génération texte-image Stable Diffusion est devenu open source. Les successeurs peuvent mieux utiliser cet outil open source pour découvrir une écologie de contenu plus riche, qui joue un rôle crucial dans sa vulgarisation auprès d'un plus large éventail. des utilisateurs finaux C.

La popularité de Stable Diffusion réside essentiellement dans le fait que l'open source libère la créativité.

L'IA générative est confrontée à de réels défis

L'institution de capital-risque Sequoia Capital a mentionné dans un article de blog sur son site officiel : "L'IA générativea le potentiel de générer des milliards de dollars en valeur économique.

" Selon Sequoia Capital , l'IA générative peut transformer toutes les industries qui nécessitent que les humains créent des œuvres originales, des jeux à la publicité en passant par le droit.

Plus précisément, les scénarios d'application de l'IA générative à l'avenir sont très larges. Outre les industries de production de contenu telles que la création culturelle et l'actualité, l'IA générative a de riches applications dans de nombreux secteurs tels que les soins de santé, le commerce numérique, la fabrication, et l'agriculture. Perspectives d'application, telles qu'aider les médecins à détecter les lésions lors des examens par rayons X, tomodensitogrammes et autres équipements, créer des jumeaux numériques de produits, aider à tester la qualité des produits, etc.

Il existe également un espace d'application abondant dans les technologies populaires telles que la XR, les jumeaux numériques et les véhicules autonomes.

Mais il convient de noter qu'il reste encore de nombreux problèmes à résoudre dans l'IA générative actuelle.

Par exemple, dans le domaine du divertissement, l'une des raisons pour lesquelles de nombreuses personnes utilisent l'IA générative pour la création est d'éviter les problèmes de droits d'auteur, mais cela ne veut pas dire qu'il n'y a pas de dangers cachés.

D'une part, la création d'IA recombine également les données apprises selon les besoins. Bien que la granularité soit de plus en plus fine, il est inévitable que certains yeux perçants voient quelles œuvres peuvent être référencées, et même certains internautes. Il a été indiqué sur la plateforme sociale que des traces d'une signature suspecte étaient vaguement visibles sur une image générée par l'IA.

D'un autre côté, la plupart des plates-formes de génération d'IA actuelles ne revendiquent pas de droit d'auteur ou n'indiquent pas clairement qu'elles peuvent être utilisées à des fins commerciales. Cependant, à mesure que l'IA générative est progressivement commercialisée, un tel environnement de droit d'auteur existe-t-il et s'il est nouveau. des problèmes de droits d'auteur se poseront également et doivent être discutés.

La logique et la sécurité de l'IA générative doivent également être améliorées. L’IA générative actuelle est encline à commettre des erreurs de bon sens et est également sujette à des problèmes dans les domaines qui nécessitent une mémoire à long terme.

Par exemple, dans le processus de romans générés par l'IA, il y a souvent des incohérences en raison de la longueur.

Par conséquent, même si l'IA générative peut déjà être appliquée dans de nombreux domaines, pour faire réellement fonctionner l'IA générative, beaucoup de formation est nécessaire pour éviter des pertes majeures causées par les "erreurs" de l'IA.

Après tout, les scénarios d'application tels que le médical et l'industrie manufacturière n'ont pas la même marge d'essais et d'erreurs que les industries culturelles et créatives.

Conclusion

Bien que l'IA générative soit actuellement indissociable de l'intervention humaine, il est indéniable que l'IA générative a encore un grand potentiel de développement.

L'émergence de l'IA générative signifie que l'IA commence à assumer un nouveau rôle dans le contenu de la vie réelle, passant de « l'observation et la prédiction » à la « génération directe et la prise de décision ». En d’autres termes, l’IA générative crée, pas seulement des analyses.

Comme l'a déclaré Sam Altman, PDG d'OpenAI : « L'IA générative nous rappelle qu'il est difficile de faire des prédictions sur l'intelligence artificielle.

Il y a dix ans, la sagesse conventionnelle était que l'intelligence artificielle affecterait d'abord le travail manuel ; C'est un travail cognitif ; alors, peut-être qu'un jour, il pourra faire un travail créatif. Maintenant, il semble que cela se fera dans l'ordre inverse. "

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

Video Face Swap

Échangez les visages dans n'importe quelle vidéo sans effort grâce à notre outil d'échange de visage AI entièrement gratuit !

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Sujets chauds

Bytedance Cutting lance le super abonnement SVIP : 499 yuans pour un abonnement annuel continu, offrant une variété de fonctions d'IA

Jun 28, 2024 am 03:51 AM

Bytedance Cutting lance le super abonnement SVIP : 499 yuans pour un abonnement annuel continu, offrant une variété de fonctions d'IA

Jun 28, 2024 am 03:51 AM

Ce site a rapporté le 27 juin que Jianying est un logiciel de montage vidéo développé par FaceMeng Technology, une filiale de ByteDance. Il s'appuie sur la plateforme Douyin et produit essentiellement du contenu vidéo court pour les utilisateurs de la plateforme. Il est compatible avec iOS, Android et. Windows, MacOS et autres systèmes d'exploitation. Jianying a officiellement annoncé la mise à niveau de son système d'adhésion et a lancé un nouveau SVIP, qui comprend une variété de technologies noires d'IA, telles que la traduction intelligente, la mise en évidence intelligente, l'emballage intelligent, la synthèse humaine numérique, etc. En termes de prix, les frais mensuels pour le clipping SVIP sont de 79 yuans, les frais annuels sont de 599 yuans (attention sur ce site : équivalent à 49,9 yuans par mois), l'abonnement mensuel continu est de 59 yuans par mois et l'abonnement annuel continu est de 59 yuans par mois. est de 499 yuans par an (équivalent à 41,6 yuans par mois) . En outre, le responsable de Cut a également déclaré que afin d'améliorer l'expérience utilisateur, ceux qui se sont abonnés au VIP d'origine

Assistant de codage d'IA augmenté par le contexte utilisant Rag et Sem-Rag

Jun 10, 2024 am 11:08 AM

Assistant de codage d'IA augmenté par le contexte utilisant Rag et Sem-Rag

Jun 10, 2024 am 11:08 AM

Améliorez la productivité, l’efficacité et la précision des développeurs en intégrant une génération et une mémoire sémantique améliorées par la récupération dans les assistants de codage IA. Traduit de EnhancingAICodingAssistantswithContextUsingRAGandSEM-RAG, auteur JanakiramMSV. Bien que les assistants de programmation d'IA de base soient naturellement utiles, ils ne parviennent souvent pas à fournir les suggestions de code les plus pertinentes et les plus correctes, car ils s'appuient sur une compréhension générale du langage logiciel et des modèles d'écriture de logiciels les plus courants. Le code généré par ces assistants de codage est adapté à la résolution des problèmes qu’ils sont chargés de résoudre, mais n’est souvent pas conforme aux normes, conventions et styles de codage des équipes individuelles. Cela aboutit souvent à des suggestions qui doivent être modifiées ou affinées pour que le code soit accepté dans l'application.

Sept questions d'entretien technique Cool GenAI et LLM

Jun 07, 2024 am 10:06 AM

Sept questions d'entretien technique Cool GenAI et LLM

Jun 07, 2024 am 10:06 AM

Pour en savoir plus sur l'AIGC, veuillez visiter : 51CTOAI.x Community https://www.51cto.com/aigc/Translator|Jingyan Reviewer|Chonglou est différent de la banque de questions traditionnelle que l'on peut voir partout sur Internet. nécessite de sortir des sentiers battus. Les grands modèles linguistiques (LLM) sont de plus en plus importants dans les domaines de la science des données, de l'intelligence artificielle générative (GenAI) et de l'intelligence artificielle. Ces algorithmes complexes améliorent les compétences humaines et stimulent l’efficacité et l’innovation dans de nombreux secteurs, devenant ainsi la clé permettant aux entreprises de rester compétitives. LLM a un large éventail d'applications. Il peut être utilisé dans des domaines tels que le traitement du langage naturel, la génération de texte, la reconnaissance vocale et les systèmes de recommandation. En apprenant de grandes quantités de données, LLM est capable de générer du texte

Le réglage fin peut-il vraiment permettre au LLM d'apprendre de nouvelles choses : l'introduction de nouvelles connaissances peut amener le modèle à produire davantage d'hallucinations

Jun 11, 2024 pm 03:57 PM

Le réglage fin peut-il vraiment permettre au LLM d'apprendre de nouvelles choses : l'introduction de nouvelles connaissances peut amener le modèle à produire davantage d'hallucinations

Jun 11, 2024 pm 03:57 PM

Les grands modèles linguistiques (LLM) sont formés sur d'énormes bases de données textuelles, où ils acquièrent de grandes quantités de connaissances du monde réel. Ces connaissances sont intégrées à leurs paramètres et peuvent ensuite être utilisées en cas de besoin. La connaissance de ces modèles est « réifiée » en fin de formation. À la fin de la pré-formation, le modèle arrête effectivement d’apprendre. Alignez ou affinez le modèle pour apprendre à exploiter ces connaissances et répondre plus naturellement aux questions des utilisateurs. Mais parfois, la connaissance du modèle ne suffit pas, et bien que le modèle puisse accéder à du contenu externe via RAG, il est considéré comme bénéfique de l'adapter à de nouveaux domaines grâce à un réglage fin. Ce réglage fin est effectué à l'aide de la contribution d'annotateurs humains ou d'autres créations LLM, où le modèle rencontre des connaissances supplémentaires du monde réel et les intègre.

Cinq écoles d'apprentissage automatique que vous ne connaissez pas

Jun 05, 2024 pm 08:51 PM

Cinq écoles d'apprentissage automatique que vous ne connaissez pas

Jun 05, 2024 pm 08:51 PM

L'apprentissage automatique est une branche importante de l'intelligence artificielle qui donne aux ordinateurs la possibilité d'apprendre à partir de données et d'améliorer leurs capacités sans être explicitement programmés. L'apprentissage automatique a un large éventail d'applications dans divers domaines, de la reconnaissance d'images et du traitement du langage naturel aux systèmes de recommandation et à la détection des fraudes, et il change notre façon de vivre. Il existe de nombreuses méthodes et théories différentes dans le domaine de l'apprentissage automatique, parmi lesquelles les cinq méthodes les plus influentes sont appelées les « Cinq écoles d'apprentissage automatique ». Les cinq grandes écoles sont l’école symbolique, l’école connexionniste, l’école évolutionniste, l’école bayésienne et l’école analogique. 1. Le symbolisme, également connu sous le nom de symbolisme, met l'accent sur l'utilisation de symboles pour le raisonnement logique et l'expression des connaissances. Cette école de pensée estime que l'apprentissage est un processus de déduction inversée, à travers les connaissances existantes.

Afin de fournir un nouveau système de référence et d'évaluation de questions-réponses scientifiques et complexes pour les grands modèles, l'UNSW, Argonne, l'Université de Chicago et d'autres institutions ont lancé conjointement le cadre SciQAG.

Jul 25, 2024 am 06:42 AM

Afin de fournir un nouveau système de référence et d'évaluation de questions-réponses scientifiques et complexes pour les grands modèles, l'UNSW, Argonne, l'Université de Chicago et d'autres institutions ont lancé conjointement le cadre SciQAG.

Jul 25, 2024 am 06:42 AM

L'ensemble de données ScienceAI Question Answering (QA) joue un rôle essentiel dans la promotion de la recherche sur le traitement du langage naturel (NLP). Des ensembles de données d'assurance qualité de haute qualité peuvent non seulement être utilisés pour affiner les modèles, mais également évaluer efficacement les capacités des grands modèles linguistiques (LLM), en particulier la capacité à comprendre et à raisonner sur les connaissances scientifiques. Bien qu’il existe actuellement de nombreux ensembles de données scientifiques d’assurance qualité couvrant la médecine, la chimie, la biologie et d’autres domaines, ces ensembles de données présentent encore certaines lacunes. Premièrement, le formulaire de données est relativement simple, et la plupart sont des questions à choix multiples. Elles sont faciles à évaluer, mais limitent la plage de sélection des réponses du modèle et ne peuvent pas tester pleinement la capacité du modèle à répondre aux questions scientifiques. En revanche, les questions et réponses ouvertes

Les performances de SOTA, la méthode d'IA de prédiction d'affinité protéine-ligand multimodale de Xiamen, combinent pour la première fois des informations sur la surface moléculaire

Jul 17, 2024 pm 06:37 PM

Les performances de SOTA, la méthode d'IA de prédiction d'affinité protéine-ligand multimodale de Xiamen, combinent pour la première fois des informations sur la surface moléculaire

Jul 17, 2024 pm 06:37 PM

Editeur | KX Dans le domaine de la recherche et du développement de médicaments, il est crucial de prédire avec précision et efficacité l'affinité de liaison des protéines et des ligands pour le criblage et l'optimisation des médicaments. Cependant, les études actuelles ne prennent pas en compte le rôle important des informations sur la surface moléculaire dans les interactions protéine-ligand. Sur cette base, des chercheurs de l'Université de Xiamen ont proposé un nouveau cadre d'extraction de caractéristiques multimodales (MFE), qui combine pour la première fois des informations sur la surface des protéines, la structure et la séquence 3D, et utilise un mécanisme d'attention croisée pour comparer différentes modalités. alignement. Les résultats expérimentaux démontrent que cette méthode atteint des performances de pointe dans la prédiction des affinités de liaison protéine-ligand. De plus, les études d’ablation démontrent l’efficacité et la nécessité des informations sur la surface des protéines et de l’alignement des caractéristiques multimodales dans ce cadre. Les recherches connexes commencent par "S

SK Hynix présentera de nouveaux produits liés à l'IA le 6 août : HBM3E à 12 couches, NAND à 321 hauteurs, etc.

Aug 01, 2024 pm 09:40 PM

SK Hynix présentera de nouveaux produits liés à l'IA le 6 août : HBM3E à 12 couches, NAND à 321 hauteurs, etc.

Aug 01, 2024 pm 09:40 PM

Selon les informations de ce site le 1er août, SK Hynix a publié un article de blog aujourd'hui (1er août), annonçant sa participation au Global Semiconductor Memory Summit FMS2024 qui se tiendra à Santa Clara, Californie, États-Unis, du 6 au 8 août, présentant de nombreuses nouvelles technologies de produit. Introduction au Future Memory and Storage Summit (FutureMemoryandStorage), anciennement Flash Memory Summit (FlashMemorySummit) principalement destiné aux fournisseurs de NAND, dans le contexte de l'attention croissante portée à la technologie de l'intelligence artificielle, cette année a été rebaptisée Future Memory and Storage Summit (FutureMemoryandStorage) pour invitez les fournisseurs de DRAM et de stockage et bien d’autres joueurs. Nouveau produit SK hynix lancé l'année dernière