Périphériques technologiques

Périphériques technologiques

IA

IA

Article exceptionnel de l'ICRA 2022 : En convertissant des images 2D de conduite autonome en vue à vol d'oiseau, la précision de la reconnaissance du modèle augmente de 15 %

Article exceptionnel de l'ICRA 2022 : En convertissant des images 2D de conduite autonome en vue à vol d'oiseau, la précision de la reconnaissance du modèle augmente de 15 %

Article exceptionnel de l'ICRA 2022 : En convertissant des images 2D de conduite autonome en vue à vol d'oiseau, la précision de la reconnaissance du modèle augmente de 15 %

Pour de nombreuses tâches de conduite autonome, il est plus facile de les réaliser dans une perspective descendante, cartographique ou à vol d'oiseau (BEV). Étant donné que de nombreux sujets de conduite autonome sont limités au plan du sol, une vue de dessus est une représentation de faible dimension plus pratique et est idéale pour la navigation, capturant les obstacles et les dangers pertinents. Pour des scénarios tels que la conduite autonome, des cartes BEV sémantiquement segmentées doivent être générées sous forme d'estimations instantanées pour gérer les objets et les scènes en mouvement libre qui ne sont visités qu'une seule fois.

Pour déduire des cartes BEV à partir d'images, il faut déterminer la correspondance entre les éléments de l'image et leurs positions dans l'environnement. Certaines recherches antérieures ont utilisé des cartes de profondeur denses et des cartes de segmentation d'images pour guider ce processus de conversion, et d'autres recherches ont étendu la méthode d'analyse implicite de la profondeur et de la sémantique. Certaines études exploitent les a priori géométriques de la caméra mais n'apprennent pas explicitement l'interaction entre les éléments de l'image et les plans BEV.

Dans un article récent, des chercheurs de l'Université de Surrey ont introduit un mécanisme d'attention pour convertir des images 2D de conduite autonome en vue à vol d'oiseau, améliorant ainsi la précision de reconnaissance du modèle de 15 %. Cette recherche a remporté le prix Outstanding Paper Award lors de la conférence ICRA 2022 qui s’est terminée il n’y a pas si longtemps. " Problème de conversion Image-to-World"

, dont le but est d'apprendre l'alignement entre les lignes de balayage verticales dans l'image et les rayons polaires dans le BEV. Cette géométrie projective est donc implicite au réseau.

, dont le but est d'apprendre l'alignement entre les lignes de balayage verticales dans l'image et les rayons polaires dans le BEV. Cette géométrie projective est donc implicite au réseau.

Dans le modèle d'alignement, les chercheurs ont adopté Transformer, une structure de prédiction de séquence basée sur l'attention

Les transformateurs sont parfaitement adaptés aux problèmes de traduction d'image en BEV, car ils peuvent raisonner sur les interdépendances entre les objets, la profondeur et l'éclairage de la scène pour obtenir des représentations globalement cohérentes. Les chercheurs intègrent le modèle d'alignement basé sur Transformer dans une formulation d'apprentissage de bout en bout qui prend en entrée une image monoculaire et sa matrice intrinsèque, puis prédit la cartographie sémantique BEV des classes statiques et dynamiques.

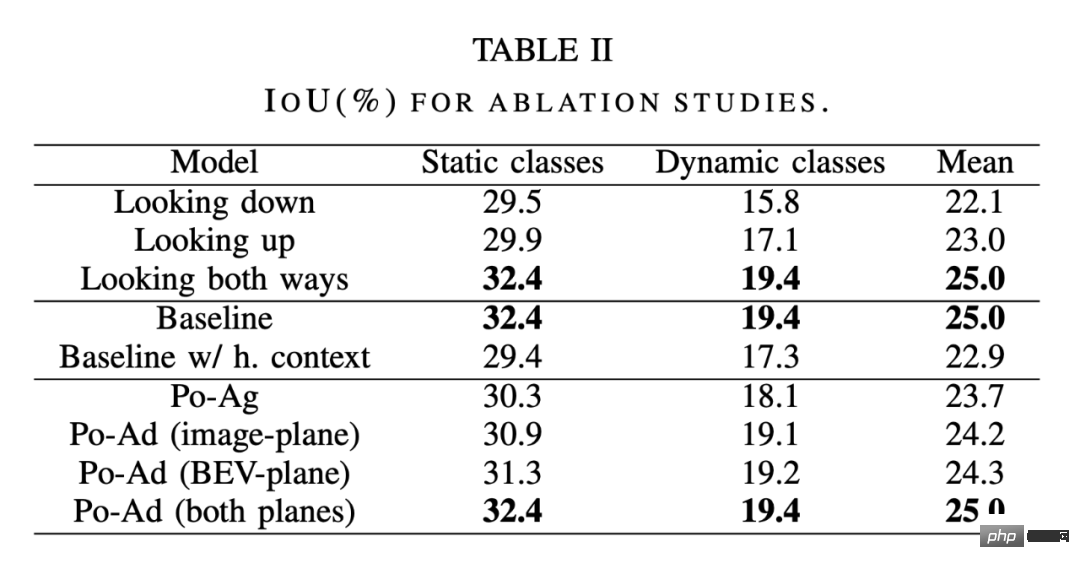

Cet article construit une architecture qui permet de prédire le mappage sémantique BEV à partir d'images monoculaires autour d'un modèle d'alignement. Comme le montre la figure 1 ci-dessous, il contient trois composants principaux : un réseau fédérateur CNN standard pour extraire les caractéristiques spatiales sur le plan image ; un transformateur codeur-décodeur pour convertir les caractéristiques sur le plan image en BEV et enfin un réseau de segmentation pour décoder les caractéristiques BEV ; en cartes sémantiques. Plus précisément, les principales contributions de cette étude sont : Expérience d'ablation Comme le montre la première partie du tableau 2 ci-dessous, les chercheurs ont comparé l'attention douce (en regardant des deux côtés), l'attention monotone du retour en arrière du bas de l'image (en regardant vers le bas), le retour en arrière du haut de l'image (en regardant vers le haut) une attention monotone. Le long des indices de texture locaux - Ceci est cohérent avec la façon dont les humains tentent de déterminer la distance des objets dans les environnements urbains, où nous utilisons l'endroit où l'objet croise le plan du sol. Les résultats montrent également que l’observation dans les deux sens améliore encore la précision, rendant l’inférence profonde plus discriminante.

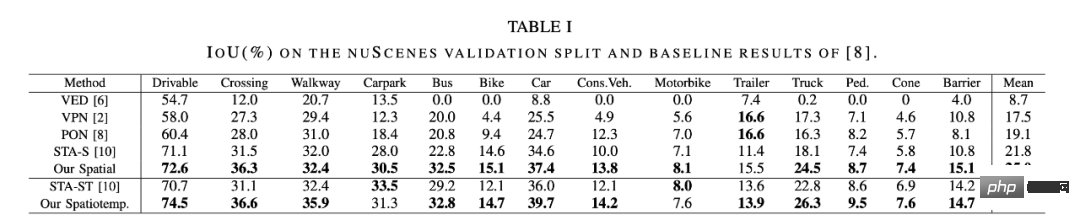

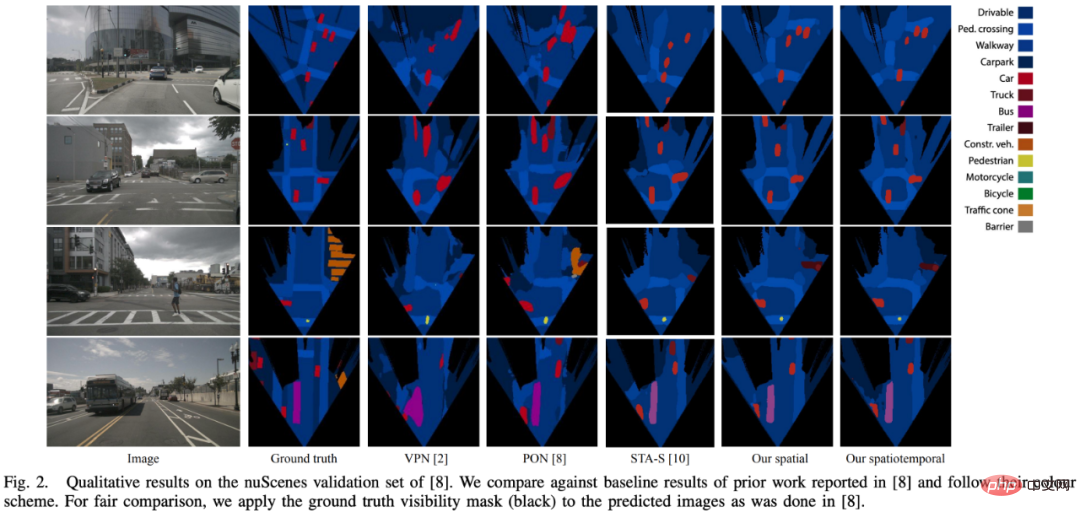

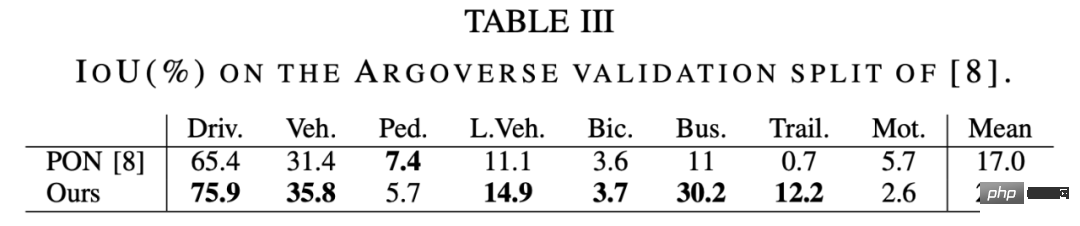

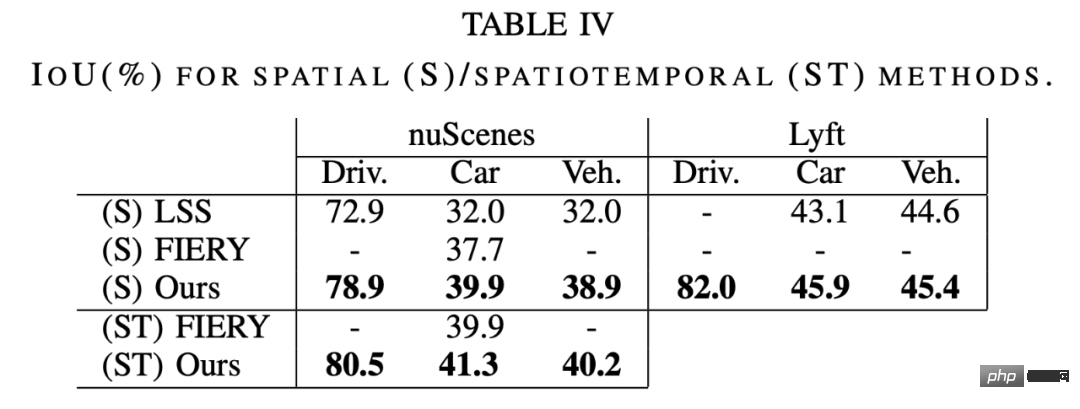

La conversion image en BEV ici est effectuée comme un ensemble de conversions séquence à séquence 1D, donc une question est de savoir ce qui se passe lorsque l'image entière est convertie en BEV. Compte tenu du temps de calcul secondaire et de la mémoire requis pour générer des cartes d’attention, cette approche est d’un coût prohibitif. Cependant, les avantages contextuels de l’utilisation de l’image entière peuvent être approximés en appliquant une attention axiale horizontale aux caractéristiques du plan de l’image. Avec une attention axiale à travers les lignes d'image, les pixels des lignes de balayage verticales ont désormais un contexte horizontal à longue portée, puis un contexte vertical à longue portée est fourni par la transition entre les séquences 1D comme auparavant. Comme le montre la partie centrale du tableau 2, , et a même un léger effet négatif. Cela illustre deux points : premièrement, chaque rayon transformé ne nécessite pas d'informations sur toute la largeur de l'image d'entrée, ou plutôt, le contexte de séquence longue ne fournit aucune information supplémentaire par rapport au contexte déjà agrégé par l'avantage de la convolution frontale. . Cela montre que l'utilisation de l'image entière pour effectuer la transformation n'améliorera pas la précision du modèle au-delà de la formule de contrainte de base. De plus, la dégradation des performances causée par l'introduction de l'attention axiale horizontale signifie la difficulté d'utiliser l'attention pour former des séquences de largeur d'image ; comme on peut le voir, il sera plus difficile de s'entraîner en utilisant l'image entière comme séquence d'entrée. : La dernière partie du tableau 2 compare les variantes Po-Ag et Po-Ad. Un modèle Po-Ag n'a pas d'informations de position de polarisation, le Po-Ad du plan image comprend des codages polaires ajoutés à l'encodeur Transformer, et pour le plan BEV, ces informations sont ajoutées au décodeur. L'ajout de codages polaires à l'un ou l'autre plan est plus avantageux que de l'ajouter au modèle agnostique, la classe dynamique étant celle qui en ajoute le plus. L'ajouter aux deux plans renforce encore cela, mais a le plus grand impact sur les classes statiques. Comparaison avec les méthodes SOTA Les chercheurs ont comparé cette méthode avec certaines méthodes SOTA. . Sur les classes dynamiques plus petites, l'amélioration est encore plus significative, la précision de détection des bus, camions, remorques et obstacles augmentant toutes de 35 à 45 %. Les résultats qualitatifs obtenus dans la figure 2 ci-dessous soutiennent également cette conclusion. Le modèle présenté dans cet article montre une plus grande similarité structurelle et un meilleur sens de la forme. Cette différence peut être partiellement attribuée aux couches entièrement connectées (FCL) utilisées pour la compression : lors de la détection d'objets petits et distants, une grande partie de l'image est un contexte redondant. De plus, les piétons et autres objets sont souvent partiellement bloqués par les véhicules. Dans ce cas, la couche entièrement connectée aura tendance à ignorer les piétons et à conserver la sémantique des véhicules. Ici, la méthode de l'attention montre son avantage car chaque profondeur radiale peut être remarquée indépendamment de l'image - de sorte que des profondeurs plus profondes peuvent rendre visibles les corps des piétons, tandis que les profondeurs précédentes ne peuvent détecter que les véhicules. Les résultats sur l'ensemble de données Argoverse dans le tableau 3 ci-dessous montrent un schéma similaire, dans lequel notre méthode s'améliore de 30 % par rapport à PON [8]. Comme le montre le tableau 4 ci-dessous, les performances de cette méthode sur nuScenes et Lyft sont meilleures que LSS [9] et FIERY [20]. Une véritable comparaison est impossible sur Lyft car il n'a pas de répartition canonique train/val, et il n'y a aucun moyen d'obtenir la répartition utilisée par LSS. Pour plus de détails sur la recherche, veuillez vous référer à l'article original.

Dans l'expérience, les chercheurs ont effectué plusieurs évaluations : traiter la conversion d'image en BEV comme un problème de conversion sur l'ensemble de données nuScenes pour évaluer son utilité ; utilité du contexte au niveau de la séquence et impact des informations de position polaire. Enfin, la méthode est comparée aux méthodes SOTA sur les ensembles de données nuScenes, Argoverse et Lyft.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Le modèle MoE open source le plus puissant au monde est ici, avec des capacités chinoises comparables à celles du GPT-4, et le prix ne représente que près d'un pour cent de celui du GPT-4-Turbo.

May 07, 2024 pm 04:13 PM

Le modèle MoE open source le plus puissant au monde est ici, avec des capacités chinoises comparables à celles du GPT-4, et le prix ne représente que près d'un pour cent de celui du GPT-4-Turbo.

May 07, 2024 pm 04:13 PM

Imaginez un modèle d'intelligence artificielle qui non seulement a la capacité de surpasser l'informatique traditionnelle, mais qui permet également d'obtenir des performances plus efficaces à moindre coût. Ce n'est pas de la science-fiction, DeepSeek-V2[1], le modèle MoE open source le plus puissant au monde est ici. DeepSeek-V2 est un puissant mélange de modèle de langage d'experts (MoE) présentant les caractéristiques d'une formation économique et d'une inférence efficace. Il est constitué de 236B paramètres, dont 21B servent à activer chaque marqueur. Par rapport à DeepSeek67B, DeepSeek-V2 offre des performances plus élevées, tout en économisant 42,5 % des coûts de formation, en réduisant le cache KV de 93,3 % et en augmentant le débit de génération maximal à 5,76 fois. DeepSeek est une entreprise explorant l'intelligence artificielle générale

Comment résoudre le problème de la longue traîne dans les scénarios de conduite autonome ?

Jun 02, 2024 pm 02:44 PM

Comment résoudre le problème de la longue traîne dans les scénarios de conduite autonome ?

Jun 02, 2024 pm 02:44 PM

Hier, lors de l'entretien, on m'a demandé si j'avais posé des questions à longue traîne, j'ai donc pensé faire un bref résumé. Le problème à longue traîne de la conduite autonome fait référence aux cas extrêmes dans les véhicules autonomes, c'est-à-dire à des scénarios possibles avec une faible probabilité d'occurrence. Le problème perçu de la longue traîne est l’une des principales raisons limitant actuellement le domaine de conception opérationnelle des véhicules autonomes intelligents à véhicule unique. L'architecture sous-jacente et la plupart des problèmes techniques de la conduite autonome ont été résolus, et les 5 % restants des problèmes à longue traîne sont progressivement devenus la clé pour restreindre le développement de la conduite autonome. Ces problèmes incluent une variété de scénarios fragmentés, de situations extrêmes et de comportements humains imprévisibles. La « longue traîne » des scénarios limites dans la conduite autonome fait référence aux cas limites dans les véhicules autonomes (VA). Les cas limites sont des scénarios possibles avec une faible probabilité d'occurrence. ces événements rares

Bonjour, Atlas électrique ! Le robot Boston Dynamics revient à la vie, des mouvements étranges à 180 degrés effraient Musk

Apr 18, 2024 pm 07:58 PM

Bonjour, Atlas électrique ! Le robot Boston Dynamics revient à la vie, des mouvements étranges à 180 degrés effraient Musk

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas entre officiellement dans l’ère des robots électriques ! Hier, l'Atlas hydraulique s'est retiré "en larmes" de la scène de l'histoire. Aujourd'hui, Boston Dynamics a annoncé que l'Atlas électrique était au travail. Il semble que dans le domaine des robots humanoïdes commerciaux, Boston Dynamics soit déterminé à concurrencer Tesla. Après la sortie de la nouvelle vidéo, elle a déjà été visionnée par plus d’un million de personnes en seulement dix heures. Les personnes âgées partent et de nouveaux rôles apparaissent. C'est une nécessité historique. Il ne fait aucun doute que cette année est l’année explosive des robots humanoïdes. Les internautes ont commenté : Les progrès des robots ont fait ressembler la cérémonie d'ouverture de cette année à des êtres humains, et le degré de liberté est bien plus grand que celui des humains. Mais n'est-ce vraiment pas un film d'horreur ? Au début de la vidéo, Atlas est allongé calmement sur le sol, apparemment sur le dos. Ce qui suit est à couper le souffle

KAN, qui remplace MLP, a été étendu à la convolution par des projets open source

Jun 01, 2024 pm 10:03 PM

KAN, qui remplace MLP, a été étendu à la convolution par des projets open source

Jun 01, 2024 pm 10:03 PM

Plus tôt ce mois-ci, des chercheurs du MIT et d'autres institutions ont proposé une alternative très prometteuse au MLP – KAN. KAN surpasse MLP en termes de précision et d’interprétabilité. Et il peut surpasser le MLP fonctionnant avec un plus grand nombre de paramètres avec un très petit nombre de paramètres. Par exemple, les auteurs ont déclaré avoir utilisé KAN pour reproduire les résultats de DeepMind avec un réseau plus petit et un degré d'automatisation plus élevé. Plus précisément, le MLP de DeepMind compte environ 300 000 paramètres, tandis que le KAN n'en compte qu'environ 200. KAN a une base mathématique solide comme MLP est basé sur le théorème d'approximation universelle, tandis que KAN est basé sur le théorème de représentation de Kolmogorov-Arnold. Comme le montre la figure ci-dessous, KAN a

L'IA bouleverse la recherche mathématique ! Le lauréat de la médaille Fields et mathématicien sino-américain a dirigé 11 articles les mieux classés | Aimé par Terence Tao

Apr 09, 2024 am 11:52 AM

L'IA bouleverse la recherche mathématique ! Le lauréat de la médaille Fields et mathématicien sino-américain a dirigé 11 articles les mieux classés | Aimé par Terence Tao

Apr 09, 2024 am 11:52 AM

L’IA change effectivement les mathématiques. Récemment, Tao Zhexuan, qui a prêté une attention particulière à cette question, a transmis le dernier numéro du « Bulletin de l'American Mathematical Society » (Bulletin de l'American Mathematical Society). En se concentrant sur le thème « Les machines changeront-elles les mathématiques ? », de nombreux mathématiciens ont exprimé leurs opinions. L'ensemble du processus a été plein d'étincelles, intense et passionnant. L'auteur dispose d'une équipe solide, comprenant Akshay Venkatesh, lauréat de la médaille Fields, le mathématicien chinois Zheng Lejun, l'informaticien de l'Université de New York Ernest Davis et de nombreux autres universitaires bien connus du secteur. Le monde de l’IA a radicalement changé. Vous savez, bon nombre de ces articles ont été soumis il y a un an.

Google est ravi : les performances de JAX surpassent Pytorch et TensorFlow ! Cela pourrait devenir le choix le plus rapide pour la formation à l'inférence GPU

Apr 01, 2024 pm 07:46 PM

Google est ravi : les performances de JAX surpassent Pytorch et TensorFlow ! Cela pourrait devenir le choix le plus rapide pour la formation à l'inférence GPU

Apr 01, 2024 pm 07:46 PM

Les performances de JAX, promu par Google, ont dépassé celles de Pytorch et TensorFlow lors de récents tests de référence, se classant au premier rang sur 7 indicateurs. Et le test n’a pas été fait sur le TPU présentant les meilleures performances JAX. Bien que parmi les développeurs, Pytorch soit toujours plus populaire que Tensorflow. Mais à l’avenir, des modèles plus volumineux seront peut-être formés et exécutés sur la base de la plate-forme JAX. Modèles Récemment, l'équipe Keras a comparé trois backends (TensorFlow, JAX, PyTorch) avec l'implémentation native de PyTorch et Keras2 avec TensorFlow. Premièrement, ils sélectionnent un ensemble de

NuScenes dernier SOTA SparseAD : les requêtes clairsemées contribuent à une conduite autonome efficace de bout en bout !

Apr 17, 2024 pm 06:22 PM

NuScenes dernier SOTA SparseAD : les requêtes clairsemées contribuent à une conduite autonome efficace de bout en bout !

Apr 17, 2024 pm 06:22 PM

Écrit à l'avant et point de départ Le paradigme de bout en bout utilise un cadre unifié pour réaliser plusieurs tâches dans les systèmes de conduite autonome. Malgré la simplicité et la clarté de ce paradigme, les performances des méthodes de conduite autonome de bout en bout sur les sous-tâches sont encore loin derrière les méthodes à tâche unique. Dans le même temps, les fonctionnalités de vue à vol d'oiseau (BEV) denses, largement utilisées dans les méthodes de bout en bout précédentes, rendent difficile l'adaptation à davantage de modalités ou de tâches. Un paradigme de conduite autonome de bout en bout (SparseAD) centré sur la recherche clairsemée est proposé ici, dans lequel la recherche clairsemée représente entièrement l'ensemble du scénario de conduite, y compris l'espace, le temps et les tâches, sans aucune représentation BEV dense. Plus précisément, une architecture clairsemée unifiée est conçue pour la connaissance des tâches, notamment la détection, le suivi et la cartographie en ligne. De plus, lourd

Les robots Tesla travaillent dans les usines, Musk : Le degré de liberté des mains atteindra 22 cette année !

May 06, 2024 pm 04:13 PM

Les robots Tesla travaillent dans les usines, Musk : Le degré de liberté des mains atteindra 22 cette année !

May 06, 2024 pm 04:13 PM

La dernière vidéo du robot Optimus de Tesla est sortie, et il peut déjà fonctionner en usine. À vitesse normale, il trie les batteries (les batteries 4680 de Tesla) comme ceci : Le responsable a également publié à quoi cela ressemble à une vitesse 20 fois supérieure - sur un petit "poste de travail", en sélectionnant et en sélectionnant et en sélectionnant : Cette fois, il est publié L'un des points forts de la vidéo est qu'Optimus réalise ce travail en usine, de manière totalement autonome, sans intervention humaine tout au long du processus. Et du point de vue d'Optimus, il peut également récupérer et placer la batterie tordue, en se concentrant sur la correction automatique des erreurs : concernant la main d'Optimus, le scientifique de NVIDIA Jim Fan a donné une évaluation élevée : la main d'Optimus est l'un des robots à cinq doigts du monde. le plus adroit. Ses mains ne sont pas seulement tactiles