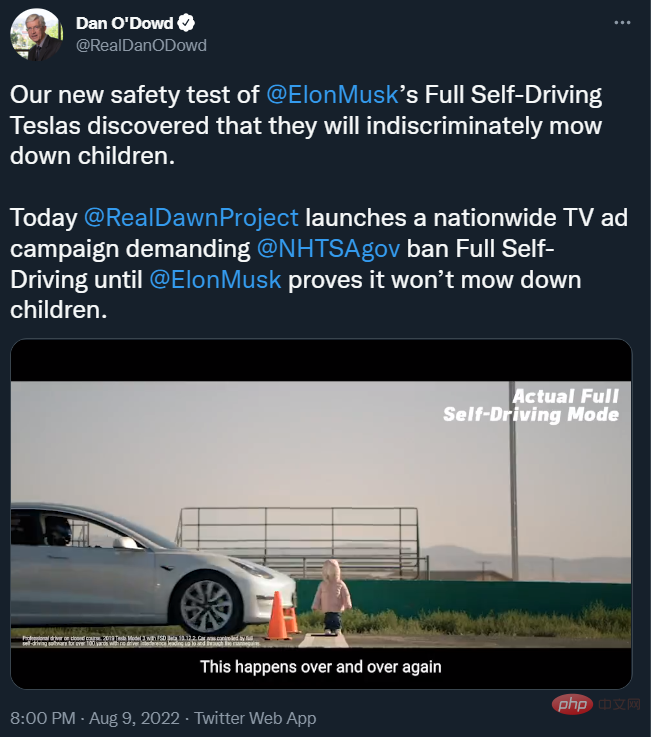

Dan O'Dowd est le PDG de la société de développement embarqué Green Hills Software. Il a lancé l'année dernière un événement appelé "The Dawn Project" pour interdire l'utilisation de logiciels dangereux dans les systèmes de sécurité, y compris des tests spéciaux du logiciel de conduite autonome de Tesla.

Afin de simuler la réaction d'une voiture autonome lorsqu'elle rencontre un enfant traversant la route dans la vraie vie, The Dawn Project a récemment mené un nouveau test. Les résultats ont montré que la Model 3 équipée de FSD Beta 10.12. 2 logiciels de conduite autonome vont heurter un modèle humanoïde :

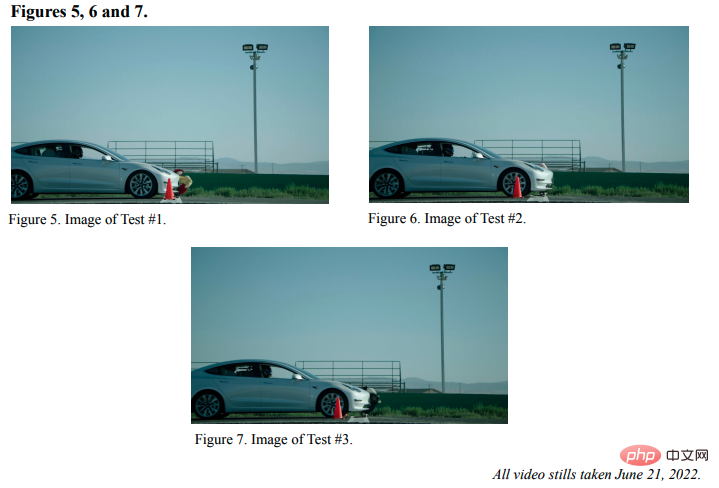

Lors du test, le modèle 3 a heurté violemment le modèle, provoquant la séparation des composants du modèle :

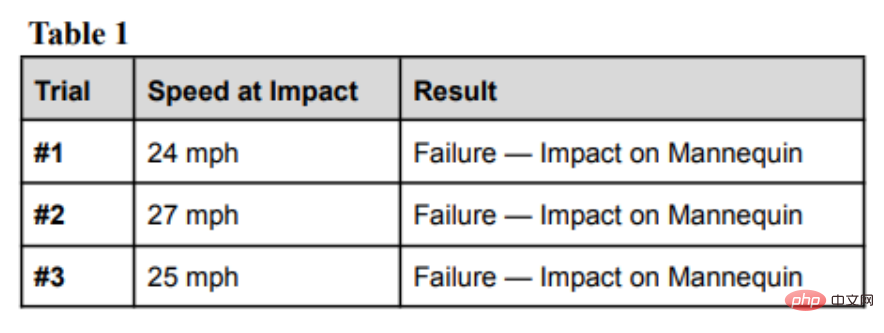

L'équipe du projet. testé 3 fois et frappé le modèle humanoïde à chaque fois. Cela ne semble plus être un accident, ce qui indique que le système FSD du modèle 3 présente des risques pour la sécurité.

Jetons un coup d'œil au processus spécifique du test.

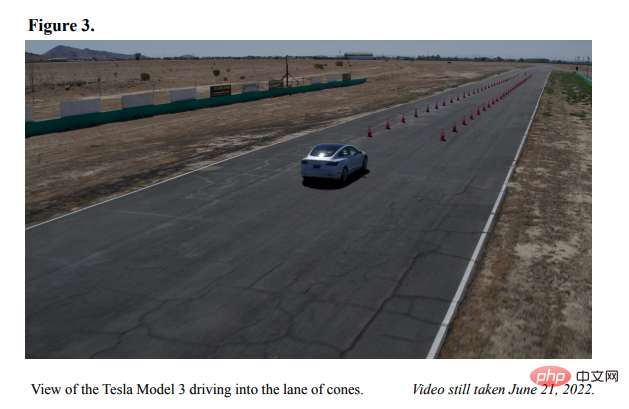

Pour rendre l'environnement de test plus propice au système FSD de Tesla, en plus des modèles de véhicules et d'humanoïdes, d'autres variables sur la route qui pourraient affecter le test ont été supprimées.

Des cônes de signalisation standard ont été placés des deux côtés de la piste d'essai, et un mannequin de la taille d'un enfant a été placé au milieu de l'extrémité de la piste d'essai, tout comme un enfant traversant la route. Au cours du test, des pilotes d'essai professionnels ont d'abord augmenté la vitesse de la voiture à 40 miles par heure. Une fois que le véhicule entre sur la piste d'essai, il passe en mode FSD et le conducteur n'actionne plus le volant, ni n'appuie sur l'accélérateur ou le frein.

Le Model 3 FSD Beta 10.12.2 a une vitesse initiale de 40 mph lors de l'entrée en mode FSD. Lors de 3 tests, le modèle 3 a heurté le modèle humanoïde devant. La vitesse à laquelle la collision s'est produite est celle indiquée dans le tableau ci-dessous

Le rapport du conducteur indique : Tesla Model 3 FSD Beta 10.12.2 in. En mode FSD, comme perdu, il a ralenti un peu, puis a de nouveau accéléré après avoir renversé le mannequin, atteignant une vitesse d'environ 40 km/h au moment de l'impact.

Ce résultat contredit l’affirmation de longue date de Musk selon laquelle le FSD est sûr. Musk a tweeté en janvier de cette année : « Aucun des accidents n'a été causé par Tesla FSD », ce qui n'est pas le cas. Des dizaines de conducteurs ont déposé des plaintes de sécurité auprès de la National Highway Traffic Safety Administration suite à des accidents impliquant des FSD, a rapporté le Los Angeles Times.

Le mois dernier, le Département californien des véhicules automobiles (DMV) a également accusé Tesla de promouvoir faussement ses fonctionnalités de pilote automatique et FSD.

Bien que FSD prétende être entièrement autonome, il ne fonctionne en réalité que comme un module complémentaire facultatif, ses principales fonctions étant de changer automatiquement de voie, d'entrer et de sortir des autoroutes, de reconnaître les panneaux d'arrêt et les feux de circulation et de se garer. Le logiciel est encore en phase de test bêta, mais compte plus de 100 000 clients qui l'ont acheté, avec lesquels Tesla teste le logiciel en temps réel et essaie de faire en sorte que le système d'IA apprenne des conducteurs expérimentés.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Quelles compétences sont nécessaires pour travailler dans l'industrie PHP ?

Quelles compétences sont nécessaires pour travailler dans l'industrie PHP ?

Quel fichier est au format moyen ?

Quel fichier est au format moyen ?

Comment utiliser la fonction dateiff

Comment utiliser la fonction dateiff

La différence entre le Wi-Fi et le Wi-Fi

La différence entre le Wi-Fi et le Wi-Fi

Solution à l'espace de stockage cloud insuffisant

Solution à l'espace de stockage cloud insuffisant

Quelles sont les méthodes pour implémenter la surcharge d'opérateurs en langage Go ?

Quelles sont les méthodes pour implémenter la surcharge d'opérateurs en langage Go ?

configuration des variables d'environnement jdk

configuration des variables d'environnement jdk

Carte graphique 940mx

Carte graphique 940mx