Périphériques technologiques

Périphériques technologiques

IA

IA

En utilisant une seule ligne de code pour améliorer considérablement l'effet des méthodes d'apprentissage sans tir, l'Université de technologie de Nanjing et Oxford proposent un module de classification plug-and-play.

En utilisant une seule ligne de code pour améliorer considérablement l'effet des méthodes d'apprentissage sans tir, l'Université de technologie de Nanjing et Oxford proposent un module de classification plug-and-play.

En utilisant une seule ligne de code pour améliorer considérablement l'effet des méthodes d'apprentissage sans tir, l'Université de technologie de Nanjing et Oxford proposent un module de classification plug-and-play.

Zero-Shot Learning se concentre sur la classification des catégories qui ne sont pas apparues au cours du processus de formation. L'apprentissage Zero-shot basé sur la description sémantique réalise la classification à partir de classes visibles (transfert de connaissances d'une classe vue à une classe invisible). L'apprentissage zéro-shot traditionnel doit uniquement identifier les classes invisibles lors de la phase de test, tandis que l'apprentissage zéro-shot généralisé (GZSL) doit identifier à la fois les classes visibles et invisibles. Ses indicateurs d'évaluation sont la précision moyenne des classes visibles et la précision moyenne des classes invisibles. classes. Moyenne harmonique de précision.

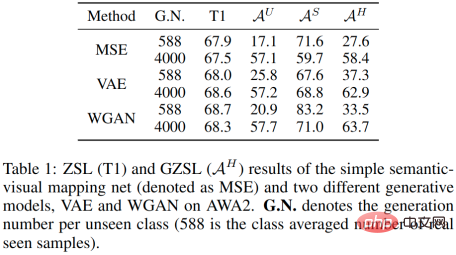

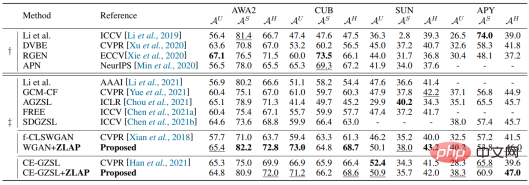

Une stratégie générale d'apprentissage sans tir consiste à utiliser des échantillons de classe visibles et la sémantique pour former un modèle de génération conditionnelle de l'espace sémantique à l'espace d'échantillon visuel, puis à utiliser la sémantique de classe invisible pour générer des pseudo-échantillons de classes invisibles, et enfin à utiliser des classes invisibles. classes Des échantillons et pseudo-échantillons de classes invisibles sont utilisés pour entraîner le réseau de classification. Cependant, l'apprentissage d'une bonne relation de cartographie entre deux modalités (modalité sémantique et modalité visuelle) nécessite généralement un grand nombre d'échantillons (voir CLIP), ce qui ne peut pas être obtenu dans les environnements d'apprentissage zéro-shot traditionnels. Par conséquent, la distribution d'échantillons visuels générée à l'aide d'une sémantique de classe invisible s'écarte généralement de la distribution d'échantillons réelle, ce qui signifie les deux points suivants : 1. La précision de classe invisible obtenue par cette méthode est limitée. 2. Lorsque le nombre moyen de pseudo-échantillons générés par classe pour les classes invisibles est équivalent au nombre moyen d'échantillons pour chaque classe pour les classes visibles, il existe une grande différence entre l'exactitude des classes invisibles et l'exactitude des classes visibles, comme indiqué dans le tableau 1 ci-dessous.

Nous avons constaté que même si nous apprenons uniquement le mappage de la sémantique aux points centraux de catégorie et copions le point d'échantillonnage unique sur lequel la sémantique de classe invisible est mappée plusieurs fois, puis participons à la formation du classificateur, nous pouvons nous rapprocher de l’utilisation de l’effet de modèle génératif. Cela signifie que les caractéristiques invisibles du pseudo-échantillon générées par le modèle génératif sont relativement homogènes pour le classificateur.

Les méthodes précédentes répondent généralement à la métrique d'évaluation GZSL en générant un grand nombre de pseudo-échantillons de classe invisibles (bien qu'un grand nombre d'échantillons ne soit pas utile pour la discrimination inter-classes invisible). Cependant, il a été prouvé que cette stratégie de rééchantillonnage dans le domaine de l'apprentissage à longue traîne entraînait un surajustement du classificateur sur certaines caractéristiques, ce qui est pseudo-invisible et s'écarte des caractéristiques réelles de la classe. Cette situation n’est pas propice à l’identification d’échantillons réels de classes visibles et invisibles. Alors, pouvons-nous abandonner cette stratégie de rééchantillonnage et utiliser à la place le décalage et l'homogénéité de la génération de pseudo-échantillons de classes invisibles (ou le déséquilibre de classes entre les classes vues et les classes invisibles) comme biais inductif ?

Sur cette base, nous avons proposé un module de classificateur plug-and-play qui peut améliorer l'effet de la méthode d'apprentissage génératif zéro-shot en modifiant simplement une ligne de code. Seuls 10 pseudo-échantillons sont générés par classe invisible pour atteindre le niveau SOTA. Par rapport à d'autres méthodes génératives à échantillon nul, la nouvelle méthode présente un énorme avantage en termes de complexité de calcul. Les membres de recherche viennent de l’Université des sciences et technologies de Nanjing et de l’Université d’Oxford.

- Papier : https://arxiv.org/abs/2204.11822

- Code : https://github.com/cdb342/IJCAI-2022-Z LA

Cet article utilise les objectifs cohérents de formation et de test comme guide pour dériver la limite inférieure variationnelle de l'indice d'évaluation de l'apprentissage zéro-shot généralisé. Le classificateur modélisé de cette manière peut éviter d'utiliser la stratégie de réadoption et empêcher le classificateur de surajuster les pseudo-échantillons générés et d'affecter négativement la reconnaissance des échantillons réels. La méthode proposée peut rendre le classificateur basé sur l'intégration efficace dans le cadre de la méthode générative et réduire la dépendance du classificateur à l'égard de la qualité des pseudo-échantillons générés.

Méthode

1. Présentation du prior paramétré

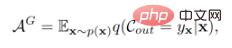

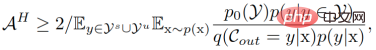

Nous avons décidé de commencer par la fonction de perte du classificateur. En supposant que l'espace des classes a été complété par des pseudo-échantillons générés de classes invisibles, le classificateur précédent est optimisé dans le but de maximiser la précision globale :

où  est la précision globale,

est la précision globale,  représente la sortie du classificateur,

représente la sortie du classificateur,  représente la distribution de l'échantillon,

représente la distribution de l'échantillon,  est l'étiquette correspondante de l'échantillon X. Les indicateurs d'évaluation de GZSL sont :

est l'étiquette correspondante de l'échantillon X. Les indicateurs d'évaluation de GZSL sont :

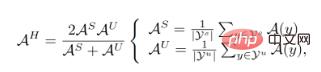

où  et

et  représentent respectivement l'ensemble des classes visibles et invisibles. L'incohérence entre les objectifs de formation et les objectifs de test signifie que les stratégies de formation précédentes des classificateurs ne prenaient pas en compte les différences entre les classes visibles et invisibles. Naturellement, nous essayons d'obtenir des résultats cohérents avec les objectifs d'entraînement et de tests en dérivant

représentent respectivement l'ensemble des classes visibles et invisibles. L'incohérence entre les objectifs de formation et les objectifs de test signifie que les stratégies de formation précédentes des classificateurs ne prenaient pas en compte les différences entre les classes visibles et invisibles. Naturellement, nous essayons d'obtenir des résultats cohérents avec les objectifs d'entraînement et de tests en dérivant  . Après dérivation, nous avons obtenu sa borne inférieure :

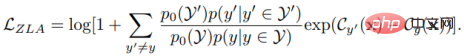

. Après dérivation, nous avons obtenu sa borne inférieure :

où  représente la classe visible - la classe invisible a priori, qui est indépendante des données et est ajustée comme un hyperparamètre dans l'expérience,

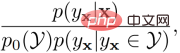

représente la classe visible - la classe invisible a priori, qui est indépendante des données et est ajustée comme un hyperparamètre dans l'expérience,  représente la classe visible ou l'antériorité interne de classe invisible est remplacée par la fréquence d'échantillonnage de classe vue ou une distribution uniforme pendant le processus de mise en œuvre. En maximisant la limite inférieure de

représente la classe visible ou l'antériorité interne de classe invisible est remplacée par la fréquence d'échantillonnage de classe vue ou une distribution uniforme pendant le processus de mise en œuvre. En maximisant la limite inférieure de  , nous obtenons l'objectif d'optimisation final :

, nous obtenons l'objectif d'optimisation final :

En conséquence, notre objectif de modélisation de classification présente les changements suivants par rapport au précédent :

Par l'utilisation de l'entropie croisée correspond à la probabilité postérieure  , et nous obtenons la perte du classificateur comme :

, et nous obtenons la perte du classificateur comme :

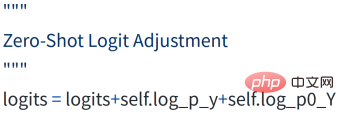

Ceci est similaire à l'ajustement logit dans l'apprentissage à longue traîne, nous l'appelons donc ajustement logit à échantillon nul (ZLA). Jusqu'à présent, nous avons implémenté l'introduction de priorités paramétrées pour implanter le déséquilibre des catégories entre les classes vues et les classes invisibles en tant que biais inductif dans la formation du classificateur, et il suffit d'ajouter des termes de biais supplémentaires aux logits d'origine dans l'implémentation du code pour obtenir ce qui précède. effets.

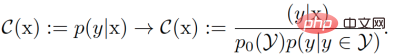

2. Présentation du prior sémantique

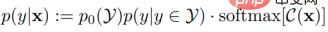

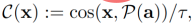

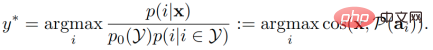

Jusqu'à présent, le noyau du transfert zéro-shot, c'est-à-dire le prior sémantique (prior sémantique), ne joue qu'un rôle dans la formation du générateur et la génération de pseudo-échantillons. entièrement sur la qualité des pseudo-échantillons générés de classes invisibles. Évidemment, si des a priori sémantiques peuvent être introduits lors de la phase de formation du classificateur, cela aidera à identifier les classes invisibles. Dans le domaine de l’apprentissage zéro-shot, il existe une classe de méthodes basées sur l’intégration qui peuvent réaliser cette fonction. Cependant, ce type de méthode est similaire aux connaissances apprises par le modèle génératif, c'est-à-dire le lien entre sémantique et vision (lien sémantique-visuel), qui a conduit à l'introduction directe du cadre génératif précédent (se référer à l'article f -CLSWGAN) basé sur le classificateur intégré ne peut pas obtenir de meilleurs résultats que l'original (à moins que le classificateur lui-même n'ait de meilleures performances de tir nul). Grâce à la stratégie ZLA proposée dans cet article, nous sommes en mesure de modifier le rôle que jouent les pseudo-échantillons de classe invisibles générés dans la formation du classificateur. De la fourniture initiale d'informations sur les classes invisibles à l'ajustement actuel de la frontière de décision entre les classes invisibles et les classes visibles, nous pouvons introduire des priorités sémantiques dans la phase de formation du classificateur. Plus précisément, nous utilisons une méthode d'apprentissage de prototype pour mapper la sémantique de chaque catégorie dans un prototype visuel (c'est-à-dire le poids du classificateur), puis modélisons la probabilité a posteriori ajustée comme la similarité cosinusoïdale entre l'échantillon et le prototype visuel Degré (similitude cosinusoïdale). , c'est-à-dire

où  est le coefficient de température. Dans la phase de test, il est prévu que les échantillons correspondent à la catégorie du prototype visuel présentant la plus grande similarité cosinusoïdale.

est le coefficient de température. Dans la phase de test, il est prévu que les échantillons correspondent à la catégorie du prototype visuel présentant la plus grande similarité cosinusoïdale.

Expériences

Nous avons combiné le classificateur proposé avec le WGAN de base et obtenu des résultats comparables aux SoTA en générant 10 échantillons par classe invisible. De plus, nous l'avons inséré dans la méthode CE-GZSL plus avancée, améliorant l'effet initial sans modifier d'autres paramètres (y compris le nombre d'échantillons générés).

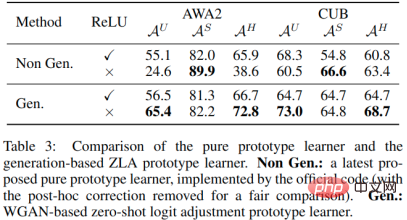

Dans des expériences d'ablation, nous avons comparé un apprenant prototype basé sur une génération avec un apprenant prototype pur. Nous avons constaté que la dernière couche ReLU est essentielle au succès d'un apprenant pur prototype, car la suppression des nombres négatifs augmente la similitude du prototype de catégorie avec les fonctionnalités de classe invisibles (les fonctionnalités de classe invisibles sont également activées par ReLU). Cependant, fixer certaines valeurs à zéro limite également l'expression du prototype, ce qui n'est pas propice à des performances de reconnaissance ultérieures. L'utilisation d'échantillons de classe pseudo-invisibles pour compenser les informations de classe invisibles peut non seulement obtenir des performances plus élevées lors de l'utilisation de RuLU, mais également atteindre une transcendance supplémentaire des performances sans couche ReLU.

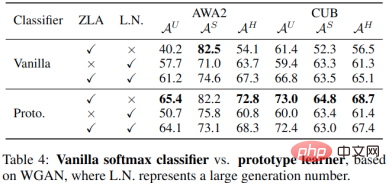

Dans une autre étude d'ablation, nous avons comparé un prototype d'apprenant avec un classificateur initial. Les résultats montrent que le prototype d’apprenant n’a aucun avantage sur le classificateur initial lorsqu’il génère un grand nombre d’échantillons de classe invisibles. En utilisant la technologie ZLA proposée dans cet article, le prototype d’apprenant montre sa supériorité. Comme mentionné précédemment, cela est dû au fait que le prototype d'apprenant et le modèle génératif apprennent des connexions sémantiques-visuelles, de sorte que les informations sémantiques sont difficiles à utiliser pleinement. ZLA permet aux échantillons de classe invisibles générés d'ajuster la limite de décision au lieu de simplement fournir des informations de classe invisibles, activant ainsi le prototype d'apprenant.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Cet article vous amènera à comprendre SHAP : explication du modèle pour l'apprentissage automatique

Jun 01, 2024 am 10:58 AM

Cet article vous amènera à comprendre SHAP : explication du modèle pour l'apprentissage automatique

Jun 01, 2024 am 10:58 AM

Dans les domaines de l’apprentissage automatique et de la science des données, l’interprétabilité des modèles a toujours été au centre des préoccupations des chercheurs et des praticiens. Avec l'application généralisée de modèles complexes tels que l'apprentissage profond et les méthodes d'ensemble, la compréhension du processus décisionnel du modèle est devenue particulièrement importante. Explainable AI|XAI contribue à renforcer la confiance dans les modèles d'apprentissage automatique en augmentant la transparence du modèle. L'amélioration de la transparence des modèles peut être obtenue grâce à des méthodes telles que l'utilisation généralisée de plusieurs modèles complexes, ainsi que les processus décisionnels utilisés pour expliquer les modèles. Ces méthodes incluent l'analyse de l'importance des caractéristiques, l'estimation de l'intervalle de prédiction du modèle, les algorithmes d'interprétabilité locale, etc. L'analyse de l'importance des fonctionnalités peut expliquer le processus de prise de décision du modèle en évaluant le degré d'influence du modèle sur les fonctionnalités d'entrée. Estimation de l’intervalle de prédiction du modèle

Identifier le surapprentissage et le sous-apprentissage grâce à des courbes d'apprentissage

Apr 29, 2024 pm 06:50 PM

Identifier le surapprentissage et le sous-apprentissage grâce à des courbes d'apprentissage

Apr 29, 2024 pm 06:50 PM

Cet article présentera comment identifier efficacement le surajustement et le sous-apprentissage dans les modèles d'apprentissage automatique grâce à des courbes d'apprentissage. Sous-ajustement et surajustement 1. Surajustement Si un modèle est surentraîné sur les données de sorte qu'il en tire du bruit, alors on dit que le modèle est en surajustement. Un modèle surajusté apprend chaque exemple si parfaitement qu'il classera mal un exemple inédit/inédit. Pour un modèle surajusté, nous obtiendrons un score d'ensemble d'entraînement parfait/presque parfait et un score d'ensemble/test de validation épouvantable. Légèrement modifié : "Cause du surajustement : utilisez un modèle complexe pour résoudre un problème simple et extraire le bruit des données. Parce qu'un petit ensemble de données en tant qu'ensemble d'entraînement peut ne pas représenter la représentation correcte de toutes les données."

Transparent! Une analyse approfondie des principes des principaux modèles de machine learning !

Apr 12, 2024 pm 05:55 PM

Transparent! Une analyse approfondie des principes des principaux modèles de machine learning !

Apr 12, 2024 pm 05:55 PM

En termes simples, un modèle d’apprentissage automatique est une fonction mathématique qui mappe les données d’entrée à une sortie prédite. Plus précisément, un modèle d'apprentissage automatique est une fonction mathématique qui ajuste les paramètres du modèle en apprenant à partir des données d'entraînement afin de minimiser l'erreur entre la sortie prédite et la véritable étiquette. Il existe de nombreux modèles dans l'apprentissage automatique, tels que les modèles de régression logistique, les modèles d'arbre de décision, les modèles de machines à vecteurs de support, etc. Chaque modèle a ses types de données et ses types de problèmes applicables. Dans le même temps, il existe de nombreux points communs entre les différents modèles, ou il existe une voie cachée pour l’évolution du modèle. En prenant comme exemple le perceptron connexionniste, en augmentant le nombre de couches cachées du perceptron, nous pouvons le transformer en un réseau neuronal profond. Si une fonction noyau est ajoutée au perceptron, elle peut être convertie en SVM. celui-ci

L'évolution de l'intelligence artificielle dans l'exploration spatiale et l'ingénierie des établissements humains

Apr 29, 2024 pm 03:25 PM

L'évolution de l'intelligence artificielle dans l'exploration spatiale et l'ingénierie des établissements humains

Apr 29, 2024 pm 03:25 PM

Dans les années 1950, l’intelligence artificielle (IA) est née. C’est à ce moment-là que les chercheurs ont découvert que les machines pouvaient effectuer des tâches similaires à celles des humains, comme penser. Plus tard, dans les années 1960, le Département américain de la Défense a financé l’intelligence artificielle et créé des laboratoires pour poursuivre son développement. Les chercheurs trouvent des applications à l’intelligence artificielle dans de nombreux domaines, comme l’exploration spatiale et la survie dans des environnements extrêmes. L'exploration spatiale est l'étude de l'univers, qui couvre l'ensemble de l'univers au-delà de la terre. L’espace est classé comme environnement extrême car ses conditions sont différentes de celles de la Terre. Pour survivre dans l’espace, de nombreux facteurs doivent être pris en compte et des précautions doivent être prises. Les scientifiques et les chercheurs pensent qu'explorer l'espace et comprendre l'état actuel de tout peut aider à comprendre le fonctionnement de l'univers et à se préparer à d'éventuelles crises environnementales.

Implémentation d'algorithmes d'apprentissage automatique en C++ : défis et solutions courants

Jun 03, 2024 pm 01:25 PM

Implémentation d'algorithmes d'apprentissage automatique en C++ : défis et solutions courants

Jun 03, 2024 pm 01:25 PM

Les défis courants rencontrés par les algorithmes d'apprentissage automatique en C++ incluent la gestion de la mémoire, le multithread, l'optimisation des performances et la maintenabilité. Les solutions incluent l'utilisation de pointeurs intelligents, de bibliothèques de threads modernes, d'instructions SIMD et de bibliothèques tierces, ainsi que le respect des directives de style de codage et l'utilisation d'outils d'automatisation. Des cas pratiques montrent comment utiliser la bibliothèque Eigen pour implémenter des algorithmes de régression linéaire, gérer efficacement la mémoire et utiliser des opérations matricielles hautes performances.

Cinq écoles d'apprentissage automatique que vous ne connaissez pas

Jun 05, 2024 pm 08:51 PM

Cinq écoles d'apprentissage automatique que vous ne connaissez pas

Jun 05, 2024 pm 08:51 PM

L'apprentissage automatique est une branche importante de l'intelligence artificielle qui donne aux ordinateurs la possibilité d'apprendre à partir de données et d'améliorer leurs capacités sans être explicitement programmés. L'apprentissage automatique a un large éventail d'applications dans divers domaines, de la reconnaissance d'images et du traitement du langage naturel aux systèmes de recommandation et à la détection des fraudes, et il change notre façon de vivre. Il existe de nombreuses méthodes et théories différentes dans le domaine de l'apprentissage automatique, parmi lesquelles les cinq méthodes les plus influentes sont appelées les « Cinq écoles d'apprentissage automatique ». Les cinq grandes écoles sont l’école symbolique, l’école connexionniste, l’école évolutionniste, l’école bayésienne et l’école analogique. 1. Le symbolisme, également connu sous le nom de symbolisme, met l'accent sur l'utilisation de symboles pour le raisonnement logique et l'expression des connaissances. Cette école de pensée estime que l'apprentissage est un processus de déduction inversée, à travers les connaissances existantes.

IA explicable : Expliquer les modèles IA/ML complexes

Jun 03, 2024 pm 10:08 PM

IA explicable : Expliquer les modèles IA/ML complexes

Jun 03, 2024 pm 10:08 PM

Traducteur | Revu par Li Rui | Chonglou Les modèles d'intelligence artificielle (IA) et d'apprentissage automatique (ML) deviennent aujourd'hui de plus en plus complexes, et le résultat produit par ces modèles est une boîte noire – impossible à expliquer aux parties prenantes. L'IA explicable (XAI) vise à résoudre ce problème en permettant aux parties prenantes de comprendre comment fonctionnent ces modèles, en s'assurant qu'elles comprennent comment ces modèles prennent réellement des décisions et en garantissant la transparence des systèmes d'IA, la confiance et la responsabilité pour résoudre ce problème. Cet article explore diverses techniques d'intelligence artificielle explicable (XAI) pour illustrer leurs principes sous-jacents. Plusieurs raisons pour lesquelles l’IA explicable est cruciale Confiance et transparence : pour que les systèmes d’IA soient largement acceptés et fiables, les utilisateurs doivent comprendre comment les décisions sont prises

Flash Attention est-il stable ? Meta et Harvard ont constaté que les écarts de poids de leur modèle fluctuaient de plusieurs ordres de grandeur.

May 30, 2024 pm 01:24 PM

Flash Attention est-il stable ? Meta et Harvard ont constaté que les écarts de poids de leur modèle fluctuaient de plusieurs ordres de grandeur.

May 30, 2024 pm 01:24 PM

MetaFAIR s'est associé à Harvard pour fournir un nouveau cadre de recherche permettant d'optimiser le biais de données généré lors de l'apprentissage automatique à grande échelle. On sait que la formation de grands modèles de langage prend souvent des mois et utilise des centaines, voire des milliers de GPU. En prenant comme exemple le modèle LLaMA270B, sa formation nécessite un total de 1 720 320 heures GPU. La formation de grands modèles présente des défis systémiques uniques en raison de l’ampleur et de la complexité de ces charges de travail. Récemment, de nombreuses institutions ont signalé une instabilité dans le processus de formation lors de la formation des modèles d'IA générative SOTA. Elles apparaissent généralement sous la forme de pics de pertes. Par exemple, le modèle PaLM de Google a connu jusqu'à 20 pics de pertes au cours du processus de formation. Le biais numérique est à l'origine de cette imprécision de la formation,