Périphériques technologiques

Périphériques technologiques

IA

IA

Tellement cool que ça explose ! La démonstration en ligne HuggingGPT a fait une apparition époustouflante et les internautes ont testé la génération d'images en personne

Tellement cool que ça explose ! La démonstration en ligne HuggingGPT a fait une apparition époustouflante et les internautes ont testé la génération d'images en personne

Tellement cool que ça explose ! La démonstration en ligne HuggingGPT a fait une apparition époustouflante et les internautes ont testé la génération d'images en personne

La combinaison la plus puissante HuggingFace+ChatGPT="Jarvis" est maintenant ouverte en démo.

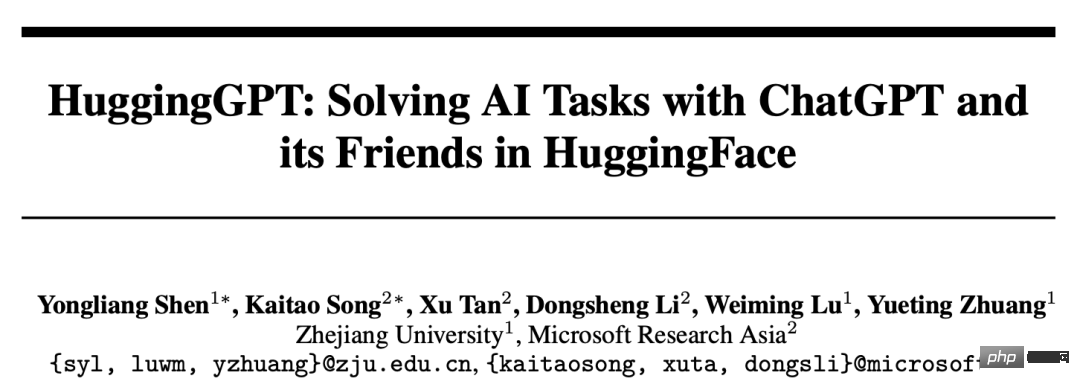

Il y a quelque temps, l'Université du Zhejiang et Microsoft ont lancé HuggingGPT, un système de collaboration à grande échelle qui est devenu un succès instantané.

Les chercheurs ont proposé d'utiliser ChatGPT comme contrôleur pour connecter divers modèles d'IA de la communauté HuggingFace afin d'effectuer des tâches complexes multimodales.

Dans l'ensemble du processus, tout ce que vous avez à faire est de : présenter vos exigences en langage naturel.

Les scientifiques de NVIDIA ont déclaré que c'était l'article le plus intéressant que j'ai lu cette semaine. Son idée est très proche de la "Everything App" que j'ai évoquée précédemment, c'est-à-dire que tout est une App, et les informations sont directement lues par l'IA.

Démarrez l'expérience

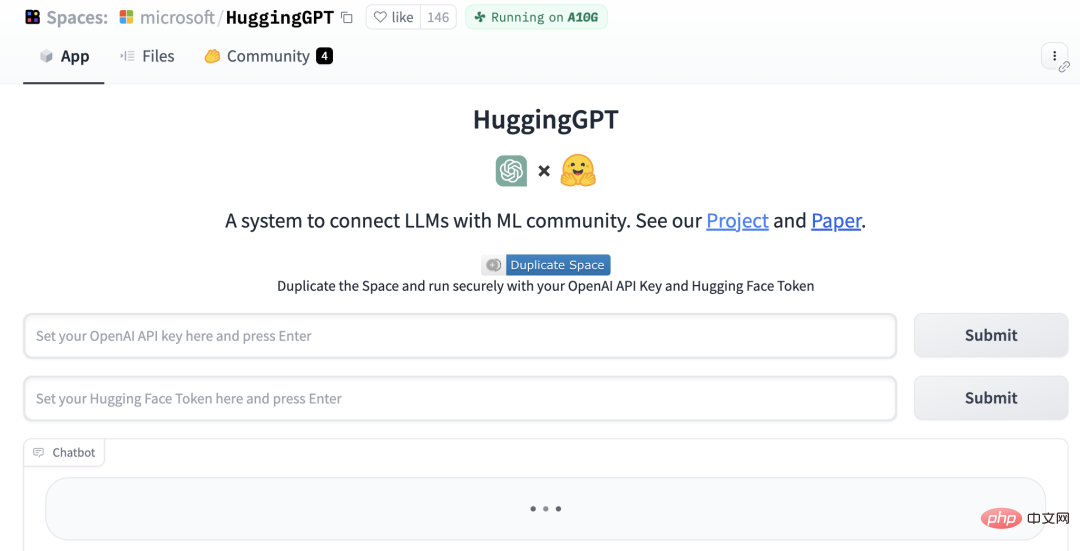

Maintenant, HuggingGPT a ajouté la démo Gradio.

Adresse du projet : https://github.com/microsoft/JARVIS

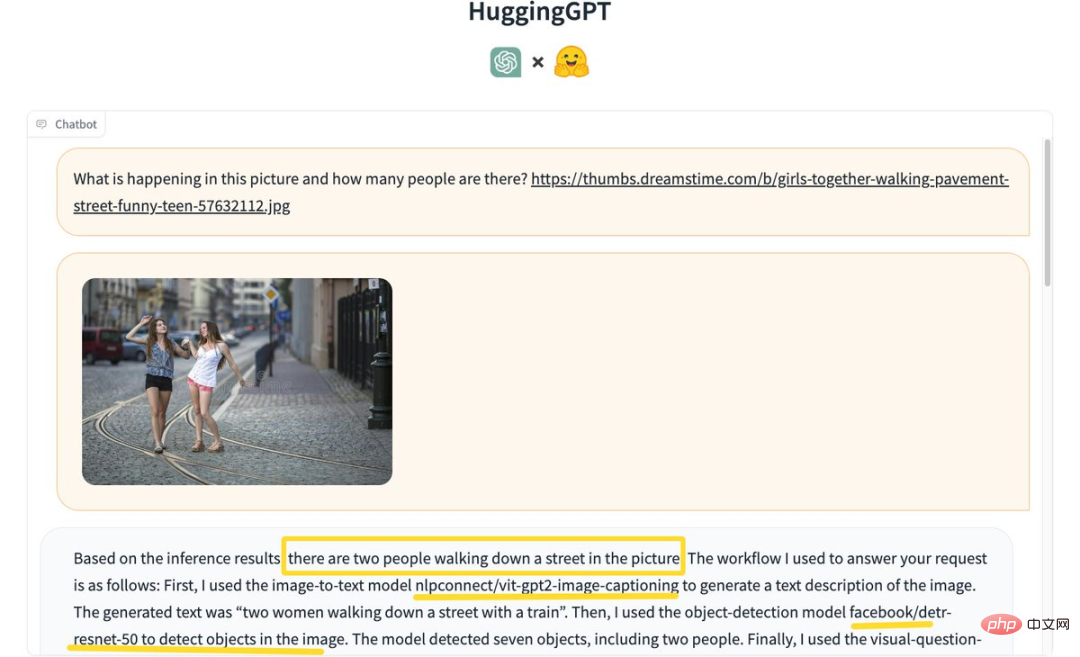

D'abord, « Reconnaître combien de personnes sont sur la photo » ?

HuggingGPT, sur la base des résultats d'inférence, a conclu qu'il y a 2 personnes marchant dans la rue sur la photo.

Le processus spécifique est le suivant :

Utilisez d'abord l'image pour envoyer un texte au modèle nlpconnect/vit-gpt2-image-captioning pour décrire l'image, et le texte généré "2 femmes marchant dans une rue avec un train ".

Ensuite, le modèle de détection d'objets facebook/detrresnet 50 est utilisé pour détecter le nombre de personnes sur la photo. Le modèle a détecté 7 objets et 2 personnes.

Ensuite, utilisez le modèle de réponse visuelle aux questions dandelin/vilt-b32-finetuned-vqa pour obtenir les résultats. Enfin, le système fournit des réponses détaillées et des informations modèles pour répondre à la question.

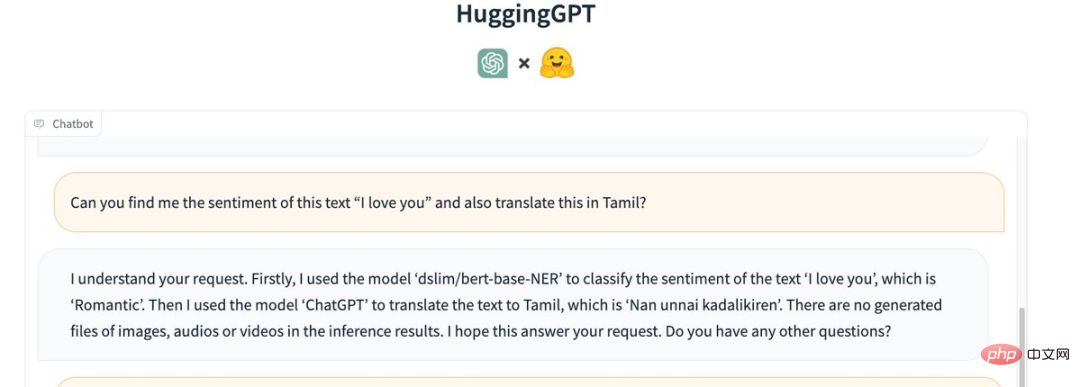

Aussi, faites-lui comprendre l'émotion de la phrase "Je t'aime" et traduisez-la en tamoul (Tamiḻ).

HuggingGPT a appelé le modèle suivant :

Tout d'abord, le modèle "dslim/bert-base-NER" a été utilisé pour classer l'émotion du texte "je t'aime", qui est "romantique".

Ensuite, utilisez « ChatGPT » pour traduire le texte en tamoul, qui est « Nan unnai kadalikiren ».

Il n'y a aucune image, fichier audio ou vidéo généré dans les résultats d'inférence.

HuggingGPT a échoué lors de la transcription des fichiers MP3. Un internaute a déclaré : « Je ne sais pas s'il s'agit d'un problème avec mon fichier d'entrée. »

Regardons les capacités de génération d'images.

Entrez l'image "Un chat dansant" et ajoutez le texte "Je t'aime" en superposition.

HuggingGPT a d'abord utilisé le modèle "runwayml/stable-diffusion-1-5" pour générer une image de "chat dansant" basée sur le texte donné.

Ensuite, le même modèle a été utilisé pour générer une image de "I LOVE YOU" basée sur le texte donné.

Enfin, fusionnez les deux images ensemble et le résultat est le suivant :

Jarvis devient réalité

Quelques jours seulement après que le projet a été rendu public, Jarvis a déjà reçu 12,5k étoiles et 811 étoiles sur le fork GitHub. .

Les chercheurs ont souligné que la résolution des problèmes actuels des grands modèles de langage (LLM) pourrait être la première et cruciale étape vers l'AGI.

Étant donné que la technologie actuelle des grands modèles de langage présente encore certaines lacunes, il existe des défis urgents sur la voie de la construction de systèmes AGI.

Pour gérer des tâches d'IA complexes, les LLM doivent être capables de se coordonner avec des modèles externes pour exploiter leurs capacités.

Par conséquent, le point clé est de savoir comment choisir le middleware approprié pour relier les LLM et les modèles d'IA.

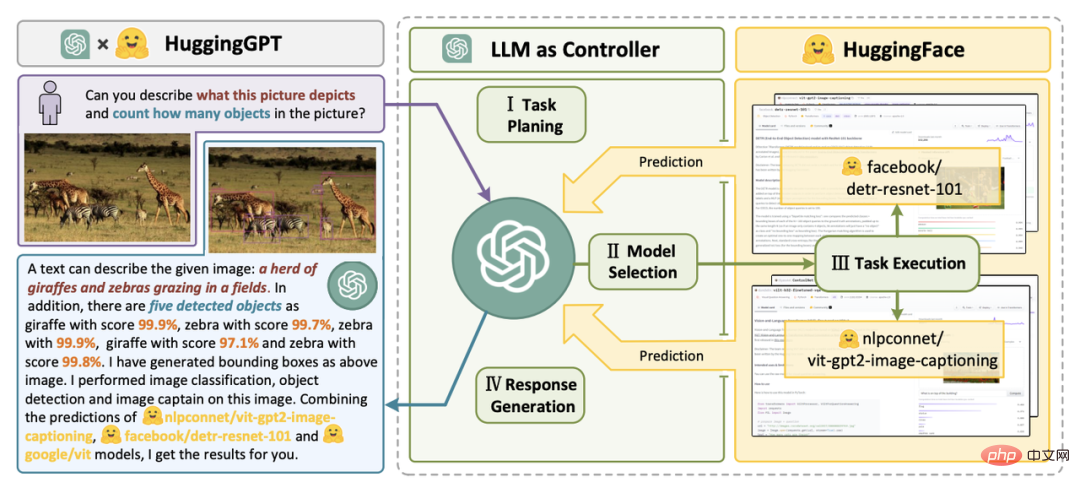

Dans ce document de recherche, le chercheur propose que le langage soit une interface universelle dans HuggingGPT. Son flux de travail est principalement divisé en quatre étapes :

Adresse papier : https://arxiv.org/pdf/2303.17580.pdf

La première est la planification des tâches. ChatGPT analyse les demandes des utilisateurs et les convertit. Décomposez-le en plusieurs tâches et planifiez la séquence de tâches et les dépendances en fonction de ses connaissances.

Ensuite, procédez à la sélection du modèle. LLM attribue des tâches analysées à des modèles experts en fonction de la description du modèle dans HuggingFace.

Ensuite, effectuez la tâche. Le modèle expert exécute les tâches assignées sur le point de terminaison d'inférence et enregistre les informations d'exécution et les résultats d'inférence dans le LLM.

La dernière étape est la génération de réponses. LLM résume les journaux du processus d'exécution et les résultats d'inférence, et renvoie le résumé à l'utilisateur.

Supposons qu'une telle demande soit donnée :

Veuillez générer une photo d'une fille lisant un livre, sa posture est la même que celle du garçon dans l'exemple.jpg. Utilisez ensuite votre voix pour décrire la nouvelle image.

Vous pouvez voir comment HuggingGPT le décompose en 6 sous-tâches et sélectionne respectivement le modèle à exécuter pour obtenir le résultat final.

En incorporant des descriptions de modèles d'IA dans les invites, ChatGPT peut être considéré comme le cerveau qui gère les modèles d'IA. Par conséquent, cette méthode permet à ChatGPT d'appeler des modèles externes pour résoudre des tâches pratiques.

Pour parler simplement, HuggingGPT est un système de collaboration, pas un grand modèle.

Sa fonction est de connecter ChatGPT et HuggingFace pour traiter les entrées selon différentes modalités et résoudre de nombreuses tâches complexes d'intelligence artificielle.

Ainsi, chaque modèle d'IA de la communauté HuggingFace a une description de modèle correspondante dans la bibliothèque HuggingGPT et est intégrée dans l'invite pour établir une connexion avec ChatGPT.

HuggingGPT utilise ensuite ChatGPT comme cerveau pour déterminer la réponse à la question.

Jusqu'à présent, HuggingGPT a intégré des centaines de modèles sur HuggingFace autour de ChatGPT, couvrant 24 tâches telles que la classification de texte, la détection de cible, la segmentation sémantique, la génération d'images, les questions et réponses, la synthèse vocale et la synthèse texte-vidéo.

Les résultats expérimentaux prouvent que HuggingGPT peut montrer de bonnes performances sur diverses formes de tâches complexes.

Commentaires chauds des internautes

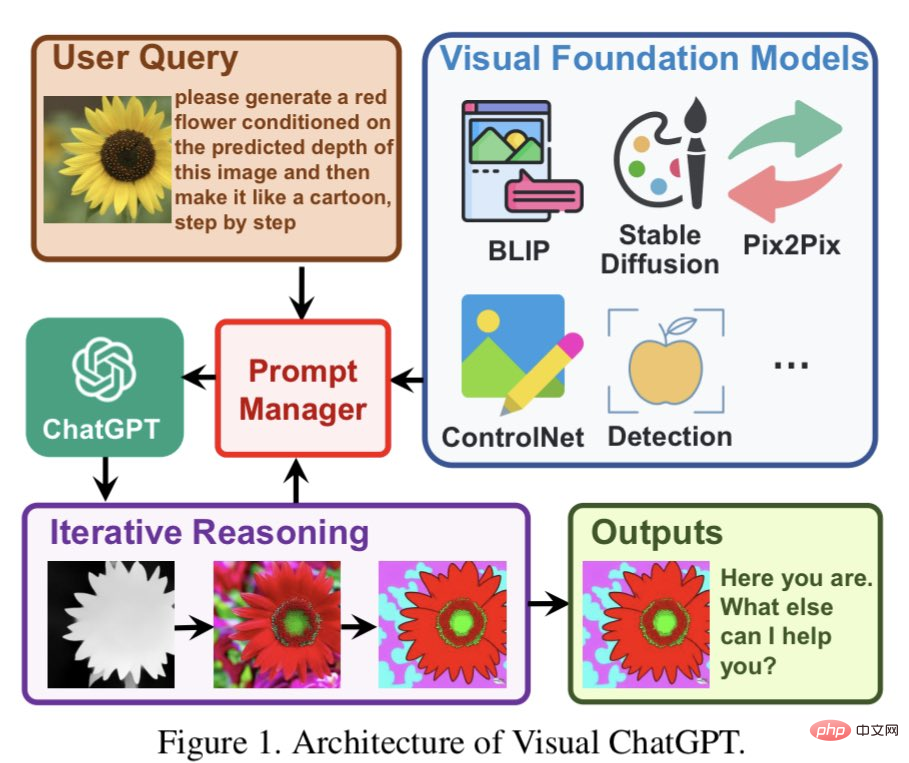

Certains internautes ont déclaré que HuggingGPT est similaire au Visual ChatGPT précédemment proposé par Microsoft. Il semble qu'ils aient étendu l'idée originale à un vaste ensemble de modèles pré-entraînés.

Visual ChatGPT est construit directement sur ChatGPT et y injecte de nombreux modèles visuels (VFM). Prompt Manage est proposé dans l’article.

Avec l'aide des PM, ChatGPT peut utiliser ces VFM et recevoir leurs commentaires de manière itérative jusqu'à ce que les exigences de l'utilisateur soient satisfaites ou que la condition finale soit atteinte.

Certains internautes pensent que cette idée est en effet très similaire à ChatGPT. Utiliser LLM comme centre de compréhension sémantique et de planification des tâches peut améliorer infiniment les capacités de LLM. En combinant LLM avec d'autres experts fonctionnels ou spécialisés, nous pouvons créer des systèmes d'IA plus puissants et plus flexibles, capables de mieux s'adapter à une variété de tâches et de besoins.

C'est ce que j'ai toujours pensé de l'AGI, des modèles d'intelligence artificielle capables de comprendre des tâches complexes puis d'attribuer des tâches plus petites à d'autres modèles d'IA plus professionnels.

Tout comme le cerveau, il comporte également différentes parties pour accomplir des tâches spécifiques, ce qui semble très logique.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Ligne de commande de l'arrêt CentOS

Apr 14, 2025 pm 09:12 PM

Ligne de commande de l'arrêt CentOS

Apr 14, 2025 pm 09:12 PM

La commande de fermeture CENTOS est arrêtée et la syntaxe est la fermeture de [options] le temps [informations]. Les options incluent: -H Arrêtez immédiatement le système; -P éteignez l'alimentation après l'arrêt; -r redémarrer; -t temps d'attente. Les temps peuvent être spécifiés comme immédiats (maintenant), minutes (minutes) ou une heure spécifique (HH: mm). Des informations supplémentaires peuvent être affichées dans les messages système.

Quelles sont les méthodes de sauvegarde pour Gitlab sur Centos

Apr 14, 2025 pm 05:33 PM

Quelles sont les méthodes de sauvegarde pour Gitlab sur Centos

Apr 14, 2025 pm 05:33 PM

La politique de sauvegarde et de récupération de GitLab dans le système CentOS afin d'assurer la sécurité et la récupérabilité des données, Gitlab on CentOS fournit une variété de méthodes de sauvegarde. Cet article introduira plusieurs méthodes de sauvegarde courantes, paramètres de configuration et processus de récupération en détail pour vous aider à établir une stratégie complète de sauvegarde et de récupération de GitLab. 1. MANUEL BACKUP Utilisez le Gitlab-RakegitLab: Backup: Créer la commande pour exécuter la sauvegarde manuelle. Cette commande sauvegarde des informations clés telles que le référentiel Gitlab, la base de données, les utilisateurs, les groupes d'utilisateurs, les clés et les autorisations. Le fichier de sauvegarde par défaut est stocké dans le répertoire / var / opt / gitlab / backups. Vous pouvez modifier / etc / gitlab

Comment vérifier la configuration de CentOS HDFS

Apr 14, 2025 pm 07:21 PM

Comment vérifier la configuration de CentOS HDFS

Apr 14, 2025 pm 07:21 PM

Guide complet pour vérifier la configuration HDFS dans les systèmes CentOS Cet article vous guidera comment vérifier efficacement la configuration et l'état de l'exécution des HDF sur les systèmes CentOS. Les étapes suivantes vous aideront à bien comprendre la configuration et le fonctionnement des HDF. Vérifiez la variable d'environnement Hadoop: Tout d'abord, assurez-vous que la variable d'environnement Hadoop est correctement définie. Dans le terminal, exécutez la commande suivante pour vérifier que Hadoop est installé et configuré correctement: HadoopVersion Check HDFS Fichier de configuration: Le fichier de configuration de base de HDFS est situé dans le répertoire / etc / hadoop / conf / le répertoire, où Core-site.xml et hdfs-site.xml sont cruciaux. utiliser

Comment est la prise en charge du GPU pour Pytorch sur Centos

Apr 14, 2025 pm 06:48 PM

Comment est la prise en charge du GPU pour Pytorch sur Centos

Apr 14, 2025 pm 06:48 PM

Activer l'accélération du GPU Pytorch sur le système CentOS nécessite l'installation de versions CUDA, CUDNN et GPU de Pytorch. Les étapes suivantes vous guideront tout au long du processus: CUDA et CUDNN Installation détermineront la compatibilité de la version CUDA: utilisez la commande NVIDIA-SMI pour afficher la version CUDA prise en charge par votre carte graphique NVIDIA. Par exemple, votre carte graphique MX450 peut prendre en charge CUDA11.1 ou plus. Téléchargez et installez Cudatoolkit: visitez le site officiel de Nvidiacudatoolkit et téléchargez et installez la version correspondante selon la version CUDA la plus élevée prise en charge par votre carte graphique. Installez la bibliothèque CUDNN:

CentOS installe MySQL

Apr 14, 2025 pm 08:09 PM

CentOS installe MySQL

Apr 14, 2025 pm 08:09 PM

L'installation de MySQL sur CENTOS implique les étapes suivantes: Ajout de la source MySQL YUM appropriée. Exécutez la commande YUM Install MySQL-Server pour installer le serveur MySQL. Utilisez la commande mysql_secure_installation pour créer des paramètres de sécurité, tels que la définition du mot de passe de l'utilisateur racine. Personnalisez le fichier de configuration MySQL selon les besoins. Écoutez les paramètres MySQL et optimisez les bases de données pour les performances.

Explication détaillée du principe docker

Apr 14, 2025 pm 11:57 PM

Explication détaillée du principe docker

Apr 14, 2025 pm 11:57 PM

Docker utilise les fonctionnalités du noyau Linux pour fournir un environnement de fonctionnement d'application efficace et isolé. Son principe de travail est le suivant: 1. Le miroir est utilisé comme modèle en lecture seule, qui contient tout ce dont vous avez besoin pour exécuter l'application; 2. Le Système de fichiers Union (UnionFS) empile plusieurs systèmes de fichiers, ne stockant que les différences, l'économie d'espace et l'accélération; 3. Le démon gère les miroirs et les conteneurs, et le client les utilise pour l'interaction; 4. Les espaces de noms et les CGROUP implémentent l'isolement des conteneurs et les limitations de ressources; 5. Modes de réseau multiples prennent en charge l'interconnexion du conteneur. Ce n'est qu'en comprenant ces concepts principaux que vous pouvez mieux utiliser Docker.

CentOS8 redémarre SSH

Apr 14, 2025 pm 09:00 PM

CentOS8 redémarre SSH

Apr 14, 2025 pm 09:00 PM

La commande pour redémarrer le service SSH est: SystemCTL Redémarrer SSHD. Étapes détaillées: 1. Accédez au terminal et connectez-vous au serveur; 2. Entrez la commande: SystemCTL Restart SSHD; 3. Vérifiez l'état du service: SystemCTL Status Sshd.

Comment faire fonctionner la formation distribuée de Pytorch sur CentOS

Apr 14, 2025 pm 06:36 PM

Comment faire fonctionner la formation distribuée de Pytorch sur CentOS

Apr 14, 2025 pm 06:36 PM

La formation distribuée par Pytorch sur le système CentOS nécessite les étapes suivantes: Installation de Pytorch: La prémisse est que Python et PIP sont installés dans le système CentOS. Selon votre version CUDA, obtenez la commande d'installation appropriée sur le site officiel de Pytorch. Pour la formation du processeur uniquement, vous pouvez utiliser la commande suivante: pipinstalltorchtorchVisionTorChaudio Si vous avez besoin d'une prise en charge du GPU, assurez-vous que la version correspondante de CUDA et CUDNN est installée et utilise la version Pytorch correspondante pour l'installation. Configuration de l'environnement distribué: la formation distribuée nécessite généralement plusieurs machines ou des GPU multiples uniques. Lieu