Périphériques technologiques

Périphériques technologiques

IA

IA

Un nouveau paradigme pour l'édition de texte et d'images, un modèle unique permet l'édition d'images guidées multi-textes

Un nouveau paradigme pour l'édition de texte et d'images, un modèle unique permet l'édition d'images guidées multi-textes

Un nouveau paradigme pour l'édition de texte et d'images, un modèle unique permet l'édition d'images guidées multi-textes

Bref aperçu de l'article

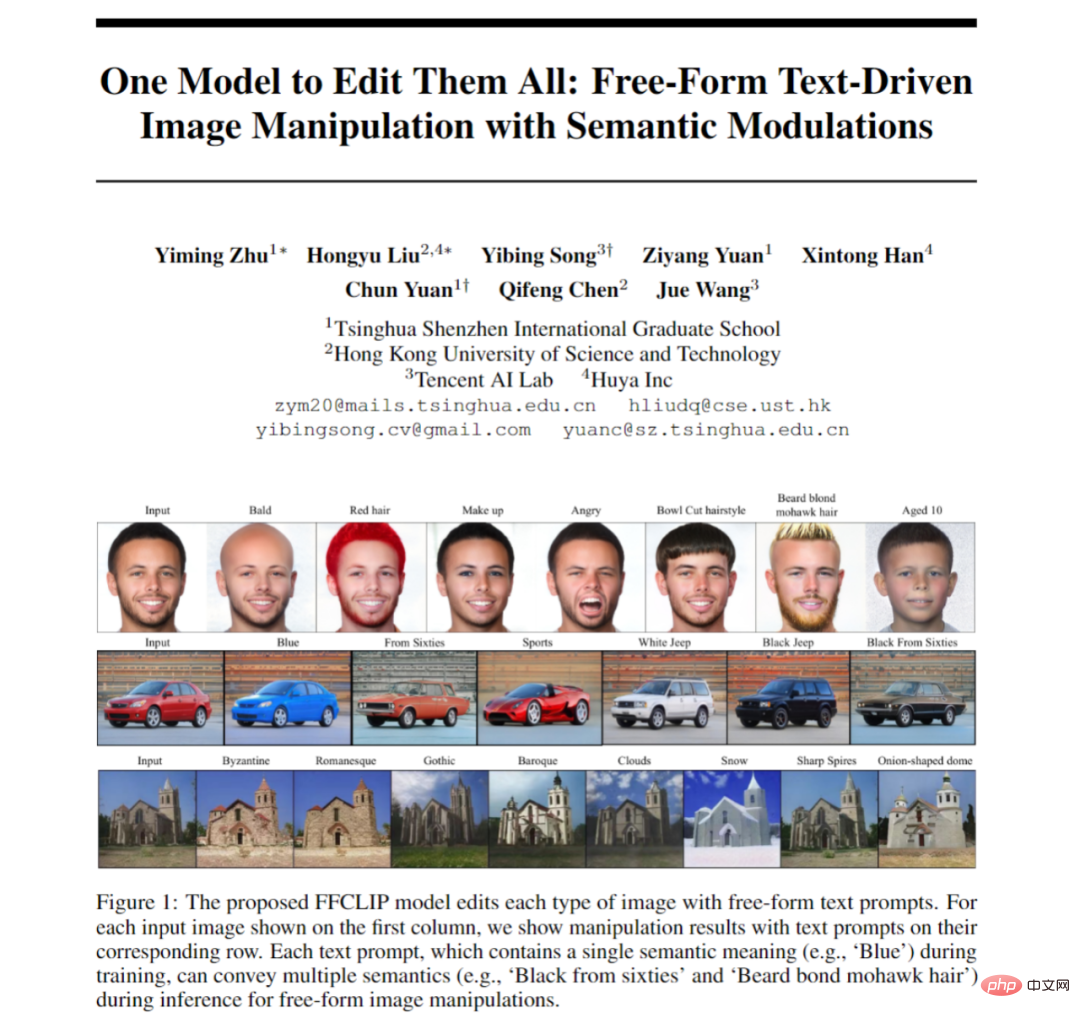

La recherche liée à l'utilisation de texte pour éditer des images est très en vogue Récemment, de nombreuses études sont basées sur des modèles de diffusion de débruitage pour améliorer l'effet, mais peu de chercheurs continuent de prêter attention aux recherches connexes. sur GAN. Cet article est basé sur les classiques StyleGAN et CLIP et propose un module de modulation sémantique, de sorte qu'un seul modèle est nécessaire pour différents textes pour effectuer l'édition texte-image.

Cet article utilise d'abord l'encodeur existant pour convertir l'image à éditer en code latent w dans l'espace sémantique W^+ de StyleGAN, puis module de manière adaptative le code latent via le module de modulation sémantique proposé. Le module de modulation sémantique comprend des modules d'alignement sémantique et d'injection sémantique. Il aligne d'abord la sémantique entre l'encodage de texte et l'encodage latent du GAN via le mécanisme d'attention, puis injecte les informations textuelles dans l'encodage latent aligné pour garantir que l'encodage Caïn est propriétaire. le texte. Informations permettant ainsi d'éditer des images à l'aide de texte.

Différent du modèle StyleCLIP classique, notre modèle n'a pas besoin de former un modèle distinct pour chaque texte. Un modèle peut répondre à plusieurs textes pour éditer efficacement les images, de sorte que notre modèle devient une manipulation d'image pilotée par texte sans forme FFCLIP. . Dans le même temps, notre modèle a obtenu de très bons résultats sur les ensembles de données classiques d'église, de visage et de voiture.

- Adresse papier : https://arxiv.org/pdf/2210.07883.pdf

- Adresse Github : https://github.com/KumapowerLIU/FFCLIP

Contexte et implications

Récemment, des invites de texte libre décrivant les intentions de l'utilisateur ont été utilisées pour modifier les espaces latents StyleGAN pour les opérations d'édition d'images [1, 2]. En prenant en entrée une phrase (par exemple, « Bleu ») ou une expression (par exemple, « Homme âgé de 10 ans »), ces méthodes modifient les attributs de l'image décrite en conséquence en modulant le codage latent dans l'espace latent StyleGAN.

Texte précis - L'édition d'images repose sur un mappage latent précis entre l'espace sémantique visuel de StyleGAN et l'espace sémantique textuel de CLIP. Par exemple, lorsque l'invite textuelle est « surprise », nous identifions d'abord son sous-espace sémantique associé (c'est-à-dire « expression », car la surprise appartient à l'attribut d'expression) dans l'espace sémantique visuel. Après avoir trouvé le sous-espace sémantique correspondant au texte, le texte nous indiquera le sens dans lequel l'encodage latent change, de l'expression courante à l'expression surprise. Des études pionnières telles que TediGAN [1] et StyleCLIP [2] ont prédéfini de manière empirique quel sous-espace visuel latent correspond à l'intégration d'indices textuels cible (c'est-à-dire la sélection d'attributs spécifiques dans TediGAN et le mappage de regroupement dans StyleCLIP). Cette reconnaissance empirique oblige, étant donné une invite de texte, à former un modèle d'édition correspondant.

Différents signaux textuels nécessitent différents modèles pour moduler les codes latents dans le sous-espace visuel latent de StyleGAN. Bien que la méthode d'orientation globale dans StyleCLIP n'utilise pas un tel processus, les ajustements des paramètres et les orientations d'édition sont prédéfinis manuellement. Pour cette raison, nous avons des raisons d’explorer comment trouver automatiquement le sous-espace sémantique visuel implicite à travers un texte explicite, afin qu’un seul modèle puisse gérer plusieurs textes.

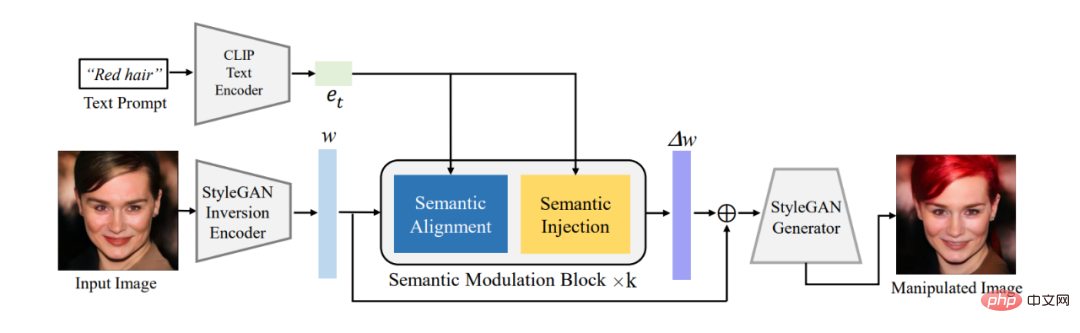

Dans cet article, nous proposons FFCLIP-Free Form CLIP, qui peut trouver automatiquement le sous-espace visuel correspondant pour différents textes. FFCLIP se compose de plusieurs modules de modulation sémantique qui prennent en entrée l'encodage latent w^+ et l'encodage de texte e dans l'espace latent StyleGAN W^+.

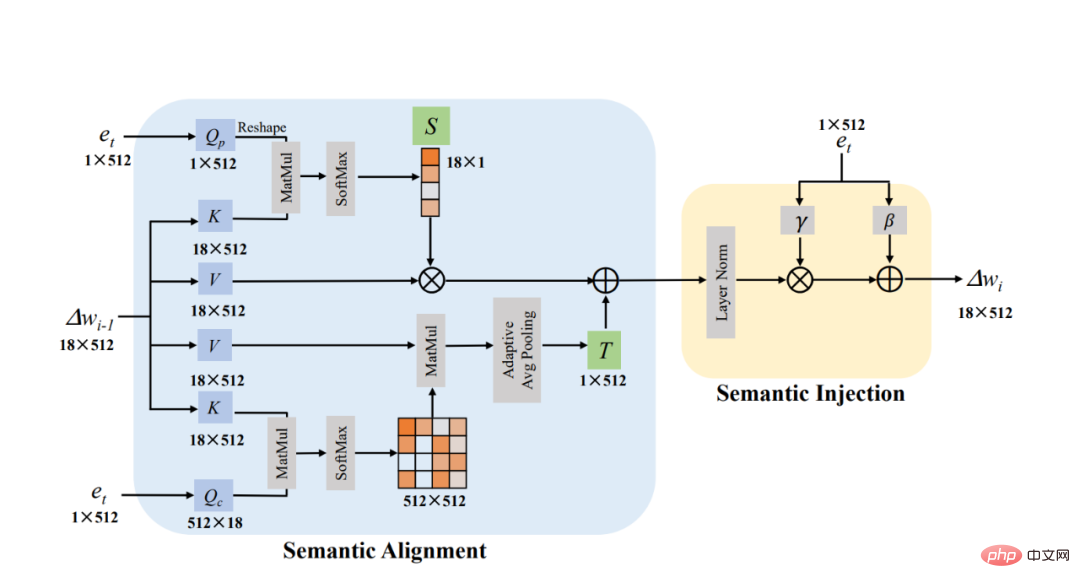

Le module de modulation sémantique se compose d'un module d'alignement sémantique et d'un module d'injection sémantique. Le module d'alignement sémantique prend le codage de texte e comme requête et le codage latent était comme clé et valeur. Ensuite, nous calculons l’attention croisée dans les dimensions de la position et du canal respectivement, ce qui donne lieu à deux cartes d’attention. Ensuite, nous utilisons la transformation linéaire pour transformer l'espace visuel actuel en sous-espace correspondant au texte, où les paramètres de transformation linéaire (c'est-à-dire les paramètres de traduction et de mise à l'échelle) sont calculés sur la base de ces deux cartes d'attention. Grâce à cet alignement, nous pouvons trouver automatiquement le sous-espace visuel correspondant à chaque texte. Enfin, le module d'injection sémantique [3] modifie le code latent dans le sous-espace en suivant une autre transformation linéaire.

Du point de vue de FFCLIP, [1, 2] la sélection empirique dans l'espace neutronique est une forme particulière de notre transformation linéaire dans le module d'alignement sémantique. Leur opération de sélection de groupe est similaire aux valeurs binaires de nos paramètres de mise à l'échelle pour indiquer l'utilisation de chaque dimension de position de w. D'un autre côté, nous observons que la sémantique de l'espace W^+ est toujours enchevêtrée et que la conception empirique ne parvient pas à trouver une cartographie précise entre l'espace latent de StyleGAN et l'espace sémantique textuel de CLIP. Au lieu de cela, le paramètre de mise à l'échelle de notre module d'alignement sémantique modifie de manière adaptative le code latent w pour mapper différentes intégrations d'indices textuels. L'alignement est ensuite encore amélioré via nos paramètres de traduction. Nous évaluons notre méthode sur des ensembles de données de référence et comparons FFCLIP avec les méthodes de pointe. Les résultats montrent que FFCLIP est capable de générer un contenu plus raisonnable tout en transmettant l'intention de l'utilisateur.

FFCLIP

La figure 1 montre notre cadre global. FFCLIP obtient d'abord l'encodage latent des images et des textes via l'encodeur d'inversion GAN pré-entraîné et l'encodeur de texte. L'encodage latent des images est w dans l'espace sémantique visuel StyleGAN mentionné précédemment W^+, tandis que l'encodage du texte est e_t. Comme StyleCLIP, nous utilisons l'encodeur d'inversion e4e GAN [4] et l'encodeur de texte dans CLIP pour obtenir respectivement l'encodage latent correspondant. Ensuite, nous utilisons e_t et w comme entrée du module de modulation et produisons le décalage Δw de w. Enfin, ajoutons Δw au w d'origine et plaçons-le dans le StyleGAN pré-entraîné pour obtenir le résultat correspondant.

Figure 1 : Schéma du cadre général

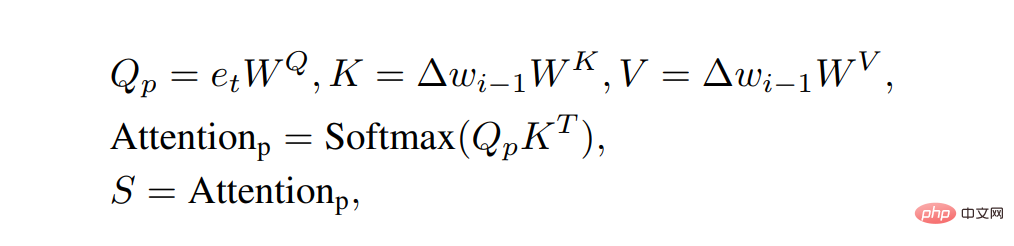

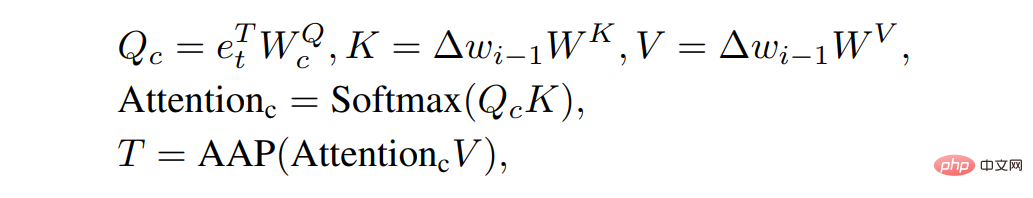

La deuxième figure ci-dessous est notre module de modulation sémantique. Dans le module d'alignement sémantique (Semantic Alignment), nous pouvons clairement voir que nous définissons Δw sur Key et Value et définissons e_t sur Query pour calculer deux cartes d'attention. Les tailles de ces deux cartes d'attention sont respectivement de 18 × 1 et 512 × 512. . Ensuite, nous utilisons la carte d'attention 18×1 comme coefficient d'échelle S dans la transformation linéaire. Notre processus de calcul de la carte d'attention est le suivant :

En même temps, nous multiplions la carte d'attention 512×512. par valeur puis passer. L'opération de pooling obtient le coefficient de traduction T dans la transformation explicite. Notre processus de calcul de la carte d'attention est le suivant :

Après avoir obtenu les coefficients de traduction et de mise à l'échelle, nous pouvons trouver le sous-espace visuel correspondant pour le texte actuel e_t par transformation linéaire. Les étapes de calcul sont les suivantes :

Midterm x_i est le résultat de sortie de notre i-ème module de modulation sémantique. Puisque la taille de Δw est de 18×512, les cartes d'attention de 18×1 et 512×512 sont calculées respectivement dans les deux dimensions de position et de canal de Δw. Cette opération est similaire à la double attention [5].

Nous pouvons obtenir le sous-espace visuel correspondant au texte grâce aux opérations ci-dessus, puis nous utilisons une méthode similaire à AdaIN pour injecter des informations textuelles dans Dans cet espace, pour obtenir le résultat final, nous appelons cette opération le module d'injection sémantique (Semantic Injection). Les étapes de mise en œuvre de l'ensemble du module sont les suivantes :

Au final, un total de 4 modules de modulation sémantique ont été empilés dans notre FFCLIP, et finalement le décalage final Δw a été obtenu.

Résultats expérimentaux

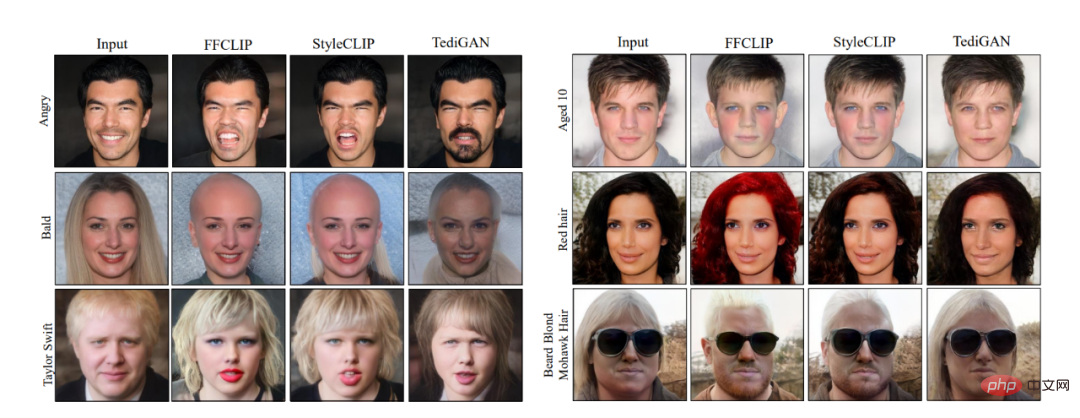

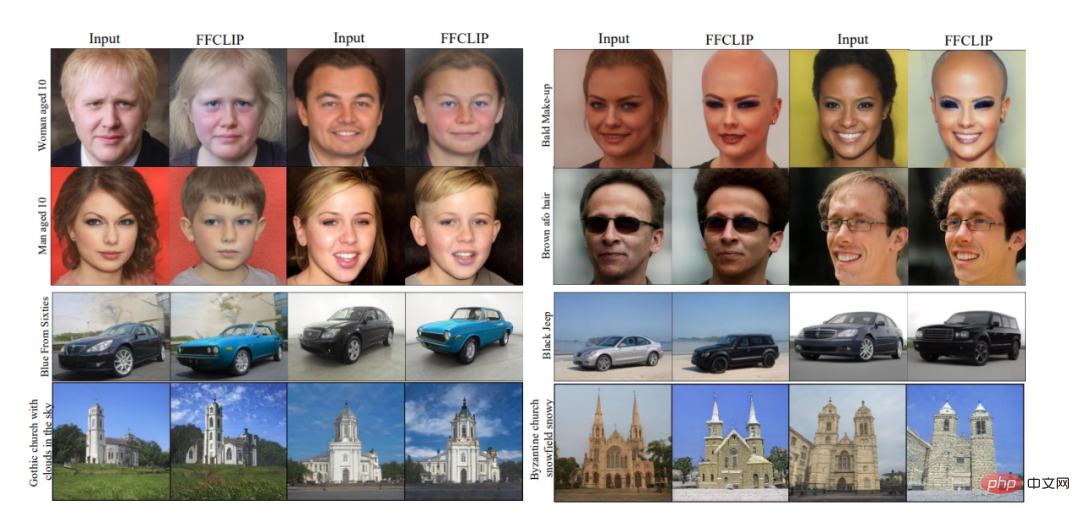

Figure 3 : Tableau de comparaison visuelle

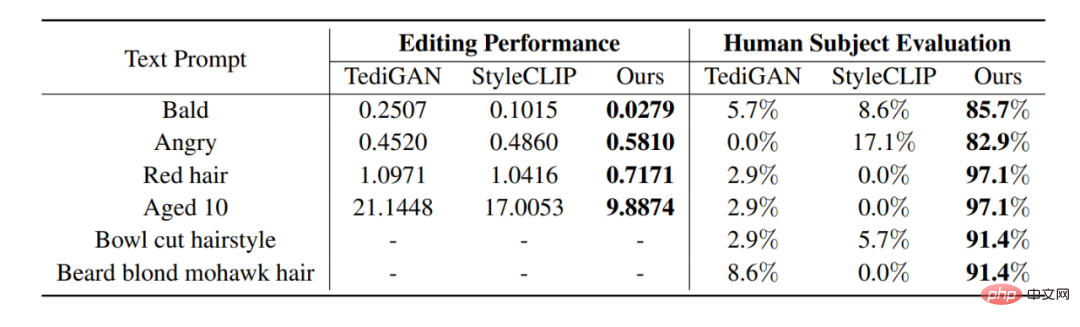

Comme le montre la figure 3, nous avons effectué des comparaisons visuelles avec StyleCLIP [1], TediGAN [2] et HairCLIP [3] Comparaison sur : On peut voir que FFCLIP peut mieux refléter la sémantique du texte et générer des images éditées plus réalistes. Dans le même temps, les résultats de comparaison numérique correspondants sont présentés dans le tableau ci-dessous. Notre méthode permet d'obtenir les meilleurs résultats en termes de valeurs objectives et subjectives.

Tableau 1 : Comparaison numérique

En même temps, notre méthode montre également une très bonne robustesse. FFCLIP n'a pas vu de combinaison de mots lors de l'entraînement mais en utilise un seul. Les mots sont. utilisé pour la formation, mais dans le test, l'image peut être bien éditée selon la sémantique de la phrase. L'effet visuel est illustré à la figure 4.

Figure 4 : Édition de phrases

Pour plus de résultats expérimentaux et d'expériences d'ablation, veuillez consulter le texte original.

Résumé

Dans cet article, nous proposons FFCLIP, une nouvelle méthode d'édition d'images efficace qui peut cibler différents textes mais ne nécessite qu'un seul modèle. La motivation de cet article est que les méthodes existantes correspondent au texte actuel et au sous-espace sémantique du GAN sur la base de l'expérience existante, de sorte qu'un modèle d'édition ne peut gérer qu'une seule invite de texte. Nous améliorons la cartographie latente grâce à l’alignement et à la modulation sémantique injectée. Il facilite un modèle d'édition pour gérer plusieurs invites de texte. Des expériences sur plusieurs ensembles de données démontrent que notre FFCLIP produit efficacement des résultats sémantiquement pertinents et visuellement réalistes.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Le modèle MoE open source le plus puissant au monde est ici, avec des capacités chinoises comparables à celles du GPT-4, et le prix ne représente que près d'un pour cent de celui du GPT-4-Turbo.

May 07, 2024 pm 04:13 PM

Le modèle MoE open source le plus puissant au monde est ici, avec des capacités chinoises comparables à celles du GPT-4, et le prix ne représente que près d'un pour cent de celui du GPT-4-Turbo.

May 07, 2024 pm 04:13 PM

Imaginez un modèle d'intelligence artificielle qui non seulement a la capacité de surpasser l'informatique traditionnelle, mais qui permet également d'obtenir des performances plus efficaces à moindre coût. Ce n'est pas de la science-fiction, DeepSeek-V2[1], le modèle MoE open source le plus puissant au monde est ici. DeepSeek-V2 est un puissant mélange de modèle de langage d'experts (MoE) présentant les caractéristiques d'une formation économique et d'une inférence efficace. Il est constitué de 236B paramètres, dont 21B servent à activer chaque marqueur. Par rapport à DeepSeek67B, DeepSeek-V2 offre des performances plus élevées, tout en économisant 42,5 % des coûts de formation, en réduisant le cache KV de 93,3 % et en augmentant le débit de génération maximal à 5,76 fois. DeepSeek est une entreprise explorant l'intelligence artificielle générale

L'IA bouleverse la recherche mathématique ! Le lauréat de la médaille Fields et mathématicien sino-américain a dirigé 11 articles les mieux classés | Aimé par Terence Tao

Apr 09, 2024 am 11:52 AM

L'IA bouleverse la recherche mathématique ! Le lauréat de la médaille Fields et mathématicien sino-américain a dirigé 11 articles les mieux classés | Aimé par Terence Tao

Apr 09, 2024 am 11:52 AM

L’IA change effectivement les mathématiques. Récemment, Tao Zhexuan, qui a prêté une attention particulière à cette question, a transmis le dernier numéro du « Bulletin de l'American Mathematical Society » (Bulletin de l'American Mathematical Society). En se concentrant sur le thème « Les machines changeront-elles les mathématiques ? », de nombreux mathématiciens ont exprimé leurs opinions. L'ensemble du processus a été plein d'étincelles, intense et passionnant. L'auteur dispose d'une équipe solide, comprenant Akshay Venkatesh, lauréat de la médaille Fields, le mathématicien chinois Zheng Lejun, l'informaticien de l'Université de New York Ernest Davis et de nombreux autres universitaires bien connus du secteur. Le monde de l’IA a radicalement changé. Vous savez, bon nombre de ces articles ont été soumis il y a un an.

Google est ravi : les performances de JAX surpassent Pytorch et TensorFlow ! Cela pourrait devenir le choix le plus rapide pour la formation à l'inférence GPU

Apr 01, 2024 pm 07:46 PM

Google est ravi : les performances de JAX surpassent Pytorch et TensorFlow ! Cela pourrait devenir le choix le plus rapide pour la formation à l'inférence GPU

Apr 01, 2024 pm 07:46 PM

Les performances de JAX, promu par Google, ont dépassé celles de Pytorch et TensorFlow lors de récents tests de référence, se classant au premier rang sur 7 indicateurs. Et le test n’a pas été fait sur le TPU présentant les meilleures performances JAX. Bien que parmi les développeurs, Pytorch soit toujours plus populaire que Tensorflow. Mais à l’avenir, des modèles plus volumineux seront peut-être formés et exécutés sur la base de la plate-forme JAX. Modèles Récemment, l'équipe Keras a comparé trois backends (TensorFlow, JAX, PyTorch) avec l'implémentation native de PyTorch et Keras2 avec TensorFlow. Premièrement, ils sélectionnent un ensemble de

Bonjour, Atlas électrique ! Le robot Boston Dynamics revient à la vie, des mouvements étranges à 180 degrés effraient Musk

Apr 18, 2024 pm 07:58 PM

Bonjour, Atlas électrique ! Le robot Boston Dynamics revient à la vie, des mouvements étranges à 180 degrés effraient Musk

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas entre officiellement dans l’ère des robots électriques ! Hier, l'Atlas hydraulique s'est retiré "en larmes" de la scène de l'histoire. Aujourd'hui, Boston Dynamics a annoncé que l'Atlas électrique était au travail. Il semble que dans le domaine des robots humanoïdes commerciaux, Boston Dynamics soit déterminé à concurrencer Tesla. Après la sortie de la nouvelle vidéo, elle a déjà été visionnée par plus d’un million de personnes en seulement dix heures. Les personnes âgées partent et de nouveaux rôles apparaissent. C'est une nécessité historique. Il ne fait aucun doute que cette année est l’année explosive des robots humanoïdes. Les internautes ont commenté : Les progrès des robots ont fait ressembler la cérémonie d'ouverture de cette année à des êtres humains, et le degré de liberté est bien plus grand que celui des humains. Mais n'est-ce vraiment pas un film d'horreur ? Au début de la vidéo, Atlas est allongé calmement sur le sol, apparemment sur le dos. Ce qui suit est à couper le souffle

KAN, qui remplace MLP, a été étendu à la convolution par des projets open source

Jun 01, 2024 pm 10:03 PM

KAN, qui remplace MLP, a été étendu à la convolution par des projets open source

Jun 01, 2024 pm 10:03 PM

Plus tôt ce mois-ci, des chercheurs du MIT et d'autres institutions ont proposé une alternative très prometteuse au MLP – KAN. KAN surpasse MLP en termes de précision et d’interprétabilité. Et il peut surpasser le MLP fonctionnant avec un plus grand nombre de paramètres avec un très petit nombre de paramètres. Par exemple, les auteurs ont déclaré avoir utilisé KAN pour reproduire les résultats de DeepMind avec un réseau plus petit et un degré d'automatisation plus élevé. Plus précisément, le MLP de DeepMind compte environ 300 000 paramètres, tandis que le KAN n'en compte qu'environ 200. KAN a une base mathématique solide comme MLP est basé sur le théorème d'approximation universelle, tandis que KAN est basé sur le théorème de représentation de Kolmogorov-Arnold. Comme le montre la figure ci-dessous, KAN a

Les robots Tesla travaillent dans les usines, Musk : Le degré de liberté des mains atteindra 22 cette année !

May 06, 2024 pm 04:13 PM

Les robots Tesla travaillent dans les usines, Musk : Le degré de liberté des mains atteindra 22 cette année !

May 06, 2024 pm 04:13 PM

La dernière vidéo du robot Optimus de Tesla est sortie, et il peut déjà fonctionner en usine. À vitesse normale, il trie les batteries (les batteries 4680 de Tesla) comme ceci : Le responsable a également publié à quoi cela ressemble à une vitesse 20 fois supérieure - sur un petit "poste de travail", en sélectionnant et en sélectionnant et en sélectionnant : Cette fois, il est publié L'un des points forts de la vidéo est qu'Optimus réalise ce travail en usine, de manière totalement autonome, sans intervention humaine tout au long du processus. Et du point de vue d'Optimus, il peut également récupérer et placer la batterie tordue, en se concentrant sur la correction automatique des erreurs : concernant la main d'Optimus, le scientifique de NVIDIA Jim Fan a donné une évaluation élevée : la main d'Optimus est l'un des robots à cinq doigts du monde. le plus adroit. Ses mains ne sont pas seulement tactiles

FisheyeDetNet : le premier algorithme de détection de cible basé sur une caméra fisheye

Apr 26, 2024 am 11:37 AM

FisheyeDetNet : le premier algorithme de détection de cible basé sur une caméra fisheye

Apr 26, 2024 am 11:37 AM

La détection de cibles est un problème relativement mature dans les systèmes de conduite autonome, parmi lesquels la détection des piétons est l'un des premiers algorithmes à être déployés. Des recherches très complètes ont été menées dans la plupart des articles. Cependant, la perception de la distance à l’aide de caméras fisheye pour une vue panoramique est relativement moins étudiée. En raison de la distorsion radiale importante, la représentation standard du cadre de délimitation est difficile à mettre en œuvre dans les caméras fisheye. Pour alléger la description ci-dessus, nous explorons les conceptions étendues de boîtes englobantes, d'ellipses et de polygones généraux dans des représentations polaires/angulaires et définissons une métrique de segmentation d'instance mIOU pour analyser ces représentations. Le modèle fisheyeDetNet proposé avec une forme polygonale surpasse les autres modèles et atteint simultanément 49,5 % de mAP sur l'ensemble de données de la caméra fisheye Valeo pour la conduite autonome.

DualBEV : dépassant largement BEVFormer et BEVDet4D, ouvrez le livre !

Mar 21, 2024 pm 05:21 PM

DualBEV : dépassant largement BEVFormer et BEVDet4D, ouvrez le livre !

Mar 21, 2024 pm 05:21 PM

Cet article explore le problème de la détection précise d'objets sous différents angles de vue (tels que la perspective et la vue à vol d'oiseau) dans la conduite autonome, en particulier comment transformer efficacement les caractéristiques de l'espace en perspective (PV) en vue à vol d'oiseau (BEV). implémenté via le module Visual Transformation (VT). Les méthodes existantes sont globalement divisées en deux stratégies : la conversion 2D en 3D et la conversion 3D en 2D. Les méthodes 2D vers 3D améliorent les caractéristiques 2D denses en prédisant les probabilités de profondeur, mais l'incertitude inhérente aux prévisions de profondeur, en particulier dans les régions éloignées, peut introduire des inexactitudes. Alors que les méthodes 3D vers 2D utilisent généralement des requêtes 3D pour échantillonner des fonctionnalités 2D et apprendre les poids d'attention de la correspondance entre les fonctionnalités 3D et 2D via un transformateur, ce qui augmente le temps de calcul et de déploiement.