Aperçu du cadre technologique de conduite autonome

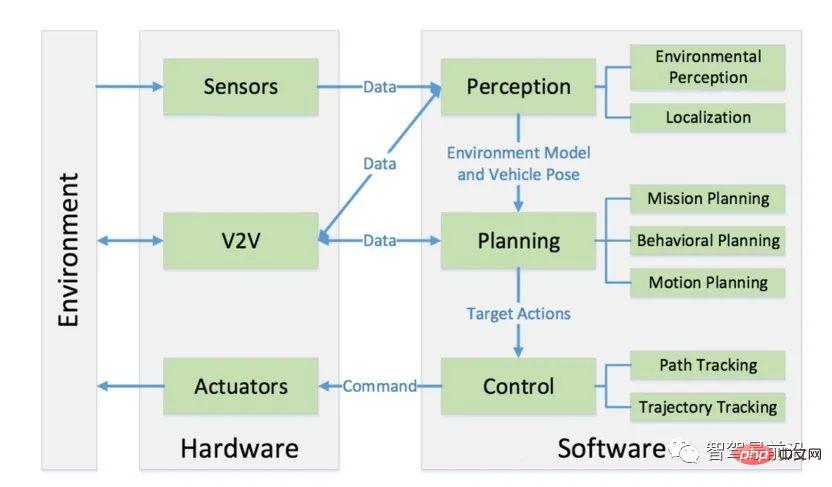

Le cœur du système de conduite sans pilote peut être résumé en trois parties : Perception, Planification et Contrôle. L'interaction de ces pièces et leur interaction avec le matériel du véhicule et d'autres véhicules peuvent être représentées par la figure suivante :

La perception fait référence à la capacité d'un système de conduite sans pilote à collecter des informations sur l'environnement et à en extraire des connaissances pertinentes. Parmi eux, la perception environnementale fait spécifiquement référence à la capacité de comprendre la scène de l'environnement, telle que l'emplacement des obstacles, la détection des panneaux/marques routiers, la détection des piétons et des véhicules et la classification sémantique des données. D'une manière générale, la localisation fait également partie de la perception. La localisation est la capacité d'un véhicule sans pilote à déterminer sa position par rapport à l'environnement.

La planification est le processus par lequel les véhicules autonomes prennent des décisions ciblées pour un certain objectif. Pour les véhicules autonomes, cet objectif fait généralement référence à l'atteinte de la destination depuis le point de départ tout en évitant les obstacles, et à l'optimisation continue des trajectoires et des comportements de conduite pour garantir le bon déroulement de la conduite. sécurité et confort des passagers. La couche de planification est généralement subdivisée en trois couches : la planification de la mission, la planification comportementale et la planification des mouvements.

Enfin, le contrôle est la capacité du véhicule autonome à exécuter avec précision des actions planifiées, qui proviennent de couches supérieures.

01 Perception

Perception de l'environnement

Afin de garantir que les véhicules sans pilote comprennent et appréhendent l'environnement, la partie perception de l'environnement du système de conduite sans pilote doit généralement obtenir une grande quantité d'informations sur l'environnement environnant. Concrètement, cela comprend : la localisation des obstacles, la vitesse et le comportement possible, la zone roulable, les règles de circulation, etc. Les véhicules sans pilote obtiennent généralement ces informations en fusionnant les données de plusieurs capteurs tels que le Lidar, la caméra et le radar à ondes millimétriques. Dans cette section, nous examinons brièvement le rôle du Lidar et des caméras dans les applications de détection humaine et automobile.

Le Lidar est un type d'appareil qui utilise des lasers pour la détection et la télémétrie. Il peut envoyer des millions d'impulsions lumineuses à l'environnement chaque seconde. Son intérieur est une structure rotative, qui permet au lidar de détecter en temps réel. carte du milieu environnant.

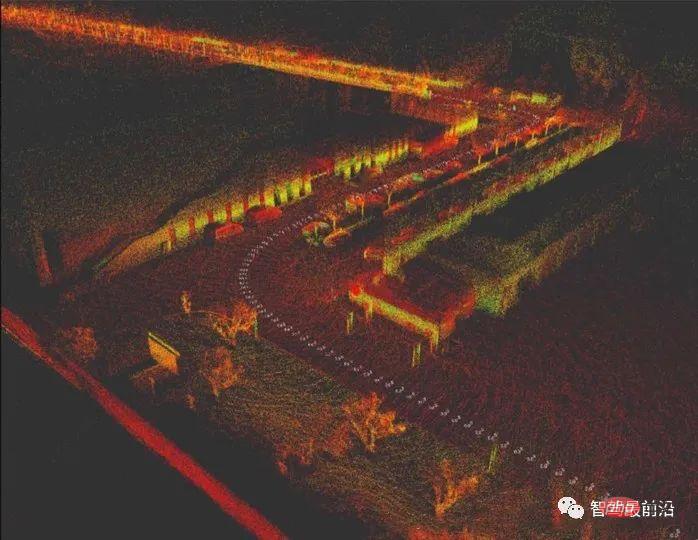

De manière générale, le lidar tourne et scanne l'environnement environnant à une vitesse d'environ 10 Hz. Le résultat d'un scan est une carte tridimensionnelle composée de points denses. Le graphique est appelé graphique de nuages de points. Comme le montre la figure ci-dessous, il s'agit d'une carte de nuages de points créée à l'aide du lidar Velodyne VLP-32c :

Le Lidar est toujours utilisé en raison de sa fiabilité. capteur important dans le système de conduite sans pilote. Cependant, en utilisation réelle, le lidar n'est pas parfait. Il existe souvent un problème selon lequel le nuage de points est trop clairsemé ou même certains points sont perdus. Pour les surfaces d'objets irrégulières, il est très difficile d'utiliser le lidar. Il est difficile de discerner des modèles et le lidar ne peut pas être utilisé dans des situations telles que de fortes pluies.

Afin de comprendre les informations sur les nuages de points, de manière générale, nous effectuons des opérations en deux étapes sur les données des nuages de points : la segmentation (Segmentation) et la classification (Classification). Parmi eux, la segmentation consiste à regrouper des points discrets dans l'image du nuage de points en plusieurs ensembles, tandis que la classification consiste à distinguer à quelle catégorie appartiennent ces ensembles (comme les piétons, les véhicules et les obstacles). Les algorithmes de segmentation peuvent être classés dans les catégories suivantes :

- Méthodes basées sur les bords, telles que le filtrage par gradient, etc. ;

- Méthodes basées sur les régions, qui utilisent des caractéristiques régionales pour regrouper les points proches. Le regroupement est basé sur l'utilisation de certaines normes spécifiées (telles que la distance euclidienne). , normale de surface, etc.), cette méthode sélectionne généralement un certain nombre de points de départ dans le nuage de points, puis utilise des normes spécifiées pour regrouper les points voisins à partir de ces

- paramètres Méthodes. modèles pour ajuster les nuages de points. Les méthodes courantes incluent le consensus d'échantillons aléatoires (RANSAC) et la transformation de Hough (HT) ;

- Méthode basée sur les attributs, calcule d'abord les attributs de chaque point, puis regroupe les points associés aux attributs ;

- méthode basée sur un graphique ;

- basée sur la méthode d'apprentissage automatique ;

Une fois la cible du nuage de points segmentée, les cibles segmentées doivent être correctement classées dans ce processus. L'apprentissage, tel que Support Vector Machine (SVM), est généralement utilisé pour classer les fonctionnalités en cluster. Récemment, ces dernières années, en raison du développement de l'apprentissage en profondeur, l'industrie a commencé à utiliser des réseaux neuronaux convolutifs spécialement conçus (Convolutional Neural Network, CNN). ) pour classer les clusters de nuages de points tridimensionnels.

Cependant, qu'il s'agisse de la méthode d'extraction de caractéristiques - SVM ou du nuage de points d'origine - méthode CNN, en raison de la faible résolution du nuage de points lidar lui-même, pour les cibles avec des points de réflexion clairsemés (comme les piétons), basée sur le nuage de points La classification n'est pas fiable, donc dans la pratique, nous fusionnons souvent les capteurs lidar et caméra, utilisons la haute résolution de la caméra pour classer les cibles et utilisons la fiabilité du lidar pour détecter les obstacles et la portée, intégrant les avantages des deux. Sensibilisation totale à l'environnement.

Dans les systèmes sans conducteur, nous utilisons généralement la vision par image pour compléter la détection de route et la détection de cibles sur la route. La détection routière comprend la détection des lignes routières (détection de voie), la détection des zones carrossables (détection de zone praticable) ; la détection des panneaux routiers comprend la détection d'autres véhicules (détection de véhicule), la détection de piétons (détection de piéton), les panneaux de signalisation et la détection et la classification de tous. les participants à la circulation tels que la détection des feux de circulation.

La détection des lignes de voie implique deux aspects : le premier est d'identifier les lignes de voie, et pour les lignes de voie courbes, sa courbure peut être calculée le second est de déterminer le décalage du véhicule lui-même par rapport aux lignes de voie ; (c'est-à-dire que personne ne conduit) Là où la voiture se trouve sur la ligne de voie). Une méthode consiste à extraire certaines caractéristiques des voies, y compris les caractéristiques des bords (généralement des dégradés, tels que l'opérateur Sobel), les caractéristiques de couleur des lignes de voie, etc., à utiliser des polynômes pour ajuster les pixels que nous pensons être des lignes de voie, puis à se baser sur le polynôme. et La position actuelle de la caméra montée sur le véhicule détermine la courbure de la voie devant et la déviation du véhicule par rapport à la voie.

Une approche actuelle pour détecter les zones carrossables consiste à utiliser un réseau neuronal profond pour segmenter directement la scène, c'est-à-dire en entraînant un réseau neuronal profond qui classe pixel par pixel pour compléter le découpage des zones carrossables dans l'image.

La détection et la classification des participants au trafic reposent actuellement principalement sur des modèles d'apprentissage profond. Les modèles couramment utilisés comprennent deux catégories :

- Algorithmes de détection de cibles d'apprentissage profond basés sur des propositions régionales représentés par RCNN (RCNN, SPP-NET, Fast-RCNN, Faster-RCNN, etc.);

- Algorithme de détection de cible d'apprentissage profond basé sur la méthode de régression représentée par YOLO (YOLO, SSD, etc.); Au niveau de perception des véhicules sans pilote, l'importance du positionnement est évidente. Les véhicules sans pilote doivent connaître leur position exacte par rapport à l'environnement. L'erreur de positionnement ici ne peut pas dépasser 10 cm. Imaginez si notre erreur de positionnement de véhicule sans pilote était de 30 centimètres. ce serait un véhicule autonome très dangereux (à la fois pour les piétons et les passagers), car la couche de planification et d'exécution de la conduite autonome ne sait pas qu'il y a une erreur de 30 centimètres, et elle suit toujours le positionnement. Si les décisions et les contrôles sont basés sur sur des prémisses précises, alors les décisions prises pour certaines situations seront erronées, entraînant des accidents. On constate que les véhicules sans pilote nécessitent un positionnement de haute précision.

La méthode de positionnement la plus largement utilisée pour les véhicules sans pilote à l'heure actuelle est sans aucun doute la méthode de positionnement qui intègre le système de positionnement global (GPS) et le système de navigation inertielle (système de navigation inertielle). Parmi eux, la précision de positionnement du GPS est de l'ordre de plusieurs dizaines. de mètres en centimètres. Parmi eux, les capteurs GPS de haute précision sont relativement chers. La méthode de positionnement intégrant GPS/IMU ne peut pas atteindre un positionnement de haute précision lorsque le signal GPS est absent ou faible, comme dans les parkings souterrains et les zones urbaines entourées d'immeubles de grande hauteur. Par conséquent, elle ne peut être appliquée qu'aux tâches de conduite sans pilote. quelques scénarios.

L'algorithme de positionnement assisté par carte est un autre algorithme de positionnement de véhicules sans pilote largement utilisé. La localisation et la cartographie simultanées (SLAM) sont le représentant de ce type d'algorithme. Le but du SLAM est de créer une carte en même temps en utilisant cette carte. pour la localisation, SLAM détermine l'emplacement du véhicule actuel et l'emplacement des caractéristiques actuellement observées en utilisant les caractéristiques environnementales déjà observées.

Il s'agit d'un processus d'estimation de la position actuelle à l'aide d'observations passées et actuelles. En pratique, nous utilisons généralement un filtre bayésien pour le compléter, notamment le filtre de Kalman), le filtre de Kalman étendu (filtre de Kalman étendu) et le filtre de particules. (Filtre à particules).

Bien que SLAM soit un point chaud de la recherche dans le domaine du positionnement de robots, l'utilisation du positionnement SLAM dans le processus de développement actuel de véhicules sans pilote pose des problèmes. Contrairement aux robots, les véhicules sans pilote se déplacent sur de longues distances et dans de grands environnements ouverts. Dans les mouvements sur de longues distances, à mesure que la distance augmente, la déviation du positionnement SLAM augmentera progressivement, entraînant un échec de positionnement.

En pratique, une méthode efficace pour le positionnement des véhicules sans pilote consiste à modifier l'algorithme de correspondance de numérisation dans le SLAM d'origine. Plus précisément, nous ne cartographions plus pendant le positionnement, mais utilisons à l'avance des capteurs tels que le lidar pour cartographier le nuage de points régional. La carte est construite et une partie de la « sémantique » est ajoutée à la carte par le biais d'un programme et d'un traitement manuel (telles que des annotations spécifiques des lignes de voie, des réseaux routiers, des emplacements des feux de circulation, des règles de circulation du tronçon de route actuel, etc.), qui inclut la sémantique. La carte est la carte de haute précision (HD Map) de notre voiture sans conducteur.

En positionnement réel, nous utilisons le scan lidar actuel et la carte pré-construite de haute précision pour effectuer une correspondance de nuages de points afin de déterminer la position spécifique de notre véhicule sans pilote sur la carte. Cette méthode est collectivement appelée méthode de correspondance par scan. (Scan Matching), la méthode de correspondance de scan la plus courante est la méthode itérative du point le plus proche (ICP), qui complète l'enregistrement du nuage de points en fonction de la mesure de la distance entre le scan en cours et le scan cible.

De plus, la transformation des distributions normales (NDT) est également une méthode courante pour l'enregistrement des nuages de points. Elle permet un enregistrement basé sur les histogrammes des caractéristiques des nuages de points. Les méthodes de positionnement basées sur l'enregistrement de nuages de points peuvent également atteindre une précision de positionnement inférieure à 10 centimètres.

Bien que l'enregistrement par nuages de points puisse donner le positionnement global des véhicules sans pilote par rapport à la carte, cette méthode repose trop sur des cartes préconstruites de haute précision et doit encore être utilisée avec le positionnement GPS sur des sections de route ouvertes. la scène Pour des tronçons de route relativement uniques (tels que les autoroutes), le coût de l'utilisation du GPS et de la correspondance des nuages de points est relativement élevé.

Planification 03

Planification de mission

La conception de la structure hiérarchique du système de planification de conduite sans pilote est issue du DAPRA Urban Challenge organisé en 2007. Dans la compétition, la plupart des équipes participantes n'auront personne Le module de planification de la voiture est divisé en trois niveaux de conception : la planification des tâches, la planification du comportement et la planification des actions. Parmi elles, la planification des tâches est généralement également appelée planification d'itinéraire ou planification d'itinéraire (Planification d'itinéraire), qui est responsable d'un itinéraire de niveau relativement élevé. planification, comme la sélection du chemin du point de départ au point final.

Nous pouvons traiter notre système routier actuel en un graphe de réseau orienté (Directed Graph Network). Ce graphe de réseau orienté peut représenter les connexions entre les routes, les règles de circulation, la largeur des routes, etc. L'information est essentiellement la partie « sémantique » de la carte de haute précision que nous avons mentionnée dans la section de positionnement précédente. Ce graphe de réseau orienté est appelé un graphe de réseau de routes, comme le montre la figure suivante :

.

Chaque bord dirigé dans un tel graphique de réseau routier est pondéré. Ensuite, le problème de planification de trajet des véhicules sans pilote devient celui du graphique de réseau routier, afin que le véhicule atteigne un certain objectif (généralement du point A au point B). , le processus de sélection du chemin optimal (c'est-à-dire la perte minimale) basé sur une certaine méthode, le problème devient alors un problème de recherche de graphes dirigés. Les algorithmes traditionnels tels que l'algorithme de Dijkstra) et l'algorithme A* (algorithme A*) sont principalement utilisés. pour calculer la recherche de chemin optimale à partir de graphiques discrets, et sont utilisés pour rechercher le chemin avec le moins de perte dans le graphique du réseau routier.

Planification du comportement

La planification du comportement est parfois aussi appelée prise de décision (Decision Maker). La tâche principale est de suivre les objectifs de la planification de la mission et la situation locale actuelle (l'emplacement et le comportement des autres véhicules et piétons, le). règles de circulation en vigueur, etc.) pour prendre la prochaine décision que le véhicule sans pilote doit exécuter. Cette couche peut être comprise comme le copilote du véhicule. Il dirige le conducteur en fonction de la cible et de la situation de circulation actuelle, s'il doit suivre ou non. dépasser, ou s'il faut s'arrêter et attendre les piétons. Dépasser ou contourner les piétons, etc.

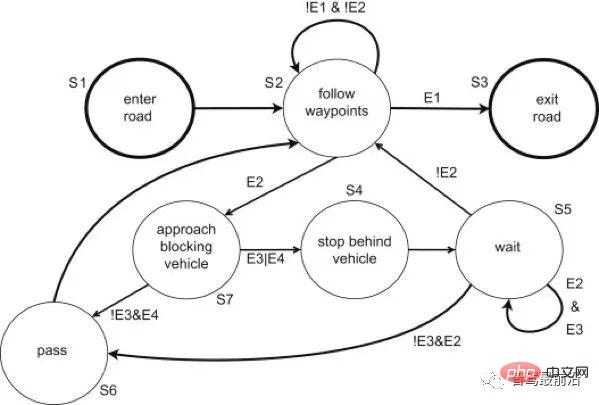

Une méthode de planification du comportement consiste à utiliser une machine à états finis (FSM) complexe contenant un grand nombre de phrases d'action. La machine à états finis part d'un état de base et passera à différents états en fonction de différents scénarios de conduite. L'état d'action transmet la phrase d'action à la couche inférieure de planification d'action. La figure ci-dessous est une simple machine à états finis :

Comme le montre la figure ci-dessus, chaque état est une décision sur l'action du véhicule. Il existe certaines conditions de saut entre les états, et certains états peuvent s'auto-boucler (comme l'état de suivi et l'état d'attente dans la figure ci-dessus). Bien qu'il s'agisse de la méthode de prise de décision comportementale principale actuellement utilisée dans les véhicules sans pilote, les machines à états finis présentent encore de grandes limites : premièrement, pour prendre des décisions comportementales complexes, un grand nombre d'états doivent être conçus manuellement dans l'état ; de la machine à états finis. États considérés ; si la machine à états finis n’est pas conçue avec une protection contre les blocages, le véhicule peut même tomber dans une sorte de blocage.

Planification d'action

Le processus de planification d'une série d'actions pour atteindre un certain objectif (comme éviter les obstacles) est appelé planification d'action. De manière générale, deux indicateurs sont généralement utilisés pour considérer les performances des algorithmes de planification d'action : l'efficacité informatique (Computational Efficiency) et l'exhaustivité (Completness). Les algorithmes de planification d'action varient considérablement. Cela dépend en grande partie de l'espace de configuration. Si un algorithme de planification d'action peut renvoyer une solution dans un temps limité s'il existe une solution au problème, et ne peut renvoyer aucune solution s'il n'y a pas de solution, alors nous appelons. l'action L'algorithme de planification est terminé.

Espace de configuration : un ensemble qui définit toutes les configurations possibles du robot. Il définit les dimensions dans lesquelles le robot peut se déplacer. Le problème discret bidimensionnel le plus simple, alors l'espace de configuration est [x, y], la configuration. du véhicule sans pilote L'espace peut être très complexe, selon l'algorithme de planification de mouvement utilisé.

Après avoir introduit la notion d'espace de configuration, la planification d'action des véhicules sans pilote devient : étant donné une configuration initiale (Configuration de démarrage), une configuration cible (Configuration d'objectif) et plusieurs contraintes (Contrainte), retrouver une série d'actions dans le espace de configuration pour atteindre la configuration cible. Le résultat de l'exécution de ces actions est de transférer le véhicule sans pilote de la configuration initiale à la configuration cible tout en satisfaisant les contraintes.

Dans le scénario d'application des véhicules autonomes, la configuration initiale est généralement l'état actuel du véhicule autonome (position actuelle, vitesse et vitesse angulaire, etc.), et la configuration cible provient de la couche supérieure de planification d'action - la couche de planification du comportement, et les contraintes sont les limites de mouvement du véhicule (amplitude angulaire maximale, accélération maximale, etc.).

Évidemment, la quantité de calcul pour la planification d'actions dans un espace de configuration de grande dimension est très énorme. Afin de garantir l'intégrité de l'algorithme de planification, nous devons rechercher presque tous les chemins possibles, ce qui constitue un problème en continu. planification d'action. Le problème de la « malédiction de la dimensionnalité ». Le concept central pour résoudre ce problème dans la planification d'action actuelle est de convertir le modèle spatial continu en un modèle discret. Les méthodes spécifiques peuvent être résumées en deux catégories : la planification combinatoire et la planification basée sur l'échantillonnage.

Les méthodes combinatoires de planification de mouvement trouvent des chemins à travers un espace de configuration continu sans recourir à des approximations. Grâce à cette propriété, ils peuvent être appelés algorithmes exacts. Les méthodes combinées trouvent une solution complète en construisant une représentation discrète du problème de planification, comme l'algorithme de planification d'action utilisé par la voiture autonome BOSS de la CMU dans le Darpa Urban Challenge. Ils utilisent d'abord un planificateur de chemin pour générer des chemins alternatifs et des points cibles (. ces chemins et points cibles sont accessibles par la dynamique de fusion), puis sélectionnez le chemin optimal grâce à l'algorithme d'optimisation.

Une autre méthode de discrétisation est les approches de décomposition de grille. Après avoir quadrillé l'espace de configuration, nous pouvons généralement trouver un chemin d'optimisation à l'aide d'un algorithme de recherche de graphes discrets (tel que A*).

Les méthodes basées sur l'échantillonnage sont largement utilisées en raison de leur exhaustivité probabiliste. Les algorithmes les plus courants sont les PRM (Probabilistic Roadmaps), RRT (Rapidly-Exploring Random Tree), FMT (Fast-Marching Trees), dans les véhicules sans pilote. Dans les applications. , la méthode d'échantillonnage d'état doit prendre en compte les contraintes de contrôle des deux états, et a également besoin d'une méthode capable de demander efficacement si l'état d'échantillonnage et l'état parent sont accessibles. Plus tard, nous présenterons en détail State-Lattice Planners, un algorithme de planification de mouvement basé sur l'échantillonnage.

04 Contrôle

En tant que couche la plus basse du système de véhicule sans pilote, la tâche de la couche de contrôle est de réaliser nos actions planifiées, donc l'indice d'évaluation du module de contrôle est la précision du contrôle. Il y aura des mesures à l'intérieur du système de contrôle et le contrôleur émet des actions de contrôle en comparant les mesures du véhicule avec notre état attendu. Ce processus est appelé contrôle par rétroaction.

Le contrôle par rétroaction est largement utilisé dans le domaine du contrôle d'automatisation. Le contrôleur par rétroaction le plus typique est le contrôleur PID (contrôleur proportionnel-intégral-dérivé). Le principe de contrôle du contrôleur PID est basé sur un simple signal d'erreur. Le signal d'erreur se compose de trois éléments : la proportion de l'erreur (Proportion), l'intégrale de l'erreur (Intégrale) et la dérivée de l'erreur (Dérivée).

Le contrôle PID reste le contrôleur le plus largement utilisé dans l'industrie en raison de sa mise en œuvre simple et de ses performances stables. Cependant, en tant que contrôleur à rétroaction pure, le contrôleur PID présente certains problèmes dans le contrôle des véhicules sans pilote : Contrôle PID Le contrôleur est purement basé. sur le retour d'erreur actuel. En raison du retard du mécanisme de freinage, cela entraînera un retard dans notre contrôle lui-même. Puisque PID n'a pas de modèle de système interne, PID ne peut pas modéliser le retard. Afin de résoudre ce problème, nous introduisons un contrôle. méthode basée sur la prédiction d’un modèle.

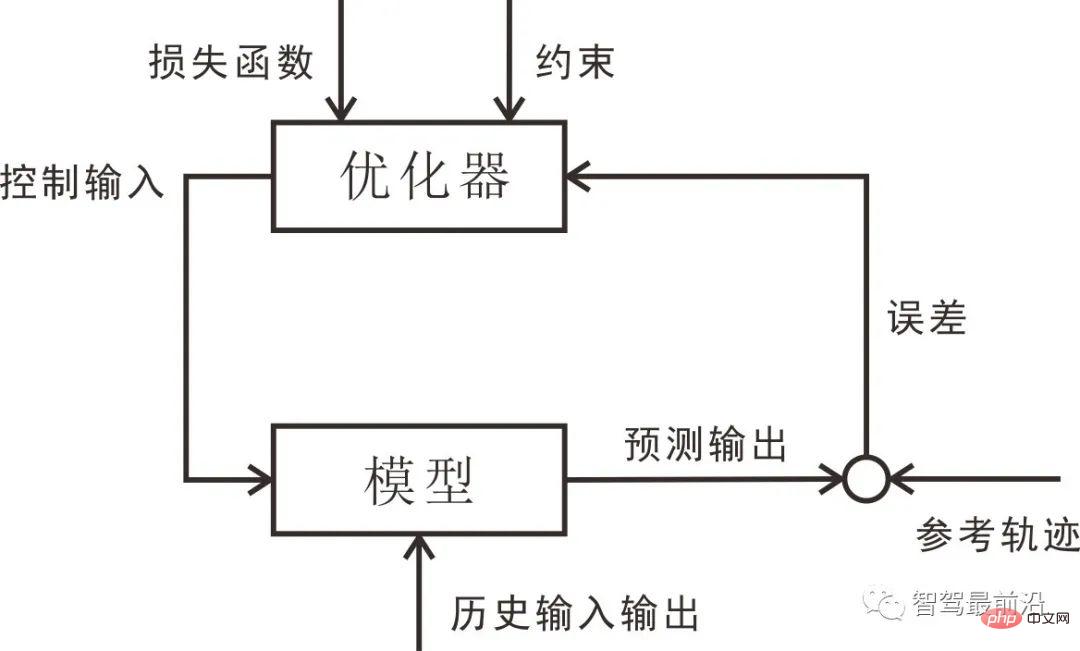

- Modèle prédictif : Un modèle qui prédit l'état de la période future en fonction de l'état actuel et des entrées de contrôle. Dans un système de véhicule sans pilote, il fait généralement référence au modèle cinématique/dynamique du véhicule ; Correction de rétroaction : le processus de correction de rétroaction est appliqué au modèle, ce qui confère au contrôle prédictif une forte capacité à résister aux perturbations et à surmonter l'incertitude du système.

- Optimisation roulante : Optimisez la séquence de contrôle sur une base glissante pour obtenir la séquence de prédiction la plus proche de la trajectoire de référence.

- Trajectoire de référence : la trajectoire fixée.

- La figure suivante montre la structure de base du contrôle prédictif du modèle. Étant donné que le contrôle prédictif du modèle est optimisé en fonction du modèle de mouvement, le problème de retard de contrôle rencontré dans le contrôle PID peut être rétabli et pris en compte par le modèle. le contrôle prédictif est utilisé dans les véhicules sans pilote. Il a une grande valeur d’application en matière de contrôle.

05 Conclusion

05 Conclusion Dans ce résumé, nous avons décrit la structure de base du système de conduite autonome Le système logiciel de conduite autonome est généralement divisé en trois couches : perception, planification et contrôle. Dans une certaine mesure, un véhicule sans pilote peut être considéré comme un « robot habité » dans ce système en couches. Parmi eux, la perception inclut spécifiquement la perception et le positionnement de l'environnement. Ces dernières années, les percées dans l'apprentissage profond ont permis la technologie de perception basée sur l'image et la profondeur. L'apprentissage joue un rôle de plus en plus important dans la perception de l'environnement. Avec l'aide de l'intelligence artificielle, nous ne nous limitons plus à percevoir les obstacles, mais nous comprenons progressivement ce que sont les obstacles, la compréhension des scènes et même la prévision des obstacles cibles. comportement des objets, apprentissage automatique et apprentissage profond dans les deux prochains chapitres.

Dans la perception réelle des véhicules sans pilote, nous devons généralement fusionner plusieurs mesures telles que le lidar, la caméra et le radar à ondes millimétriques. Cela implique des algorithmes de fusion tels que le filtrage de Kalman, le filtrage de Kalman étendu et le lidar.

Il existe de nombreuses méthodes de positionnement pour les véhicules sans pilote et les robots. La méthode courante actuelle consiste à utiliser la méthode de fusion GPS + système de navigation inertielle, et la seconde consiste à utiliser les méthodes de numérisation et de correspondance des nuages de points Lidar. Nous nous concentrerons sur l'ICP et le CND. et d'autres méthodes basées sur la correspondance de nuages de points.

Le module de planification est également divisé en trois couches : la planification des tâches (également appelée planification de chemin), la planification du comportement et la planification des actions. La méthode de planification des tâches basée sur le réseau routier et l'algorithme de recherche de chemin discret sera introduite plus tard dans la planification du comportement. Dans ce chapitre, nous nous concentrerons sur l'application des machines à états finis dans la prise de décision comportementale. Au niveau des algorithmes de planification d'action, nous nous concentrerons sur les méthodes de planification basées sur l'échantillonnage.

Nous utilisons souvent des méthodes de contrôle basées sur la prédiction d'un modèle pour le module de contrôle des véhicules sans pilote, mais avant de comprendre l'algorithme de contrôle prédictif du modèle, en tant que compréhension du contrôle par rétroaction de base, nous avons déjà découvert le contrôleur PID. Ensuite, nous étudions les deux types de modèles de véhicules les plus simples : les modèles de vélos cinématiques et les modèles de vélos dynamiques, et enfin, nous introduisons le contrôle prédictif des modèles.

Bien que le consensus actuel dans l'industrie soit de comprendre les véhicules sans pilote comme des robots et d'utiliser la pensée développée par les robots pour traiter les systèmes de véhicules sans pilote, il existe également des cas où l'intelligence artificielle ou des agents sont simplement utilisés pour effectuer une conduite sans pilote. Parmi eux, la conduite sans conducteur de bout en bout basée sur l’apprentissage profond et les agents de conduite basés sur l’apprentissage par renforcement sont des points chauds de recherche actuels.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

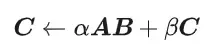

La multiplication matricielle universelle de CUDA : de l'entrée à la maîtrise !

Mar 25, 2024 pm 12:30 PM

La multiplication matricielle universelle de CUDA : de l'entrée à la maîtrise !

Mar 25, 2024 pm 12:30 PM

La multiplication matricielle générale (GEMM) est un élément essentiel de nombreuses applications et algorithmes, et constitue également l'un des indicateurs importants pour évaluer les performances du matériel informatique. Une recherche approfondie et l'optimisation de la mise en œuvre de GEMM peuvent nous aider à mieux comprendre le calcul haute performance et la relation entre les systèmes logiciels et matériels. En informatique, une optimisation efficace de GEMM peut augmenter la vitesse de calcul et économiser des ressources, ce qui est crucial pour améliorer les performances globales d’un système informatique. Une compréhension approfondie du principe de fonctionnement et de la méthode d'optimisation de GEMM nous aidera à mieux utiliser le potentiel du matériel informatique moderne et à fournir des solutions plus efficaces pour diverses tâches informatiques complexes. En optimisant les performances de GEMM

Le système de conduite intelligent Qiankun ADS3.0 de Huawei sera lancé en août et sera lancé pour la première fois sur Xiangjie S9

Jul 30, 2024 pm 02:17 PM

Le système de conduite intelligent Qiankun ADS3.0 de Huawei sera lancé en août et sera lancé pour la première fois sur Xiangjie S9

Jul 30, 2024 pm 02:17 PM

Le 29 juillet, lors de la cérémonie de lancement de la 400 000e nouvelle voiture d'AITO Wenjie, Yu Chengdong, directeur général de Huawei, président de Terminal BG et président de la BU Smart Car Solutions, a assisté et prononcé un discours et a annoncé que les modèles de la série Wenjie seraient sera lancé cette année En août, la version Huawei Qiankun ADS 3.0 a été lancée et il est prévu de pousser successivement les mises à niveau d'août à septembre. Le Xiangjie S9, qui sortira le 6 août, lancera le système de conduite intelligent ADS3.0 de Huawei. Avec l'aide du lidar, la version Huawei Qiankun ADS3.0 améliorera considérablement ses capacités de conduite intelligente, disposera de capacités intégrées de bout en bout et adoptera une nouvelle architecture de bout en bout de GOD (identification générale des obstacles)/PDP (prédictive prise de décision et contrôle), fournissant la fonction NCA de conduite intelligente d'une place de stationnement à l'autre et mettant à niveau CAS3.0

Quelle version du système Apple 16 est la meilleure ?

Mar 08, 2024 pm 05:16 PM

Quelle version du système Apple 16 est la meilleure ?

Mar 08, 2024 pm 05:16 PM

La meilleure version du système Apple 16 est iOS16.1.4. La meilleure version du système iOS16 peut varier d'une personne à l'autre. Les ajouts et améliorations de l'expérience d'utilisation quotidienne ont également été salués par de nombreux utilisateurs. Quelle version du système Apple 16 est la meilleure ? Réponse : iOS16.1.4 La meilleure version du système iOS 16 peut varier d'une personne à l'autre. Selon les informations publiques, iOS16, lancé en 2022, est considéré comme une version très stable et performante, et les utilisateurs sont plutôt satisfaits de son expérience globale. De plus, l'ajout de nouvelles fonctionnalités et les améliorations de l'expérience d'utilisation quotidienne dans iOS16 ont également été bien accueillies par de nombreux utilisateurs. Surtout en termes de durée de vie de la batterie mise à jour, de performances du signal et de contrôle du chauffage, les retours des utilisateurs ont été relativement positifs. Cependant, compte tenu de l'iPhone14

Toujours nouveau ! Mises à niveau de la série Huawei Mate60 vers HarmonyOS 4.2 : amélioration du cloud AI, le dialecte Xiaoyi est si facile à utiliser

Jun 02, 2024 pm 02:58 PM

Toujours nouveau ! Mises à niveau de la série Huawei Mate60 vers HarmonyOS 4.2 : amélioration du cloud AI, le dialecte Xiaoyi est si facile à utiliser

Jun 02, 2024 pm 02:58 PM

Le 11 avril, Huawei a officiellement annoncé pour la première fois le plan de mise à niveau de 100 machines HarmonyOS 4.2. Cette fois, plus de 180 appareils participeront à la mise à niveau, couvrant les téléphones mobiles, les tablettes, les montres, les écouteurs, les écrans intelligents et d'autres appareils. Au cours du mois dernier, avec la progression constante du plan de mise à niveau de 100 machines HarmonyOS4.2, de nombreux modèles populaires, notamment Huawei Pocket2, la série Huawei MateX5, la série nova12, la série Huawei Pura, etc., ont également commencé à être mis à niveau et à s'adapter, ce qui signifie qu'il y aura davantage d'utilisateurs de modèles Huawei pourront profiter de l'expérience commune et souvent nouvelle apportée par HarmonyOS. À en juger par les commentaires des utilisateurs, l'expérience des modèles de la série Huawei Mate60 s'est améliorée à tous égards après la mise à niveau d'HarmonyOS4.2. Surtout Huawei M

Quels sont les systèmes d'exploitation informatiques ?

Jan 12, 2024 pm 03:12 PM

Quels sont les systèmes d'exploitation informatiques ?

Jan 12, 2024 pm 03:12 PM

Un système d'exploitation informatique est un système utilisé pour gérer du matériel informatique et des logiciels. C'est également un programme de système d'exploitation développé sur la base de tous les systèmes logiciels. Alors, quels sont les systèmes informatiques ? Ci-dessous, l'éditeur partagera avec vous ce que sont les systèmes d'exploitation informatiques. Le soi-disant système d'exploitation consiste à gérer le matériel informatique et les logiciels. Tous les logiciels sont développés sur la base des programmes du système d'exploitation. En fait, il existe de nombreux types de systèmes d’exploitation, notamment ceux à usage industriel, commercial et personnel, couvrant un large éventail d’applications. Ci-dessous, l'éditeur vous expliquera ce que sont les systèmes d'exploitation informatiques. Quels systèmes d'exploitation informatiques sont les systèmes Windows ? Le système Windows est un système d'exploitation développé par Microsoft Corporation des États-Unis. que le plus

Explication détaillée de la façon de modifier la date système dans la base de données Oracle

Mar 09, 2024 am 10:21 AM

Explication détaillée de la façon de modifier la date système dans la base de données Oracle

Mar 09, 2024 am 10:21 AM

Explication détaillée de la méthode de modification de la date système dans la base de données Oracle. Dans la base de données Oracle, la méthode de modification de la date système consiste principalement à modifier le paramètre NLS_DATE_FORMAT et à utiliser la fonction SYSDATE. Cet article présentera en détail ces deux méthodes et leurs exemples de code spécifiques pour aider les lecteurs à mieux comprendre et maîtriser l'opération de modification de la date système dans la base de données Oracle. 1. Modifier la méthode du paramètre NLS_DATE_FORMAT NLS_DATE_FORMAT correspond aux données Oracle

Différences et similitudes des commandes cmd dans les systèmes Linux et Windows

Mar 15, 2024 am 08:12 AM

Différences et similitudes des commandes cmd dans les systèmes Linux et Windows

Mar 15, 2024 am 08:12 AM

Linux et Windows sont deux systèmes d'exploitation courants, représentant respectivement le système Linux open source et le système Windows commercial. Dans les deux systèmes d'exploitation, il existe une interface de ligne de commande permettant aux utilisateurs d'interagir avec le système d'exploitation. Sur les systèmes Linux, les utilisateurs utilisent la ligne de commande Shell, tandis que sur les systèmes Windows, les utilisateurs utilisent la ligne de commande cmd. La ligne de commande Shell dans le système Linux est un outil très puissant qui peut effectuer presque toutes les tâches de gestion du système.

Comment résoudre l'erreur 0xc0000428 dans le système win10

Dec 27, 2023 pm 04:41 PM

Comment résoudre l'erreur 0xc0000428 dans le système win10

Dec 27, 2023 pm 04:41 PM

Après avoir installé le système d'exploitation Win10 sur nos ordinateurs, certains amis peuvent rencontrer un écran bleu du système et demander le code d'erreur 0xc0000428 lors de l'utilisation de l'ordinateur. Ne vous inquiétez pas de ce genre de problème, l'éditeur pense que nous pouvons d'abord résoudre le problème sur le système pour voir s'il est causé par le matériel ou le logiciel, puis résoudre le problème de manière ciblée. Jetons un coup d'œil à ce que l'éditeur a fait pour les détails spécifiques ~ Comment résoudre le problème de 0xc0000428 dans le système win10 1. Redémarrez continuellement, puis forcez l'arrêt trois fois pour permettre au système win10 d'entrer automatiquement dans les options de démarrage avancées. 2. Dans l'interface des options de démarrage avancées du système Win10, ouvrez dans l'ordre : Dépannage-Options avancées-Paramètres de démarrage, dans Paramètres de démarrage.

05 Conclusion

05 Conclusion