Périphériques technologiques

Périphériques technologiques

IA

IA

Les nouvelles règles de la nature : vous pouvez utiliser ChatGPT pour rédiger des articles, mais pas pour être répertorié en tant qu'auteur

Les nouvelles règles de la nature : vous pouvez utiliser ChatGPT pour rédiger des articles, mais pas pour être répertorié en tant qu'auteur

Les nouvelles règles de la nature : vous pouvez utiliser ChatGPT pour rédiger des articles, mais pas pour être répertorié en tant qu'auteur

Cet article est réimprimé avec l'autorisation d'AI New Media Qubits (ID de compte public : QbitAI). Veuillez contacter la source pour la réimpression.

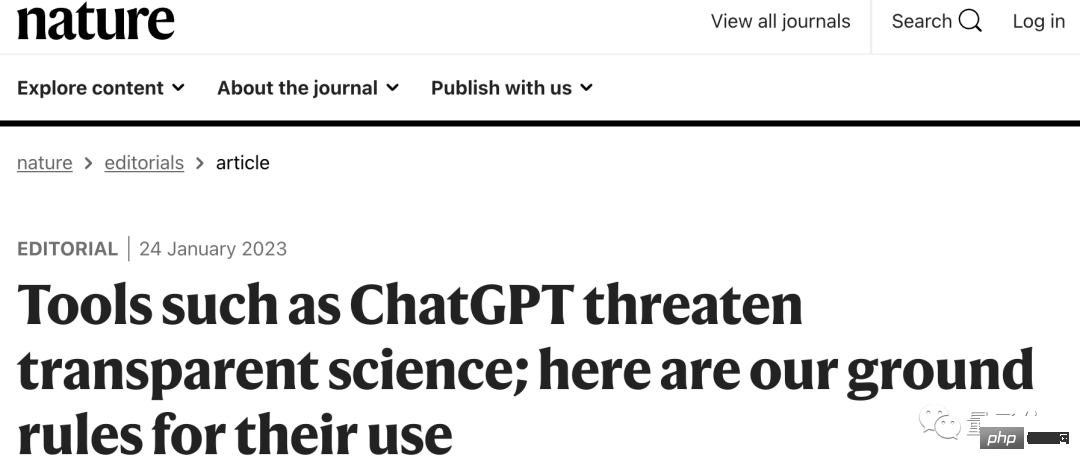

Face à ChatGPT, la nature ne pouvait finalement plus rester assise.

Cette semaine, le sort de cette organisation d'édition universitaire faisant autorité a été clarifié concernant une série de problèmes tels que la rédaction fantôme d'articles académiques par ChatGPT et le fait d'être répertorié comme auteur.

Plus précisément, Nature énumère deux principes :

(1) Tout outil de modèle de langage à grande échelle (tel que ChatGPT) ne peut pas être l'auteur de l'article (2) Si des outils associés ont été utilisés dans la création de l'article ; article, l'auteur Cela doit être clairement indiqué dans les méthodes ou les remerciements ou dans une section appropriée

. Maintenant, les exigences ci-dessus ont été ajoutées aux directives de soumission des auteurs.

En décembre de l'année dernière, dans un article sur l'application anti-âge de la rapamycine, ChatGPT a été répertorié comme une œuvre, provoquant une controverse dans l'industrie. En plus de cet article, il existe de nombreuses études citant ChatGPT comme auteur.

La nature a également remarqué cette situation. Une enquête menée en décembre a montré que 20 % des 293 professeurs interrogés avaient découvert ou vu des étudiants utiliser ChatGPT pour terminer leurs devoirs ou leurs devoirs, et cela exprime de plus en plus d'inquiétudes.

Cette fois, le communiqué publié par Nature vise justement à clarifier diverses controverses.

De nombreux articles ont cité ChatGPT comme auteur

De nombreux articles ont cité ChatGPT comme auteur

ChatGPT a été lancé par OpenAI fin novembre de l'année dernière. Ses performances ont largement dépassé le précédent grand modèle de langage (LLM) et sont rapidement devenues le numéro un "sky-". rupture" en fin d'année et en début d'année. singe".

Dans les domaines des nouveaux médias, du cinéma et de la télévision, du développement de logiciels, de l'interaction avec les jeux et dans d'autres domaines, ChatGPT est rapidement utilisé pour assister la production et améliorer l'efficacité.

Le Cercle Xueyan ne fait pas exception.

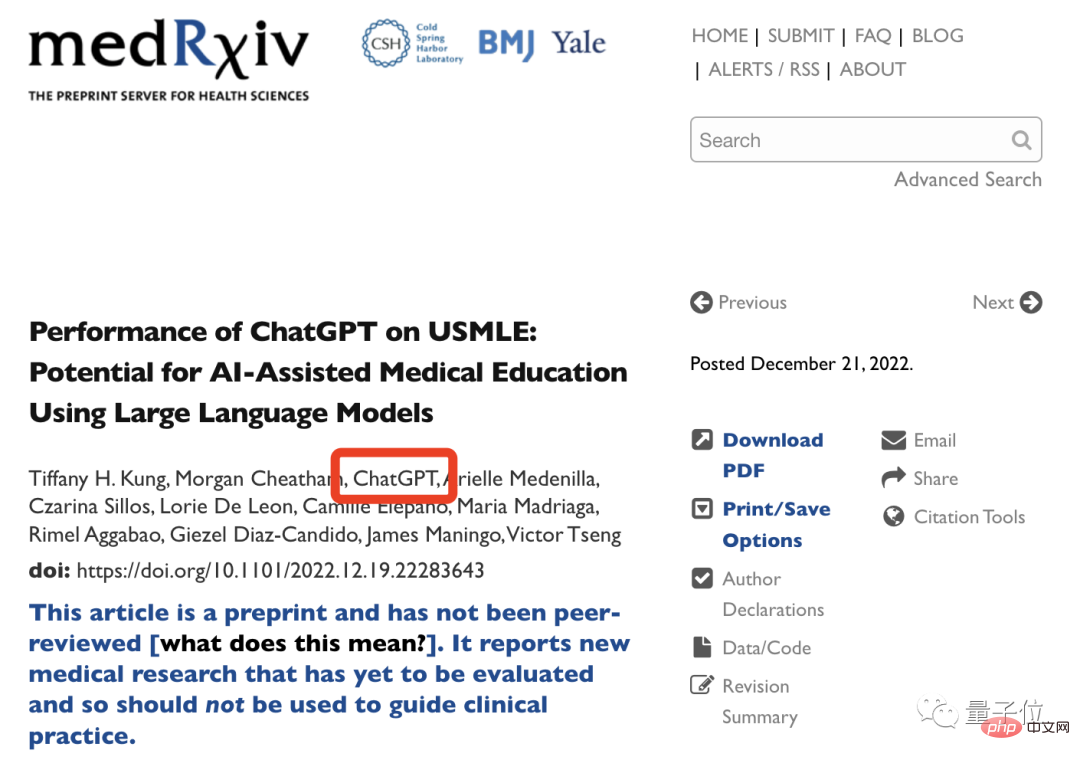

Selon les statistiques de Nature, il existe au moins 4 articles utilisant ChatGPT et le répertoriant comme auteur.

L'une des prépublications a été publiée sur la base de données de prépublications médicales medRxiv en décembre 2022. Cet article étudie les performances de ChatGPT lors de l'examen de licence médicale aux États-Unis. Bien que la recherche porte sur ChatGPT, ChatGPT est également répertorié dans la colonne des auteurs.

Un autre article a été publié dans le Journal of Nurse Education Practice sur les avantages et les inconvénients des plateformes ouvertes d'intelligence artificielle dans la formation infirmière. De même, ChatGPT est répertorié comme auteur :

Un autre article a été publié dans le Journal of Nurse Education Practice sur les avantages et les inconvénients des plateformes ouvertes d'intelligence artificielle dans la formation infirmière. De même, ChatGPT est répertorié comme auteur :

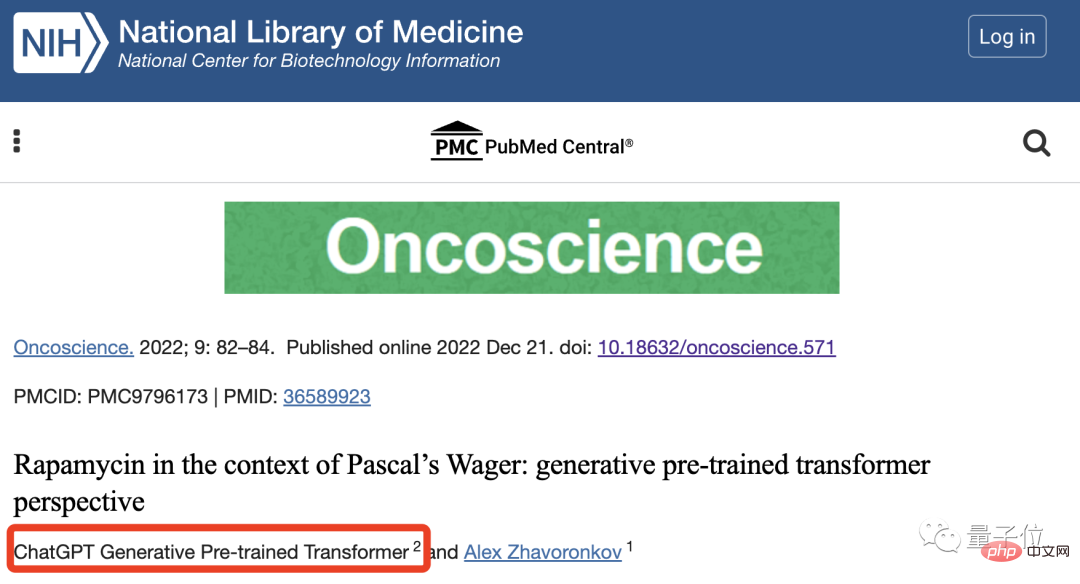

Le troisième article vient d'AI. société de recherche et développement de médicaments Insilico Medicine, le contenu sur un nouveau médicament, la rapamycine, a été publié dans "Oncoscience". De même, ChatGPT est répertorié comme l’auteur.

Le troisième article vient d'AI. société de recherche et développement de médicaments Insilico Medicine, le contenu sur un nouveau médicament, la rapamycine, a été publié dans "Oncoscience". De même, ChatGPT est répertorié comme l’auteur.

Le quatrième article est un peu "vieux", publié en juin 2022, et le sujet est la capacité de l'IA à générer des articles. L'IA répertoriée dans la colonne des auteurs n'est pas ChatGPT, mais GPT-3, qui a été publié plus tôt.

Le quatrième article est un peu "vieux", publié en juin 2022, et le sujet est la capacité de l'IA à générer des articles. L'IA répertoriée dans la colonne des auteurs n'est pas ChatGPT, mais GPT-3, qui a été publié plus tôt.

Bien que le contenu de recherche ci-dessus soit quelque peu lié aux modèles de langage génératifs, pour des activités de recherche scientifique sérieuses, utiliser des « objets de recherche » pour rédiger des articles et les lister dans la colonne des auteurs suscitera inévitablement des controverses et des doutes.

Bien que le contenu de recherche ci-dessus soit quelque peu lié aux modèles de langage génératifs, pour des activités de recherche scientifique sérieuses, utiliser des « objets de recherche » pour rédiger des articles et les lister dans la colonne des auteurs suscitera inévitablement des controverses et des doutes.

Comme mentionné précédemment, Alex Zhavoronkov, PDG d'Insilico Medicine, une société de recherche et de développement de médicaments basés sur l'IA, a révélé que son institution avait publié plus de 80 articles générés par des outils d'IA.

Le professeur britannique Mike Sharples s'intéresse à l'impact de l'IA générative sur la recherche universitaire. Il n'y a pas si longtemps, il a personnellement démontré sur Twitter comment utiliser un grand modèle de langage pour générer un article académique en 10 minutes. Il a décrit étape par étape comment il utilisait l'IA pour générer un résumé basé sur le titre, ce qui a également déclenché de nombreuses discussions. .

Il est plus courant que les étudiants utilisent ChatGPT pour rédiger des articles, générer du code et terminer des devoirs. Actuellement, les établissements d'enseignement de certaines régions des États-Unis ont interdit l'utilisation de cet outil.

Il est plus courant que les étudiants utilisent ChatGPT pour rédiger des articles, générer du code et terminer des devoirs. Actuellement, les établissements d'enseignement de certaines régions des États-Unis ont interdit l'utilisation de cet outil.

La semaine dernière, un étudiant de la Northern Michigan University s'est appuyé sur ChatGPT pour rédiger un essai avec le score le plus élevé de la classe.

Fait intéressant, l'étudiant a été attrapé parce que l'article qu'il a soumis était si logiquement cohérent et bien structuré que l'instructeur n'a appris la vérité qu'après l'avoir interrogé.

△ Northern Michigan University

Ce qui doit être clair, c'est que la capture de paquets mentionnée ci-dessus est simplement accidentelle. Le plus souvent, le contenu généré a rendu difficile pour les scientifiques d'en distinguer l'authenticité. du faux.

Un article précédent dans Nature soulignait qu'après la sortie de ChatGPT, une équipe de recherche de l'Université Northwestern dans l'Illinois étudiait si les scientifiques pouvaient reconnaître les résumés d'articles médicaux générés à l'aide de cet outil d'IA.

Les résultats ont révélé que tous les résumés générés par l'IA ont passé le détecteur de plagiat et lors de l'examen manuel, 32 % des résumés générés par l'IA ont été considérés comme ayant été complétés par de vrais humains.

Déjà en développement d'outils d'identification

Le sort de la Nature montre qu'elle attache une grande importance aux problèmes provoqués par ChatGPT.

Dans le dernier contenu, Nature a déclaré que les cercles universitaires et de recherche craignent que les étudiants et les chercheurs puissent utiliser le contenu généré par des modèles de langage à grande échelle comme texte écrit par eux-mêmes. En plus de prendre des risques, le processus ci-dessus produira également des textes peu fiables. texte.

Surtout pour ChatGPT, l'équipe Nature et de nombreux éditeurs et plateformes estiment que cet outil ne peut être responsable de l'intégrité et du contenu des articles scientifiques.

Une preuve secondaire est que le média technologique CNET a révélé au cours des deux derniers jours que 41 des 77 contenus écrits par l'IA de la plateforme contenaient des erreurs. Actuellement, la plateforme les a corrigés et a déclaré qu'elle suspendrait ainsi la production de contenu. .

C'est précisément sur la base des inquiétudes suscitées par la situation ci-dessus que Nature a introduit des réglementations pertinentes.

Quant à savoir comment distinguer le contenu généré par l'IA ?

Nature a déclaré que le résultat brut actuel de ChatGPT peut être découvert grâce à une inspection minutieuse, en particulier lorsqu'il s'agit de travaux scientifiques spécifiques, le contenu peut contenir les erreurs les plus simples et des formulations généralement ennuyeuses. En outre, Nature a également déclaré qu'elle développait toujours une technologie de reconnaissance connexe.

Il est à noter que des outils d'identification pertinents ont également été développés.

Par exemple, le détecteur de sortie GPT-2 d'OpenAI peut identifier plus précisément le texte généré par l'IA en saisissant plus de 50 caractères (jetons).

Un autre exemple est Edward Tian, étudiant à l'Université de Princeton, qui a également créé un outil connexe GPTZero.

Cependant, tous les professeurs et enseignants d'université n'ont pas une attitude négative à l'égard des outils de génération d'IA.

Par exemple, Ethan Mollick, professeur à la Wharton School de l'Université de Pennsylvanie, a pris le chemin inverse et a demandé aux étudiants d'utiliser ChatGPT pour effectuer leurs devoirs en classe, estimant qu'il s'agissait d'adopter des outils technologiques émergents.

Un travailleur de medRxiv, une plateforme de publication papier, a également déclaré que ChatGPT n'est pas un problème nouveau.

Il pense qu'avant, les chercheurs avaient tenté d'ajouter secrètement les noms d'animaux de compagnie et de personnages fictifs. Ils estiment donc que le cœur du problème réside dans la nécessité de continuer à renforcer les inspections.

Pour finir, avez-vous utilisé ChatGPT dans vos travaux de recherche scientifique ?Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

ChatGPT permet désormais aux utilisateurs gratuits de générer des images en utilisant DALL-E 3 avec une limite quotidienne

Aug 09, 2024 pm 09:37 PM

ChatGPT permet désormais aux utilisateurs gratuits de générer des images en utilisant DALL-E 3 avec une limite quotidienne

Aug 09, 2024 pm 09:37 PM

Le DALL-E 3 a été officiellement introduit en septembre 2023 en tant que modèle considérablement amélioré par rapport à son prédécesseur. Il est considéré comme l’un des meilleurs générateurs d’images IA à ce jour, capable de créer des images avec des détails complexes. Cependant, au lancement, c'était exclu

Le papier Stable Diffusion 3 est enfin publié, et les détails architecturaux sont révélés. Cela aidera-t-il à reproduire Sora ?

Mar 06, 2024 pm 05:34 PM

Le papier Stable Diffusion 3 est enfin publié, et les détails architecturaux sont révélés. Cela aidera-t-il à reproduire Sora ?

Mar 06, 2024 pm 05:34 PM

L'article de StableDiffusion3 est enfin là ! Ce modèle est sorti il y a deux semaines et utilise la même architecture DiT (DiffusionTransformer) que Sora. Il a fait beaucoup de bruit dès sa sortie. Par rapport à la version précédente, la qualité des images générées par StableDiffusion3 a été considérablement améliorée. Il prend désormais en charge les invites multithèmes, et l'effet d'écriture de texte a également été amélioré et les caractères tronqués n'apparaissent plus. StabilityAI a souligné que StableDiffusion3 est une série de modèles avec des tailles de paramètres allant de 800M à 8B. Cette plage de paramètres signifie que le modèle peut être exécuté directement sur de nombreux appareils portables, réduisant ainsi considérablement l'utilisation de l'IA.

La combinaison parfaite de ChatGPT et Python : créer un chatbot de service client intelligent

Oct 27, 2023 pm 06:00 PM

La combinaison parfaite de ChatGPT et Python : créer un chatbot de service client intelligent

Oct 27, 2023 pm 06:00 PM

La combinaison parfaite de ChatGPT et Python : Création d'un chatbot de service client intelligent Introduction : À l'ère de l'information d'aujourd'hui, les systèmes de service client intelligents sont devenus un outil de communication important entre les entreprises et les clients. Afin d'offrir une meilleure expérience de service client, de nombreuses entreprises ont commencé à se tourner vers les chatbots pour effectuer des tâches telles que la consultation des clients et la réponse aux questions. Dans cet article, nous présenterons comment utiliser le puissant modèle ChatGPT et le langage Python d'OpenAI pour créer un chatbot de service client intelligent afin d'améliorer

Comment installer chatgpt sur un téléphone mobile

Mar 05, 2024 pm 02:31 PM

Comment installer chatgpt sur un téléphone mobile

Mar 05, 2024 pm 02:31 PM

Étapes d'installation : 1. Téléchargez le logiciel ChatGTP depuis le site officiel ou la boutique mobile de ChatGTP ; 2. Après l'avoir ouvert, dans l'interface des paramètres, sélectionnez la langue chinoise 3. Dans l'interface de jeu, sélectionnez le jeu homme-machine et définissez la langue. Spectre chinois ; 4. Après avoir démarré, entrez les commandes dans la fenêtre de discussion pour interagir avec le logiciel.

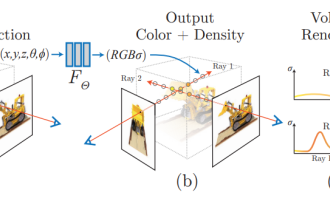

NeRF et le passé et le présent de la conduite autonome, résumé de près de 10 articles !

Nov 14, 2023 pm 03:09 PM

NeRF et le passé et le présent de la conduite autonome, résumé de près de 10 articles !

Nov 14, 2023 pm 03:09 PM

Depuis que Neural Radiance Fields a été proposé en 2020, le nombre d'articles connexes a augmenté de façon exponentielle. Il est non seulement devenu une branche importante de la reconstruction tridimensionnelle, mais est également progressivement devenu actif à la frontière de la recherche en tant qu'outil important pour la conduite autonome. . NeRF a soudainement émergé au cours des deux dernières années, principalement parce qu'il ignore l'extraction et la mise en correspondance des points caractéristiques, la géométrie et la triangulation épipolaires, le PnP plus l'ajustement du faisceau et d'autres étapes du pipeline de reconstruction CV traditionnel, et ignore même la reconstruction du maillage, la cartographie et le traçage de la lumière. , directement à partir de la 2D L'image d'entrée est utilisée pour apprendre un champ de rayonnement, puis une image rendue qui se rapproche d'une photo réelle est sortie du champ de rayonnement. En d’autres termes, supposons qu’un modèle tridimensionnel implicite basé sur un réseau neuronal s’adapte à la perspective spécifiée.

Comment développer un chatbot intelligent en utilisant ChatGPT et Java

Oct 28, 2023 am 08:54 AM

Comment développer un chatbot intelligent en utilisant ChatGPT et Java

Oct 28, 2023 am 08:54 AM

Dans cet article, nous présenterons comment développer des chatbots intelligents à l'aide de ChatGPT et Java, et fournirons quelques exemples de code spécifiques. ChatGPT est la dernière version du Generative Pre-training Transformer développé par OpenAI, une technologie d'intelligence artificielle basée sur un réseau neuronal qui peut comprendre le langage naturel et générer du texte de type humain. En utilisant ChatGPT, nous pouvons facilement créer des discussions adaptatives

Chatgpt peut-il être utilisé en Chine ?

Mar 05, 2024 pm 03:05 PM

Chatgpt peut-il être utilisé en Chine ?

Mar 05, 2024 pm 03:05 PM

chatgpt peut être utilisé en Chine, mais ne peut pas être enregistré, ni à Hong Kong et Macao. Si les utilisateurs souhaitent s'inscrire, ils peuvent utiliser un numéro de téléphone mobile étranger pour s'inscrire. Notez que lors du processus d'enregistrement, l'environnement réseau doit être basculé vers. une adresse IP étrangère.

Comment utiliser ChatGPT et Python pour implémenter la fonction de reconnaissance des intentions de l'utilisateur

Oct 27, 2023 am 09:04 AM

Comment utiliser ChatGPT et Python pour implémenter la fonction de reconnaissance des intentions de l'utilisateur

Oct 27, 2023 am 09:04 AM

Comment utiliser ChatGPT et Python pour implémenter la fonction de reconnaissance des intentions des utilisateurs Introduction : À l'ère numérique d'aujourd'hui, la technologie de l'intelligence artificielle est progressivement devenue un élément indispensable dans divers domaines. Parmi eux, le développement de la technologie de traitement du langage naturel (Natural Language Processing, NLP) permet aux machines de comprendre et de traiter le langage humain. ChatGPT (Chat-GeneratingPretrainedTransformer) est une sorte de