Périphériques technologiques

Périphériques technologiques

IA

IA

Portez un casque VR pour apprendre à un robot à saisir, et le robot l'apprendra sur place

Portez un casque VR pour apprendre à un robot à saisir, et le robot l'apprendra sur place

Portez un casque VR pour apprendre à un robot à saisir, et le robot l'apprendra sur place

Ces dernières années, de nombreux développements intéressants ont émergé dans le domaine de la robotique, comme les chiens robots qui peuvent danser et jouer au football, et les robots bipèdes qui font bouger les choses. Généralement, ces robots s'appuient sur la génération de stratégies de contrôle basées sur des entrées sensorielles. Bien que cette approche évite les défis liés au développement de modules d’estimation d’état, à la modélisation des propriétés des objets et au réglage des gains du contrôleur, elle nécessite une expertise significative dans le domaine. Même avec de nombreux progrès, les goulots d’étranglement en matière d’apprentissage font qu’il est difficile pour les robots d’effectuer des tâches arbitraires et d’atteindre des objectifs généraux.

Pour comprendre la clé de l'apprentissage des robots, une question centrale est la suivante : comment collectons-nous les données d'entraînement des robots ? Une approche consiste à collecter des données sur le robot grâce à une stratégie de collecte de données auto-supervisée. Bien que cette approche soit relativement robuste, elle nécessite souvent des milliers d’heures d’interaction de données avec le monde réel, même pour des tâches opérationnelles relativement simples. L'autre consiste à s'entraîner sur des données simulées puis à transférer vers des robots réels (Sim2Real). Cela permet aux robots d’apprendre des comportements robotiques complexes de plusieurs ordres de grandeur plus rapidement. Cependant, la mise en place d'un environnement robotique simulé et la spécification des paramètres du simulateur nécessitent souvent une expertise approfondie du domaine.

En fait, il existe une troisième méthode. Pour collecter des données de formation, vous pouvez également demander à des enseignants humains de faire des démonstrations, puis entraîner le robot à imiter rapidement des démonstrations humaines. Cette approche d’imitation a récemment montré un grand potentiel dans une variété de problèmes opérationnels difficiles. Cependant, la plupart de ces travaux souffrent d’une limitation fondamentale : il est difficile de collecter des données de démonstration de haute qualité pour les robots.

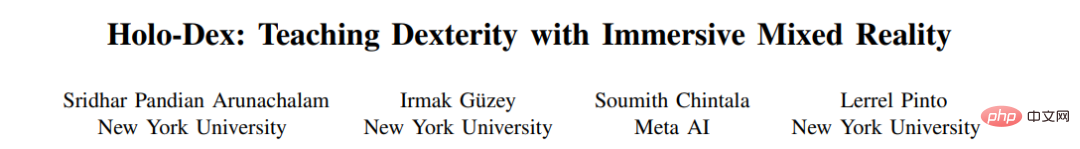

Sur la base des problèmes ci-dessus, des chercheurs de l'Université de New York et de Meta AI ont proposé HOLO-DEX, un nouveau cadre pour collecter des données de démonstration et entraîner des robots adroits. Il utilise un casque VR (comme le Quest 2) pour placer des enseignants humains dans un monde virtuel immersif. Dans ce monde virtuel, les enseignants peuvent voir ce que le robot « voit » à travers les yeux du robot et contrôler le manipulateur Allegro via des détecteurs de pose intégrés.

Cela ressemble à un humain apprenant au robot à effectuer des actions "étape par étape" :

HOLODEX permet aux humains de fournir de manière transparente des données de démonstration de haute qualité au robot grâce à un système de retour d'observation à faible latence. . Il présente les trois avantages suivants :

- Par rapport aux méthodes de collecte de données auto-supervisées, HOLODEX est basé sur une puissante technologie d'apprentissage par imitation et peut être formé rapidement sans mécanisme de récompense.

- Par rapport à la méthode Sim2Real, les politiques apprises peuvent être exécutées directement sur de vrais robots car ils sont formés sur des données réelles ;

- Par rapport à d'autres méthodes d'imitation, HOLODEX réduit considérablement les exigences en matière d'expertise dans le domaine et ne nécessite que des humains pour faire fonctionner des appareils VR ;

Lien papier : https://arxiv.org/pdf/2210.06463.pdf

Lien du projet : https://holo-dex.github.io/

Lien du code : https://github.com/SridharPandian/Holo-Dex

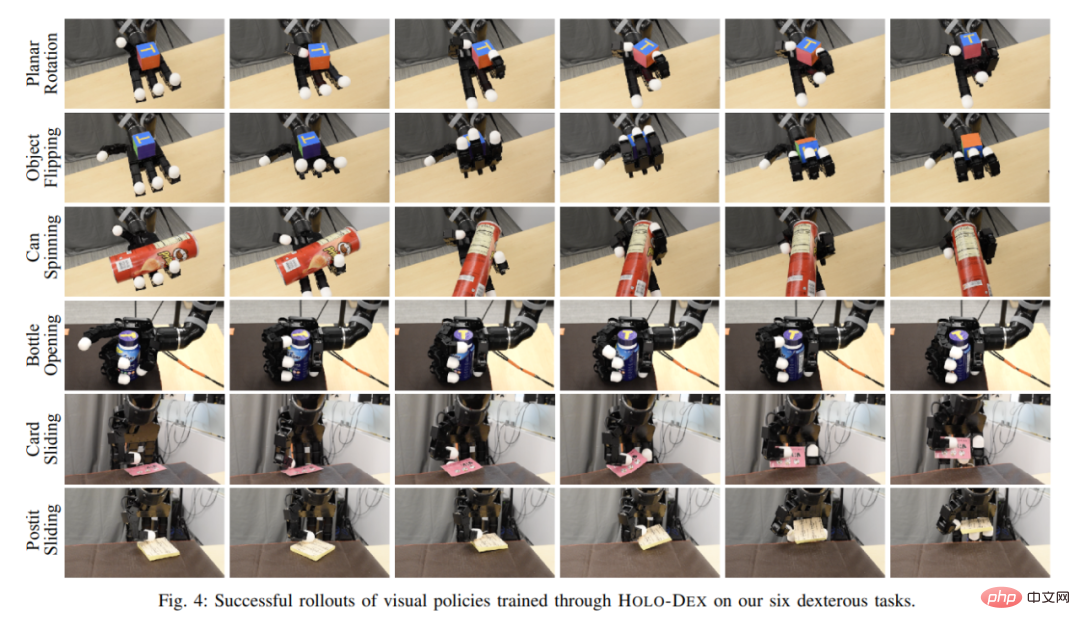

Pour évaluer les performances de HOLO-DEX, l'étude a mené des expériences sur six tâches nécessitant une opération adroite, y compris des objets portatifs, dévisser les bouchons des bouteilles. , etc. d'une seule main. L'étude a révélé que les enseignants humains utilisant HOLO-DEX étaient 1,8 fois plus rapides que les travaux antérieurs sur la téléopération à image unique (téléopération). Sur 4/6 tâches, le taux de réussite de la stratégie d'apprentissage HOLO-DEX dépasse les 90%. De plus, l’étude a révélé que les stratégies adroites apprises grâce à HOLO-DEX peuvent se généraliser à de nouveaux objets cibles invisibles.

Dans l'ensemble, les contributions de cette étude comprennent :

- Fournit une méthode permettant aux enseignants humains d'obtenir une téléopération de haute qualité en réalité mixte à l'aide de casques VR

- Les expériences montrent que les démonstrations collectées par HOLO-DEX peuvent être utilisées pour entraîner des comportements d'opération adroits efficaces et polyvalents ;

- L'étude a également mené des expériences d'analyse et d'ablation sur diverses décisions de la méthode proposée pour vérifier l'utilité de chaque conception clé.

De plus, l'API de réalité mixte, les démonstrations de collections de recherche et le code de formation lié à HOLO-DEX ont été open source : https://holo-dex.github.io/

Aperçu de l'architecture HOLO-DEX

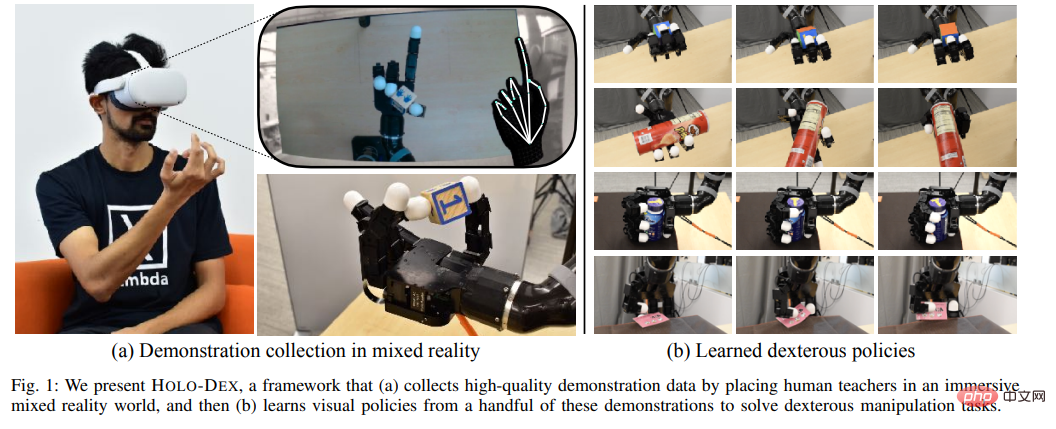

Comme le montre la figure 1 ci-dessous, HOLO-DEX fonctionne en deux étapes. Dans la première phase, un enseignant humain utilise un casque de réalité virtuelle (VR) pour faire une démonstration au robot. Cette étape comprend la création d'un monde virtuel pour l'enseignement, l'estimation de la posture de la main de l'enseignant, le déplacement de la posture de la main de l'enseignant vers la main du robot et enfin le contrôle de la main du robot. Après avoir collecté quelques démonstrations dans la première phase, la deuxième phase de HOLO-DEX apprend des stratégies visuelles pour résoudre les tâches démontrées.

L'étude a placé des enseignants humains dans un monde virtuel à l'aide d'un casque Meta Quest 2 VR avec une résolution de 1832 × 1920 et un taux de rafraîchissement de 72 Hz. La version de base du casque coûte 399 $ et est relativement légère (503 grammes), ce qui rend les présentations plus faciles et plus confortables pour les enseignants. De plus, l'interface API de Quest 2 permet la création de mondes de réalité mixte personnalisés qui visualisent des systèmes robotiques ainsi que des panneaux de diagnostic en VR.

Utiliser des casques VR pour estimer les poses des mains

Par rapport aux travaux antérieurs sur la téléopération adroite, l'utilisation de casques VR présente trois avantages dans l'estimation des poses des mains pour les enseignants humains. Premièrement, puisque Quest 2 utilise 4 caméras monochromes, son estimateur de gestes est beaucoup plus puissant que l'estimateur à caméra unique. Deuxièmement, étant donné que les caméras sont étalonnées en interne, elles ne nécessitent pas les procédures d’étalonnage spécialisées requises dans les précédents cadres de téléopération multi-caméras. Troisièmement, puisque l’estimateur de pose de la main est intégré à l’appareil, il est capable de transmettre des poses en temps réel à 72 Hz. Des recherches antérieures ont souligné qu'un défi majeur dans la téléopération adroite consiste à acquérir des postures de main avec une précision et une fréquence élevées. HOLO-DEX simplifie considérablement ce problème en utilisant un casque VR de qualité commerciale.

Retargeting de la pose de la main

Ensuite, la pose de la main de l'enseignant extraite de la réalité virtuelle doit être reciblée sur la main du robot. Il s'agit d'abord de calculer les angles de chaque articulation de la main de l'enseignant, puis une méthode de réorientation directe consiste à « commander » aux articulations du robot de se déplacer vers les angles correspondants. Cette méthode a fonctionné pour tous les doigts de l'étude, à l'exception du pouce, mais la forme de la main robotique Allegro ne correspond pas exactement à celle des humains, donc la méthode ne fonctionne pas entièrement avec le pouce.

Pour résoudre ce problème, cette étude mappe les coordonnées spatiales de la pointe du pouce de l'enseignant à la pointe du pouce du robot, puis calcule l'angle de l'articulation du pouce grâce à un solveur cinématique inverse. Il convient de noter que puisque le manipulateur Allegro n’a pas de petit doigt, l’étude a ignoré l’angle du petit doigt de l’enseignant.

L'ensemble du processus de redirection de posture ne nécessite aucun calibrage ni ajustement spécifique à l'enseignant pour collecter des démos. Mais l'étude a révélé que la redirection du pouce pourrait être améliorée en trouvant une cartographie spécifique entre le pouce de l'enseignant et celui du robot. L’ensemble du processus est peu coûteux en termes de calcul et peut transmettre la pose souhaitée de la main du robot à 60 Hz.

Robot Hand Control

Allegro Hand effectue un contrôle asynchrone via le cadre de communication ROS. Compte tenu des positions des articulations des mains du robot calculées par le programme de réorientation, cette étude utilise un contrôleur PD pour produire le couple requis à 300 Hz. Pour réduire l'erreur en régime permanent, cette étude utilise un module de compensation gravitationnelle pour calculer le couple de décalage. Lors des tests de latence, l'étude a révélé qu'une latence inférieure à 100 millisecondes était obtenue lorsque le casque VR était sur le même réseau local que la main robotique. Une faible latence et de faibles taux d’erreur sont essentiels pour HOLO-DEX, car ils permettent une téléopération intuitive de la main robotique par un enseignant humain.

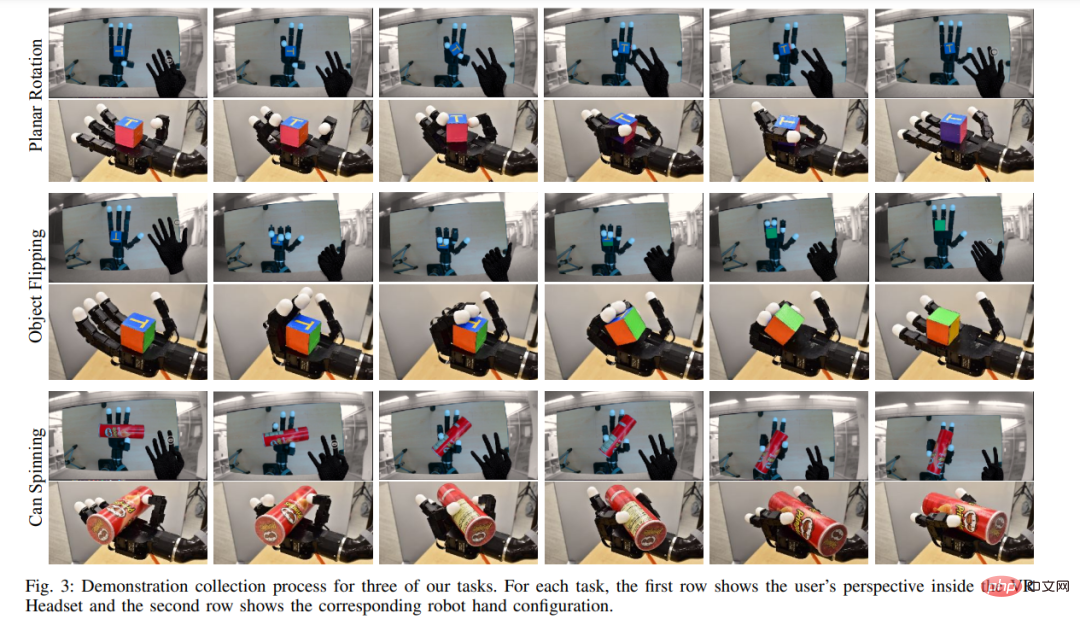

Lorsque les enseignants humains contrôlent la main du robot, ils peuvent voir les changements du robot en temps réel (60 Hz). Cela permet à l'enseignant de corriger les erreurs d'exécution de la main du robot. Au cours du processus d'enseignement, l'étude a enregistré les données d'observation de trois caméras RGBD et les informations de mouvement du robot à une fréquence de 5 Hz. L'étude a dû réduire la fréquence d'enregistrement en raison de l'empreinte de données importante et de la bande passante associée requise pour enregistrer plusieurs caméras.

Utilisez les données HOLO-DEX pour l'apprentissage par imitation

Après la collecte des données, HOLO-DEX doit entraîner la stratégie visuelle sur les données. Cette étude adopte l'algorithme d'imitation du plus proche voisin (INN) pour l'apprentissage. Dans des travaux antérieurs, il a été démontré que INN produisait des politiques étatiques intelligentes sur Allegro. HOLO-DEX va plus loin et démontre que ces stratégies visuelles se généralisent à de nouveaux objets dans une variété de tâches de manipulation adroites.

Afin de choisir l'algorithme d'apprentissage pour obtenir des intégrations de faible dimension, cette étude a essayé plusieurs algorithmes d'apprentissage auto-supervisés de pointe et a constaté que BYOL fournissait les meilleurs résultats de voisin le plus proche, donc BYOL a été sélectionné comme la méthode d’apprentissage auto-supervisée de base.

Résultats expérimentaux

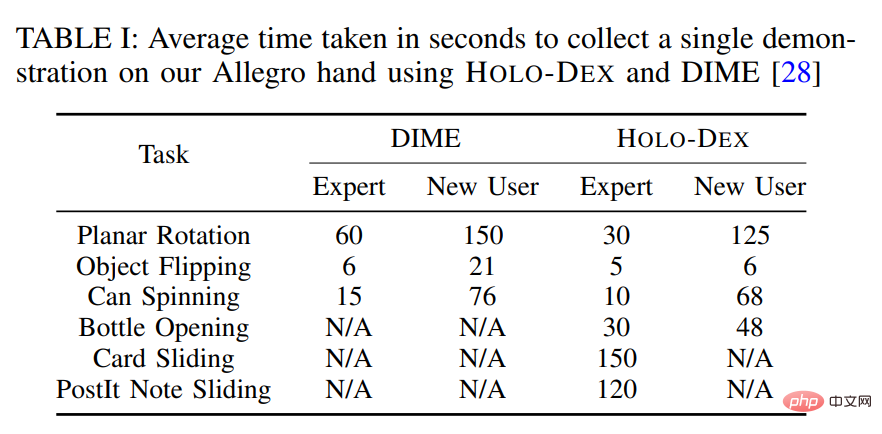

Le tableau 1 ci-dessous montre que HOLO-DEX collecte les démos réussies 1,8 fois plus rapidement que DIME. Pour 3 tâches sur 6 nécessitant un mouvement 3D précis, l’étude a révélé que la téléopération sur une seule image n’était même pas suffisante pour collecter une seule démonstration.

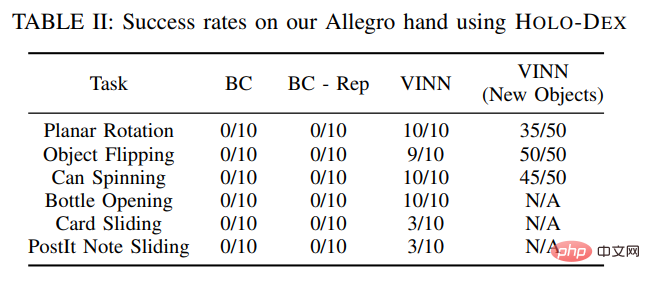

Cette étude a examiné la performance de diverses stratégies d'apprentissage par imitation sur des tâches de dextérité. Les taux de réussite de chaque tâche selon différentes stratégies sont présentés dans le tableau 2 ci-dessous.

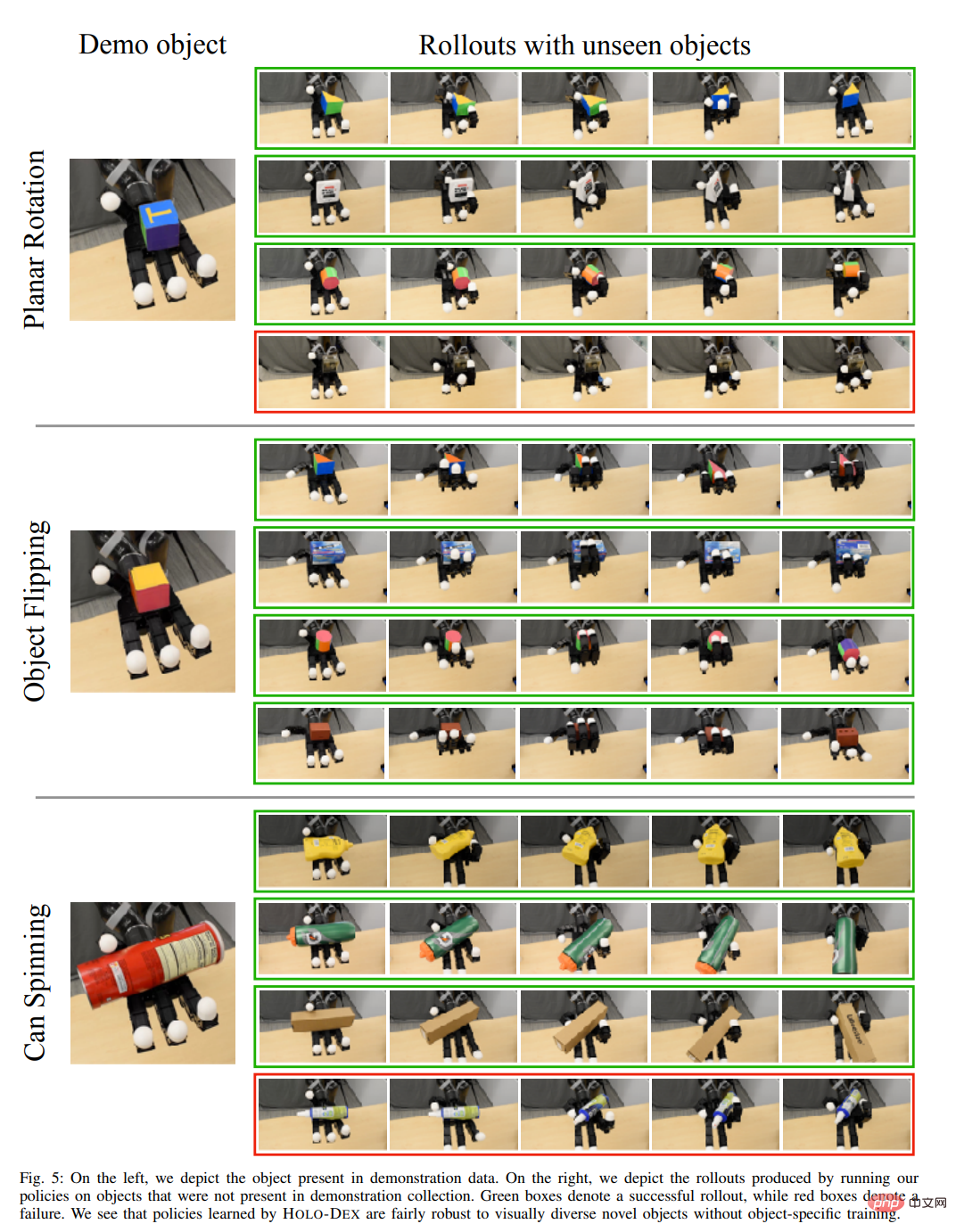

Étant donné que les stratégies proposées dans cette étude sont basées sur la vision et ne nécessitent pas d'estimation explicite de l'état de l'objet, elles sont compatibles avec les objets invisibles en formation. L'étude a évalué ses stratégies de manipulation manuelle qui ont été entraînées pour effectuer des tâches de rotation de plan, de retournement d'objet et de rotation de canettes sur des objets ayant diverses apparences visuelles et géométries, comme le montre la figure 5 ci-dessous.

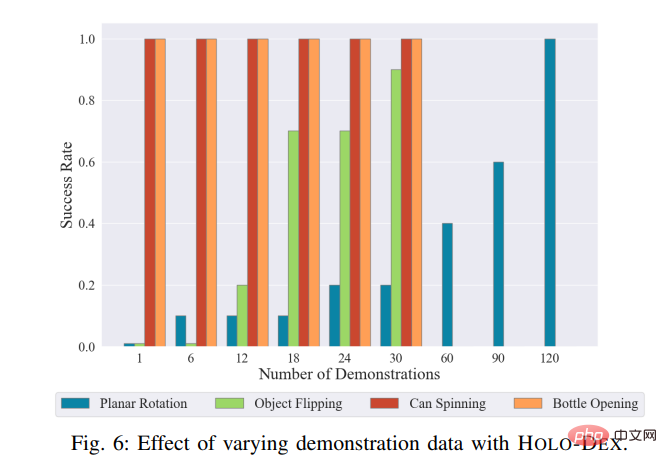

De plus, l'étude a également testé les performances de HOLO-DEX sur des ensembles de données de différentes tailles pour différentes tâches, et les résultats de visualisation sont présentés dans la figure ci-dessous.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

Video Face Swap

Échangez les visages dans n'importe quelle vidéo sans effort grâce à notre outil d'échange de visage AI entièrement gratuit !

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Sujets chauds

L'Ameca deuxième génération est là ! Il peut communiquer couramment avec le public, ses expressions faciales sont plus réalistes et il peut parler des dizaines de langues.

Mar 04, 2024 am 09:10 AM

L'Ameca deuxième génération est là ! Il peut communiquer couramment avec le public, ses expressions faciales sont plus réalistes et il peut parler des dizaines de langues.

Mar 04, 2024 am 09:10 AM

Le robot humanoïde Ameca est passé à la deuxième génération ! Récemment, lors de la Conférence mondiale sur les communications mobiles MWC2024, le robot le plus avancé au monde, Ameca, est à nouveau apparu. Autour du site, Ameca a attiré un grand nombre de spectateurs. Avec la bénédiction de GPT-4, Ameca peut répondre à divers problèmes en temps réel. "Allons danser." Lorsqu'on lui a demandé si elle avait des émotions, Ameca a répondu avec une série d'expressions faciales très réalistes. Il y a quelques jours à peine, EngineeredArts, la société britannique de robotique derrière Ameca, vient de présenter les derniers résultats de développement de l'équipe. Dans la vidéo, le robot Ameca a des capacités visuelles et peut voir et décrire toute la pièce et des objets spécifiques. Le plus étonnant, c'est qu'elle peut aussi

Comment l'IA peut-elle rendre les robots plus autonomes et adaptables ?

Jun 03, 2024 pm 07:18 PM

Comment l'IA peut-elle rendre les robots plus autonomes et adaptables ?

Jun 03, 2024 pm 07:18 PM

Dans le domaine de la technologie de l’automatisation industrielle, il existe deux points chauds récents qu’il est difficile d’ignorer : l’intelligence artificielle (IA) et Nvidia. Ne changez pas le sens du contenu original, affinez le contenu, réécrivez le contenu, ne continuez pas : « Non seulement cela, les deux sont étroitement liés, car Nvidia ne se limite pas à son unité de traitement graphique d'origine (GPU ), il étend son GPU. La technologie s'étend au domaine des jumeaux numériques et est étroitement liée aux technologies émergentes d'IA "Récemment, NVIDIA a conclu une coopération avec de nombreuses entreprises industrielles, notamment des sociétés d'automatisation industrielle de premier plan telles qu'Aveva, Rockwell Automation, Siemens. et Schneider Electric, ainsi que Teradyne Robotics et ses sociétés MiR et Universal Robots. Récemment, Nvidiahascoll

Après 2 mois, le robot humanoïde Walker S peut plier les vêtements

Apr 03, 2024 am 08:01 AM

Après 2 mois, le robot humanoïde Walker S peut plier les vêtements

Apr 03, 2024 am 08:01 AM

Rédacteur en chef du Machine Power Report : Wu Xin La version domestique de l'équipe robot humanoïde + grand modèle a accompli pour la première fois la tâche d'exploitation de matériaux flexibles complexes tels que le pliage de vêtements. Avec le dévoilement de Figure01, qui intègre le grand modèle multimodal d'OpenAI, les progrès connexes des pairs nationaux ont attiré l'attention. Hier encore, UBTECH, le « stock numéro un de robots humanoïdes » en Chine, a publié la première démo du robot humanoïde WalkerS, profondément intégré au grand modèle de Baidu Wenxin, présentant de nouvelles fonctionnalités intéressantes. Maintenant, WalkerS, bénéficiant des capacités de grands modèles de Baidu Wenxin, ressemble à ceci. Comme la figure 01, WalkerS ne se déplace pas, mais se tient derrière un bureau pour accomplir une série de tâches. Il peut suivre les commandes humaines et plier les vêtements

Le premier robot capable d'accomplir de manière autonome des tâches humaines apparaît, avec cinq doigts flexibles et rapides, et de grands modèles prennent en charge l'entraînement dans l'espace virtuel

Mar 11, 2024 pm 12:10 PM

Le premier robot capable d'accomplir de manière autonome des tâches humaines apparaît, avec cinq doigts flexibles et rapides, et de grands modèles prennent en charge l'entraînement dans l'espace virtuel

Mar 11, 2024 pm 12:10 PM

Cette semaine, FigureAI, une entreprise de robotique investie par OpenAI, Microsoft, Bezos et Nvidia, a annoncé avoir reçu près de 700 millions de dollars de financement et prévoit de développer un robot humanoïde capable de marcher de manière autonome au cours de la prochaine année. Et l’Optimus Prime de Tesla a reçu à plusieurs reprises de bonnes nouvelles. Personne ne doute que cette année sera celle de l’explosion des robots humanoïdes. SanctuaryAI, une entreprise canadienne de robotique, a récemment lancé un nouveau robot humanoïde, Phoenix. Les responsables affirment qu’il peut accomplir de nombreuses tâches de manière autonome, à la même vitesse que les humains. Pheonix, le premier robot au monde capable d'accomplir des tâches de manière autonome à la vitesse d'un humain, peut saisir, déplacer et placer avec élégance chaque objet sur ses côtés gauche et droit. Il peut identifier des objets de manière autonome

Le robot de balayage et de nettoyage Cloud Whale Xiaoyao 001 a un « cerveau » ! Expérience |

Apr 26, 2024 pm 04:22 PM

Le robot de balayage et de nettoyage Cloud Whale Xiaoyao 001 a un « cerveau » ! Expérience |

Apr 26, 2024 pm 04:22 PM

Les robots de balayage et de nettoyage sont l’un des appareils électroménagers intelligents les plus populaires auprès des consommateurs ces dernières années. La commodité d'utilisation qu'il apporte, voire l'absence d'opération, permet aux paresseux de libérer leurs mains, permettant aux consommateurs de « se libérer » des tâches ménagères quotidiennes et de consacrer plus de temps à ce qu'ils aiment. Une qualité de vie améliorée sous une forme déguisée. Surfant sur cet engouement, presque toutes les marques d'électroménager du marché fabriquent leurs propres robots de balayage et de nettoyage, rendant l'ensemble du marché des robots de balayage et de nettoyage très vivant. Cependant, l'expansion rapide du marché entraînera inévitablement un danger caché : de nombreux fabricants utiliseront la tactique de la mer de machines pour occuper rapidement plus de parts de marché, ce qui entraînera de nombreux nouveaux produits sans aucun point de mise à niveau. ce sont des modèles de "matriochka". Ce n'est pas une exagération. Cependant, tous les robots de balayage et de nettoyage ne sont pas

Le robot humanoïde peut faire de la magie, laissez l'équipe du programme du Gala de la Fête du Printemps en savoir plus

Feb 04, 2024 am 09:03 AM

Le robot humanoïde peut faire de la magie, laissez l'équipe du programme du Gala de la Fête du Printemps en savoir plus

Feb 04, 2024 am 09:03 AM

En un clin d’œil, les robots ont appris à faire de la magie ? On a vu qu'il avait d'abord ramassé la cuillère à eau sur la table, prouvant au public qu'il n'y avait rien dedans... Ensuite, il a mis l'objet en forme d'œuf dans sa main, puis a remis la cuillère à eau sur la table. et a commencé à « jeter un sort »... … Juste au moment où il a repris la cuillère à eau, un miracle s'est produit. L'œuf qui avait été initialement mis dedans a disparu et la chose qui a sauté s'est transformée en ballon de basket... Regardons à nouveau les actions continues : △ Cette animation montre un ensemble d'actions à une vitesse 2x, et cela se déroule sans problème uniquement en regardant. la vidéo à plusieurs reprises à une vitesse de 0,5x peut-elle être comprise. Finalement, j'ai découvert les indices : si la vitesse de ma main était plus rapide, je pourrais peut-être la cacher à l'ennemi. Certains internautes ont déploré que les compétences magiques du robot soient encore supérieures aux leurs : c'est Mag qui a réalisé cette magie pour nous.

Mar 22, 2024 pm 08:51 PM

Mar 22, 2024 pm 08:51 PM

Les 10 robots humanoïdes suivants façonnent notre avenir : 1. ASIMO : Développé par Honda, ASIMO est l'un des robots humanoïdes les plus connus. Mesurant 4 pieds de haut et pesant 119 livres, ASIMO est équipé de capteurs avancés et de capacités d'intelligence artificielle qui lui permettent de naviguer dans des environnements complexes et d'interagir avec les humains. La polyvalence d'ASIMO le rend adapté à une variété de tâches, allant de l'assistance aux personnes handicapées à la réalisation de présentations lors d'événements. 2. Pepper : Créé par Softbank Robotics, Pepper vise à être un compagnon social pour les humains. Avec son visage expressif et sa capacité à reconnaître les émotions, Pepper peut participer à des conversations, aider dans les commerces de détail et même fournir un soutien pédagogique. Poivrons

L'IoT robotique est-il l'avenir de l'industrie manufacturière ?

Mar 01, 2024 pm 06:10 PM

L'IoT robotique est-il l'avenir de l'industrie manufacturière ?

Mar 01, 2024 pm 06:10 PM

L'IoT robotique est un développement émergent qui promet de rassembler deux technologies précieuses : les robots industriels et les capteurs IoT. L'Internet des objets robotiques deviendra-t-il courant dans le secteur manufacturier ? Qu'est-ce que l'Internet des objets robotiques (IoRT) est une forme de réseau qui connecte les robots à Internet. Ces robots utilisent des capteurs IoT pour collecter des données et interpréter leur environnement. Ils sont souvent associés à diverses technologies telles que l’intelligence artificielle et le cloud computing pour accélérer le traitement des données et optimiser l’utilisation des ressources. Le développement de l’IoRT permet aux robots de détecter et de réagir plus intelligemment aux changements environnementaux, apportant ainsi des solutions plus efficaces à diverses industries. En s'intégrant à la technologie IoT, l'IoRT peut non seulement réaliser un fonctionnement autonome et un auto-apprentissage, mais également